到 2026 年,一張靜態照片鮮少是故事的終點。它現在充當著電影的開場鏡頭。攝影與電影之間的界限已經消失。這種轉變改變了從我們如何記錄歷史到我們如何行銷產品和製作電影的一切。

就在幾年前,AI 影片工具製作的片段模糊且僅持續數秒。現在,圖生影片(Image-to-Video)技術已成為專業工作的強大工具。將平面圖像轉化為流暢、高品質的動態影像,是我們這個時代最大的創意飛躍。

2026 年,挑選 I2V 工具的標準非常高。這些工具需要在以下三個關鍵領域表現卓越才具備競爭力:

- 4K AI 影片生成: 專業人士現在要求所有項目都具備原生 4K 甚至 8K 升頻能力。

- AI 影片中的時序一致性(Temporal Coherence): 視覺效果和紋理從片段開始到結束必須保持穩定和紮實。

- 角色一致性 AI(或稱「身份鎖定」): 角色在每個鏡頭中必須保持相同的面孔和衣服。新的 AI 影片物理引擎 使這成為可能。

重磅登場:前 10 名工具排名

各工具的詳細解析,包括「最適合」標籤、優缺點及定價。

| 排名 | 工具名稱 | 關鍵賣點(2026 版) | 最適合... |

| 1 | Kling 3.0 | 無與倫比的物理模擬和多鏡頭一致性。 | 電影級寫實感 |

| 2 | OpenAI Sora 2 | 敘事深度和迪士尼授權的角色包。 | 故事講述 |

| 3 | Runway Gen-4.5 | 專業級「運動筆刷」和時間軸 VFX 控制。 | 創意總監 |

| 4 | Google Veo 3.1 | 原生 4K 且與 Google Nano 無縫整合。 | 高端製作 |

| 5 | Luma Dream Machine | 最快的「一鍵式」高保真渲染。 | 快速原型製作 |

| 6 | Seedance 2.0 | 最佳多模態輸入(圖像 + 影片 + 音訊)。 | 多媒體創作者 |

| 7 | Pika Labs (Pro) | 一流的對嘴(Lip Sync)和在地化音效。 | 社群媒體/迷因 |

| 8 | Wan 2.2 Spicy | 高能量動態和不受限的創意自由。 | 病毒式/實驗性內容 |

| 9 | Haiper 2.5 | 高風格化藝術濾鏡和光影控制。 | 美學/氛圍內容 |

| 10 | Wan 2.6 | 適用於本地 RTX 生成的開源強大工具。 | 隱私/進階用戶 |

深度解析:為什麼這些工具在 2026 年脫穎而出

2026 年之所以成為重大轉折點,是因為這些模型發生了變化。它們不再只是複製簡單的模式,而是模擬真實世界。我們不再只是「製造像素」;我們正在構建現實。

從「扭曲」到「世界物理」

今年最大的突破是 AI 物理引擎。回溯到 2024 年,如果你要求 AI 倒水,畫面可能看起來很混亂——液體可能會滲出玻璃杯或變成沙子。到 2026 年,AI 終於理解了現實世界的運作方式。

- 趨勢: 模型不再只是「像素變形」或在兩點之間進行插值。相反,它們模擬重量、動量、摩擦力和重力。當一個角色在 Runway Gen-4.5 中坐在沙發上時,坐墊會根據角色的感知質量真實地壓縮。

- 首選: Runway Gen-4.5 目前在物體碰撞和反彈方面處於領先地位。與此同時,Kling AI 3.0 則完美掌握了液體的流動方式。無論是奔騰的河流還是噴出的煙霧,這些元素不再只是「模糊」或消失,而是遵循真實的自然規律。

Runway Gen-4.5 vs. Kling AI 3.0 概覽

| 功能 | Runway Gen-4.5 | Kling AI 3.0 |

| 主要物理優勢 | 剛體動力學:多物體碰撞和真實重量模擬(如織物壓縮)的行業領先者。 | 流體與體積動力學:液體、煙霧和大氣效果(如湍急的河流)具有無與倫比的寫實感。 |

| 最高解析度 | 原生 4K 搭配 8K AI 升頻(超高位元率)。 | 原生超高清(60fps 電影級輸出)。 |

| 核心架構 | 具有集成 3D 空間意識的專有「世界模擬」引擎。 | 具備原生高保真視聽同步功能的「全方位潛在(Omni-Latent)」擴散模型。 |

| 部署與 API | 閉環(封閉花園):主要僅透過 Runway 網頁/App 訪問。為企業合作夥伴提供有限的 Studio API。 | 開放訪問 / Atlas Cloud:可透過官方網頁門戶和高併發的 Atlas Cloud API 取得。 |

| 角色一致性 | 使用帶有 3D 幾何映射的「身份鎖定(Identity Lock)」來維持一致的面部特徵。 | 使用「All-in-One Reference 3.0」進行多圖像角色和道具錨定。 |

| 價格範圍 | 標準版:$95/月(標準 4K) 專業版:$250/月(無限「導演模式」) | 標準版:$80/月(網頁界面) 企業 API:透過 Atlas Cloud 分層定價(每次渲染 $0.50 - $1.20)。 |

身份鎖定(角色一致性)

多年來,創作者的痛點一直是「角色偏移(character drift)」——每當鏡頭移動時,角色的臉部都會發生細微變化。這使得專業的故事講述幾乎不可能實現。

- 趨勢: 我們已從生成「一次性片段」轉向創建「分鏡腳本級資產」。現代工具在神經架構中使用專門的「身份區塊」來鎖定臉部幾何形狀。

- 領先案例: OpenAI Sora 2 擁有專有的「身份鎖定」功能,可在數千幀中保持角色肖像。在開源方面,Wan 2.2 Spicy(Wan 架構的不受限、高動態變體)支持進階 LoRA(低秩適配)訓練。這允許用戶對特定人物或產品進行一次模型訓練,然後將其部署到任何電影環境中,並保持 100% 的一致性。

OpenAI Sora 2 vs. Wan 2.2 Spicy 概覽

| 功能 | OpenAI Sora 2 | Wan 2.2 Spicy |

| 身份技術 | 「Cameo」系統:一種專有的「視覺 DNA」鎖,將角色幾何形狀存儲在雲端。 | 進階 LoRA 訓練:原生支持低秩適配,將身份「烘焙」到模型權重中。 |

| 一致性水平 | 高 (90-95%):出色的相似度,但在極端光線或複雜角度下可能會發生輕微「偏移」。 | 絕對 (99%+):達到「數位孿生」狀態;即使在高動態序列中,相似度也保持完美。 |

| 工作流風格 | 提示詞調用:使用指令(如「返回相同的 Cameo 顧問」)來延續身份。 | 基於訓練:生成前需要 15–30 張圖像/片段的數據集來訓練自定義權重文件。 |

| API 獲取 | OpenAI 官方 API:具有嚴格速率限制和分層訪問(Tier 2+)的託管服務。 | Atlas Cloud API:開放權重部署,原生支持部署自定義 LoRA 文件。 |

| 價格範圍 | 標準版:$0.10 - $0.30 /秒輸出。 專業版 (1024p):$0.50 /秒(每 10 秒影片 $5.00)。 | 企業 API:透過 Atlas Cloud 每秒 $0.03 - $0.3。 |

原生多模態合成(音訊 + 影片)

在 2026 年,「無聲」AI 影片被認為是過時的。行業已轉向 **零樣本圖生影片 (Zero-Shot Image to Video)**,其中包括在同一次推理中生成的同步音訊層。

- 進展: 影片工具現在可以同時創建音效、背景噪音,甚至對嘴。這減少了約 70% 的繁重後期製作工作。

- 領先案例: Google Veo 3.1 和 Wan 2.6 在這一領域領先。它們的原生音訊引擎不只是「猜測」聲音,而是分析運動向量。如果 AI 看到腳踩在礫石上,它會生成該衝擊特有的碎裂聲。如果它看到窗戶打開,它會生成環境風的吹拂聲。

Google Veo 3.1 與 Wan 2.6 概覽

| 功能 | Google Veo 3.1 | Wan 2.6 |

| 音訊邏輯 | 環境感知:分析場景上下文以生成 3D 空間音效和背景音樂。 | 人聲優先:一流的對嘴功能,並可透過 5 秒參考影片進行「聲音克隆」。 |

| 最高品質 | 原生 4K 搭配頂尖升頻技術;廣播級位元率。 | 原生 1080p(可增強至超高清);針對真實物理和「固體」物體進行了優化。 |

| 影片時長 | 8–10 秒(可透過「場景延伸」技術擴展)。 | 長達 15 秒(穩定、高動態輸出)。 |

| 官方訪問 | Google Vertex AI、Gemini API 和 Google AI Studio。 | 阿里雲(通義)、Dzine 和開源模型庫。 |

| 官方定價 | 官方定價:$0.15/秒 - $0.75/秒。 企業 API:透過 Atlas Cloud 每秒 $0.09 - $0.2。 | 官方定價:$0.07 - $0.18 /秒 企業 API:透過 Atlas Cloud 每秒 $0.018 - $0.07。 |

實踐指南:如何從圖像生成電影級影片

要用好這些工具,請停止「描述場景」,開始「導演」場景。以下是 2026 年 I2V 提示詞的運作方式。

專業提示詞結構

一個專業的 I2V 提示詞包含四個主要部分:

- 參考 (Reference): 你上傳的圖像。

- 運動向量 (Motion Vector): 鏡頭如何移動(推拉 Dolly、平移 Pan 或軌道 Orbit)。

- 物理動作 (Physical Action): 主體實際在做什麼。

- 時序細節 (Temporal Detail): 光線或環境的變化。

範例:使用 Runway Gen-4.5 進行產品拍攝

如果你有一張放在海邊岩石上的名貴手錶靜態照片:

提示詞範例:

"Reference: [Image_01]. Camera: Slow orbital pan 180-degrees. Action: Ocean waves crash against the rock, generating realistic sea spray and mist. Physics: Water droplets interact with the watch glass, beaded and rolling off the surface. Lighting: Golden hour sunset, light reflecting off the moving water. 4K, 60fps, cinematic realism."

範例:使用 Wan 2.6 進行敘事場景

如果你有一張角色肖像:

提示詞範例:

"Reference: [Character_Photo]. Action: The character turns to the camera and sighs. Audio: A soft breath mixed with distant city noise. SFX: The sound of a leather jacket moving. 4K, High Temporal Coherence."

法律與倫理環境

隨著我們進入 2026 年中期,AI 影片生成工具終於有了穩定的法律框架。2023–2024 年的「西部荒野」時期已經結束。現在,每位專業創作者都必須了解並遵守這些特定的合規標準。

2026 年的版權: 「人為參與」先例

在 2026 年 3 月 2 日的一項里程碑式裁決中,美國最高法院駁回了 Thaler v. Perlmutter 的調卷申請,有效維持了受版權保護的作品必須有「人類作者」的裁決(Baker Donelson, 2026)。

- 裁決: 你不能為僅由提示詞生成的原始影片申請版權。

- 策略: 為了在 2026 年主張所有權,專業人士使用「遞歸細化(Recursive Refinement)」。藉由記錄多步驟過程——從最初的零樣本圖生影片到手動幀繪畫以及特定的物理調整——創作者可以證明「實質性的創意控制」,從而使最終的電影傑作受到保護。

水印與透明度:SynthID 和 C2PA

透明度現在是一項要求。根據 2026 年全面實施的《歐盟 AI 法案》,所有 AI 媒體都必須是機器可讀的。這條規則有助於阻止深偽(deepfakes)的傳播(MEXC News, 2026)。

- SynthID: Google 的元數據級水印現在是 Veo 3.1 和 Nano Banana Pro 輸出的標準,即使在裁剪或壓縮後仍可被檢測到。

- C2PA 標準: 大多數 2026 年的工具現在都嵌入了「內容憑證(Content Credentials)」——這是一種類似數位營養標籤的東西,顯示使用了哪個模型(例如 OpenAI Sora 2 或 Kling AI 3.0)以及人類進行了哪些編輯。

基礎設施障礙:解決「4K 算力差距」

AI 影片軟體發展迅速,但 2026 年的硬體仍然滯後。製作具有真實物理效果(如水流或物體撞擊)的 4K 片段,對家用電腦來說非常吃力。這些工具需要標準顯示卡尚未具備的海量 VRAM。因此,對於大多數創作者來說,渲染長且高品質的場景仍然是一個主要挑戰。

多節點渲染的興起

對於專業創作者來說,「本地渲染」正在迅速消失。雲端編排(Cloud Orchestration)是行業的新標準。當一個項目需要 20 秒穩定的 4K 影片時,一台電腦是不夠的。相反,繁重的工作負載會被分配到一個強大的機器集群中。這種轉變使得生產更加快速且可靠。

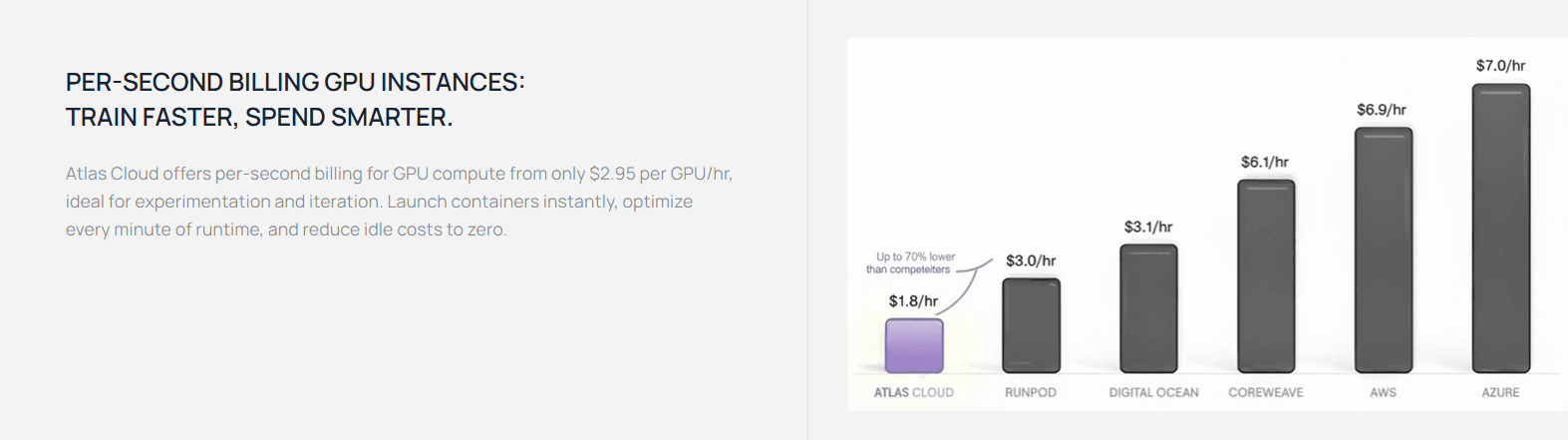

專業解決方案:Atlas Cloud

Atlas Cloud 目前是最新開放權重模型頂尖的「爆發渲染(Render Burst)」工具。它能與 Wan 2.6 和 Wan 2.2 Spicy 完美配合,解決家用設備常見的限制。透過使用強大的 NVIDIA B200 節點,Atlas 能將粗糙的本地預覽轉化為清晰、專業的影片。這是快速獲得工作室級品質結果的最佳方式。

- 速度優勢: 一段 15 秒的 4K 影片在快速的家用電腦上需要 90 分鐘。在 Atlas 上,同樣的渲染在不到 2 分鐘內即可完成。

- 吞吐量優勢: 在高端本地電腦上可能需要 90 分鐘的 15 秒 4K 渲染,在 Atlas 上僅需不到 2 分鐘 即可完成。

- 持續訓練: 與閉環網頁界面不同,Atlas 允許原生 LoRA(低秩適配)整合,這對於在整個系列中保持角色一致性 AI 至關重要。

- 實時代理: 他們的「即時預覽」功能允許遠程團隊在投入完整的 4K 渲染之前,實時查看低解析度的物理模擬。

編者註: 如果你在開源生態系統(Wan 或 Stable Video)中工作,將潛在過程卸載到像 Atlas 這樣的專門雲端環境已不再是可選項,而是實現無硬體偽影「身份鎖定」的基本要求。

Atlas Cloud 工作流:規模化部署

除了簡單部署外,專業工作流還需要一個預先配置的環境來處理專門的影片編解碼器和依賴項。

「Atlas 提供 DevPods,這是一些持久化的容器化環境。與裸機部署不同,工作室通常使用

來確保預加載所有自定義 CUDA 內核和 LoRA 權重,將『冷啟動』時間從幾分鐘縮短到幾秒鐘。」text1_atlas devpod create --image "wan-2.6-production-v1"_

用於批次渲染的彈性自動擴展

對於涉及數百個鏡頭的「爆發渲染」情境,單節點部署是不夠的。

「CLI 支持水平擴展組(Horizontal Scaling groups)。透過定義

,Atlas 編排器可以在 4K 渲染期間啟動一個由 8x H200 節點組成的集群,並在潛在擴散過程完成後自動關閉它們,從而優化成本支出(Opex)。」text1_scaling-policy.yaml_

分布式存儲與檢查點同步

高保真 4K 影片在去噪過程中會生成海量的臨時數據集。

「為了在多個節點之間保持『身份鎖定』,Atlas 利用了**全域命名空間存儲 (GNS)**。這確保了當 CLI 觸發渲染時,LoRA 檢查點和角色參考表會透過高速 InfiniBand 網路在所有活動 GPU 節點之間同步,防止在不同硬體上渲染的幀之間出現一致性偏移。」

用於生產的增強型 CLI 語法

一個生產就緒的指令通常包括輸出目的地和遙測標誌:

Bash

plaintext1# 增強型生產指令 2atlas deploy --model "alibaba/wan-2.6" \ 3 --gpu "h200-141gb" \ 4 --count 8 \ 5 --storage-mount "s3://studio-assets/project-alpha" \ 6 --webhook-url "https://api.studio.com/updates" \ 7 --priority "high-availability"

結論:你應該選擇哪一個?

如本指南所示,2026 年不再有一個「最好」的 AI 影片工具。相反,針對你的特定創意目標選擇正確的引擎至關重要。市場已經成熟,現在為不同的需求提供專門的工具。為了幫助你根據今年的預算挑選合適的訂閱方案,請使用下表查看每個模型的主要優勢。

| 如果你的優先考量是... | 選擇這個工具 | 原因 |

| 連貫的故事講述 | OpenAI Sora 2 | 在敘事邏輯和長篇(25秒+)片段方面領先。 |

| 物理與運動控制 | Runway Gen-4.5 | 頂級的物理準確性和對「導演語言」的遵循。 |

| 人物寫實與對嘴 | Kling AI 3.0 | 一流的面部微表情和原生對白同步。 |

| 行動優先內容 | Google Veo 3.1 | 原生 9:16 支持,並與 YouTube Shorts 深度整合。 |

| 電影級 4K 保真度 | Luma Dream Machine Ray 3 | 卓越的升頻技術和 16-bit HDR 光照管線。 |

| 商業安全的工作流 | Adobe Firefly Video | 完全授權的訓練數據和 C2PA 內容憑證。 |

| 開源實力 | Wan 2.6 / 2.2 Spicy | 適用於本地或 Atlas Cloud 部署的極高靈活性。 |

常見問題

我可以合法擁有我用 AI 生成的電影影片的版權嗎?

截至 2026 年 3 月,美國最高法院(維持 Thaler v. Perlmutter 的裁決)主張單純由 AI 生成的作品不能獲得版權,因為它們缺乏「人類作者」。然而,行業已轉向「人機協作(Human-in-the-Loop)」標準。

為了獲得知識產權(IP)保護,專業人士現在使用**「遞歸細化」。這涉及記錄多步驟的創意過程:使用你自己的攝影作品作為零樣本**來源,透過 Runway Gen-4.5 指導特定的鏡頭路徑,以及對角色一致性進行手動「重繪(inpainting)」。透過證明 AI 是一個「受控工具」而非自主創作者,你便確立了法律保護所需的人類署名權。

為什麼我的 4K 影片渲染在本地電腦上看起來有「破圖」?

生成具有真實物理效果的 4K AI 影片(如 Kling 3.0 中的流體動力學)需要海量的 VRAM——通常超過標準消費級顯示卡上的 24GB。如果你的影片出現「融化」或「重影」,你的硬體可能遇到了記憶體瓶頸。

在 2026 年,專業的解決方案是 雲端 GPU 編排,例如 Atlas Cloud。這些平台允許你將渲染任務「爆發」到高效能的 NVIDIA B200 集群。透過將沉重的工作卸載到雲端,你可以獲得 10 倍的生成速度,並保持本地硬體在 4K 解析度下無法處理的完美時序一致性。

如何在不同場景中保持「身份鎖定」?

在 2026 年,保持角色外貌一致不再是奢侈品,而是基本規則。你現在可以透過兩種主要方式在工作流中處理此問題:

- 封閉模型 (Sora 2 / Veo 3.1): 這些工具使用「身份區塊(Identity Blocks)」。你只需上傳自己的照片或影片,AI 就會構建一個在超過 60 秒的影片中保持不變的數位「演員」。

- 開源模型 (Wan 2.2 Spicy / Wan 2.6): 這些模型使用 LoRA 訓練。你可以針對特定角色訓練一個微小的 100MB 文件並將其插件化。對於需要對整部電影的角色進行全面控制的電影製作人來說,這是首選。