早期的 AI 動態工具充斥著破圖和人體畸形。 🫠

最大的缺陷?彆扭的手部、毫無面部表情,以及像橡皮筋一樣拉伸的身體。

可靈 Kling 2.6 登場。 它徹底解決了動態控制問題:

1️⃣ 細節清晰: 完美的指尖與微表情。不再模糊。

2️⃣ 人體結構鎖定: 智能骨骼系統保持身體比例 100% 一致。不再扭曲。

我們進行了 4 項極端「嚴酷測試」 來證明這一點。結果令人驚嘆。 👇

01 數據說話:讓競爭對手望塵莫及

看完簡介後,你可能會問:「市面上有很多支援影片參考的模型。萬象 (Wan) 的動態控制也很紮實。那憑什麼說可靈 Kling 2.6 領先好幾個量級?」

請看下方的對比影片,答案顯而易見 👇:

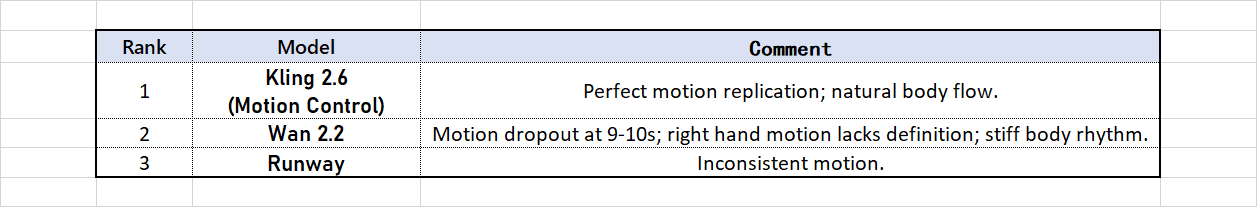

[分析拆解] 這段受拳擊啟發的舞蹈動作呈現了一個重大的壓力測試:快速的手臂揮舞結合軀幹的節奏律動。

可靈 Kling 2.6 動態控制展現了教科書級的表現。 看看 0:09 處 的繞手動作:可靈不僅完美地複製了軌跡,還捕捉到了動能——你可以感覺到動量是從肩部肌肉發出的。它在保持絕對結構完整性的同時,最大化了節奏忠實度,沒有任何扭曲或塌陷。

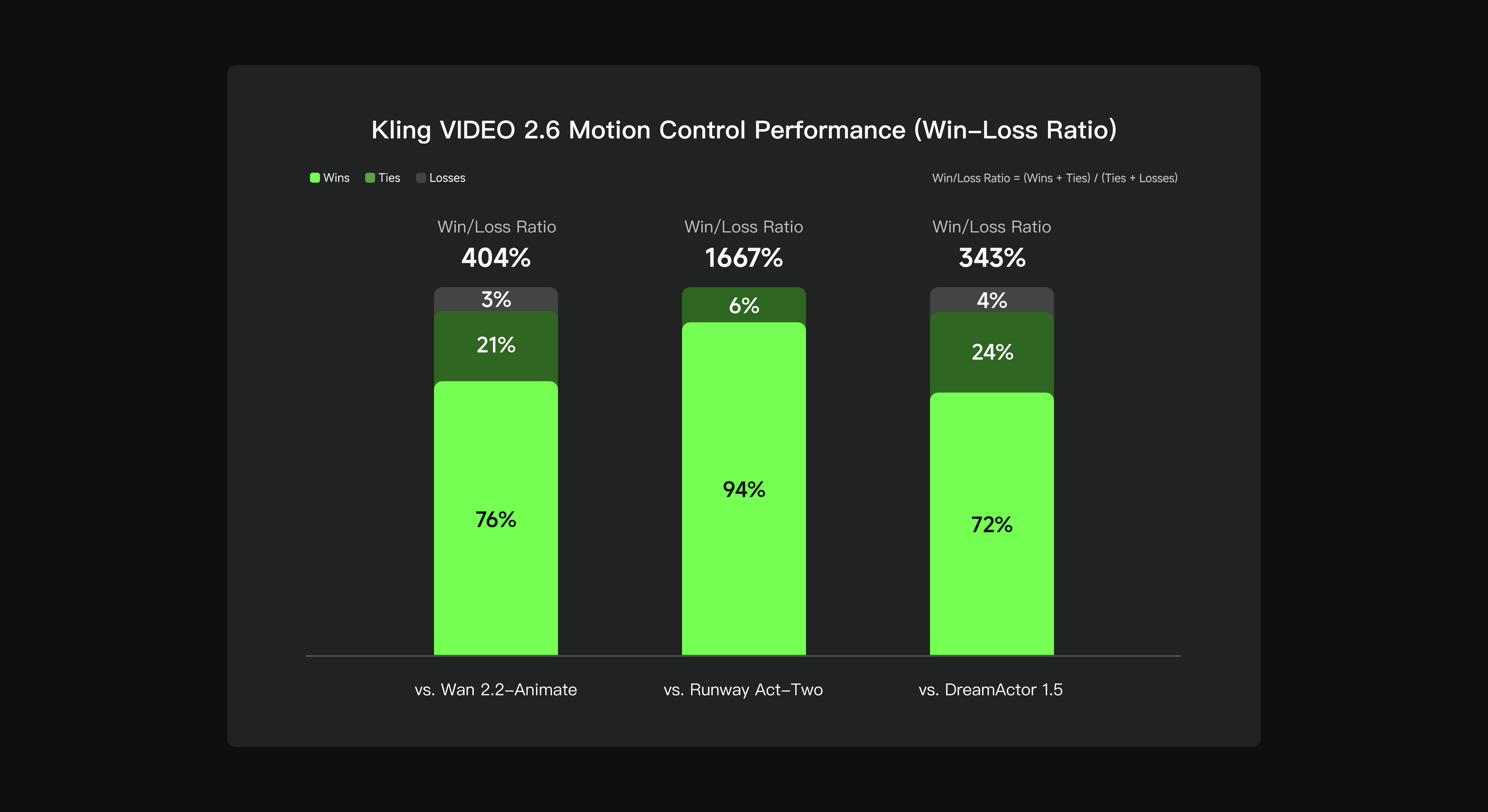

現在,如果你認為那段 Kobe 影片只是個巧合——或者我們只是運氣好「挑選」了一個完美的種子值——請看看這張官方盲測圖表。數據會說話。

邏輯很簡單:綠色代表可靈獲勝,深綠色是平局,而頂部那一小塊灰色?那是它唯一輸掉的地方。

看看左側對抗 萬象 Wan 2.2 的表現。萬象是一個強勁的對手,這就是為什麼你會看到較多的深綠色(約 21% 的平局)。但即便如此,可靈仍以 76% 的驚人勝率佔據統治地位。

至於中間的 Runway?可靈的勝率飆升至 94%。這簡直是壓倒性的勝利。這與我們在測試過程中的感受完全一致:在動作範圍和精確度方面,Runway 已經被遠遠甩在後頭。

02 深度分析:解決 5 大瓶頸

以往,AI 影片控制高度依賴動態筆刷 (Motion Brush) 和提示詞。這需要手動遮罩並繪製方向箭頭——這是一個繁瑣的過程,且僅限於基礎的平移或抖動效果。隨後出現了「影片參考」方法,但它們往往難以在提示詞遵循與精確動作複製之間取得平衡。

可靈 Kling 2.6 通過影片對影片 (Video-to-Video) 背景下的深度語義映射克服了這一障礙。 這個概念非常優雅:你提供靜態圖像(視覺身份)和一個參考影片(動作靈魂)。

這實際上就像為你的角色穿上了一件隱形的動態捕捉 (MoCap) 服。入門門檻消失了——不需要昂貴的攝影棚設備;用智慧型手機隨手拍的影片就能完美運作。

完美的動作同步、表情與對嘴

精湛的複雜動作表現

手部表演的精確度

30 秒長鏡頭動作

場景細節盡在掌控

03 零門檻:每個人的算力自由

看到這些巨大的升級後,你可能會感到既興奮又焦慮:「要實現這種程度的動態控制,我是否需要購買價值數千美元的頂級顯卡?我是否需要像開發者一樣寫代碼來搭建本地環境?」

答案是不需要。

我們正處於科技的一個轉折點,創作的障礙正在消失。阻礙創作者的唯一因素是算力瓶頸和複雜的安裝過程。

這正是 Atlas Cloud 存在的意義。

我們處理複雜的部署和繁重的工作,因此你可以完全專注於創作自由。打破這最後一道牆的成本不到一杯咖啡的錢。我們正在將好萊塢級別的視覺特效從昂貴的工作站帶入你的日常生活中。

工具已經準備就緒,剩下的就交給你的想像力。點擊 啟動 Atlas Cloud,開啟你的導演之旅。 🚀

在 Atlas Cloud 上,你可以:

- 並排對比 輸出品質與成本

- 決定哪個模型為你的特定工作流程提供最佳的投資報酬率 (ROI)

如何在 Atlas Cloud 上使用模型

Atlas Cloud 讓你能夠並排使用模型 —— 首先在 Playground 中嘗試,然後通過單一 API 使用。

方法 1:直接在 Atlas Cloud Playground 中使用

方法 2:通過 API 訪問

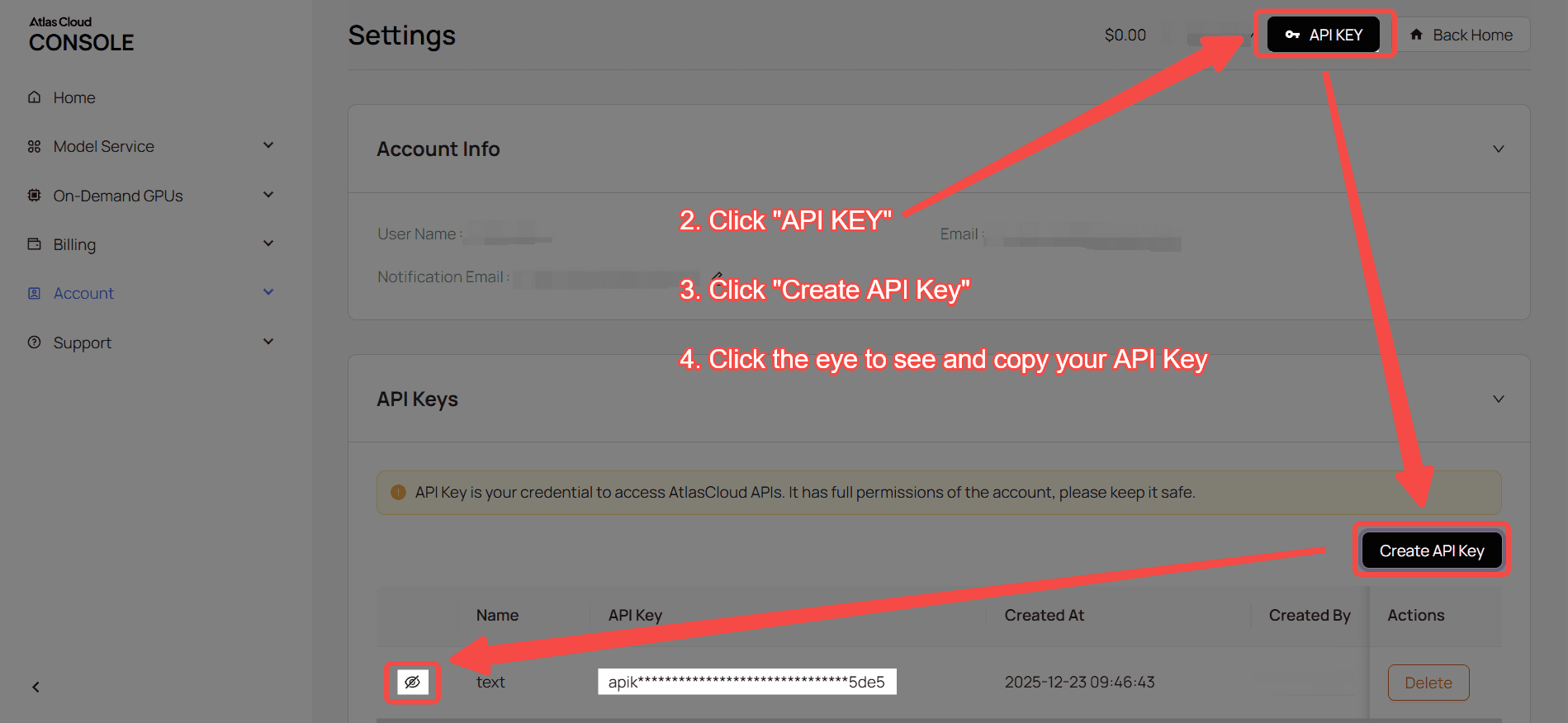

第一步:獲取你的 API Key

在你的 控制台 (Console) 中建立一個 API Key,並複製備用。

第二步:查看 API 文件

在我們的 API 文件 中查看端點 (endpoint)、請求參數和身份驗證方法。

第三步:發送你的第一次請求 (Python 範例)

範例:使用 kwaivgi/kling-v2.6-std/motion-control 生成影片

plaintext1import requests 2import time 3 4# 步驟 1:啟動影片生成 5generate_url = "https://api.atlascloud.ai/api/v1/model/generateVideo" 6headers = { 7 "Content-Type": "application/json", 8 "Authorization": "Bearer $ATLASCLOUD_API_KEY" 9} 10data = { 11 "model": "kwaivgi/kling-v2.6-std/motion-control", 12 "character_orientation": "video", 13 "image": "https://static.atlascloud.ai/media/images/dc0051d2c757c405abcc66db9e73731b.jpg", 14 "keep_original_sound": True, 15 "prompt": "Replace the characters in the video with the characters from the image, while strictly maintaining the characters' movements.", 16 "video": "https://static.atlascloud.ai/media/videos/29538d8995e0a9ba017469aab11b2172.mp4" 17} 18 19generate_response = requests.post(generate_url, headers=headers, json=data) 20generate_result = generate_response.json() 21prediction_id = generate_result["data"]["id"] 22 23# 步驟 2:輪詢結果 24poll_url = f"https://api.atlascloud.ai/api/v1/model/prediction/{prediction_id}" 25 26def check_status(): 27 while True: 28 response = requests.get(poll_url, headers={"Authorization": "Bearer $ATLASCLOUD_API_KEY"}) 29 result = response.json() 30 31 if result["data"]["status"] in ["completed", "succeeded"]: 32 print("Generated video:", result["data"]["outputs"][0]) 33 return result["data"]["outputs"][0] 34 elif result["data"]["status"] == "failed": 35 raise Exception(result["data"]["error"] or "Generation failed") 36 else: 37 # 還在處理中,等待 2 秒 38 time.sleep(2) 39 40video_url = check_status()