Kimi K2.5 登陸 AtlasCloud:解鎖原生視覺、萬億 MoE 架構與蜂群智能

速覽

$0.56/2.8M 輸入/輸出

AtlasCloud 上線 Kimi K2.5 :

-

核心定義:Kimi K2.5 由 Moonshot AI 開發,透過原生視覺與混合專家架構提升了 Kimi 系列 的多模態基礎。

-

主要效益:適用於複雜影片流分析、自動化代理任務執行及高審美標準的程式開發。

-

當前狀態:震撼上線!

Kimi K2 確立了長文本處理領域的行業標準,Kimi K2.5 將憑藉其全方位的推理與執行能力推動 AI 生成技術的發展。

01 核心技術突破:原生視覺、蜂群智能與 MoE 高效能架構

Kimi K2.5 展現了從「單一對話」向「全能多模態執行」的質變。

「蜂群思維」與高階推理能力 (Agentic Intelligence)

Kimi K2.5 突破了傳統大模型「單線程思考」的局限,引入了類似生物集群的協作智能。

- 核心解析:

- **Agent Swarm (蜂群代理)**:「自我指導」的並行處理系統。模型可以將一個複雜目標拆解,指揮多達 100 個子智能體並行協作,不僅保留了 Kimi 招牌的「思考模式」,更將其擴展到了任務執行層面。

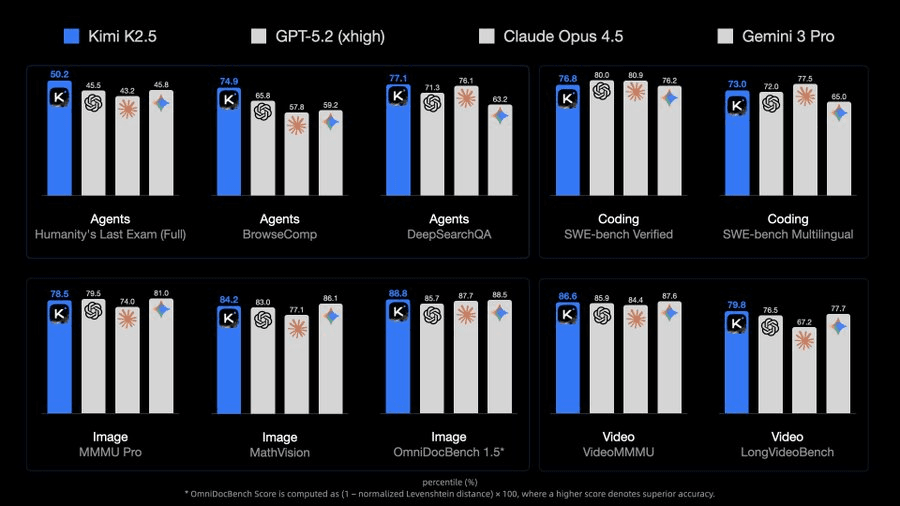

- 複雜任務統治力:在 HLE(人類終極考試,見圖片)基準中取得 50.2% 的成績,證明其在處理長鏈條、多步驟的複雜指令時,具備了超越以往模型的規劃能力。

- 與前代/競品對比:

- 對比單代理(Single-Agent):執行速度提升 4.5 倍,且能處理的任务複雜度遠超 Kimi K2 或標準 GPT-4 類模型。

- 對比競品:在代理能力上超越了當時的頂尖競品(如模擬環境中的 GPT-5.2 和 Claude 4.5),成為新的全球標杆。

原生視覺與影片直讀能力 (Native Multimodal Vision)

- 核心解析:

- 影片即輸入:不僅支援用戶上傳圖像,更能直接處理影片流。基於 15T 圖文混合數據的預訓練,使其能深度分析影片中的動態變化、邏輯關係。

- 這也讓它成為 Atlas Cloud 上眾多生圖生影片模型的最佳搭檔——用戶可以在平台上讓多個影片模型同時跑 Prompt,優選出最佳素材後直接餵給 Kimi 進行分析,無需在多個工具間反覆橫跳。

- 精準佈局解析:能解讀「精密的平面佈局」,這得益於其原生的多模態架構,使其在 MMMU Pro(78.5%)和 VideoMMMU(86.6%)等視覺基準上實現了開源 SOTA。

- 影片即輸入:不僅支援用戶上傳圖像,更能直接處理影片流。基於 15T 圖文混合數據的預訓練,使其能深度分析影片中的動態變化、邏輯關係。

- 與前代/競品對比:

- 對比外掛視覺模型:早期的多模態模型往往是「語言模型+視覺編碼器」的拼接,而 K2.5 是原生融合,理解更深,不再會有「幻覺」或「理解斷層」。

- 對比 Kimi K2:從 K2 的「長文本王者」進化為 K2.5 的「全感官通才」,彌補了純文本模型的感知短板。

「懂審美」的工程化程式開發 (Code with Taste)

Kimi K2.5 將程式編寫能力從單純的「功能實現」提升到了「交互美學」的維度。

- 核心解析:

- 視覺轉程式碼:用戶可以直接上傳設計圖甚至演示影片,K2.5 能將其轉化為程式碼。

- 高階特效支持:特別強化了對 Three.js 等複雜 3D 函式庫和動態效果的支持。

- 工程實戰:在 SWE-bench Verified 中獲得 76.8% 的高分,證明其不僅懂花哨的前端,也能處理嚴肅的後端邏輯。

- 與前代/競品對比:

- 對比普通程式碼模型:大多數程式碼模型(如 CodeLlama)只能保證程式碼「不報錯」,而 K2.5 能保證程式碼「好看」且「符合視覺邏輯」,這是質的飛躍。

架構革新與跨代效能飛躍 (Architectural Revolution & Generational Leap)

Kimi K2.5 基於 MoE 架構實現了計算效率與智能密度的完美平衡,標誌著模型能力從「線性增長」轉向「指數級跨越」。

- 核心解析:

- MoE 架構紅利:採用 1T 參數的混合專家架構,但在推理時僅激活 32B 參數。

- 這種高能效設計與 Atlas Cloud 的低成本優勢完美契合,用戶既能在平台上同屏直觀對比「生成質量 vs 成本」,用最少的錢跑出最完美的影片或程式碼,也能利用平台提供的 OpenAI 兼容接口 (API) 輕鬆接入這一頂級模型。

- 與前代/競品對比:

- 對比 Kimi K2:如果說 K2 是長文本領域的專家,K2.5 則是在全維度上實現了智能化重構,推理深度與廣度呈現爆發式增長。

- 對比傳統大模型 API:得益於高效的 MoE 架構,K2.5 在提供同等甚至超越 GPT-4 級別智能的同時,展現出了更具優勢的推理效率,是構建高性能 AI 應用的理想基座。

02 開發者實戰場景:自動化影片工作流與視覺轉程式碼全鏈路

Kimi K2.5 的核心能力不僅僅停留在技術參數上,更在於它如何改變開發者的日常工作方式,以下是三個具體的應用方向:

多模態工作流與素材篩選

- 影片深度理解:直接分析影片流內的動態邏輯並省去繁瑣的預處理環節。

- 多模型協作:配合平台並行生成的多個影片結果快速篩選出質量最佳的素材。

- 智能成本控制:直觀對比不同模型的生成效果與價格以找到最優的投入產出比。

視覺驅動的程式開發

- 設計稿還原:將靜態圖片或演示影片直接轉化為帶有 Three.js 動效的前端程式碼。

- 通用接口接入:利用 OpenAI 兼容接口把這種高級編程能力輕鬆連入現有的開發工具。

- 高性能推理:借助混合專家架構在極低的延遲下處理複雜的生產級程式碼邏輯。

大規模自動化代理集群

- 蜂群並行執行:將大任務拆解給上百個子智能體同時處理以大幅提升完成速度。

- 長程邏輯規劃:在執行多步驟的複雜任務時保持極其穩定的邏輯連貫性。

- 高並發處理:依托平台的高並發設施運行大規模代理網絡並實現業務流程自動化。

現在,讓我們看看如何在 AtlasCloud 上快速配置好這一切。

03 Atlas Cloud: 駕馭 Kimi K2.5 的最佳平台

Atlas Cloud 核心優勢預覽

成本效益與極致速度

- 具競爭力的定價策略:透過優化的性價比提供最具成本效益的生成體驗。

- 加速推理與生成:以更快的響應速度支援高頻次的專案迭代與快速交付。

工作流集成與 API 生態 專為無縫融入技術開發管線及支援下游任務而設計。

- 靈活的協同工作流:支援與其他生成式模型在同一環境中並行協作。

- 高可用性交付物:生成結果便於直接進行即時後處理或二次編輯。

- 全功能 API 接入:提供標準開發者接口以實現業務流程自動化與應用深度集成。

如何在 Atlas Cloud 上使用?

方法一:直接在平台上使用

方法二:接入 API 使用

步驟 1: 獲取你的 API

在控制台中創建並粘貼你的 API

步驟 2:查閱 API 文檔

請在我們的 API 文檔中查看接口端點、請求參數及認證方式。

步驟 3:發起您的首次請求(Python 示例)

plaintext1import requests 2 3# Vision Understanding Example 4# Image: Use base64 encoding (data:image/png;base64,...) 5# Video: Use URL (recommended for large files) 6 7url = "https://api.atlascloud.ai/v1/chat/completions" 8headers = { 9 "Content-Type": "application/json", 10 "Authorization": "Bearer $ATLASCLOUD_API_KEY" 11} 12data = { 13 "model": "moonshotai/kimi-k2.5", 14 "messages": [ 15 { 16 "role": "user", 17 "content": [ 18 { 19 "type": "image_url", 20 "image_url": { 21 "url": "data:image/png;base64,<BASE64_IMAGE_DATA>" 22 } 23 }, 24 { 25 "type": "video_url", 26 "video_url": { 27 "url": "https://example.com/your-video.mp4" 28 } 29 }, 30 { 31 "type": "text", 32 "text": "Please describe the content of this image/video" 33 } 34 ] 35 } 36 ], 37 "max_tokens": 32768, 38 "temperature": 1, 39 "stream": True 40} 41 42response = requests.post(url, headers=headers, json=data) 43print(response.json())