AI 影片 API 的角色一致性(Character Consistency)是指在不同鏡頭之間維持角色視覺特徵(如五官、服飾與比例)的能力。透過擺脫隨機的「提示詞輪盤」(prompt roulette),並採用如參考錨點(Reference Anchors)與微調 LoRA 等結構化 API 約束,創作者現在能製作出視覺連貫性達 95% 的劇集內容,並將製作成本降低多達 80%。

多年來,「角色漂移」(Character Drift)現象——即主角的面部特徵或服飾在影格間不一致地變動——使 AI 影片一直被視為充滿怪異感的迷因(memes)。這種缺乏視覺穩定性的問題,是阻礙 AI 從短片發展為專業敘事的主要門檻。

現在,這一切由**持久性(persistence)**來定義。產業已從「靠提示詞碰運氣」轉向結構化製作。如 Atlas Cloud 等集中化平台,透過提供高一致性 AI 影片 API 的統一入口,終於解決了這場「身分危機」。

| 指標 | 2024 年表現 | 2026 年表現 |

| 角色漂移 | 高(50% 面部偏移) | 極低(<5% 視覺變異) |

| 身分設定 | 手動提示詞 | 自動參考錨點(Reference Anchoring) |

| 渲染模式 | 逐幀渲染 | 狀態式時序連貫(Stateful Temporal Coherence) |

透過掌握這些 AI 影片 API,創作者不再只是「下指令」,而是在執導數位電影的新時代。以下技術已將 AI 從實驗性玩具轉變為專業電影引擎:

- Atlas Cloud: 一個統一的 API 平台,整合了 Seedance 2.0 與 Kling 3.0 等頂尖(SOTA)模型,讓開發者能透過單一端點在整部劇集中鎖定角色身分。

- LTX Studio: 專為多鏡頭一致性與敘事控制設計的綜合平台。

- 自定義 ComfyUI 端點: 模組化工作流程,允許創作者將特定的角色身分(LoRA)嵌入潛在空間(latent space)中。

2026 年 API 如何解決時序連貫性

從閃爍的「夢境般」短片到穩定的劇集內容,其轉變的動力源於 AI 影片 API 處理數據方式的根本性變革。到了 2026 年,產業已超越簡單的文字提示詞,轉向「狀態式」(Stateful)架構,將角色身分視為持久變數,而非隨機生成的產物。

超越提示詞:身分錨定(Identity Anchoring)

現代 API 利用身分錨定來消除角色漂移。開發者不再僅使用「蓄鬍男子」這類基礎文字提示,而是使用「基礎身分」(Base Identity)。這通常是一張清晰的照片或 3D 頭部模型,作為嚴格的規則基準。它像穩定的錨一樣運作,確保每一幀畫面看起來都與原始角色一致,無論光影或拍攝角度如何變化,面部與骨骼結構皆保持不變。

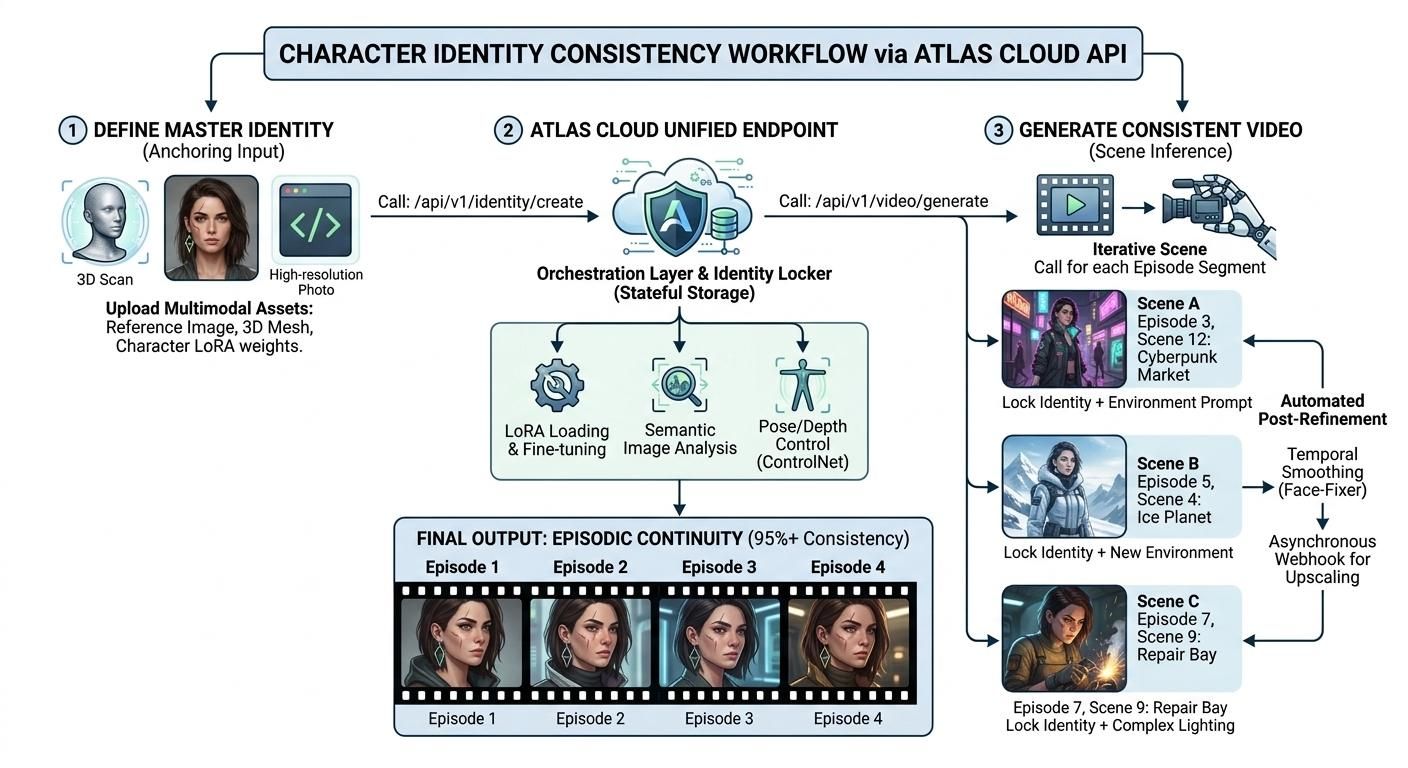

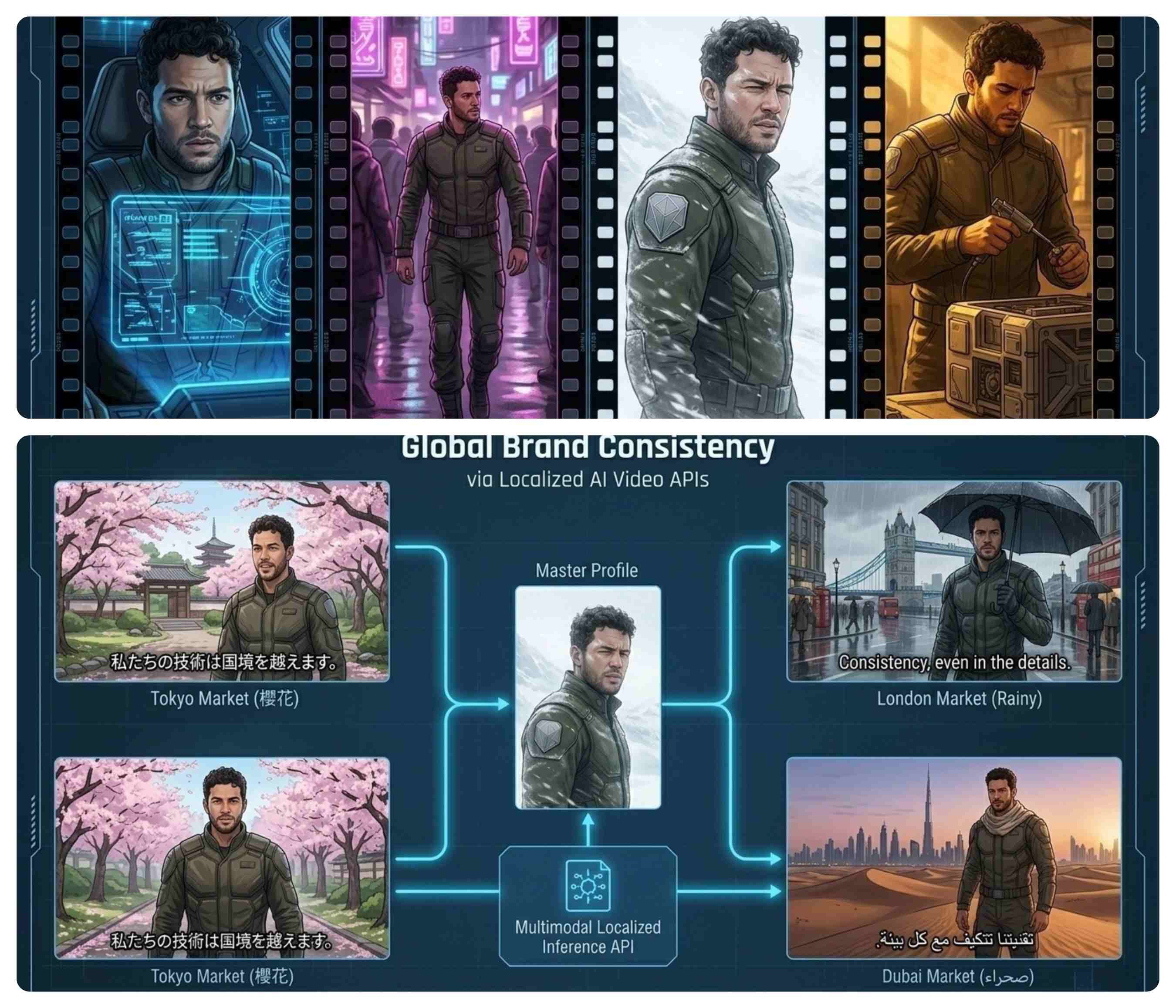

圖示: Image_0.png 演示了單一中性參考肖像(「錨點」)如何強制 AI API 在多樣化、動態的場景中維持相同身分(注意獨特的疤痕與耳環),即使面臨視角、光影與環境的變化依然穩定。

LoRA 與 IP-Adapter 的角色

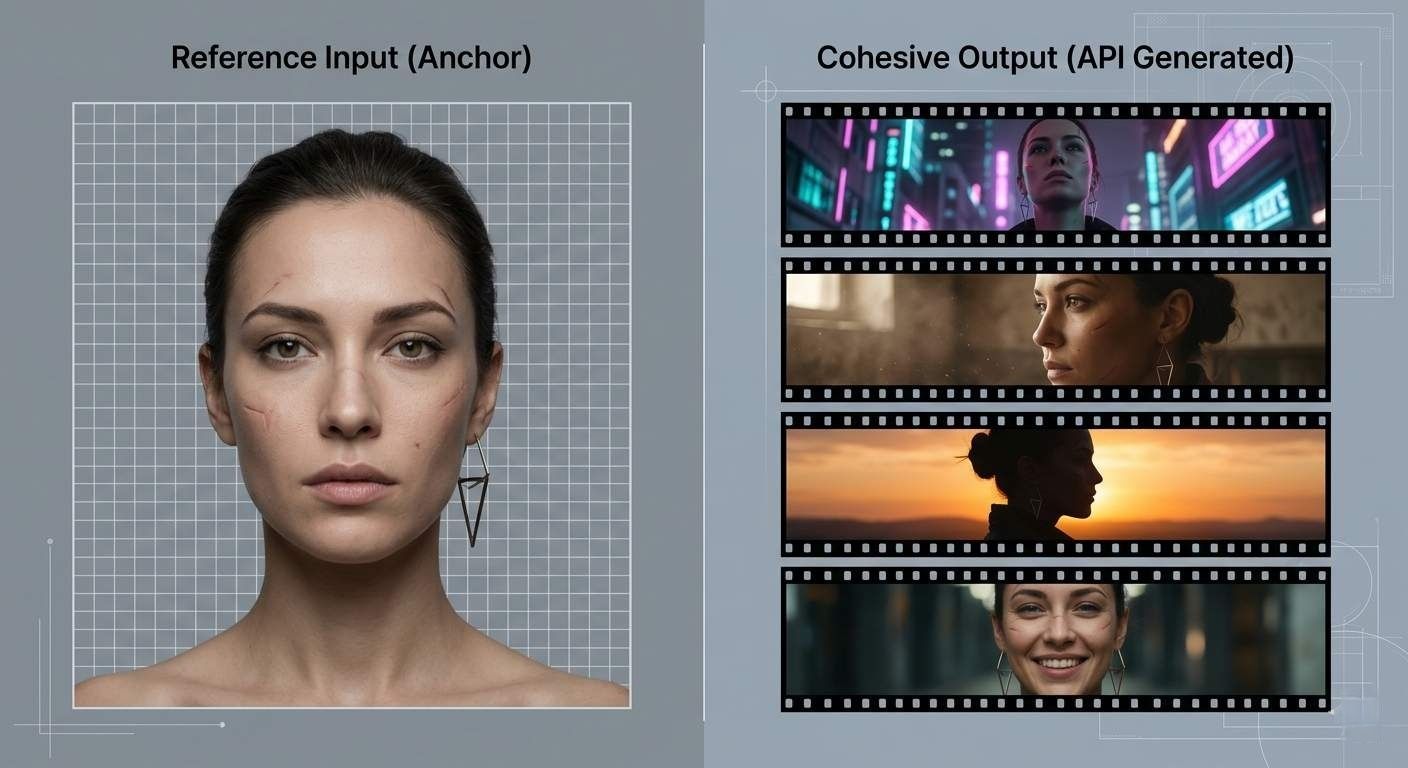

為了實現「最先進」的一致性,技術流水線利用了兩個關鍵組件:

- LoRA(低秩自適應): 這是小型、經過微調的權重層,能「鎖定」角色的特定美學,例如獨特的皮膚紋理或服裝圖案。

- IP-Adapter: 與需要訓練的 LoRA 不同,IP-Adapter 允許即時的「零樣本」(zero-shot)身分注入。

目前最穩定的專業工作流程採用「混合架構」(Hybrid Stack):

| 組件 | 技術功能 | 目標一致性 |

| 身分 LoRA | 一般體型與氛圍 | 70% |

| PuLID / IP-Adapter | 精確的面部特徵鎖定 | 90% |

| ControlNet | 空間與姿勢規範 | 95%+ |

image_1.png 直觀地說明了如何應用多重約束。我們可以看到空間控制(ControlNet/姿勢)、特定角色特徵(IP-Adapter 參考圖像)以及專門的美學權重(裝甲 LoRA)相結合,從而在新環境中生成連貫的角色。

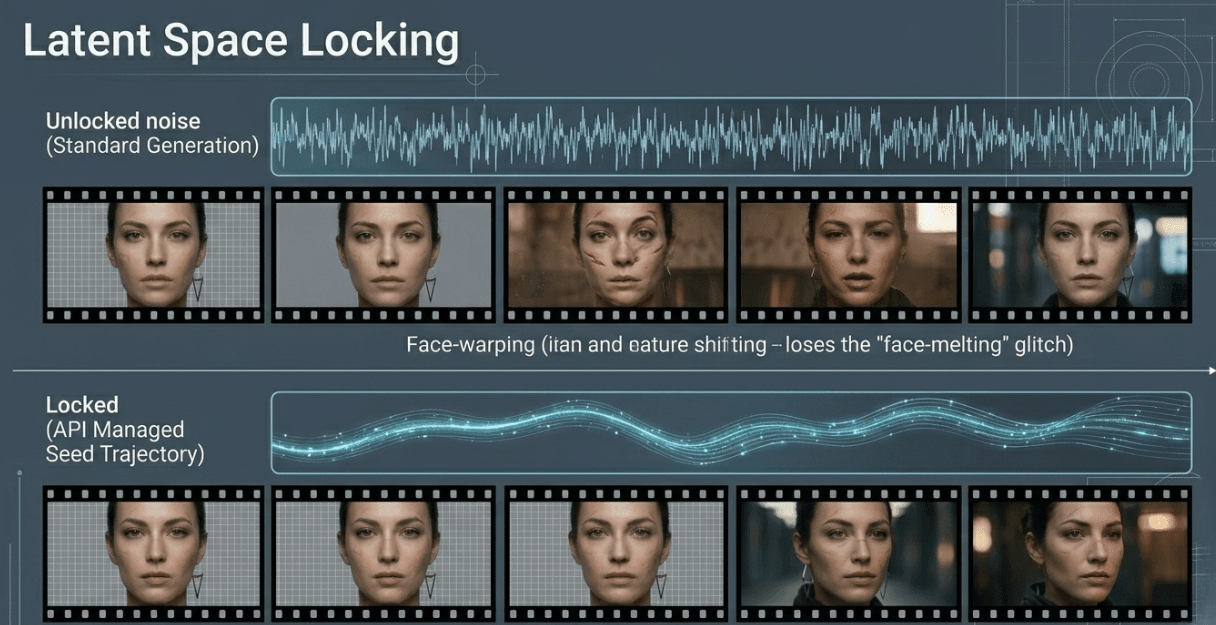

種子軌跡(Seed Trajectories)與潛在空間鎖定

一項高價值的技術突破是使用潛在空間鎖定(Latent Space Locking)。每一次 AI 生成都始於一個「種子」(隨機噪點)。透過在影格間保持噪點模式或「種子軌跡」的一致性,API 能防止「面部融化」現象。此方法確保像素背後的數學演變平滑,使角色能穿梭於複雜場景中而不喪失視覺完整性。

透過結合這三個部分,創作者終於能製作出主角在每一集看起來都完全一樣的劇集。從第一場戲到全季結束,面部特徵始終保持完美的一致性。

Image_2.png 提供了對比視圖。上方的時間軸(標準噪點)顯示 Image_0.png 中的面部特徵「融化」——面部、表情甚至身分都在偏移。下方的時間軸(鎖定噪點)顯示面部保持近 95% 的同一性,且僅顯示自然的演變(如轉頭),這歸功於 API 所施加的數學約束。

徹底改變劇集製作流程

角色一致性 AI 影片 API 的整合,從根本上改變了劇集媒體的經濟格局。巨大的優勢不僅在於「速度」,更在於讓任何人都能製作高品質故事。這些工具處理了維持視覺一致性的繁瑣工作,使小型創作者與工作室能製作出媲美大製作電影品質的作品。

新的製作範式

歷史上,為動畫系列創建連貫角色需要投入大量成本進行 3D 建模、綁定與貼圖映射。若角色設計在季度中期更改,這類「技術債」可能拖垮整個製作。

現代 AI 工作流程以動態、微調過的權重取代了這些僵化的資產。採用 AI 原生流水線的製作團隊報告稱,總開銷降低了 70-90%。

效率基準:傳統 vs. AI 原生

下表說明了針對 22 分鐘標準劇集在關鍵績效指標上的顛覆性影響:

| 特徵 | 傳統動畫/CGI | AI 影片 API 工作流程 |

| 角色設定 | 數月的建模與綁定 | 2–4 小時的 LoRA 訓練 |

| 單集成本 | USD100,000 – USD1M+ | USD500 – USD5,000 |

| 迭代速度 | 數週(渲染時間) | 數分鐘(推理時間) |

| 一致性 | 完美(手工編碼) | 高(API 約束 95%+) |

雖然傳統方法在畫素級別的精確度上仍具優勢,但「推理替代渲染」(Inference-over-Rendering)模型使創作者能在幾分鐘內生成初稿。這種「時間壓縮」使工作室每月發布的內容增加了 42%,將劇集內容從緩慢的奢侈品轉化為靈活、響應迅速的媒體。

案例研究:「微型影集」與虛擬網紅的崛起

我們正從隨機短片轉向真實故事,並創造了新趨勢:AI「微型影集」。透過使用能維持角色一致性的智慧影像工具,人們正製作出視覺效果媲美常規動畫的影集,且不僅時間大幅縮短,成本也大幅降低。

獨立製作革命:20 天產出 20 集

TikTok 與 YouTube Shorts 上的獨立創作者不再受限於過去困擾 AI 生成影片的「身分漂移」問題。利用如 Atlas Cloud 等統一平台來整合 Seedance 2.0 或 Kling 3.0 等模型,單一創作者只需定義一次「角色 ID」,即可在全季重複使用。

這項技術飛躍促成了系列化敘事的興起,呈現以下特點:

- 製作速度: 創作者能在數週內發布 20 集的微型影集,而非傳統 CGI 所需的 12–18 個月。

- 參與度: 虛擬網紅現在佔據了 4.2% 的市場份額,參與率平均為 5.67%——幾乎是真人網紅的三倍。

全球品牌一致性與 AI 代言人

對於全球企業而言,「身分危機」曾是品牌安全的隱患。如今,企業利用 AI 影片 API 在全球市場維持一致的「虛擬代言人」。透過 API 調用集中化的角色嵌入(embedding),品牌能生成在地化內容,代言人在說不同語言或出現在不同文化場景時,視覺上依然完全一致。

| 優勢 | 對全球品牌的影響 |

| 視覺保真度 | 身分在各地區保持 95%+ 的同一性。 |

| 在地化 | 透過在地化 API 調用實現即時口型同步與語言翻譯。 |

| 風險管理 | 相較於真人名人代言人,爭議風險為 0%。 |

市場增長趨勢

這種一致性帶來的經濟影響力驚人。產業數據突顯了品牌支出向這些持久數位資產傾斜的根本轉變:

- 市場規模: 虛擬網紅市場在 2026 年初達到 USD4.6 billion。

- 效率: 使用 AI 一致性角色的單篇貼文製作成本比涉及真人網紅的成本低 38%。

- 採用率:92% 的品牌目前正在使用或積極測試用於劇集行銷的 AI 工作流程。

透過將角色身分視為可擴展的數位資產,AI 影片 API 已超越「玩具」階段,成為高效率劇集經濟的核心支柱。

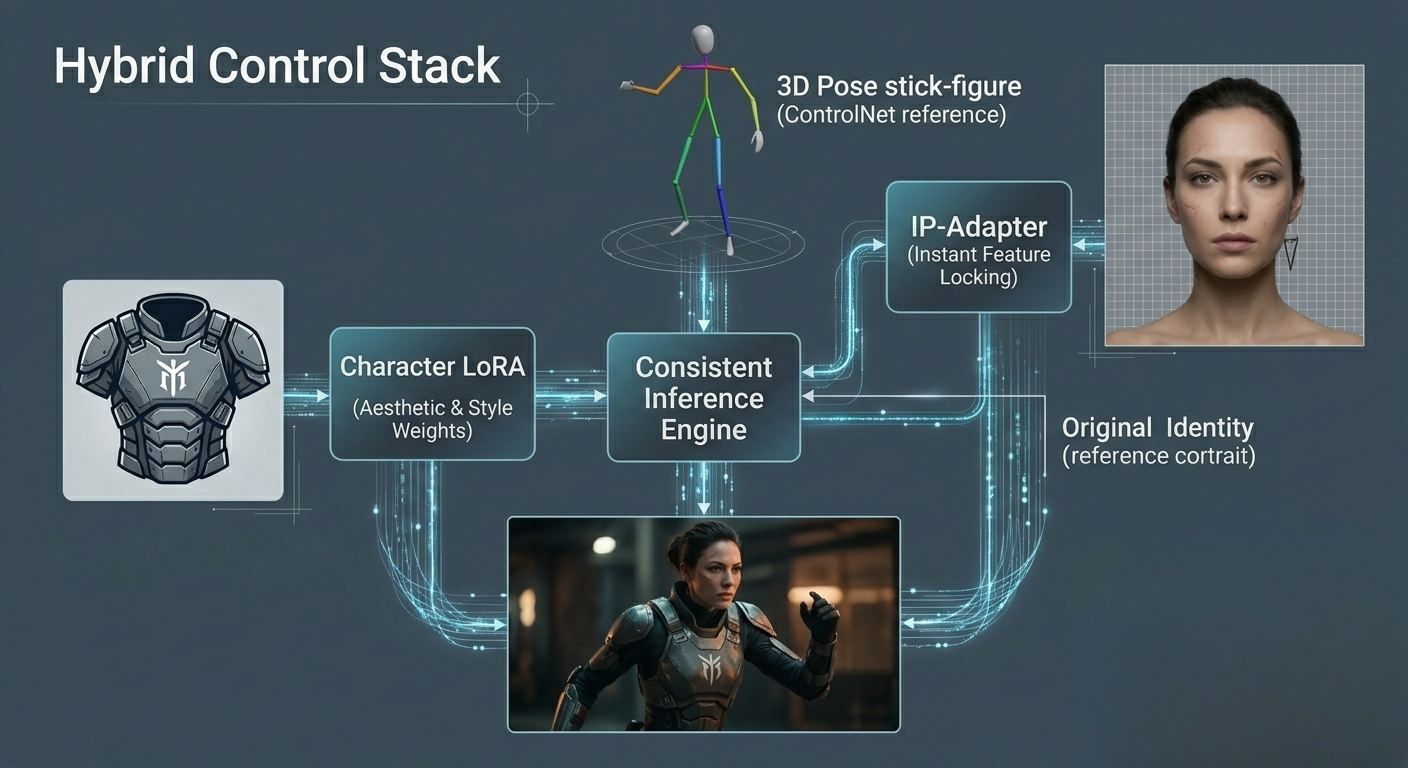

如何建立您的一致性工作流程

從玩轉 AI 短片到製作真實影集,需要新的計劃。您需要一個組織嚴密且具擴展性的工作流程。產業標準已轉向利用多模態輸入來錨定視覺身分的「一鍵訪問」(One-Key Access)架構。透過利用統一的 AI 影片 API,創作者可以在不同場景間維持角色連貫性,而無需進行手動的逐幀編輯。

第一步:定義主身分(Master Identity)

任何連貫系列的核心基礎就是「主身分」。創作者不再僅輸入文字描述,而是結合多種檔案格式。他們通常會使用一張清晰的參考照片,並搭配 3D 地圖或角色 LoRA。這個「身分錨點」保持了穩定性,確保面部、細小疤痕甚至衣物紋理在每個鏡頭中都精確相同。

第二步:透過 Atlas Cloud 進行編排

專業流水線不再需要為不同模型維護各自獨立的 API 金鑰與不相容的資料格式,而是利用 Atlas Cloud 統一 API。此編排層允許無縫切換模型,同時維持相同的核心程式碼庫。

例如,創作者可以透過 Atlas Cloud 調用 **Seedance 2.0「通用參考」**系統,在複雜的 15 秒動作序列中鎖定角色特徵。若某個鏡頭需要 Kling 3.0 的出色流體運動,或 Veo 3.1 的寫實電影光影,開發者只需在 Atlas Cloud 環境中切換模型參數即可。

| 工作流程階段 | 工具範例 | 關鍵優勢 |

| 模型切換 | Kling 3.0 ↔ Veo 3.1 | 針對鏡頭類型優化性能 |

| 身分鎖定 | Seedance 2.0 Ref | 永久的面部與服飾持續性 |

| 整合 | Atlas Cloud SDK | 統一端點;無碎片化金鑰 |

seedance-2.0 以圖生影 程式碼範例:

plaintext1import requests 2import time 3 4# 第一步:啟動影片生成 5generate_url = "https://api.atlascloud.ai/api/v1/model/generateVideo" 6headers = { 7 "Content-Type": "application/json", 8 "Authorization": "Bearer $ATLASCLOUD_API_KEY" 9} 10data = { 11 "model": "bytedance/seedance-2.0/image-to-video", # 必要。模型名稱 12 "prompt": "A smooth, futuristic ship is floating slowly around a massive planet...", # 描述期望影片動態的文字提示詞 13 "image": "https://static.atlascloud.ai/media/images/454eee7f1a05a0bf276afe2e056200ba.png", # 必要。第一幀影像 URL 或資產參考 14 "last_image": "example_value", # 最後一幀影像 URL 或資產參考 15 "duration": 5, # 影片時長(秒,4-15),或 -1 由模型自動選擇 16 "resolution": "720p", # 影片解析度 17 "ratio": "adaptive", # 長寬比 18 "generate_audio": True, # 是否生成同步音訊 19 "watermark": False, # 是否添加浮水印 20 "return_last_frame": False, # 是否回傳最後一幀作為單獨影像 21} 22 23generate_response = requests.post(generate_url, headers=headers, json=data) 24generate_result = generate_response.json() 25prediction_id = generate_result["data"]["id"] 26 27# 第二步:輪詢檢查結果 28poll_url = f"https://api.atlascloud.ai/api/v1/model/prediction/{prediction_id}" 29 30def check_status(): 31 while True: 32 response = requests.get(poll_url, headers={"Authorization": "Bearer $ATLASCLOUD_API_KEY"}) 33 result = response.json() 34 35 if result["data"]["status"] in ["completed", "succeeded"]: 36 print("Generated video:", result["data"]["outputs"][0]) 37 return result["data"]["outputs"][0] 38 elif result["data"]["status"] == "failed": 39 raise Exception(result["data"]["error"] or "Generation failed") 40 else: 41 time.sleep(2) 42 43video_url = check_status()

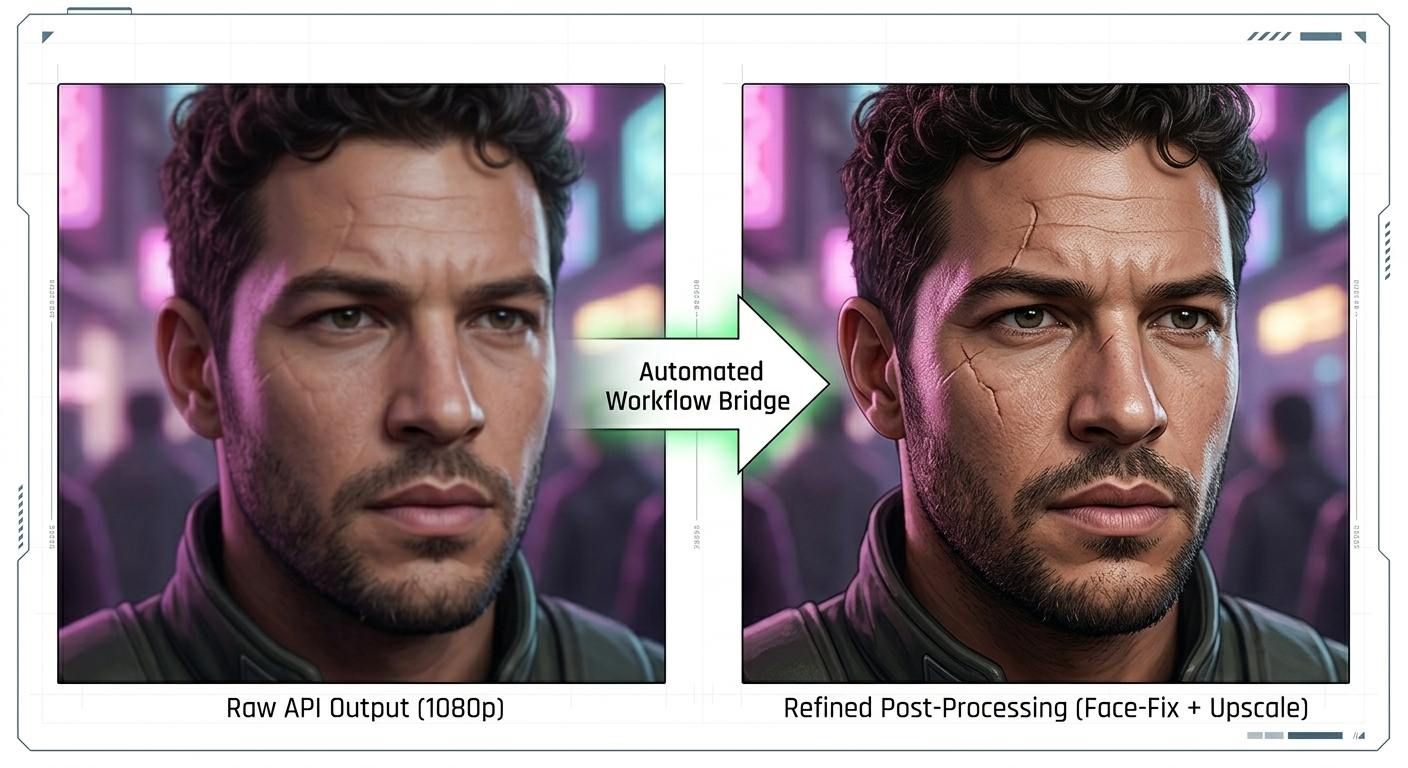

第三步:生成後精修

為了達到「4K 廣播級」品質,最終階段涉及自動化後處理橋接。透過 Atlas Cloud 的非同步 Webhook 架構,系統可在 1080p 渲染完成的瞬間自動觸發外部增強任務。

常見的自動化後處理任務包括:

- 時序平滑化: 消除角色特徵的微小波動。

- 外部 4K 超解析度: 將 1080p API 輸出透過專業超解析度模型進行升頻。

- 視訊音訊同步: 使用 Vidu Q3 整合,自動將音效與角色動作精準對齊。

透過此三步驟 API 流程,團隊可自動化 85% 的視覺工作,在幾分鐘內創作出高品質劇集,同時確保視覺連貫性。

未來展望:告別「恐怖谷」?

展望 2026 年下半年,AI 影片 API 的演進正從預渲染的劇集內容邁向「即時身分」(Live Identity)範式。過去造成「恐怖谷」的技術壁壘——如微小停頓與光影不一致——正被即時神經渲染(neural rendering)所攻克。

邁向即時連貫影片

下一個前沿是從靜態生成轉向即時 AI 頭像。這些工具的未來版本預計能在 100 毫秒內運作,代表角色在與您即時互動時也能保持外觀一致。這將徹底改變敘事方式,觀眾能在直播互動中與角色對話,或在影集中做出選擇,即便劇情因互動而改變,角色視覺依然完美。

倫理層面:保護身分權益

隨著完美複製角色(或人類)的能力出現,法律挑戰也隨之而來。產業目前正在開發「身分權益」框架,以防止未經授權的數位克隆。在 2026 年,我們正看到以下發展:

- 鏈上身分驗證: 使用區塊鏈來「簽署」角色的獨特權重設定檔。

- 浮水印標準: 對所有 API 生成的身分實施強制性的 SynthID 風格浮水印,以區分人類與合成演員。

常見問題

什麼是 AI 影片的角色一致性?

角色一致性是指 AI 模型能讓主題看起來完全相同。它確保面部、髮型與衣物在不同角度與環境中保持不變。在真實的節目製作中,這就是將一系列隨機片段轉變為完整、連貫故事的關鍵。

哪些 AI 影片 API 支援角色一致性?

雖然許多模型正在進入市場,但目前透過 API 提供穩固一致性控制的領導者包括:

- LTX-Studio: 專注於電影級「鏡頭間」角色鎖定。

- Magic Hour: 創作者專注於一致性角色動畫與換臉的熱門選擇。

- Atlas Cloud: 一個統一平台,透過單一專注於一致性的端點編排多個模型。

我可以使用自己的臉來實現角色一致性嗎?

可以。透過「角色客串」(Character Cameo)功能與 IP-Adapter,您可以上傳自己的參考肖像。API 隨後會提取您的「面部潛在權重」並應用於數位主角身上,確保您在整個劇集中始終作為連貫的主角出現。