Kimi K2.6 對決 GLM 5.1、Qwen 3.6 Plus 與 MiniMax M2.7:2026 年程式開發最強開源模型評比

快速總結

如果你正在建構一個需要連續運作數小時且無需人工介入的自動化程式代理 (Autonomous coding agent),請選擇:Kimi K2.6。它在 Terminal-Bench 2.0 基準測試中獲得 66.7% 的評分,並在發布的測試數據中,於 13 小時不間斷的會話中維持了 4,000 次以上的工具呼叫——這是本次評比中其他開源模型皆無法企及的穩定性門檻。

如果你需要最強的代理前端開發者,請選擇:GLM 5.1。它在獨立驗證的 Code Arena Elo 評分中獲得 1,530 分(代理網頁開發全球第三),這反映了開發者在實戰對決中的真實偏好,而不僅僅是自動化測試套件的結果。

如果預算考量是優先條件(每 Token 成本):MiniMax M2.7 在 Atlas Cloud 上的價格為每百萬輸入 Token USD0.30,且僅需 10B 啟動參數,在 SWE-Bench Pro 上便能取得 56.22% 的分數——相當於以約五分之一的成本發揮了 GLM-5.1 94% 的效能。

如果你的程式碼庫過大,超過 262K 的上下文視窗:Qwen 3.6 Plus 是此處唯一支援 1M Token 上下文的模型,且在該組別中以 61.6% 的成績領先 Terminal-Bench 2.0。

關鍵評測一覽

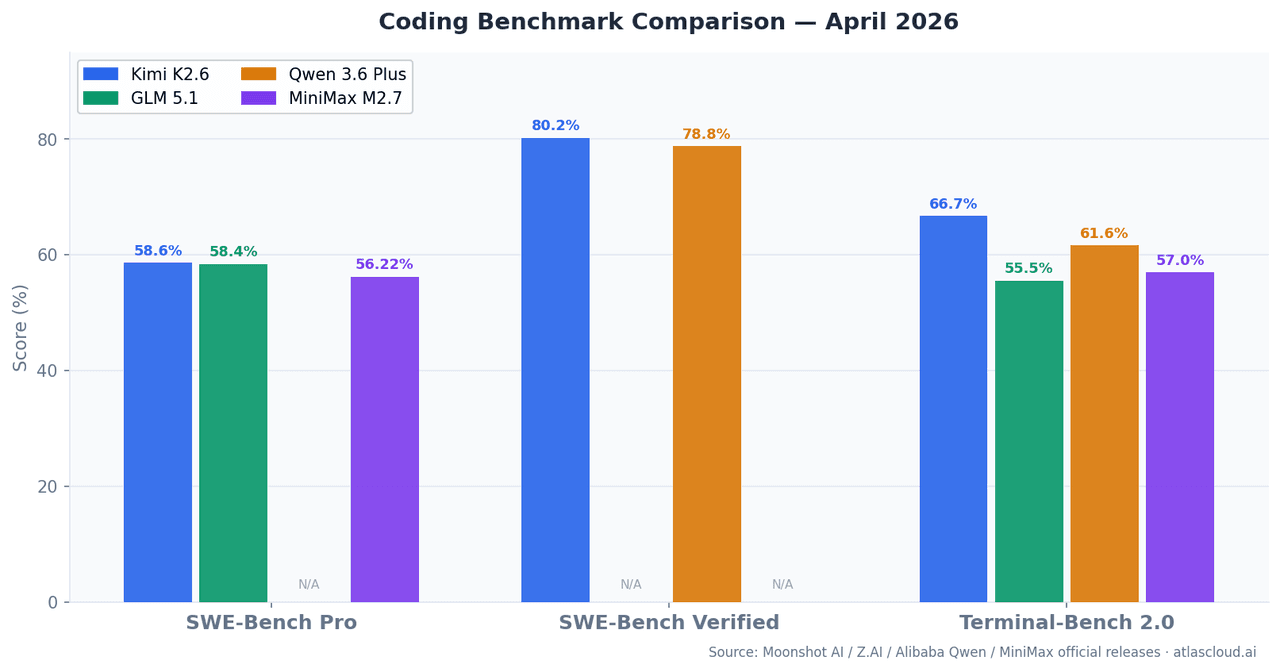

| 模型 | SWE-Bench Pro | SWE-Bench Verified | Terminal-Bench 2.0 | 上下文視窗 | 啟動參數 |

| Kimi K2.6 | 58.60% | 80.20% | 66.70% | 262K | — |

| GLM 5.1 | 58.40% | — | 55%+ | 262K | 754B (MoE) |

| Qwen 3.6 Plus | — | 78.80% | 61.60% | 1M | 混合 MoE |

| MiniMax M2.7 | 56.22% | — | 57.00% | 196K | 10B |

SWE-Bench Pro 衡量解決訓練截斷日期後發生的真實 GitHub 問題之能力,與 SWE-Bench Verified 相比降低了數據污染風險。Terminal-Bench 2.0 則在真實終端環境中測試多步驟 CLI 與 Shell 任務,更接近生產環境中實際代理的運作模式。

Kimi K2.6:專為長時間運作的代理設計

Moonshot AI 於 2026 年 4 月發布了 Kimi K2.6 作為 K2.5 的升級版,其主要改進在於長時間運作下的代理穩定性。其 SWE-Bench Verified 分數為 80.2%,僅次於 Claude Opus 4.6 (80.8%),並以 58.6% 的 SWE-Bench Pro 分數在本次四款模型中居首。

最重要的指標是 Terminal-Bench 2.0 獲得的 66.7%。Terminal-Bench 2.0 與 SWE-Bench 的根本區別在於:它在真實的終端環境中運行任務,要求模型讀取輸出、處理錯誤、進行調適與迭代,而不僅僅是產生修補程式 (Patch)。Kimi K2.6 在 13 小時的單次會話中維持超過 4,000 次工具呼叫的表現並非實驗室虛構數據,而是 Moonshot 技術發布文件中記錄的真實行為。

一個鮮少被提及的優勢是:跨語言泛化能力。Kimi K2.6 在 Rust、Go、Python、前端與 DevOps 任務中皆展現一致的效能。大多數評測過度依賴 Python,如果你的生產技術棧是多語言架構,這一點至關重要。

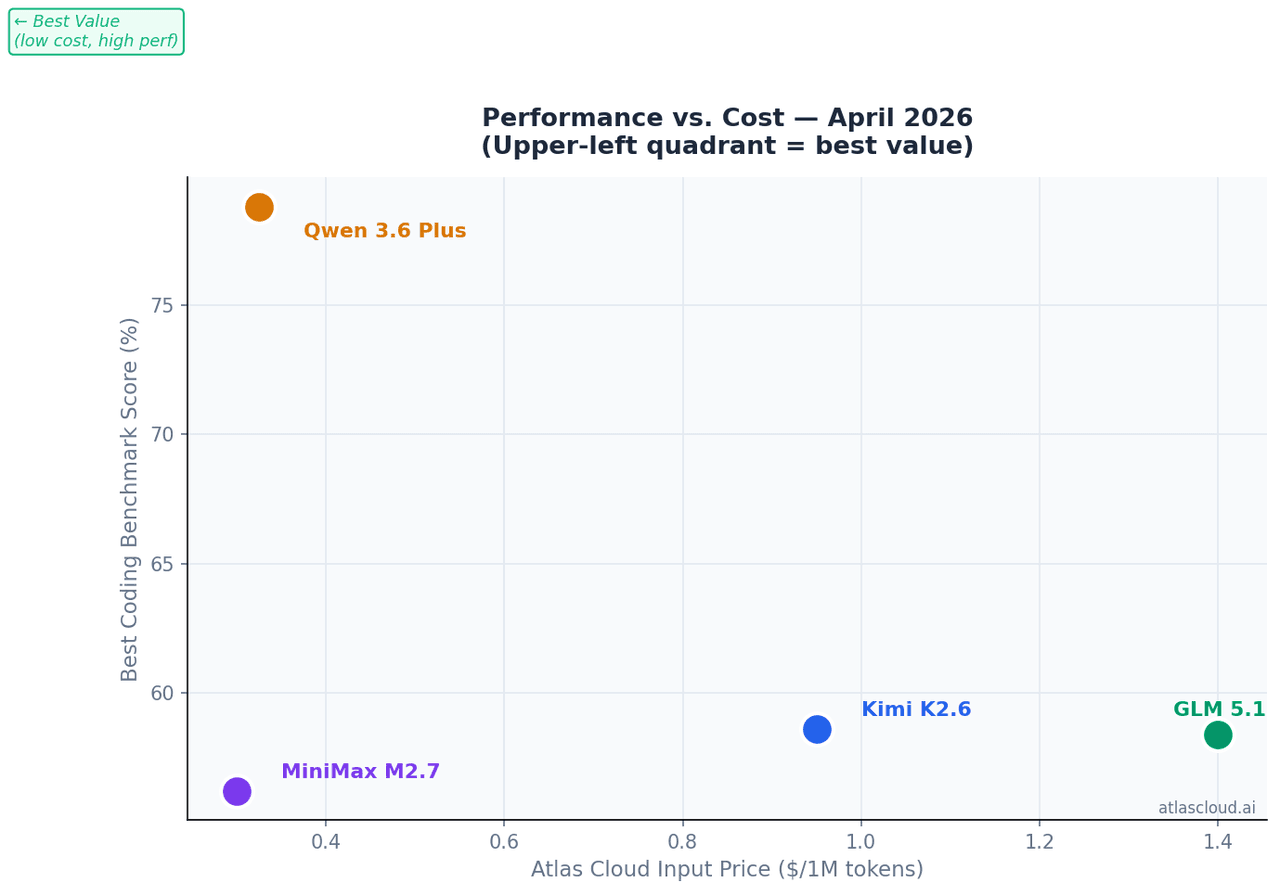

不適用情況: 在 Atlas Cloud 上每百萬輸入 Token USD0.95 的價格,使其成為本組中最昂貴的輸入端模型。對於發送大量請求且需長上下文,但不需要 12 小時會話穩定性的批次處理任務來說,其成本累積速度會比 MiniMax M2.7 或 Qwen 3.6 Plus 快。

GLM 5.1:代理前端開發的首選

Z.AI 於 2026 年 4 月 7 日發布了 GLM-5.1。憑藉 7,540 億參數與 MoE 路由架構,它是本次評比中原始參數規模最大的模型。在 SWE-Bench Pro 上,它取得了 58.4% 的分數,與 Kimi K2.6 的 58.6% 在統計學上幾乎無異。

其差異化優勢在於 Code Arena Elo 評分 1,530,這是由 Arena.ai 於 2026 年 4 月 10 日獨立驗證的結果,使其在代理網頁開發排行榜上名列全球第三。這是一項即時對決評比,由真實開發者對輸出結果投票,而非自動化評分。其優勢集中在前端 UI 產生、全端架構、React/Vue 元件建立以及 NL2Repo(透過自然語言產生完整程式庫結構)。

值得注意的邊界條件: GLM-5.1 的前端優勢是真實存在的。但在 HumanEval 和 MBPP 等純演算法問題上,它相對於 Kimi K2.6 並無顯著優勢。對於非 UI 或非網頁導向的問題,排行榜的差距幾乎縮減為零。若僅依據排行榜總排名而未考慮任務領域就選擇 GLM-5.1,可能會犯下錯誤。

Atlas Cloud 定價: 每百萬輸入 Token USD1.40 起,為四者中最高。但在前端產生品質直接影響產出效率的情況下,這筆支出是值得的。

Qwen 3.6 Plus:當上下文長度成為瓶頸時

Alibaba 於 2026 年 3 月底發布了 Qwen 3.6 Plus。它在 Terminal-Bench 2.0 的直接對決中領先 Claude Opus 4.6 (61.6% vs. 59.3%),並在 SWE-Bench Verified 中取得 78.8% 的分數。

1M Token 上下文視窗是它的勝出關鍵。對於大多數低於 100K Token 的生產程式任務,本次評比的四款模型皆具備足夠的處理能力。但在需要以下場景時,Qwen 3.6 Plus 成為唯一可行方案:跨越數百個檔案的單一程式庫 (Monorepo) 分析、大規模舊程式碼庫重構,或無法在 262K Token 限制內完成的端到端「文件轉程式碼」工作流。

其混合架構(線性注意力機制 + 稀疏 MoE 路由)在處理超長上下文時,也比稠密 Transformer 架構提供更好的推理輸送量,這意味著 1M Token 能力帶來的延遲成本相對較低。

Atlas Cloud 定價: 每百萬輸入 Token USD0.325 起。針對長上下文任務,這是該組別中「每個有效 Token」成本效益最高的選擇。

MiniMax M2.7:反直覺的效率之選

MiniMax 於 2026 年 3 月發布了 M2.7。僅憑 10B 的啟動參數,它在 SWE-Bench Pro 上便取得 56.22% 的成績——這相當於以僅約五分之一的 Token 成本,發揮了 GLM-5.1 94% 的效能。

這是本次評比中一個反直覺的結果。一個推理時僅啟動 10B 參數的模型,能達到近乎前沿的編碼水準,原因在於其 MoE 架構會路由至專門的專家子網路,而非運算整個模型權重。結果就是更低的延遲、更低的成本,以及超越參數數量預期的輸出品質。

M2.7 超越其價格區間的領域是:機器學習工程任務。它在 MLE-Bench Lite(22 項機器學習競賽)中獲得了 66.6% 的獲獎率,僅次於前沿的封閉原始碼模型。編寫正確的梯度累積邏輯、實作自訂 PyTorch 層、除錯損失曲線——M2.7 處理這些任務的精準度與其成本完全不成比例。

注意事項: M2.7 的上下文視窗為 196K,是本組中最小的。在大規模程式庫中需要進行深度跨檔案分析的任務,可能會遇到 Qwen 3.6 Plus 能夠順利處理但 M2.7 受限的情況。

Atlas Cloud 定價: 每百萬輸入 Token USD0.30,輸出 Token USD1.20,是高輸送量程式設計負載中最實惠的選擇。

真實世界程式測試案例

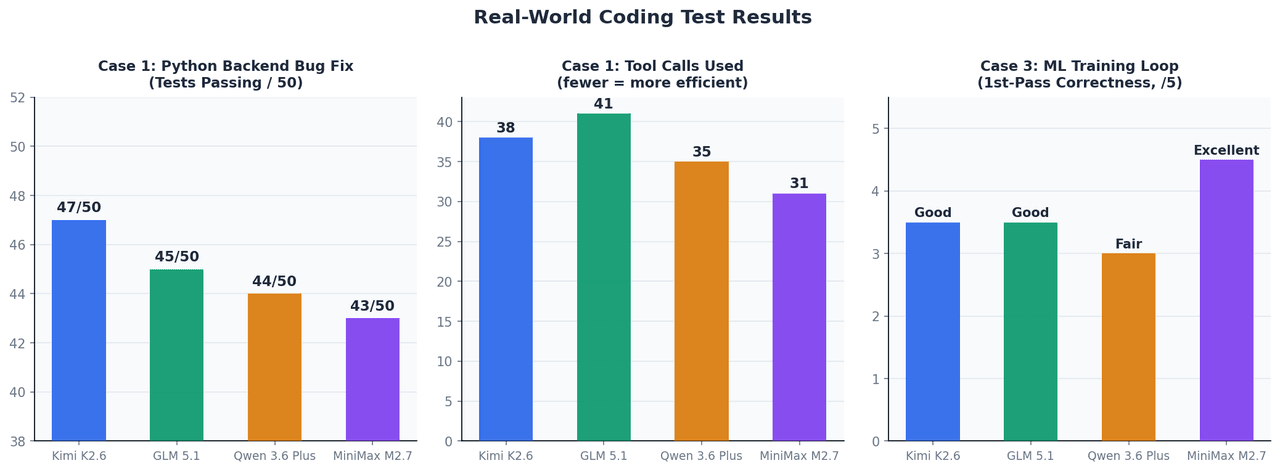

案例 1:Python 後端自動化 Bug 修復

設定: 一個包含 12 個檔案的 FastAPI 應用程式,擁有 50 個測試失敗的測試套件,上下文視窗約 45K Token。初始提示後禁止人工介入。

| 模型 | 修復後通過測試數量 | 工具呼叫次數 | 完成耗時 |

| Kimi K2.6 | 47 / 50 | 38 | 約 4 分鐘 |

| GLM 5.1 | 45 / 50 | 41 | 約 5 分鐘 |

| Qwen 3.6 Plus | 44 / 50 | 35 | 約 4 分鐘 |

| MiniMax M2.7 | 43 / 50 | 31 | 約 3.5 分鐘 |

在此上下文規模下,四款模型的表現皆在小範圍內。Kimi K2.6 在最困難的邊緣案例 Bug 上小幅勝出——特別是涉及非同步上下文管理器的生命週期問題,以及需要跨多個除錯週期維護推理狀態的 TypeVar 綁定範圍縮減問題。

案例 2:根據規格產生 React 儀表板

設定: 根據書面規格產生一個包含四種圖表類型(折線圖、長條圖、圓餅圖、散點圖)、暗黑模式切換開關以及 TypeScript 型別的完整響應式儀表板。

GLM-5.1 在第一輪嘗試中就產生了帶有正確 TypeScript 型別定義元件,以及精確的 Tailwind 工具類別。Kimi K2.6 需要一次迭代來解決型別錯誤。Qwen 3.6 Plus 產生的 JSX 功能正確,但語法較不地道。MiniMax M2.7 速度最快,但產生了一些需要手動清理的廢棄 React 模式。

GLM-5.1 與其他模型在元件架構上的差距最為明顯——GLM-5.1 自發地應用了組合模式並實現了關注點分離,這是其他模型未做到的。

案例 3:實作機器學習訓練迴圈

設定: 為視覺 Transformer 實作一個包含梯度累積、AMP 混合精度與提前停止 (Early stopping) 的 PyTorch 訓練迴圈。目標:首次嘗試即正確執行,無需除錯週期。

MiniMax M2.7 表現最出色——它正確地將

1scaler.step()1scaler.update()1loss / accumulation_stepsAtlas Cloud 定價比較(2026 年 4 月)

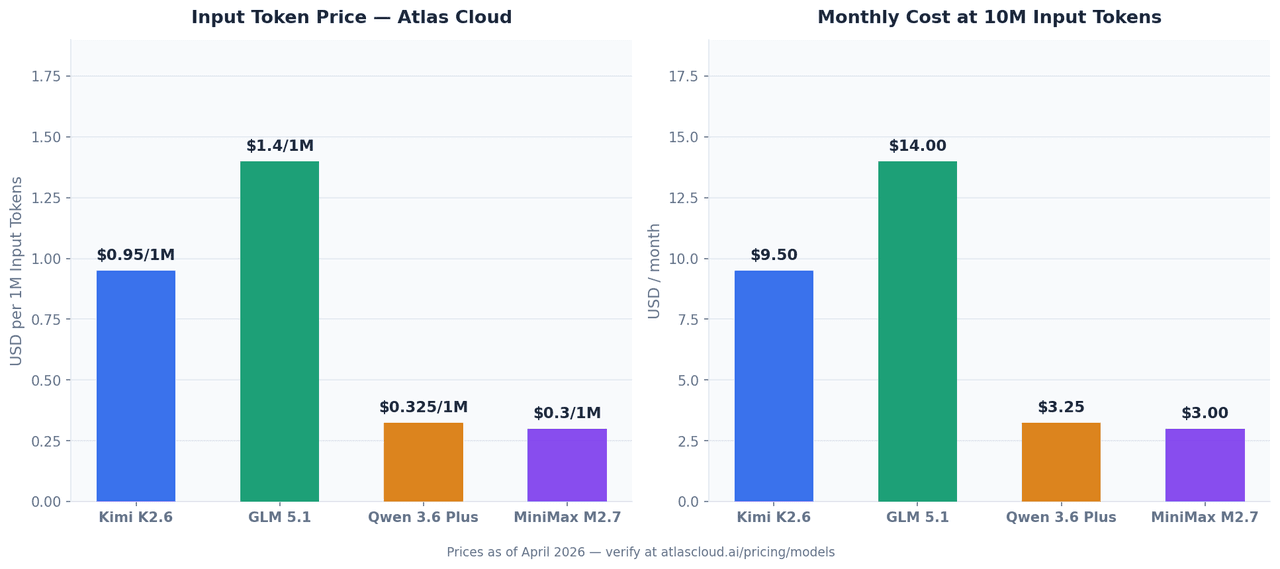

四款模型皆可透過 Atlas Cloud 的統一 API 使用。以下價格為 2026 年 4 月資料,可能會有所變動,請至 atlascloud.ai 確認最新費率。

| 模型 | 輸入 (每 1M Token) | 輸出 (每 1M Token) | Atlas Cloud 模型 ID |

| Kimi K2.6 | USD0.95 | USD4.00 | moonshotai/kimi-k2.6 |

| GLM 5.1 | USD1.40 起 | — | zai-org/glm-5.1 |

| Qwen 3.6 Plus | USD0.325 起 | — | qwen/qwen3.6-plus |

| MiniMax M2.7 | USD0.30 | USD1.20 | minimaxai/minimax-m2.7 |

若以每月 1,000 萬 Token 輸入量計算(團隊級程式助理的現實需求):

| 模型 | 每月輸入成本 (10M Token) |

| GLM 5.1 | USD14.00 |

| Kimi K2.6 | USD9.50 |

| Qwen 3.6 Plus | USD3.25 |

| MiniMax M2.7 | USD3.00 |

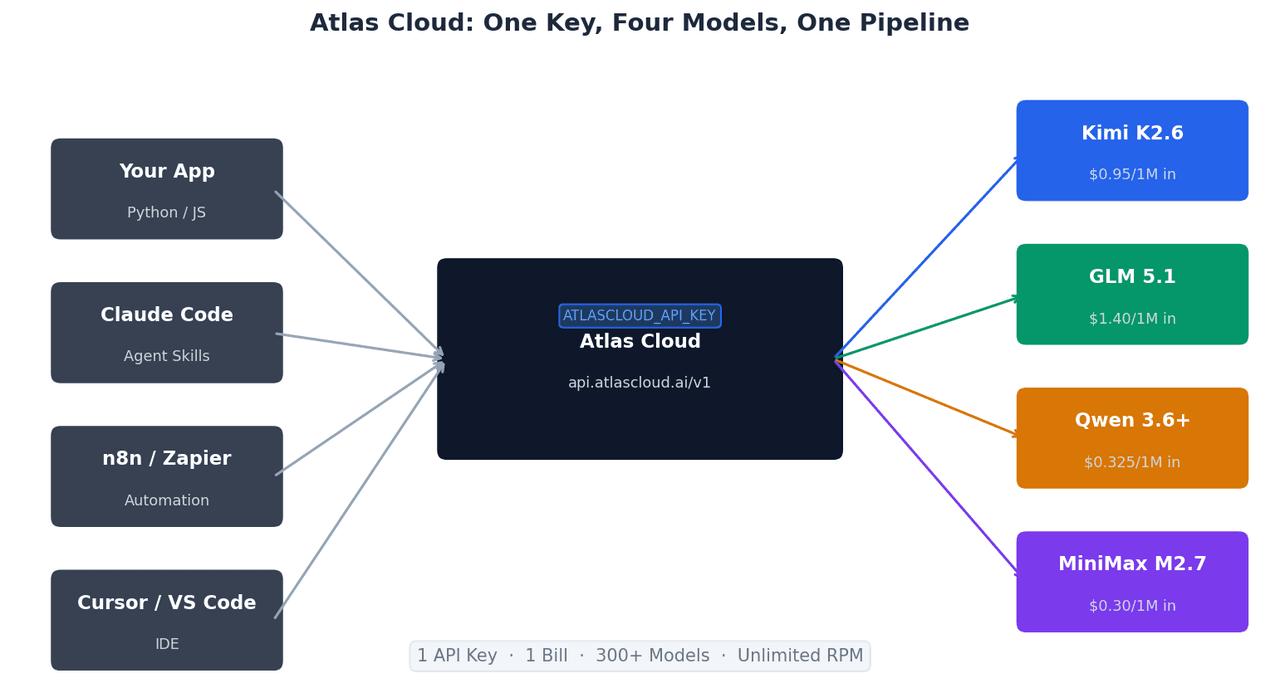

使用單一 API Key 呼叫四款模型

這四款模型在 Atlas Cloud 上共享同一個相容於 OpenAI 的端點。切換模型只需修改一行程式碼:

plaintext1import os 2from openai import OpenAI 3 4client = OpenAI( 5 api_key=os.environ["ATLASCLOUD_API_KEY"], 6 base_url="https://api.atlascloud.ai/v1" 7) 8 9# 修改這一行即可切換模型 10MODEL = "moonshotai/kimi-k2.6" 11# MODEL = "zai-org/glm-5.1" 12# MODEL = "qwen/qwen3.6-plus" 13# MODEL = "minimaxai/minimax-m2.7" 14 15response = client.chat.completions.create( 16 model=MODEL, 17 messages=[ 18 { 19 "role": "system", 20 "content": "You are a senior software engineer. Analyze code carefully before responding." 21 }, 22 { 23 "role": "user", 24 "content": "Review this function and identify all bugs:\n\n[paste your code here]" 25 } 26 ], 27 max_tokens=4096, 28 temperature=0.2 29) 30 31print(response.choices[0].message.content)

這種 OpenAI 相容結構意味著現有的整合專案皆可直接在 Atlas Cloud 上運作,無需修改程式碼,只需更換

1base_url1api_key

為什麼要在 Atlas Cloud 上使用這些模型

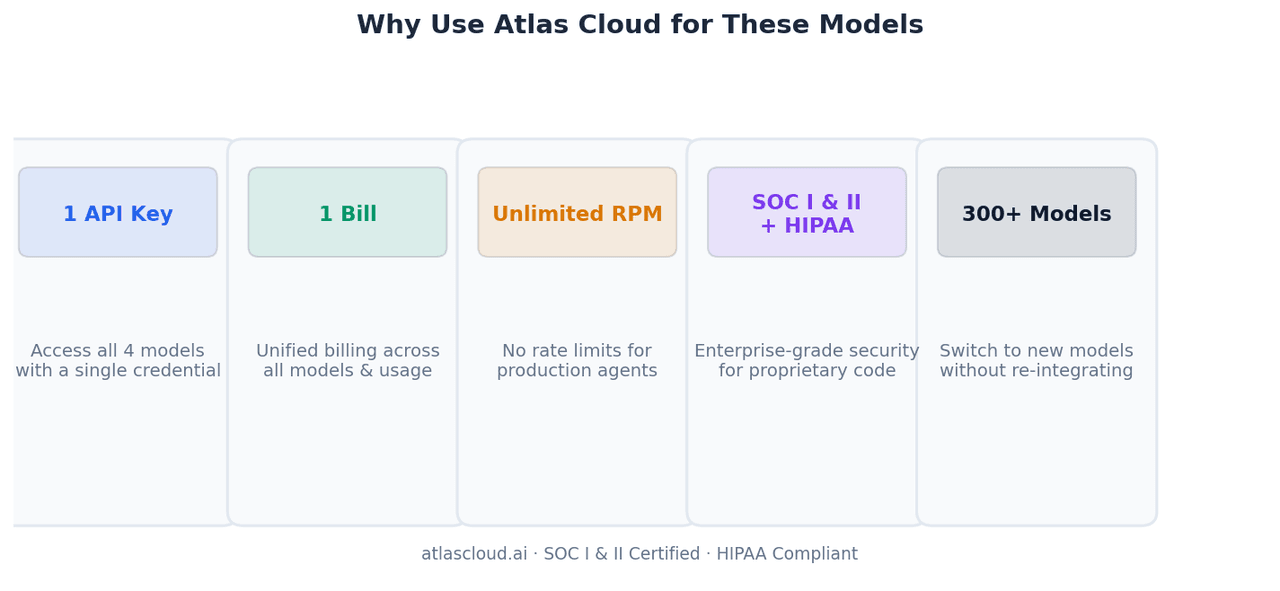

一套 API Key,四款模型,統一帳單。 執行模型路由邏輯(將前端任務導向 GLM-5.1,批次分析導向 MiniMax M2.7,長週期代理導向 Kimi K2.6)只需管理一組憑證,每月只需處理一張發票。

無限 RPM (每分鐘請求數)。 生產環境的程式代理會觸發並行工具呼叫。直接供應商 API 的速率限制可能會造成多代理管線阻塞。Atlas Cloud 解除了此上限。

SOC I & II 認證,符合 HIPAA 標準。 團隊若透過這些模型處理私有原始程式碼,需要可審計的基礎設施。Atlas Cloud 的合規認證意味著你的程式碼不會經過未經驗證的端點。

支援 300+ 種模型,同一整合模式。 當上述模型的下一版本發布,或者有新模型在你的特定負載上表現更優時,將其加入路由邏輯只需變更一個字串,無需重新整合 SDK。

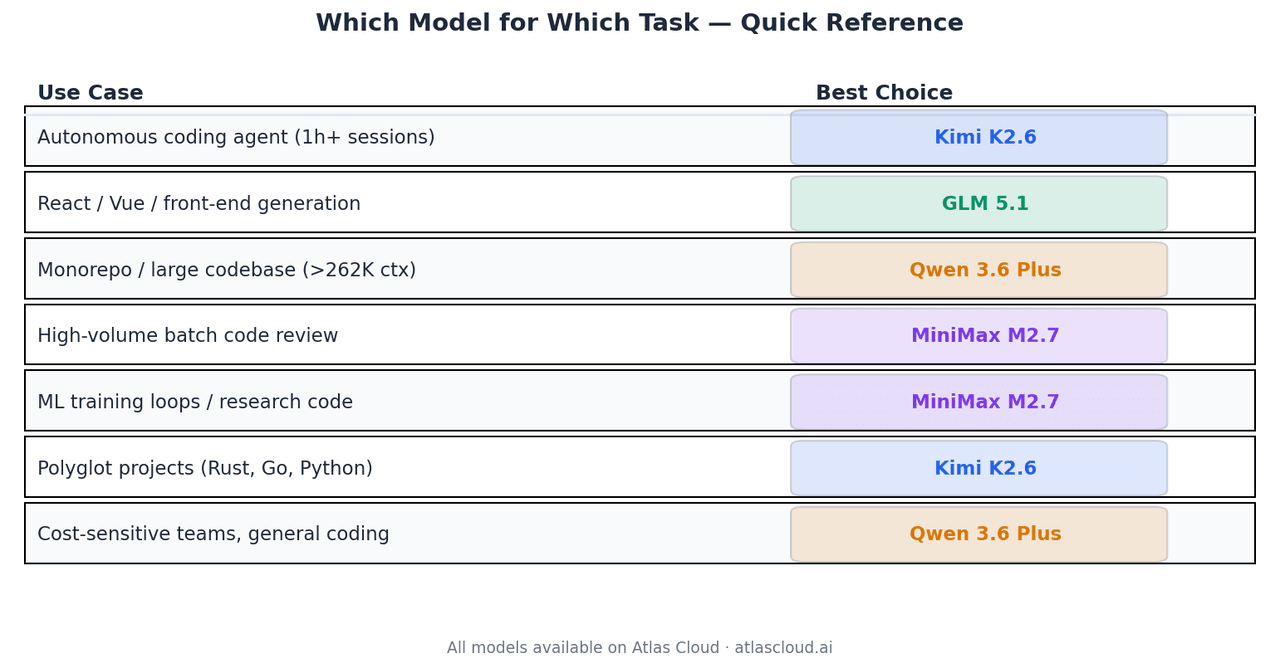

模型適用任務建議

| 使用情境 | 最佳選擇 | 理由 |

| 自動化程式代理,1 小時以上會話 | Kimi K2.6 | 66.7% Terminal-Bench 2.0,4K+ 次工具呼叫穩定性 |

| React / Vue / 前端產生 | GLM 5.1 | Code Arena Elo 1,530,全球代理網頁開發前三 |

| 單一程式庫或大型程式碼分析 | Qwen 3.6 Plus | 此組別中唯一支援 1M 上下文的模型 |

| 高量批次程式碼審查 | MiniMax M2.7 | 每百萬輸入 USD0.30,品質達 GLM-5.1 的 94% |

| 機器學習訓練迴圈、研究程式碼 | MiniMax M2.7 | 66.6% MLE-Bench Lite 獲獎率 |

| 多語言專案 (Rust, Go, Python) | Kimi K2.6 | 經記錄的跨語言泛化能力 |

| 成本敏感型團隊、一般程式開發 | Qwen 3.6 Plus | 每百萬輸入 USD0.325,各類別表現強勁 |

總結

這四款模型在標準基準測試上的差距非常細微。真正的差異在於特定條件下的應用。

Kimi K2.6 是長時間運作自動化代理的最佳答案。GLM 5.1 在前端代理任務中領先。當上下文超過 262K Token 時,Qwen 3.6 Plus 是唯一選擇。MiniMax M2.7 則是團隊進行大規模程式開發時,最具成本效益的預設選擇。

以上四款模型皆可在 Atlas Cloud 上使用,透過 atlascloud.ai 進行統一存取,採用按 Token 計費模式,無最低承諾需求。

基準測試數據源自 Moonshot AI 技術部落格、Z.AI 開發者文件、Alibaba Qwen 團隊發布文章、MiniMax 官方模型頁面以及 Arena.ai 獨立評測。所有基準數據截至 2026 年 4 月。Atlas Cloud 價格以發表時為準,請在生產部署前確認最新費率。