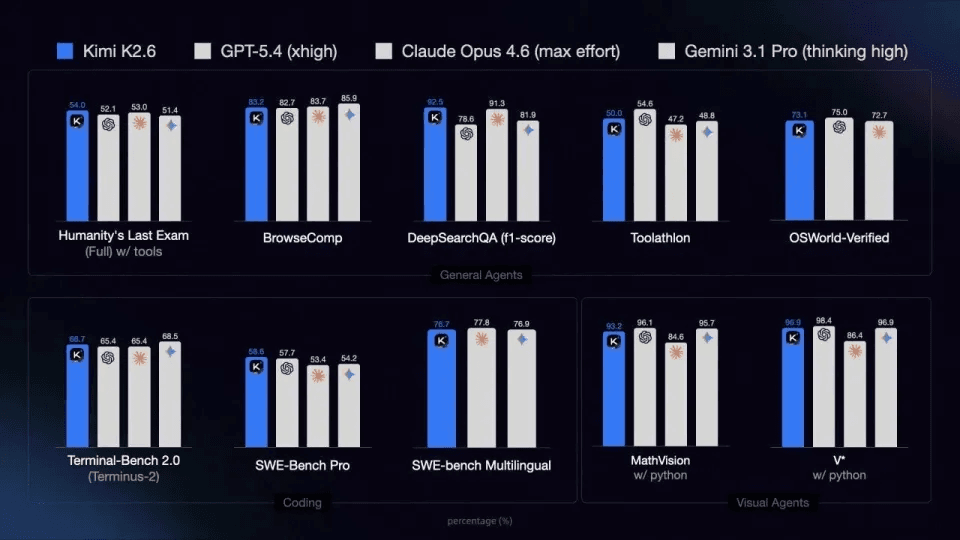

Kimi 剛剛發布了 K2.6——已在 HuggingFace 開源,並與 GPT-5.4、Claude Opus 4.6 和 Gemini 3.1 Pro 進行了基準測試。它在 Humanity's Last Exam、DeepSearchQA 和 SWE-Bench Pro 上均優於上述三者,代碼能力較 K2.5 提升近 20%,平均任務步驟減少了 35%,且在 Agent 工作負載下的定價僅為 Claude Opus 4.6 的 1/8。

如果你正在運行 AI Agent 並希望將 K2.6 接入現有工具鏈,本指南涵蓋了四大主流框架——Claude Code、OpenCode、OpenClaw 和 Hermes Agent,並通過 atlascloud.ai 提供統一的 API 端點。後半部分將展示 K2.6 運行時的實際表現。

快速參考

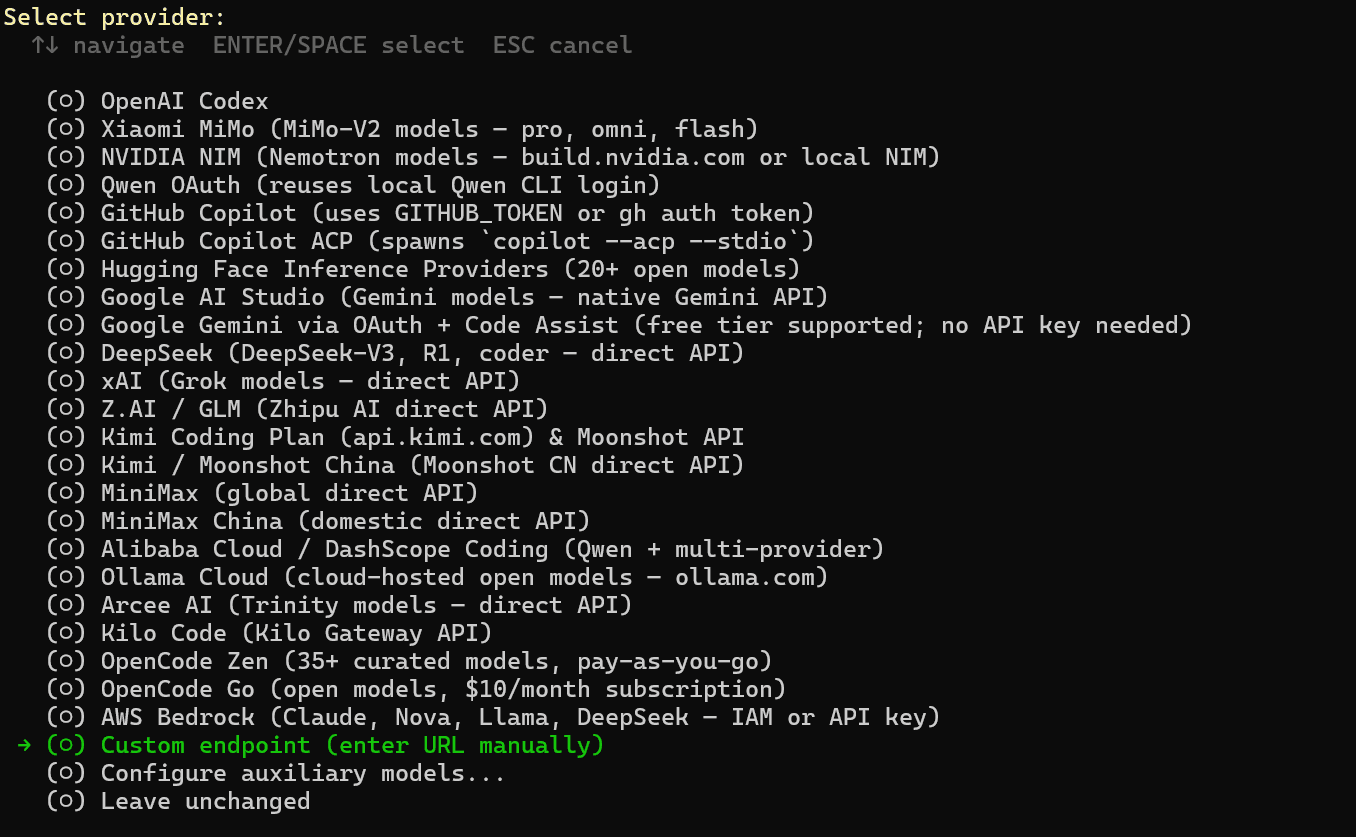

| 工具 | 配置位置 | 切換模型 | 注意事項 |

| Claude Code | 環境變數 ANTHROPIC_* | 修改環境變數或 /model | 無 |

| OpenCode | ~/.config/opencode/config.json | 編輯 model 欄位 | 必須使用 @ai-sdk/openai-compatible |

| OpenClaw | ~/.openclaw/openclaw.json | 編輯 primary | 需要先啟動 gateway |

| Hermes Agent | 互動式 hermes setup | 重新運行 setup | 模型 ID 格式必須完全正確 |

本文所有教學均在 Windows 使用 WSL2 完成。

第一部分 — 設定

-

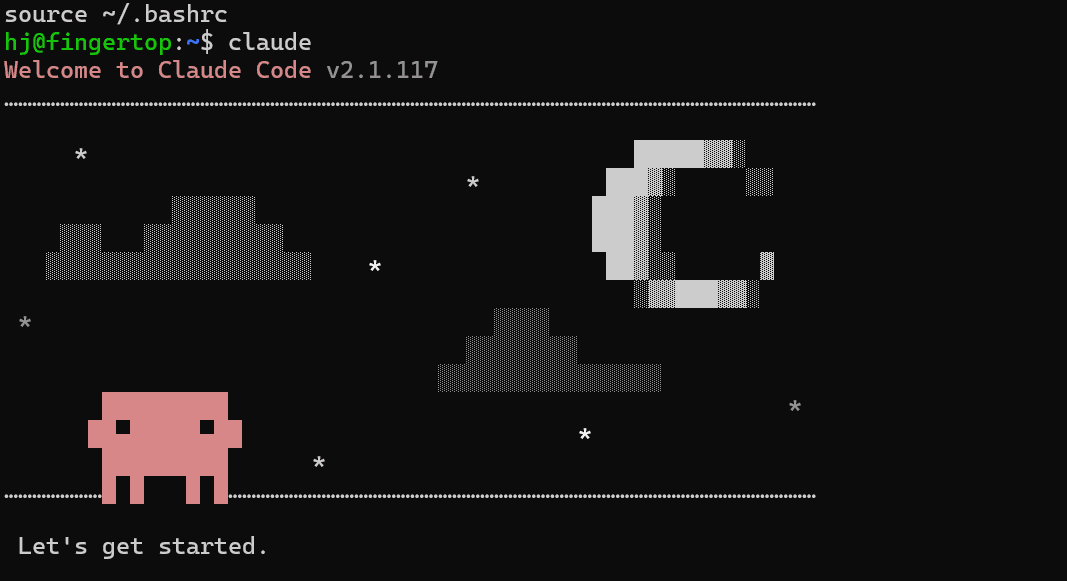

Claude Code (最簡單)

Claude Code 官方下載與說明文件:https://github.com/anthropics/claude-code

Claude Code 原生支援 Anthropic 格式。只需設定三個環境變數即可完成:

plaintext1# 加入到 ~/.bashrc 或 ~/.zshrc 2export ANTHROPIC_BASE_URL="https://api.atlascloud.ai" 3export ANTHROPIC_AUTH_TOKEN="apikey-xxx" 4export ANTHROPIC_MODEL="moonshot/kimi-k2.6" 5export ANTHROPIC_SMALL_FAST_MODEL="moonshot/kimi-k2.6"

執行

1source ~/.bashrc1/model2. OpenCode (設定檔)

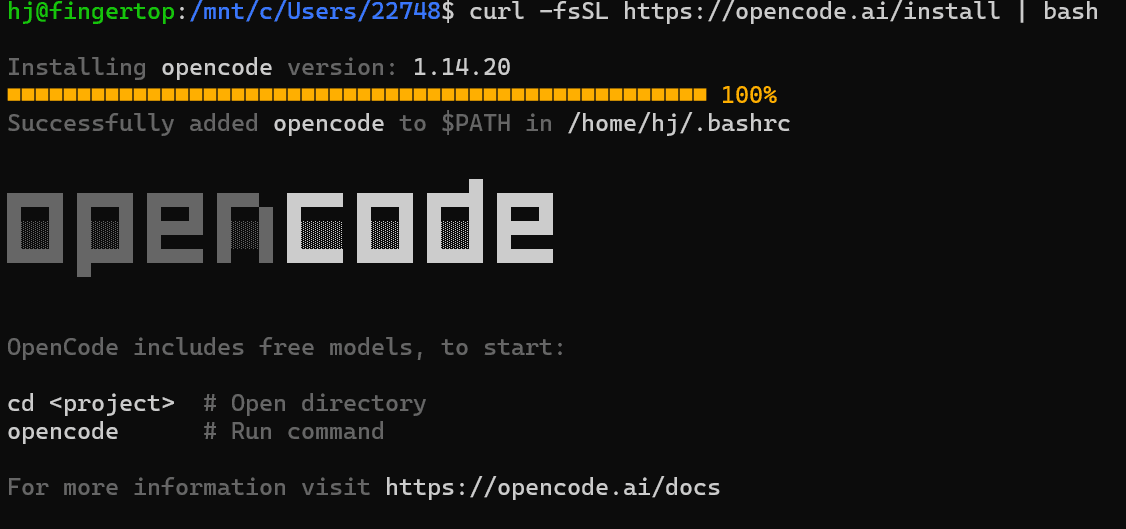

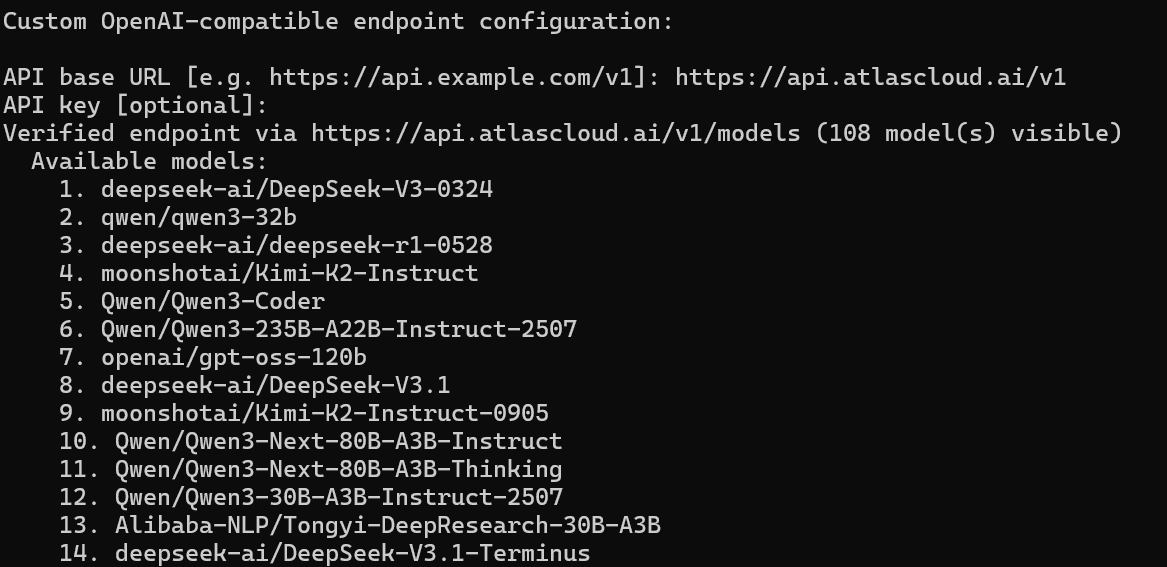

OpenCode 官方下載與說明文件:https://github.com/anomalyco/opencode

OpenCode 內建

1openai1openai/1@ai-sdk/openai-compatible1~/.config/opencode/config.jsonjson

plaintext1{ 2 "$schema": "https://opencode.ai/config.json", 3 "provider": { 4 "atlascloud": { 5 "npm": "@ai-sdk/openai-compatible", 6 "name": "AtlasCloud", 7 "options": { 8 "baseURL": "https://api.atlascloud.ai/v1", 9 "apiKey": "apikey-xxx" 10 }, 11 "models": { 12 "moonshot/kimi-k2.6": { "name": "Kimi K2.6" } 13 } 14 } 15 }, 16 "model": "atlascloud/moonshot/kimi-k2.6" 17}

1model1providerName/modelKey

3. OpenClaw (設定檔 + 雙終端機)

OpenClaw 作為兩個獨立進程運行:閘道器 (gateway) 和 TUI。使用前兩者皆須啟動。

1~/.openclaw/openclaw.jsonjson

plaintext1{ 2 "agents": { 3 "defaults": { 4 "model": { 5 "primary": "custom-api-atlascloud-ai/moonshot/kimi-k2.6" 6 } 7 } 8 }, 9 "models": { 10 "providers": { 11 "custom-api-atlascloud-ai": { 12 "baseUrl": "https://api.atlascloud.ai/v1", 13 "api": "openai-completions", 14 "apiKey": "apikey-xxx", 15 "models": [ 16 { 17 "id": "moonshot/kimi-k2.6", 18 "name": "Kimi K2.6", 19 "api": "openai-completions" 20 } 21 ] 22 } 23 } 24 } 25}

啟動順序:

bash

plaintext1# 終端機 1 2openclaw gateway 3 4# 終端機 2 5openclaw tui

互動式重新配置:

1openclaw configure若要切換模型,編輯

1primary4. Hermes Agent (互動式設定)

Hermes 使用嚮導程式而非設定檔:

bash

plaintext1hermes setup

依序輸入:

- Provider: text

1custom - Endpoint: text

1https://api.atlascloud.ai/v1 - API Key: text

1apikey-xxx - Model: text

1moonshot/kimi-k2.6

重要:模型 ID 必須包含

前綴。若只輸入text1moonshot/會返回 404 錯誤。text1kimi-k2.6

若後續需切換模型,請重新運行

1hermes setup

第二部分 — K2.6 的實際表現

Claude Code × K2.6 — 當 23 個 Agent 同時運行會發生什麼?

當你將 AI 系統推向極限時,什麼會先崩潰?

有開發者決定進行測試——通過 Claude Code 在一整天內同時運行 23 個 Agent。在 26 個對話進程中,系統處理了高頻工具呼叫、多步驟管線以及撰寫 PRD 和 SEO 規劃等長鏈任務。換句話說,這是一個真實的「生產級」工作負載,通常這類情況下系統很容易出錯。

但這次,出現了意想不到的結果。

沒有發生任何 429 速率限制錯誤。

對於任何嘗試過擴展 Agent 工作流的人來說,這一點非常突出。在類似條件下,像 GLM 5.1 這樣的模型往往會頻繁觸發速率限制,導致需要重試、管線斷開以及系統不穩定。相比之下,K2.6 表現得非常穩健——它並不是最快的,但在壓力之下展現了始終如一的可靠性。

而這種區別比聽起來更重要。

因為一旦你超越了單次 Prompt 進入多 Agent 系統,真正的挑戰不再是「模型能否給出好的回答」,而是:

在處理數十個並行任務時,它能否在不導致系統崩潰的情況下保持高品質輸出?

不僅僅是生成,更像是一種規劃

差異不僅在於穩定性。K2.6 處理複雜任務的方式也顯得不同。

當被要求撰寫 PRD 時,模型不只是回應——它主動構建了問題空間。競爭對手分析、用戶故事、功能優先級排序——這些並非明確要求,但系統卻自動生成了,彷彿它深知一份「完整」的 PRD 應該具備什麼架構。

在 SEO 任務中表現類似。K2.6 沒有直接跳轉到關鍵字建議,而是先推斷了搜索意圖,隨後相應調整了內容方向。輸出感覺不像是單純的原始生成,更像是早期的戰略規劃。

這是一種微妙但重要的轉變:

你得到的不再僅僅是答案,而是井然有序的思考過程。

在多 Agent 環境中,這種優勢會疊加。當每個 Agent 都能產出結構化、高品質的輸出時,協調層需要處理的「清理工作」就會大幅減少。

權衡:穩定性帶來的成本

話雖如此,這種表現並非沒有代價。

K2.6 明顯比 GLM 5.1 慢,尤其是在首字延遲 (first-token latency) 方面。延遲並非微不足道——大約高出了一個數量級。在單次互動中這或許可以忍受,但在 23 個 Agent 並行運行時,每一步的小暫停都會累積起來。

部分原因在於其架構。K2.6 採用混合專家模型 (MoE) 設計,總參數約 1 兆,推理時激活約 320 億參數。這種規模帶來了能力的提升,但也帶來了排程開銷。且由於目前仍是預覽版,推理優化尚未完全推送。

因此,權衡顯而易見:

- 如果你注重吞吐量與速度,這點很重要

- 如果你注重大規模下的穩定性與結構化輸出,那麼這一切是值得的

OpenCode × K2.6 — 從一個 Prompt 到九個並行工作流

如果 Claude Code 的實驗展示了 K2.6 在壓力下的表現,那麼 OpenCode 則揭示了另一面:它是如何組織工作的。

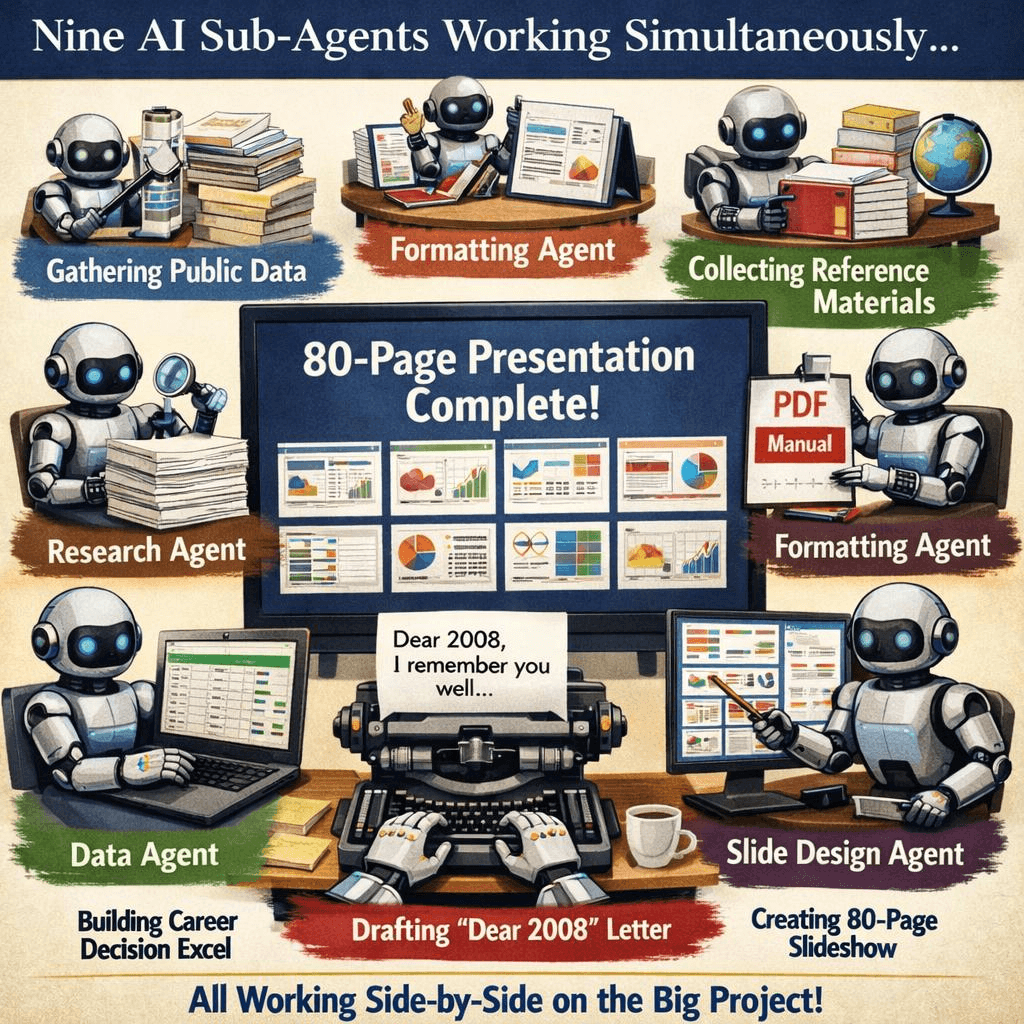

K2.6 引入了一個稱為 AgentSwarm 的協調層,單一的「協調者 (Coordinator)」Agent 可以衍生出數十個專門的子 Agent,每個 Agent 被分配特定角色。系統不再在單一執行緒中一步步處理任務,而是將任務拆解並並行執行多個處理程序。

以一個實際例子為例:

研究人員要求 K2.6 對 Dario Amodei 進行深度剖析,追蹤他從普林斯頓物理學博士到創立 Anthropic 的歷程。K2.6 沒有將其視為單一的長篇生成任務,而是將其分解為九個並行軌道。

每個軌道都有明確職責。一個 Agent 專注於研究,收集公開資訊;另一個處理版面設計,將素材格式化為結構化 PDF;另一個 Agent 建構關鍵職業決策點的資料集。與此同時,寫作 Agent 撰寫了一篇名為《親愛的 2008》的第一人稱敘事文。

這一切都是同時進行的。

結果不只是一個單一輸出,而是一個協調過的套件:一份 80 頁的簡報,輔以結構化數據和格式化文件。原本需要多個工具、多次會話和手動組裝的工作,現在被當作一個統一的產出交付。

為什麼這改變了你使用 AI 的方式

關鍵的推動力在於 技能 (Skill) 系統。

K2.6 不再將每個任務視為獨立的 Prompt,而是允許你載入結構化知識——例如一份高盛報告、競爭對手分析或寫得很好的產品規格書——並將其轉化為可重複使用的「技能」。當子 Agent 運行時,它會繼承該架構:分析風格、語氣,甚至結構。

隨著時間推移,你的系統將轉變為與傳統基於 Prompt 的工作流完全不同的形式。

它變成了可重複的生產管線。

這也導致了對 AI 使用方式的根本轉變:

你不再只是在向模型下指令,而是在管理一個團隊。

如果你正在建構基於 Agent 的工作流,這種差異不容忽視。

所有四種工具均通過

1https://api.atlascloud.ai/v11moonshot/kimi-k2.6常見問題

-

使用 Hermes Agent 與直接呼叫 Kimi K2.6 API 有什麼區別?

核心區別在於 執行 (execution) 與 回應 (response)。

直接呼叫 Kimi K2.6 API,本質上是每次請求獲得單一回應。即使對於複雜任務,你仍需手動拆解、迭代多次 Prompt 並自行合併輸出。這對於簡單或互動式應用有效,但對於結構化工作流來說效率極低。

Hermes 通過引入工作流編排 (workflow orchestration) 改變了這一點。你不再定義單一 Prompt,而是定義一個包含多步驟的管線——研究、規劃、執行等——Hermes 會將每個步驟分配給一個 Agent。這些 Agent 可以相互傳遞結果、驗證中間輸出,甚至在出錯時重試步驟。

在實踐中,這意味著你從「提示工程 (Prompt Engineering)」轉向了任務編排。API 成為系統內的一個組件,而非系統本身。

-

Kimi K2.6 是否適合多 Agent 工作流與自動化?

是的,這正是它表現出色的領域。

在多 Agent 設定中,最大的挑戰通常是:

- 步驟間的一致性

- 長時間運行時的穩定性

- 遵循結構化任務的能力

Kimi K2.6 在這三個方面都表現強勁。在 Hermes 內部使用時,它可以在多個階段保持結構化輸出,並處理複雜任務鏈,而不會破壞格式或偏離方向。

另一個重要方面是自我修正。如果中間結果偏離目標,系統可以重新生成該步驟,而不是帶著錯誤數據繼續執行。這使得它非常適合自動化場景,讓你無需手動監控每一個步驟。

總體而言,它感覺更像是一個可靠的執行層,而不僅僅是一個單純的文字生成器。

-

為什麼 Kimi K2.6 在 Agent 工作流中比其他模型慢?

速度較慢主要是因為它的使用方式,而不僅僅是模型本身。

在標準聊天場景中,你只等待一次回應。而在 Agent 工作流中,單一任務可能涉及多個步驟——每個步驟都需要單獨呼叫模型,加上 Agent 之間的協調開銷。這自然會在每個階段引入延遲。

此外,Kimi K2.6 設計了更複雜的架構(例如 MoE 風格路由),與更小或更優化的模型相比,這可能會增加推理開銷。當與多 Agent 編排相結合時,延遲會變得更加明顯。

然而,權衡之處在於每一步都能產生更高品質、更結構化的輸出,減少了重試或手動修復的需求。因此,雖然它在原始回應時間上較慢,但在工作流層級卻可能更有效率。