yxUS-H6oB1A

1. 起源:兩大模型的碰撞

2026 年 4 月。

OpenAI 推出了 GPT Image 2 —— 文字渲染、世界知識與美學呈現均推向了極限。

「從今天起,AI 生成圖像正式進入了普通人無法與現實區分的時代,正如 AI 生成文字一樣。」

與此同時,X 上出現了兩篇高熱度貼文:

@AI_Jasonyu:

GPT-Image 2 (beta) + Seedance 2.0 —— 這兩者結合簡直是絕配。工作流程很簡單:先由 GPT-Image 2 生成分鏡腳本;確認後,交給 Seedance 2.0 進行長影片生成。這才是 AI 影片該有的樣子。

@arrakis_ai:

The Codex + GPT Image 2 工作流簡直無敵了。這是我今年見過最具顛覆性的 AI 工作流。我丟進去一行草稿 ——「把它轉成漫畫書」—— 隨後就生成了一本完整的漫畫書。

兩篇貼文都指向同一個核心:最強的圖像模型 + 最強的影片模型,串聯成一個工作流。

問題在於:過去要執行這個工作流,你需要 OpenAI GPT Image 2 的額度、字節跳動 (ByteDance) Seedance 2.0 的存取權,以及處理提示詞、輪詢 (polling) 與 CDN 管理的自訂膠水程式碼。

現在,不再需要那麼麻煩。

2. Atlas Cloud 現已支援 GPT Image 2:一把金鑰,兩端連通

Atlas Cloud 剛剛將 GPT Image 2 加入其模型陣容,與完整的 Seedance 2.0 系列(文生影片 / 圖生影片 / 參考圖生影片 / 極速版 / 高解析度版)位於同一個資源池。

| 過去 | 現在 |

|---|---|

| 申請 OpenAI 額度 + 分別整合 Seedance | 僅需一把 Atlas Cloud API Key |

| 兩套 SDK、兩套帳單系統、兩套文件 | 統一端點: text |

| 自行開發輪詢 / CDN / 錯誤處理 | 提供官方 SDK / MCP / Skill 範本 |

實際上僅有兩個端點:

# 生成圖像 (GPT Image 2 / Seedream / Qwen Image ...) POST https://api.atlascloud.ai/api/v1/model/generateImage # 生成影片 (Seedance 2.0 / Kling / Vidu ...) POST https://api.atlascloud.ai/api/v1/model/generateVideo # 共用輪詢端點 GET https://api.atlascloud.ai/api/v1/model/prediction/{id}

Bearer token 認證。執行

1export ATLASCLOUD_API_KEY=...合規聲明:本教學中的每一個角色均由 GPT Image 2 生成為超寫實數位角色。不涉及也不暗示任何真實人物形象。

3. 最強圖像模型 GPT Image 2 + 最強影片模型 Seedance 2.0

市面上大多數 AI 影片教學主要採用以下兩種方案:

方案 A:純文生影片 (直接提示詞 → 15秒影片)

- 問題:單次抽獎,每次重試都在燃燒算力。

方案 B:多鏡頭片段串聯 (6–12 個鏡頭 × 每個 5 秒,縫合在一起)

- 問題:速度慢 (6 次圖生 + 6 次影片生成),成本高,角色一致性極易崩壞。

1drama-director方案 C:一張 9 宮格漫畫頁 + 一段 15 秒動畫影片

- GPT Image 2 生成一張 3×3 的九宮格頁面(將 9 個分鏡畫面繪製到一張圖中,如同漫畫書頁面)。

- Seedance 2.0 I2V 讀取該頁面 + 運鏡提示詞,單次呼叫即可產生 15 秒影片 —— Seedance 將 9 宮格圖像視為其視覺 DNA 與分鏡參考(角色、服裝、場景、光影、色調皆由圖像鎖定),並輸出一段** 15 秒的電影級畫面** —— 你能清楚看到奈米絲線拉緊、郵輪駛入、金屬板切開、水柱噴湧的過程,而非「鏡頭掃過一本漫畫書」。

這種組合的三大優勢:

| 維度 | 9 宮格方案 | 6-8 片段串聯方案 |

|---|---|---|

| 成本 | 1 次圖生 + 1 次影片生成 | 6-8 次圖生 + 6-8 次影片生成 |

| 時間 | 約 3-5 分鐘 | 約 8-15 分鐘 |

| 角色一致性 | 所有 9 宮格在同一畫布上,模型自然保證 | 每個鏡頭獨立生成,需參考圖錨定 |

| 疊代成本 | 修改 image_prompt,重新生成一張圖 | 修改一個分鏡會影響整個流程 |

| 交付成果 | 一部完整的漫畫戲劇影片,可直接發布 | 需要後期剪輯拼接 |

第三點 —— 角色一致性 —— 是串聯工作流中最大的痛點。9 宮格網格本質上是「同一個畫布上的 9 個區域」,因此 GPT Image 2 自然能保證角色長相、衣著在 9 個分鏡中完全一致。這個簡單的設計決策消除了大量後續的工程處理。

4. drama-director:一則訊息,完整工作流

你可以做什麼

在 Claude Code 中,你只需要:

將這段小說情節轉化為漫畫戲劇: <貼上片段>

Claude 識別觸發詞("comic drama" / "storyboard" / "九宮格" / ...),載入

1drama-director- 閱讀內容 → 提煉為 9 個關鍵情節節奏(3×3 閱讀順序)

- 建立完整的 (分鏡描述 + 風格限制)並展示給你審核text

1image_prompt - 單次呼叫 GPT Image 2 → 生成 9 宮格漫畫頁(包含 的text

1image_url)text1.json - 展示圖像;在你確認後,單次呼叫 Seedance 2.0 I2V → 產生 15 秒動態漫畫(包含 的text

1video_url)text1.json - 輸出 Markdown 報告

從頭到尾你只需要輸入兩次訊息:腳本內容,以及「確認」。

底層模型

| 階段 | 模型 ID (預設) | 備註 |

|---|---|---|

| 9 宮格頁面 | text | 若 GPT Image 2 未開放,自動降級為 text |

| 動態影片 | text | 15s / 720p / 1:1,可配置 |

| 極速版本 | text | 更便宜、更快 |

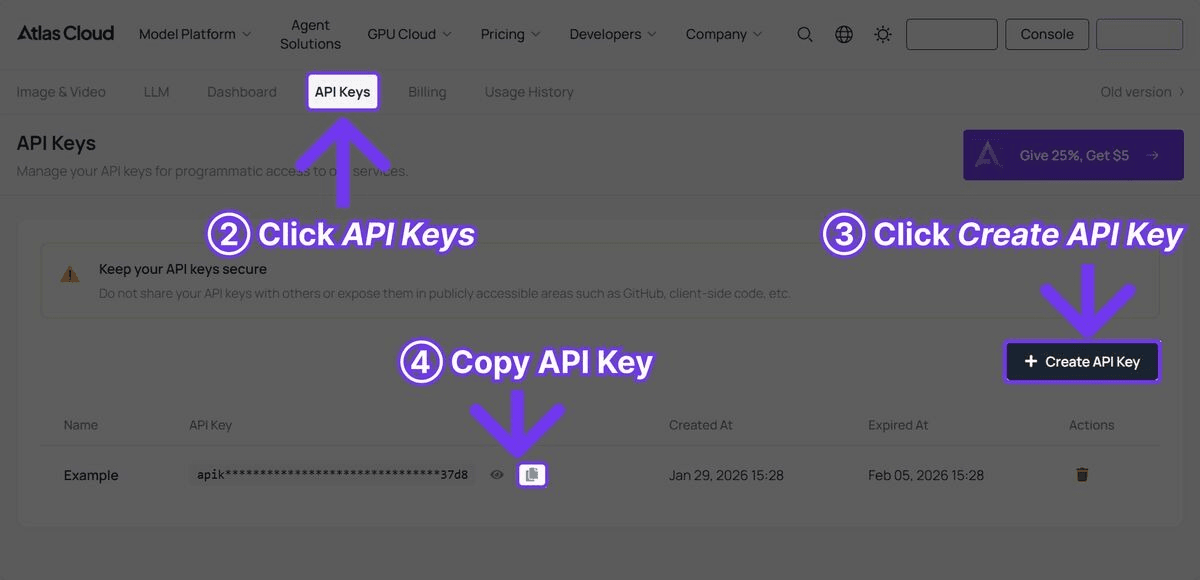

5. 3 分鐘完成安裝

第一步 — 取得 API Key

前往 atlascloud.ai 註冊並在 API Keys 頁面產生金鑰。

export ATLASCLOUD_API_KEY="sk-your-key" echo 'export ATLASCLOUD_API_KEY="sk-your-key"' >> ~/.zshrc

第二步 — 安裝 drama-director skill

將其從 GitHub 克隆到 Claude 的 skills 目錄:

mkdir -p ~/.claude/skills git clone https://github.com/kianaliang-dev/drama-director-skill ~/.claude/skills/drama-director

驗證:

ls ~/.claude/skills/drama-director/ # 預期結果: SKILL.md scripts/

此 skill 是完全獨立的 ——

內建了場景原型路由器(衝擊 / 決鬥 / 追逐 / 旅程 / 氛圍 / 揭露 / 對峙等)、Seedance 引擎硬限制以及雙對比剪輯規則。無需其他插件。text1SKILL.md

第三步 — 腳本冒煙測試

python3 ~/.claude/skills/drama-director/scripts/generate_image.py \ --prompt "a cinematic 3x3 comic book page with 9 panels showing a cyberpunk chase scene, bold black gutters, film noir palette" \ --aspect 1:1

約 30 秒後,你應該會看到一個包含

1image_url6. 示範:《三體》中的「古箏行動」→ 15 秒漫畫戲劇

為什麼選擇這個場景

這是劉慈欣小說中視覺張力最強的片段之一 —— 郵輪在巴拿馬運河被奈米絲線切開。動作密度極高,剛好適合 9 個分節:

巴拿馬運河,深夜。50 根奈米絲線,每根直徑不足人髮的十分之一,像巨大的古箏琴弦般橫跨運河。

「審判日號」郵輪駛來。船頭接觸絲線陣列。船繼續前進 —— 然後被切成了 45 層水平切片。

切片錯位、坍塌。巨大的金屬板像撲克牌一樣墜入運河,激起數層樓高的水柱。

岸上所有人屏住呼吸。這是人類歷史上第一次用這種方法徹底殲滅一艘巨輪上的所有靈魂。

對話過程

你貼入 Claude Code:

將這段《三體》片段轉化為漫畫戲劇(9 宮格 + 15 秒影片): 巴拿馬運河,深夜。50 根奈米絲線橫跨水面... (貼上全文)

Claude 的處理方式:

- 識別觸發詞("comic drama" / "9-panel grid"),載入 。text

1drama-director - 將文章拆解為 9 個節奏(絲線佈陣 → 郵輪駛入 → 初次接觸 → 切層錯位 → 完全切開 → 傾斜崩潰 → 金屬撞擊 → 廣角空鏡 → 岸上觀察者)。

- 向你展示 image_prompt 供確認:

A cinematic 3x3 comic book page with 9 panels depicting "Operation Guzheng" from Three-Body Problem: nanofilaments slicing a cruise ship on the Panama Canal at night. Read order: left-to-right, top-to-bottom. Panel 1 (top-left): 50 ultra-thin nanofilaments stretched taut across the dark Panama Canal at midnight, invisible to the naked eye, faint moonlight catches their threads like guqin strings. Panel 2 (top-center): the massive cruise ship "Judgment Day" approaches, lights ablaze, unaware. Black water, bow cutting foam. Panel 3 (top-right): first contact — the bow touches the nanofilament array, showing no visible resistance, ship continues forward. Panel 4 (middle-left): interior cross-section cutaway, passengers mid-motion, the upper floors beginning to slide a fraction of a meter forward relative to the lower floors. Panel 5 (middle-center, HERO SHOT): the entire ship now visibly sliced into 45 horizontal layers, each layer displacing slightly, still holding its shape, caught mid-collapse. Panel 6 (middle-right): layers start tilting, catastrophic geometric chaos, photorealistic metal fracture lines, debris beginning to fall. Panel 7 (bottom-left): massive metal slabs crashing into the canal, water explosions hundreds of feet high, sparks, reflections. Panel 8 (bottom-center): wide shot, the ship now a collapsing stack of metal pancakes, night lit by emergency flares. Panel 9 (bottom-right): silent aftermath — shore observers (silhouettes) stand frozen, debris field floating on black water, cold moonlight, a single piece of paper drifting down. Style: photorealistic cinematic, Netflix production quality, IMAX-grade detail, dramatic but well-exposed lighting — moonlight on water, ship running lights, emergency flares casting warm highlights. Rich color grading (cool blues in water, warm ambers in ship lights), not overly dark, every panel clearly legible. Bold black panel borders with thin white gutters, consistent ship and canal appearance across all panels. Photorealistic digital character silhouettes on shore. 16:9 aspect ratio, 8K ultra-high resolution, hyperrealistic detail.

你回覆 "confirm"。

- 執行 → 約 1 分鐘後回傳 9 宮格頁面。Claude 將text

1generate_image.py發給你。text1image_url - 你回覆 "OK, continue."

- 遵循內建的 場景原型路由器,Claude 選擇 衝擊 (Impact),疊加 Seedance 引擎約束 + 三段式結構(風格/氛圍 → 動態 → 靜態),撰寫描述現實場景動作的 motion_prompt —— 這裡的 9 宮格影像僅作為視覺 DNA,而非拍攝對象:

Style & Mood: Photorealistic cinematic realism, Netflix production quality, IMAX-grade detail. Midnight palette — cold blues in canal water, warm amber highlights from ship running lights and emergency flares. Dramatic but well-exposed lighting, moonlight rim on water surface, high dynamic range retaining shadow detail. Anamorphic lens flare on lights. 16:9, 8K hyperrealistic textures.

Dynamic Description: Opens extreme wide aerial drone shot — the Panama Canal at midnight, 50 near-invisible nanofilaments stretched taut across the water, catching faint moonlight like a guqin's strings, the cruise ship Judgment Day advancing from frame right, lights blazing. Hard cut to wide static low-angle at the waterline — the bow touches the filament array, no visible resistance, the ship continues forward into frame. Hard cut to medium close-up handheld on the ship's mid-hull — HERO SHOT — the hull now visibly sliced into 45 horizontal layers, each layer displaced a few dozen centimeters, still holding the ship's silhouette mid-collapse. Extreme close-up insert, locked-off — one filament stretched taut catches a pinpoint of moonlight, a thin line of emergency flare light strobing beside it. Hard cut to wide stabilized tracking alongside the hull — the 45 layers begin tilting and sliding, metal slabs shearing free, sparks arcing where severed conduits short, warm amber light spilling from the gaps. Hard cut to extreme wide crane pull-back — massive metal slabs crashing into the canal like fallen playing cards, water columns erupting several stories high, sparks trailing, emergency flares lighting the mist in warm ambers against cold blue water. Final hard cut to medium shot on the shore — a row of silhouetted figures stands motionless, a single torn scrap of paper drifts down from the debris column, catching a soft backlight, floating toward the still-black water at the frame edge.

Static Description: Panama Canal at midnight, concrete canal walls, still black water, low mist. Cruise ship Judgment Day — white superstructure, multi-story, windows fully lit. Nanofilament array strung between two shore anchors, invisible except for occasional moonlight glints. Emergency flares casting warm pools along canal banks. Shore observers as silhouetted photorealistic digital character figures, backlit.

核心概念:Seedance I2V 將 9 宮格圖像視為 視覺 DNA(角色外觀、服裝、場景、光影等皆由此鎖定),隨後生成一個真實的電影場景,而非「掃描漫畫頁」。所以 motion_prompt 必須描述場景內實際發生的動作,遵循 Seedance 偏好的結構:風格/氛圍 → 動態描述(逐鏡頭)→ 靜態描述。

- 2-3 分鐘後影片完成,及text

1video_url送達。text1/tmp/drama_output/report.md

成本估算

| 項目 | 次數 | 估計價格 |

|---|---|---|

| GPT Image 2 9 宮格 (1:1, 1024×1024) | 1 | 依照 Atlas Cloud 控制台定價 |

| Seedance 2.0 I2V (15s / 720p / 1:1) | 1 | 約 0.101/sec×15s≈0.101/sec × 15s ≈ 0.101/sec×15s≈1.5 |

| 總計 | 約 1.5−1.5 - 1.5−2 / 集 |

相較於單鏡頭 T2V 抽獎或 6-8 鏡頭串聯,成本降低了 1/5 – 1/8。

7. 常見變體

| 需求 | 只需添加 |

|---|---|

| 切換動漫風格 | "Use Japanese anime style, Studio Ghibli palette" |

| 美式漫畫感 | "Use American superhero comic style" |

| 電影感 / Netflix 風格 | "Use photorealistic cinematic Netflix style, 16:9, 8K" |

| TikTok/Reels 直式 | "Use 9:16 nine-panel layout" |

| 1080p 輸出 | "Render video at 1080p" |

| 節省成本 | "Use seedance-2.0-fast" |

| 以真實照片鎖定主角 | "Main character looks like this: [image URL], reference this look in the 9-panel" |

| 12 分鏡而非 9 分鏡 | "Use a 4×3 twelve-panel grid" (可行,但 15s 塞 12 個節奏會顯得匆促) |

8. Atlas Cloud 官方 MCP + Skill 庫(開發者用)

若你想自建工作流或從 Claude Desktop / 其他 Agent 呼叫原子工具,Atlas Cloud 提供開源資源:

官方 Skill 庫

npx skills add AtlasCloudAI/atlas-cloud-skills

Repo: https://github.com/AtlasCloudAI/atlas-cloud-skills

其中的

1references/image-gen.md1references/video-gen.md1drama-director1generate_image.py1generate_video.py官方 MCP Server (9 項工具)

claude mcp add atlascloud -- npx -y atlascloud-mcp

npm: https://www.npmjs.com/package/atlascloud-mcp

安裝後,這 9 項 MCP 工具即可在 Claude Desktop / Claude Code 使用:

| 工具 | 用途 |

|---|---|

text | 列出所有可用模型 |

text | 關鍵字搜尋模型文件 |

text | 取得模型規格與定價 |

text | 提交圖像生成任務 |

text | 提交影片生成任務 |

text | 關鍵字 → 一鍵生成(自動搜尋模型) |

text | OpenAI 相容 LLM 對話 |

text | 輪詢 / 取得結果連結 |

text | 上傳本地檔案 → 公開連結 |

9. 工作流背後的設計決策

1. 為什麼是 9 宮格而不是 6 或 12? 3×3 平衡了閱讀性與資訊密度 —— 讀者一眼即知,且 9 個節奏足以承載完整的戲劇弧線。12 格會導致單格過小;4 格則無法講好故事。

2. 為什麼 1 張圖 + 1 段影片足夠? Seedance 2.0 I2V 現已強大到能根據 9 宮格自動產生相機運鏡與局部動畫 —— 原本需要人力後期剪輯的工作,現在已委派給生成模型。

3. 為什麼 motion_prompt 描述「場景動作」而非「掃描漫畫」? 我們曾嘗試將 motion_prompt 寫成「相機掃過漫畫頁」,結果 Seedance 忠實地生成了「相機對準一本漫畫書」。正確的心智模型是:9 宮格影像為 視覺 DNA + 分鏡參考,而 motion_prompt 描述的是場景實際動作(拉絲、切割、崩塌、噴湧)。這就是為什麼

1drama-director4. 為什麼 Skill 禁用年齡詞彙? 使用統一的功能性描述詞 —— "figure / character / photorealistic digital character" —— 更合規且產出更穩定。年齡詞彙容易觸發模型的保守模式。

5. 為什麼預設 1:1 而非 16:9? 9 宮格本質是 3×3 的方形。1:1 能讓每一格都是乾淨的正方形。16:9 會將每一格拉長為絲帶狀 —— 對漫畫分鏡不利。若需直式輸出,請使用 9:16。

10. 常見問題

Q:API 費用如何計算? A:Atlas Cloud 隨用隨付,無訂閱費。15 秒影片約 $1.5-2。

Q:GPT Image 2 還沒出現在模型清單? A:

1generate_image.pyQ:9 宮格長得像一張大雜繪? A:強化 Prompt:「各分鏡間有粗黑邊框,留有清晰白邊,3x3 漫畫佈局,分鏡明確隔離」。

Q:角色在不同格子長得不一樣? A:添加 "same character across all panels, same outfit" 或是將角色設定放在提示詞開頭。

Q:影片看起來像靜態圖? A:motion_prompt 不夠強 —— 加入 "camera dolly-in, diagonal sweep, panels come alive sequentially, subtle parallax, wind, smoke"。

Q:影片連結過期? A:Atlas Cloud CDN 預設 24 小時過期,請及時下載。

Q:支援中文腳本嗎? A:支援。Claude 會自動將腳本改寫為英文 Prompt(模型更喜歡英文)。報告會保留原始中文劇情描述。

11. 後續方向

安裝完後,試試這些提示詞:

- 經典科幻片刻:「水滴擊毀艦隊」、「黑暗森林打擊」、「二向箔」。

- 網文高潮:任何玄幻/驚悚小說的戰鬥或高潮場景。

- 新聞視覺化:將突發新聞拆解為 9 宮格漫畫劇,用於社群貼文。

- 產品廣告:將產品功能拆成 9 個節奏,製作 15 秒漫畫風 Story Ad。

想擴充 Skill(語音旁白、字幕、B-roll、多集串聯)?直接編輯

1~/.claude/skills/drama-director/SKILL.md1scripts/相關連結

- Atlas Cloud 控制台:https://atlascloud.ai

- 官方 Skill 庫:https://github.com/AtlasCloudAI/atlas-cloud-skills

- 官方 MCP Server:https://www.npmjs.com/package/atlascloud-mcp

- 本教學 Skill:text

1https://github.com/kianaliang-dev/drama-director-skill