旧的 AI 动作工具充满了闪烁和肢体扭曲。 🫠

最大的缺陷?手指崩坏、面部表情僵硬,以及像橡皮筋一样拉伸的身体。

进入可灵 2.6。 它完全解决了动作控制问题:

1️⃣ 细腻细节: 完美的手指和微表情。不再模糊。

2️⃣ 骨骼锁定: 智能绑定保持身体比例 100% 一致。没有形变。

我们运行了 4 项极端的"魔鬼"测试来证明这一点。结果令人惊叹。 👇

01 数据:遥遥领先于竞争对手

看完开场后,你可能会问:"市面上支持视频参考的模型很多,万象 (Wan) 也有扎实的动作控制。凭什么说可灵 2.6 遥遥领先?"

观看下方的对比演示,答案显而易见 👇:

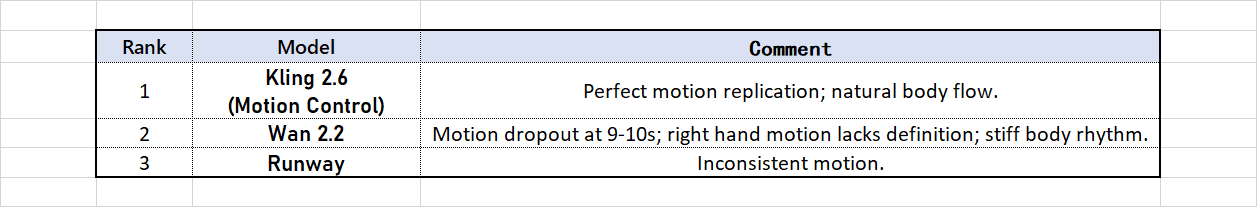

[分析解读] 这套拳击灵感的舞蹈动作呈现了一个重大的压力测试:快速的手臂绕环与躯干有节奏的律动相结合。

可灵 2.6 动作控制带来了大师级的表现。 注意 0:09 处的手部翻转动作:可灵不仅完美复制了轨迹,还捕捉到了动能——你可以感受到从肩部肌肉传导出的动量。它在保持绝对结构完整性的同时,最大化了节奏保真度,没有出现任何形变或塌陷。

如果你认为科比那个片段只是个偶然——或者我们只是**运气好,"精挑细选"**了一个完美的种子——请看这张官方盲测图表。数据胜于雄辩。

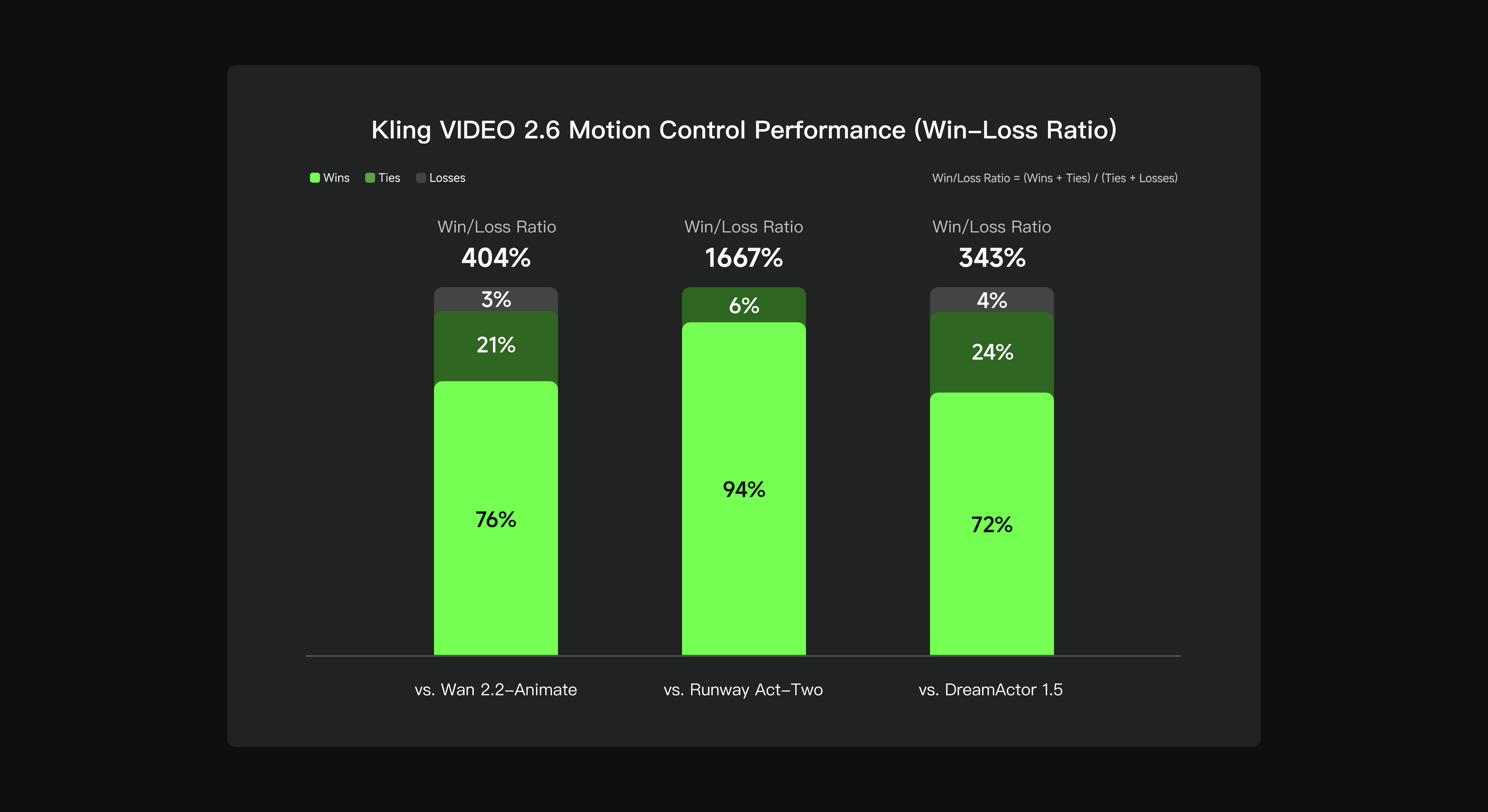

逻辑很简单:绿色代表可灵获胜,深绿色是平局,而顶部那一小撮灰色?那是它唯一输掉的地方。

看看左侧对比 Wan 2.2。万象是一个强劲的对手,这就是为什么你会看到更多的深绿色(约 21% 平局)。但即便如此,可灵仍以 76% 的超高胜率占据统治地位。

至于中间的 Runway?可灵的胜率飙升至 94%。这是一场彻底的碾压。这与我们在测试中的感受完全一致:在动作幅度和精准度方面,Runway 已经被甩在了身后。

02 深度分析:解决 5 大核心瓶颈

此前,AI 视频控制严重依赖于运动笔刷 (Motion Brushes) 和提示词。这需要手动遮罩并绘制方向箭头——这是一个乏味的过程,且仅限于基本的平移或摇晃效果。随后出现了"视频参考"方法,但它们往往无法在遵循提示词与精确动作复制之间取得平衡。

可灵 2.6 通过视频到视频 (Video-to-Video) 上下文中的深度语义映射克服了这一障碍。 它的概念非常精妙:你提供静态图像(视觉身份)和参考视频(动作灵魂)。

这实际上为你的角色穿上了一件隐形的动捕 (MoCap) 服。入门门槛彻底消失了——无需昂贵的摄影棚设备;用智能手机随手拍摄的视频就能完美胜任。

完美同步的动作、表情和口型

复杂动作的高超表现

精准的手部表现

30秒长镜头动作

场景细节尽在掌控

03 零门槛:每个人的算力自由

在看到这些巨大的升级后,你可能会感到兴奋与焦虑并存:"为了实现这种级别的动作控制,我是否需要购买价值数千美元的高端 GPU?我是否需要像开发者一样写代码才能搭建好本地环境?"

答案是否定的。

我们正处于技术的一个临界点,创作障碍正在消失。阻碍创作者的唯一因素就是算力瓶颈和复杂的安装过程。

这正是 Atlas Cloud 存在的意义。

我们处理复杂的部署和重活,让你能够纯粹专注于创作自由。打破这最后一堵墙的成本比一杯咖啡还便宜。我们将好莱坞级的 VFX 视觉特效从昂贵的工作站带进你的日常生活。

工具已经准备就绪。剩下的就看你的想象力了。点击 启动 Atlas Cloud,开启你的导演之旅。 🚀

在 Atlas Cloud 上,你可以:

- 直观对比输出质量与成本

- 决定哪个模型能为你特定的工作流提供最佳的投资回报率 (ROI)

如何在 Atlas Cloud 上使用模型

Atlas Cloud 让你能够并排使用模型 —— 首先在 Playground 中测试,然后通过统一的 API 调用。

方法 1:直接在 Atlas Cloud Playground 中使用

方法 2:通过 API 访问

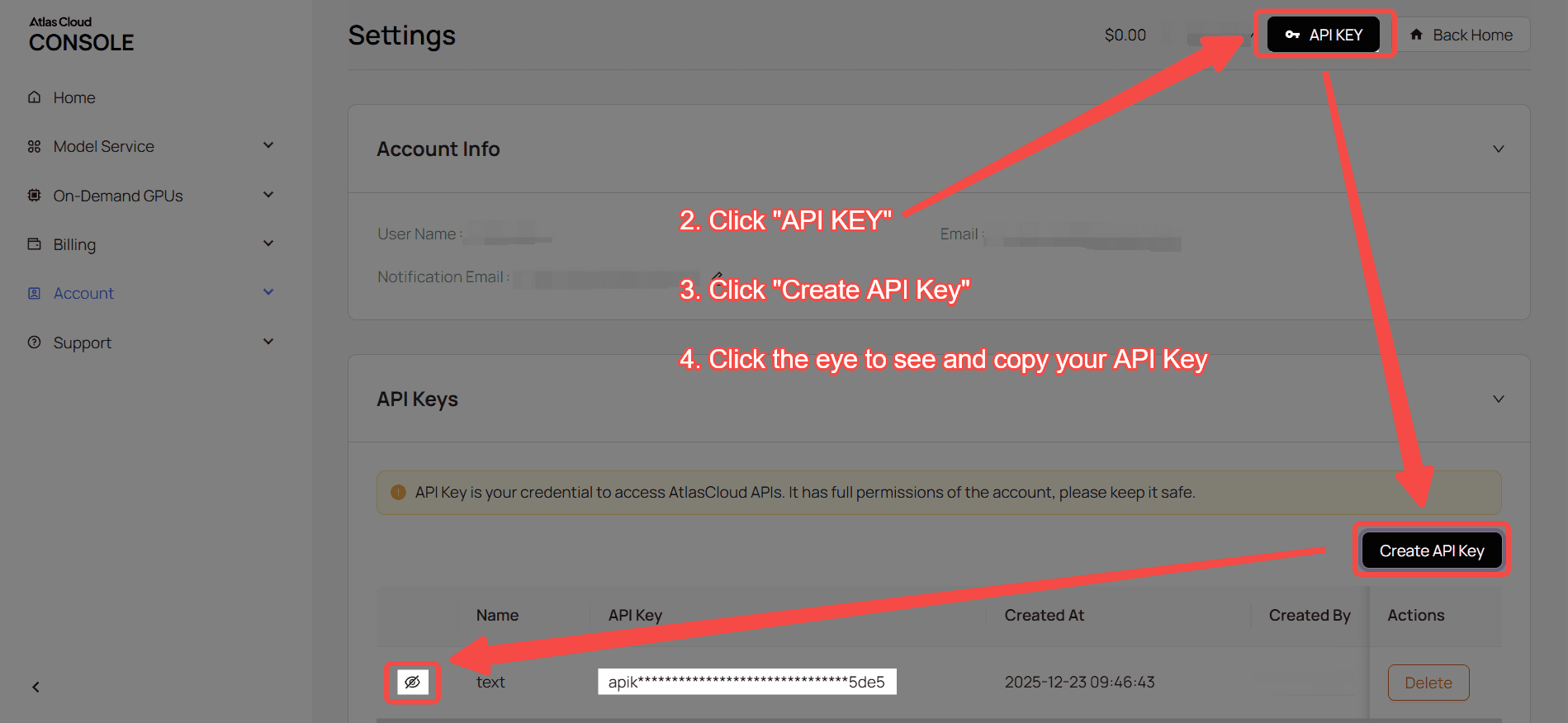

第一步:获取你的 API Key

在你的 控制台 中创建一个 API Key 并复制以备后用。

第二步:查看 API 文档

在我们的 API 文档中查看端点、请求参数和认证方式。

第三步:发起你的第一次请求(Python 示例)

示例:使用 kwaivgi/kling-v2.6-std/motion-control 生成视频

plaintext1import requests 2import time 3 4# 步骤 1:开始视频生成 5generate_url = "https://api.atlascloud.ai/api/v1/model/generateVideo" 6headers = { 7 "Content-Type": "application/json", 8 "Authorization": "Bearer $ATLASCLOUD_API_KEY" 9} 10data = { 11 "model": "kwaivgi/kling-v2.6-std/motion-control", 12 "character_orientation": "video", 13 "image": "https://static.atlascloud.ai/media/images/dc0051d2c757c405abcc66db9e73731b.jpg", 14 "keep_original_sound": True, 15 "prompt": "Replace the characters in the video with the characters from the image, while strictly maintaining the characters' movements.", 16 "video": "https://static.atlascloud.ai/media/videos/29538d8995e0a9ba017469aab11b2172.mp4" 17} 18 19generate_response = requests.post(generate_url, headers=headers, json=data) 20generate_result = generate_response.json() 21prediction_id = generate_result["data"]["id"] 22 23# 步骤 2:轮询结果 24poll_url = f"https://api.atlascloud.ai/api/v1/model/prediction/{prediction_id}" 25 26def check_status(): 27 while True: 28 response = requests.get(poll_url, headers={"Authorization": "Bearer $ATLASCLOUD_API_KEY"}) 29 result = response.json() 30 31 if result["data"]["status"] in ["completed", "succeeded"]: 32 print("Generated video:", result["data"]["outputs"][0]) 33 return result["data"]["outputs"][0] 34 elif result["data"]["status"] == "failed": 35 raise Exception(result["data"]["error"] or "Generation failed") 36 else: 37 # 正在处理中,等待 2 秒 38 time.sleep(2) 39 40video_url = check_status()