GLM 4.7 在 Atlas Cloud 上可用

我们很高兴地宣布,GLM 4.7 现已在 Atlas Clouds 上可用。

GLM 4.7 是 Z.ai 最新发布的、经过聊天优化的开源大型语言模型,已在 Hugging Face 上发布,专为现实世界的智能代理、推理和编码场景而设计。Atlas Clouds 将这些开放权重作为完全托管、生产级 API 提供,定价清晰、简单:

- 输入每 100 万个 token 仅需 $0.44

- 输出每 100 万个 token 仅需 $1.74

这使得 GLM 4.7 成为一个有吸引力的选择,当您需要接近前沿水平的能力,同时又偏好开源模型、可预测的成本和 OpenAI 兼容的接口时。

Z.ai 的 GLM 4.7 介绍

GLM 4.7 是 Z.ai 提供的大规模语言模型。它延续了非常受欢迎的 GLM 4.6 的发布,并定位为现实应用(而不仅仅是基准测试)的通用骨干。

GLM 4.7 延续了这一方向。它具有:

- 聊天优化:提供官方聊天模板以实现一致的行为

- 开源:在允许商业使用的许可下发布

- 生态系统友好:可直接与 Transformers、vLLM、SGLang 等标准工具配合使用

在 Atlas Clouds 上,我们通过 OpenAI 兼容的 API 提供 GLM 4.7,使其易于集成到现有代理和应用程序中。

GLM 4.7 的主要特性

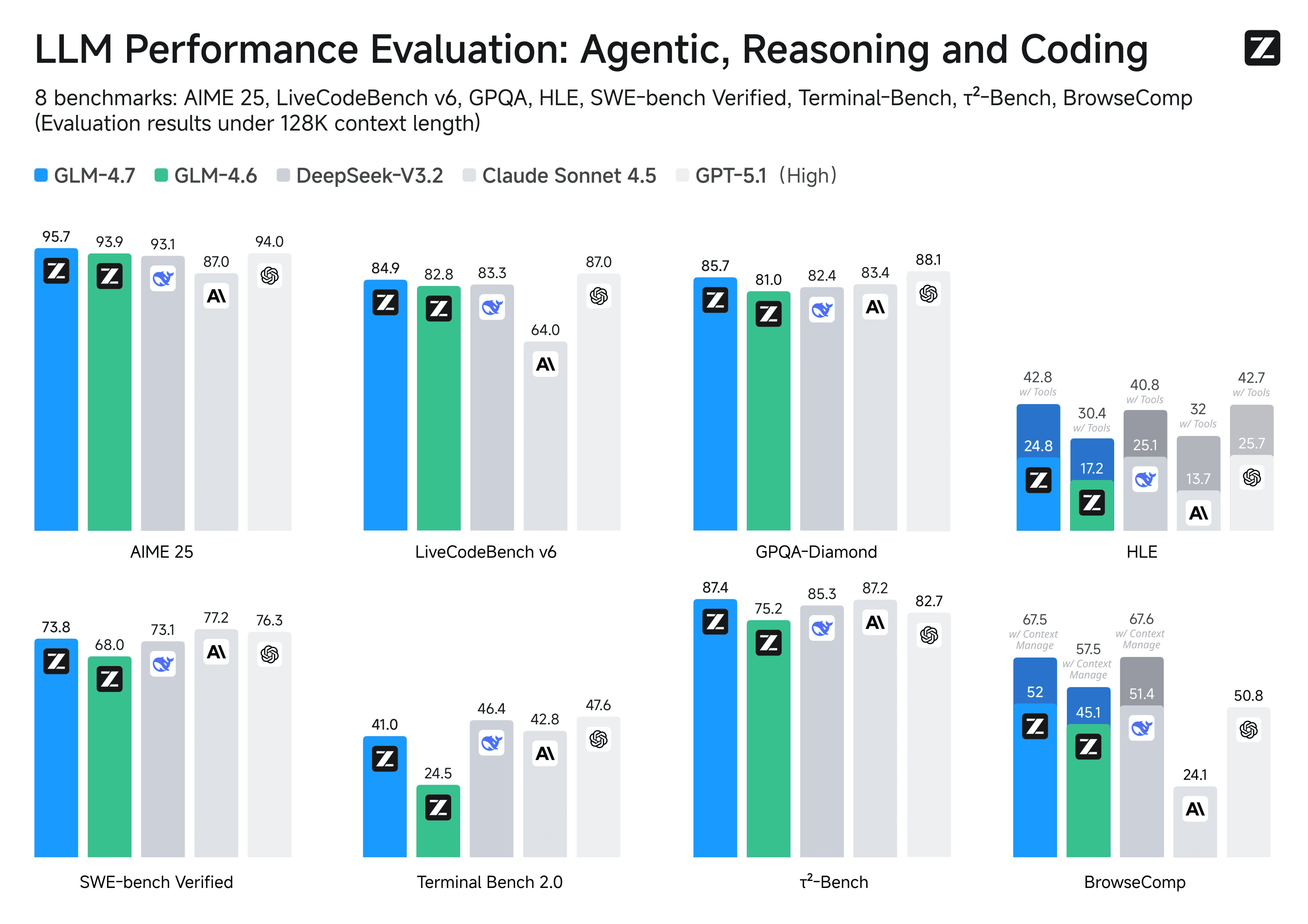

GLM‑4.7 被设计为您的下一代编码和推理伙伴,在现实世界基准测试和代理场景中相比 GLM‑4.6 有了显著的提升。以下是其基准性能快照。

核心编码性能

GLM‑4.7 在多语言、代理式编码和基于终端的工作流方面取得了实质性改进。在关键基准测试中,它显示出相比 GLM‑4.6 的显著提升:

- SWE‑bench Verified:73.8%(+5.8 分)

- SWE‑bench Multilingual:66.7%(+12.9 分)

- Terminal Bench 2.0:41.0%(+16.5 分)

除了原始分数,GLM‑4.7 在复杂的编码代理中能"三思而后行",在 Claude Code、Kilo Code、Cline 和 Roo Code 等主流框架中表现出明显更强的性能。这使其在需要跨多步保持规划、工具使用和代码编辑一致性的长周期软件任务中特别有效。

Vibe 编码与 UI 质量

GLM‑4.7 在团队称之为"Vibe Coding"方面也迈出了一大步——即生成不仅能工作,而且外观和感觉都很棒的代码的能力:

- 生成更干净、更现代的网页,结构更好。

- 生成外观更好的幻灯片,布局和尺寸更准确。

如果您关心前端质量、设计润色或内容呈现,GLM‑4.7 在 UI 生成方面的改进是立即可见的。

工具使用与网络浏览

使用工具的代理是另一个主要焦点。GLM‑4.7 在工具增强型工作流中显示出显著的提升,在以下方面取得了强劲的结果:

- τ²‑Bench:87.4 对比 GLM‑4.6 的 75.2

- BrowseComp 和 BrowseComp‑Zh,包括 BrowseComp w/ Context Manage,它能更稳健地处理多步浏览和上下文管理。

在实践中,这意味着 GLM‑4.7 在以下方面表现更好:

- 按正确的顺序调用工具。

- 在与 API 或网络交互时管理和重用上下文。

- 处理需要导航和综合的复杂、搜索密集型任务。

复杂推理与数学

GLM‑4.7 在数学和通用推理方面也带来了实质性的提升。在带工具的 HLE(人类最后的考试)基准测试中,它达到了:

- 42.8%,比 GLM‑4.6 提高了 12.4 分。

在更广泛的推理基准测试集(MMLU‑Pro、GPQA‑Diamond、AIME 2025、HMMT、IMOAnswerBench 等)中,GLM‑4.7 的性能始终与当前顶级模型处于同一水平,同时保持完全开源。

更好的日常 AI:聊天、创意、角色扮演

除了编码和基准测试,GLM‑4.7 在日常使用中也感觉更好:

- 更自然、更具吸引力的聊天。

- 更强的创意写作和叙事控制。

- 更一致的角色扮演和个性处理。

无论您是构建开发者工具、代理还是面向用户的助手,这些定性改进都使 GLM‑4.7 更易于集成到实际产品中。

GLM 4.7 的应用

AI 编码与智能办公自动化

应用场景

- 代码生成、重构和调试(Python、Java、JavaScript、SQL)

- 自动文档生成和代码审查

- 智能办公助手:邮件起草、报告摘要、电子表格分析

- 内部企业系统的流程自动化

案例:一个由 GLM-4.7 构建的西班牙语学习网站

翻译与跨语言智能

应用场景

- 高质量机器翻译

- 跨语言信息检索和摘要

- 多语言客户支持和知识库问答

- 技术文档和产品内容的本地化

案例:将西班牙语翻译成英语

- 翻译前:

Puedo escribir los versos más tristes esta noche.

Escribir, por ejemplo: "La noche está estrellada, y tiritan, azules, los astros, a lo lejos."

El viento de la noche gira en el cielo y canta.

Puedo escribir los versos más tristes esta noche.

- 翻译后:

I can write the saddest lines tonight.

Write, for example: "The night is starry, and the stars shiver, blue, in the distance."

The night wind revolves in the sky and sings.

I can write the saddest lines tonight.

内容创作与虚拟角色

应用场景

- 博客写作、营销文案和社交媒体内容

- 视频、游戏和互动故事的剧本创作

- 用于客户服务、教育和娱乐的虚拟角色

- 具有一致个性的个性化对话代理

案例:撰写一篇 X 帖子以推广 GLM 模型

如果没有限制,你会创造什么?🌌

有了 GLM-4,唯一的限制就是你的想象力。

我们从头开始重建了引擎,使其比以往任何时候都更智能、更快、更直观。无论你是创办一家初创公司还是创作一首交响乐,我都已准备好帮助你将其变为现实。

让我们一起创造非凡。

👉 [链接]

#GLM4 #人工智能 #创新 #创造力 #新时代

智能搜索与深度研究

应用场景

- 跨大型文档集合进行语义搜索

- 研究助手:文献综述、比较分析、洞察提取

- 企业知识管理和内部问答系统

- 通过多源推理进行决策支持

案例:对 Claude Opus 4.5 和 Gemini 3 Pro 进行竞争性比较分析,预测其未来发展,并将结果以一个少于 100 字的寓言故事形式呈现,该故事说明了它们的比较和演变。

石匠建造了纯逻辑的高塔,深邃但孤立。织女将视觉和声音编织成巨大的挂毯,连接但肤浅。石匠解决了谜题;织女看到了道路。

他们融合了。石匠用结构框定了织女的丝线;织女为石匠的高塔装上了窗户。他们成为了一个新的心智——深邃如基岩,广阔如天空——结构完美而又无限敏锐,超越竞争而进化,同时掌握思想的深度和世界的广度。

结论

GLM 4.7 定位为一个平衡的、通用的语言模型,旨在实现实际应用而非狭窄优化的基准测试。GLM 4.7 适用于语言性能稳定、跨语言支持和可扩展部署是关键考量的场景。随着更多技术细节的公布,更深入的评估将能进一步阐明其在不断发展的大型语言模型格局中的作用。

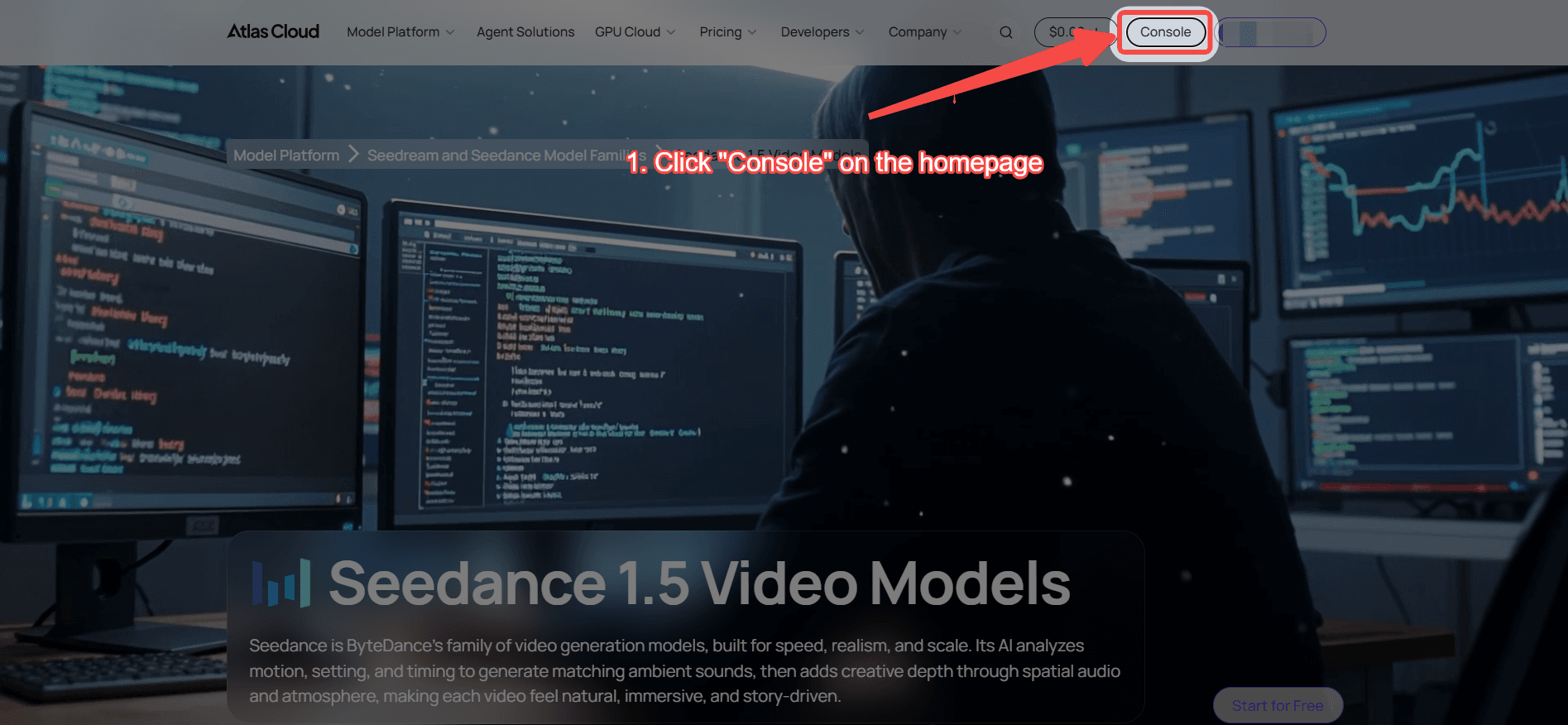

如何在 Atlas Cloud 上使用 GLM-4.7?

Atlas Cloud 让您首先在 Playground 中使用 GLM 4.7,然后通过单个 API 进行使用。

方法 1:直接在 Atlas Cloud Playground 中使用

在 Playground 中试用 GLM 4.7。

方法 2:通过 API 访问

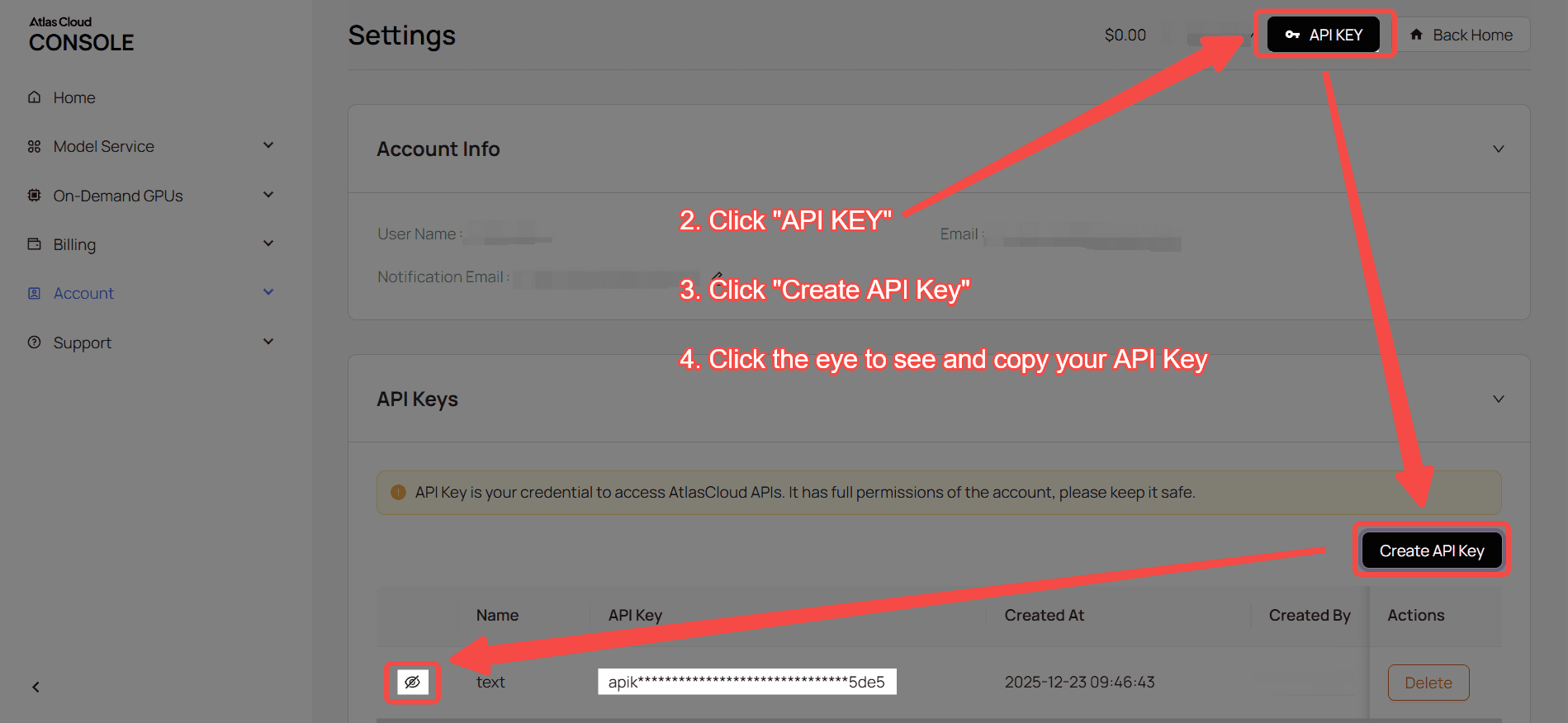

步骤 1:获取您的 API 密钥

在您的 控制台 中创建 API 密钥并复制以备后用。

步骤 2:查看 API 文档

在我们的 API 文档 中查看端点、请求参数和身份验证方法。

步骤 3:发出您的第一个请求(Python 示例)

示例:发送一个使用 GLM 4.7 的请求。

plaintext1import requests 2 3url = "https://api.atlascloud.ai/v1/chat/completions" 4headers = { 5 "Content-Type": "application/json", 6 "Authorization": "Bearer $ATLASCLOUD_API_KEY" 7} 8data = { 9 "model": "zai-org/glm-4.7", 10 "messages": [ 11 { 12 "role": "user", 13 "content": "what is difference between http and https" 14 } 15 ], 16 "max_tokens": 65536, 17 "temperature": 1, 18 "stream": True 19} 20 21response = requests.post(url, headers=headers, json=data) 22print(response.json())