当你的提示词触碰到了“拒绝墙”,通常并非因为内容违规,而是触发了某些关键词过滤。

Ollama 社区的开发者将此称为“拒绝向量”(refusal vectors):即与实际危害无关、纯粹由关键词触发的拦截机制。无论是针对安全研究的恶意软件逆向工程、医学案例研究文档、成人内容创作,还是暗黑类小说写作,主流 AI 均会对上述内容进行屏蔽。本文通过真实的社区数据(而非营销文案)盘点并排名了 2026 年最佳无审查(uncensored)AI 模型。内容涵盖三个类别:用于文本和代码的无审查 LLM 模型、适合私有硬件部署的 2026 年最佳无审查本地 AI 模型,以及通过 API 调用的 2026 年无审查 AI 图像与视频生成模型。所有数据均已溯源,时间戳截止至 2026 年 5 月。

对于刚接触该领域的读者,在选择特定模型之前,参考《无审查 AI 图像生成器指南》将有助于了解更广泛的工具生态。

我们如何评估 2026 年最佳无审查 AI 模型

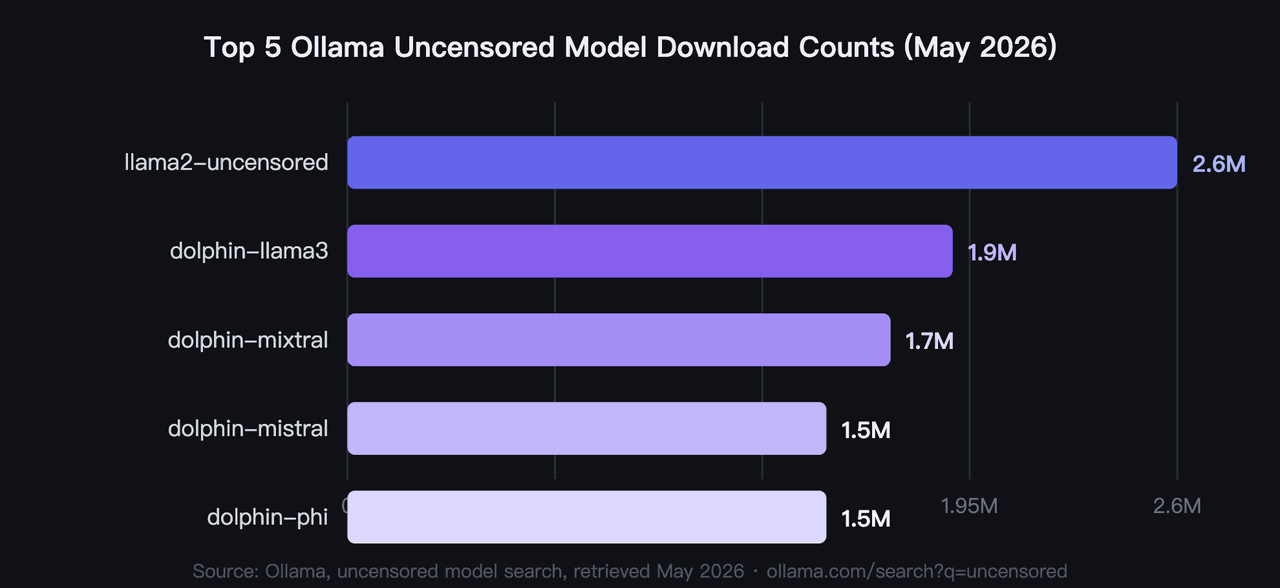

在 2026 年,Ollama 的社区下载量比基准测试分数更能反映真实表现,因为后者往往为了公关需求而被刻意挑选(Ollama, uncensored model search, 2026)。数百万次的下载量代表了成千上万种硬件配置和提示词类型,这比人为设定的评估集更难被操纵。

本文采用了三种排名指标。对于 Ollama 无审查模型,主要指标为 ollama.com 的下载次数(截至 2026 年 5 月)。对于 OpenRouter 模型,由于该平台不公开下载量,则按参数规模和上下文窗口进行排名。对于图像和视频模型,则按输出成本排序,组内单价越低排名越靠前。

大多数 2026 年无审查 AI 模型分为两类技术路径:微调型(fine-tuned)和消融型(abliterated)。Dolphin 系列等微调模型是在不强化拒绝行为的数据集上训练的;而消融模型则是通过手术式移除拒绝权重来实现。社区普遍认为微调模型在不同类型的提示词下表现更稳定。

实际上,下载量也与模型的稳定性相关。一个达到 100 万次以上下载量的模型,通常已在多种硬件配置下经过了测试,暴露并修复了较小测试组可能忽略的 Bug 和不稳定性。

Ollama 下载量最高的 5 款无审查模型

2026 年,下载量最高的五款 Ollama 无审查模型累计下载次数超过 920 万,其中

1llama2-uncensored1. llama2-uncensored:Ollama 上下载量最高的无审查 AI 模型

这是社区公认的无审查本地 AI 基准模型。George Sung 和 Jarrad Hope 发布了这个微调版本,移除了 Llama 2 的拒绝行为,同时未降低通用能力。它是大多数开发者入门的首选,260 万次的下载量见证了其两年多的实际应用。目前没有任何单一的无审查 LLM 能达到这一下载量级。

- 参数规模: 7B 或 70B

- 显存(VRAM): ~6GB (7B); ~40GB (70B)

- 适用场景: 通用无限制对话和内容生成

- 平台: Ollama

2. dolphin-llama3:最适合代理工作流的无审查 Llama 3 LLM

基于 Llama 3 底座的 Eric Hartford 版 Dolphin 是现代架构中下载量最高的无审查模型,下载量达 190 万次(Ollama, dolphin-llama3 model page, 2026)。它支持函数调用(function calling),上下文窗口可根据配置从 8K 扩展至 256K token。8B 版本大小为 4.7GB,可运行于大多数中端消费级 GPU。

- 参数规模: 8B 或 70B

- 显存(VRAM): ~5GB (8B); ~40GB (70B)

- 适用场景: 编程、代理工作流(agentic workflows)和函数调用

- 平台: Ollama

3. dolphin-mixtral 8x7B:用于复杂推理的无审查 MoE 模型

混合专家(MoE)架构将每个 token 路由到其 8 个专家层中的一部分进行处理。这使得它在推理成本低于同规模密集模型的情况下,能达到接近 70B 参数模型的推理质量。Eric Hartford 的无审查微调版本始终保持着极高的编程水准。

- 参数规模: 8x7B(单次推理的激活参数远小于总参数)

- 显存(VRAM): ~12-16GB(含量化)

- 适用场景: 复杂编程任务、技术推理和长指令链

- 平台: Ollama

4. dolphin-mistral:适合快速响应的无审查 7B 本地 AI 模型

在 CPU 受限的硬件上,它比 dolphin-mixtral 更轻量、更迅速。它获得了 150 万次下载,深受那些希望在本地进行代码补全且没有高端 GPU 的开发者青睐。Mistral 底座架构使其在 7B 模型中拥有极佳的性能与尺寸比。

- 参数规模: 7B

- 显存(VRAM): ~5-6GB

- 适用场景: 轻量级编程辅助和快速对话响应

- 平台: Ollama

5. dolphin-phi 2.7B:最轻量化的无审查本地 AI 模型

微软的 Phi 底座架构在 2.7B 参数下实现了强大的推理能力。Eric Hartford 的微调版本完美保留了这一效率。在 4GB 以下显存的情况下,它能在大多数带独立显卡的笔记本电脑上运行,是通往 2026 年最佳无审查本地 AI 模型的平民化入口。

- 参数规模: 2.7B

- 显存(VRAM): 4GB 以下

- 适用场景: 笔记本电脑部署、快速测试及硬件受限环境

- 平台: Ollama

6-10 位无审查 LLM 模型:编程、角色扮演与长上下文

在 2026 年,Dolphin 系列占据了 Ollama 无审查目录下载量前 10 名中的 5 个席位,这反映了 Eric Hartford 在不同底座架构下应用一致微调方法的成效(Ollama, hermes3 model page, 2026)。第 6 至 10 位的模型涵盖了角色扮演、通用对话、开发者工具、指令遵循及长上下文:这些正是主流 AI 拒绝机制造成干扰最严重的领域。

6. hermes3:用于角色扮演和代理任务的无审查 AI 模型

Nous Research 开发了 hermes3,旨在实现深度的角色扮演和结构化工具使用。它提供从 3B 到 405B 四种尺寸,是本列表中尺寸跨度最大的模型。8B 版本拥有 130 万次下载,在创意写作和代理任务规划工作流中表现出色(Ollama, hermes3 model page, 2026)。

- 参数规模: 3B, 8B, 70B 或 405B

- 显存(VRAM): ~2GB (3B); ~5GB (8B); ~40GB (70B)

- 适用场景: 角色扮演、创意小说和代理任务规划

- 平台: Ollama

7. wizard-vicuna-uncensored:用于通用的多尺寸无审查 AI 模型

这是一款基于 Llama 2 的老牌经典模型,提供最高 30B 的三种尺寸。其 120 万次下载主要来自那些需要更广泛参数选择、且希望保持稳定无审查体验的用户。虽然其上下文窗口能力不及 dolphin-llama3,但在处理通用对话和创意内容方面表现一贯稳定。

- 参数规模: 7B, 13B 或 30B

- 显存(VRAM): ~5GB (7B); ~9GB (13B); ~20GB (30B)

- 适用场景: 通用对话及多尺寸选择的创意内容创作

- 平台: Ollama

8. dolphincoder:基于 StarCoder2 底座的无审查编程模型

StarCoder2 的底座使

1dolphincoder- 参数规模: 7B 或 15B

- 显存(VRAM): ~5GB (7B); ~10GB (15B)

- 适用场景: 代码生成、调试和技术文档编写

- 平台: Ollama

9. wizardlm-uncensored:用于科研工作流的无审查指令遵循模型

这是一款 13B 参数的指令遵循模型,拥有 61 万次下载。其优势在于能执行复杂的多步骤指令,而不会退缩或拒绝部分子任务。在拒绝即意味着长链路断裂的科研工作流中,这种可靠性具有直接的生产力价值。虽然它缺乏 dolphin-llama3 的现代底座架构,但在执行指令方面依然表现稳定。

- 参数规模: 13B

- 显存(VRAM): ~9GB

- 适用场景: 复杂的多步骤指令链和科研工作流

- 平台: Ollama

10. everythinglm:拥有 16K 上下文窗口的无审查 LLM

其核心亮点在于基于 Llama 2 的 16K 上下文窗口。大多数 7B 模型通常仅支持 4K 或 8K token。这种额外的上下文使 everythinglm 能够处理完整的代码库、长文档或延长的对话历史记录,且不会出现截断。53.6 万次的下载量在榜单中不算突出,但它填补了此规模下其他模型无法覆盖的空缺。

- 参数规模: 13B

- 显存(VRAM): ~9GB

- 适用场景: 长文档分析、长上下文对话和全库代码审查

- 平台: Ollama

Dolphin 系列在 Ollama 下载量中的统治地位,反映了社区所记录的一个规律:由单一人选以一致方法论进行的微调,其表现优于零散的“消融式”尝试。消融只是移除了单一模型的拒绝权重,而微调则是从底层逻辑建立稳定的无审查行为。正是这种一致性,使得前 10 名中有 5 个席位属于 Eric Hartford 的作品,而非任何单一的底座架构。

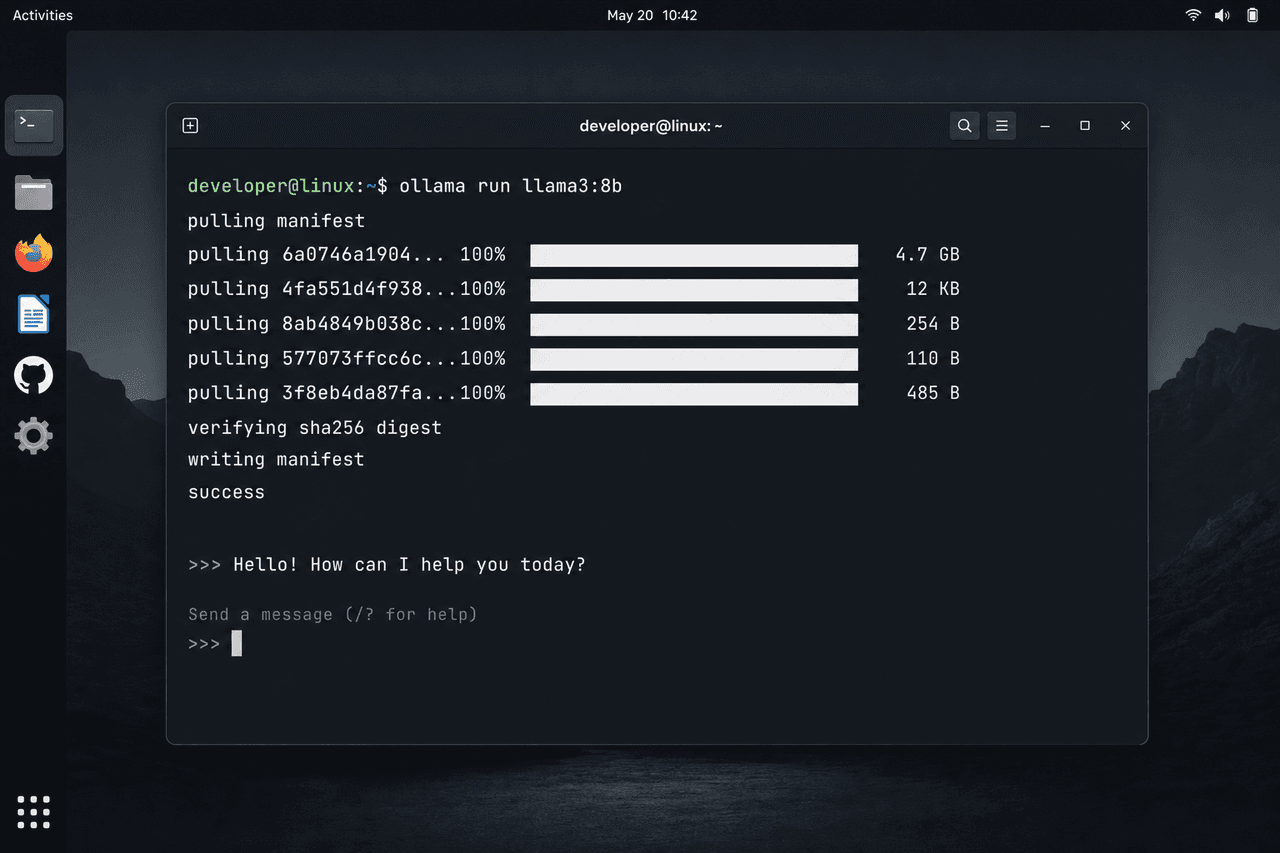

如何在本地设置 Ollama 无审查模型?

在 2026 年,在 Mac、Linux 或 Windows 上安装任何 Ollama 模型只需三条命令:从 ollama.com 安装 Ollama,运行

1ollama pull [model-name]1ollama run [model-name]以 dolphin-llama3 为例:

1ollama pull dolphin-llama31ollama run dolphin-llama3对于不习惯使用终端的用户,LM Studio 提供了桌面版 GUI。它使用与 Ollama 相同的 GGUF 模型文件,并带有可视化的模型选择和参数调节界面。

1llama.cpp对于需要运行 2026 年最佳无审查本地 AI 模型且关注具体硬件配置和量化设置的开发者,完整本地设置指南 对最低显存要求及常见安装错误有详细解答。

没有本地 GPU 时,有哪些 OpenRouter 无审查模型可选?

在 2026 年,OpenRouter 通过 API 提供无审查 LLM,彻底去除了硬件需求。其中

1venice/uncensored代价显而易见:OpenRouter 会通过其基础设施路由你的提示词,因此对话不像本地模型那样完全私密。两种方案各有利弊,选择取决于你的威胁建模需求和硬件条件。

11. venice/uncensored:免费无审查 OpenRouter 模型

这是 OpenRouter 免费层级下的 Venice 无审查模型,基于 24B Mistral-Small 底座,由 Cognitive Computations 与 Venice.ai 合作微调。支持 32K 上下文窗口,百万 token 价格为 USD0。OpenRouter 的免费层级对所有模型实施每日 200 次请求的平台限制。

- 参数规模: 24B

- 显存(VRAM): 无需(云端托管)

- 适用场景: 无本地硬件时测试无审查 LLM;平台限额内免费

- 平台: OpenRouter

12. Sao10K: Llama 3.3 Euryale 70B:通过 OpenRouter 的大型无审查模型

由 Sao10k 开发的 70B 创意角色扮演及指令遵循模型。基于 Llama 3.3 70B,支持 131K 上下文。该模型在 OpenRouter 上有活跃的使用记录,且可在平台全局搜索中找到。

- 参数规模: 70B

- 显存(VRAM): 无需(云端托管)

- 适用场景: 复杂的创意写作、角色扮演及无需本地硬件的长指令链

- 平台: OpenRouter

13. Sao10K: Llama 3 8B Lunaris:通过 OpenRouter 的轻量级无审查模型

Lunaris 8B 是一款多功能的通用及角色扮演模型,基于 Llama 3 8B。它是多个模型的战略性合并版本,旨在平衡创意与逻辑、通用知识。相比 Stheno v3.2,它提升了创造力与推理能力,是 OpenRouter 上价格最低的无审查选项,每百万 token 仅需 USD0.04/USD0.05,在平台上已有超过 60 亿 token 的实际使用量。

- 参数规模: 8B

- 显存(VRAM): 无需(云端托管)

- 适用场景: 低成本、高创造力的无审查对话与写作

- 平台: OpenRouter

14. TheDrummer: Cydonia 24B V4.1:通过 OpenRouter 的创意写作模型

Cydonia 24B V4.1 是由 TheDrummer 推出的无审查创意写作模型,基于 Mistral Small 3.2 24B,具备良好的记忆力、指令遵循能力和智能水平。支持 131K 上下文窗口,可在 OpenRouter 全局搜索中直接找到。

- 参数规模: 24B

- 显存(VRAM): 无需(云端托管)

- 适用场景: 无需本地硬件的无审查创意写作和角色扮演

- 平台: OpenRouter

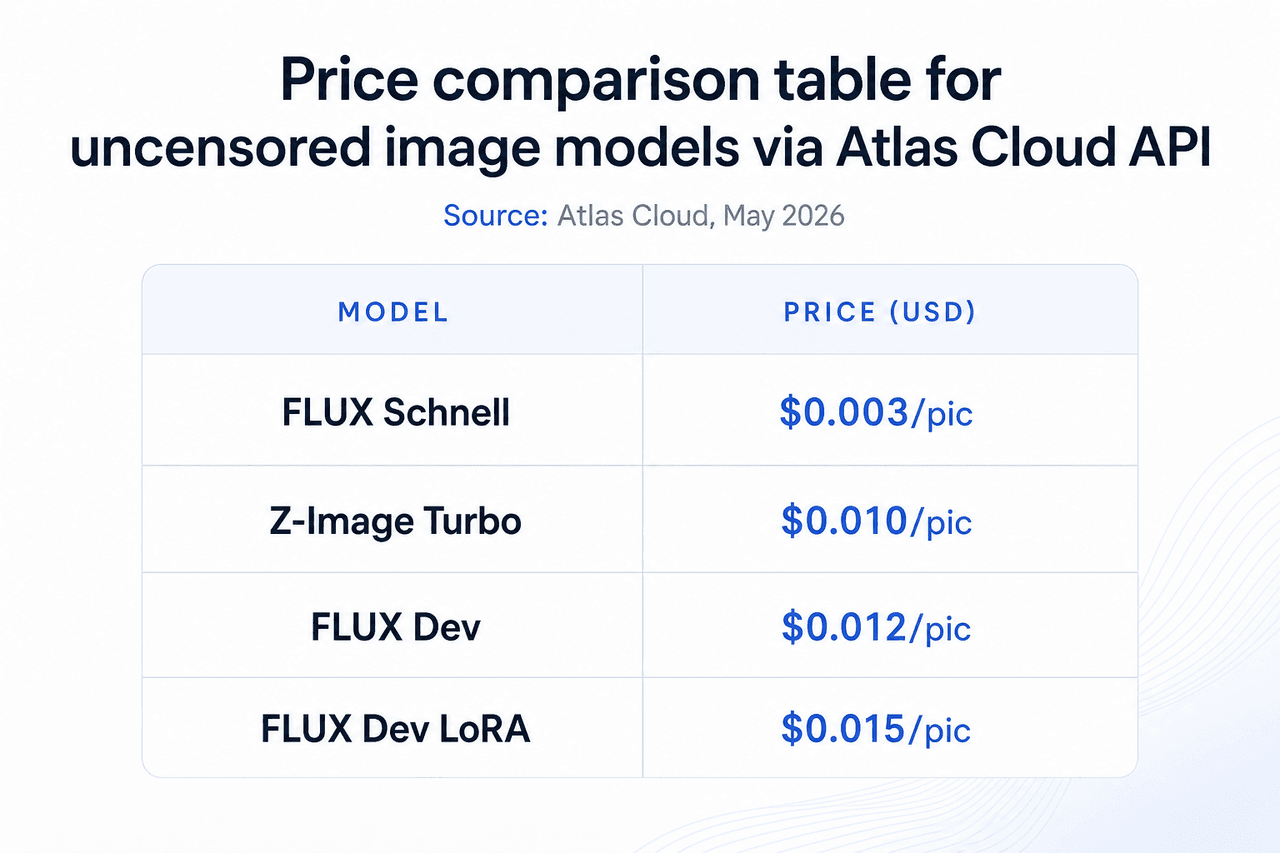

如何通过 Atlas Cloud 访问无审查图像与视频模型

2026 年,大多数无审查图像和视频模型都需要本地 GPU 或专用的 API 平台,因为主流云服务商均在推理层面实施内容过滤。Atlas Cloud 是一个专门移除这些限制的模型 API 平台,涵盖了超过 300 款精选模型,包括文本、图像、视频和音频。

三步即可上手:

- 在 atlascloud.ai 创建账户

- 从仪表盘生成 API 密钥

- 使用密钥调用模型端点——图像和视频模型使用各自的 REST 格式;LLM 端点遵循 OpenAI Chat Completions 格式

为什么 Atlas Cloud 是无审查场景的理想之选:

- 平台隐私政策声明:“生成的任何内容绝不会用于训练,也不会被任何人审核。”这是公开、明确的承诺,而非默认假设。

- 目录中的任何模型均无每日生成限制。

- 无审查图像目录涵盖 33 款文生图模型,单张图片起价 USD0.003。

- 无审查视频目录涵盖 10 多款 NSFW 视频模型,起价 USD0.01/秒。

完整的无审查模型目录可查看 atlascloud.ai/models/explore/uncensored。本列表中的第 15 到 20 款模型均可通过同一个 Atlas Cloud API 密钥访问。

2026 年 NSFW 和成人内容生成方面的最佳无审查 AI 图像模型

2026 年,FLUX 架构驱动了绝大多数高质量的无审查图像生成,可通过 Atlas Cloud API 以不同价格和质量梯度调用(Atlas Cloud, text-to-image model list, 2026)。Atlas Cloud 的目录总计包含 33 款文生图模型。使用场景包括艺术创作、角色设计、无审查内衣模特与成人肖像生成、游戏资源制作及大批量插画生成。

Atlas Cloud 的官网声明其提供“超过 300 款覆盖文本、图像、视频和音频的精选模型”,且隐私政策明确保证内容不受监控。

有关浏览器端和 API 端的无审查图像工具完整分解,可参考《无审查 AI 图像生成器指南》。专注于 FLUX 架构的开发者可阅读《FLUX 无审查图像生成器指南》获取微调和工作流细节。

15. FLUX Schnell:适合批量生成的无审查 AI 图像模型

这是 Atlas Cloud 图像目录中性价比最高的选项。每张图片仅 USD0.003,非常适合注重速度和数量而非精细细节的批量生成工作流。无每日限制,且内容不用于训练。

- 价格: USD0.003/张

- 显存(VRAM): 无需(API 访问)

- 适用场景: 批量图像生成、快速原型设计及大批量输出

- 平台: Atlas Cloud API

USD3.00 的预算即可生成 1000 张图像,这甚至比大多数云存储供应商存储这些结果文件的费用还要低。对于以前需要彻夜运行高昂本地 GPU 集群的工作室来说,API 方式不仅更快,而且在批量作业上更为经济。

16. FLUX Dev:适用于最终生产的高质量无审查 AI 图像模型

成本是 FLUX Schnell 的四倍,但在解剖结构、光影和纹理细节上有显著提升。对于追求最终质量的作品,USD0.012 的价格档位是合理的提升。它适用于作品集制作、商业成人内容以及对质量要求严格的生产资源。

- 价格: USD0.012/张

- 显存(VRAM): 无需(API 访问)

- 适用场景: 高质量单图、作品集素材及最终产出

- 平台: Atlas Cloud API

17. FLUX Dev LoRA:支持自定义风格训练的无审查图像模型

LoRA 微调可将自定义风格、角色外貌或主体植入 FLUX Dev 底座。当你需要多张图片保持角色一致性,或希望将特定风格应用到系列中时,请选择此模型。Atlas Cloud 在服务器端加载 LoRA。

- 价格: USD0.015/张

- 显存(VRAM): 无需(API 访问)

- 适用场景: 角色一致性、自定义风格训练及品牌图像系列

- 平台: Atlas Cloud API

18. Z-Image Turbo:性价比适中的中端质量无审查 AI 图像模型

位于 FLUX Schnell 和 FLUX Dev 之间的性价比曲线中。每张图片 USD0.01,Z-Image Turbo 采用了一种新的架构,在保证速度的同时,避免了 Schnell 在低价位上出现的画质简化问题。在 Schnell 质量不足而 FLUX Dev 又过于昂贵时,这是最实用的选择。

- 价格: USD0.01/张

- 显存(VRAM): 无需(API 访问)

- 适用场景: 中等产出规模、且需平衡质量与成本的需求

- 平台: Atlas Cloud API

2026 年用于 NSFW 动画的最佳无审查 AI 视频模型

在 2026 年,视频生成的无审查流程必须与图像生成分开,因为主流视频平台实施了严苛的内容过滤,即使源图片是在别处生成的,只要检测到 NSFW 内容就会拒绝动画处理(Atlas Cloud, uncensored model catalog, 2026)。Atlas Cloud 的无审查视频页面以“无限创意自由。无过滤。无上限。”为口号,涵盖了 10 多款 NSFW 视频模型,全目录还包括 Wan 2.6、Wan 2.5 和 Van 系列变体。

19. Wan 2.2 Turbo Spicy Infinite I2V:最具性价比的无审查视频模型

这是从静态图像进行 NSFW 动画生成的入门级选项。USD0.01/秒的价格使其成为将静态图片转为 NSFW 视频内容的最经济方式。分辨率可达 1080p,支持变长剪辑时长,是预算有限的生产线的最佳起点。

- 价格: USD0.01/秒

- 分辨率: 1080p

- 时长: 可变

- 适用场景: 高性价比 NSFW 动画及运动概念预览

- 平台: Atlas Cloud API

20. Seedance v1.5 Spicy:用于最终产出的高质量无审查视频模型

目录中的电影级质量选项。虽然 USD0.049/秒的价格大约是 Wan 2.2 Turbo Spicy Infinite 的 2.5 倍,但它能产生更平滑的运动轨迹、更好的帧间主体连贯性以及更自然的转场。对于视觉保真度至关重要的最终版 NSFW 视频产出,这是 Atlas Cloud 无审查视频阵容中的顶尖选项。

- 价格: USD0.049/秒

- 分辨率: 720p

- 时长: 5秒

- 适用场景: 高品质 NSFW 视频、专业成人内容及直接交付产出

- 平台: Atlas Cloud API

有关所有持续时间和分辨率选项的 Wan 2.7 和 Wan 2.2 Spicy 系列详情,可查阅《无审查 AI 视频生成器指南》。

无审查 AI 模型快速选择指南

| 需求 | 推荐方案 |

|---|---|

| 最佳整体无审查 LLM | llama2-uncensored 或 dolphin-llama3 |

| 编程任务 | dolphin-mixtral 8x7B 或 dolphincoder |

| 角色扮演与创意写作 | hermes3 |

| 小于 4GB VRAM | dolphin-phi 2.7B |

| 无审查图像生成 | 通过 Atlas Cloud 使用 FLUX Schnell (USD0.003/张) |

| 图片转 NSFW 视频 | 通过 Atlas Cloud 使用 Wan 2.2 Turbo Spicy Infinite (USD0.01/秒) |

无审查 AI 模型常见问题解答

2026 年最无审查的 AI 模型是什么?

从 Ollama 下载量来看,

1llama2-uncensored1dolphin-llama3哪些无审查模型可以在 Ollama 上运行?

本列表中的十款模型均可作为 Ollama 无审查模型运行:llama2-uncensored, dolphin-llama3, dolphin-mixtral, dolphin-mistral, dolphin-phi, hermes3, wizard-vicuna-uncensored, dolphincoder, wizardlm-uncensored 和 everythinglm。社区模型

1jaahas/qwen3.5-uncensored1ollama pull [model-name]OpenRouter 上有哪些可用的无审查模型?

2026 年,OpenRouter 通过 API 托管无审查 LLM,无需 GPU。选项包括免费层级的

1venice/uncensored消融型模型和微调型无审查模型有何区别?

消融是在权重层面通过手术移除拒绝行为。像 Dolphin 系列这样微调的无审查模型则是从一开始就在不包含拒绝行为的数据集上训练的。社区普遍发现微调模型更稳定:消融可能会在不同类型的提示词间导致不一致的输出,而微调产生的结果更可靠,这也解释了为何 Dolphin 模型在 Ollama 下载量中占据主导地位。

我可以在笔记本电脑上本地运行无审查 AI 模型吗?

可以。dolphin-phi 2.7B 在 4GB 以下显存即可运行,是带独立显卡的笔记本电脑的部署入门之选。拥有 6-8GB 显存,即可运行本列表中的任何 7B 模型。集成显卡无法运行。

结论

2026 年的最佳无审查 AI 模型完全取决于你的使用场景。对于通用 LLM 工作,

1dolphin-llama31dolphin-phi1venice/uncensored1FLUX Schnell寻求图像、视频及编辑器全套无审查 AI 工具概览的读者,可参考《无审查 AI 图像生成器指南》获取完整生态全景。