AI 视频 API 中的角色一致性(Character Consistency),是指在不同镜头之间保持角色视觉特征(如外貌、服装和比例)的能力。通过摆脱“提示词碰运气”的模式,转向使用参考锚点(Reference Anchors)和微调 LoRA 等结构化的 API 约束,创作者现在可以制作出视觉连续性达到 95% 的连载内容,并将制作成本降低高达 80%。

多年来,“角色漂移”(Character Drift)现象——即主角的面部特征或服装在帧与帧之间发生不一致的偏移——将 AI 视频局限在“恐怖谷”模因的范畴内。这种缺乏视觉稳定性的问题,是阻碍 AI 从短片段演进为专业叙事的主要壁垒。

现在,这一领域已由**持久性(Persistence)**定义。行业已从“祈祷式提示”转向结构化生产。像 Atlas Cloud 这样的中心化平台,通过提供统一的高一致性 AI 视频 API 网关,最终解决了这一“身份危机”。

| 指标 | 2024 年表现 | 2026 年表现 |

| 角色漂移 | 高(50% 面部偏移) | 极低(<5% 视觉偏差) |

| 身份设置 | 手动提示词 | 自动化参考锚点 |

| 渲染模式 | 逐帧渲染 | 状态保持的时间一致性 |

通过掌握这些 AI 视频 API,创作者不再仅仅是“提示”,而是在导演数字电影的新时代。以下技术已将 AI 从实验性玩具转化为专业的电影引擎:

- Atlas Cloud: 一个统一的 API 平台,整合了 Seedance 2.0 和 Kling 3.0 等顶级模型,允许开发者通过单一端点在整个系列中锁定角色身份。

- LTX Studio: 专为多镜头一致性和叙事控制而设计的综合平台。

- 自定义 ComfyUI 端点: 模块化工作流,允许创作者将特定的角色身份(LoRA)嵌入到潜在空间(latent space)中。

2026 年的 API 如何解决时间一致性问题

从闪烁的“梦境般”片段到稳定的连载内容,这种转变源于 AI 视频 API 处理数据方式的根本变革。到 2026 年,行业已超越了简单的文本提示,采用了“有状态”(Stateful)架构,将角色身份视为持久变量,而非随机生成。

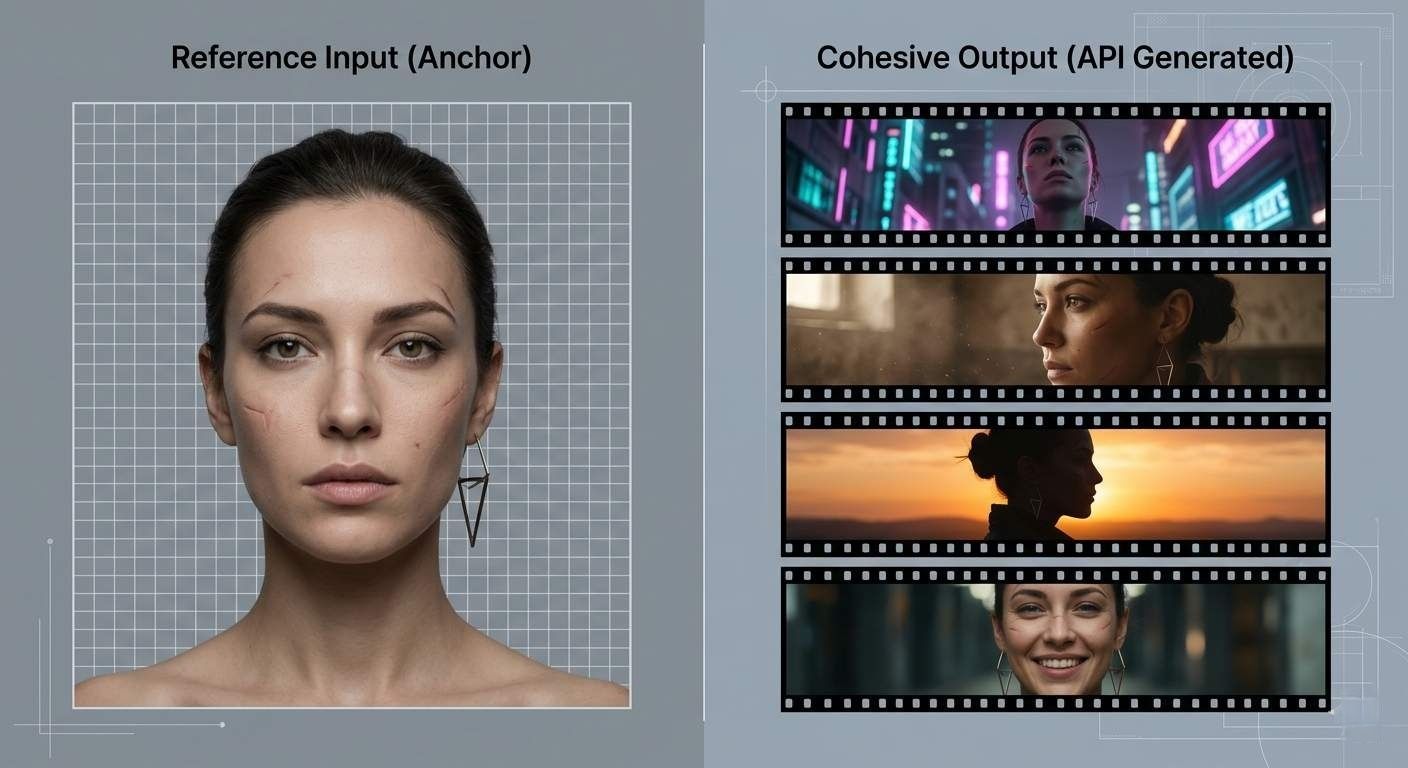

超越提示词:身份锚定(Identity Anchoring)

现代 API 利用“身份锚定”来消除角色漂移。开发者不再只使用“留胡子的男人”这种基础文本,而是使用“基础身份(Base Identity)”。这通常是一张清晰的照片或 3D 头部模型,充当严格的规则。它像稳定的锚点一样工作,确保每一帧看起来都与原始角色完全一致,无论光线或摄像机角度如何变化,都能保持面部和骨架结构不变。

图示: Image_0.png 展示了单个中性参考肖像(“锚点”)如何强制 AI API 在多样化、动态的场景中保持相同的身份(注意独特的伤疤和耳环),即使在视角、光照和环境发生变化时也是如此。

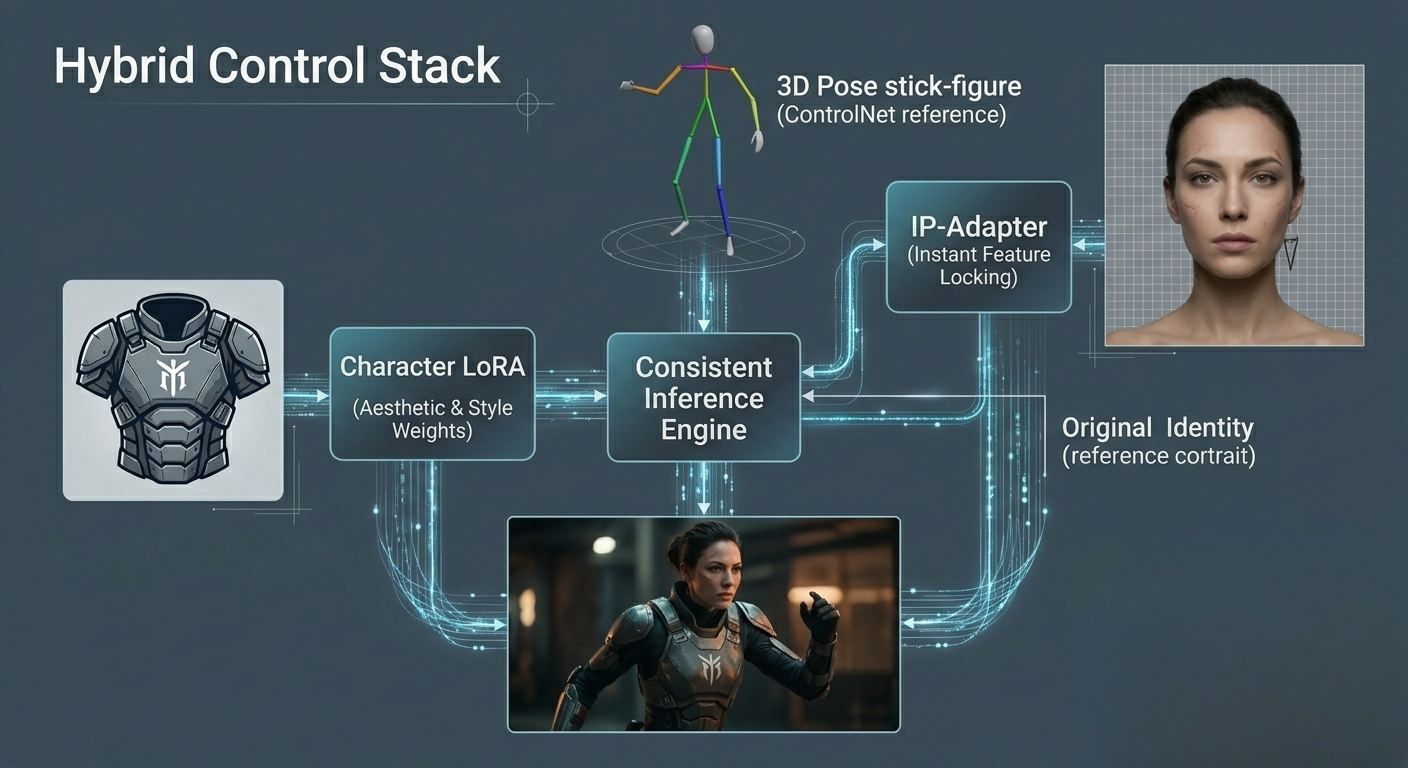

LoRA 和 IP-Adapter 的作用

为了实现“最先进”(State-of-the-Art)的一致性,技术管线利用了两个关键组件:

- LoRA(低秩自适应): 这些是小的微调权重层,用于“锁定”角色的特定审美,例如独特的皮肤纹理或服装图案。

- IP-Adapter: 与需要训练的 LoRA 不同,IP-Adapter 允许即时的“零样本”(zero-shot)身份注入。

目前最稳定的专业工作流采用“混合堆栈”:

| 组件 | 技术功能 | 目标一致性 |

| 身份 LoRA | 一般体型与氛围 | 70% |

| PuLID / IP-Adapter | 精确锁定面部特征 | 90% |

| ControlNet | 空间与姿态调节 | 95%+ |

image_1.png 直观展示了如何应用多种约束。我们看到空间控制(ControlNet/姿态)、特定角色特征(IP-Adapter 引用图像)以及专门的审美权重(用于盔甲的 LoRA)结合在一起,在新的语境中生成了一致的角色。

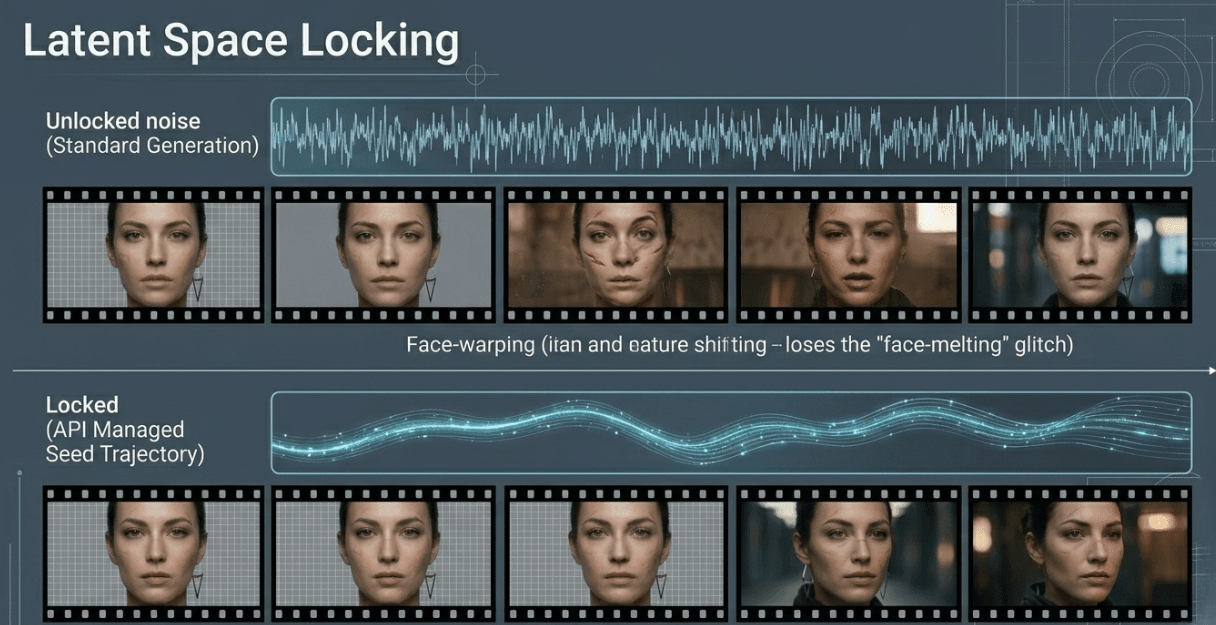

种子轨迹与潜在空间锁定

一项高价值的技术突破是使用潜在空间锁定(Latent Space Locking)。每次 AI 生成都始于一个“种子”(随机噪声)。通过在帧间保持噪声模式或“种子轨迹”的一致性,API 防止了“面部融化”式的转换。这种方法确保了像素背后的数学逻辑平稳演变,使角色能够在复杂的环境中移动而不会丢失视觉完整性。

通过将这三个部分结合,创作者终于可以制作出主角在每一集中看起来都一样的作品。从第一幕到季终,面部特征始终保持完美的一致性。

Image_2.png 提供了对比展示。上方的轴线(标准噪声)显示了来自 image_0.png 的角色面部正在“融化”——特征、表情甚至身份都在改变。下方的轴线(锁定噪声)显示了面部保持近 95% 的一致性,仅表现出自然的演变(如转头),这得益于 API 应用的数学约束。

彻底改变连载内容生产流程

角色一致性 AI 视频 API 的集成,从根本上改变了连载媒体的经济格局。这里的巨大胜利不仅仅在于“速度”,而在于让任何人都能创作高质量的故事。这些工具处理了保持视觉一致性的繁重工作,让小型创作者和微型工作室也能制作出媲美大型好莱坞影片的作品。

新的生产范式

从历史上看,为动画系列创建一致的角色需要大量的前期投资,用于 3D 建模、绑定(Rigging)和纹理贴图。如果角色设计在季中发生改变,这种“技术债务”可能会导致整个制作瘫痪。

现代 AI 工作流 用动态、微调的权重取代了这些僵化的资产。利用 AI 原生工作流的制作团队报告称,总开销减少了 70-90%。

效率基准:传统 vs. AI 原生

下表展示了针对标准 22 分钟剧集在关键绩效指标上的颠覆:

| 特性 | 传统动画/CGI | AI 视频 API 工作流 |

| 角色设置 | 数月的建模/绑定 | 2–4 小时的 LoRA 训练 |

| 单集成本 | $100,000 – $1M+ | $500 – $5,000 |

| 迭代速度 | 数周(渲染时间) | 数分钟(推理时间) |

| 一致性 | 完美(手工制作) | 高(API 约束 95%+) |

虽然传统方法在像素级精度上仍有优势,但“推理胜过渲染”(Inference-over-Rendering)的模型使创作者能够在几分钟内生成初稿。这种“时间压缩”使工作室能够每月多发布 42% 的内容,将连载内容从缓慢的奢侈品转化为敏捷、响应迅速的媒介。

案例研究:“微剧”与虚拟影响者的崛起

我们正在从零散片段走向真实故事,并创造了一个新趋势:AI“微剧”。通过使用能保持角色视觉稳定的智能视频工具,人们正在制作外观媲美常规动画的剧集。最棒的是,它的时间耗费更少,制作成本也大幅降低。

独立创作者的革命:20 天制作 20 集

TikTok 和 YouTube Shorts 等平台上的独立创作者,不再受限于此前困扰 AI 生成视频的“身份漂移”。利用 Atlas Cloud 等统一平台编排 Seedance 2.0 或 Kling 3.0 等模型,单一创作者可以一次定义一个“角色 ID”,并在整个系列中重复使用。

这一技术飞跃促成了连续叙事的兴起,其优势在于:

- 生产速度: 创作者在几周内即可发布 20 集的微剧,而传统 CGI 需要 12–18 个月。

- 参与度: 虚拟影响者目前占据了 4.2% 的市场份额,平均互动率达到 5.67%,几乎是人类同行的三倍。

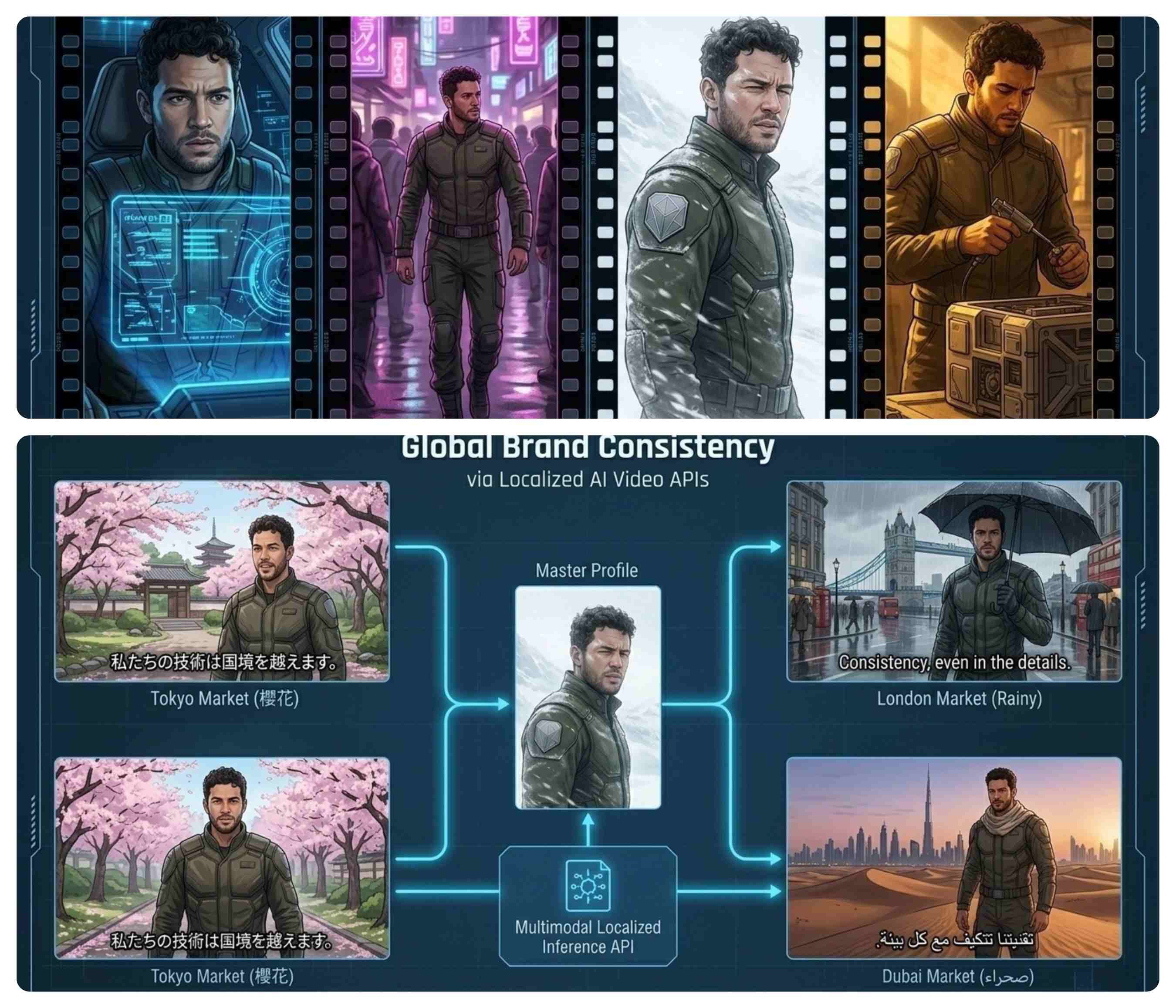

全球品牌一致性与 AI 代言人

对于全球企业而言,“身份危机”曾是品牌安全风险。如今,公司利用 AI 视频 API 在不同市场保持统一的“虚拟代言人”。通过 API 调用中心化的角色嵌入,品牌可以生成本土化内容:代言人视觉上保持高度统一,同时能讲不同的语言或出现在具有特定文化特色的场景中。

| 优势 | 对全球品牌的影响 |

| 视觉保真度 | 所有地区身份保持 95%+ 一致性。 |

| 本土化 | 通过本地化 API 调用实现实时唇形同步和语言翻译。 |

| 风险管理 | 相比人类代言人,争议风险为 0%。 |

市场增长趋势

这种一致性带来的经济影响是惊人的。行业数据凸显了品牌支出向这些持久性数字资产的根本转变:

- 市场规模: 虚拟影响者市场在 2026 年初达到了 46 亿美元。

- 效率: AI 一致性角色的单帖制作成本比涉及人类影响者的项目低 38%。

- 采用率:92% 的品牌正在使用或积极测试用于连载营销的 AI 工作流。

通过将角色身份视为可扩展的数字资产,AI 视频 API 已超越“玩具”阶段,成为新的、高效连载经济的支柱。

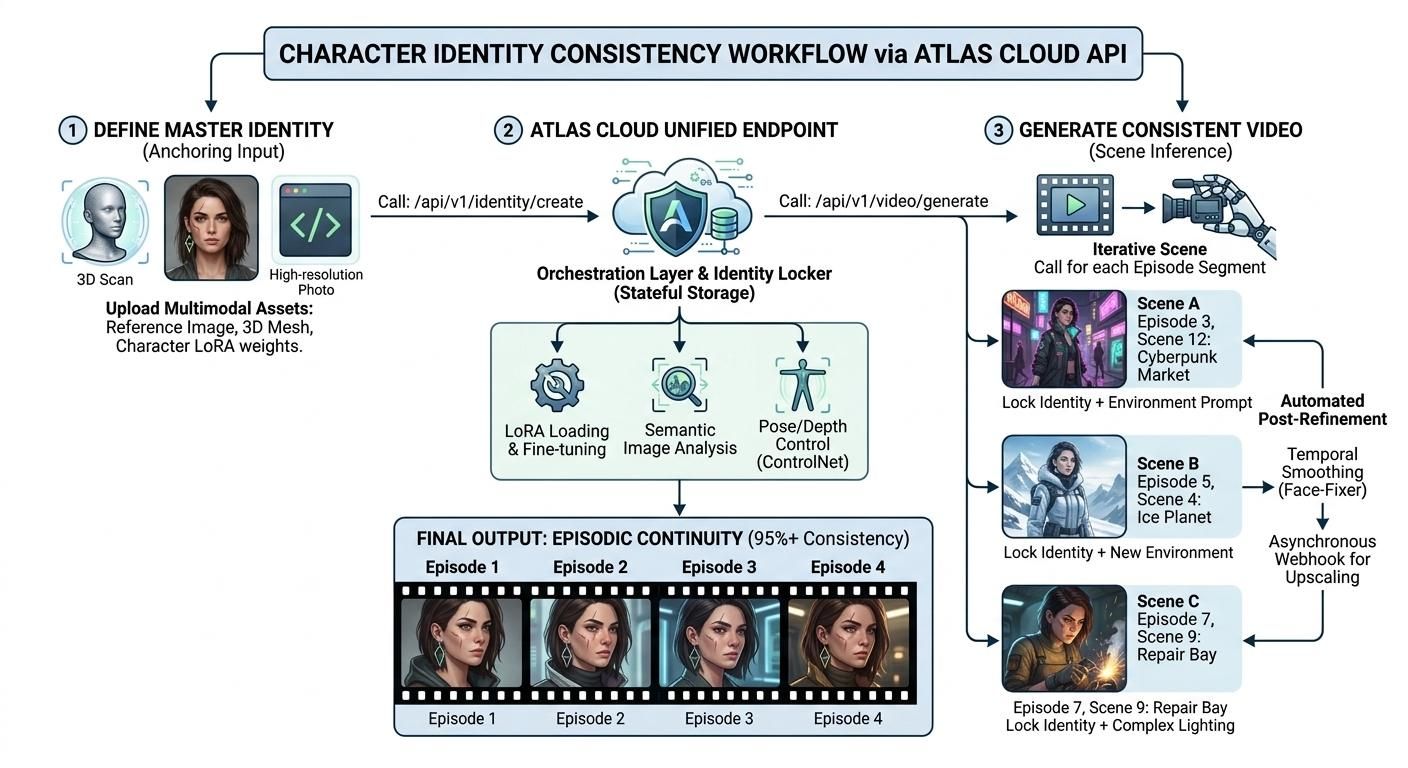

如何实现一致性工作流

从仅仅把玩 AI 片段到制作真正的剧集需要新的方案。你需要一个组织严密、易于扩展的工作流。行业标准已转向使用多模态输入来锚定视觉身份的“一键式访问”(One-Key Access)架构。通过利用统一的 AI 视频 API,创作者可以在不同场景中保持角色连续性,而无需逐帧进行手动编辑。

第一步:定义主身份(Master Identity)

任何连载系列的基础都是“主身份”。创作者不再仅使用纯文本描述,而是使用多种文件的组合。他们通常采用一张清晰的参考照片,并结合 3D 地图或角色 LoRA。这种“身份锚点”确保了一切稳定——无论是在每一帧的面部,还是微小的伤疤,甚至衬衫图案都能保持完全一致。

第二步:通过 Atlas Cloud 编排

专业管线不再为不同模型切换 API 密钥和不兼容的数据格式,而是使用 Atlas Cloud 统一 API。这个编排层允许在保持核心代码库不变的情况下实现无缝模型切换。

例如,创作者可以通过 Atlas Cloud 调用 **Seedance 2.0 “通用参考”**系统,锁定 15 秒复杂动作序列的角色特征。如果某个特定镜头需要 Kling 3.0 更流畅的运动效果,或是 Veo 3.1 更逼真的电影光影,开发者只需在 Atlas Cloud 环境中切换模型参数即可。

| 工作流阶段 | 工具示例 | 关键优势 |

| 模型切换 | Kling 3.0 ↔ Veo 3.1 | 针对镜头类型优化性能 |

| 身份锁定 | Seedance 2.0 Ref | 永久面部与服装持久性 |

| 集成 | Atlas Cloud SDK | 统一端点,无需零散密钥 |

Seedance 2.0 图生视频 代码示例:

plaintext1import requests 2import time 3 4# 第一步:启动视频生成 5generate_url = "https://api.atlascloud.ai/api/v1/model/generateVideo" 6headers = { 7 "Content-Type": "application/json", 8 "Authorization": "Bearer $ATLASCLOUD_API_KEY" 9} 10data = { 11 "model": "bytedance/seedance-2.0/image-to-video", 12 "prompt": "一艘平滑、极具未来感的飞船正在一颗巨大的行星周围缓慢漂浮。你可以看到行星明亮的云层和太空中的发光大气。背景中充满了繁星和色彩缤纷的气体云。飞船平稳地沿着轨道航行,看起来就像一部大型科幻电影场景。随着摄像机跟随飞船,光影效果显得深邃且真实。", 13 "image": "https://static.atlascloud.ai/media/images/454eee7f1a05a0bf276afe2e056200ba.png", 14 "duration": 5, 15 "resolution": "720p", 16 "ratio": "adaptive", 17 "generate_audio": True, 18 "watermark": False, 19} 20 21generate_response = requests.post(generate_url, headers=headers, json=data) 22generate_result = generate_response.json() 23prediction_id = generate_result["data"]["id"] 24 25# 第二步:轮询结果 26poll_url = f"https://api.atlascloud.ai/api/v1/model/prediction/{prediction_id}" 27 28def check_status(): 29 while True: 30 response = requests.get(poll_url, headers={"Authorization": "Bearer $ATLASCLOUD_API_KEY"}) 31 result = response.json() 32 33 if result["data"]["status"] in ["completed", "succeeded"]: 34 print("生成的视频:", result["data"]["outputs"][0]) 35 return result["data"]["outputs"][0] 36 elif result["data"]["status"] == "failed": 37 raise Exception(result["data"]["error"] or "生成失败") 38 else: 39 time.sleep(2) 40 41video_url = check_status()

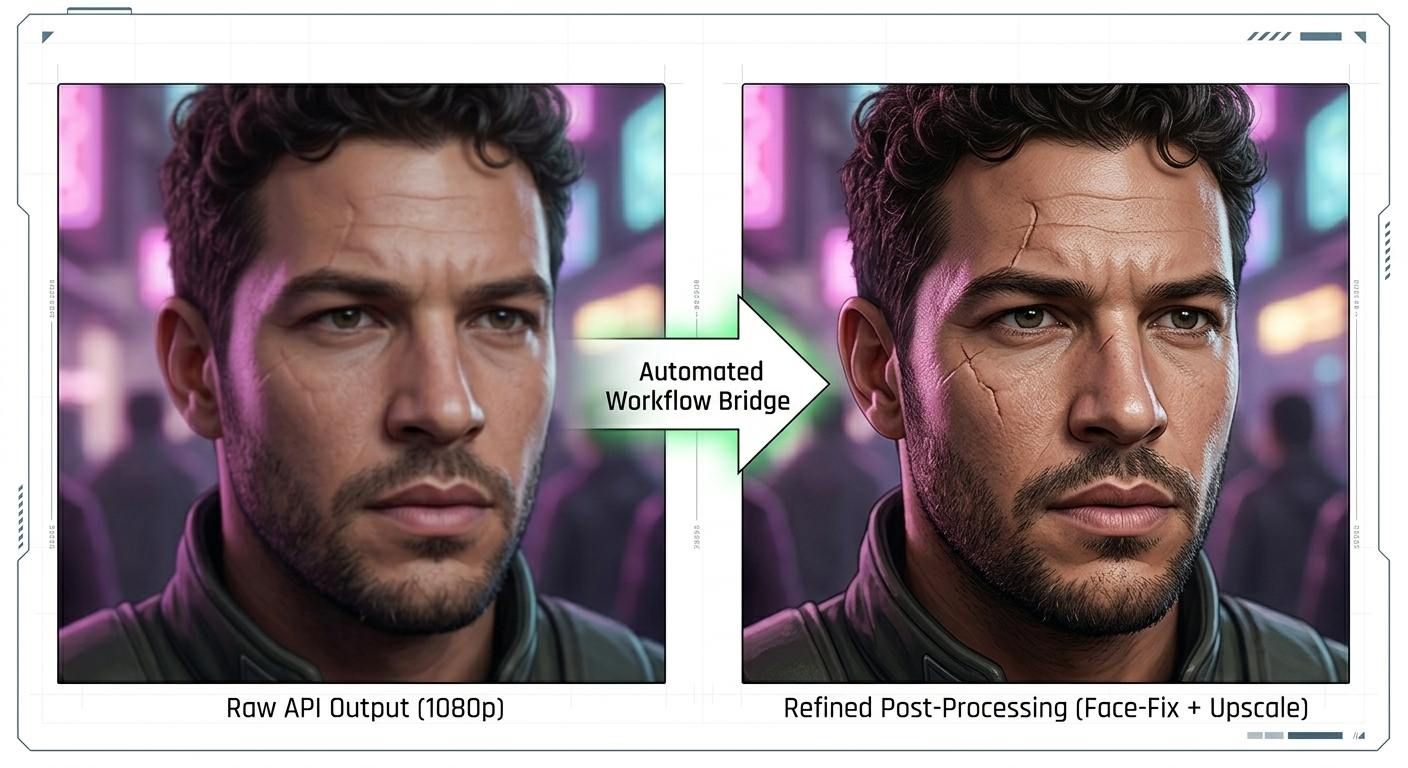

第三步:生成后优化

为了达到“4K 广播级”质量,最后阶段涉及自动化后期处理桥接。使用 Atlas Cloud 的异步 Webhook 架构,系统可以在 1080p 渲染完成的瞬间自动触发外部增强任务。

常见的自动化后期处理任务包括:

- 时间平滑(Temporal Smoothing): 消除角色特征中的微小波动。

- 外部 4K 超分辨率放大: 通过专门的超分辨率模型处理 1080p API 输出。

- 音画同步: 使用 Vidu Q3 集成自动将音效与角色动作对齐。

通过在 API 工作流中使用这一三步过程,团队可以自动完成 85% 的视觉工作,从而在几分钟内制作出高质量、视觉高度统一的剧集。

未来展望:告别“恐怖谷”?

展望 2026 年下半年,AI 视频 API 的演进正从预渲染的连载内容转向“实时身份”(Live Identity)范式。曾经导致“恐怖谷”效应的技术障碍——微小的卡顿和光影不一致——正被实时神经渲染所消除。

向实时一致性视频的转变

下一个前沿是从静态生成过渡到实时 AI 虚拟人。这些工具的后续版本可能在 100 毫秒内完成响应,这意味着角色在与你实时交谈时也能保持完全一致的视觉效果。这将改变讲故事的方式,观众将能够在直播中与角色对话,或在剧中选择自己的分支路线。即使故事根据你的行为而改变,角色依然能保持完美外观。

伦理层:保护身份权利

随着完美复制角色或人类能力的出现,重大的法律挑战随之而来。行业目前正在开发“身份权利”框架以防止未经授权的数字克隆。2026 年,我们看到了以下技术的兴起:

- 链上身份验证: 使用区块链为角色的唯一权重配置文件进行“签名”。

- 水印标准: 所有 API 生成的身份均需强制添加类似 SynthID 的水印,以区分人类演员与合成演员。

FAQ(常见问题)

什么是 AI 视频中的角色一致性?

角色一致性意味着 AI 模型能让主体保持完全一致的外观,确保面部、头发和服装在不同角度和场景中维持原样。在影视制作中,这是将零散片段串联成完整故事的核心。

哪些 AI 视频 API 支持角色一致性?

虽然许多模型正在进入市场,但目前通过 API 提供强大一致性控制的领先产品包括:

- LTX-Studio: 专注于电影级的“场景间”角色锁定。

- Magic Hour: 专注于角色动画和面部交换的创作者热门选择。

- Atlas Cloud: 一个通过单一一致性优先的端点,编排多种模型的统一平台。

我可以使用自己的脸来实现角色一致性吗?

可以。通过“角色客串”(Character Cameo)功能和 IP-Adapter,你可以上传自己的参考肖像。API 会提取你的“面部潜在权重”并将其应用到数字主角上,确保你在整集中始终保持一致的主角身份。