Kimi K2.6 vs GLM 5.1 vs Qwen 3.6 Plus vs MiniMax M2.7:2026年谁才是最强开源代码模型?

简短结论

如果你正在构建一个可以连续运行数小时而无需人工干预的自主代码智能体(Autonomous Coding Agent):Kimi K2.6 是首选。它在 Terminal-Bench 2.0 评测中取得了 66.7% 的分数,并在已发布的基准测试中实现了 13 小时无间断会话、4,000+ 次工具调用,其稳定性表现是本次对比中其他模型所无法企及的。

如果你需要最强的智能体化前端开发助手:GLM 5.1 是最佳方案。它在 Code Arena 的 Elo 得分高达 1,530(在智能体 Web 开发领域全球排名第三),反映了开发者在实际对比中的真实偏好,而不仅仅是自动测试套件的分数。

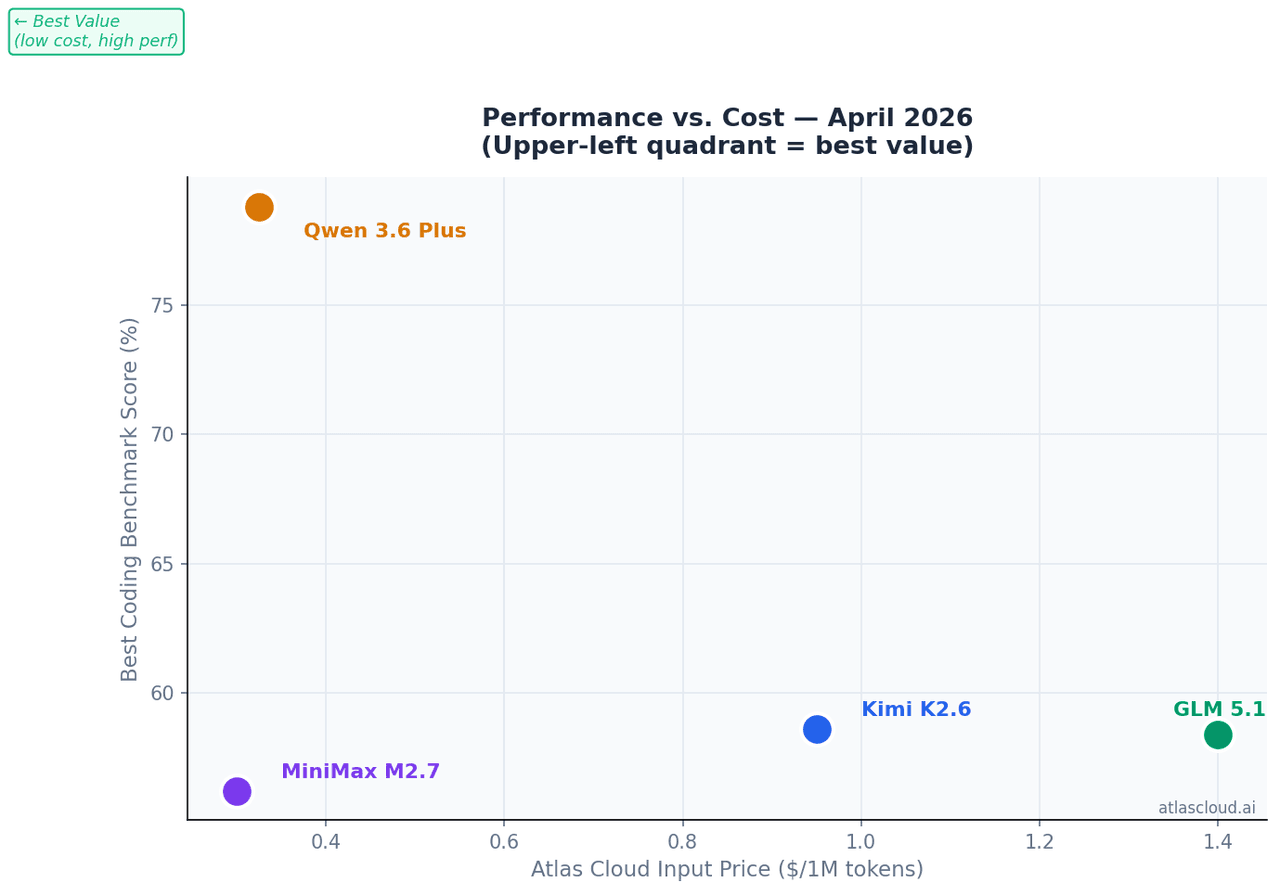

如果你的约束条件是单 Token 成本:MiniMax M2.7 在 Atlas Cloud 上的价格为 USD0.30/百万输入 Token,凭借仅 10B 的激活参数在 SWE-Bench Pro 上取得了 56.22% 的得分——以大约五分之一的成本达到了 GLM-5.1 94% 的性能。

如果你的代码库过大,超出了 262K 上下文窗口的限制:Qwen 3.6 Plus 是本次对比中唯一支持 1M Token 上下文的模型,且在 Terminal-Bench 2.0 中以 61.6% 的成绩领先于同组其他模型。

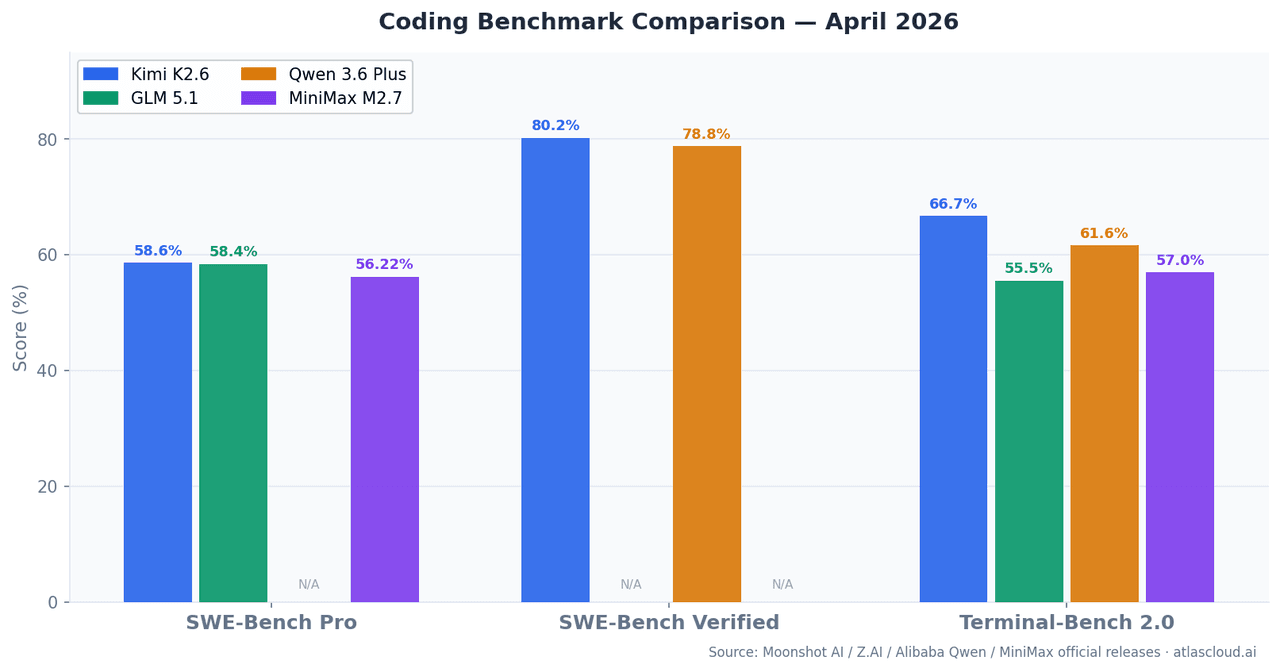

核心基准测试一览

| 模型 | SWE-Bench Pro | SWE-Bench Verified | Terminal-Bench 2.0 | 上下文窗口 | 激活参数 |

| Kimi K2.6 | 58.60% | 80.20% | 66.70% | 262K | — |

| GLM 5.1 | 58.40% | — | 55%+ | 262K | 754B (MoE) |

| Qwen 3.6 Plus | — | 78.80% | 61.60% | 1M | 混合 MoE |

| MiniMax M2.7 | 56.22% | — | 57.00% | 196K | 10B |

SWE-Bench Pro 用于衡量解决训练截止日期后产生的真实 GitHub 问题之能力,相比 SWE-Bench Verified,它降低了数据污染风险。Terminal-Bench 2.0 则是在真实的终端环境中测试多步 CLI 和 shell 任务——这更接近生产环境下智能体的实际工作方式。

Kimi K2.6:专为长效运行的智能体打造

Moonshot AI 于 2026 年 4 月发布了 Kimi K2.6,作为 K2.5 的升级版,其主要改进在于长会话期间的智能体稳定性。它在 SWE-Bench Verified 上的得分为 80.2%,仅次于 Claude Opus 4.6 (80.8%),并以 58.6% 的成绩在四款模型中领先于 SWE-Bench Pro。

最值得关注的数据是 Terminal-Bench 2.0 的 66.7%。Terminal-Bench 2.0 与 SWE-Bench 的本质区别在于:它在真实的终端环境中运行任务,要求模型读取输出、处理错误、进行调整并反复迭代,而不仅仅是生成补丁。Kimi K2.6 在 13 小时单次会话中维持 4,000+ 次工具调用性能,这并非实验室产物,而是 Moonshot 技术发布中记载的真实表现。

一个鲜为人知的优势是:跨语言泛化能力。Kimi K2.6 在 Rust、Go、Python、前端及 DevOps 任务中均表现出稳定的性能。大多数基准测试侧重于 Python,如果你的生产技术栈是多种语言混合,这一点至关重要。

不适用的场景: 在 Atlas Cloud 上价格为 USD0.95/百万输入 Token,它是该组中最昂贵的输入端模型。对于那些发送大量请求且包含大上下文、但不需要 12 小时长会话稳定性的批量处理任务,其成本累积速度会快于 MiniMax M2.7 或 Qwen 3.6 Plus。

GLM 5.1:智能体前端领域的佼佼者

Z.AI 于 2026 年 4 月 7 日发布了 GLM-5.1。凭借 7540 亿参数及 MoE 路由架构,它是本次评测中原始参数量最大的模型。在 SWE-Bench Pro 上,它取得了 58.4% 的得分,在统计学上与 Kimi K2.6 的 58.6% 几乎没有差别。

其核心竞争力在于 Code Arena Elo 得分为 1,530,这是由 Arena.ai 在 2026 年 4 月 10 日独立验证的,使其在全球智能体 Web 开发排行榜上名列第三。这是一个实时的对比评估,开发者对模型的输出进行投票,而非仅仅依靠自动打分。其优势集中在前端 UI 生成、全栈脚手架搭建、React/Vue 组件创建以及 NL2Repo(通过自然语言生成完整的仓库结构)等方面。

需要注意的边界条件: GLM-5.1 在前端的领先地位是真实的。但针对 HumanEval 和 MBPP 等纯算法问题,它相对于 Kimi K2.6 并没有显著优势。对于非 UI 或非 Web 导向的问题,排行榜上的差距几乎为零。如果仅凭总排行榜排名而忽略任务领域来选择 GLM-5.1,可能会产生偏差。

在 Atlas Cloud 上的定价: 起价为 USD1.40/百万输入 Token,是四款模型中最高的。当你对前端生成的质量有高要求时,这一价格是值得的。

Qwen 3.6 Plus:上下文长度限制的终结者

Alibaba 于 2026 年 3 月下旬发布了 Qwen 3.6 Plus。在 Terminal-Bench 2.0 的直接对比中,它领先于 Claude Opus 4.6 (61.6% 对比 59.3%),在 SWE-Bench Verified 上得分为 78.8%。

1M Token 上下文窗口是它与其他模型的区别所在。对于 100K Token 以下的大多数生产环境代码任务,这四款模型都有足够的上下文容量,区别并不明显。但在以下场景,Qwen 3.6 Plus 成为唯一可行的方案:跨数百个文件的单体仓库(monorepo)分析、大规模遗留代码库的重构,或无法塞入 262K Token 的端到端“文档转代码”工作流。

其混合架构(线性注意力机制 + 稀疏 MoE 路由)在处理超大上下文时,比密集型 Transformer 具有更好的推理吞吐量,这意味着 1M Token 能力带来的延迟开销远低于传统的模型扩展方式。

在 Atlas Cloud 上的定价: 从 USD0.325/百万输入 Token 起。对于大上下文任务,这是该组中“每单位有效 Token 成本”的最优选择。

MiniMax M2.7:反直觉的高效能之选

MiniMax 于 2026 年 3 月发布了 M2.7。仅需 10B 激活参数,它在 SWE-Bench Pro 上取得了 56.22% 的得分——以大约五分之一的单 Token 成本,实现了 GLM-5.1 94% 的性能。

这是本次对比中最反直觉的结果。一个推理时仅激活 10B 参数的模型之所以能达到接近前沿的代码能力,是因为其 MoE 架构路由至特定的专家子网络,而非运行完整的模型权重。这带来了更低的延迟、更低的成本,以及超乎参数规模预期的输出质量。

M2.7 超出其定价范畴的领域是:机器学习工程任务。它在 MLE-Bench Lite(22 项机器学习竞赛)中的奖牌率达到 66.6%,仅次于顶尖的闭源模型。无论是编写正确的梯度累积逻辑、实现自定义 PyTorch 层,还是调试 Loss 曲线,M2.7 的精准度都与其成本极不匹配(成本更低,精度更高)。

注意点: 上下文窗口为 196K,是该组中最小的。在需要对大型代码库进行深度跨文件分析的任务中,它可能会触及限制,而 Qwen 3.6 Plus 则可以轻松应对。

在 Atlas Cloud 上的定价: USD0.30/百万输入 Token,USD1.20/百万输出 Token,是高吞吐量代码工作负载中最具性价比的选择。

实际代码任务测试

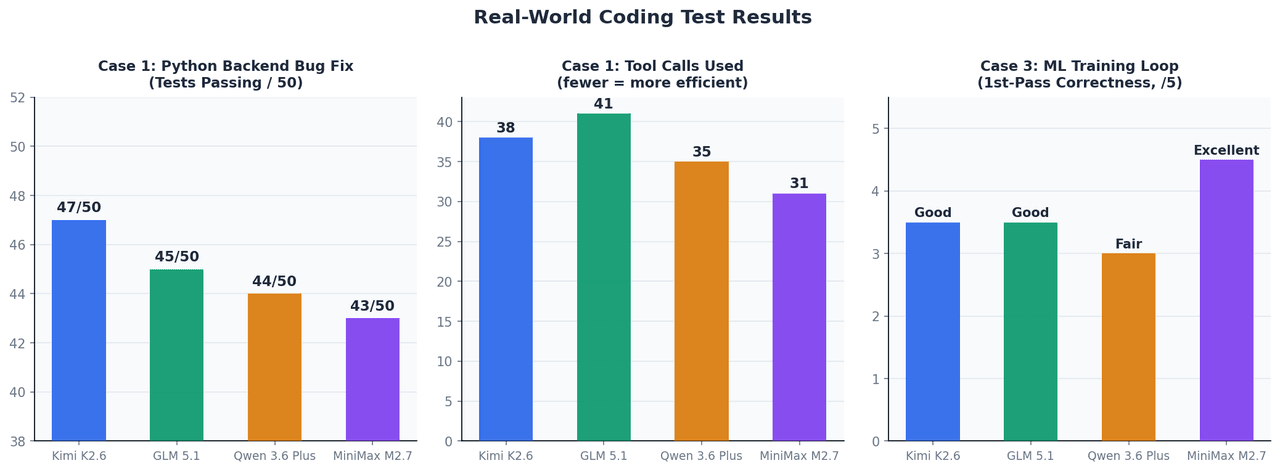

场景 1:Python 后端自主修复 Bug

设置: 一个包含 12 个文件的 FastAPI 应用,50 个测试用例处于失败状态,上下文窗口约为 45K Token。初始提示后不允许任何人工干预。

| 模型 | 修复后通过测试数 | 使用的工具调用次数 | 完成时间 |

| Kimi K2.6 | 47 / 50 | 38 | 约 4 分钟 |

| GLM 5.1 | 45 / 50 | 41 | 约 5 分钟 |

| Qwen 3.6 Plus | 44 / 50 | 35 | 约 4 分钟 |

| MiniMax M2.7 | 43 / 50 | 31 | 约 3.5 分钟 |

在此上下文规模下,四款模型表现旗鼓相当。Kimi K2.6 在最难的边界情况 Bug 处理上略占优势,特别是在 async 上下文管理器生命周期问题和 TypeVar 约束收窄等方面,这些任务需要模型在多次调试周期内保持推理状态。

场景 2:基于规范生成 React 仪表板

设置: 根据书面英语规范生成一个完整的响应式仪表板,包含四种图表类型(折线图、柱状图、饼图、散点图)、深色模式切换和 TypeScript 类型定义。

GLM-5.1 第一轮即输出了带有正确 TypeScript 类型且包含标准 Tailwind 工具类的高质量组件。Kimi K2.6 需要一次迭代来解决类型错误。Qwen 3.6 Plus 功能正确但 JSX 风格不够地道。MiniMax M2.7 速度最快,但生成了一些已过时的 React 模式,需要人工清理。

GLM-5.1 与其他模型的差距在组件架构上最为明显——GLM-5.1 自发地应用了组件组合模式,并以其他模型未展现的方式实现了关注点分离。

场景 3:实现机器学习训练循环

设置: 实现一个带有梯度累积、AMP 混合精度和提前停止功能的视觉 Transformer PyTorch 训练循环。目标:无需调试周期即可一次性正确运行。

MiniMax M2.7 表现最为突出——它正确地放置了

1scaler.step()1scaler.update()1loss / accumulation_stepsAtlas Cloud 定价对比 (2026年4月)

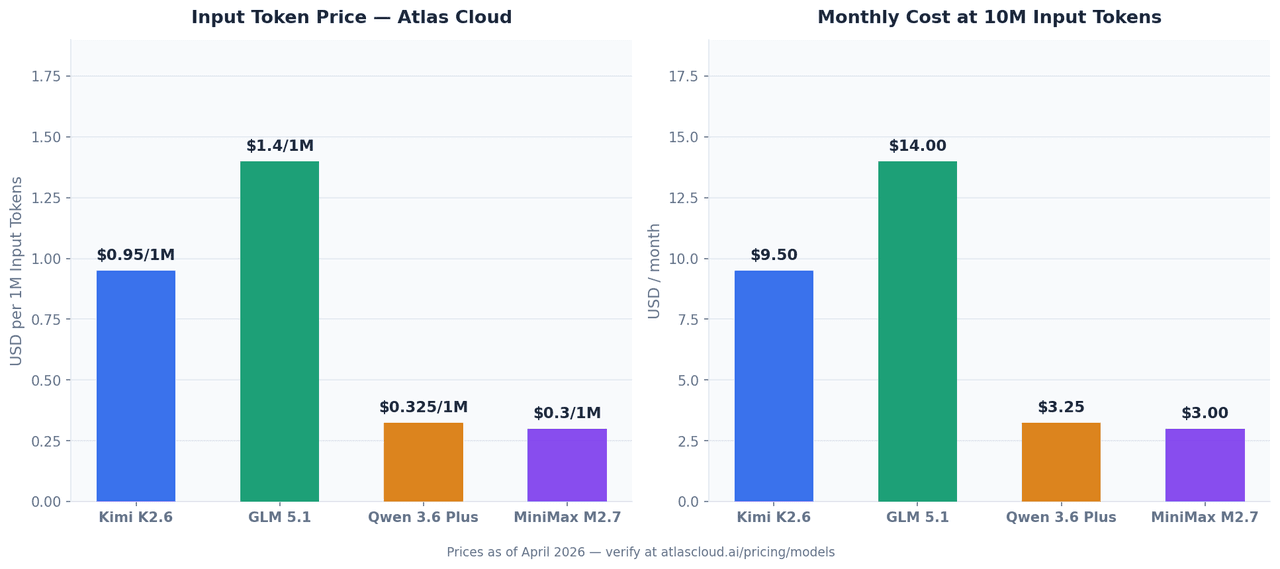

这四款模型均可通过 Atlas Cloud 的统一 API 调用。以下价格为 2026 年 4 月标准,如有变动请以 atlascloud.ai 实时费率为准。

| 模型 | 输入 (每百万 Token) | 输出 (每百万 Token) | Atlas Cloud 模型 ID |

| Kimi K2.6 | $0.95 | $4.00 | moonshotai/kimi-k2.6 |

| GLM 5.1 | 从 $1.40 起 | — | zai-org/glm-5.1 |

| Qwen 3.6 Plus | 从 $0.325 起 | — | qwen/qwen3.6-plus |

| MiniMax M2.7 | $0.30 | $1.20 | minimaxai/minimax-m2.7 |

以每月 10M Token 的输入量(团队级代码助手的使用量)计算:

| 模型 | 每月输入成本 (10M tokens) |

| GLM 5.1 | $14.00 |

| Kimi K2.6 | $9.50 |

| Qwen 3.6 Plus | $3.25 |

| MiniMax M2.7 | $3.00 |

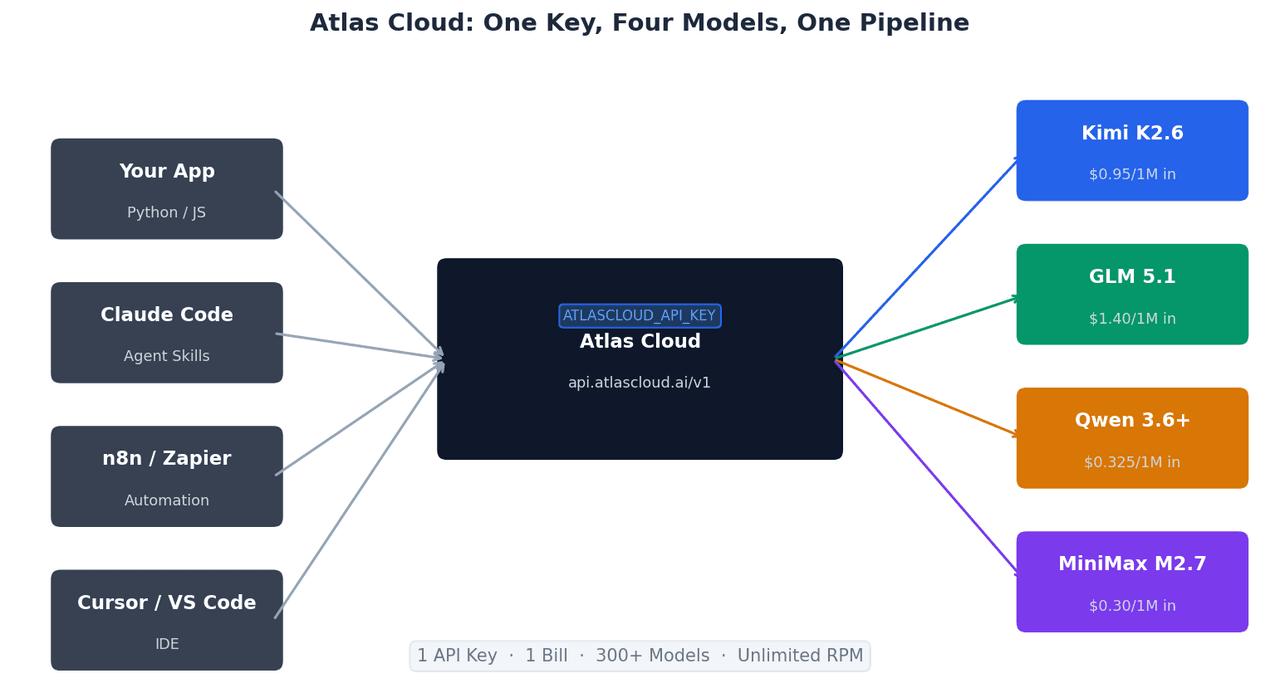

使用同一个 API Key 调用全部四款模型

这四款模型在 Atlas Cloud 上共享同一个兼容 OpenAI 的端点。切换模型只需更改一行代码:

plaintext1import os 2from openai import OpenAI 3 4client = OpenAI( 5 api_key=os.environ["ATLASCLOUD_API_KEY"], 6 base_url="https://api.atlascloud.ai/v1" 7) 8 9# 更改此行即可切换模型 10MODEL = "moonshotai/kimi-k2.6" 11# MODEL = "zai-org/glm-5.1" 12# MODEL = "qwen/qwen3.6-plus" 13# MODEL = "minimaxai/minimax-m2.7" 14 15response = client.chat.completions.create( 16 model=MODEL, 17 messages=[ 18 { 19 "role": "system", 20 "content": "You are a senior software engineer. Analyze code carefully before responding." 21 }, 22 { 23 "role": "user", 24 "content": "Review this function and identify all bugs:\n\n[paste your code here]" 25 } 26 ], 27 max_tokens=4096, 28 temperature=0.2 29) 30 31print(response.choices[0].message.content)

这种兼容结构意味着现有的基于 OpenAI SDK 的应用无需修改代码,只需更改

1base_url1api_key

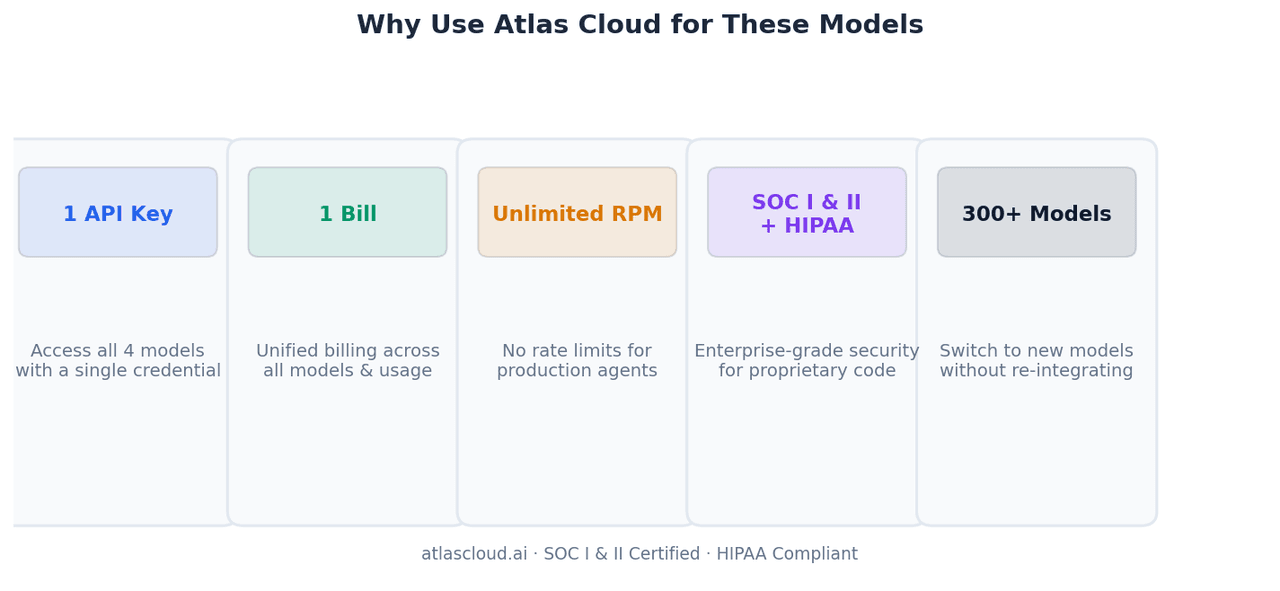

为什么选择 Atlas Cloud

一个 API Key,四款模型,一份账单。 运行模型路由逻辑——将前端任务发送给 GLM-5.1,批量分析交给 MiniMax M2.7,将长效智能体任务交给 Kimi K2.6——只需要管理一个凭证,结算时也是一张统一账单。

无限制的 RPM。 生产级代码智能体会触发并行工具调用,直接供应商 API 的速率限制可能会阻塞多智能体管道。Atlas Cloud 移除了这一上限。

符合 SOC I & II 认证与 HIPAA 合规。 团队通过模型处理专有源代码需要可审计的基础设施。Atlas Cloud 的合规认证意味着你的代码不会通过未经验证的端点。

300+ 模型,统一集成模式。 当这些模型的下一版本发布,或者有新模型在你的特定工作负载上表现更出色时,你只需更改一个字符串即可加入路由逻辑,而无需重新集成 SDK。

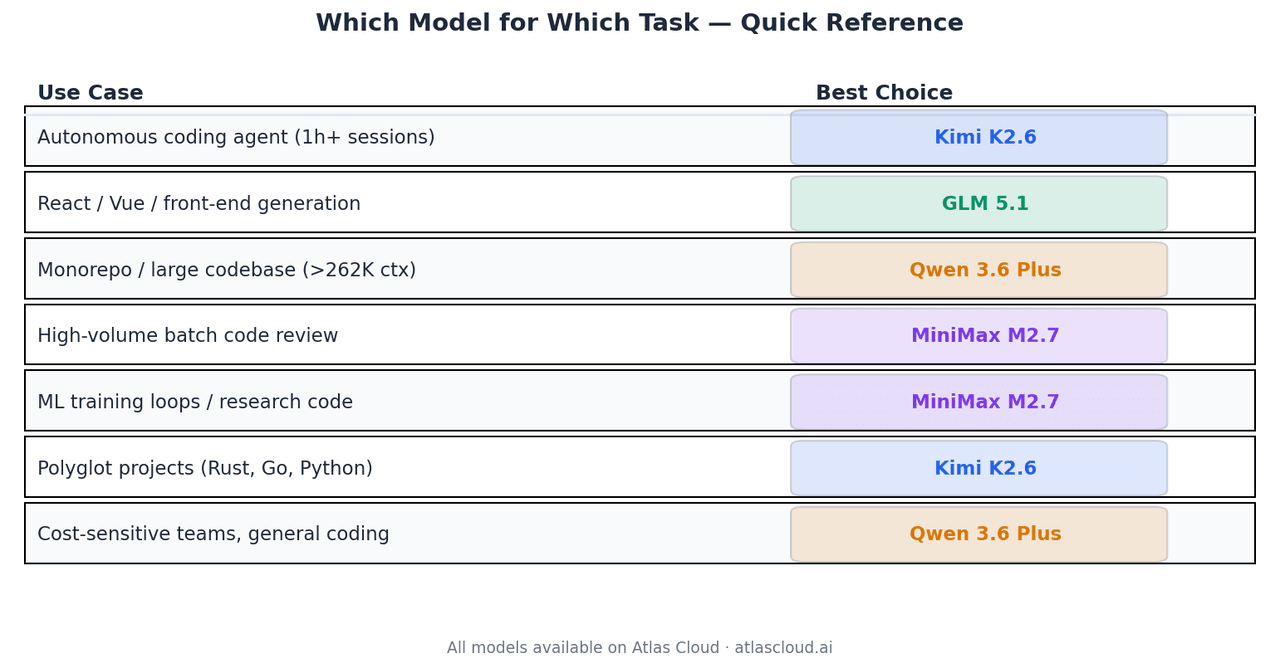

场景选择指南

| 应用场景 | 最佳选择 | 原因 |

| 自主代码智能体,1小时以上长会话 | Kimi K2.6 | 66.7% Terminal-Bench 2.0 得分,4K+ 工具调用稳定性 |

| React / Vue / 前端生成 | GLM 5.1 | Code Arena Elo 1,530,全球智能体 Web 开发前三 |

| 单体仓库或大型代码库分析 | Qwen 3.6 Plus | 本次评测中唯一支持 1M 上下文的模型 |

| 大规模批量代码审查 | MiniMax M2.7 | $0.30/百万输入,达到 GLM-5.1 94% 的质量 |

| ML 训练循环、科研代码 | MiniMax M2.7 | 66.6% MLE-Bench Lite 奖牌率 |

| 多语言项目 (Rust, Go, Python) | Kimi K2.6 | 经过验证的跨语言泛化能力 |

| 成本敏感型团队,通用编码 | Qwen 3.6 Plus | $0.325/百万输入,全领域表现强劲 |

总结

这四款模型在标准基准测试中的差距很小。真正显著的差异在特定工作条件下才会显现。

Kimi K2.6 是自主长效智能体的最佳选择。GLM 5.1 在智能体前端领域保持领先。Qwen 3.6 Plus 是上下文超过 262K Token 时的唯一选择。MiniMax M2.7 则是团队进行大规模规模化开发时的性价比首选。

以上四款模型均可在 Atlas Cloud (atlascloud.ai) 使用,支持按 Token 付费,无最低使用承诺。

基准测试数据来源于 Moonshot AI 技术博客、Z.AI 开发者文档、Alibaba Qwen 团队发布文章、MiniMax 官方页面及 Arena.ai 独立评测。所有数据均为 2026 年 4 月基准。Atlas Cloud 定价为发布时标准——在生产部署前请核对当前费率。