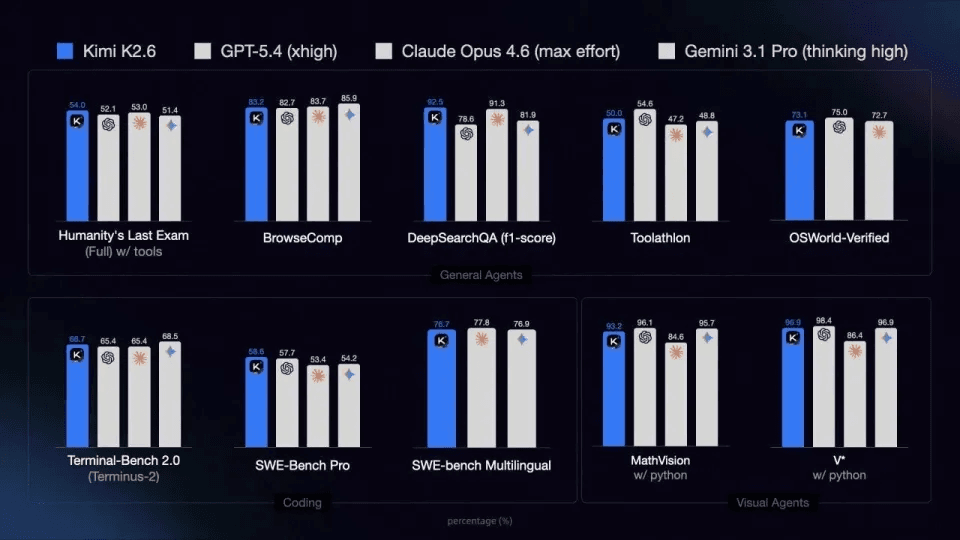

Kimi 刚刚发布了 K2.6——已在 HuggingFace 开源,并与 GPT-5.4、Claude Opus 4.6 和 Gemini 3.1 Pro 进行了基准测试。在 Humanity's Last Exam、DeepSearchQA 和 SWE-Bench Pro 等测试中,K2.6 的表现全面超越上述三款模型。其代码能力较 K2.5 提升近 20%,平均任务步骤减少了 35%,且针对 Agent 工作负载的定价仅为 Claude Opus 4.6 的 1/8。

如果你正在运行 AI Agent,并希望将 K2.6 集成到现有的工具链中,本指南涵盖了四大主流框架——Claude Code、OpenCode、OpenClaw 和 Hermes Agent——它们均通过 atlascloud.ai 提供统一的 API 端点。文章后半部分将展示 K2.6 实际运行时的表现。

快速参考

| 工具 | 配置路径 | 切换模型 | 注意事项 |

| Claude Code | 环境变量 ANTHROPIC_* | 修改环境变量或使用 /model | 无 |

| OpenCode | ~/.config/opencode/config.json | 编辑 model 字段 | 必须使用 @ai-sdk/openai-compatible |

| OpenClaw | ~/.openclaw/openclaw.json | 编辑 primary 字段 | 需先启动网关 (gateway) |

| Hermes Agent | 交互式 hermes setup | 重新运行 setup | 模型 ID 格式必须精确 |

本文中的所有教程均在 Windows 下的 WSL2 环境中完成。

第一部分 — 设置

-

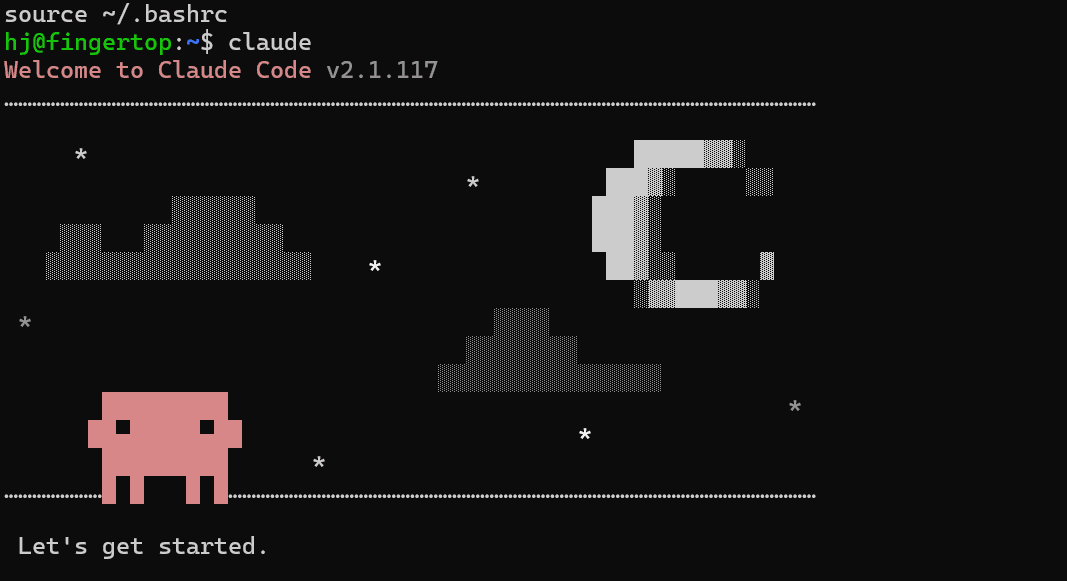

Claude Code (最简单)

Claude Code 官方下载文档:https://github.com/anthropics/claude-code

Claude Code 原生支持 Anthropic 格式。设置三个环境变量即可完成:

plaintext1# 添加到 ~/.bashrc 或 ~/.zshrc 2export ANTHROPIC_BASE_URL="https://api.atlascloud.ai" 3export ANTHROPIC_AUTH_TOKEN="apikey-xxx" 4export ANTHROPIC_MODEL="moonshot/kimi-k2.6" 5export ANTHROPIC_SMALL_FAST_MODEL="moonshot/kimi-k2.6"

执行

1source ~/.bashrc1/model2. OpenCode (配置文件)

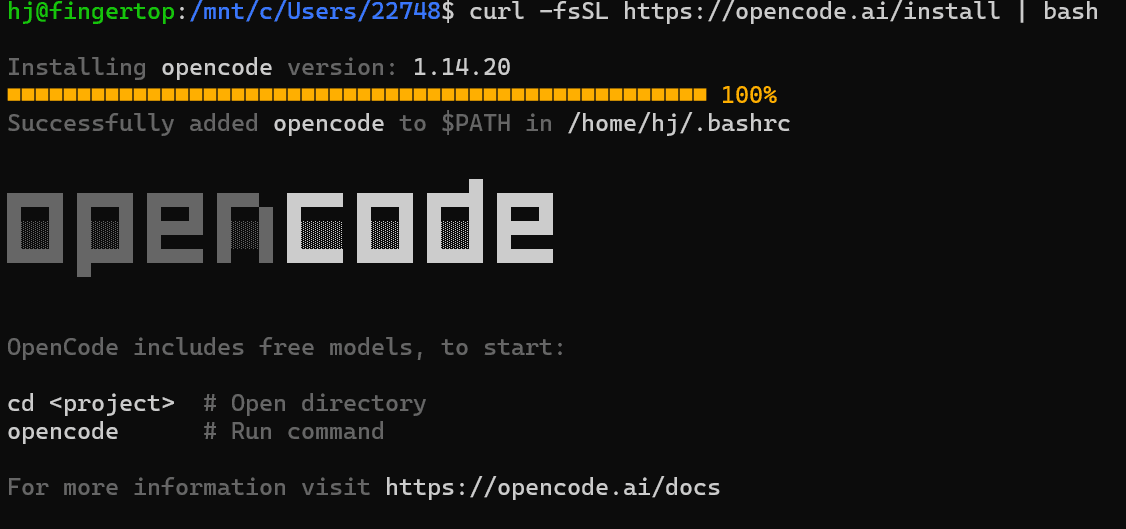

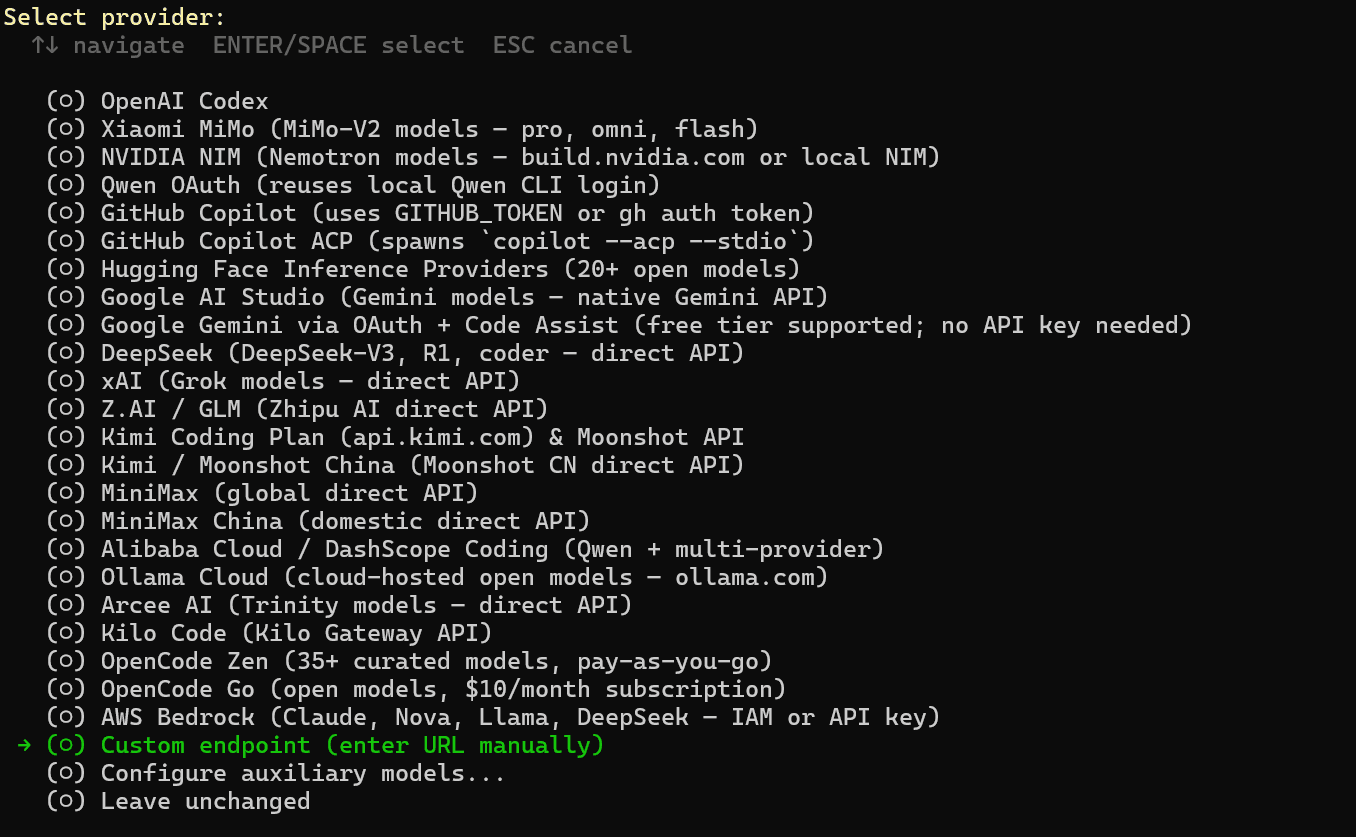

OpenCode 官方下载文档:https://github.com/anomalyco/opencode

OpenCode 内置了

1openai1openai/1@ai-sdk/openai-compatible1~/.config/opencode/config.jsonjson

plaintext1{ 2 "$schema": "https://opencode.ai/config.json", 3 "provider": { 4 "atlascloud": { 5 "npm": "@ai-sdk/openai-compatible", 6 "name": "AtlasCloud", 7 "options": { 8 "baseURL": "https://api.atlascloud.ai/v1", 9 "apiKey": "apikey-xxx" 10 }, 11 "models": { 12 "moonshot/kimi-k2.6": { "name": "Kimi K2.6" } 13 } 14 } 15 }, 16 "model": "atlascloud/moonshot/kimi-k2.6" 17}

1model1providerName/modelKey

3. OpenClaw (配置文件 + 双终端)

OpenClaw 作为两个独立进程运行:网关和 TUI。使用前两者必须同时启动。

1~/.openclaw/openclaw.jsonjson

plaintext1{ 2 "agents": { 3 "defaults": { 4 "model": { 5 "primary": "custom-api-atlascloud-ai/moonshot/kimi-k2.6" 6 } 7 } 8 }, 9 "models": { 10 "providers": { 11 "custom-api-atlascloud-ai": { 12 "baseUrl": "https://api.atlascloud.ai/v1", 13 "api": "openai-completions", 14 "apiKey": "apikey-xxx", 15 "models": [ 16 { 17 "id": "moonshot/kimi-k2.6", 18 "name": "Kimi K2.6", 19 "api": "openai-completions" 20 } 21 ] 22 } 23 } 24 } 25}

启动顺序:

bash

plaintext1# 终端 1 2openclaw gateway 3 4# 终端 2 5openclaw tui

交互式重新配置:

1openclaw configure如需切换模型,请编辑

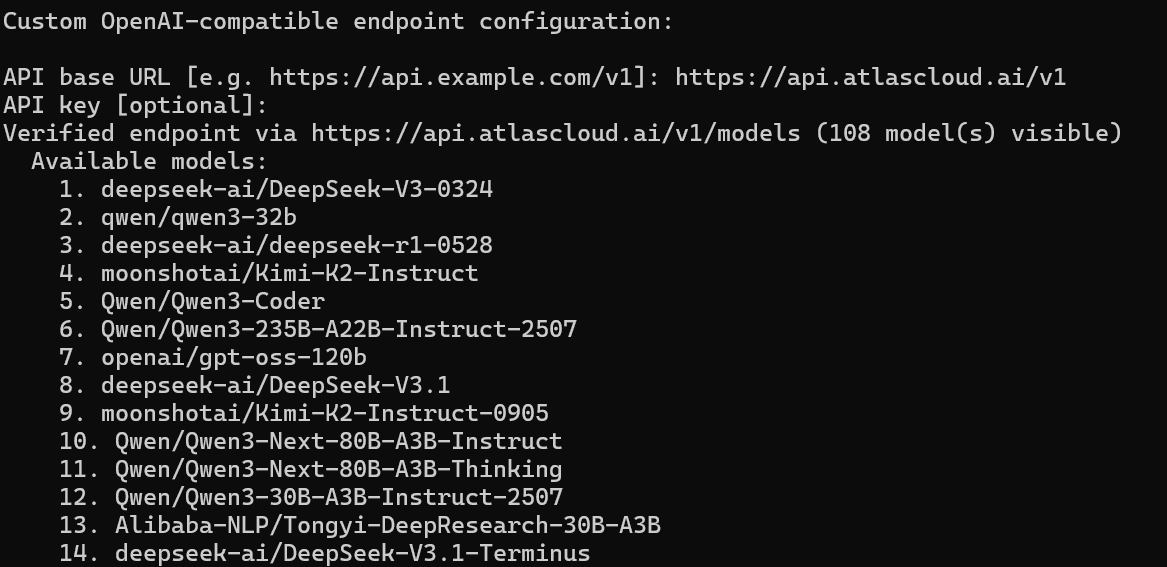

1primary4. Hermes Agent (交互式设置)

Hermes 使用向导而非配置文件:

bash

plaintext1hermes setup

根据提示输入:

- Provider: text

1custom - Endpoint: text

1https://api.atlascloud.ai/v1 - API Key: text

1apikey-xxx - Model: text

1moonshot/kimi-k2.6

重要:模型 ID 必须包含

前缀。如果只输入text1moonshot/,会返回 404 错误。text1kimi-k2.6

如需稍后切换模型,请重新运行

1hermes setup

第二部分 — K2.6 实际表现

Claude Code × K2.6 — 当 23 个 Agent 同时运行时会发生什么?

当我们将 AI 系统推向极限时,最先崩溃的会是什么?

一位开发者决定进行测试:通过 Claude Code 同时运行 23 个 Agent,并持续一整天。在 26 次会话中,系统处理了高频工具调用、多步流水线以及长链任务(如撰写 PRD 和 SEO 规划)。换句话说,这是典型的“类生产”环境工作负载。

但这次发生了一些不同寻常的事情。

没有出现一次 429 速率限制错误。

对于任何尝试过扩展 Agent 工作流的人来说,这一点尤为突出。在类似条件下,GLM 5.1 等模型往往会频繁触碰速率限制,导致重试、流水线中断以及系统不稳。而 K2.6 表现得非常稳健——它不是通过提升极致速度,而是通过在压力下保持一致的可靠性来脱颖而出。

这种区别意义重大。

因为一旦脱离了单一提示词,进入多 Agent 系统,真正的挑战不再是“模型回答得好不好”,而是:

它能否在处理数十个并行任务的同时,持续保持高水平输出,而不使系统崩溃?

这不仅仅是生成,更是逻辑规划

区别不仅在于稳定性。在处理复杂任务时,K2.6 的逻辑展现也截然不同。

当被要求撰写 PRD 时,模型不仅仅是进行回答,它还自主构建了问题域。竞争分析、用户画像、功能优先级排序——这些并未被明确要求,但它们自然地呈现了出来,仿佛系统天生理解什么是“完整”的 PRD。

在 SEO 任务中,表现同样如此。K2.6 没有直接跳向关键词建议,而是先推断出搜索意图,再据此调整内容方向。输出的内容感觉不像是在单纯生成文字,而是在进行早期的战略规划。

这是一个细微但关键的转变:

你得到的不再仅仅是答案,而是结构化的思维。

在多 Agent 环境中,这种优势会成倍放大。当每个 Agent 都能输出结构化、高质量的结果时,协调层需要进行的清理工作就会大幅减少。

代价:稳定性伴随着成本

当然,这种表现并非没有代价。

K2.6 明显比 GLM 5.1 要慢,特别是在首字延迟 (TTFT) 方面。延迟并非微不足道,大约高出一个数量级。在单次交互中,这或许可以忍受;但在 23 个 Agent 并行运行的系统中,每一个步骤都会引入轻微的停顿,累积起来就会变得明显。

这部分源于其架构。K2.6 采用了混合专家模型 (MoE) 设计,总参数量约 1 万亿,推理时激活约 320 亿。这种规模带来了强大能力,但也增加了调度开销。由于这仍是预览版,推理优化尚未完全释放。

权衡点很明确:

- 如果你追求吞吐量和速度,这很重要;

- 如果你追求大规模下的稳定性和结构化输出,这很值得。

OpenCode × K2.6 — 从单次提示到九路并行工作流

如果说 Claude Code 实验展示了 K2.6 在压力下的表现,那么 OpenCode 则揭示了它的另一面:如何组织工作。

K2.6 引入了一个名为 AgentSwarm 的协调层,单一的“协调员”Agent 可以生成数十个专业子 Agent,每个都被分配特定角色。系统不再在单个线程中按顺序处理任务,而是将其拆解并并行运行多个流程。

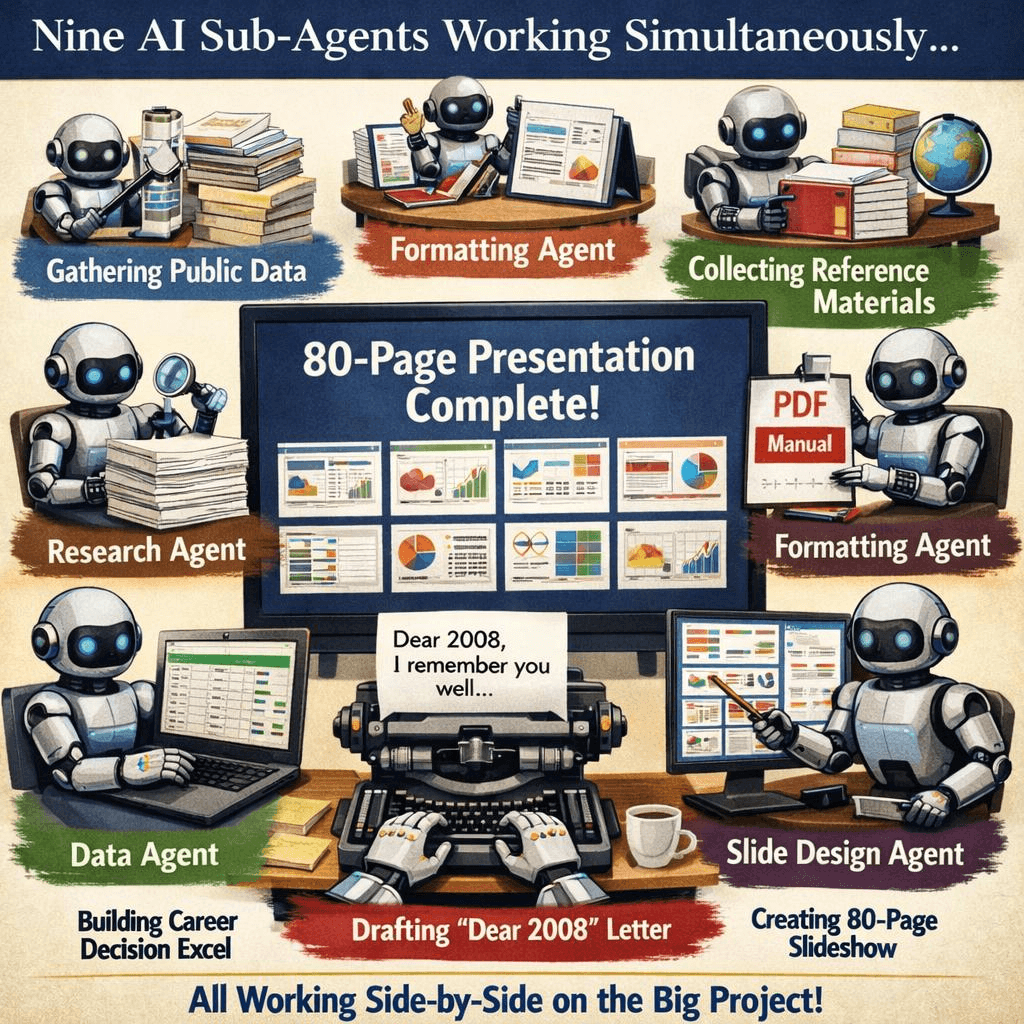

举个例子:研究员要求 K2.6 对 Dario Amodei 进行深入剖析,追踪他从普林斯顿物理学博士到创立 Anthropic 的历程。K2.6 没有将其视为单一的长文生成任务,而是将其分解为 九个并行轨道。

每个轨道都有明确的职责。一个 Agent 专注于研究,搜集公开信息;另一个处理排版,将资料整理成结构化的 PDF;还有一个 Agent 构建关键职业决策点数据集;与此同时,撰写 Agent 创作了一篇名为《致 2008》的第一人称叙事文。

这些全部同步完成。

最终产出的不仅是一个单一的输出,而是一套协调的交付物:一套 80 页的 PPT 演示文稿,配有结构化数据和格式化文档。原本需要多个工具、多次会话和手动拼凑的工作,现在被统一成了一份成果。

为什么这改变了 AI 的使用方式

关键在于 技能系统 (Skill system)。

K2.6 不再将每个任务视为全新的提示,它允许你加载结构化知识——如高盛报告、竞争对手分析或编写规范的文档——并将它们转化为可复用的“技能”。当子 Agent 运行时,它会继承这种框架:分析风格、语气,甚至是结构。

随着时间推移,你的系统将不再是简单的提示词驱动工作流。

它会变成一个可重复的生产流水线。

这改变了对 AI 使用方式的看法:

你不再是在向模型提问,而是在管理一个团队。

如果你正在构建基于 Agent 的工作流,这种差异是不容忽视的。

四个工具均通过

1https://api.atlascloud.ai/v11moonshot/kimi-k2.6FAQ

-

使用 Hermes Agent 与直接调用 Kimi K2.6 API 有什么区别?

核心区别在于 执行与响应。

直接调用 Kimi K2.6 API,你得到的本质上是每个请求的单次响应。即使是复杂任务,你仍然需要手动拆解、多次迭代提示词并自己组合输出。这对于简单或交互式场景效果不错,但对于结构化工作流则效率低下。

Hermes 通过引入 工作流编排 改变了这一点。你定义一个包含多个步骤(研究、规划、执行等)的流水线,Hermes 将每个步骤分配给对应的 Agent。这些 Agent 可以相互传递结果、验证中间输出,甚至在出错时自动重试。

这意味着你从“提示词工程”转向了任务编排。API 成为了系统中的一个组件,而非系统本身。

-

Kimi K2.6 适合多 Agent 工作流和自动化吗?

是的,这正是它表现出色的领域。

在多 Agent 设置中,最大的挑战通常是:

- 步骤间的一致性

- 长时间运行时的稳定性

- 遵循结构化任务的能力

Kimi K2.6 在这三个方面表现强劲。当在 Hermes 中使用时,它可以在多个阶段保持结构化输出,并在处理复杂任务链时不会丢失格式或方向。

另一个重要方面是自我修正。如果中间结果偏离目标,系统可以重新生成该步骤,而不是带着错误的数据继续。这使得它非常适合那些不需要你手动监督每一步的自动化场景。

总体而言,它更像是一个可靠的执行层,而非简单的文本生成器。

-

为什么在 Agent 工作流中 Kimi K2.6 比其他模型慢?

速度较慢主要是由于其使用方式,而不仅仅是模型本身的问题。

在标准聊天场景中,你只需要等待一个响应。而在 Agent 工作流中,单个任务可能包含多个步骤——每个步骤都需要单独的模型调用,外加 Agent 间的协调开销。这自然会在每个阶段引入延迟。

此外,Kimi K2.6 采用了更复杂的架构(例如 MoE 路由),与较小或更优化的模型相比,这会增加推理开销。当结合多 Agent 编排时,延迟就更加明显了。

然而,权衡在于每个步骤都能产出更高质量、更结构化的输出,从而减少了重试或手动修正的需求。因此,虽然它在原始响应速度上较慢,但在工作流层面上却更加高效。