OpenAI Sora 2 是一款用于 AI 视频生成的尖端模型,尤其擅长物理模拟。物体坠落、反弹、破碎以及与周围环境的互动方式看起来非常真实可信——这是目前没有任何竞争模型能完全比拟的成就。本 Sora 2 教程涵盖了开发者通过 Sora 2 Atlas Cloud API 将其集成到工作流中所需了解的一切,包括定价、Python 代码示例、提示词工程,以及与 Seedance 2.0、Kling 3.0 和 Veo 3.1 的直接对比。

查看 Sora 2 的实际效果:Sora 2 API 可通过 Atlas Cloud 访问,费用为每秒生成视频 0.15 美元。Atlas 在注册时还会提供 1 美元的免费额度。Atlas 用户只需一个 API 密钥即可访问 Sora 2 以及 300 多个其他模型,无需分别在 OpenAI、快手、字节跳动和 Google 注册账户。

Sora 2 概览

- 开发者: OpenAI

- 模型 ID: text

1openai/sora-2/text-to-video-pro-developer - 最大分辨率: 高清 (High Definition)

- 最长时长: 12 秒

- 帧率: 30fps

- 原生音频: 是

- 参考输入: 1 张图片

- 核心优势: 物理模拟、逼真的物体交互

- Atlas Cloud 价格: $0.15/秒

Sora 2 的主要功能

物理模拟

Sora 2 正是在这一领域真正脱颖而出。重力、动量、流体动力学和碰撞动力学的模拟达到了其他模型无法始终如一地重现的保真度。输入关于保龄球击中球瓶的提示词,结果将展示出正确的力分布、球瓶散开模式和后续动作。Kling 3.0 和 Seedance 2.0 大多是对这些互动进行估算;而 Sora 2 则是模拟它们。

逼真的物体交互

Sora 2 模型对物理的理解不仅仅局限于单个物体。将液体倒入杯子、堆叠会倾斜并倒塌的积木,或者猫将东西从桌子上推下,这些都涉及对物体间如何相互作用的因果推理。Sora 2 模型展示了比迄今为止通过公共 API 提供的任何其他模型都更强的复杂、多物体交互的稳健性。

材质和表面渲染

玻璃、金属、水、织物和木材在 Sora 2 的输出中都表现出独特的物理特性。光线在穿过透明介质时会发生折射。镜子能捕捉并扭曲周围环境。织物悬挂和起皱时带有合适的质感。这种材料保真度提升了 Sora 2 输出的整体真实感。

原生音频生成

Sora 2 可以与视频同步生成音频。脚步声与行走动作节奏吻合,碰撞声恰到好处,背景噪音也符合场景需求。音频虽然未达到商业生产质量,但提供了一个可用的基准,减少了许多工作流程中的额外步骤。

时间一致性

在长达 12 秒的最大时长内,Sora 2 在光照、角色呈现和背景细节方面表现出高度的内部一致性。物体不会在帧与帧之间改变颜色或形状。阴影在整个视频片段中都会适当地跟随光源。这种连续性对于缓慢、有条理的动作镜头尤为关键,因为这些镜头很容易显示出突兀的不连续性。

Sora 2 定价

OpenAI Sora 2 官方访问权限

OpenAI Sora 2 的访问权限由 ChatGPT 作为其 Plus 订阅(20 美元/月)或 Pro 订阅(200 美元/月)的一部分提供,但有严格限制。虽然 Plus 订阅用户每月获得的生成次数有限,但在高峰时段队列时间可能会很长。也可以通过 OpenAI 的直接 API 访问,但这仅适用于经过 OpenAI 批准的开发者账户,且 Sora 2 的定价更高。

Atlas Cloud API 定价(推荐)

开发者访问 Sora 2 API 最简单的方法是通过 Atlas Cloud:

- 模型: text

1openai/sora-2/text-to-video-pro-developer - 价格: $0.15/秒

- 10 秒片段: $1.50

- 12 秒片段(最大值): $1.80

- 注册免费额度: $1.00

- 队列: 无等待时间

注册时赠送的 1 美元免费额度约等于 6 秒的 Sora 2 视频——让您在决定付费使用更多额度之前,可以先体验其质量和物理准确性。采用 Sora 2 定价,对于大规模生产的团队来说,费用呈线性增长且非常可预测。

如何访问 Sora 2 API

选项 1:OpenAI 直接访问

用户可以通过 OpenAI 的官方渠道访问 Sora 2,即通过 ChatGPT 订阅或开发者 API。开发者 API 的访问权限取决于是否拥有经过批准的账户,并且每次生成都会产生更高的成本。文档请参考 platform.openai.com,入驻流程包括视频生成端点的等待名单审批。

选项 2:Atlas Cloud(推荐)

对于许多开发者来说,通往生产环境的最快途径是通过 Sora 2 Atlas Cloud 集成。一个 API 密钥即可调用 OpenAI Sora 2 以及包括 Seedance 2.0、Kling 3.0 和 Veo 3.1 在内的 300 多个其他模型。无需等待名单。无需单独账户。统一结算。

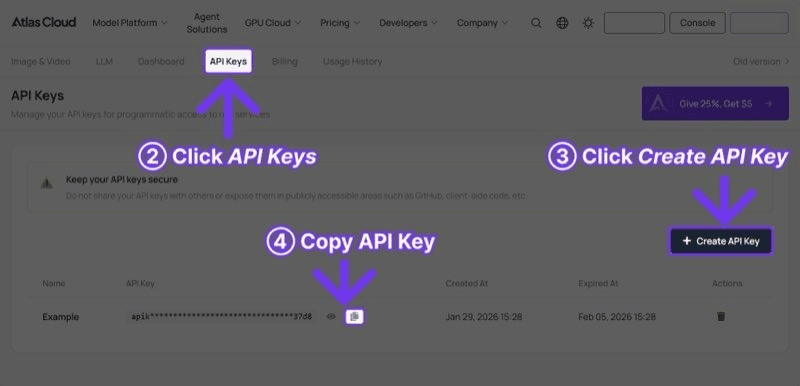

步骤 1: 在 atlascloud.ai (https://www.atlascloud.ai?utm_medium=article&utm_source=blog&utm_campaign=sora-2-guide) 注册并从仪表板获取您的 API 密钥。您的账户将自动添加 1 美元免费额度。

步骤 2: 使用 Python 生成 Sora 2 视频:

python1import requests 2import time 3 4API_KEY = "your-atlas-cloud-api-key" 5BASE_URL = "https://api.atlascloud.ai/api/v1" 6 7# 使用 Sora 2 生成视频 8response = requests.post( 9 f"{BASE_URL}/model/generateVideo", 10 headers={ 11 "Authorization": f"Bearer {API_KEY}", 12 "Content-Type": "application/json" 13 }, 14 json={ 15 "model": "openai/sora-2/text-to-video-pro-developer", 16 "prompt": "A glass sphere rolling down a wooden staircase, each bounce creating ripples of light, realistic physics and reflections, cinematic slow motion", 17 "duration": 10, 18 "resolution": "1080p" 19 } 20) 21 22result = response.json() 23 24# 轮询结果 25while True: 26 status = requests.get( 27 f"{BASE_URL}/model/prediction/{result['request_id']}/get", 28 headers={"Authorization": f"Bearer {API_KEY}"} 29 ).json() 30 if status["status"] == "completed": 31 print(f"Video: {status['output']['video_url']}") 32 break 33 time.sleep(5)

步骤 3: API 会立即返回一个

1request_id1completedSora 2 提示词技巧

在对 Sora 2 API 进行大量测试后,本教程部分总结了各种能可靠产生高质量结果的提示词方法。Sora 2 在响应专注于物理交互和材料行为的提示词方面表现出色。

- 明确物理细节。Sora 2 底层最强大的引擎是物理模拟,所以要充分利用它。不要只说"一个球在弹跳",试着说"一个橡胶球从肩高处掉落到硬木地板上,反弹 3 次且高度递减,具有逼真的弹性和阴影移动"。模型鼓励物理特异性的描述。

- 描述材料和表面。Sora 2 能模拟具有不同属性的材料。使用具体的材料名称:"磨砂玻璃"、"拉丝铝"、"潮湿的鹅卵石"、"丝绸窗帘"。模型能识别这些纹理,并将光物理特性正确映射到每一种上。

- 使用电影语言进行摄影机操作。Sora 2 能很好地将基本的电影术语转换为摄影机指令。"缓慢向前推拉"、"从前景到背景的焦点转换"、"低角度追踪镜头"——这些术语都能让摄影机执行你预期的动作。不要使用像"酷炫的运镜"这样模棱两可的指令。

- 设计 10-12 秒的提示词。考虑到 12 秒的最长时长,提示词应描述一个动作或一组连贯的动作。一个主体、一个主要动作、一个核心画面。不要试图将多个场景和剪辑强行塞进一次生成中。

- 利用因果链。Sora 2 在处理物理世界中先后发生的事件方面似乎很强。"多米诺骨牌穿过桌面,撞倒一杯铅笔"或"划火柴,点燃蜡烛芯"——这些包含多个步骤的物理事件短语能发挥出模型的优势。

测试中表现良好的示例提示词:

物理展示:

plaintext1A ceramic mug tipping off the edge of a kitchen counter in slow motion, 2shattering on impact with a tile floor, fragments and liquid scattering 3realistically, soft morning light from a nearby window, cinematic depth of field

产品演示:

plaintext1A smartphone placed on a reflective dark surface, water droplets falling 2onto the screen and beading naturally, demonstrating water resistance, 3studio lighting with subtle blue accent lights, 4K commercial style

自然模拟:

plaintext1A single drop of water falling into a still pond, creating concentric 2ripples that expand outward, a fallen autumn leaf floating on the surface 3gently disturbed by the waves, golden hour lighting, macro lens perspective

Sora 2 与竞品对比

- Sora 2: 最大分辨率:高清,最长时长:12s,参考输入:1 张图片,原生音频:是,API 成本(Atlas Cloud):$0.15/秒,最佳优势:物理真实感,内容过滤:严格

- Seedance 2.0: 最大分辨率:高清,最长时长:15s,参考输入:12 个文件,原生音频:是,API 成本(Atlas Cloud):$0.022/秒,最佳优势:多模态控制,内容过滤:严格

- Kling 3.0: 最大分辨率:超高清,最长时长:10s,参考输入:1-2 张图片,原生音频:是(5 种语言),API 成本(Atlas Cloud):$0.126/秒,最佳优势:分辨率 + 性价比,内容过滤:非常严格

- Veo 3.1: 最大分辨率:高清电影级,最长时长:8s,参考输入:1-2 张图片,原生音频:是,API 成本(Atlas Cloud):$0.03/秒,最佳优势:电影级质感,内容过滤:中等

Sora 2 的胜出之处

OpenAI Sora 2 在物理模拟的逼真度以及物体行为的可信度方面处于领先地位。在基于物理的因果关系视频内容(产品演示、解释性可视化、基于物理的艺术创作)方面,没有任何其他模型能与其输出质量相提并论。其 12 秒的最大时长比 Kling 3.0 (10s) 和 Veo 3.1 (8s) 有所改进,允许在单个片段中承载更多内容。

Sora 2 的不足之处

对比 Sora 2 的价格,$0.15/秒是本文中价格最高的。Seedance 2.0 每秒 0.022 美元的成本比它便宜约 85%。分辨率上限为高清,低于 Kling 3.0 的超高清。参考输入仅限 1 张图片,而 Seedance 2.0 最多可处理 12 个文件(9 张图片、3 个视频、3 个音频)。对于预算有限的团队或需要深度参考控制的项目,这些差异非常关键。

实用方法

如本 Sora 2 教程中所述,大多数团队将需要不止一种模型,且不会只使用 Sora 2。Sora 2 适用于制作物理效果重的场景。Seedance 2.0 适用于复杂的、多参考的项目。Kling 3.0 适用于全分辨率的最终渲染。Veo 3.1 适用于电影级质感打磨。Atlas Cloud 通过单一 API 密钥和统一账单,使得这种多模型策略变得可行。

谁应该使用 Sora 2?

如果符合以下条件,请选择 Sora 2:

- 物理准确性是首要需求。重力、流体动力学、碰撞和材料交互是 Sora 2 的核心优势。

- 项目涉及产品演示,需要物体表现真实——如掉落、溅射、旋转、机械运动等。

- 教育或科学可视化工作要求模拟出经得起推敲的真实物理行为。

- 12 秒的时长限制已足够满足预期内容。Sora 2 提供的单片段时长比 Kling 3.0 和 Veo 3.1 更长。

- 比起成本,更看重物理驱动内容的输出质量。

如果符合以下条件,请改选 Seedance 2.0:

- 项目需要大量的参考材料——如输入多个图片、视频和音频文件。

- 预算效率至关重要。在 Atlas Cloud 上每秒 0.022 美元,Seedance 2.0 约为 Sora 2 成本的 1/7。

- 需要更长的片段(最长 15 秒)。

- 多模态输入控制比物理准确性更重要。

如果符合以下条件,请改选 Kling 3.0:

- 需要超高清输出。Sora 2 的输出仅限于高清分辨率。

- 免费额度很重要。Kling 3.0 提供每日 66 个额度;Sora 2 需要付费订阅。

- 电商内容需要在生成的视频中展现清晰、可读的文本渲染。

如果符合以下条件,请改选 Veo 3.1:

- 电影级的视觉效果和色彩分级是重中之重。

- 需要高性价比的规模化扩展。每秒 0.03 美元,Veo 3.1 比 Sora 2 便宜 5 倍。

- 对于您的用例,更短的片段(最长 8 秒)是可以接受的。

常见问题解答

如何访问 Sora 2 API?

最简单的方法是通过 Atlas Cloud。注册,获取 API 密钥,并在请求中包含模型 ID

1openai/sora-2/text-to-video-pro-developerSora 2 每个视频多少钱?

在 Atlas Cloud 上,Sora 2 的价格为每秒视频 0.15 美元。一个 10 秒的片段费用为 1.50 美元。最长 12 秒的片段费用为 1.80 美元。通过 OpenAI 直接访问 Sora 2 的定价因订阅等级而异,但对于同等输出质量,通常比 Sora 2 Atlas Cloud 的费率更贵。

Sora 2 最长能生成多长的视频?

Sora 2 高清分辨率下的最长时长为 12 秒。它处于 Seedance 2.0(最长 15 秒)和 Kling 3.0(最长 10 秒)之间。大多数人通过创建多个片段并在剪辑中合并来完成更长的作品。

Sora 2 可以进行图生视频生成吗?

可以。Sora 2 接受单张参考图片作为输入,模型将该图片作为视频的初始帧或风格参考,但仅限一张。Seedance 2.0 最多支持 12 个参考文件,适用于更复杂的参考驱动生成。

Sora 2 比 Seedance 2.0 或 Kling 3.0 更好吗?

这些模型在不同领域各有所长。Sora 2 拥有最好的物理模拟和现实世界物体交互能力。Seedance 2.0 具有最好的多模态输入控制和最低的 API 定价($0.022/秒)。Kling 3.0 拥有最高的分辨率输出和最宽松的免费额度。对于大多数团队,最佳策略是通过像 Atlas Cloud 这样的统一平台使用这三者,并针对每项任务选择最合适的模型。

Sora 2 会随视频生成音频吗?

是的。Sora 2 的原生音频生成与视觉同步。音频对于草稿和社交媒体内容是可用的,尽管对于专业内容,可能需要在后期制作中进行替换或增强。

结论

Sora 2 在 AI 视频生成生态系统中拥有非常特定的位置。它不是性价比最高的,分辨率也不是最高的,输入系统也不是最开放的。但它拥有目前任何公共 API 中可用的、物理准确度最高的视频生成能力。如果您的应用或内容依赖于符合真实世界的物理规律——如产品演示、教育、科学可视化、基于现实的艺术创作——那么 Sora 2 是对您而言最强大的选择。

本 Sora 2 教程的核心实用建议:在 Atlas Cloud 上访问 Sora 2 + Seedance 2.0、Kling 3.0、Veo 3.1 以及 300 多个模型。一个 API 密钥,一张账单。自由选择最适合每项工作的模型。使用 1 美元免费额度开始并行测试 Sora 2 的物理模拟能力,并随需求扩大规模。

────────────────────────────────────────────────────────────