不久前,制作一段高质量的社交媒体视频还需要一整个团队的配合:撰写脚本、拍摄、剪辑、声音设计。到 2026 年,整个流程已被压缩为一个文本提示词(text prompt)和一个 API 调用。如今,将产品描述、一行脚本或内容摘要直接转化为可发布视频片段的基础设施已经成型。

本文将阐述这种基础设施的形态、如何基于它进行构建,以及如何使其在规模化应用中实现稳定运行。

为什么社交视频自动化在当下至关重要

短视频早已不再仅仅是娱乐。TikTok、Instagram Reels 和 YouTube Shorts 已成为推动文化、营销和电子商务的核心分发引擎。但存在一个简单的制约因素:内容生产无法随需求同步扩展。

即使对于经验丰富的创作者来说,制作高质量视频也需要耗费大量时间——包括构思脚本、故事板、拍摄或寻找素材、剪辑、调色、混音、添加字幕。制约因素往往不是创意本身,而是执行速度。当一个热点趋势仅能持续几小时,抢先发布者即为赢家。AI 视频生成通过将批量生产从一项昂贵的资本项目转变为日常运营成本,彻底改变了游戏规则。

为什么 API 比用户界面更重要

许多 AI 视频工具提供了美观的网页界面:输入提示词、点击按钮、查看结果。这对个人创作者很方便。但如果你正在构建一套自动化内容系统,UI 将无济于事。真正实现规模化的关键在于 API。

API 带来了可编程性。你可以批量提交任务,自动为不同平台调整纵横比,将视频生成作为原生功能嵌入你的 SaaS 平台。你可以运行程序化的 A/B 测试——针对同一产品描述生成十种不同风格的变体,发布到不同的受众群体,然后利用互动数据来优化下一批提示词。

以一家每天上架两百个新产品的电商平台为例。如果手动为每个产品制作展示视频,需要数十名专业视频剪辑师。而使用 API,你可以编写一个脚本来读取产品数据库,自动组装提示词模板,调用 API,并将结果推送到社交媒体排期工具中。整个过程无需任何人工打开剪辑软件。UI 是给普通用户用的,API 则是为系统而生的。真正的突破正来自于后者。

一次 API 调用的生命周期

让我们追踪一次从提交到下载的真实 API 调用过程。

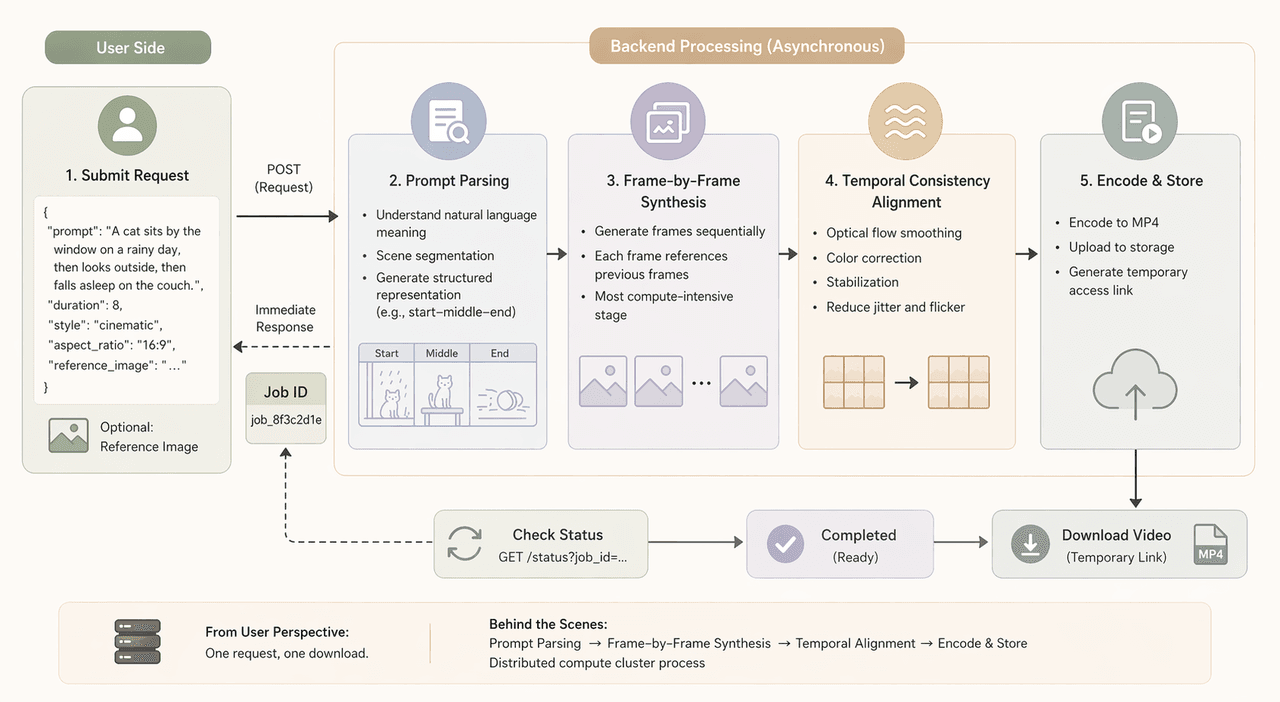

首先,将你的提示词和参数封装进 JSON。请求通常包含提示词、时长(例如 8 秒)、风格预设、纵横比(aspect_ratio),有时还需要一张参考图像来锁定角色或场景。你将其发送至端点,系统会立即返回一个唯一的任务 ID。由于生成过程需要数秒到数分钟不等,因此该过程是异步的。

提交后,后端开始处理。

第一步是提示词解析——将你的自然语言转化为结构化表示。这包括场景分割:如果你的描述暗示了三个连续动作,模型会自行计算出开头、中间和结尾。

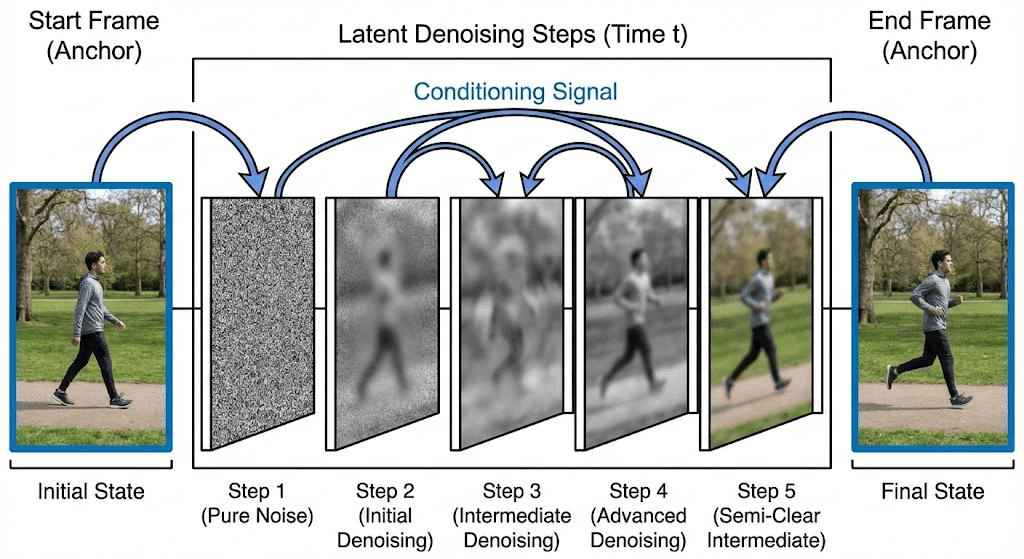

第二步是逐帧合成。模型按顺序生成帧,每一帧都参考前一帧以保持连贯性。这是计算最密集的阶段。

第三步是时间一致性校准。即使模型表现极佳,原始帧仍可能存在细微抖动。后续处理阶段会应用光流平滑、色彩校正和稳定处理。

最后,系统将视频编码为 MP4,上传至存储空间并生成临时访问链接。从用户的角度来看,这是一次请求和一次下载。而在幕后,分布式计算集群已经完成了大量工作。

不同角色如何利用此技术

独立创作者利用 API 扩充输出量。你可以拿出一个核心创意并生成十几种变体——改变色调、更换配音风格、调整摄像机运镜。你原本每周只能产出三个视频,现在每天可以做出十个。瓶颈从生产速度转移到了你对内容取舍的判断力上。

快速演示:一个创意,多种变体

plaintext1import requests 2 3API_KEY = "YOUR_API_KEY" 4url = "https://api.atlascloud.ai/api/v1" 5 6styles = ["cinematic", "anime", "documentary", "vlog"] 7 8for style in styles: 9 payload = { 10 "prompt": "A cat sitting by the window, wind blowing curtain", 11 "duration": 6, 12 "style": style, 13 "aspect_ratio": "1:1" 14 } 15 16 res = requests.post(url, json=payload, headers={ 17 "Authorization": f"Bearer {API_KEY}" 18 }).json() 19 20 print(f"{style} → job_id:", res["job_id"])

营销团队则采用更系统化的方法。一个常见的用例是多地区本地化。一家在二十个国家开展业务的全球品牌可以制作一个主视频,然后通过脚本自动替换每个语言版本的屏幕文字、配音和视觉细节。原本一个月的工期缩短为几天。

电商是另一个快速增长的领域。一张静态产品图片加上简短描述,即可变成动态展示视频。对于一块智能手表,你输入带有光影和运镜的特写描述,系统即可生成六秒的循环视频。放置在产品详情页上时,这种视频片段的转化效果往往优于静态图片,且你可以批量处理整个目录。

开发者和 SaaS 平台将视频生成打包为服务。社交媒体排期工具可以集成 API,让用户只需输入推文,工具即可自动将其扩展为视频脚本、生成视频并安排发布。这些平台正在将视频生成转化为一种基础能力。

如何让 AI 输出达到生产级别

一个残酷的真相是:原始的 API 输出通常无法直接发布。成功的生产系统会在 API 之上封装多个层级。

首先是提示词工程(Prompt Engineering)。成熟的团队会为不同类别、风格和平台维护提示词模板库。Instagram Reels 的提示词强调高饱和度和快速剪辑,而 YouTube Shorts 的提示词侧重叙事节奏。模板中包含由脚本动态填充的变量。

其次是生成质量管理。同一个提示词运行五次,可能会产出三个可用的片段和两个有瑕疵的片段(如变形的手指、不合逻辑的背景物体)。你需要编写自动化检查逻辑,识别常见的失败模式,并标记需要重新生成的片段。

第三是后期处理流水线。生成后,你可能需要添加 LOGO、片头/片尾或内嵌字幕。这些都应通过脚本完成,而不是重新导入剪辑软件。

第四是缓存与重用。如果你的库中反复使用相同的产品或角色,请缓存结果。这既能降低成本,又能保持视觉一致性。

所有这些层级共同构建了一个真正的内容引擎。API 只是其中的一个组件,价值在于你如何组装整套系统。

目前仍存在的问题

AI 视频生成远未完美。如果你试图生成超过 15 秒的内容,往往会遇到问题——物体变形、场景逻辑断裂、角色不一致。当前模型有效的叙事窗口期很短。

计算成本是另一个制约因素。生成一秒钟的高质量视频所需的 GPU 时间远多于生成一张图片。价格虽在下降,但对于每天需要数百个视频的团队来说,成本计算依然关键。务实的做法是将昂贵的生成资源留给关键内容,而对测试内容使用低成本选项。

提示词的不可预测性也是一个长期麻烦。同一个提示词今天和明天的结果可能截然不同,且不同提供商之间的结果差异巨大。自动化系统需要额外的稳健性——假设并非每次生成都能达到预期,并在逻辑中预留重试机制。

多场景的叙事连贯性依然很弱。你可以生成“一个人在咖啡馆喝咖啡”,也可以生成“同一个人走到街上”,但模型无法自动理解其中的衔接。要实现多场景视频,目前你必须详细描述每一个分镜剪辑。

未来趋势

尽管存在局限,但方向是明确的。视频生成不会只是一种独立工具。未来几年,预计会出现全自动的内容流水线:系统每天早上扫描趋势,自动生成视频概念,进行小规模测试,选出表现最好的视频并进行投放放大。人类无需做出创意决策,只需进行最终的品牌安全审核。

同时,期待代理式(agentic)创意系统的出现。你给 AI 代理一个目标(例如“本周提高新产品曝光度”),它会提出脚本方向、生成候选素材、发布到测试受众、分析反馈、调整策略并生成下一批内容。

实时个性化视频流也将出现。健身 App 可以利用用户的个人数据、进度视觉和鼓励性的旁白,生成个性化的周度总结视频。

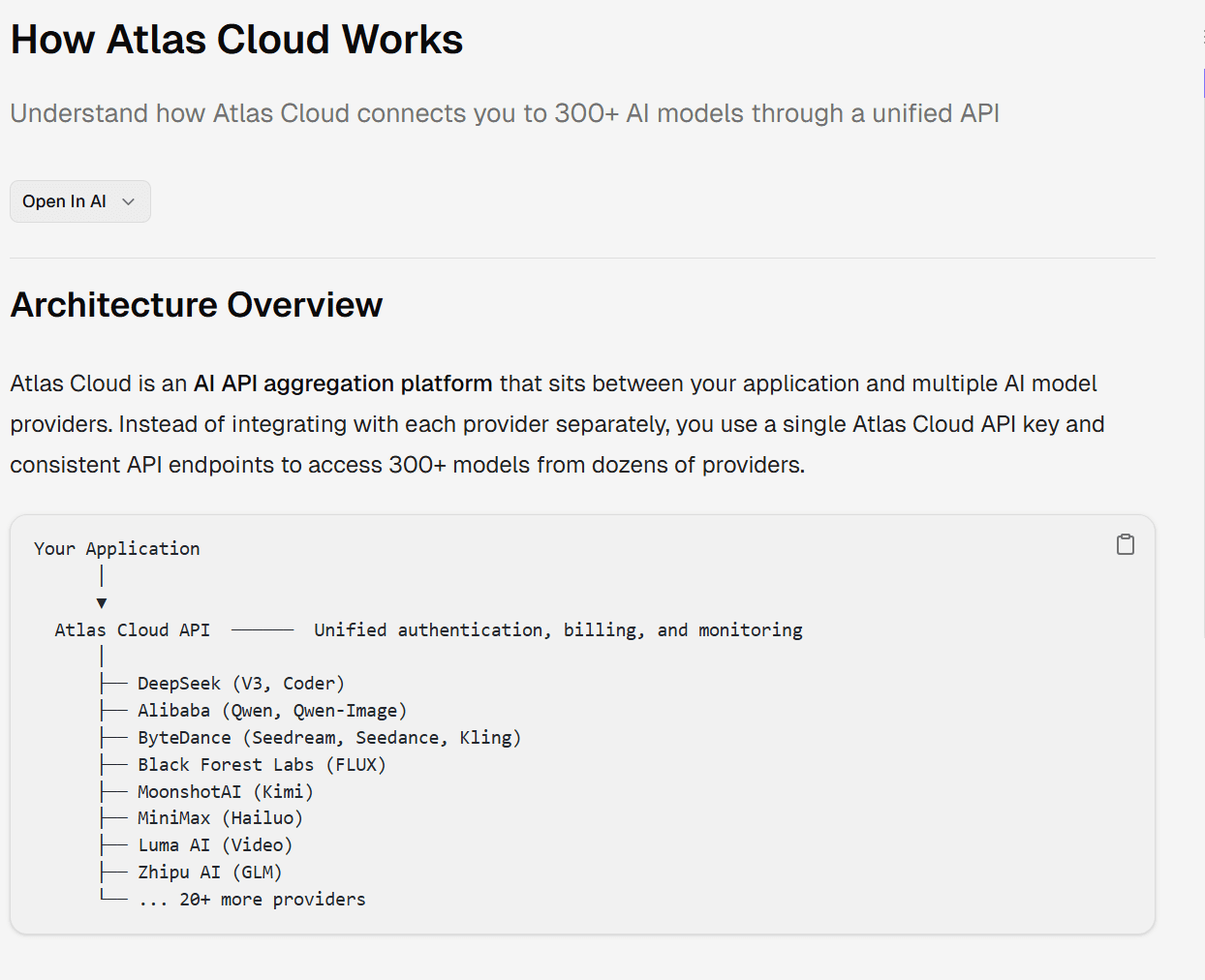

最后,期待与营销自动化堆栈的深度集成。像 AtlasCloud 这样的平台支持聚合多种图像和视频生成模型,使用户能够更轻松地将其整合到自己的创意或商业项目中。

结语

从人工剪辑到基于 API 生成的转变,不仅仅是工具的升级,更是内容制作与消费方式的结构性变革。视频生成 API 正在成为现代数字叙事的基础设施层。对于创作者,这意味着规模化;对于开发者,意味着机遇;对于平台,意味着自动化;对于互联网,则意味着从静态批量生产向持续生成式媒体系统的跨越。这一转变已经在发生。任何拥有 API Key 和创意的人,无需百万美元预算,现在就可以开始构建自己的视频生产线。