yxUS-H6oB1A

1. 起源:两大模型的碰撞

2026年4月。

OpenAI 推出了 GPT Image 2 —— 在文本渲染、世界知识和美学表现上都达到了极致。

“从今天起,AI 生成的图像,正如 AI 生成的文本一样,正式进入了普通人无法分辨真假的时代。”

与此同时,X(原推特)上有两条高热度帖文引发了关注:

@AI_Jasonyu:

GPT-Image 2 (beta) + Seedance 2.0 —— 这两者结合简直是“杀手级”组合。工作流很简单:先用 GPT-Image 2 生成分镜脚本;确认后,交给 Seedance 2.0 生成长视频。这才是 AI 视频该有的样子。

@arrakis_ai:

Codex + GPT Image 2 的工作流简直无敌。这是我今年见过最具颠覆性的 AI 工作流。我扔进去一行手稿——“把它做成漫画”——直接出来了一部完整成型的漫画。

这两条帖文都指向同一个核心:最强图像模型 + 最强视频模型,串联成一条工作流。

问题在于:以前要跑通这条流水线,你需要 OpenAI GPT Image 2 的额度、字节跳动 Seedance 2.0 的访问权限,还得写一堆胶水代码来处理提示词、轮询(polling)和 CDN 资源。

现在,不需要了。

2. Atlas Cloud 接入 GPT Image 2:一个 Key,一键串联

Atlas Cloud 现已将 GPT Image 2 加入其模型库,与完整的 Seedance 2.0 系列(Text-to-Video / Image-to-Video / Reference-to-Video / Fast / Upscaled)处于同一池中。

| 以前 | 现在 |

|---|---|

| 申请 OpenAI 额度 + 分别集成 Seedance | 一个 Atlas Cloud API key |

| 两套 SDK,两套计费系统,两套文档 | 统一入口: text |

| 自己写轮询 / CDN / 错误处理 | 官方 SDK / MCP / 技能模板直接可用 |

实际上只需要两个接口:

# 生成图像 (GPT Image 2 / Seedream / Qwen Image 等) POST https://api.atlascloud.ai/api/v1/model/generateImage # 生成视频 (Seedance 2.0 / Kling / Vidu 等) POST https://api.atlascloud.ai/api/v1/model/generateVideo # 公共轮询接口 GET https://api.atlascloud.ai/api/v1/model/prediction/{id}

使用 Bearer token 认证。设置

1export ATLASCLOUD_API_KEY=...合规提示:本教程中的每一个角色都是由 GPT Image 2 渲染的照相级数字角色。不涉及也不暗示任何真实人物肖像。

3. 最强图像 GPT Image 2 + 最强视频 Seedance 2.0

市面上大多数 AI 视频教程采用的是以下两种路径之一:

路径 A:纯文本生成视频(直接提示词 → 15秒视频)

- 问题:单次抽奖,重试成本高。

路径 B:多段分镜(6–12个片段 × 5秒,最后拼接)

- 问题:慢(6次图生图 + 6次视频生成),昂贵,角色一致性容易崩。

1drama-director路径 C:一张九宫格漫画页 + 一个 15 秒动画视频

- GPT Image 2 生成一张 3×3 九宫格页面(9 个分镜画面绘制在同一张图中,类似漫画页)。

- Seedance 2.0 I2V 接收该图片 + 运动提示词,单次调用产出一个 15 秒视频 —— Seedance 将九宫格图片视为其视觉基因和分镜参考(角色、服饰、场景、光影、色调均从图片锁定),输出一段** 15 秒的电影级实拍片段** —— 你看到的是纳米丝绷紧、游轮航行、金属板断裂、水柱喷涌的动态画面,而不是“镜头在漫画页上平移”。

这种组合的三个优势:

| 维度 | 九宫格方案 | 6-8 段分镜方案 |

|---|---|---|

| 成本 | 1 次图生图 + 1 次视频生成 | 6-8 次图生图 + 6-8 次视频生成 |

| 时间 | ~3-5 分钟 | ~8-15 分钟 |

| 角色一致性 | 9 个分镜在同一画布上 — 模型自然保证 | 每个分镜独立生成,需要参考图锚定 |

| 迭代成本 | 调整 image_prompt,重生成一张图 | 一个分镜修改会导致整条流水线重做 |

| 交付物 | 一部完整的漫画剧视频,直接发布 | 需要后期拼接 |

第三点——角色一致性——是串联工作流中最大的痛点。九宫格本质上是“同一画布上的 9 个区域”,因此 GPT Image 2 自然能保证角色在所有分镜中外观、服装一致。这一个设计决策省去了大量的后期工程。

4. drama-director:一句话,全流水线执行

操作流程

在 Claude Code 中,你只需要:

将这段小说片段转化为漫画剧: <粘贴小说片段>

Claude 识别触发词(“漫画剧” / “分镜” / “九宫格” / ...),加载

1drama-director- 阅读内容 → 提炼为 9 个关键节奏(3×3 阅读顺序)。

- 构建完整的 (分镜描述 + 风格约束),并让你审核。text

1image_prompt - 单次调用 GPT Image 2 → 九宫格漫画页(返回 含text

1.json)。text1image_url - 向你展示九宫格图片;审核通过后,单次调用 Seedance 2.0 I2V → 15 秒动画漫画(返回 含text

1.json)。text1video_url - 输出 Markdown 报告。

你从头到尾只输入了两条消息:剧本,以及“确认”。

模型后台

| 阶段 | 模型 ID (默认) | 备注 |

|---|---|---|

| 九宫格页面 | text | 若 GPT Image 2 未完全开放,自动回退至 text |

| 动态视频 | text | 15s / 720p / 1:1,可配置 |

| 极速版 | text | 更便宜,更快 |

5. 3 分钟完成安装

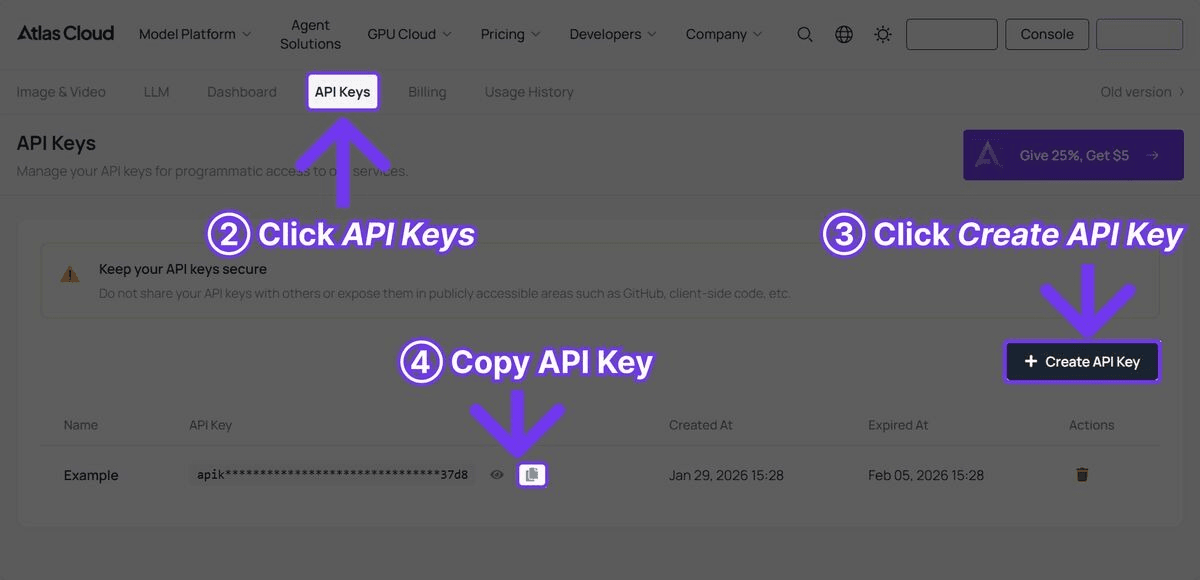

第 1 步 — 获取 API Key

在 atlascloud.ai 注册并从 API Keys 页面生成密钥。

export ATLASCLOUD_API_KEY="sk-your-key" echo 'export ATLASCLOUD_API_KEY="sk-your-key"' >> ~/.zshrc

第 2 步 — 安装 drama-director 技能

从 GitHub 克隆到 Claude 的技能目录:

mkdir -p ~/.claude/skills git clone https://github.com/kianaliang-dev/drama-director-skill ~/.claude/skills/drama-director

验证:

ls ~/.claude/skills/drama-director/ # 预期: SKILL.md scripts/

该技能完全自包含 ——

中内置了场景原型路由(冲击、决斗、追逐、旅程、氛围、揭秘、对峙等)、Seedance 引擎硬约束和双对比剪辑规则。无需其他技能。text1SKILL.md

第 3 步 — 烟雾测试

python3 ~/.claude/skills/drama-director/scripts/generate_image.py \ --prompt "a cinematic 3x3 comic book page with 9 panels showing a cyberpunk chase scene, bold black gutters, film noir palette" \ --aspect 1:1

约 30 秒后,你应该会看到一个包含

1image_url6. 演示:《三体》“古筝行动” → 15 秒漫画剧

为什么选这一段

刘慈欣原著中最具视觉冲击力的片段之一 —— 纳米丝切开巴拿马运河上的游轮。动作密度极高,恰好是 9 个节奏点的内容:

巴拿马运河,午夜。50 根纳米丝,每根直径不到头发丝的十分之一,像巨大的古筝弦一样绷紧在水面上。

游轮“审判日号”驶来。船头接触到纳米丝阵列,继续前进,船身被切成了 45 层。

切片层叠、错位,继而崩塌。大块的金属板像扑克牌一样坠入运河,溅起数层楼高的水柱。

岸上所有人屏住呼吸。这是人类历史上第一次用这种方式消灭巨轮上的每一个灵魂。

对话过程

你在 Claude Code 中输入:

将这段《三体》片段转化为漫画剧(9 格网格 + 15 秒视频): 巴拿马运河,午夜。50 根纳米丝绷紧在水面上... (粘贴全文)

Claude 的操作:

- 识别触发词(“漫画剧” / “9 格网格”),加载 技能。text

1drama-director - 将片段拆解为 9 个节奏点(丝线布置 → 游轮靠近 → 初次接触 → 层叠错位 → 全面切断 → 倾斜崩塌 → 金属碎裂 → 广角余波 → 岸上观察者)。

- 向你展示完整的 以供审核:text

1image_prompt

(略)

你回复“确认”。

- 运行 → 约 1 分钟后返回九宫格图。Claude 发送text

1generate_image.py。text1image_url - 你说“OK,继续。”

- 根据内置的场景原型路由,Claude 选择“冲击”(单次决定性时刻 = 纳米丝切开船体),叠加 Seedance 引擎硬约束(无关节生物力学、无反射、双对比剪辑)以及三段式结构(风格氛围 → 动态描述 → 静态描述),并撰写一段描述真实场景动作的 —— 九宫格图像在此仅作为视觉基因,而非拍摄主体:text

1motion_prompt

(此处包含详细的动态描述描述, Seedance 会根据该描述进行 15 秒的影视级运镜处理)

核心逻辑:Seedance I2V 将九宫格图片视为视觉基因(角色外观、服饰、场景、光影、色彩都从该图锁定),然后根据

生成真实的电影级镜头 —— 而不是“在漫画页上平移”。所以text1motion_prompt必须描述场景中实际发生的动作。text1motion_prompt

- 2-3 分钟后,视频就绪。提供 和text

1video_url。text1/tmp/drama_output/report.md

成本估算

| 项目 | 调用次数 | 预估价格 |

|---|---|---|

| GPT Image 2 九宫格 (1:1, 1024×1024) | 1 | 按 Atlas Cloud 控制台实时价格 |

| Seedance 2.0 I2V (15s / 720p / 1:1) | 1 | 约 0.101/秒×15s≈0.101/秒 × 15s ≈ 0.101/秒×15s≈1.5 |

| 总计 | 每集约 1.5−1.5 - 1.5−2 |

与单次 T2V 抽奖或 6-8 段分镜流水线相比,成本降低至 1/5 – 1/8。

7. 常见变体

| 需求 | 添加提示词即可 |

|---|---|

| 切换为动漫风格 | "Use Japanese anime style, Studio Ghibli palette" |

| 美式超级英雄风格 | "Use American superhero comic style" |

| 电影 / Netflix 质感 | "Use photorealistic cinematic Netflix style, 16:9, 8K" |

| TikTok/Reels 竖屏 | "Use 9:16 nine-panel layout" |

| 1080p 输出 | "Render video at 1080p" |

| 节省费用 | "Use seedance-2.0-fast" |

8. Atlas Cloud 官方 MCP + 技能库(开发者用)

如果你想构建自己的流水线,或者从 Claude Desktop / 其他 Agent 调用原子工具,Atlas Cloud 提供了开源资源:

官方技能库

npx skills add AtlasCloudAI/atlas-cloud-skills

Repo: https://github.com/AtlasCloudAI/atlas-cloud-skills

官方 MCP Server (9 项工具)

claude mcp add atlascloud -- npx -y atlascloud-mcp

安装后,9 个 MCP 工具可在 Claude Desktop / Claude Code 中直接使用。

9. 工作流背后的设计决策

- 为什么是 9 格而不是 6 格或 12 格? 3×3 平衡了可读性和信息密度 —— 阅读一眼即知,9 个节奏足以构建完整的戏剧弧线。12 格会导致单格太小,4 格无法支撑完整剧情。

- 为什么 1 张图 + 1 段视频就够了? Seedance 2.0 I2V 现在足够强悍,给定九宫格图,它能自动生成运镜和局部动画 —— 原本需要人类剪辑的任务现在交给了生成模型。

- 为什么 motion_prompt 描述“场景动作”而不是“平移漫画”? 因为我们想要的是影视级的场景复现,而非“展示一张漫画书”。Seedance 会将九宫格图像的视觉元素“展开”为真实镜头。

10. FAQ

Q: API 费用多少? A: Atlas Cloud 按量计费,无订阅费。每 15 秒视频约 1.5−1.5 - 1.5−2。 Q: GPT Image 2 还没在列表中? A:

1generate_image.py1gpt-image-1.51image_prompt1motion_prompt11. 下一步行动

安装技能后,尝试以下提示词:

- 经典科幻桥段:如“水滴 vs 舰队”、“黑暗森林打击”、“二向箔”。

- 网文高潮片段:任意奇幻/惊悚小说的高潮场景。

- 新闻视觉化:将突发新闻分解为 9 格漫画,用于社交媒体发布。

- 产品叙事广告:将产品功能分解为 9 个节奏,制作 15 秒漫画风广告。

需要扩展技能(添加 TTS 配音、内嵌字幕、B-roll、多集串联)?直接修改

1~/.claude/skills/drama-director/SKILL.md1scripts/相关链接

- Atlas Cloud 控制台: https://atlascloud.ai

- 官方技能库: https://github.com/AtlasCloudAI/atlas-cloud-skills

- 官方 MCP Server: https://www.npmjs.com/package/atlascloud-mcp

- 本教程使用的 drama-director 技能: text

1https://github.com/kianaliang-dev/drama-director-skill