Las antiguas herramientas de movimiento por IA estaban llenas de fallos y horrores corporales. 🫠

¿Los mayores defectos? Manos mal hechas, cero emoción facial y cuerpos que se estiraban como bandas de goma.

Entra Kling 2.6. Corrige por completo el control de movimiento:

1️⃣ Detalles nítidos: Dedos perfectos y microexpresiones. No más desenfoque.

2️⃣ Bloqueo de anatomía: El rigging inteligente mantiene las proporciones corporales 100% consistentes. Sin deformaciones.

Realizamos 4 pruebas extremas de "fuego" para demostrarlo. Los resultados son asombrosos. 👇

01 Los Datos: Dejando atrás a la competencia

Después de ver la introducción, podrías preguntarte: "Hay muchos modelos por ahí que soportan referencia de vídeo. Wan también tiene un control de movimiento sólido. Entonces, ¿por qué afirmar que Kling 2.6 está a años luz de distancia?"

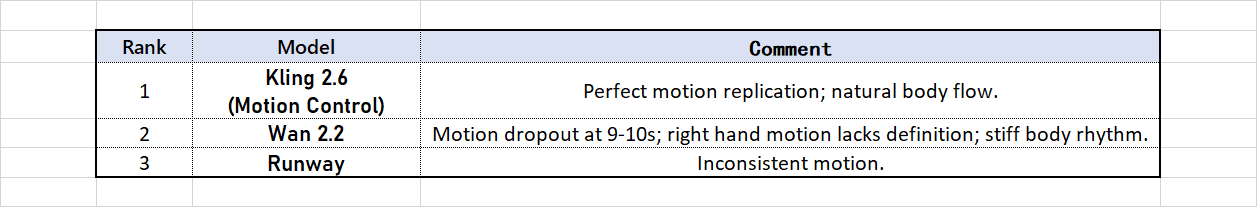

Mira la comparación lado a lado a continuación, y la respuesta será obvia 👇:

[Desglose del Análisis] Esta rutina de baile inspirada en el boxeo presenta una gran prueba de esfuerzo: el rápido movimiento de brazos combinado con el ritmo del torso.

El Control de Movimiento de Kling 2.6 ofrece una actuación magistral. Observa el movimiento de rotación de manos en el minuto 0:09: Kling no solo replica la trayectoria perfectamente; realmente captura la energía cinética; puedes sentir el impulso desde los músculos del hombro. Maximiza la fidelidad rítmica manteniendo una absoluta integridad estructural, con cero deformaciones o colapsos.

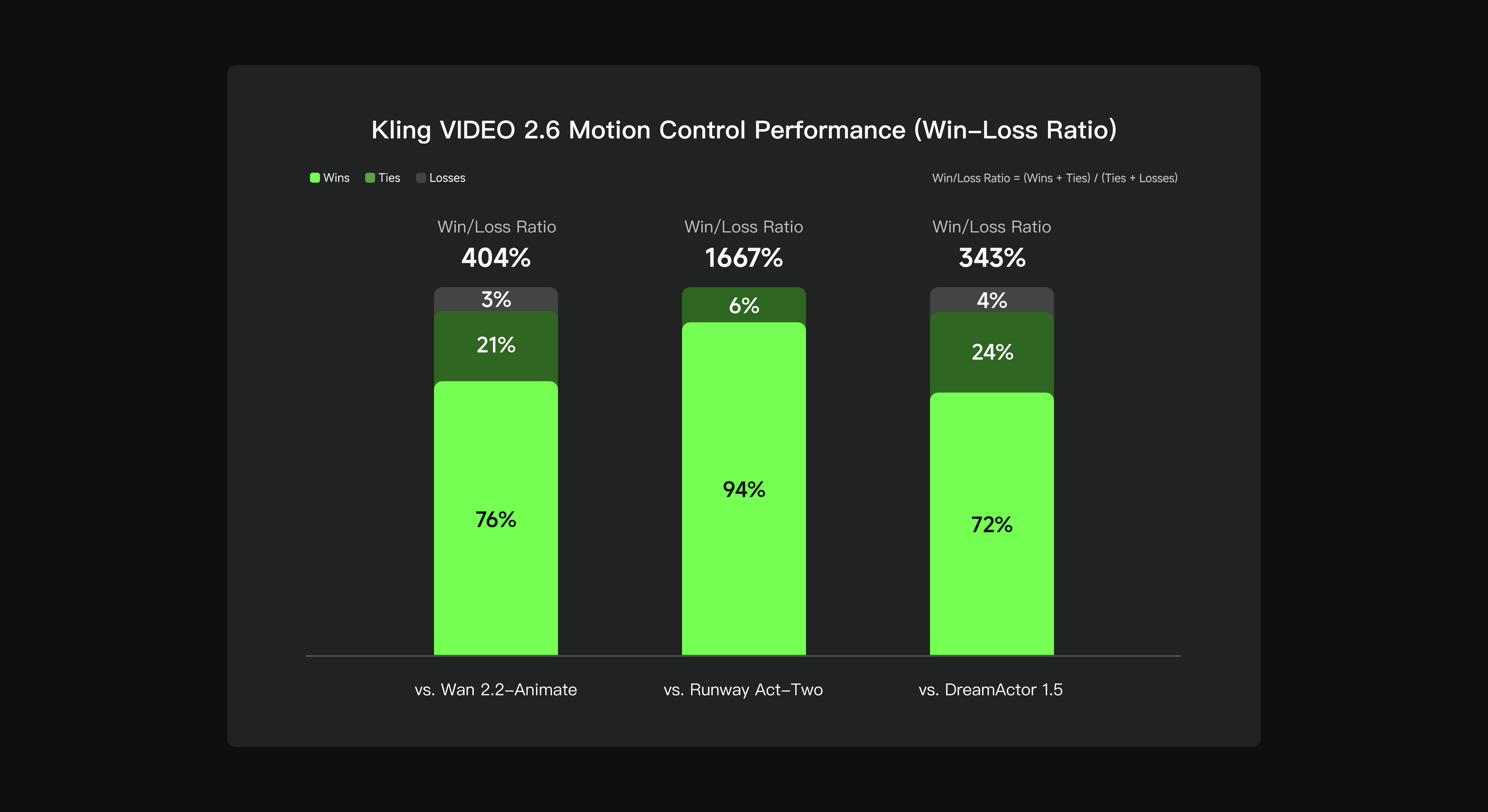

Ahora, si piensas que ese clip de Kobe fue solo una casualidad —o que simplemente tuvimos suerte y 'seleccionamos a dedo' una semilla perfecta— echa un vistazo a este gráfico oficial de prueba ciega. Los datos hablan por sí solos.

La lógica es simple: Verde significa que Kling gana, Verde Oscuro es un empate, ¿y esa pequeña franja Gris en la parte superior? Ese es el único lugar donde perdió.

Mira el lado izquierdo contra Wan 2.2. Wan es un competidor difícil, por lo que ves más Verde Oscuro (aproximadamente 21% de empates). Pero incluso así, Kling domina con una masiva tasa de victoria del 76%.

¿En cuanto a Runway en el centro? La tasa de victoria de Kling se dispara al 94%. Es una victoria aplastante. Esto coincide exactamente con lo que sentimos durante nuestras pruebas: cuando se trata de rango de movimiento y precisión, Runway se ha quedado atrás.

02 Análisis profundo: Resolviendo 5 cuellos de botella principales

Anteriormente, el control de vídeo por IA dependía en gran medida de los Motion Brushes y Prompts. Esto requería el enmascaramiento manual y el dibujo de flechas direccionales, un proceso tedioso limitado a efectos básicos de paneo o sacudida. Posteriormente aparecieron los métodos de "Referencia de vídeo", pero a menudo fallaban al equilibrar la adherencia al prompt con la replicación precisa del movimiento.

Kling 2.6 supera este obstáculo a través de un mapeo semántico profundo en un contexto de Vídeo a Vídeo. El concepto es elegante: proporcionas la imagen estática (la Identidad Visual) y un vídeo de referencia (el Alma del Movimiento).

Esto funciona efectivamente como un traje invisible de MoCap (Captura de Movimiento) para tu personaje. La barrera de entrada ha desaparecido: no se requiere equipo de estudio costoso; un vídeo casual grabado con un smartphone funciona perfectamente.

Movimientos, expresiones y sincronización de labios perfectamente sincronizados

Interpretación magistral de movimientos complejos

Precisión en el desempeño de las manos

Acción de plano único de 30s

Detalles de la escena bajo tu control

03 Cero barreras: Libertad de cómputo para todos

Después de ver estas mejoras masivas, podrías sentir una mezcla de entusiasmo y ansiedad: "Para lograr este nivel de control de movimiento, ¿necesito comprar una GPU de gama alta que cuesta miles de dólares? ¿Necesito programar como un desarrollador solo para configurar el entorno local?"

La respuesta es no.

Estamos en un punto de inflexión tecnológico donde las barreras para la creación están desapareciendo. Lo único que frena a los creadores son los cuellos de botella de cómputo y los procesos de instalación complicados.

Esa es exactamente la razón por la que existe Atlas Cloud.

Nosotros nos encargamos del despliegue complejo y del trabajo pesado, para que puedas centrarte puramente en la libertad creativa. Derribar esta última pared cuesta menos que una taza de café. Estamos llevando los VFX de grado Hollywood fuera de las costosas estaciones de trabajo y hacia tu vida diaria.

Las herramientas están listas. El resto depende de tu imaginación. Haz clic para lanzar Atlas Cloud y comenzar tu viaje como director. 🚀

En Atlas Cloud, puedes:

- Ver la calidad de salida vs el costo lado a lado

- Decidir qué modelo ofrece el mejor ROI para tu flujo de trabajo específico

Cómo usar modelos en Atlas Cloud

Atlas Cloud te permite usar modelos lado a lado — primero en un playground, luego a través de una única API.

Método 1: Usar directamente en el playground de Atlas Cloud

Control de Movimiento Kling 2.6

Método 2: Acceder vía API

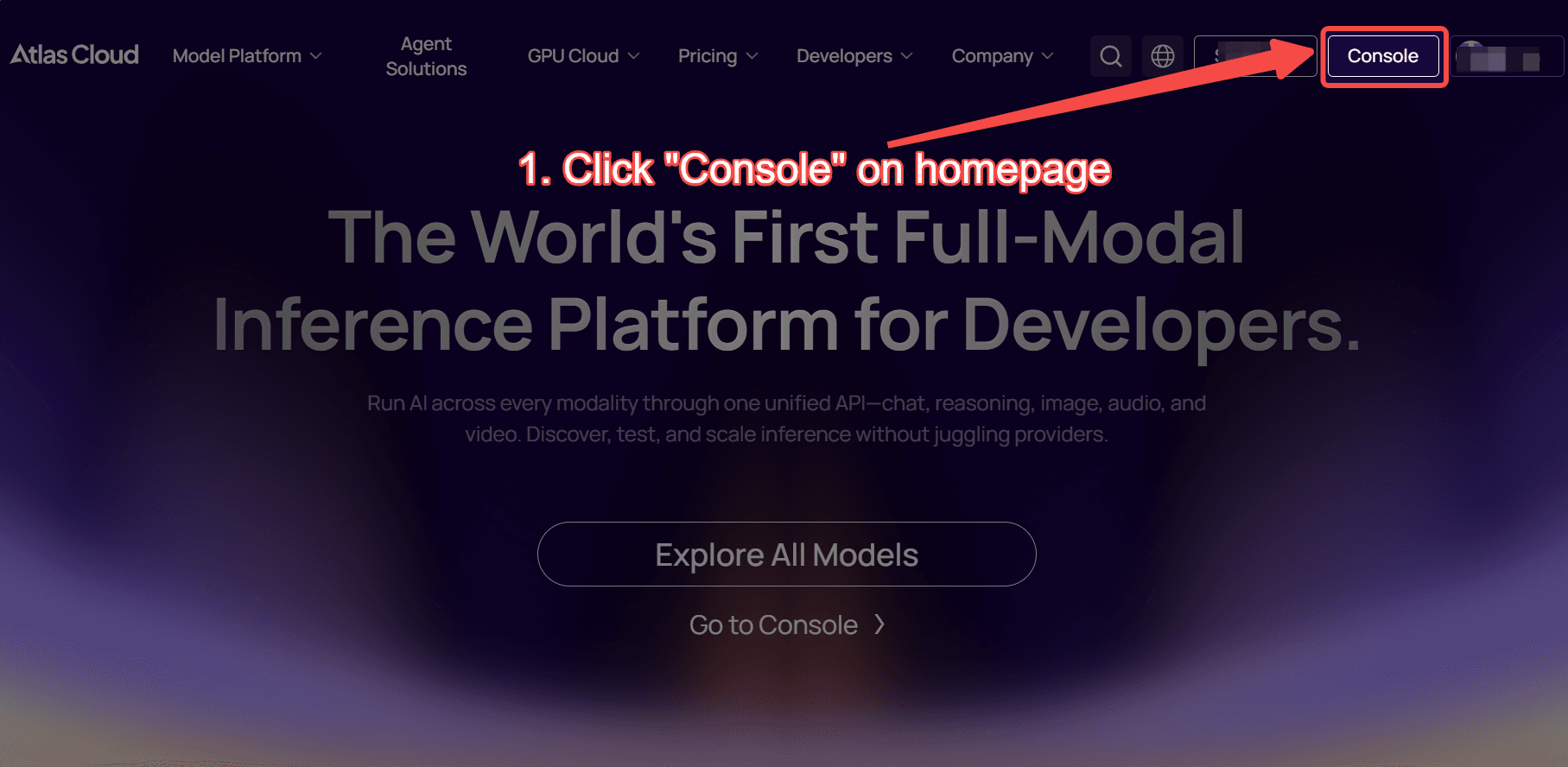

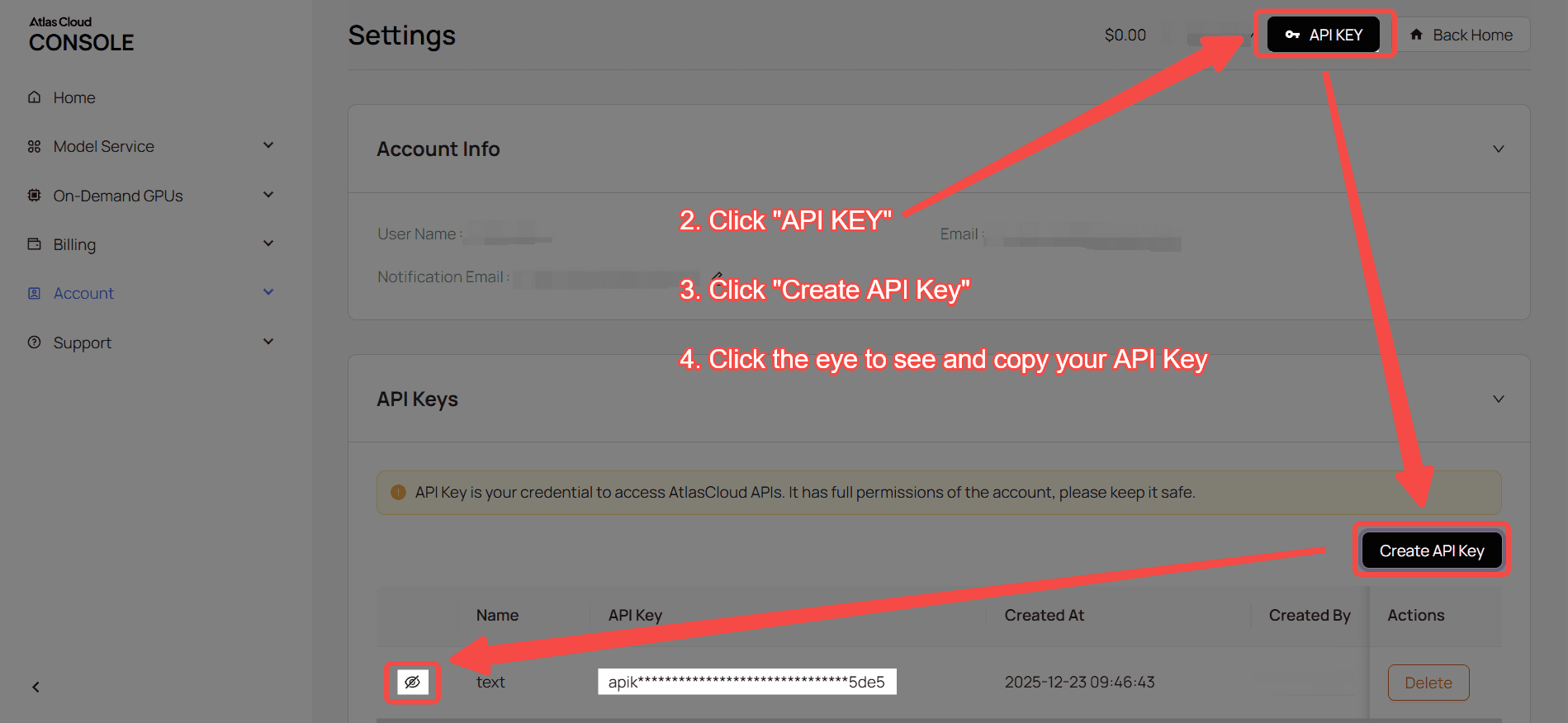

Paso 1: Obtén tu clave API

Crea una clave API en tu consola y cópiala para usarla más tarde.

Paso 2: Consulta la documentación de la API

Revisa el endpoint, los parámetros de solicitud y el método de autenticación en nuestra documentación de API.

Paso 3: Realiza tu primera solicitud (ejemplo en Python)

Ejemplo: generar un vídeo con kwaivgi/kling-v2.6-std/motion-control

plaintext1import requests 2import time 3 4# Paso 1: Iniciar la generación de vídeo 5generate_url = "https://api.atlascloud.ai/api/v1/model/generateVideo" 6headers = { 7 "Content-Type": "application/json", 8 "Authorization": "Bearer $ATLASCLOUD_API_KEY" 9} 10data = { 11 "model": "kwaivgi/kling-v2.6-std/motion-control", 12 "character_orientation": "video", 13 "image": "https://static.atlascloud.ai/media/images/dc0051d2c757c405abcc66db9e73731b.jpg", 14 "keep_original_sound": True, 15 "prompt": "Replace the characters in the video with the characters from the image, while strictly maintaining the characters' movements.", 16 "video": "https://static.atlascloud.ai/media/videos/29538d8995e0a9ba017469aab11b2172.mp4" 17} 18 19generate_response = requests.post(generate_url, headers=headers, json=data) 20generate_result = generate_response.json() 21prediction_id = generate_result["data"]["id"] 22 23# Paso 2: Polling para obtener el resultado 24poll_url = f"https://api.atlascloud.ai/api/v1/model/prediction/{prediction_id}" 25 26def check_status(): 27 while True: 28 response = requests.get(poll_url, headers={"Authorization": "Bearer $ATLASCLOUD_API_KEY"}) 29 result = response.json() 30 31 if result["data"]["status"] in ["completed", "succeeded"]: 32 print("Generated video:", result["data"]["outputs"][0]) 33 return result["data"]["outputs"][0] 34 elif result["data"]["status"] == "failed": 35 raise Exception(result["data"]["error"] or "Generation failed") 36 else: 37 # Aún procesando, esperar 2 segundos 38 time.sleep(2) 39 40video_url = check_status()