Atlas Cloud está integrando el muy esperado GLM-5, expandiendo aún más el potente panorama de la IA generativa.

- Posicionamiento del modelo: Creado por ZHIPU AI(Z.ai), este nuevo modelo insignia representa un salto cualitativo sobre la sólida base de la serie GLM-4. Con una arquitectura MoE masiva de 744 mil millones de parámetros y la innovadora tecnología de post-entrenamiento "Slime", GLM-5 lleva el razonamiento complejo, la programación y las capacidades de agentes a nuevas alturas.

- Características principales: Diseñado específicamente para tareas de alta dificultad, GLM-5 está concebido para navegar sin esfuerzo por la ingeniería de sistemas complejos, flujos de trabajo de agentes autónomos de largo horizonte y la resolución de problemas lógicos profundos.

- Precio: $0.95 por 3.15M de tokens (Entrada/Salida)

Tecnología Principal: Lógica más rigurosa y programación más inteligente con Slime y Arquitectura MoE

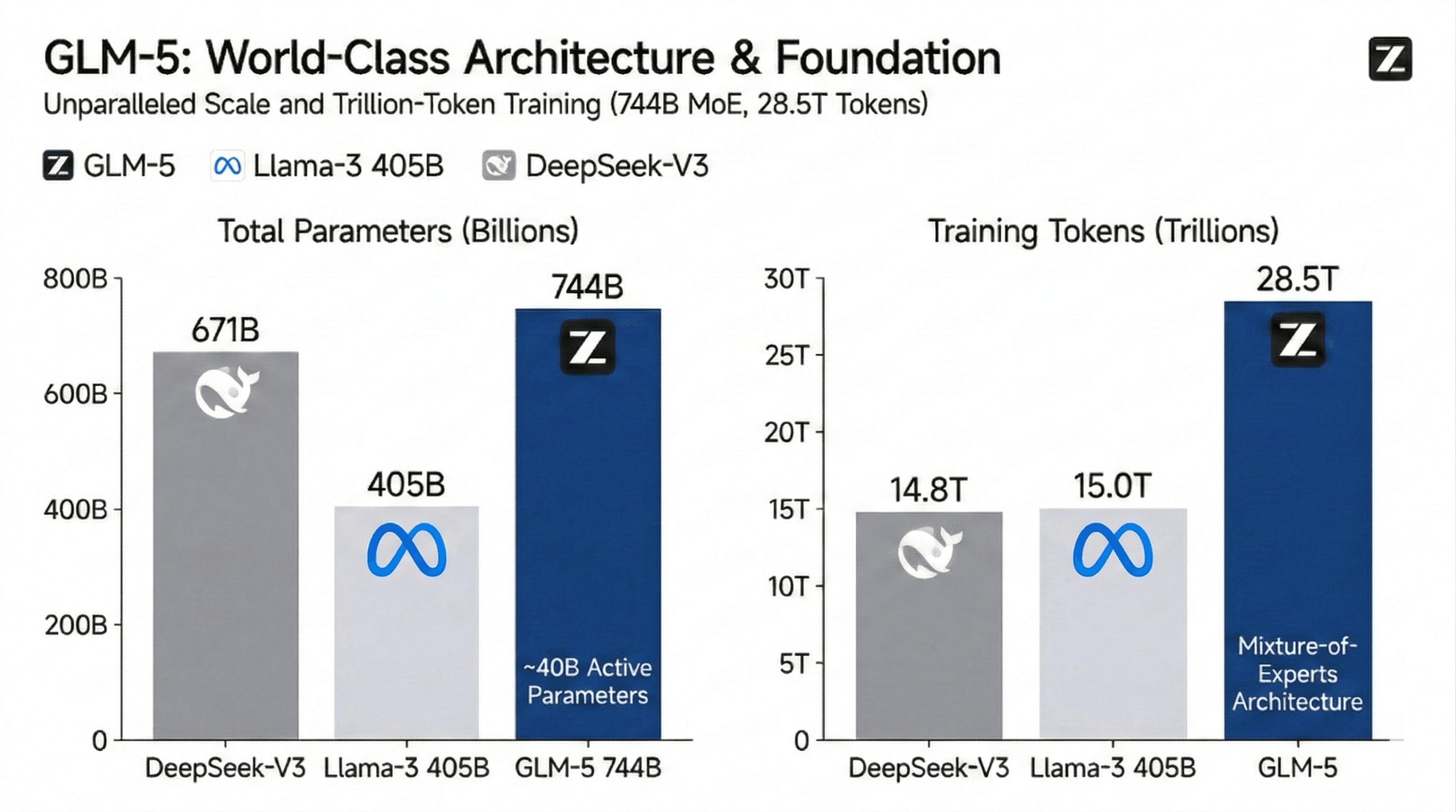

Arquitectura MoE de 744B de parámetros y base de datos masiva

GLM-5 logra un salto de magnitud en la escala del modelo y la amplitud de los datos, estableciéndose como el nuevo "punto de referencia para pesos abiertos".

- Escala ultra grande: El modelo se expande a 744 mil millones de parámetros (aprox. 40B parámetros activos) utilizando una arquitectura de Mezcla de Expertos (MoE). Comparado con Llama-3 405B o DeepSeek-V3, GLM-5 mantiene una ventaja significativa en capacidad, albergando un repositorio más vasto de conocimiento mundial.

- Entrenamiento con billones de tokens: Pre-entrenado con la asombrosa cifra de 28.5 billones de tokens.

- Ventaja de implementación: Acceda directamente a través de la API compatible con OpenAI de Atlas Cloud para disfrutar de velocidades de inferencia de nivel empresarial sin las complicaciones de la infraestructura.

Capacidades disruptivas de ingeniería de sistemas de "agentes"

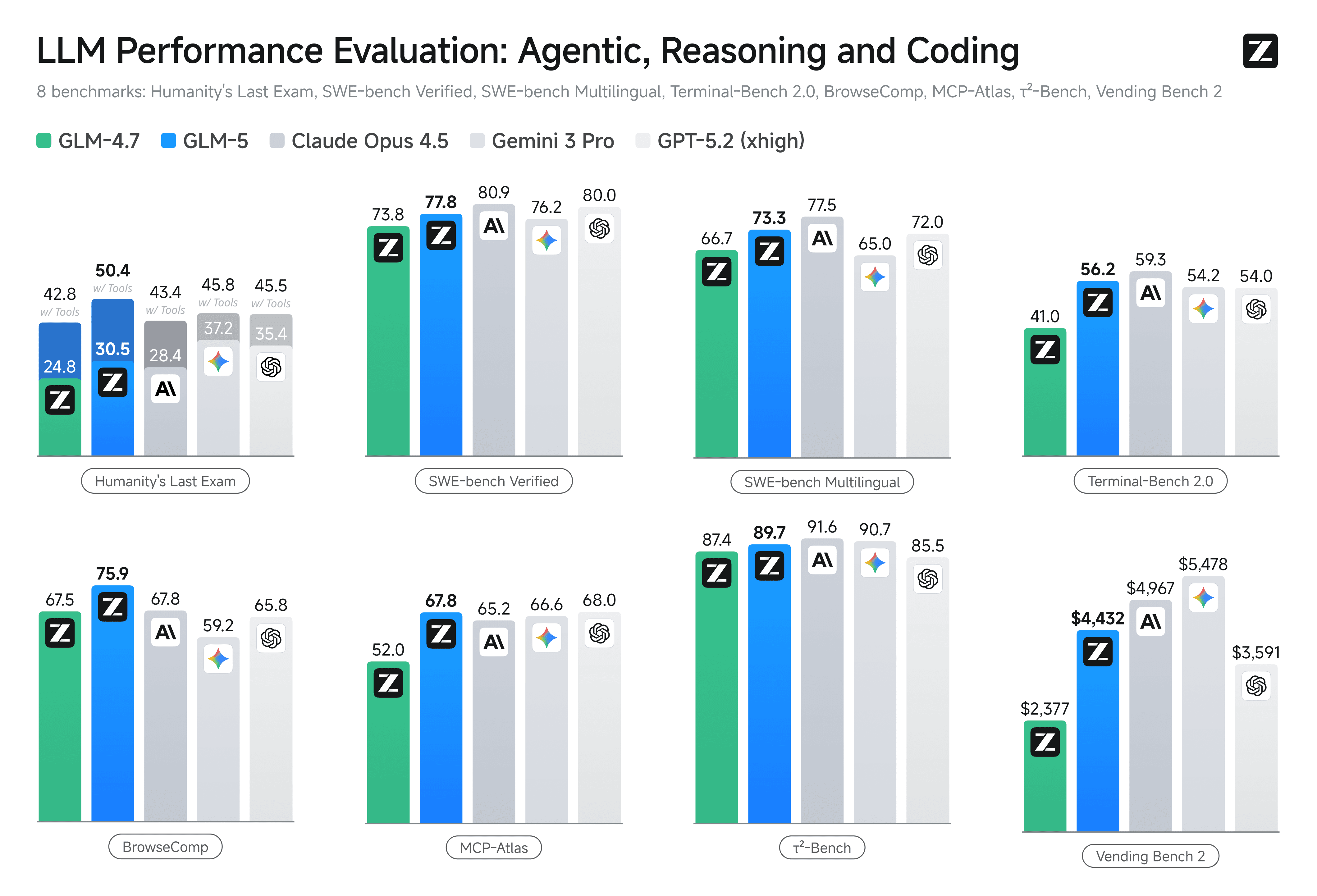

GLM-5 está diseñado para tareas sistémicas complejas de largo horizonte.

- Planificación de largo horizonte: Para tareas que requieren docenas de pasos de razonamiento (por ejemplo, desarrollo de software automatizado, redacción de documentos legales), GLM-5 demuestra una estabilidad excepcional.

- Comparación de rendimiento: En evaluaciones oficiales, sus capacidades de agentes han reducido significativamente la brecha con modelos propietarios de primer nivel como Claude Opus 4.5, Gemini 3 Pro y GPT-5.2 (xhigh). Supera a los modelos de código abierto SOTA actuales en pruebas de referencia como Vending Bench.

- Casos de uso de la API: Para los desarrolladores que crean agentes de IA autónomos, la API de alta concurrencia de Atlas Cloud permite replicar una experiencia de programación automatizada similar a Devin a un costo menor, sin gestionar backends de modelos complejos.

RL asíncrono "Slime" y el salto en la lógica de programación

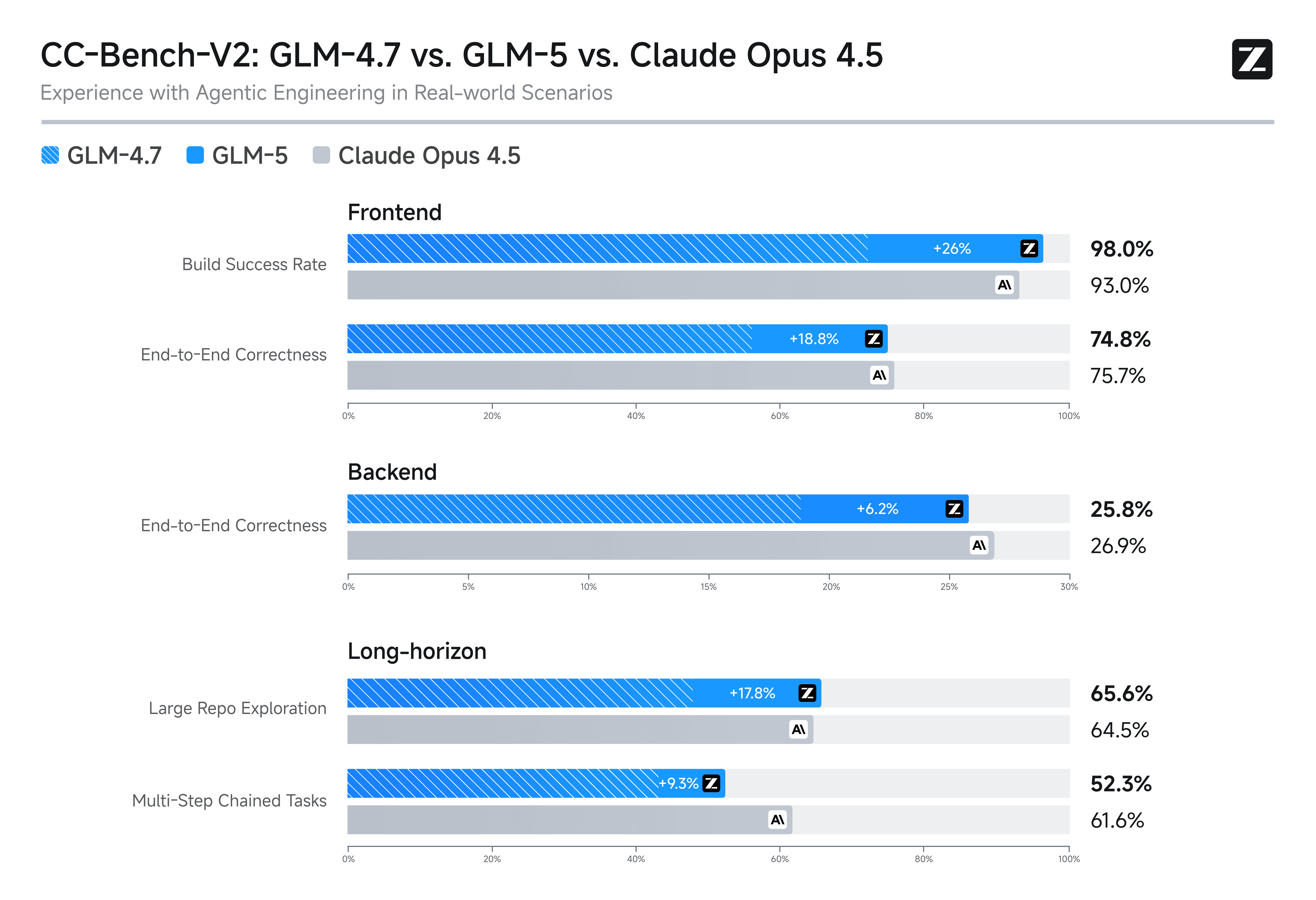

Zhipu AI presenta una novedosa tecnología de post-entrenamiento en GLM-5, impulsando significativamente el rigor lógico y la calidad de la generación de código.

- Innovación técnica: Introduce "Slime," una infraestructura de aprendizaje por refuerzo (RL) asíncrona que soluciona la ineficiencia del post-entrenamiento de modelos a gran escala.

- Salto en capacidades: En pruebas de referencia internas y académicas, GLM-5 supera drásticamente a su predecesor, GLM-4.7, en desarrollo frontend/backend y planificación a largo plazo, ocupando el primer lugar entre los modelos de código abierto.

- Facilidad de integración: Su programación y lógica de alta precisión lo convierten en un backend ideal para asistentes de código. A través de Atlas Cloud, los usuarios pueden alternar sin problemas entre GLM-5 y otros modelos de visión/lenguaje (como Qwen、MiniMax) para evaluar el rendimiento y verificar la superioridad de GLM-5 en lógica empresarial específica.

Aplicaciones en el mundo real: Automatización de la refactorización de código heredado y análisis de investigación de nivel experto

Ingeniería de software compleja y refactorización automatizada de "código heredado"

Los desarrolladores sénior a menudo sufren al heredar "código espagueti" (falta de documentación, lógica caótica). Los modelos estándar, limitados por ventanas de contexto o profundidad de razonamiento, a menudo no logran comprender las dependencias de todo el repositorio, generando código que no compila o introduce nuevos errores.

- Comprensión y reparación a nivel de repositorio: Gracias a la arquitectura 744B y las capacidades de contexto largo, GLM-5 actúa como un "Arquitecto de IA". Los usuarios pueden cargar un repositorio de proyecto completo; el modelo analiza el acoplamiento entre módulos y planifica y ejecuta automáticamente la refactorización entre archivos (por ejemplo, dividiendo un monolito en microservicios).

- Integración perfecta en el IDE: Utilice la API de Atlas Cloud para integrar el razonamiento de GLM-5 en flujos de trabajo locales con un costo de migración mínimo, pasando de la "asistencia de programación con IA" a la "corrección autónoma de errores".

- Generación de pruebas de extremo a extremo: Para sistemas heredados que carecen de casos de prueba, GLM-5 puede realizar ingeniería inversa de reglas de negocio a partir de la lógica para escribir pruebas unitarias de alta cobertura, reduciendo drásticamente los riesgos de mantenimiento.

Análisis de investigación profundo y síntesis de informes multilingües

Los analistas e investigadores se enfrentan a una sobrecarga de información. Los LLM tradicionales a menudo tienen dificultades con el razonamiento profundo, la verificación de la autenticidad de los datos y la evitación de alucinaciones en documentos largos multilingües.

- Razonamiento profundo sobre conocimiento masivo: Con 28.5 billones de tokens de entrenamiento, GLM-5 posee reservas de datos casi omniscientes. En análisis complejos de la industria, va más allá del resumen para identificar lagunas lógicas en los informes y combinar datos históricos para deducir tendencias del mercado, ofreciendo "intuición de experto" en lugar de un simple apilamiento de texto.

- Alta concurrencia y baja latencia: Para las instituciones que monitorean el sentimiento global en tiempo real, implementar modelos súper grandes resulta prohibitivo en términos de costo. A través de la API de alta disponibilidad de Atlas Cloud, los usuarios pueden procesar cientos de documentos multilingües simultáneamente utilizando cómputo en la nube elástico, eliminando la necesidad de costosos clústeres de GPU.

- Limpieza de datos estructurados: La superior capacidad de seguimiento de instrucciones de GLM-5 le permite extraer datos con precisión (por ejemplo, ingresos, tasas de crecimiento) de noticias no estructuradas o PDF y generar documentos con formato en PDF, Word o Excel.

- ↓ Documento (.docx) generado por GLM-5

Atlas Cloud: La mejor manera de dominar GLM-5

Diga adiós a la tediosa gestión de claves API y al cambio de plataformas. En Atlas Cloud, usted puede:

- Pruebas concurrentes con un solo clic: Cambie instantáneamente entre GLM-5、DeepSeek、MiniMax y otros modelos convencionales para responder al mismo Prompt simultáneamente.

- Máxima rentabilidad: Obtenga el resultado perfecto para sus necesidades con el presupuesto de tokens más bajo.

Cómo usar GLM-5 en Atlas Cloud

Atlas Cloud le permite usar modelos en paralelo, primero en un playground y luego a través de una única API.

Método 1: Usar directamente en el playground de Atlas Cloud

Método 2: Acceder a través de la API

Paso 1: Obtenga su clave API

Cree una clave API en su consola y cópiela para su uso posterior.

Step 2: Check the API documentation

Revise el endpoint, los parámetros de solicitud y el método de autenticación en nuestra documentación de la API.

Paso 3: Realice su primera solicitud (ejemplo en Python)

Un ejemplo de GLM-5:

plaintext1import requests 2 3url = "https://api.atlascloud.ai/v1/chat/completions" 4headers = { 5 "Content-Type": "application/json", 6 "Authorization": "Bearer $ATLASCLOUD_API_KEY" 7} 8data = { 9 "model": "zai-org/glm-5", 10 "messages": [ 11 { 12 "role": "user", 13 "content": "what is difference between http and https" 14 } 15 ], 16 "max_tokens": 1024, 17 "temperature": 0.7, 18 "stream": True 19} 20 21response = requests.post(url, headers=headers, json=data) 22print(response.json())