Wan 2.6 vs Sora 2: 2025년 비디오 AI 대결

소개

2025년 말 AI 비디오 분야는 두 가지 플래그십 모델이 주도하고 있습니다:

둘 다 멋진 비디오를 생성하지만, 매우 다른 목표에 최적화되어 있습니다. 만약 당신이 묻고 있다면:

- "Wan 2.6 vs Sora 2 — 광고에 어떤 것을 사용해야 할까요?"

- "긴 시네마틱 월드를 만드는 데 어떤 모델이 더 나을까요?"

- "하나의 장소에서 둘 다 테스트하고 제품에 통합하는 방법은 무엇인가요?"

이 가이드는 실용적이고 생산 지향적인 비교를 제공하며, Atlas Cloud를 통해 놀이터에서 두 모델을 모두 시도하고 단일 API를 통해 통합하는 방법을 보여줍니다.

TL;DR 빠른 비교 (사양 및 가격 프로필)

Wan 2.6 vs Sora 2 한눈에 보기

| Wan 2.6 | Sora 2 | |

|---|---|---|

| 가격 | Atlas Cloud에서 초당 $0.08 | Atlas Cloud에서 초당 $0.05 |

| 핵심 초점 | 캐릭터 제어 및 스토리 생성 | 월드 시뮬레이션 및 상업/시네마틱 비디오 |

| 일반적인 지속 시간 | 5초; 10초; 15초 | 10초; 15초 |

| 입력 유형 | 텍스트-비디오; 이미지-비디오; 비디오 참조 | 텍스트-비디오; 이미지-비디오 |

| 크기 | 텍스트-비디오 및 비디오 참조: 720*1280; 1280*720; 960*960; 1088*832; 832*1088; 1920*1080; 1080*1920; 1440*1440; 1632*1248; 1248*1632; 이미지-비디오: 참조 이미지 크기에 따름. | 720*1280; 1280*720 |

| 해상도 | 720P, 1080P | —— |

| 강점 | 다중 샷 내러티브, 얼굴 안정성, 시네마틱 카메라 경로 | 심층 물리학, 복잡한 환경 |

| 오디오 | 내러티브 및 대화 | 몰입형 배경 사운드스케이프 |

| 최적 | 캐릭터 애니메이션, 소셜 미디어 콘텐츠, 빠른 아이디어 구상 | 광고, 이커머스, 영화 제작, 전문 제작 |

| 의미론적 외삽 | 시네마틱 장면에 탁월 | 상업 광고에 탁월 |

| 샷 구성 | 지능형 프롬프트 실행 | 프롬프트 준수 |

| 일관성 | 캐릭터 일관성 | 환경 일관성 |

Atlas Cloud에서는 다음을 수행할 수 있습니다.

- 동일한 프롬프트를 Wan 2.6과 Sora 2로 실행

- 출력 품질 대비 비용을 나란히 확인

- 특정 워크플로우에 가장 적합한 ROI를 제공하는 모델 결정

모델 개요

Wan 2.6 요약

Alibaba Cloud의 Wan 2.6은 획기적인 멀티모달 기능과 네이티브 오디오 동기화를 제공합니다. 이 최신 Wan 2.6 업데이트는 고급 텍스트-비디오 및 이미지-비디오 도구로 크리에이터에게 힘을 실어주며, 최대 15초 길이의 1080p 시네마틱 콘텐츠를 제작합니다.

주요 아이디어:

- 스마트 세분화 (멀티샷 내러티브)

샷 경계를 이해하고 클로즈업, 미디엄 샷, 와이드 샷 전체에서 동일한 캐릭터 정체성을 유지합니다. 영웅이 모델에서 벗어나지 않아야 하는 광고 및 스토리보드에 적합합니다.

- 15초 고품질 클립

일반적인 비디오 길이를 약 15초로 확장합니다. 단일 생성으로 전체 내러티브 비트( 설정 → 액션 → 반응 )를 담기에 충분하며, 이는 6~15초 광고 슬롯 및 소셜 후크에 완벽하게 매핑됩니다.

- 고품질 오디오 및 안정적인 다중 화자 대화

네이티브 오디오 생성에서 큰 도약을 이루었습니다. Wan 2.6은 극도로 사실적인 보컬 음색을 제공하며 안정적인 다중 화자 대화를 지원합니다. AI 오디오에서 흔히 발견되는 로봇적인 톤을 제거하고, 여러 캐릭터 간에 동기화되고 자연스러운 대화를 생성합니다.

- 고급 비디오 참조 (참조 가이드 연기)

리허설 비디오(휴대폰 녹화)를 업로드하면 Wan 2.6이 생성된 캐릭터에 타이밍, 블로킹, 신체 언어를 복제합니다. 이를 통해 감독은 재촬영 없이 배우 수준의 제어를 얻을 수 있습니다.

전반적으로 Wan 2.6은 지능적인 멀티샷 비주얼과 고품질 대화를 결합하여 완전한 15초 분량의 시네마틱 스토리라인을 제공하는 감독을 위한 포괄적인 내러티브 엔진처럼 느껴집니다.

Sora 2 요약

Sora 2는 물리적 정확성, 사실성 및 제어 가능성에서 이전 시스템을 훨씬 능가하는 고급 비디오 생성 모델로, 월드 시뮬레이션을 위한 강력한 엔진 역할을 합니다.

주요 아이디어

- 비교할 수 없는 사실성과 물리 시뮬레이션

Sora 2는 고급 월드 시뮬레이션 기능을 특징으로 하며, 생성된 장면이 물리 법칙을 더 엄격하게 따르도록 합니다. 극사실적이고 시네마틱한 영상부터 독특한 애니메이션 스타일까지 다양한 미학 전반에 걸쳐 고품질 비주얼을 제공하는 데 탁월합니다.

- 뛰어난 제어 가능성 및 일관성

시스템은 전례 없는 제어를 제공하며, 여러 샷에 걸친 복잡한 지침을 따를 수 있습니다. 중요한 것은 "월드 상태"(지속성)를 정확하게 유지하여 복잡한 시퀀스 전체에서 객체, 캐릭터 및 환경이 일관되게 유지되도록 합니다.

- 완전 동기화 오디오 통합

정지된 이미지의 한계를 넘어, Sora 2는 동기화된 대화 및 사운드 효과를 도입합니다. 완전한 몰입형 경험을 위해 화면상의 액션과 완벽하게 일치하는 높은 수준의 사실성을 가진 정교한 배경 사운드스케이프, 음성 및 SFX를 생성합니다.

- 실제 세계 통합

이 모델은 사용자가 생성된 콘텐츠에 실제 세계의 요소를 직접 주입할 수 있도록 하여 가상과 물리적 세계 사이의 간극을 메웁니다.

결론적으로, Sora 2는 물리적으로 일관되고, 다중 스타일의 비디오를, 고도로 제어 가능한 지침을 통해 완전 동기화된 오디오로 생성하도록 설계된 고품질 월드 시뮬레이터입니다.

핵심 차이점

일관성 초점: 캐릭터 vs. 월드

- Wan 2.6: 캐릭터 일관성 및 립싱크에 강점이 있습니다. 프레임 전체에서 캐릭터의 정체성을 안정적으로 유지하고 입 움직임을 음성에 완벽하게 맞추는 데 탁월합니다.

- Sora 2: 환경 일관성이 강점입니다. 안정적이고 지속적인 월드 상태를 유지하여 카메라가 움직여도 배경, 물리 및 공간 관계가 일관되게 유지되도록 합니다.

촬영 및 워크플로우

사용 사례에 따라 워크플로우 경험이 크게 다릅니다.

- 일반 장면:

- Wan 2.6 (생성): 간단한 자연어로 아름답게 작동합니다. 분위기를 설명하면 장면을 "생성"해 줍니다. 생성적 직관에 의존합니다.

- Sora 2 (제작): 더 세분화된 제어가 필요합니다. 감독처럼 구체적인 카메라 및 샷 지침(예: 패닝, 줌)을 제공해야 합니다. 기술적인 "제작" 프로세스처럼 느껴집니다.

- 광고 장면:

- Sora 2: 놀랍게도 상업적 맥락에서 Sora 2는 높은 수준의 개념 추론을 보여줍니다. 마이크로 관리가 필요 없이 광고를 위한 정교한 스토리보드와 샷을 지능적으로 생성할 수 있습니다.

오디오 역학

- Wan 2.6: 내러티브에 중점을 둡니다. 생성된 페르소나를 기반으로 캐릭터 대화를 자율적으로 디자인합니다.

- Sora 2: 몰입에 중점을 둡니다. 물리적 설정에 완벽하게 맞는 극사실적인 환경 오디오 및 배경 사운드스케이프를 생성합니다.

결론: 생성 vs. 제작

궁극적으로 선택은 두 가지 뚜렷한 철학으로 귀결됩니다:

- Wan 2.6은 캐릭터 "생성"을 위한 것: 배우와 그들의 연기를 우선시하는 직관적인 창의적 파트너처럼 느껴집니다.

- Sora 2는 월드 "제작"을 위한 것: 물리적 환경과 정밀한 시네마틱 제어를 우선시하는 고품질 시뮬레이터처럼 작동합니다.

사용 사례: Wan 2.6 또는 Sora 2 선택 시점/대상

(동일한 프롬프트, 다른 결과)

두 모델에 동일한 크리에이티브 브리프를 실행하고 결과를 비교하는 것을 상상하면 결정하는 데 도움이 됩니다.

예시 1: 시네마틱 판타지 장면

plaintext1프롬프트: 2시네마틱 SF 예고편. 샷 1: 황량한 붉은 화성 사막을 가로질러 걷는 낡은 우주복을 입은 외로운 탐험가의 와이드 샷, 멀리 거대한 버려진 우주선이 보임. 샷 2: 탐험가가 멈춰서 헬멧 바이저의 먼지를 닦고 충격에 눈을 크게 뜨는 클로즈업. 샷 3: 오버숄더 샷, 앞에서 빠르게 피어나는 빛나는 생체 발광 푸른 꽃을 보여줌. 8k 해상도, 매우 상세함, 일관된 캐릭터.

결과:

- Wan 2.6 결과 (결과 비디오를 보려면 여기를 클릭하세요)

- 각도 전반에 걸쳐 일관된 배우

- 좋은 지침 준수

- 몰입형 배경 사운드스케이프

- Sora 2 (결과 비디오를 보려면 여기를 클릭하세요)

- 좋은 지침 준수

- 몰입형 배경 사운드스케이프 및 대화

예시 2: 15초 제품 광고

plaintext1프롬프트: 영어를 사용하는 이 AI 동반 장난감을 홍보하는 유튜버. 1280*720

결과:

- Wan 2.6 (결과 비디오를 보려면 여기를 클릭하세요)

- Sora 2 (결과 비디오를 보려면 여기를 클릭하세요)

- 상업적 맥락에서의 뛰어난 의미론적 외삽 능력

- 뛰어난 제작 일관성 유지

예시 3: 애니메이션 스타일

이 경우 Wan 2.6이 대화 및 자동 장면 감지에서 어떻게 발전했고, Sora 2가 몰입형 배경 사운드스케이프에서 어떻게 발전했는지 명확하게 볼 수 있습니다.

plaintext1프롬프트: 2고품질 애니메이션 스타일. 밤에 전통적인 신사 계단에 서 있는 화려한 꽃 무늬 유카타를 입은 소녀. 그녀는 부드러운 미소를 지으며 카메라를 돌아본다. 그녀 뒤의 어두운 하늘에 거대하고 생생한 불꽃놀이가 폭발하며 그녀의 실루엣을 비춘다. 걸려 있는 종이 등불에서 부드러운 빛이 난다. 반딧불이, 마법 같은 분위기.

결과:

- Wan 2.6 (결과 비디오를 보려면 여기를 클릭하세요)

- 뛰어난 AI 스토리보딩 기능

- 부드러운 내러티브 및 자연스러운 대화

- Sora 2 (결과 비디오를 보려면 여기를 클릭하세요)

- 몰입형 배경 사운드스케이프

누가 무엇을 선택해야 할까요?

- 빠른 바이럴 콘텐츠를 쫓는 인플루언서/캐주얼 크리에이터/유연한 비디오 크기를 원하는 사람 → Wan 2.6

- 정교함과 제어가 필요한 전문 크리에이터 및 브랜드/이커머스 → Sora 2

Atlas Cloud에서 두 모델 모두 사용하는 방법

"Wan 2.6 vs Sora 2"에 갇히는 대신, Atlas Cloud를 사용하면 두 모델을 나란히 사용할 수 있습니다 - 먼저 플레이그라운드에서, 그 다음 단일 API를 통해.

방법 1: Atlas Cloud 플랫폼에서 직접 사용

방법 2: API를 통한 액세스

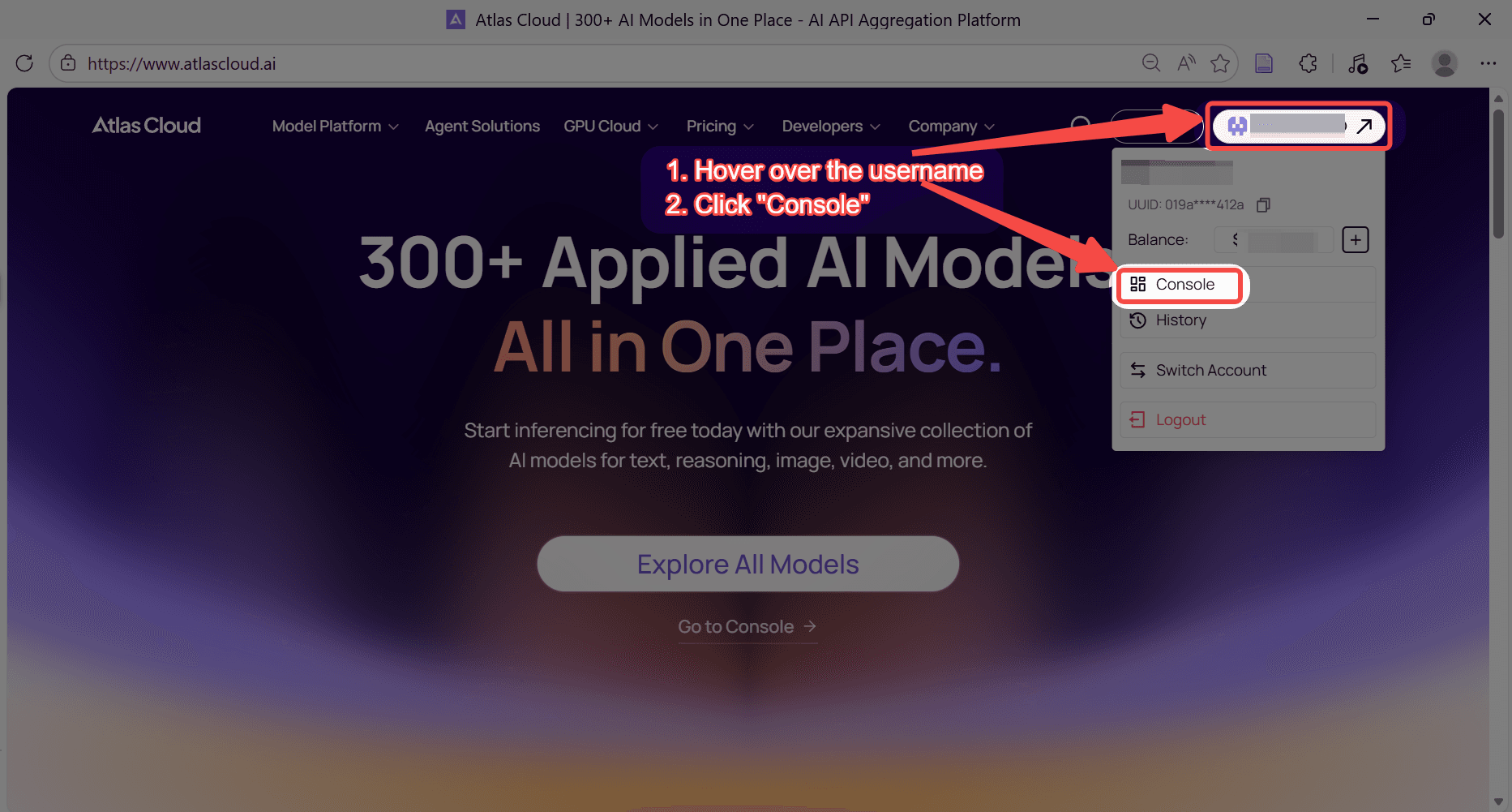

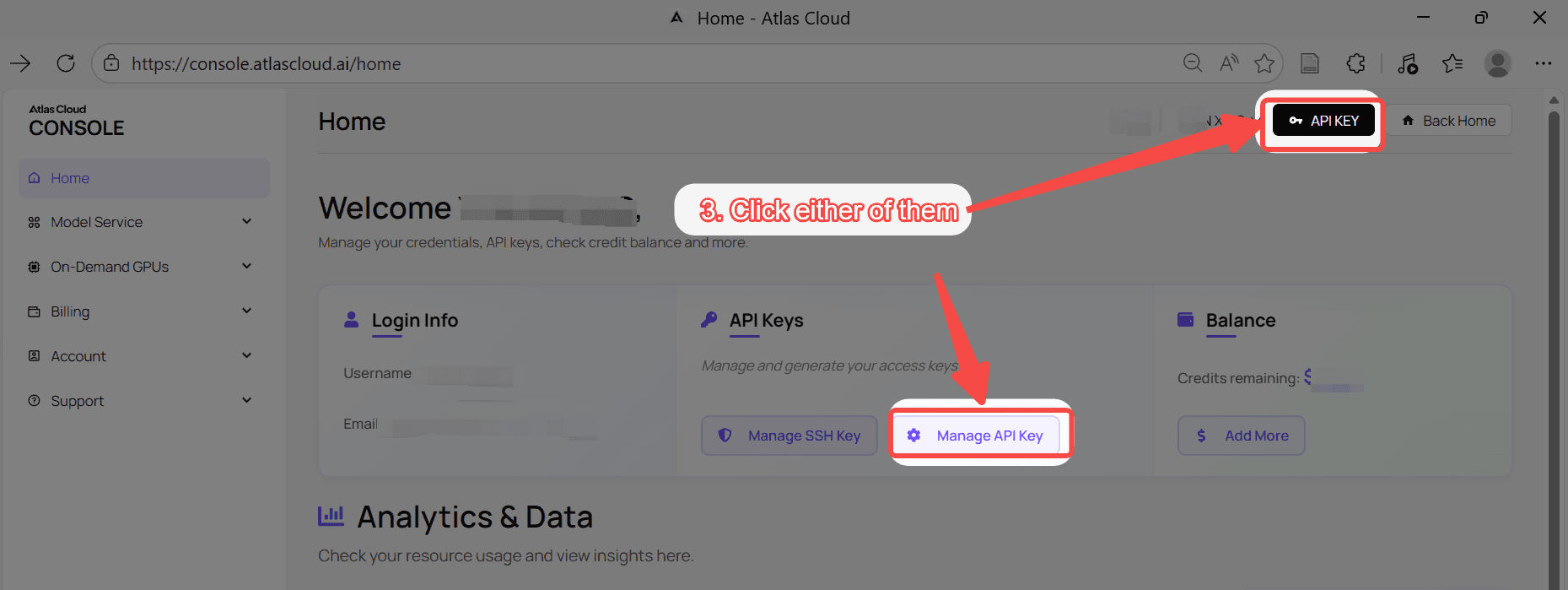

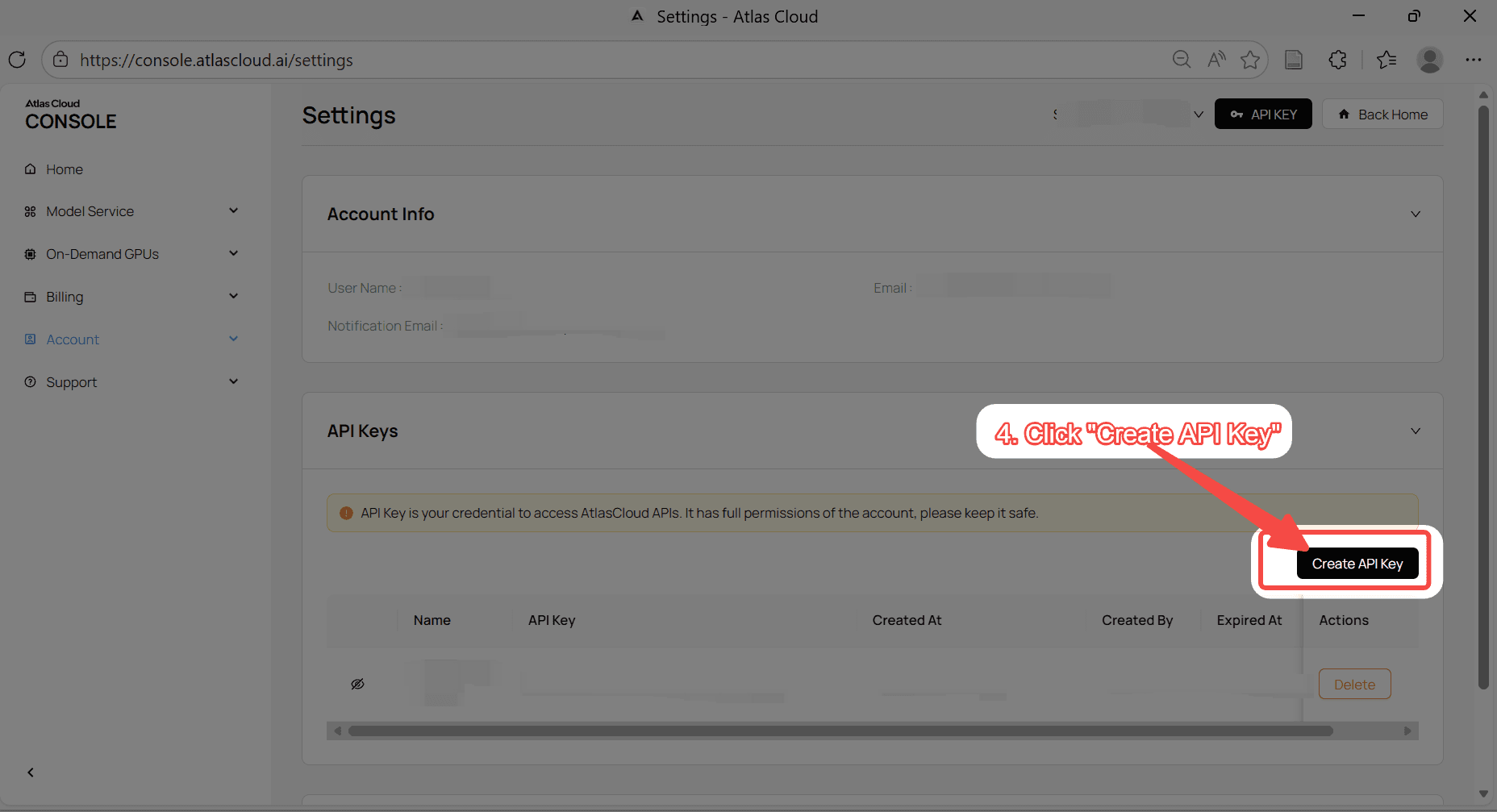

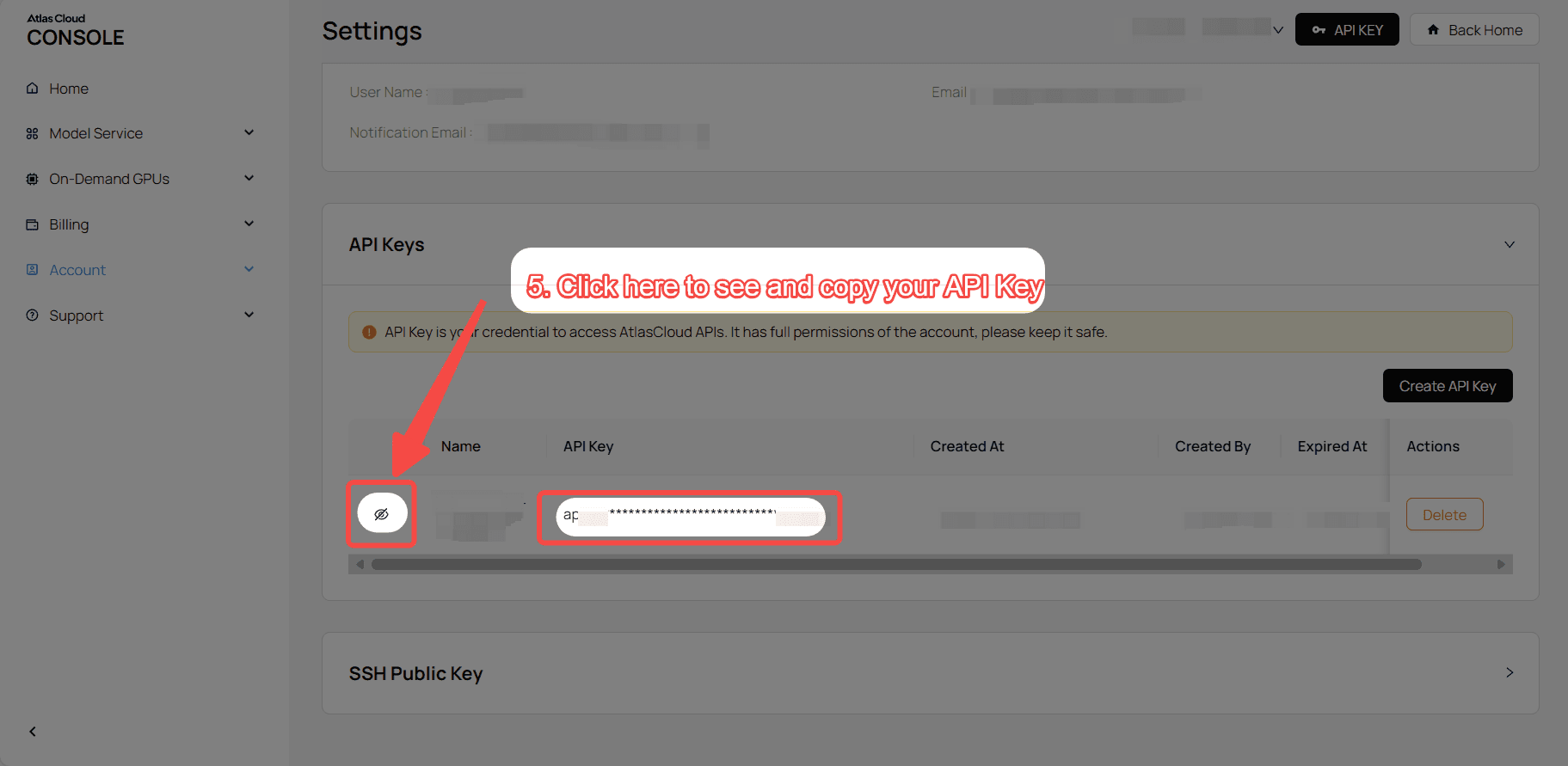

1단계: API 키 받기

콘솔에서 API 키를 생성하고 나중에 사용할 수 있도록 복사합니다.

2단계: API 문서 확인

API 문서에서 엔드포인트, 요청 매개변수 및 인증 방법을 검토합니다.

3단계: 첫 번째 요청하기 (Python 예시)

예시: Wan 2.6 (텍스트-비디오)로 비디오 생성.

python1import requests 2import time 3 4# 1단계: 비디오 생성 시작 5generate_url = "https://api.atlascloud.ai/api/v1/model/generateVideo" 6headers = { 7 "Content-Type": "application/json", 8 "Authorization": "Bearer $ATLASCLOUD_API_KEY" 9} 10data = { 11 "model": "alibaba/wan-2.6/text-to-video", 12 "audio": None, 13 "duration": 15, 14 "enable_prompt_expansion": True, 15 "negative_prompt": "example_value", 16 "prompt": "A cinematic sci-fi trailer. Shot 1: Wide shot, a lonely explorer in a battered spacesuit walking across a desolate red Martian desert, a massive derelict spaceship in the distance. Shot 2: Close-up, the explorer stops and wipes dust off their helmet visor, eyes widening in shock. Shot 3: Over-the-shoulder shot, revealing a glowing, bioluminescent blue flower blooming rapidly in front of them. 8k resolution, highly detailed, consistent character.", 17 "seed": -1, 18 "size": "1920*1080", 19 "shot_type": "multi" 20} 21 22generate_response = requests.post(generate_url, headers=headers, json=data) 23generate_result = generate_response.json() 24prediction_id = generate_result["data"]["id"] 25 26# 2단계: 결과 폴링 27poll_url = f"https://api.atlascloud.ai/api/v1/model/prediction/{prediction_id}" 28 29def check_status(): 30 while True: 31 response = requests.get(poll_url, headers={"Authorization": "Bearer $ATLASCLOUD_API_KEY"}) 32 result = response.json() 33 34 if result["data"]["status"] in ["completed", "succeeded"]: 35 print("Generated video:", result["data"]["outputs"][0]) 36 return result["data"]["outputs"][0] 37 elif result["data"]["status"] == "failed": 38 raise Exception(result["data"]["error"] or "Generation failed") 39 else: 40 # 아직 처리 중, 2초 대기 41 time.sleep(2) 42 43video_url = check_status()

FAQ

Q: Atlas Cloud는 Wan 2.6과 Sora 2 중 선택하는 데 어떻게 도움이 되나요? A: Atlas Cloud를 사용하면 정확히 동일한 프롬프트를 두 모델에서 동시에 실행할 수 있습니다. 결과 품질과 비용을 나란히 비교하여 특정 워크플로우에 가장 적합한 ROI를 제공하는 모델을 결정할 수 있습니다.

Q: 두 모델의 근본적인 차이점은 무엇인가요? A: 핵심 철학이 다릅니다: Wan 2.6은 "생성"을 위한 것으로, 캐릭터와 내러티브 연기에 중점을 둔 직관적인 창의적 파트너 역할을 합니다. Sora 2는 "제작"을 위한 것으로, 물리적 정확성, 환경 일관성 및 정밀한 시네마틱 제어에 중점을 둔 고품질 시뮬레이터 역할을 합니다.

Q: 어떤 모델이 오디오를 더 잘 처리하나요? A: 둘 다 오디오를 지원하지만 초점이 다릅니다:

- Wan 2.6: 내러티브에 중점을 둡니다. 로봇적인 톤 없이 여러 캐릭터 간의 자연스럽고 동기화된 대화에 탁월합니다.

- Sora 2: 몰입에 중점을 둡니다. 화면상의 물리적 액션과 완벽하게 일치하는 극사실적인 배경 사운드스케이프 및 사운드 효과(SFX)를 생성합니다.