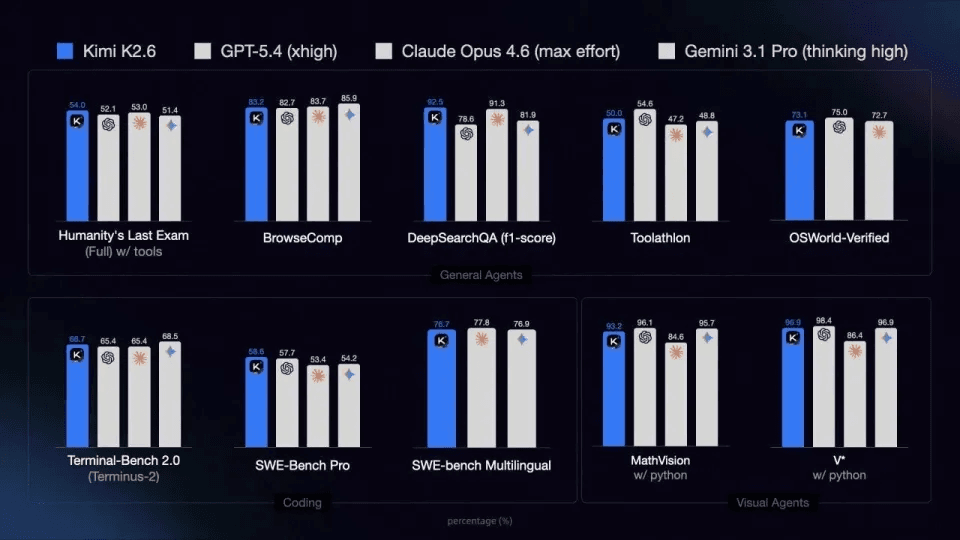

Kimi가 K2.6을 새롭게 선보였습니다. HuggingFace에 오픈 소스로 공개되었으며, GPT-5.4, Claude Opus 4.6, Gemini 3.1 Pro와 벤치마크를 진행했습니다. Humanity's Last Exam, DeepSearchQA, SWE-Bench Pro에서 세 모델을 모두 앞섰으며, 코드 작성 능력은 K2.5 대비 약 20% 향상되었고, 평균 작업 단계는 35% 감소했습니다. 특히 에이전트 워크로드의 경우 Claude Opus 4.6 대비 1/8 수준의 가격으로 이용 가능합니다.

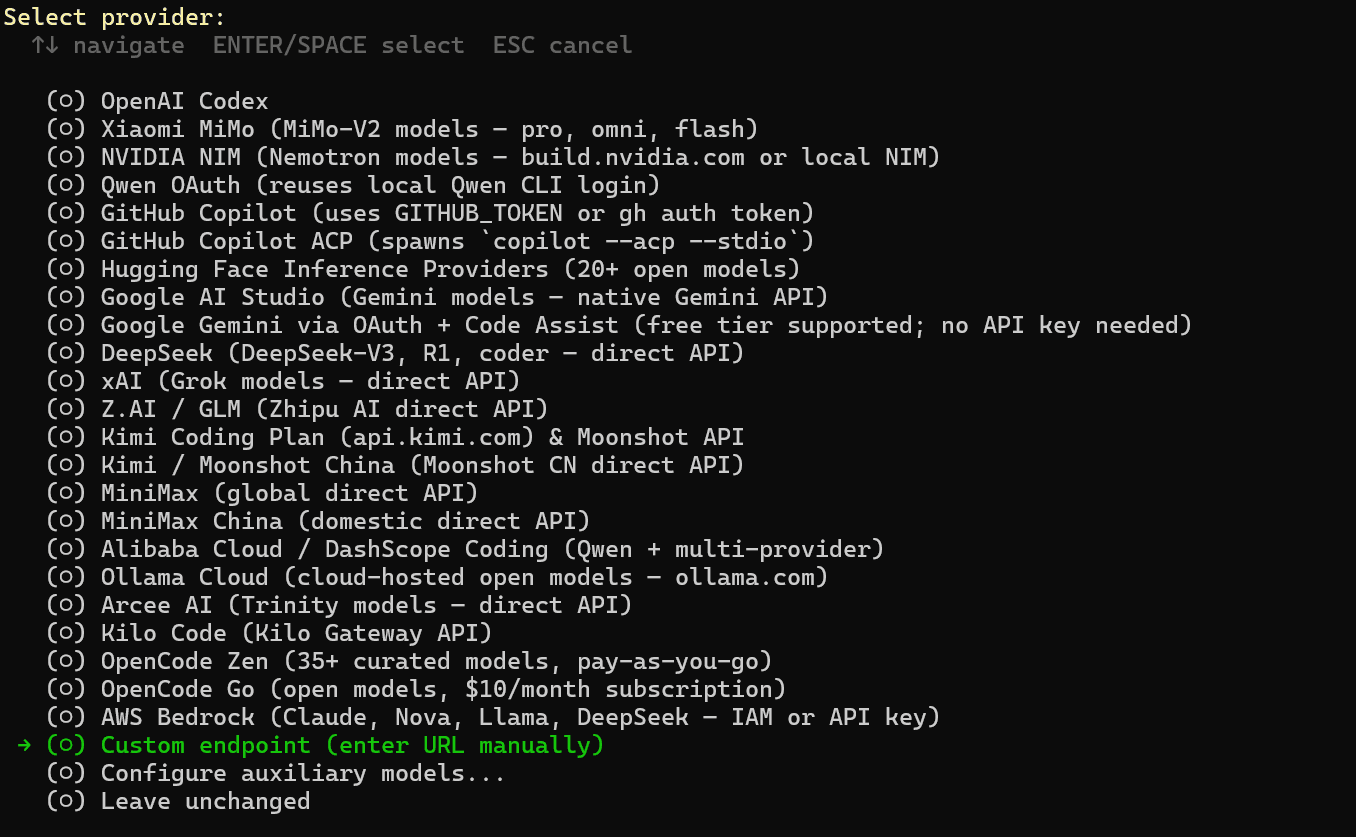

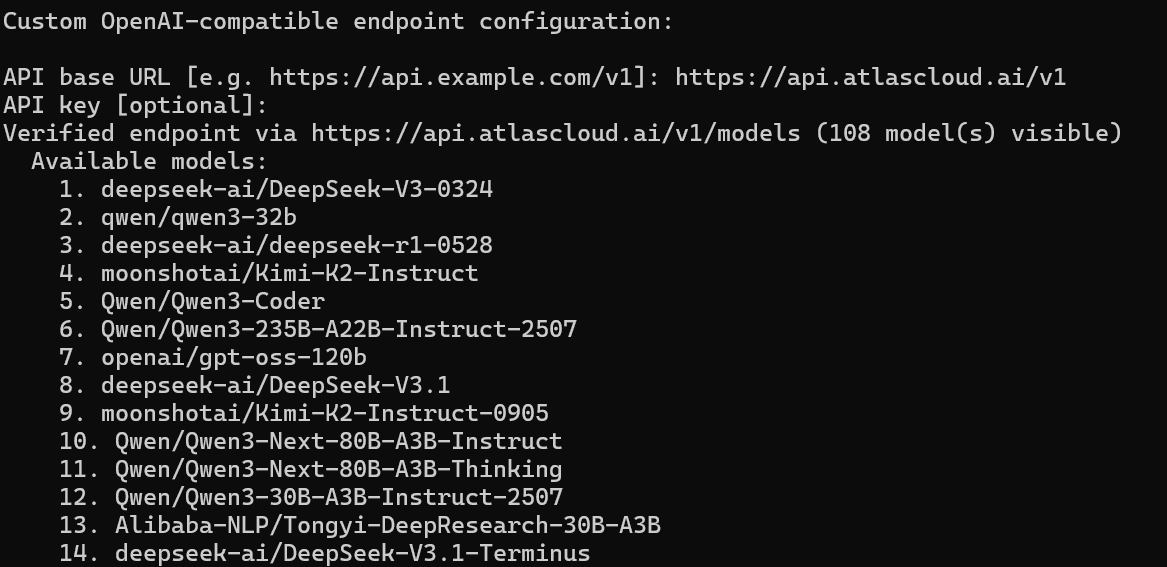

AI 에이전트를 운영 중이며 기존 툴체인에 K2.6을 연동하고 싶다면, atlascloud.ai의 공통 API 엔드포인트를 통해 주요 프레임워크 4종(Claude Code, OpenCode, OpenClaw, Hermes Agent)을 모두 지원하는 이 가이드를 확인하세요. 가이드 후반부에서는 K2.6의 실제 구동 성능을 다룹니다.

요약 가이드

| 도구 | 설정 위치 | 모델 변경 방법 | 주의사항 |

| Claude Code | env vars ANTHROPIC_* | 환경 변수 또는 /model 명령어 | 없음 |

| OpenCode | ~/.config/opencode/config.json | model 필드 수정 | @ai-sdk/openai-compatible 필수 사용 |

| OpenClaw | ~/.openclaw/openclaw.json | primary 필드 수정 | 게이트웨이 사전 실행 필요 |

| Hermes Agent | 대화형 hermes setup | setup 재실행 | 모델 ID 형식을 정확히 입력해야 함 |

본 가이드의 모든 튜토리얼은 Windows의 WSL2 환경에서 진행되었습니다.

1부 — 설정

-

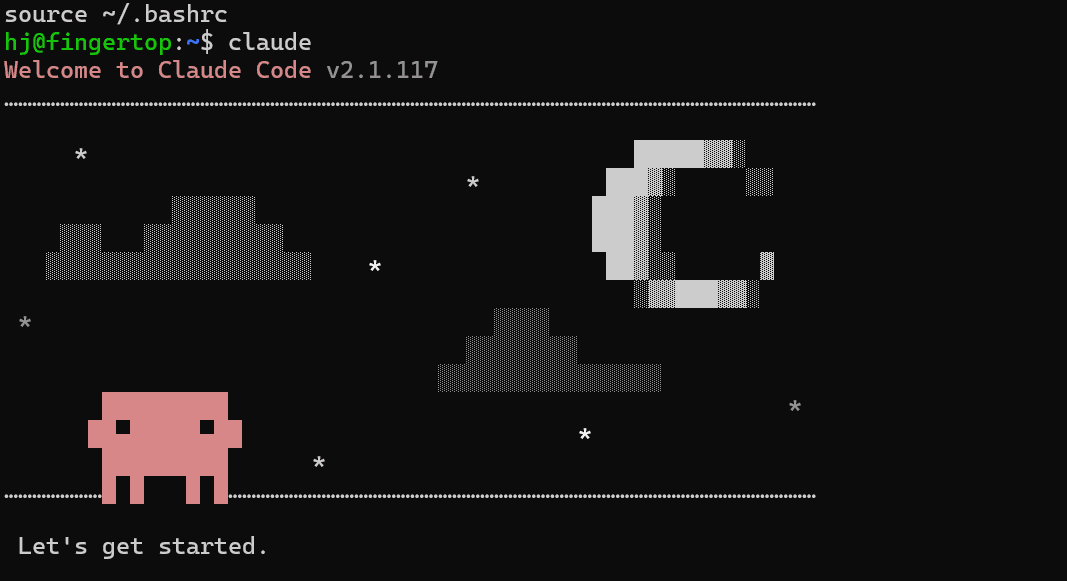

Claude Code (가장 간단)

Claude Code 다운로드 및 공식 문서: https://github.com/anthropics/claude-code

Claude Code는 Anthropic 형식을 기본 지원합니다. 다음 세 가지 환경 변수를 설정하면 즉시 완료됩니다.

plaintext1# ~/.bashrc 또는 ~/.zshrc에 추가 2export ANTHROPIC_BASE_URL="https://api.atlascloud.ai" 3export ANTHROPIC_AUTH_TOKEN="apikey-xxx" 4export ANTHROPIC_MODEL="moonshot/kimi-k2.6" 5export ANTHROPIC_SMALL_FAST_MODEL="moonshot/kimi-k2.6"

1source ~/.bashrc1/model2. OpenCode (설정 파일)

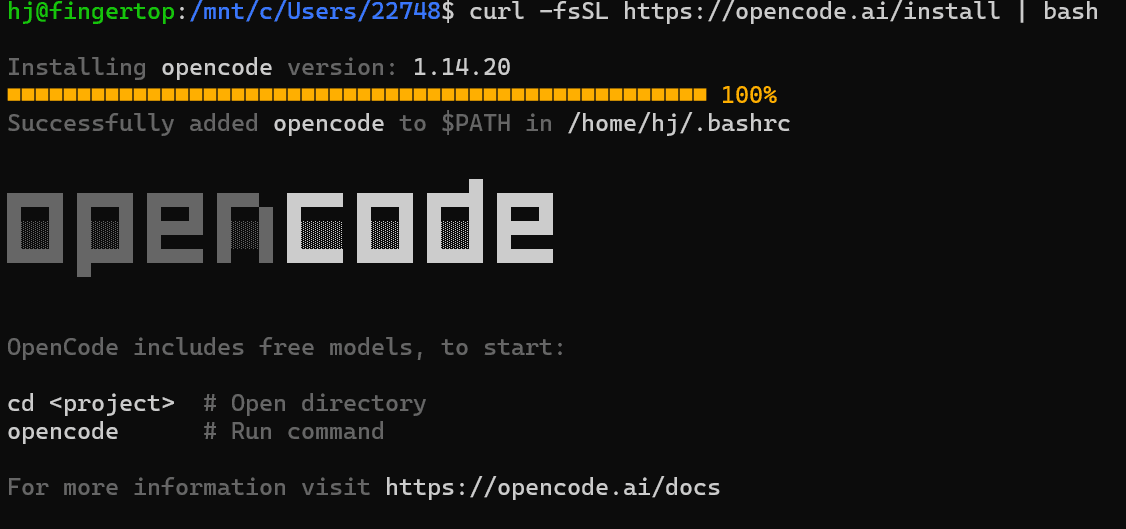

OpenCode 다운로드 및 공식 문서: https://github.com/anomalyco/opencode

OpenCode에는 내장

1openai1openai/1@ai-sdk/openai-compatible1~/.config/opencode/config.jsonplaintext1{ 2 "$schema": "https://opencode.ai/config.json", 3 "provider": { 4 "atlascloud": { 5 "npm": "@ai-sdk/openai-compatible", 6 "name": "AtlasCloud", 7 "options": { 8 "baseURL": "https://api.atlascloud.ai/v1", 9 "apiKey": "apikey-xxx" 10 }, 11 "models": { 12 "moonshot/kimi-k2.6": { "name": "Kimi K2.6" } 13 } 14 } 15 }, 16 "model": "atlascloud/moonshot/kimi-k2.6" 17}

1model1providerName/modelKey

3. OpenClaw (설정 파일 + 터미널 2개)

OpenClaw는 게이트웨이와 TUI라는 두 개의 개별 프로세스로 실행됩니다. 사용 전 둘 다 실행해야 합니다.

1~/.openclaw/openclaw.jsonplaintext1{ 2 "agents": { 3 "defaults": { 4 "model": { 5 "primary": "custom-api-atlascloud-ai/moonshot/kimi-k2.6" 6 } 7 } 8 }, 9 "models": { 10 "providers": { 11 "custom-api-atlascloud-ai": { 12 "baseUrl": "https://api.atlascloud.ai/v1", 13 "api": "openai-completions", 14 "apiKey": "apikey-xxx", 15 "models": [ 16 { 17 "id": "moonshot/kimi-k2.6", 18 "name": "Kimi K2.6", 19 "api": "openai-completions" 20 } 21 ] 22 } 23 } 24 } 25}

실행 순서:

plaintext1# 터미널 1 2openclaw gateway 3 4# 터미널 2 5openclaw tui

대화형 재설정이 필요한 경우:

1openclaw configure모델을 변경하려면

1primary4. Hermes Agent (대화형 설정)

Hermes는 설정 파일 대신 설정 마법사를 사용합니다.

plaintext1hermes setup

질문에 다음과 같이 입력하세요:

- Provider: text

1custom - Endpoint: text

1https://api.atlascloud.ai/v1 - API Key: text

1apikey-xxx - Model: text

1moonshot/kimi-k2.6

중요: 모델 ID에는 반드시

접두사가 포함되어야 합니다.text1moonshot/만 입력하면 404 오류가 발생합니다.text1kimi-k2.6

추후 모델을 변경하려면

1hermes setup

2부 — K2.6의 실제 역량

Claude Code × K2.6 — 23개 에이전트 동시 실행 시 발생하는 일

AI 시스템을 한계치까지 밀어붙였을 때 가장 먼저 무너지는 것은 무엇일까요?

한 개발자가 이를 테스트하기 위해 23개의 에이전트를 Claude Code를 통해 하루 종일 동시에 실행해 보았습니다. 총 26개의 세션에서 고주파 도구 호출, 다단계 파이프라인, PRD 작성 및 SEO 기획과 같은 긴 체인 작업을 수행했습니다. 즉, 일반적인 "운영 환경"과 다름없는 가혹한 부하 테스트였습니다.

그런데 예상 밖의 결과가 나타났습니다.

429 속도 제한(Rate-limit) 오류가 단 한 번도 발생하지 않았습니다.

에이전트 워크플로우 확장을 시도해 본 사람이라면 이것이 얼마나 놀라운 결과인지 아실 것입니다. 유사한 환경에서 GLM 5.1과 같은 모델들은 잦은 속도 제한으로 인해 재시도가 필요하고 파이프라인이 중단되는 불안정함을 보였습니다. 반면, K2.6은 가장 빠른 속도보다는 압박 속에서도 유지되는 일관된 안정성을 보여주었습니다.

이 차이는 생각보다 중요합니다.

단일 프롬프트를 넘어 다중 에이전트 시스템으로 진입하면, 진짜 과제는 "모델이 답변을 잘하는가?"가 아니라 다음과 같기 때문입니다.

수십 개의 병렬 작업을 수행하면서 시스템을 중단시키지 않고 안정적으로 답변을 지속할 수 있는가?

생성 그 이상의, 기획에 가까운 품질

차이는 안정성에만 있지 않았습니다. K2.6은 복잡한 작업을 처리하는 방식에서도 두각을 나타냈습니다.

PRD 작성을 요청했을 때, 단순히 내용을 채워 넣는 것을 넘어 스스로 문제 영역을 구조화했습니다. 경쟁 분석, 사용자 스토리, 기능 우선순위 등 명시적으로 요청하지 않은 부분까지 마치 "완벽한 PRD"가 갖춰야 할 요건을 이해하고 있는 것처럼 구성했습니다.

SEO 작업에서도 유사한 모습을 보였습니다. 단순히 키워드를 제안하는 대신, K2.6은 먼저 검색 의도를 추론한 후 그에 맞춰 콘텐츠 방향을 조정했습니다. 결과물은 단순한 텍스트 생성이라기보다 초기 단계의 전략 기획에 가까웠습니다.

이는 미묘하지만 중요한 변화입니다.

단순히 답을 얻는 것이 아니라, 조직화된 사고 과정을 얻는 것입니다.

다중 에이전트 환경에서는 이 효과가 증폭됩니다. 각 에이전트가 구조화된 고품질 결과물을 생성하면, 이를 조율하는 계층에서 해야 할 정리 작업이 획기적으로 줄어들기 때문입니다.

트레이드오프: 안정성에는 비용이 따른다

물론 이러한 성능은 공짜가 아닙니다.

K2.6은 특히 첫 토큰 생성 시간(first-token latency) 면에서 GLM 5.1보다 눈에 띄게 느립니다. 지연 시간이 무시할 수 없는 수준이며, 대략 한 자릿수 정도 차이가 납니다. 단일 요청에서는 견딜 만하지만, 23개의 에이전트가 병렬로 돌아가는 시스템에서는 각 단계의 지연이 누적되어 체감도가 높습니다.

이는 모델 아키텍처에서 기인합니다. K2.6은 약 1조 개의 파라미터 중 추론 시 320억 개를 활성화하는 Mixture-of-Experts(MoE) 설계를 채택했습니다. 이러한 규모가 강력한 역량을 제공하지만 스케줄링 오버헤드도 동반합니다. 프리뷰 빌드인 만큼 추론 최적화가 아직 완전히 적용되지 않았을 가능성도 있습니다.

결국 다음과 같은 명확한 트레이드오프가 존재합니다.

- 처리량과 속도가 중요하다면 다른 모델이 유리할 수 있습니다.

- 대규모 환경에서의 안정성과 구조화된 출력이 중요하다면 K2.6은 그 가치가 충분합니다.

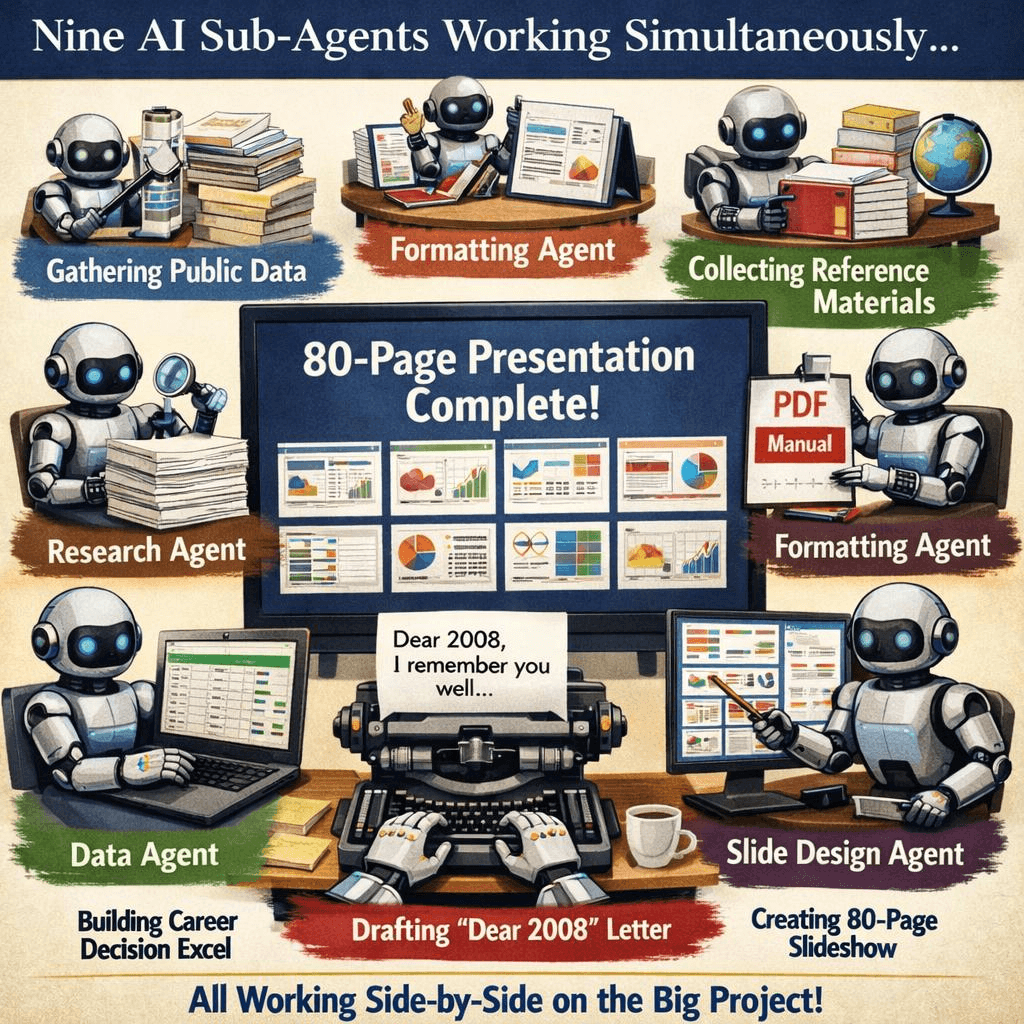

OpenCode × K2.6 — 단일 프롬프트에서 9개의 병렬 워크스트림으로

Claude Code 실험이 K2.6의 부하 내성을 보여준다면, OpenCode는 K2.6이 업무를 어떻게 조직화하는지를 잘 보여줍니다.

K2.6에는 AgentSwarm이라는 조율 계층이 도입되어, 단일 "코디네이터" 에이전트가 각각 특화된 역할을 부여받은 수십 개의 서브 에이전트를 생성할 수 있습니다. 작업을 단일 스레드에서 순차적으로 처리하는 대신, 시스템이 이를 분해하여 여러 프로세스로 병렬 실행합니다.

실제 예시를 보겠습니다.

한 연구원이 K2.6에게 다리오 아모데이(Dario Amodei)의 프린스턴 물리학 박사 학위 과정부터 Anthropic 창업까지의 경로를 추적하는 심층 프로필 작성을 요청했습니다. K2.6은 이를 단일 긴 형식의 생성 작업으로 처리하는 대신, 9개의 병렬 트랙으로 분해했습니다.

각 트랙은 고유한 책임을 가졌습니다. 한 에이전트는 공개 정보 수집이라는 연구에 집중했고, 다른 에이전트는 자료를 구조화된 PDF로 서식화했습니다. 또 다른 에이전트는 주요 경력 결정 지점 데이터셋을 구축했으며, 동시에 글쓰기 전담 에이전트가 _"Dear 2008"_이라는 제목의 1인칭 서사를 작성했습니다.

이 모든 것이 동시에 수행되었습니다.

결과물은 단순히 문서 하나가 아니라, 구조화된 데이터와 서식화된 문서가 포함된 완성된 패키지였습니다. 평소라면 여러 툴을 거치고 수동으로 조합해야 했을 작업이 하나의 통합된 결과물로 완성된 것입니다.

이것이 AI 활용 방식을 바꾸는 이유

이 변화의 핵심은 스킬(Skill) 시스템입니다.

각 작업을 새로운 프롬프트로 취급하는 대신, K2.6은 골드만삭스 보고서, 경쟁사 분석, 잘 작성된 제품 사양서와 같은 구조화된 지식을 로드하여 재사용 가능한 "스킬"로 전환할 수 있습니다. 서브 에이전트가 실행될 때 이 프레임워크(분석 스타일, 어조, 구조)를 상속받기 때문입니다.

시간이 지남에 따라 시스템은 단순 프롬프트 기반 워크플로우를 넘어섭니다.

반복 가능한 생산 파이프라인이 되는 것입니다.

이는 AI 활용에 대한 사고방식을 근본적으로 바꿉니다.

더 이상 모델에 프롬프트를 입력하는 것이 아니라, 팀을 운영하는 관리자가 되는 것입니다.

에이전트 기반 워크플로우를 구축 중이라면, 이 차이를 무시할 수 없을 것입니다.

4가지 도구 모두

1https://api.atlascloud.ai/v11moonshot/kimi-k2.6FAQ

-

Hermes Agent를 사용하는 것과 Kimi K2.6 API를 직접 호출하는 것의 차이는 무엇인가요?

핵심은 **실행(Execution)과 응답(Response)**의 차이입니다.

Kimi K2.6 API를 직접 호출하면 요청당 단일 응답을 받게 됩니다. 복잡한 작업도 직접 분해하고, 여러 프롬프트를 반복하고, 결과물을 스스로 조합해야 합니다. 이는 단순하거나 대화형 작업에는 적합하지만, 구조화된 워크플로우에서는 비효율적입니다.

반면 Hermes는 워크플로우 오케스트레이션을 도입합니다. 단일 프롬프트 대신 연구, 기획, 실행 등 다단계 파이프라인을 정의하면 Hermes가 각 단계를 에이전트에게 할당합니다. 에이전트들은 서로 결과를 전달하고, 중간 출력물을 검증하며, 오류 발생 시 스스로 단계를 재시도합니다.

즉, "프롬프트 엔지니어링"에서 작업 오케스트레이션으로 수준이 높아지는 것입니다. API가 시스템의 중심이 아니라 시스템 내의 한 부품이 됩니다.

-

Kimi K2.6은 다중 에이전트 워크플로우와 자동화에 적합한가요?

네, 바로 그 분야에서 탁월한 성능을 보입니다.

다중 에이전트 설정에서 가장 큰 당면 과제는 다음과 같습니다.

- 단계 간 일관성 유지

- 장기 실행 시의 안정성

- 구조화된 작업 지침 준수

Kimi K2.6은 이 세 영역 모두에서 뛰어난 성능을 보여줍니다. Hermes 내부에서 사용될 때, 다단계 작업 전반에 걸쳐 구조화된 결과물을 유지하고, 형식 준수나 방향성 상실 없이 복잡한 작업 체인을 처리할 수 있습니다.

또 다른 중요한 점은 자기 교정(Self-correction) 능력입니다. 중간 결과값이 목표에서 벗어나면, 시스템은 결함이 있는 데이터를 가지고 계속 진행하는 대신 해당 단계를 재생성할 수 있습니다. 이는 매 단계를 수동으로 감독할 수 없는 자동화 시나리오에 훨씬 더 적합합니다.

전반적으로 단순 텍스트 생성기보다 신뢰할 수 있는 실행 계층에 가깝습니다.

-

다른 모델에 비해 Kimi K2.6이 에이전트 워크플로우에서 느린 이유는 무엇인가요?

속도가 느린 것은 모델 자체의 특성뿐만 아니라 활용 방식과도 관련이 있습니다.

일반적인 채팅에서는 하나의 응답만 기다리면 됩니다. 하지만 에이전트 워크플로우에서는 한 작업이 여러 단계를 거치며, 각 단계마다 모델 호출이 필요하고 에이전트 간 조율 오버헤드가 발생합니다. 이 과정에서 단계별로 지연이 발생하게 됩니다.

또한, Kimi K2.6은 더 복잡한 아키텍처(예: MoE 라우팅)로 설계되어 있어, 작거나 최적화된 모델에 비해 추론 오버헤드가 높을 수 있습니다. 다중 에이전트 오케스트레이션과 결합되면 이 지연 시간이 더욱 체감됩니다.

하지만 이에 대한 반대급부로 각 단계에서 더 고품질이고 구조화된 출력물을 얻게 되므로, 재시도나 수동 수정의 필요성이 줄어듭니다. 즉, 응답 속도 자체는 느릴 수 있지만 워크플로우 수준에서는 오히려 더 효율적일 수 있습니다.