Введение: Что такое Seedance 2.0?

Seedance 2.0 — это долгожданный преемник мультимодальной модели генерации видео от ByteDance.

- Обновление: В то время как Seedance 1.5 Pro заложила основу для нативной аудиовизуальной генерации, версия 2.0, по прогнозам, представит «Акустические физические поля» и «Приоры модели мира».

- Цель: Сократить разрыв между генерацией ИИ и физической реальностью. Модель стремится стать универсальным режиссером, управляющим сложными аудиовизуальными повествованиями для видео длительностью более 30 секунд.

Ключевые прогнозы: 3 главных обновления в Seedance 2.0 (ожидаемые)

1. От синхронизации звука к «Акустической физике»

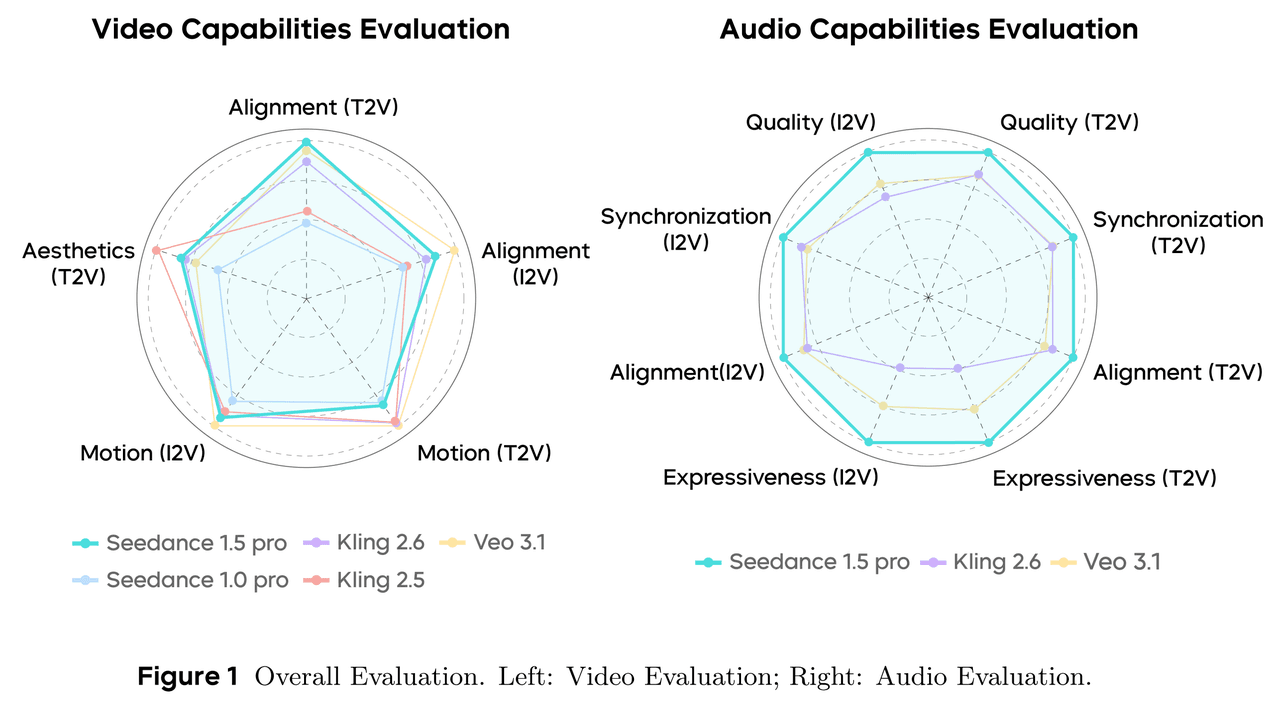

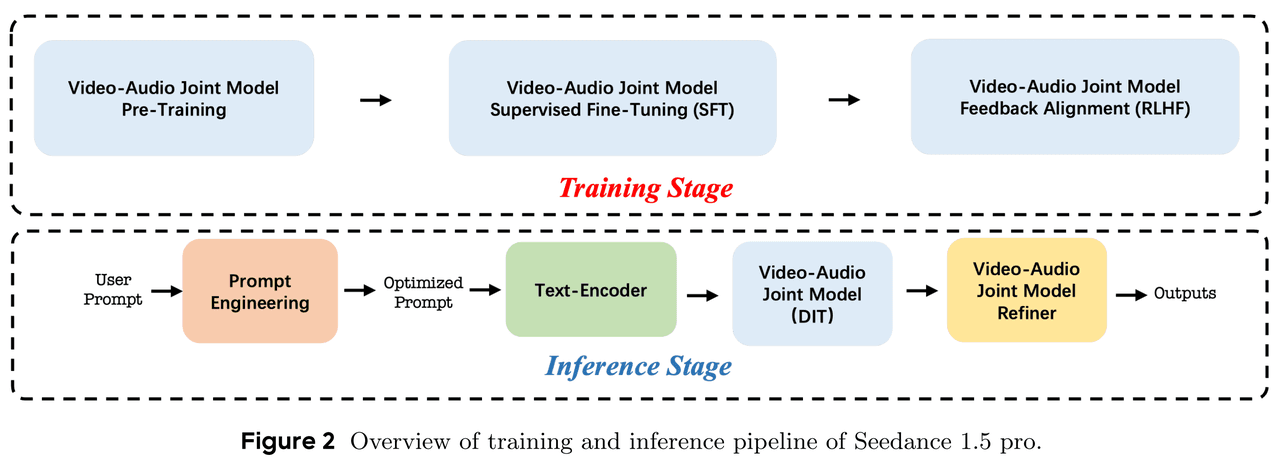

Seedance 1.5 Pro использовала двухветвевой диффузионный трансформер (MMDiT) для решения проблем синхронизации губ. Однако ожидается, что Seedance 2.0 будет симулировать полноценное акустическое поле.

- Настоящая мультимодальная физика: Если в видео разбивается стекло, генерируемый звук не будет просто обычным звуковым эффектом. Система рассчитает реверберацию на основе материала пола (например, ковер против плитки), видимого в кадре.

- Латентные приоры: Это подразумевает добавление приоров физического движка в архитектуру MMDiT, что придает звуку «вес» и «силу воздействия».

2. Конкуренция с Wan 2.6: Стабильность в длинных видео

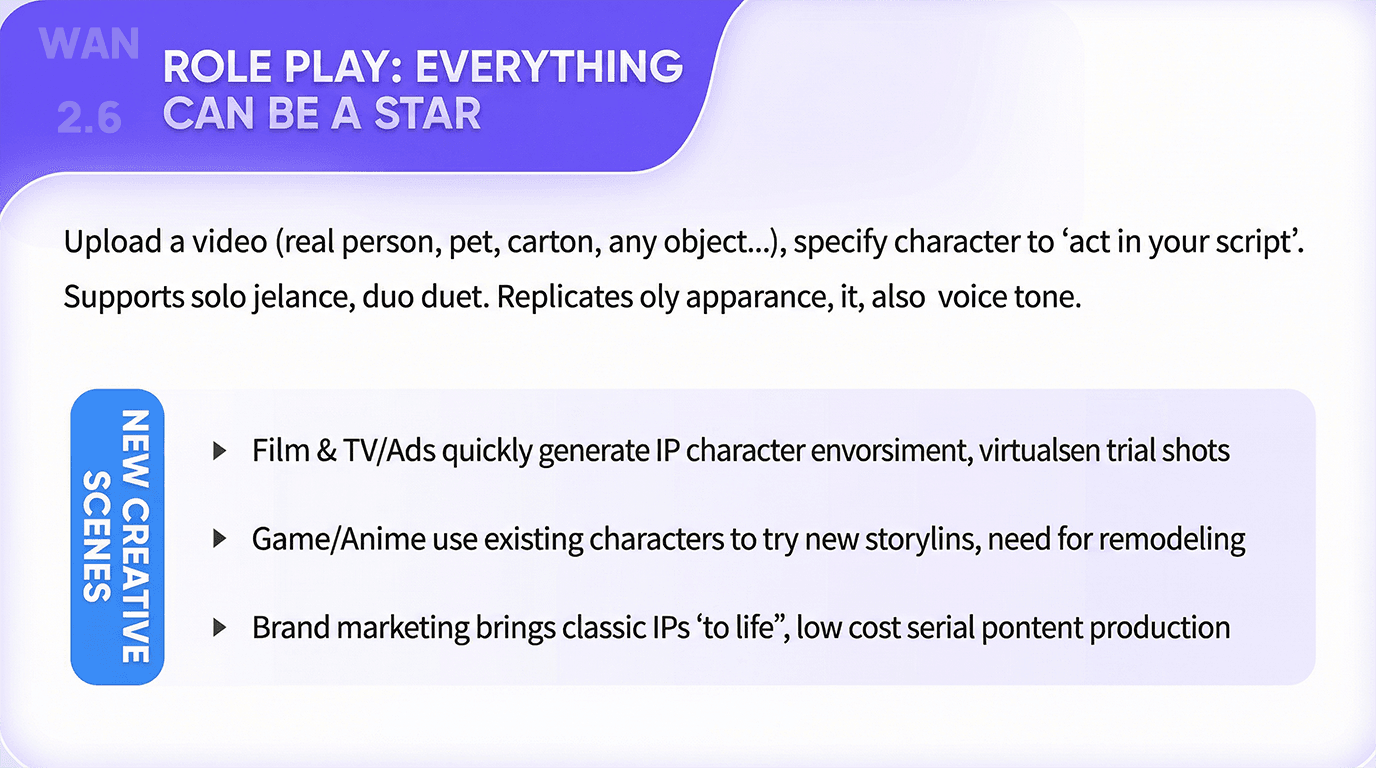

- В настоящее время Wan 2.6 доминирует в вопросах стабильности персонажей благодаря функции Reference-to-Video, которая работает как zero-shot LoRA персонажа. Ожидается, что Seedance 2.0 противопоставит этому фиксацию на «World ID».

- Более долгая генерация: Преодолевая «проклятие 12 секунд», Seedance 2.0 нацелена на нативную связность в видео длительностью 30–60 секунд.

- Временное внимание (Temporal Attention): Улучшенная оптимизация после обучения, вероятно, позволит модели «запоминать» события первой секунды и ссылаться на них в конце ролика.

3. Управление на уровне режиссера

- Прогнозируется, что в Seedance 2.0 появятся возможности узлового управления (Node-based Control) и предварительного просмотра в реальном времени.

- Частичный инпейнтинг и аудио-ремикшинг: Пользователи смогут выбрать персонажа и изменить его действие или эмоцию в диалоге (например, с сердитой на умоляющую), сохраняя фоновую музыку и окружение неизменными.

Сравнение: Seedance 2.0 и конкуренты

| Характеристика | Seedance 1.5 Pro | Seedance 2.0 (Ожидается) |

| Архитектура | MMDiT (Аудио-визуальный) | World-MMDiT (Физика + AV) |

| Аудио | Синхронизация губ, выравнивание эмоций | Симуляция физики, взаимодействие с окружением |

| Длительность | Короткая (~10 сек) | Длинная (30–60 сек) |

| Нагрузка на вычисления | Высокая | Чрезвычайно высокая |

Как получить доступ к Seedance 2.0: Проблема с аппаратным обеспечением

Техническая документация для 1.5 Pro подчеркивает, что хотя оптимизация увеличила скорость в 10 раз, переход к возможностям «Модели мира» Seedance 2.0 экспоненциально увеличит требования к видеопамяти (VRAM) и вычислениям.

Запуск Seedance 2.0 локально — даже на NVIDIA RTX 4090 — скорее всего, будет невозможен для большинства пользователей из-за огромной мультимодальной вычислительной нагрузки.

Решение: Atlas Cloud

Atlas Cloud готов к запуску. Мы интегрировали всё семейство моделей Seedance и обеспечим поддержку Seedance 2.0 в первый же день её релиза.

- Развертывание без настройки: Доступ к моделям типа Seedance, Kling и Sora без сложной настройки Python или CUDA.

- Эластичные вычисления: Мгновенно масштабируйте мощность вашего GPU. Платите посекундно за рендеринг длинных сложных видео, не перегружая собственное оборудование.

- Доступ через API: Разработчики смогут интегрировать возможности Seedance 2.0 непосредственно в свои приложения через API Atlas Cloud сразу после запуска.

Не позволяйте железу ограничивать ваш творческий потенциал. [Зарегистрируйтесь в Atlas Cloud], чтобы обеспечить себе приоритетный доступ к релизу Seedance 2.0 в середине февраля.

Как использовать на Atlas Cloud

Atlas Cloud позволяет вам использовать модели параллельно — сначала в песочнице, а затем через единый API.

Способ 1: Использование непосредственно в песочнице Atlas Cloud

Способ 2: Доступ через API

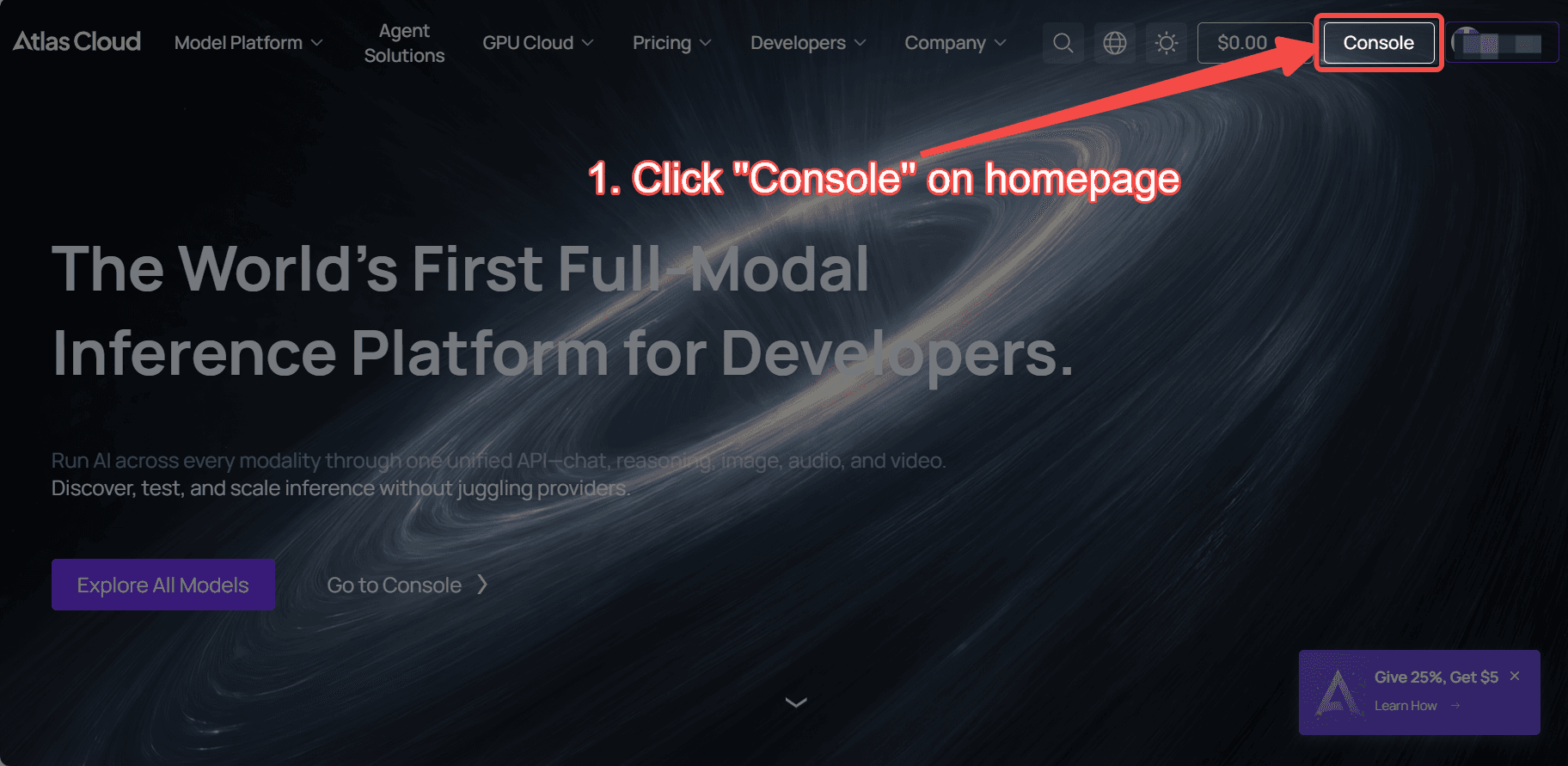

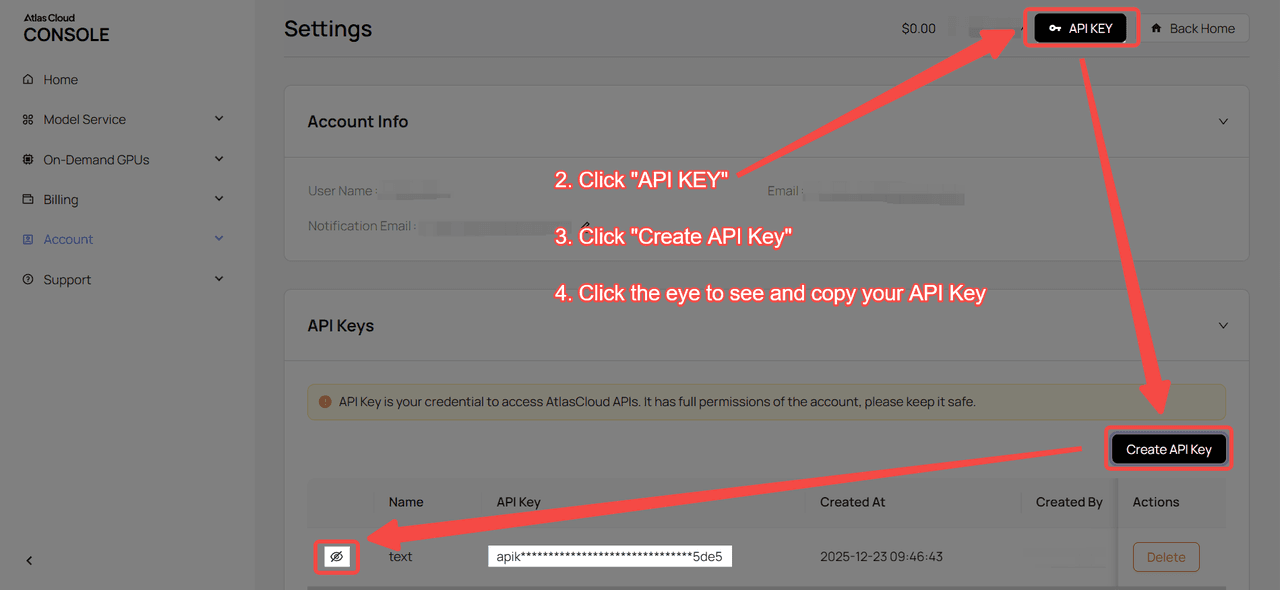

Шаг 1: Получите ваш API-ключ

Создайте API-ключ в своей консоли и скопируйте его для дальнейшего использования.

Шаг 2: Проверьте документацию API

Ознакомьтесь с конечной точкой, параметрами запроса и методом аутентификации в нашей документации API.

Шаг 3: Сделайте ваш первый запрос (пример на Python)

Пример: генерация видео с помощью Seedance 1.5 Pro:

plaintext1import requests 2import time 3 4# Step 1: Start video generation 5generate_url = "https://api.atlascloud.ai/api/v1/model/generateVideo" 6headers = { 7 "Content-Type": "application/json", 8 "Authorization": "Bearer $ATLASCLOUD_API_KEY" 9} 10data = { 11 "model": "bytedance/seedance-v1.5-pro/image-to-video-fast", 12 "aspect_ratio": "16:9", 13 "camera_fixed": False, 14 "duration": 5, 15 "generate_audio": True, 16 "image": "https://static.atlascloud.ai/media/images/06a309ac0adecd3eaa6eee04213e9c69.png", 17 "last_image": "example_value", 18 "prompt": "Use the provided image as the first frame.\nOn a quiet residential street in a summer afternoon, a young girl in high-quality Japanese anime style slowly walks forward.\nHer steps are natural and light, with her arms gently swinging in rhythm with her walk. Her body movement remains stable and well-balanced.\nAs she walks, her expression gradually softens into a gentle, warm smile. The corners of her mouth lift slightly, and her eyes look calm and bright.\nA soft breeze moves her short hair and headband, with individual strands subtly flowing. Her clothes show slight natural motion from the wind.\nSunlight comes from the upper side, creating soft highlights and natural shadows on her face and body.\nBackground trees sway gently, and distant clouds drift slowly, enhancing the peaceful summer atmosphere.\nThe camera stays at a medium to medium-close distance, smoothly tracking forward with cinematic motion, stable and controlled.\nHigh-quality Japanese hand-drawn animation style, clean linework, warm natural colors, smooth frame rate, consistent character proportions.\nThe mood is calm, youthful, and healing, like a slice-of-life moment from an animated film.", 19 "resolution": "720p", 20 "seed": -1 21} 22 23generate_response = requests.post(generate_url, headers=headers, json=data) 24generate_result = generate_response.json() 25prediction_id = generate_result["data"]["id"] 26 27# Step 2: Poll for result 28poll_url = f"https://api.atlascloud.ai/api/v1/model/prediction/{prediction_id}" 29 30def check_status(): 31 while True: 32 response = requests.get(poll_url, headers={"Authorization": "Bearer $ATLASCLOUD_API_KEY"}) 33 result = response.json() 34 35 if result["data"]["status"] in ["completed", "succeeded"]: 36 print("Generated video:", result["data"]["outputs"][0]) 37 return result["data"]["outputs"][0] 38 elif result["data"]["status"] == "failed": 39 raise Exception(result["data"]["error"] or "Generation failed") 40 else: 41 # Still processing, wait 2 seconds 42 time.sleep(2) 43 44video_url = check_status()