什麼是 GLM-5.1?智譜 AI 的自主程式編寫模型

GLM 5.1 模型即將登陸 Atlas Cloud!

- 什麼是 GLM-5.1: GLM 5.1 是智譜 AI 最先進的開源模型,擁有開源模型中最強大的程式編寫能力,足以媲美 Opus 4.6!

- 主要特色: GLM 5.1 具備頂尖的程式編寫能力。它能自動執行長達八小時的任務,並透過自適應問題解決機制,確保工作流程順暢且產出功能完善的結果。

- 發布時間: 本月。

GLM-5.1 核心特色

程式編寫效能:Opus 4.6 等級

GLM-5.1 在程式編寫任務中取得了最強的基準測試結果,效能與 Claude Opus 4.6 相當。在各大公開基準測試中,它在開源模型中名列前茅。

與 Claude 3.5 Sonnet 比較:

- Claude 3.5 Sonnet:具備強大的程式編寫能力,廣泛應用於開發工作

- GLM-5.1:達到與 Opus 4.6 同等級的效能,且價格具競爭力

與 DeepSeek V3.2 比較:

- DeepSeek V3.2:優秀的開源程式編寫模型,應用廣泛

- GLM-5.1:在專業程式編寫基準測試上表現更優異,具備獨特的長週期執行能力

長週期任務執行:8 小時自主權

GLM-5.1 的能力遠超一般的對話模型。交給它一個實際的工程專案,它會規劃工作流程、撰寫程式碼、執行測試、在遇到困難時切換策略、在故障時進行修復——並能持續工作長達 8 小時以交付完整的成果。極少有模型具備這種能力。

與 GPT-4o 比較:

- GPT-4o:適合多輪對話與短任務

- GLM-5.1:專為具備狀態管理的長期自主執行而設計

與 Qwen2.5 比較:

- Qwen2.5:在多樣化任務上表現強勁

- GLM-5.1:專門針對長時間、複雜的工程工作流程進行了優化

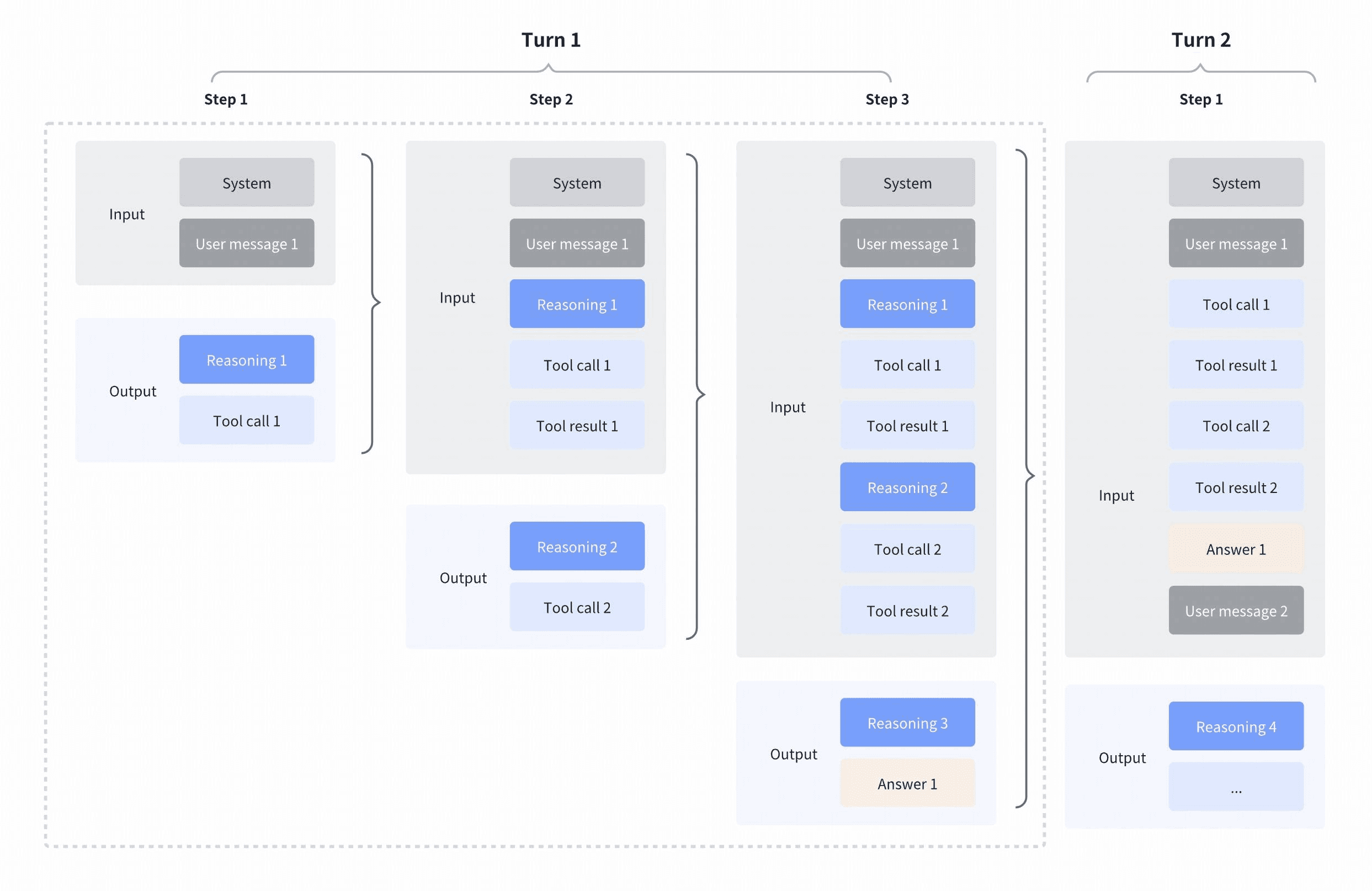

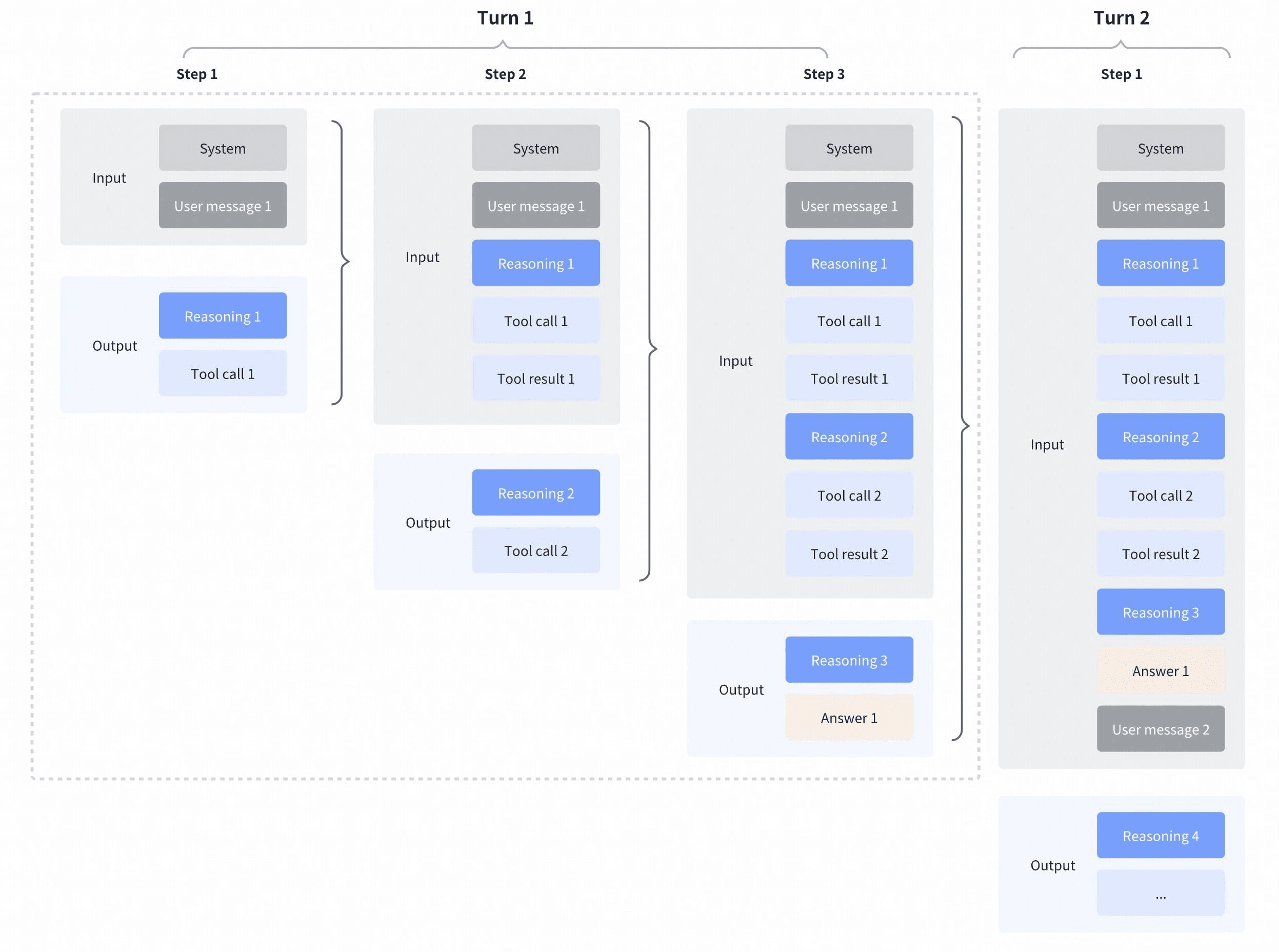

交錯式與保留式思維

- 交錯式思維 (Interleaved Thinking)

允許 GLM 在工具呼叫之間和之後進行推理,實現循序漸進的思考:詮釋輸出、連結呼叫,並根據中間結果做出精確決策。

- 保留式思維 (Preserved Thinking)

GLM-5.1 保留了前幾輪的推理過程,確保連續性、提升效能、增加快取命中率,並在實際任務中節省 Token。

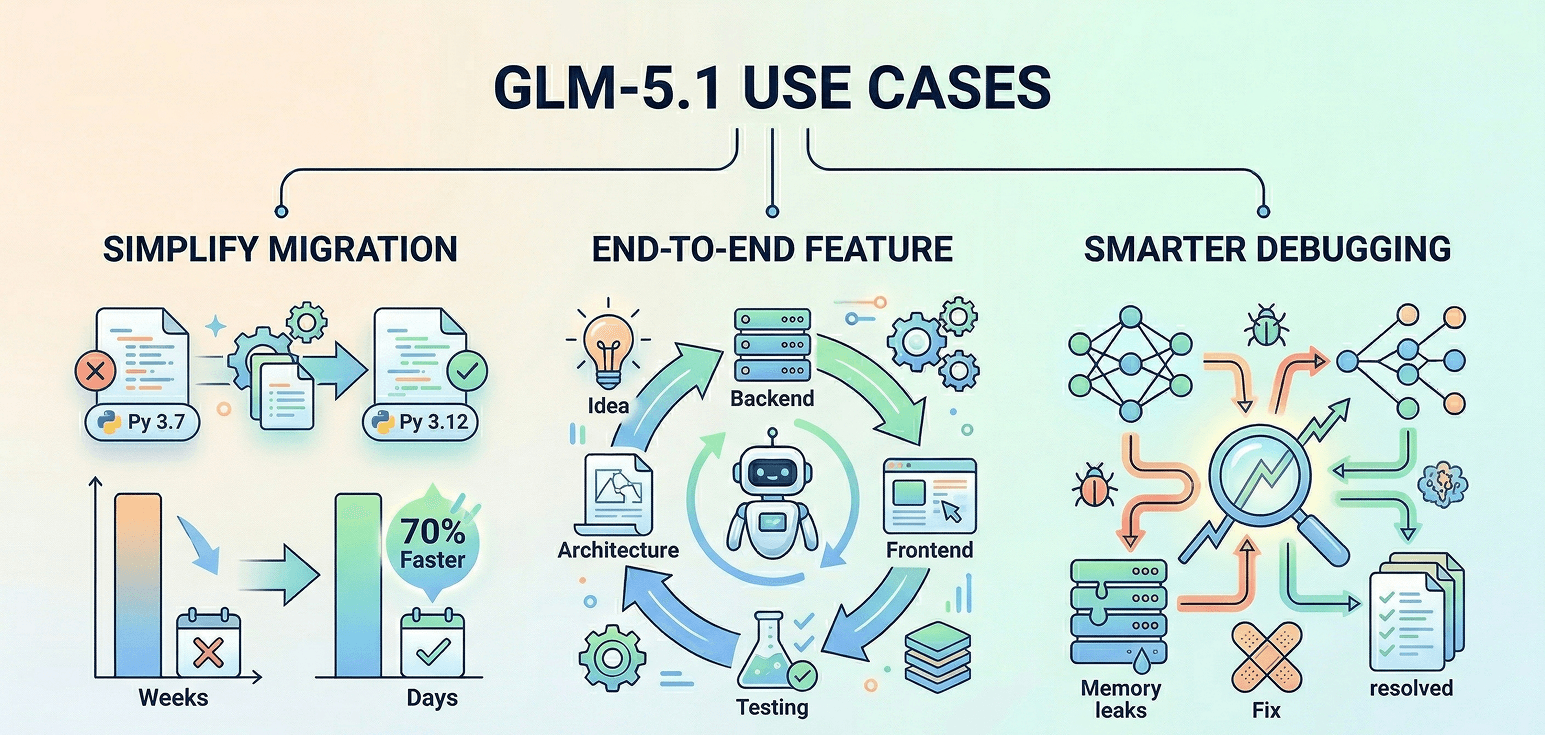

GLM-5.1 應用場景:程式碼遷移、功能開發、除錯

簡化程式碼遷移

GLM-5.1 能承擔耗時的程式碼遷移任務,將數週的工作量縮短至幾天內完成。它會審查程式庫、制定策略、大規模編輯檔案並執行全面測試。這使得升級 Python 版本或現代化框架等常見專案的效率提升了高達 70%。

端到端功能開發

從初步構思到完整建構應用程式,GLM-5.1 執行整個流程。它負責架構規劃、建立後端與前端系統、撰寫測試,甚至處理說明文件。無需持續監控,它就能交付可直接部署的完整解決方案,包含安全性、資料庫與生產環境配置。

更智慧的除錯

當大型系統出現複雜錯誤時,GLM-5.1 能承擔繁重工作。無論是競爭條件 (Race conditions) 還是記憶體洩漏,它都能持續追蹤問題,並根據仔細的測試應用修復方案。每一個步驟都會被記錄下來,留給開發者可持續擴充的解決方案。

為什麼要在 Atlas Cloud 上使用 GLM-5.1?

什麼是 Atlas Cloud?

這是一個透過單一平台提供 300 多種頂尖模型(包含文字、圖像、影片等)的平台,讓 AI 的使用變得簡單。

適合誰?

• 需要簡單且實惠的 AI 存取權的開發者。 • 需要在多個領域使用 AI 的專案團隊。 • 需要可靠 AI 來處理重要工作的企業。 • 使用 ComfyUI 和 n8n 等工具的使用者。

為什麼選擇它?

• 單一 API 即可使用所有模型——只需一把金鑰。 • 價格透明,沒有意外收費,成本低廉。 • 為企業打造:穩定、安全,並由專家提供支援。 • 與您現有的工具相容。 • 確保您的資料安全並符合法規需求。

比較優勢為何?

• Fal.ai:Atlas 擁有更多模型且價格更優。 • Wavespeed:Atlas 成本更低且包含企業級支援。 • Kie.ai:Atlas 的定價更透明,選擇更多。 • Replicate:資料庫較小且成本較高。 • 其他供應商(如 OpenAI):Atlas 將一切整合在一個簡單的平台中。

如何在 Atlas Cloud 上使用 GLM-5.1

Atlas Cloud 讓您可以並排使用模型——先在 Playground 中測試,再透過單一 API 進行呼叫。

方法 1:直接在 Atlas Cloud Playground 中使用

方法 2:透過 API 存取

步驟 1:取得 API 金鑰

在您的 控制台 中建立 API 金鑰並複製以供後續使用。

步驟 2:查看 API 文件

在我們的 API 文件 中查閱端點、請求參數與驗證方式。

步驟 3:發送您的第一個請求(Python 範例)

範例:使用 GLM-5-Turbo 生成影片

plaintext1import os 2from openai import OpenAI 3 4client = OpenAI( 5 api_key=os.getenv("ATLASCLOUD_API_KEY"), 6 base_url="https://api.atlascloud.ai/v1" 7) 8 9response = client.chat.completions.create( 10 model="zai-org/glm-5-turbo", 11 messages=[ 12 { 13 "role": "user", 14 "content": "hello" 15 } 16], 17 max_tokens=1024, 18 temperature=0.7 19) 20 21print(response.choices[0].message.content)

常見問題:GLM-5.1 常見問題集

Q:GLM-5.1 在程式編寫方面與 Claude 3.5 Sonnet 相比如何?

A:GLM-5.1 在程式編寫基準測試上與 Claude Opus 4.6 相當,優於 Claude 3.5 Sonnet。其處理長週期任務的能力使其脫穎而出。

Q:"長週期任務執行"有什麼不同?

A:一般的對話模型僅針對單一提示進行回應。然而,GLM-5.1 可以持續執行任務長達 8 小時,並在過程中不斷適應與自我修正。

Q:GLM-5.1 是開源的嗎?

A:是的,它是完全開源的。由智譜 AI 開發,您可以在官方文件中找到授權詳細資訊。

Q:它準備好投入生產環境使用了嗎?

A:絕對可以!GLM-5.1 提供 128K 上下文視窗,並執行在 Atlas Cloud 可靠的基礎設施上,使其具備生產就緒能力。

Q:我該如何整合其 8 小時執行能力?

A:針對長時間任務,請使用 Webhook 或輪詢設定。Atlas Cloud 會處理後端作業,當任務完成時,您的應用程式將會收到最終輸出。

Q:GLM-5.1 最適合處理哪些任務?

A:它非常適合挑戰性專案,如程式碼遷移、複雜系統除錯與全端軟體開發。