Wan 2.7 image 是一款由阿里巴巴通義實驗室開發的大型文字轉圖像模型。其全新的「思考模式」透過在渲染前理解空間邏輯與意圖,徹底變革了文字轉圖像技術。它不再是一個需要你微觀管理的基礎工具,而是一位真正的創意合作夥伴。下一個時代的關鍵不在於更銳利的解析度,而在於那些真正能理解你願景的模型。

WAN 2.6 與 WAN 2.7 思考模式 —— 工作流程與成本對照表

| 比較維度 | Wan 2.6 image | Wan 2.7 image (思考模式) |

| 輸入提示詞 | 需要更精確、精心設計的提示詞;對用語敏感。 | 理解自然語言。你可以像與人對話一樣描述你的想法。 |

| 生成過程 | 直接生成,內部推理有限;迭代優化較少。 | 先思考。在渲染前分析佈局、光影以及主體間的互動。 |

| 輸出創作 | 品質不錯,但在複雜場景中可能會忽略意圖或產生不一致。 | 場景高度連貫。通常在第一次或第二次嘗試就能精準呈現氛圍與結構。文字渲染能力可直接將清晰、可讀的文字嵌入圖像,無需後製處理。 |

| 使用者成本 | 單次生成成本較低,但可能需要多次重試 → 總成本較高。 | 低。工作流程更快速、重做次數大幅減少,整體生產成本更低。 |

什麼是思考模式?文字轉圖像生成的這三個階段究竟升級了什麼?

WAN 2.6 模型基本上只是「你說什麼它就畫什麼」——即便物理邏輯完全不合理。Wan 2.7 image 的思考模式徹底改變了這一點。它會先嘗試理解你試圖表達的內容,然後再協助你構建最終作品。

它不再是一台盲目的藝術機器,而更像是聯合導演。讓我們來看看在三個主要的生成階段中,底層究竟發生了什麼。

階段 ① – 意圖解讀(從關鍵字到關係)

過去,如果你要求一個「騎士與龍」,你通常只會得到兩個分開的物件,尷尬地拼貼在同一個畫面中。WAN 2.6 image 一直在多主體 AI 生成方面表現吃力。

Wan 2.7 image 會讀取文字背後的意圖。它不是隨意將物品放在畫布上,而是建立主體之間的真實關係。如果角色正在互動,它會觀察眼神接觸、姿勢和肢體聯繫。它不僅僅讀取孤立的關鍵字,還能解碼動作。這完全消除了撰寫複雜 AI 圖像提示詞的痛苦。

階段 ② – 空間與邏輯推理(從平面生成到深度)

我們都見過那些怪異的 AI 故障。手融入桌子,或者陰影指向錯誤的方向。這主要是因為 WAN 2.6 image 模型將事物平面化地渲染了。

Wan 2.7 image 應用了深入的 AI 空間推理。它在開始繪畫之前,會全域計算前景和背景的邏輯。它會找出透視關係並追蹤光源,使陰影自然投射。透過利用真正的 AI 圖像佈局控制,它確保物體確實佔據了 3D 空間。結果如何?圖像看起來像一個真實、統一的世界,而不是一本平面貼紙書。

階段 ③ – 場景構建(從單一圖像到敘事)

我們大多數人不擅長描述每一個微小的視覺細節。老實說,這沒關係。在這個最後階段,AI 會介入並自動填補你的視覺空白。

假設你想用 AI 生成海報但只給了一個基本的大綱。Wan 2.7 image 利用其多模態 AI 理解能力來選擇最佳的電影級構圖。它為你調校敘事氛圍——例如添加一些陰鬱的霧氣或特定的調色。它將一個簡單、不完整的想法轉化為一個引人入勝的故事。

案例研究:WAN 2.6 image 與 WAN 2.7 image 在生產環境中的表現

文字轉圖像技術真正的轉折點不僅僅是做出看起來還算過得去的東西,而是終於躍升到一個你可以真正將結果用於實際專案的階段。Wan 2.7 image 的思考模式似乎是推動這一巨大轉變的核心引擎。它將 AI 生成推向了真正的生產級領域。

視覺測試:「雨中街道場景」

為了看看它在實踐中如何運作,讓我們看一個簡單的視覺測試。我將完全相同的提示詞輸入到 Wan 2.6 和 Wan 2.7 image 中。

提示詞:「一個女孩在雨中的城市街道上遛狗,電影級質感,夜晚的霓虹燈。」

很標準,對吧?但產出結果的差異非常大。

並排評估總結

**WAN 2.6 image 輸出:**乍看之下似乎沒問題。但仔細觀察,狗狗身體後方/下方莫名其妙地冒出一大團濃厚的白煙。女孩握著雨傘的手指完全融化了——手指數量不對、關節結構扭曲,且直接融合在雨傘把手中。它可能騙過隨意瀏覽的人,但在審視下完全經不起考驗。

由 WAN 2.6 image 生成的圖像

**WAN 2.7 image 思考模式輸出:**這一張讓我相當驚艷。地面反射與發光的招牌完美契合。女孩和狗確實有互動。由於其先進的 AI 空間推理,場景具有真實的物理深度。你甚至可以直接拿這張圖來使用。

由 WAN 2.7 image 生成的圖像

WAN 2.6 image 與 WAN 2.7 image 思考模式 —— 視覺品質比較表

| 指標 | WAN 2.6 image | WAN 2.7 image 思考模式 |

| 構圖 | 整體構圖良好,但在複雜場景中可能會感覺平庸或稍微失衡。 | 使用智慧型 AI 圖像佈局控制實現電影級構圖,更好地強調主體與平衡。 |

| 光影 | 光線尚可,但有時會顯得平淡或在不同元素間不連貫。 | 更強、更連貫的光影,改善了真實感與情緒控制。 |

| 空間邏輯 | 偶爾有透視錯誤;物件關係在細節處可能崩壞。 | 顯著提升了空間一致性與物件相干性。 |

| 提示詞遵循度 | 相當不錯地遵循提示詞,但在給出複雜 AI 圖像提示詞時會丟失細節,可能忽略細微限制。 | 對細緻提示詞與多步驟指令的忠實度更高。 |

| 成功率 | 中等(約 70–80%):變異明顯,特別是使用複雜提示詞時。 | 高(約 85–95%):產出更可靠,所需重試次數更少。 |

商業價值:為什麼 WAN 2.7 image 的「思考模式」是遊戲規則改變者

當文字轉圖像技術從僅僅「製作圖片」轉向真正理解你想要的東西時,一切都變了。我注意到這不再只是為了獲得更漂亮的產出。真正的贏點在於效率和商業價值的巨大飛躍。它將 AI 從一個需要你不斷微觀管理的工具轉變為一個真實的協作夥伴。

更低門檻,更高效率

我記得為了得到一張可用的圖片,必須輸入各種奇怪的括號和負權重。現在這種情況大多已成為過去。透過 Wan 2.7 image 的多模態 AI 理解,自然語言終於取代了那些複雜的 AI 圖像提示詞。

你基本上只要跟它說話即可。因為它在行動前會先思考,成功率極高。命中率提高意味著工作流程大幅加速。你在兩分鐘內就能拿到素材,而不是像過去那樣需要花費許多時間。

商業用途的無與倫比的可控性

很長一段時間以來,AI 藝術大多只適合用於奇怪、抽象的概念藝術。通常不足以用於真實的商業任務。但 Wan 2.7 提供了嚴謹的 AI 圖像佈局控制。

構圖保持得非常穩固。這意味著你終於可以將其信任地用於實際的品牌宣傳活動和電商產品樣機。它處理帶有易讀文字的 AI 圖像的能力比 WAN 2.6 image 模型好得多。

團隊效率投資報酬率(ROI)最大化

將此模型引入你的公司會改變每個人的運作方式。當你減少對試錯的依賴時,投資報酬率就會飆升。以下是不同團隊實際使用它的方式:

設計師:不再從零開始。你可以快速用 AI 生成海報,利用其備受讚譽的文字渲染、多語言佈局、圖像集模式,以及處理多達 3,000 個標記(token)和支援 12 種語言的能力,將寶貴的時間花在細節打磨上。

行銷團隊:需要廣告的五種視覺變體嗎?它能輕鬆處理多主體 AI 生成,讓你的模特兒和產品每次看起來都準確無誤。

**開發人員:**你可以將這些 API 功能整合到你的應用程式中,而無需擔心使用者生成出崩壞、不可用的垃圾內容。

**內容創作者:**將部落格概念瞬間轉化為高品質縮圖,同時在整個頻道保持一致的視覺風格。

擴展 WAN 2.7 image:為什麼全球團隊使用 Atlas Cloud 的文字轉圖像 API

全新的「思考模式」令人難以置信,但我從慘痛經驗中學到,強大的功能需要強大的基礎設施。單純依賴單一的官方 API 來進行文字轉圖像生成,通常會導致巨大的麻煩。當你需要擴展時,會遇到突如其來的速率限制、惱人的佇列延遲以及深度整合的瓶頸。

這就是為什麼聰明的全球團隊轉向聚合平台。透過 Atlas Cloud 呼叫 Wan 2.7 image 模型最終成為一個更安全、更明智的選擇。

選擇 Atlas Cloud 構建的 4 個理由

- 真正的聚合靈活性

使用官方 API 意味著你被鎖定在單一模型中。此外,你還必須自己編寫所有的錯誤處理和自訂路由程式碼。這真的很麻煩。Atlas Cloud API 為你提供單一、統一的端點。你可以即時存取 Wan 2.7 image 以及其他頂級模型。你可以根據任務輕鬆切換模型。輸入和輸出完全標準化。每當全新的模型推出時,你都可以在第一天測試它,而無需重寫程式碼。

- 低延遲與高速度

官方 API 經常遭受大量使用者流量的衝擊。這意味著你的請求會卡在佇列中,應用程式速度會慢如蝸牛。Atlas Cloud 本質上繞過了官方的擁塞問題。他們提供企業級的速度,且幾乎沒有速率限制,確保你的圖像生成請求確實能快速完成。

- 企業級穩定性

在尖峰使用期間,Atlas Cloud 具備即時負載平衡。它均勻分配標記(token)並減少過載節點上的延遲高峰,確保在任何條件下都能穩定運作。

- 極具成本效益

Atlas Cloud 平台真正降低了你的基礎生成成本,成本低至每張圖片 0.03 美元。你在不犧牲任何視覺品質或速度的情況下,每張圖片的支出顯著減少。

常見問題:WAN 2.7 image 與文字轉圖像 API

關於這些技術實際上如何運作,你可能還有一些疑問。以下是當人們開始研究這種新一代技術時最常問的問題。

WAN 2.7 思考模式會增加文字轉圖像的生成時間嗎?

是的,Wan 2.7 image 的思考模式確實會增加一點推理延遲(幾毫秒到幾秒),因為它在生成前利用了思維鏈(Chain-of-Thought)推理層。然而,你的專案總時間大幅下降了。因為你不需要為了獲得一張可用的圖而被迫按下多次「生成」按鈕,所以總體而言你節省了時間。

Wan 2.7 與 Midjourney 或 Flux 有何不同?

Midjourney 以華麗、高度風格化的藝術氛圍而聞名。Flux 因其原始速度而受到高度讚揚。但 Wan 2.7 image 的建構方式不同。它依賴深入的 多模態 AI 理解。它優先考慮邏輯、物理和關係,而不僅僅是讓事物看起來漂亮。如果你需要可靠的 多主體 AI 生成,並且角色需要確實地互動而不至於相互融合,Wan 2.7 image 通常是更明智的選擇。

Wan 2.7 image 可以在圖像中渲染文字嗎?

是的,Wan 2.7 image 具備強大的多語言文字渲染能力,適用於 UI 設計與海報。

Wan 2.7 image 是開源的嗎?

不,目前尚未正式確認。

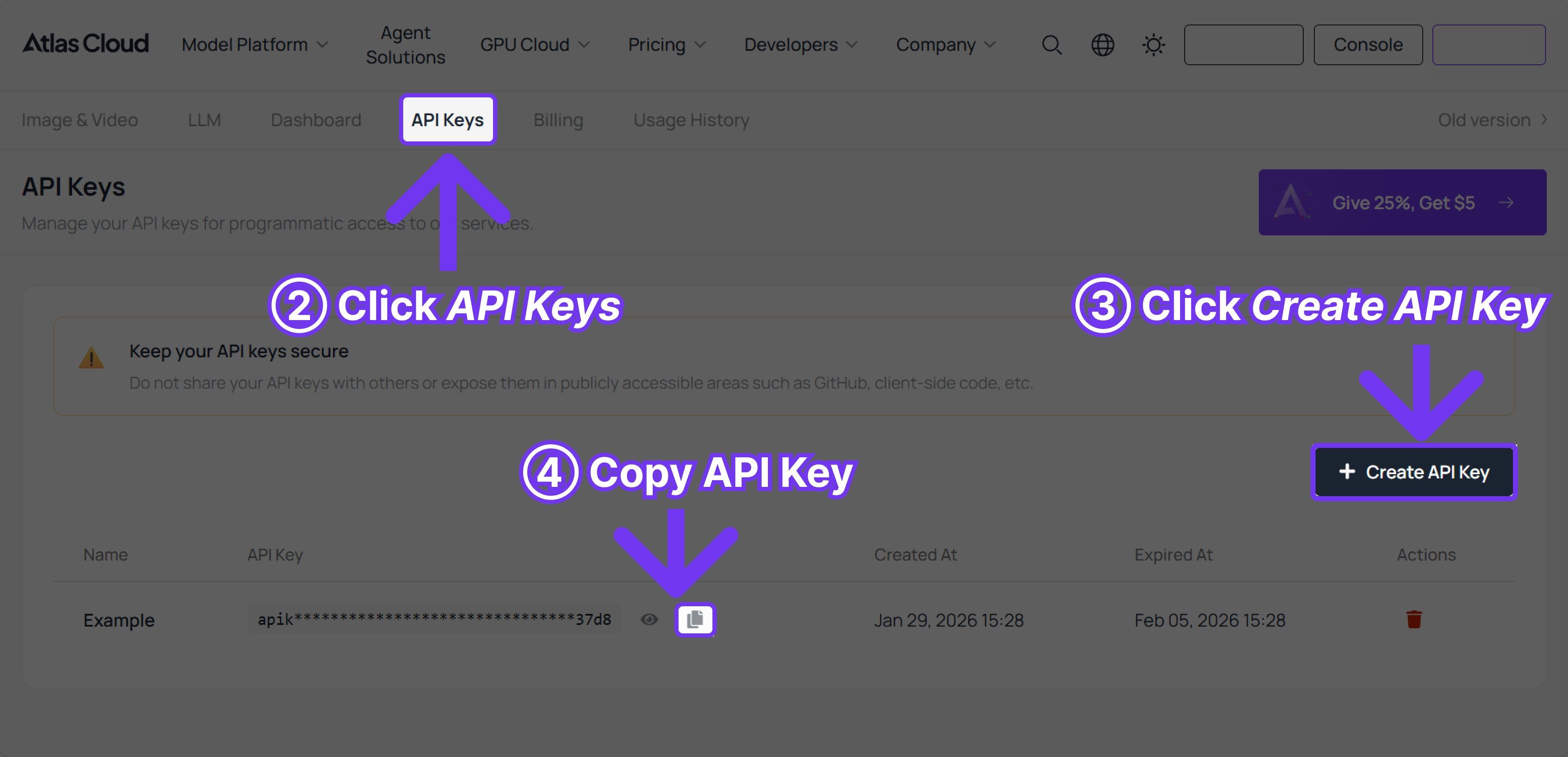

如何將 Atlas Cloud 的文字轉圖像 API 整合到我的應用程式中?

是的,你只需將目前的 URL 替換為 Atlas Cloud 的統一端點即可。它們使用標準 REST 呼叫並返回乾淨的 JSON。開發人員通常一下午就能完成並執行。

結論

回顧過去,文字轉圖像技術的演變非常驚人。幾年前,我們剛開始接觸模糊、扭曲的形狀。然後我們轉向了高解析度圖像,但依然完全缺乏基本的物理邏輯。現在,我們終於步入了一個 AI 在繪畫前真正進行思考的時代。

像 Wan 2.7 image 這樣的模型不再僅僅是盲目的圖像產生器。它們已經成為協作設計夥伴。透過理解複雜的提示詞並提供真正的佈局控制,它們彌合了原始想法與最終成品之間的最後差距,並使其具備商業應用價值。

準備好升級應用程式的生成能力了嗎?

別再與令人沮喪的提示詞工程和不可預測的官方 API 佇列作鬥爭了。將你的 AI 轉變為真正的生產力引擎。今天就在 Atlas Cloud 取得你的免費 API 金鑰,並立即測試 Wan 2.7 image。

閱讀我們的 API 文件,立即發出你的第一個 Wan 2.7 image 請求。