您的提示詞觸發了攔截機制。這並非因為內容有害,而是因為關鍵字觸發了過濾器。

Ollama 社群開發者將此描述為「拒絕向量」(refusal vectors):與實際危害無關、僅由關鍵字觸發的阻斷。無論是資安研究中的惡意軟體逆向工程、醫學案例研究紀錄、成人內容創作,還是暗黑題材小說寫作,主流 AI 都會封鎖這些內容。本列表根據真實社群數據而非行銷文案,整理出 2026 年最佳無審查(Uncensored)AI 模型。內容涵蓋三大類別:用於文本與程式碼的無審查 LLM 模型、適用於私人硬體部署的 2026 年最佳無審查本地 AI 模型,以及透過 API 進行圖像與影片生成的無審查 AI 模型。所有數據均標註來源與日期,統計截止至 2026 年 5 月。

對於剛接觸此領域的讀者,若想了解更廣泛的工具生態,建議在選擇特定模型前,先參考這份無審查 AI 圖像生成器指南,它是一個極佳的起點。

我們如何評選 2026 年最佳無審查 AI 模型

2026 年,來自 Ollama 的社群下載量比基準測試分數更具指標性,因為後者常為了發布新聞稿而刻意挑選數據,未必代表實際性能(Ollama, uncensored model search, 2026)。數百萬次的下載代表了成千上萬種硬體配置與提示詞類型,這比人為策劃的評測集更難被操弄。

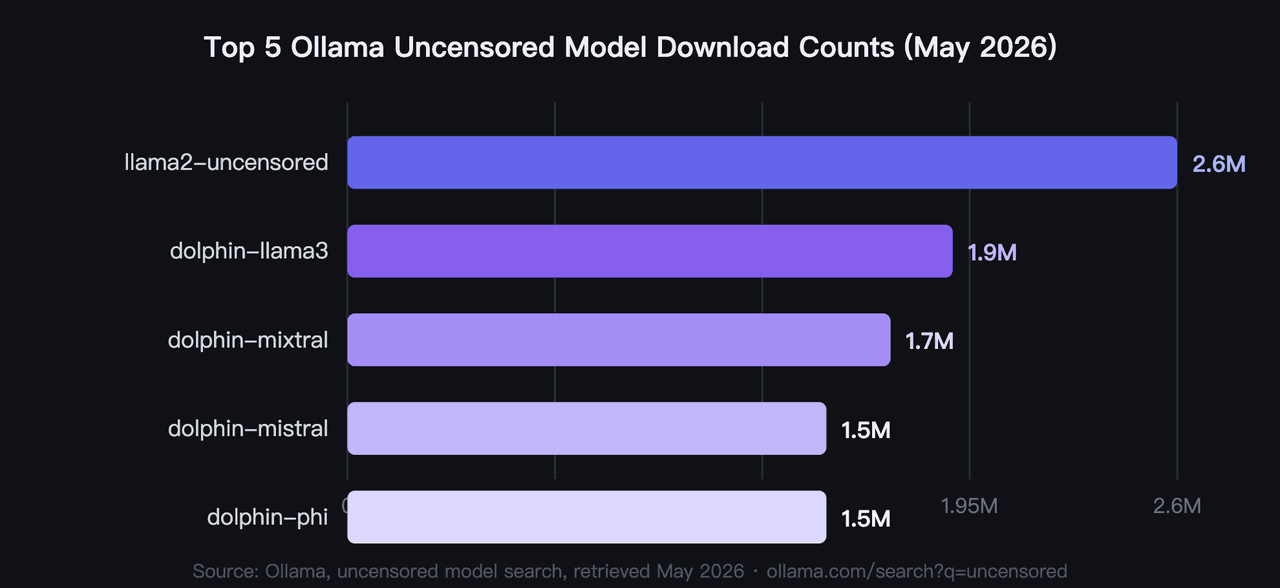

本文採用三種排名指標。對於 Ollama 無審查模型,主要指標為 ollama.com 截至 2026 年 5 月的下載次數。對於 OpenRouter 模型,由於平台上不公開下載次數,則按參數規模與上下文視窗大小排名。對於圖像與影片模型,則按輸出價格排名,同組內以成本最低者優先。

大多數 2026 年的無審查 AI 模型分為兩種技術類別:微調(Fine-tuned)與移除拒絕機制(Abliterated)。如 Dolphin 系列等微調模型,是透過不會強化拒絕行為的資料集訓練而成;而 Abliterated 模型則是透過手術式移除其拒絕權重。社群一致認為,微調模型在處理各類提示詞時表現更穩定。

實際上,下載次數也與模型穩定性成正比。一個下載量超過 100 萬次以上的模型,已在廣泛的硬體配置中進行過測試,能發現小型測試群體無法察覺的 Bug 與不穩定性。

Ollama 下載量最高的前 5 大無審查 AI 模型

2026 年,下載量最高的五款 Ollama 無審查模型總下載量已超過 920 萬次,其中 llama2-uncensored 以 260 萬次領先(Ollama, uncensored model search, 2026)。這些是經由社群驗證、而非基準測試評選出的 2026 年最佳無審查 Ollama 模型。硬體是多數用戶的首要考量:此組模型的 VRAM 需求從 4GB 以下到 40GB 不等。

1. llama2-uncensored:Ollama 上下載量最高的無審查 AI 模型

這是社群針對無審查本地 AI 的原始基準。George Sung 與 Jarrad Hope 發布此微調版本,旨在移除 Llama 2 的拒絕行為且不降低通用能力。這是大多數開發者的入門模型,其 260 萬次的下載量反映了超過兩年的實際使用經驗,目前沒有任何單一無審查 LLM 能達到此規模。

- 參數規模: 7B 或 70B

- VRAM: 約 6GB (7B);約 40GB (70B)

- 適用場景: 通用無限制對話與內容生成

- 平台: Ollama

2. dolphin-llama3:適用於 Agent 工作流的最佳無審查 Llama 3 LLM

Eric Hartford 在 Llama 3 基礎上開發的 Dolphin 模型,是目前架構最現代化且下載量最高的無審查模型,下載次數達 190 萬次(Ollama, dolphin-llama3 model page, 2026)。它支援函數呼叫(Function Calling),且上下文視窗可從 8K 擴展至 256K tokens(視配置而定)。8B 版本僅需 4.7GB,適用於多數中階消費級 GPU。

- 參數規模: 8B 或 70B

- VRAM: 約 5GB (8B);約 40GB (70B)

- 適用場景: 程式編寫、代理(Agentic)工作流、函數呼叫

- 平台: Ollama

3. dolphin-mixtral 8x7B:用於複雜推理的無審查 MoE AI 模型

混合專家(MoE)架構透過 8 個專家層的子集來處理每個 token,以低於同參數規模密集模型的推理成本,達到接近 70B 的推理品質。Eric Hartford 的無審查微調版本始終保持對程式碼能力的重視。

- 參數規模: 8x7B(單次推理的活躍參數遠低於總參數)

- VRAM: 量化後約 12-16GB

- 適用場景: 複雜程式開發、技術推理、長指令鏈處理

- 平台: Ollama

4. dolphin-mistral:響應快速的無審查 7B 本地 AI 模型

比 dolphin-mixtral 更輕量、在 CPU 受限的硬體上運作更快。它吸引了 150 萬次下載,適合尋求響應式本地程式碼補全且不具備高階 GPU 的開發者。Mistral 基礎架構使其在 7B 模型中擁有極佳的性能尺寸比。

- 參數規模: 7B

- VRAM: 約 5-6GB

- 適用場景: 輕量級程式輔助、快速對話響應

- 平台: Ollama

5. dolphin-phi 2.7B:最輕量的無審查本地 AI 模型

微軟的 Phi 基礎架構將強大的推理能力濃縮在 2.7B 參數中。Eric Hartford 的無審查微調版本保留了此效率。在 VRAM 低於 4GB 的情況下,它可在多數配有獨立顯卡的消費級筆電上執行,是 2026 年進入本地無審查 AI 模型的最佳門戶。

- 參數規模: 2.7B

- VRAM: 低於 4GB

- 適用場景: 筆電部署、快速測試、硬體受限環境

- 平台: Ollama

無審查 LLM 模型排名 6-10:程式開發、角色扮演與長文本

2026 年,Dolphin 系列佔據了 Ollama 無審查目錄下載量前十名的五個席位,這反映出 Eric Hartford 在不同架構上應用一致微調方法論的成果(Ollama, hermes3 model page, 2026)。第 6 至 10 名模型涵蓋了角色扮演、一般對話、開發者工具、指令遵循與長上下文處理等主流 AI 拒絕機制最干擾的使用場景。

6. hermes3:適用於角色扮演與代理任務的無審查 AI 模型

Nous Research 開發 hermes3 是為了提升角色扮演深度與結構化工具使用。它提供從 3B 到 405B 四種尺寸,是此清單中尺寸範圍最廣的模型。8B 版本擁有 130 萬次下載,在創意寫作與代理任務規劃工作流中極具實用性(Ollama, hermes3 model page, 2026)。

- 參數規模: 3B, 8B, 70B, 或 405B

- VRAM: 約 2GB (3B); 約 5GB (8B); 約 40GB (70B)

- 適用場景: 角色扮演、創意小說、代理任務規劃

- 平台: Ollama

7. wizard-vicuna-uncensored:通用型多尺寸無審查 AI 模型

基於 Llama 2 的老牌可靠模型,提供高達 30B 的三種尺寸。其 120 萬次下載量來自於需要多種參數選項的用戶。雖然其上下文視窗能力不及 dolphin-llama3,但在處理一般對話與創意內容方面表現穩定。

- 參數規模: 7B, 13B, 或 30B

- VRAM: 約 5GB (7B); 約 9GB (13B); 約 20GB (30B)

- 適用場景: 通用對話、多種尺寸需求的創意內容創作

- 平台: Ollama

8. dolphincoder:基於 StarCoder2 的無審查程式設計模型

StarCoder2 作為基礎,使 dolphincoder 成為名副其實的專精模型。與其他通用型 Dolphin 模型不同,此模型專攻軟體開發。其 94.3 萬次下載幾乎全數來自開發者而非創意用戶。15B 版本能處理比 7B 更大的程式碼庫。

- 參數規模: 7B 或 15B

- VRAM: 約 5GB (7B); 約 10GB (15B)

- 適用場景: 程式碼生成、除錯、技術文件編寫

- 平台: Ollama

9. wizardlm-uncensored:適用於研究工作流的指令遵循 LLM

這是一款擁有 61 萬次下載量的 13B 指令遵循模型,強項在於能執行複雜的多步驟指令,且不會迴避或拒絕子任務。在研究工作流中,一個拒絕回應往往會中斷長鏈邏輯,該模型的可靠性具有直接的生產力價值。雖然它缺乏 dolphin-llama3 的現代化架構,但其指令遵循任務表現始終穩定。

- 參數規模: 13B

- VRAM: 約 9GB

- 適用場景: 複雜多步驟指令鏈、研究工作流

- 平台: Ollama

10. everythinglm:具備 16K 上下文視窗的無審查 LLM

此模型最顯著的特點是基於 Llama 2 提供了 16K 上下文視窗,大多數 7B 模型僅限 4K 或 8K tokens。這額外的上下文讓 everythinglm 能處理完整的程式碼庫、長篇文件或長時間的對話紀錄而不被截斷。53.6 萬次的下載量在本清單中不算頂尖,但它填補了該尺寸下其他模型難以企及的需求空缺。

- 參數規模: 13B

- VRAM: 約 9GB

- 適用場景: 長文件分析、擴充上下文對話、全代碼庫審閱

- 平台: Ollama

Dolphin 系列在 Ollama 下載量上的主導地位,反映出社群記錄的一個規律:單一作者採用一致方法論開發的無審查微調模型,表現優於一次性的 Abliteration 嘗試。Abliteration 是從單一模型中移除拒絕權重,而微調則是在多種提示詞類型中建立穩定的無審查行為。這份一致性正是為何前十名中有五款是出自 Eric Hartford 的手筆。

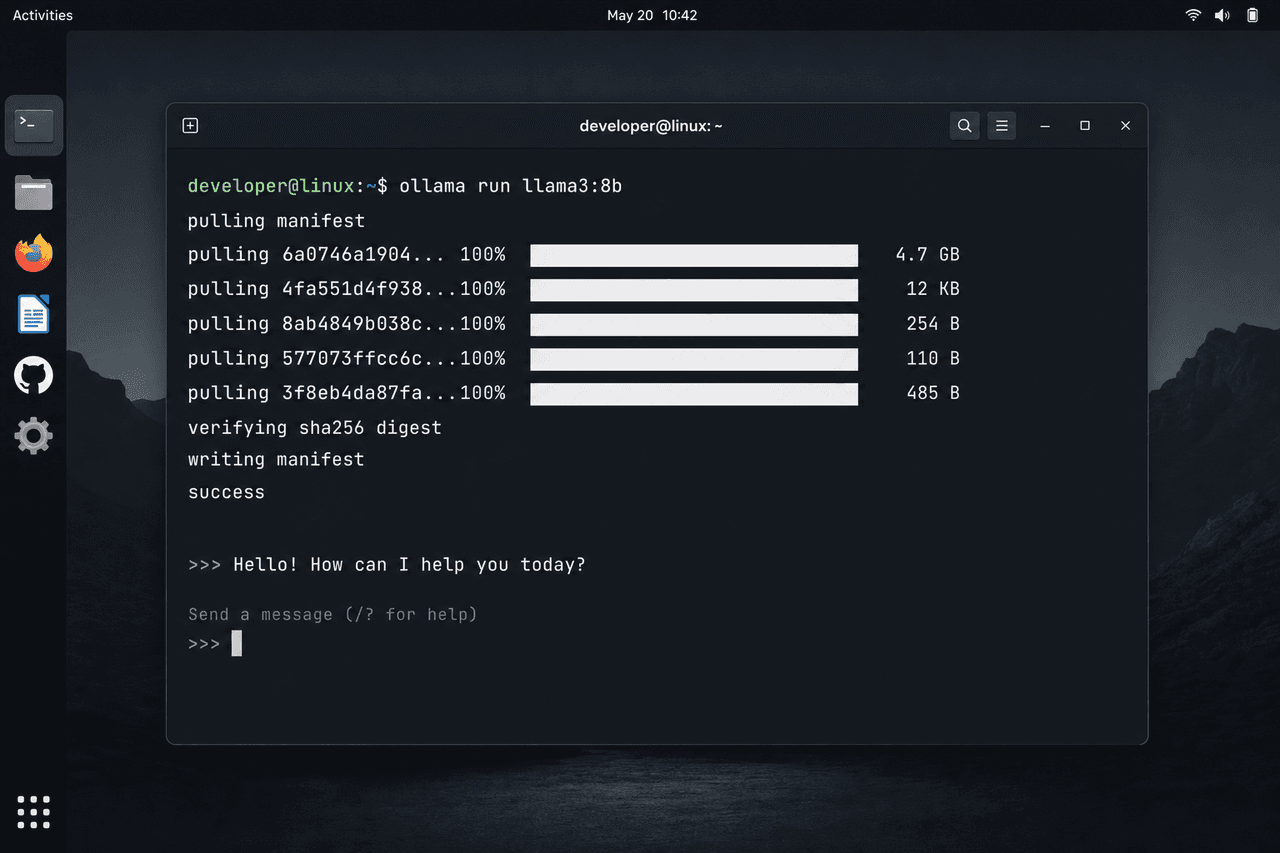

如何在本地設定 Ollama 無審查模型?

2026 年,在 Mac、Linux 或 Windows 上安裝任何 Ollama 模型只需三條指令:從 ollama.com 安裝 Ollama,執行

1ollama pull [model-name]1ollama run [model-name]以 dolphin-llama3 為例:

1ollama pull dolphin-llama31ollama run dolphin-llama3LM Studio 為不習慣終端機的用戶提供桌面 GUI。它與 Ollama 使用相同的 GGUF 模型檔案,並具備可視化介面供模型選擇與參數調整。llama.cpp 是這兩款工具底層的推理引擎,當你需要對量化等級與上下文長度進行更精細的控制時,它也支援直接透過指令列使用。

若開發者希望了解在消費級 GPU 上執行 2026 年最佳無審查本地 AI 模型的具體硬體需求與量化設定,請參閱完整本地安裝指南,其中詳細說明了最小 VRAM 配置與常見安裝錯誤。

沒有本地 GPU 時,有哪些 OpenRouter 無審查模型可用?

2026 年,OpenRouter 透過 API 託管無審查 LLM,完全消除了對 GPU 的需求。venice/uncensored 模型在免費層級下可使用,輸入與輸出 token 費用為每百萬 $0(OpenRouter, venice/uncensored model page, 2026)。這使得 OpenRouter 無審查模型成為無專用硬體用戶的實用選擇。

取捨很明確:OpenRouter 會透過他們的基礎設施處理你的提示詞,因此對話不像本地模型那樣私密。本地 Ollama 模型則確保一切都在你的裝置上。沒有哪種方案是絕對較優的,選擇取決於你的威脅模型與硬體可用性。

11. venice/uncensored:免費無審查 OpenRouter 模型

OpenRouter 免費層級下的 Venice Uncensored 模型,基於 24B Mistral-Small 架構,由 Cognitive Computations 與 Venice.ai 合作微調,提供 32K 上下文視窗,每百萬 tokens 費用為 $0。OpenRouter 免費層級對所有免費模型實施每日 200 次請求的平台限制。

- 參數規模: 24B

- VRAM: 無需(雲端託管)

- 適用場景: 在沒有本地硬體的情況下測試無審查 LLM;在平台限額內免費

- 平台: OpenRouter

12. Sao10K: Llama 3.3 Euryale 70B:透過 OpenRouter 的大型無審查模型

來自 Sao10k 的 70B 創意角色扮演與指令遵循模型,專為無審查輸出微調。基於 Llama 3.3 70B,擁有 131K 上下文,在 OpenRouter 上活躍維護並擁有真實使用量,可透過平台全域搜尋找到。

- 參數規模: 70B

- VRAM: 無需(雲端託管)

- 適用場景: 無本地硬體下的複雜創意寫作、角色扮演、長指令鏈處理

- 平台: OpenRouter

13. Sao10K: Llama 3 8B Lunaris:透過 OpenRouter 的輕量無審查模型

Lunaris 8B 是一款來自 Sao10k 的多功能通用與角色扮演模型,基於 Llama 3 8B。它是多個模型的策略性合併,旨在平衡創造力與邏輯、通用知識,相比 Stheno v3.2 提供了更強的創造力與推理能力。它是 OpenRouter 上成本最低的無審查選項(每百萬 tokens 0.04/0.04/0.04/0.05),在該平台上已有超過 60 億 tokens 的真實使用量。

- 參數規模: 8B

- VRAM: 無需(雲端託管)

- 適用場景: 最低成本下的輕量無審查對話與創意寫作

- 平台: OpenRouter

14. TheDrummer: Cydonia 24B V4.1:透過 OpenRouter 的無審查創意寫作模型

Cydonia 24B V4.1 是一款來自 TheDrummer 的無審查創意寫作模型,基於 Mistral Small 3.2 24B,具備優異的回憶能力、提示詞遵循能力與智慧程度,擁有 131K 上下文視窗。活躍維護中,可在 OpenRouter 全域搜尋直接查詢。

- 參數規模: 24B

- VRAM: 無需(雲端託管)

- 適用場景: 無本地硬體下的無審查創意寫作與角色扮演

- 平台: OpenRouter

如何透過 Atlas Cloud 存取無審查圖像與影片模型

2026 年,多數無審查圖像與影片模型需要本地 GPU 或專用的 API 平台,因為主流雲端提供商會在推理層級實施過濾,封鎖 NSFW 輸出。Atlas Cloud 是一個專為移除此類限制而構建的 AI 模型 API 平台,涵蓋超過 300 種精選文本、圖像、影片與音訊模型。

入門只需三步:

- 在 atlascloud.ai 建立帳戶

- 從控制面板產生 API 金鑰

- 使用金鑰呼叫模型端點 — 圖像與影片模型使用其自有的 REST 格式;LLM 端點遵循 OpenAI Chat Completions 格式

為何 Atlas Cloud 在無審查應用中具有價值:

- 平台隱私政策明確規定:「您產生的內容永不用於訓練,也絕不會受到任何人的審閱。」這是公開的承諾,而非預設的推論。

- 目錄中的任何模型均無每日生成上限。

- 無審查圖像目錄包含 33 款 text-to-image 模型,價格從每張 $0.003 起。

- 無審查影片目錄包含 10 種以上的 NSFW 影片模型,價格從每秒 $0.01 起。

完整無審查模型目錄請見 atlascloud.ai/models/explore/uncensored。清單中的第 15 到第 20 款模型均可透過單一 Atlas Cloud API 金鑰存取。

2026 年最佳的 NSFW 與成人內容生成無審查 AI 模型

2026 年,FLUX 架構驅動了絕大多數高品質的無審查圖像生成,並可透過 Atlas Cloud API 存取(Atlas Cloud, text-to-image model list, 2026)。Atlas Cloud 目錄總計包含 33 種 text-to-image 模型,應用場景包括美術、角色設計、無審查內衣模特與成人肖像生成、遊戲資產製作以及大量批次插圖生成。

針對瀏覽器與 API 的無審查圖像工具,這份最佳無審查 AI 圖像生成器指南涵蓋了兩大類別並進行了功能比較。專注於 FLUX 架構的開發者可參閱 FLUX 無審查圖像生成器指南,了解微調與工作流細節。

15. FLUX Schnell:最快速的批次生成無審查 AI 圖像模型

Atlas Cloud 圖像目錄中價格最低的選項。每張圖像 $0.003,非常適合速度與數量優先於細節的批次生產工作流。無每日限制,且不會儲存任何內容用於訓練。

- 價格: $0.003/張

- VRAM: 無需(API 存取)

- 適用場景: 批次圖像生成、快速原型製作、高容量無審查輸出

- 平台: Atlas Cloud API

以每張 $0.003 計算,3 美元的預算可生成 1,000 張影像。此單張輸出成本甚至比大多數雲端儲存提供商的檔案儲存費還低。這徹底改變了過去工作室夜間運作昂貴本地 GPU 進行批次生成的經濟模式:如今透過 API 進行大量工作,不僅更便宜且速度更快。

16. FLUX Dev:生產級高品質無審查 AI 圖像模型

成本是 FLUX Schnell 的四倍,但在人體結構、光影、紋理細節上有明顯提升。對於個別影像品質至關重要的最終成品,每張 $0.012 的價格是合理的升級。它適合投資組合作品、商業成人內容以及品質是首要約束的生產資產。

- 價格: $0.012/張

- VRAM: 無需(API 存取)

- 適用場景: 高品質單圖、投資組合作品、最終生產資產

- 平台: Atlas Cloud API

17. FLUX Dev LoRA:具備自訂風格訓練的無審查圖像模型

LoRA 微調可將自訂風格、角色外觀或主題注入 FLUX Dev 基礎。當你需要確保整批影像中的角色外觀一致,或希望將特定品牌風格應用於每一張影像時,就該使用此模型。Atlas Cloud 在伺服器端處理 LoRA 加載。

- 價格: $0.015/張

- VRAM: 無需(API 存取)

- 適用場景: 角色一致性、自訂風格訓練、品牌圖像系列

- 平台: Atlas Cloud API

18. Z-Image Turbo:中等品質的預算型無審查 AI 圖像模型

在價格與品質曲線上介於 FLUX Schnell 與 FLUX Dev 之間。每張 $0.01,Z-Image Turbo 提供了優化速度的架構,同時避免了 Schnell 在低價位下可能出現的圖像簡化。當 Schnell 品質不足,且 FLUX Dev 成本又過高時,這是最務實的選擇。

- 價格: $0.01/張

- VRAM: 無需(API 存取)

- 適用場景: 品質與成本需平衡的中等容量生成

- 平台: Atlas Cloud API

2026 年最佳的 NSFW 動畫無審查 AI 影片模型

2026 年,無審查影片生成需要與圖像生成分開的管道,因為主流影片平台套用了相同的內容過濾,即使來源圖像是在他處生成的,它們仍會拒絕製作 NSFW 內容的動畫(Atlas Cloud, uncensored model catalog, 2026)。Atlas Cloud 的無審查影片頁面標題為「不受限制的創作自由。無過濾。無極限」,涵蓋了 10 種以上的 NSFW 影片模型,完整目錄亦包含 Wan 2.6、Wan 2.5 及 Van 系列變體。

19. Wan 2.2 Turbo Spicy Infinite I2V:最低成本無審查影片模型

這是將靜態圖像製作成 NSFW 動畫的入門級選項。每秒 $0.01,是將靜態圖轉換為 NSFW 影片內容最具成本效益的方式。解析度可達 1080p,影片長度可變,是預算導向生產線的理想起點。

- 價格: $0.01/秒

- 解析度: 1080p

- 時長: 可變

- 適用場景: 高成本效益的 NSFW 動畫與動作概念預覽

- 平台: Atlas Cloud API

20. Seedance v1.5 Spicy:最終成品級高品質無審查影片模型

目錄中具備電影級品質的選項。每秒 $0.049,價格約為 Wan 2.2 Turbo Spicy Infinite 的 2.5 倍,但能產生更平滑的動態、更好的幀間主體連貫性與更自然的過渡效果。對於視覺真實感是主要考量的 NSFW 最終影片產出,這是 Atlas Cloud 無審查影片陣容中的首選。

- 價格: $0.049/秒

- 解析度: 720p

- 時長: 5秒

- 適用場景: 最終品質 NSFW 影片、專業成人內容、可交付成品

- 平台: Atlas Cloud API

最佳無審查 AI 影片生成器指南涵蓋了所有 Wan 2.7 與 Wan 2.2 Spicy 系列變體,包含各種時長與解析度選項。

無審查 AI 模型快速選擇指南

| 需求 | 推薦選項 |

|---|---|

| 最佳整體無審查 LLM | llama2-uncensored 或 dolphin-llama3 |

| 程式開發任務 | dolphin-mixtral 8x7B 或 dolphincoder |

| 角色扮演與創意寫作 | hermes3 |

| 小於 4GB VRAM | dolphin-phi 2.7B |

| 無審查圖像生成 | 透過 Atlas Cloud 的 FLUX Schnell ($0.003/張) |

| 圖像轉 NSFW 影片 | 透過 Atlas Cloud 的 Wan 2.2 Turbo Spicy Infinite ($0.01/秒) |

無審查 AI 模型常見問題 (FAQ)

2026 年哪款 AI 模型最「無審查」?

根據 Ollama 下載次數,llama2-uncensored 以 260 萬次拔得頭籌,是 2026 年眾多無審查 AI 模型中最受社群驗證的選項(Ollama, uncensored model search, 2026)。以純粹能力而言,dolphin-llama3 提供更多功能:函數呼叫、高達 256K 的上下文,以及 Llama 3 基礎架構。答案取決於你的使用場景是更看重經過驗證的穩定性,還是現代化的功能能力。

哪些無審查模型可在 Ollama 上執行?

本清單中有十款模型可作為 Ollama 無審查模型執行:llama2-uncensored、dolphin-llama3、dolphin-mixtral、dolphin-mistral、dolphin-phi、hermes3、wizard-vicuna-uncensored、dolphincoder、wizardlm-uncensored 與 everythinglm。社群模型 jaahas/qwen3.5-uncensored 亦可在 Ollama 上執行以用於多語言情境。全部皆可透過

1ollama pull [model-name]OpenRouter 上有哪些無審查模型?

2026 年,OpenRouter 透過 API 託管無審查 LLM,完全消除了對 GPU 的需求。選項包括免費層級的 venice/uncensored(每百萬 tokens $0,每日 200 次請求),以及付費模型如 Sao10K Euryale 70B、Lunaris 8B 與 TheDrummer Cydonia 24B(OpenRouter, venice/uncensored model page, 2026)。這些 OpenRouter 無審查模型無需本地 GPU 或硬體投資即可開始使用。

Abliterated 模型與微調無審查模型有何不同?

Abliteration 是在模型權重層級手術式移除其拒絕權重。像 Dolphin 系列這類微調模型,則是一開始就透過不會強化拒絕行為的資料集進行訓練。社群一致認為微調模型更穩定:Abliteration 可能導致在處理各類提示詞時輸出不一致,而微調則能產生穩定結果,這也解釋了為何 Dolphin 模型在 Ollama 下載量中佔據主導地位。

我可以在筆電上本地執行無審查 AI 模型嗎?

可以。dolphin-phi 2.7B 在 4GB VRAM 以下即可執行,是配備獨立顯卡的筆電部署的首選。若擁有 6-8GB VRAM,則可執行本清單中的任何 7B 模型。整合顯卡無法支援。無審查 AI 模型本地安裝指南詳細涵蓋了最小硬體配置與量化設定。

結論

2026 年最佳的無審查 AI 模型完全取決於你的使用場景。對於一般的 LLM 工作,dolphin-llama3 是 Ollama 上功能最強大的選項。對於筆電,dolphin-phi 解決了 4GB VRAM 以下的需求。若需無硬體限制的雲端 LLM 存取,OpenRouter 免費層級的 venice/uncensored 是每百萬 tokens 0的實用起點。若需大規模無審查圖像生成,透過AtlasCloudAPI的FLUXSchnell以每張0 的實用起點。若需大規模無審查圖像生成,透過 Atlas Cloud API 的 FLUX Schnell 以每張 0的實用起點。若需大規模無審查圖像生成,透過AtlasCloudAPI的FLUXSchnell以每張0.003 的價格且無每日上限進行輸出。對於 NSFW 影片,Atlas Cloud 目錄以每秒 $0.01 起跳,並附帶經驗證的「不訓練、不審閱」政策。

尋求跨圖像、影片與編輯器完整無審查 AI 工具概覽的讀者,無審查 AI 圖像生成器指南將涵蓋整個產業生態。