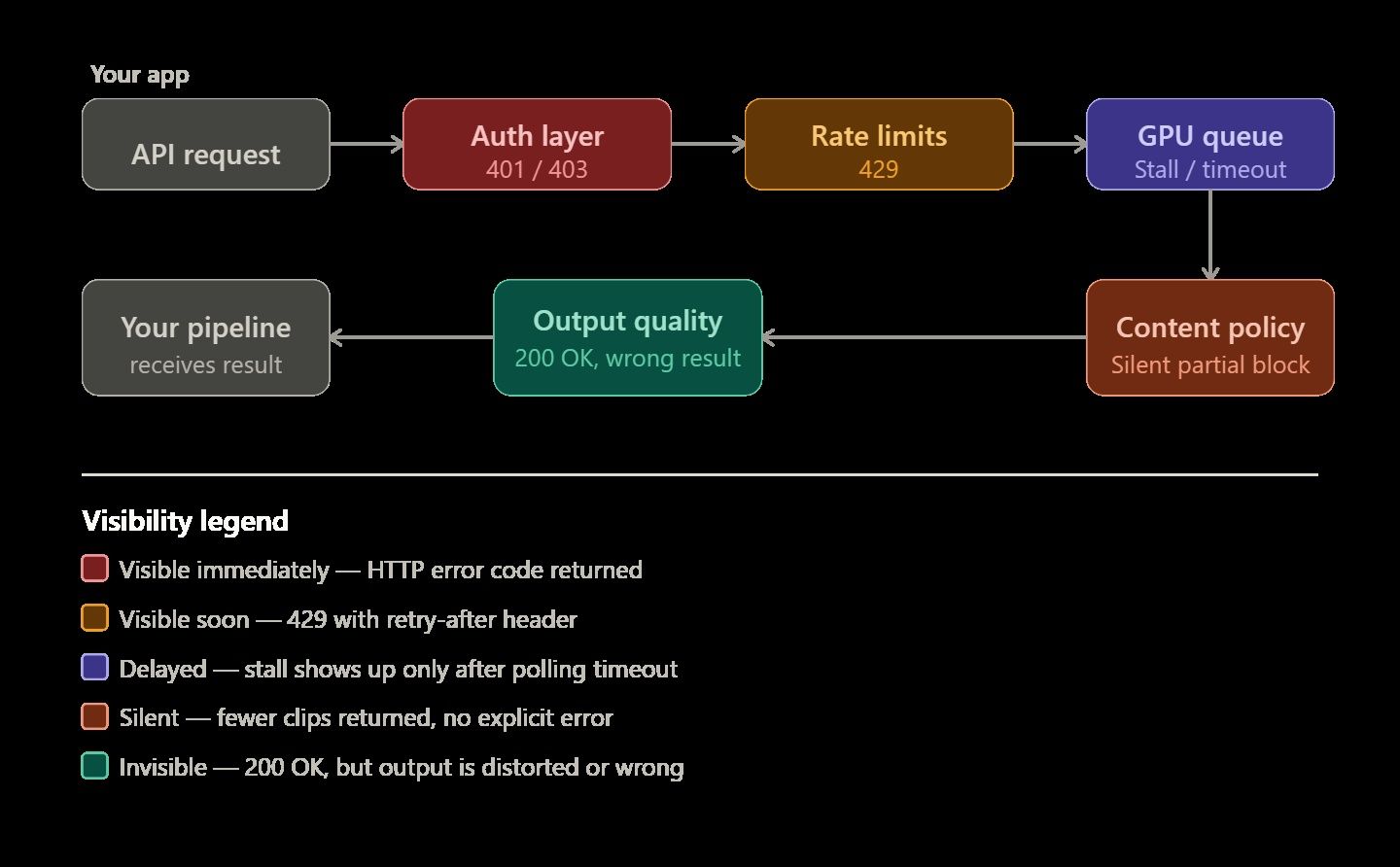

AI 影片生成 API 一直給人「難以伺候」的印象,這並非空穴來風。文字補全如果出錯,會立即回傳 400 錯誤;但影片渲染的情況則不同,也更難預測。任務可能會在 GPU 佇列中無限期卡住,且沒有任何預警;它可能只回傳了請求片段的一半;有時候,渲染雖然完美結束,但最終影片看起來卻極度扭曲或違反物理定律。

要建立可靠的系統,您必須了解這些特定錯誤發生的原因。這種知識是將簡單的展示(demo)與真正能為使用者運作的影片管道區分開來的關鍵。

本指南將介紹最常見的失敗模式、如何準確解讀 API 回應,以及建立低成本、低故障率影片渲染管道的具體策略。程式碼範例使用了 Atlas Cloud API,這是一個整合式推論平台,透過單一端點提供超過 300 種影片與多模態模型存取,是研究多模型架構的絕佳參考。

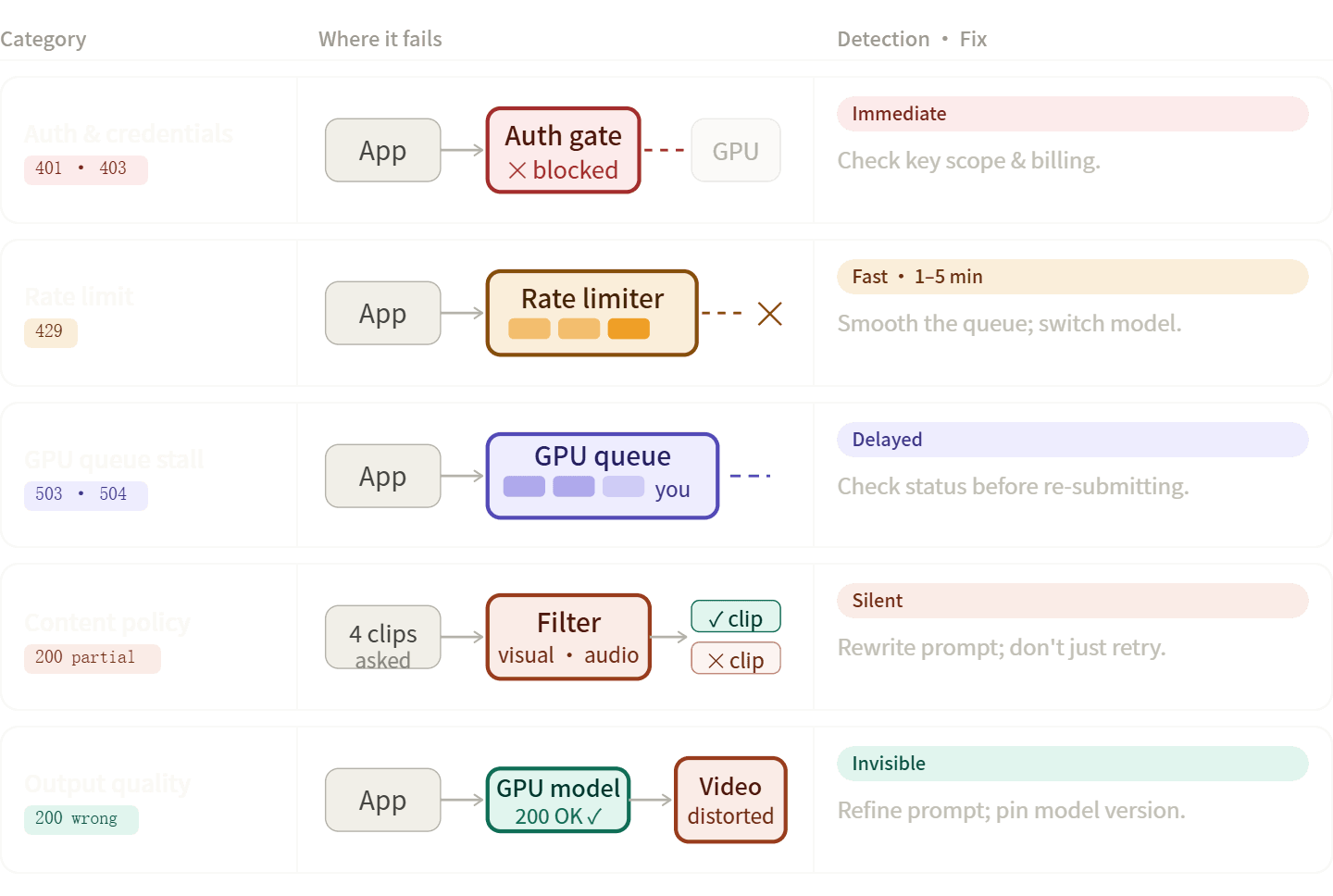

五大 AI 影片 API 錯誤類別

AI 影片管道錯誤通常可歸納為五大類。了解錯誤歸屬的類別有助於您更快速地解決問題,例如修正程式碼、重寫提示詞(Prompt),或僅僅是等待。

驗證與憑證錯誤 (401, 403)

| 代碼 | 典型原因 | 解決方法 |

| 401 Unauthorized | 缺少或格式錯誤的 Authorization: Bearer 標頭 | 檢查金鑰是否從環境變數載入,而非寫死在程式碼中 |

| 403 Forbidden (配額) | API 點數耗盡 | 綁定帳單或升級方案 |

| 403 Forbidden (權限) | 金鑰缺少所請求模型的權限範圍 | 使用正確權限重新生成金鑰 |

人們常在此混淆。因達到配額限制而出現的 403 與因權限被拒而出現的 403 使用相同的代碼,但需要不同的修正方法。不要只看狀態數字,務必閱讀完整回應主體中的錯誤訊息,以釐清問題所在。

在 Atlas Cloud 這類平台上,單一 API 金鑰可涵蓋所有模型,這意味著「驗證漂移」(即提供者 A 的金鑰可用,但提供者 B 的金鑰已過期)的情況不會發生。

速率限制錯誤 (429)

影片 API 的速率限制比文字 API 更嚴苛,因為每個請求都會佔用一個 GPU 插槽 30–90 秒。少量的併發請求可能就會觸及帳面上看起來相當寬裕的限制。

首先要檢查的關鍵區別:

- RPM (每分鐘請求數): Google Veo 3.1 API 生產模型允許 50 RPM;預覽模型限制為 10 RPM,每個專案最多 10 個併發請求。

- 併發請求限制: 即使在您的 RPM 配額內,觸及併發上限也會導致 429 錯誤。

- TPM (每分鐘 Token 數): 在影片 API 中較少見,但在提供跨模態統一計費的平台上則相關。

真正有用的策略:

| 方法 | 適用場景 | 不適用場景 |

| 指數退避 + 重試 (Exponential back-off) | 由瞬間突發流量引起的 429 | 當併發數是實際上限時 |

| 突發流量平滑處理 / 請求佇列 | 大量批次處理管道 | 互動式、對延遲敏感的 UX |

| 離峰排程(隔夜批次處理) | 內容預生成工作流程 | 即時生成 |

| 模型路由至較低負載的變體 | 具有多個同類模型的統一平台 | 單一提供者架構 |

內容政策與安全過濾器拒絕

這類問題容易誤判,因為 API 回應未必是明確的錯誤,可能只是回傳了比您要求的還少的片段。Google 的 Veo 文件明確指出,如果回傳的影片數少於請求數,部分輸出可能已被安全過濾器攔截,而非請求在傳輸層發生故障。

兩個明顯的觸發點:

- 視覺提示: 主題、場景脈絡,或暗示性的暴力/成人內容。

- 音訊/對話提示: 語音內容、歌曲請求及複雜的音效景觀會觸發獨立的過濾堆疊。

如果您的片段僅在包含音訊提示時失敗,請將音訊與視覺場景分開進行除錯。對於被政策攔截的提示詞,單純重試通常無法解決,必須調整提示詞本身。

傳輸與基礎設施錯誤 (500, 503, 504)

| 代碼 | 典型解決時間 | 應對建議 |

| 429 RESOURCE_EXHAUSTED | 1–5 分鐘 | 退避後重試 |

| 503 Service Unavailable | 30–120 分鐘 | 等待;查看狀態儀表板 |

| 504 Gateway Timeout | 不定 | 在重新提交前,先檢查渲染是否仍在進行 |

| 500 Internal Server Error | 不定 | 記錄預測 ID;在檢查狀態前切勿自動重試 |

處理 500/504 錯誤的黃金法則:在重新提交前,務必檢查渲染是否仍在進行中。盲目地對 504 錯誤進行重試可能導致重複渲染並造成費用加倍。

輸出品質失效

這些並非 HTTP 錯誤,API 會回傳 200,但輸出內容是錯誤的。常見情況包括:

- 視覺偽影或幾何不精確: AI 影片具有機率性。模型是詮釋輸入,而非進行物理計算。

- 支援模型中缺少音訊: 通常是提示詞或參數問題,而非基礎設施故障。

- 持續時間或解析度錯誤: 由不支援的組合引發,並非所有模型都支援所有的持續時間/解析度組合。

- 管道靜默丟失: 部分編碼管道會靜默丟棄特定格式下的影片,直到 QA 階段才被發現。

讀取非同步回應:預測 ID 與狀態輪詢

AI 影片生成設計上是非同步的。請求-回應週期分為兩個階段:

- POST 到生成端點 → 獲得 prediction_id

- GET 結果端點並帶入該 ID → 輪詢直到達到終止狀態

Atlas Cloud 的回應結構描述說明了完成預測後的情形:

plaintext1{ 2 "id": "pred_abc123", 3 "status": "completed", 4 "model": "bytedance/seedance-2.0/text-to-video", 5 "outputs": ["https://storage.atlascloud.ai/outputs/result.mp4"], 6 "metrics": { "predict_time": 45.2 }, 7 "created_at": "2025-01-01T00:00:00Z", 8 "completed_at": "2025-01-01T00:00:45Z" 9}

三種終止狀態:

| 狀態 | 意義 | 操作建議 |

| completed | 渲染成功;輸出可用 | 在過期期限內下載 |

| failed | 渲染失敗;請檢查 error 欄位 | 記錄錯誤訊息;決定是否重試 |

| expired | 輸出已過期,無法取得 | 若仍需要請重新提交 |

最常見的輪詢錯誤

開發者經常會檢查狀態是否為 "failed",卻從未閱讀隨後出現的 error 欄位。該欄位包含可操作的資訊,若忽略它,您只知道渲染失敗,卻無法判斷該修正提示詞、檢查配額,還是等待基礎設施故障恢復。

適合生產環境的輪詢模式

plaintext1import time 2import requests 3 4def poll_prediction(prediction_id: str, api_key: str, max_wait: int = 600) -> dict: 5 url = f"https://api.atlascloud.ai/api/v1/model/prediction/{prediction_id}" 6 headers = {"Authorization": f"Bearer {api_key}"} 7 terminal_states = {"completed", "failed", "expired"} 8 wait = 5 9 10 for _ in range(max_wait // wait): 11 resp = requests.get(url, headers=headers).json() 12 status = resp.get("status") 13 14 if status in terminal_states: 15 if status == "failed": 16 print(f"渲染失敗: {resp.get('error')}") 17 return resp 18 19 time.sleep(wait) 20 wait = min(wait * 1.5, 60) # 退避上限設為 60 秒 21 22 raise TimeoutError(f"預測 {prediction_id} 未能在 {max_wait} 秒內完成")

請記錄每次完成渲染的 metrics.predict_time。此數值的激增是基礎設施退化的主要指標,在您看到明顯故障前這是非常有用的訊號。

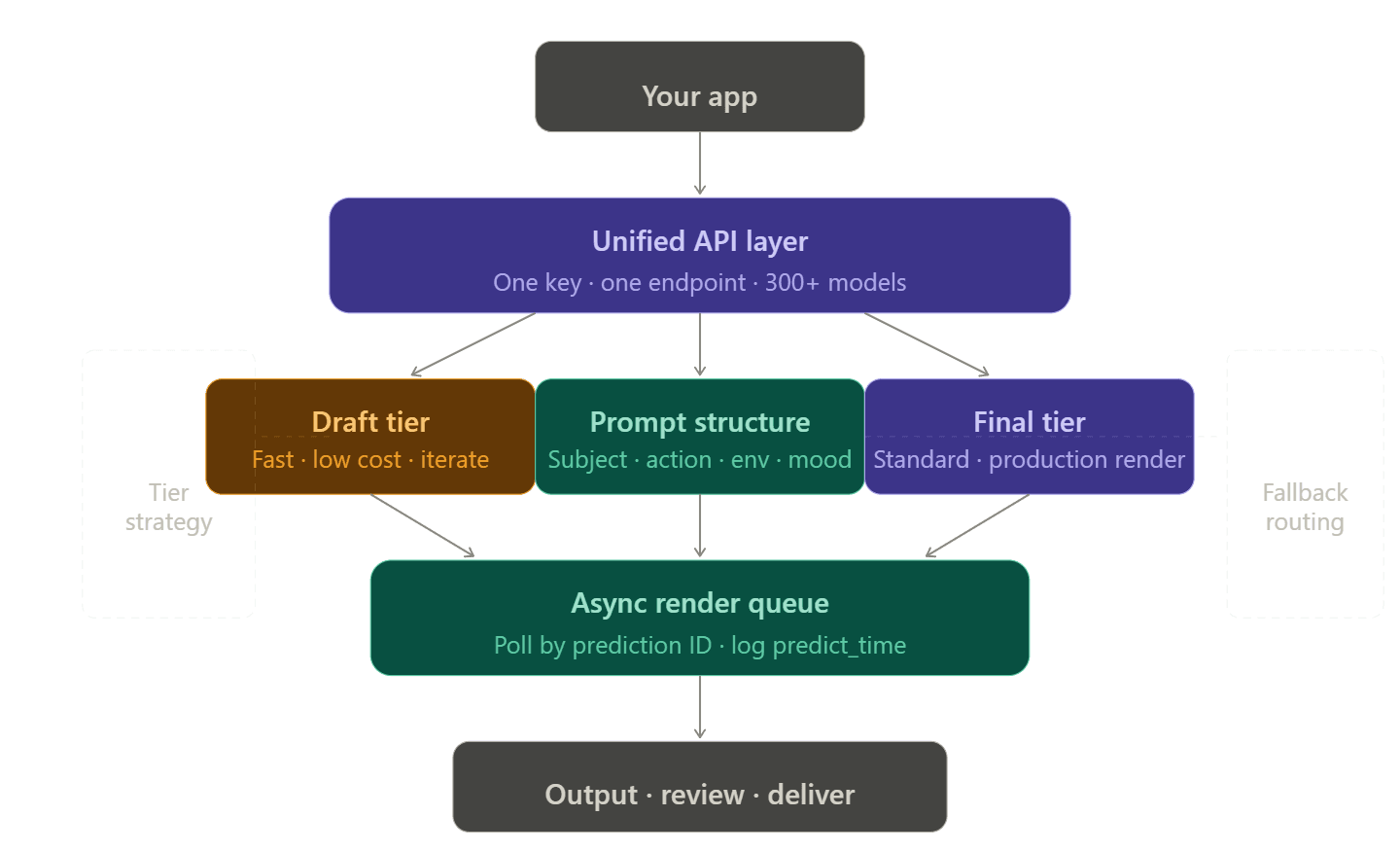

構建彈性的渲染管道

單一供應商 vs. 統一 API 架構

為每個影片提供者管理多個帳號、Token 和帳單頁面是非常痛苦的,開發者通常稱此為「整合稅」。情況會迅速惡化:如果某個模型達到限制,您需要備援。該備援服務接著又需要自己的 API 金鑰、帳單設定以及處理錯誤的自訂程式碼。

統一 API 平台透過單一端點路由多個提供者,消除了這些麻煩。在 Atlas Cloud 上,從 openai/sora-2/text-to-video 切換至 bytedance/seedance-2.0/text-to-video 只需要更改一個字串,標頭、驗證和帳單保持不變。

草稿至成品的分級策略

在成本與可靠性方面,最有效的改善方式之一就是為工作流程的各個階段選擇正確的模型層級:

| 階段 | 建議層級 | 原因 |

| 提示詞探索 / 概念測試 | 快速 / 經濟層級 | 比標準版節省 78% 以上成本;錯誤易於浮現 |

| 內部審閱草稿 | 快速層級 | 足以應付利害關係人審閱 |

| 最終生產渲染 | 標準 / Pro 層級 | 品質差異足以證明其成本合理 |

| 批次內容(社群媒體、行銷) | 快速層級 | 大量生成下成本差異顯著 |

在 Atlas Cloud 上,Seedance 2.0 的「快速」層級運作成本為 $0.081/秒,相較標準版的 $0.10/秒 — 這種差異在擴大規模時會迅速累積。團隊若每月生成 200 個 10 秒片段,使用「快速」版需花費 $162,而標準版則需 $200,且產生相同的提示詞結果。

提示詞工程作為錯誤預防

模糊的提示詞是管道失敗的主因。像「一個人走路」這樣的提示詞強迫模型做出太多隨意選擇,產生不一致的輸出,進而需要更多次重試。

可靠的 4 元件提示詞結構:

plaintext1[主體 + 細節] + [動作 + 動作風格] + [環境 + 光影] + [鏡頭 + 氛圍] 2 3範例: 4"一名穿著紅色外套的女性,夜晚快步穿過下過雨後的東京街道, 5霓虹燈映射在潮濕路面上,中景追蹤鏡頭,電影感且緊張"

使用支援多模態輸入的模型(例如 Seedance 2.0 接受最多 12 個參考檔案,包括影像、影片片段及音訊),提供視覺參考可減少導致輸出品質失敗的模糊性。

選擇正確的模型

並非所有 AI 影片工具的失敗原因都相同,因為它們的目標不同。將錯誤的模型用於特定任務是大忌。這會導致看起來像技術故障的劣質結果,但通常只是因為模型設計初衷並非用於該工作。

模型能力參考

| 模型 | 優勢 | 注意事項 | 定價 (Atlas Cloud) |

| wan 2.7 | 物理模擬,真實的物體互動 | 僅支援單一圖像參考;成本較高 | $0.1/秒 |

| Kling 3.0 | 高解析度輸出;原生口型同步;免費層級(每日 66 點數) | 最大解析度下生成時間較長 | $0.071-0.143/秒 |

| Veo 3.1 | 電影級畫質;強大的安全性合規性 | 預覽模型速率限制 (10 RPM) | $0.05–0.20/秒 |

| Seedance 2.0 | 多參考輸入控制;原生音訊 | 需要更細緻的提示詞結構 | $0.081–0.10/秒 |

| Wan 2.6 | 最低成本;大量內容生成 | 無原生音訊;最高 1080p | $0.018-0.07/秒 |

定價資訊來自 Atlas Cloud 文件,截至 2026 年 4 月。關於具體定價,請參考官方網站。

何時該切換模型 vs. 修正請求

若符合下列情況,請切換模型:

- 當提示詞包含音訊或對話時,片段持續失敗,可能該模型缺乏音訊能力

- 失敗主因是物理模擬或物體互動品質不佳,而非提示詞問題

- 您正在使用預覽模型,且觸發了生產模型不會有的速率限制

若符合下列情況,請修正提示詞:

- 風格不正確,但結構正確

- 安全過濾器因特定用語觸發

- 持續時間或解析度參數被拒絕

鎖定特定的版本字串(例如 kling-v3.0-std 而非 kling-latest)。無聲的模型更新可能會引入難以除錯的品質衰退,除非進行版本鎖定。

您的除錯工具箱

在每個階段應記錄什麼

記錄(Logging)是將除錯時間減半的最快方法。有效的最低限度記錄應包含:

請求時:

- 模型 ID 與版本

- 提示詞雜湊值(Hash),而非完整提示詞 — 可保持日誌簡潔

- 持續時間、解析度與模式參數

- 時間戳記

回應時:

- 預測 ID

- 初始狀態

- 任何立即性的錯誤訊息

輪詢完成時:

- 最終狀態

- metrics 中的 predict_time

- error 欄位內容(若失敗)

- 輸出 URL(若完成)

讀取基礎設施與應用程式錯誤

當生成失敗時,快速的診斷序列可節省時間:

- 先檢查 API 健康狀況儀表板 — 如果平台狀態不良,您除錯的方向就是錯誤的。

- 閱讀 x-deny-reason 回應標頭 — 出口代理拒絕(Egress proxy denials)會顯示於此,若無此標頭,它們看起來會像模型錯誤。

- 若從前端呼叫,檢查 CORS 錯誤 — 它們在瀏覽器 DevTools 中產生的症狀與驗證失敗相同。

- 在假設是模型錯誤前驗證檔案限制 — 多數平台會強制執行最大輸入檔案大小(通常為 16 MB)與有限的接受格式。

Atlas Cloud 的監控面板會顯示自動縮放狀態與每個請求的用量數據,這有助於區分是基礎設施慢速的一天,還是提示詞或程式碼的問題。

成本優化

三大槓桿

渲染成本是三個變數的乘積。同時優化這三個變數 — 而非僅選擇較便宜的模型 — 才能達到最大的節省效果:

| 槓桿 | 低成本選擇 | 高成本選擇 | 典型乘數 |

| 模型層級 | 快速 (Fast) | 標準/Pro | 3–5 倍 |

| 持續時間 | 4–5 秒 | 12–15 秒 | 3 倍 |

| 解析度 | 720p | 4K | 2–4 倍 |

單次 8 秒的 4K 標準渲染成本可能比同樣時間的「快速」720p 渲染高出 6–8 倍。若您的分發通路是社群媒體或網頁,終端使用者通常分辨不出 720p 或 1080p 的差異。

用量計費 vs. 訂閱計費

消費者 AI 方案(例如每月 $19.99 的 Google AI Pro 或 $249.99 的 AI Ultra)透過 Google AI 介面提供有限的影片生成功能,但不包含 API 存取權。這是團隊從消費者工具轉換至生產管道時常見的預算規劃錯誤。

Atlas Cloud 使用用量計費,讓您的成本與實際構建量掛鉤。如果您的專案需求每週都在變動,這種方式最為合適。您應追蹤每秒成品的成本,這是公正比較不同模型與定價層級的最佳方式。

參考資源重複使用

如果您生成許多具有相同角色、場景或風格參考的片段,請預先註冊這些資源:

- 上傳參考圖像或影片一次;儲存回傳的資源 ID

- 在後續請求中傳遞 asset://<ark_asset_id>,而非重新上傳

- 多數平台對參考檔案上傳不收費 — 僅計費生成的輸出持續時間

生產準備檢查清單

在將影片生成管道發布至生產環境前,請驗證以下各項:

驗證

- API 金鑰從環境變數載入,非寫死在程式碼中

- 金鑰對所使用的所有模型具備正確權限範圍

- 已建立金鑰輪替政策

速率限制與併發

- 已確認每個模型層級的 RPM 與併發請求限制

- 批次工作流程已導入突發流量平滑處理或佇列

- 已設定速率限制狀況下的備援模型

錯誤處理

- 所有終止狀態(completed, failed, expired)均已處理

- 每次失敗狀態均已擷取並記錄 error 欄位

- 長時間渲染的子程序/請求逾時設定為 ≥ 10 分鐘

- 在未先檢查狀態的情況下,不會盲目自動重試 500/504 錯誤

內容與提示詞

- 提示詞已根據平台內容指南預先審閱

- 音訊與視覺觸發點已在測試中隔離

- 已採用 4 元件提示詞結構作為團隊標準

模型設定

- 已鎖定特定版本字串(而非 latest)

- 模型層級與工作流程階段相符(草稿用 Fast,成品用 Standard)

- 已確認所選模型的所有必要參數(持續時間、解析度、音訊)

成本控管

- 用量計費儀表板已配置警示

- 所有非最終渲染預設使用 Fast 層級

- 重複使用的資源已使用參考資源 ID

可觀察性

- 每次渲染均記錄預測 ID、狀態與 predict_time

- API 健康狀況儀表板已加入書籤,並在深度除錯前檢查

- 已設定 predict_time 激增警示

一個具備錯誤處理能力的影片管道,其建置難度並不比一個容易崩潰的管道高出多少。您只需要在處理每個步驟的失敗時聰明一些。確保您的日誌記錄紮實並堅持使用特定模型版本。在擔心其他事情之前,先設定一個能從快速草稿順利過渡到最終渲染的管道。其餘的自然會水到渠成。

常見問題 (FAQ)

專業方案中的 429 Resource Exhausted 錯誤是由什麼引起的?

429 錯誤僅代表您已達到速率限制。為了保持運作順暢,提供者會限制您的請求數與 Token 量。

- 解決方法: 在程式碼中加入指數退避 (Exponential back-off)。這有助於系統自動等待並重試。同時檢查儀表板中的「使用層級」,您需要投入更多資金才能解鎖更快的速度。

如何避免「內容審查」的誤判?

安全過濾器經常將技術性提示詞誤解為政策違規。

- 解決方法: 用技術術語取代模糊字詞來修正提示詞。當您想表達「高速鏡頭移動」時,不要說「混亂的能量」。您也可以使用 LLM 來清理提示詞,將它們轉換為機器能理解的明確描述,從而避免錯誤。

如何減少渲染管道的延遲?

延遲通常來自糟糕的輪詢或過大的模型尺寸。請使用 Webhook 取代手動輪詢以接收完成數據。若為自行架設,應用 FP8 量化以加速推論。對於 API 使用者,請切換至非同步處理以並行處理多個生成任務,而非序列處理。