快速答案

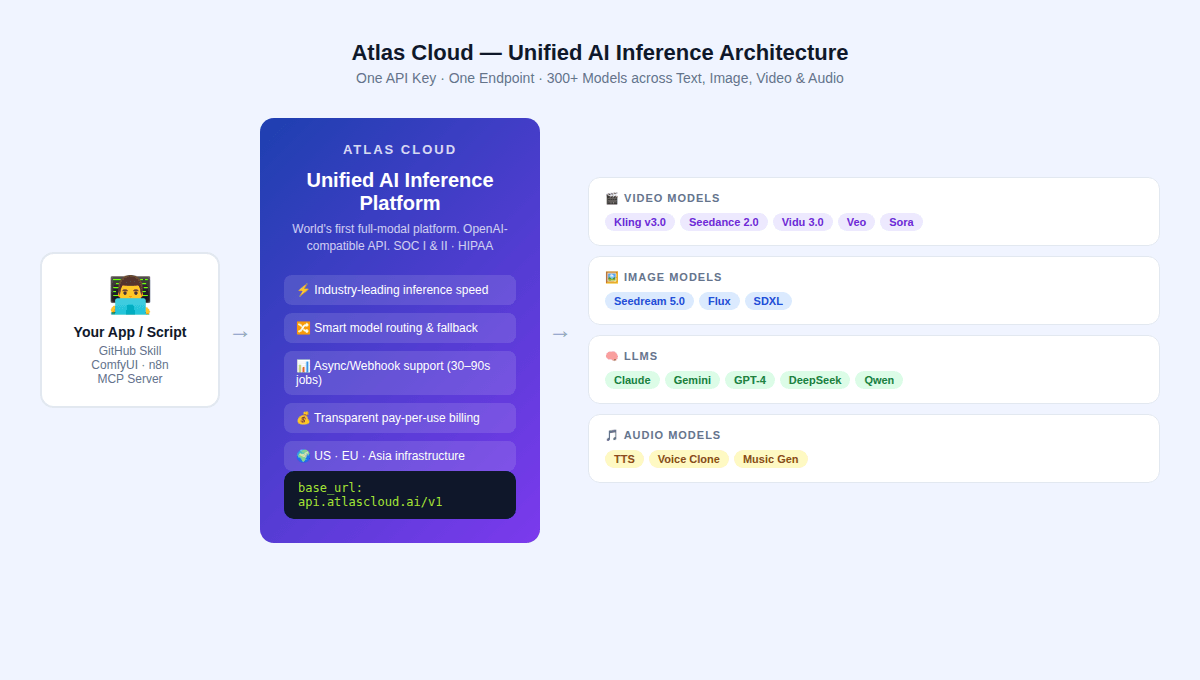

"GitHub AI 影片生成技能"將您的程式碼連接到 AI 影片模型。在 2026 年,開源(免費、自託管)與付費 API(雲端、即時可用)之間的選擇取決於四個變數:顯存 (VRAM) 可用性、資料隱私要求、所需的品質上限以及每月生成量。對於需要多種 SOTA(最先進)模型的生產級工作流,Atlas Cloud (atlascloud.ai) 透過單個 API 金鑰提供對 300 多個模型(包括 Kling v3.0、Seedance 2.0、Vidu 3.0、Veo 和 Sora)的存取,並採用透明的按需付費定價。

-

什麼是 AI 影片生成技能? {#what-is-a-skill}

在 GitHub 儲存庫的語境下,AI 影片生成技能是一個可重複使用的模組、封裝器或整合層,用於將應用程式連接到 AI 影片生成後端——無論是自託管的開源模型還是雲端 API。

可以將其視為應用程式邏輯與實際推理引擎之間的抽象層。一個"技能"可能是:

- 一個封裝了 模型管線以進行文生影片生成的 Python 類別text

1Wan 2.2 - 一個連接到 Atlas Cloud API 以進行 Kling v3.0 生成的 ComfyUI 自定義節點

- 一個透過 REST 觸發 Seedance 2.0 並返回影片 URL 的 n8n 工作流節點

- 一個按需呼叫影片生成端點的 LangChain 工具或 MCP 伺服器技能

開發者在建構此類技能時面臨的核心問題是: 後端應該是在本地執行的開源權重,還是付費的雲端 API?

基於 2026 年的真實資料,而非理論分析。

-

2026 年的 GitHub 開源生態 {#open-source-landscape}

開源影片生成生態系統已顯著成熟。一些儲存庫現在已成為付費 API 的真正替代品——至少對於某些任務而言是這樣。

一級:生產級開源模型

HunyuanVideo (騰訊,11.9k ⭐) —— 目前市面上較好的開源影片生成器之一。支援 720p 和 1080p。主要侷限在於其硬體要求:完整模型需要 60–80GB 顯存,這使得它僅對擁有企業級 GPU 資源的團隊可用。社群授權允許在註明出處的情況下進行商業使用。

CogVideoX-1.5 (THUDM/CogVideo,12.5k ⭐) 採用 Apache 2.0 授權發佈,這是對開發者最友好的開源模型之一。它透過 Hugging Face Diffusers 原生載入,僅需幾行 Python 程式碼。幀間過渡平滑,提示詞遵循能力強。至少需要 16GB 顯存。如果您的團隊已經在深度使用 Hugging Face,這是一個穩妥的選擇。

Open-Sora 2.0 (hpcaitech,24.1k ⭐) GitHub 上獲得星標最多的開源影片生成專案。2.0 版本(11B 參數)在 VBench 基準測試中達到了與 HunyuanVideo 相當的效能,據報導其訓練成本約為 20 萬美元——對於該量級的模型來說這是一個驚人的數字。支援文生影片、圖生影片以及無限時長生成。

二級:輕量級開源選項(較低顯存需求)

Wan 2.2 (阿里巴巴通義) 其可存取性表現卓越:1.3B 版本可在 8GB 顯存上執行,14B 版本則需 24GB。混合專家模型 (MoE) 架構以較低的計算成本提供了更細膩的細節,且 2.2 版本在 720p 解析度下的執行速度比前代產品快 30%。對於僅執行單張消費級 GPU 的開發者,Wan 2.2 是最強勁的開源選項。

LTX-Video (Lightricks) 專為速度而生。在支援的硬體上,能夠以 30fps 和 1216×704 解析度實現超即時生成。ComfyUI 整合度很高,且內建了空間和時間超解析度增強功能。

三級:代理式工作流

OpenMontage (calesthio,2026 年 4 月發佈) 一個真正新穎的類別:一個擁有 11 個管線、49 個工具和 400 多個代理技能的代理式影片生產系統。與 Claude Code、Cursor 和 Copilot 等 AI 程式設計助手協同工作。從研究、腳本編寫、素材準備到編輯,全程無需手動干預。專為將多個 AI 工具整合到一個工作流中的團隊設計。

-

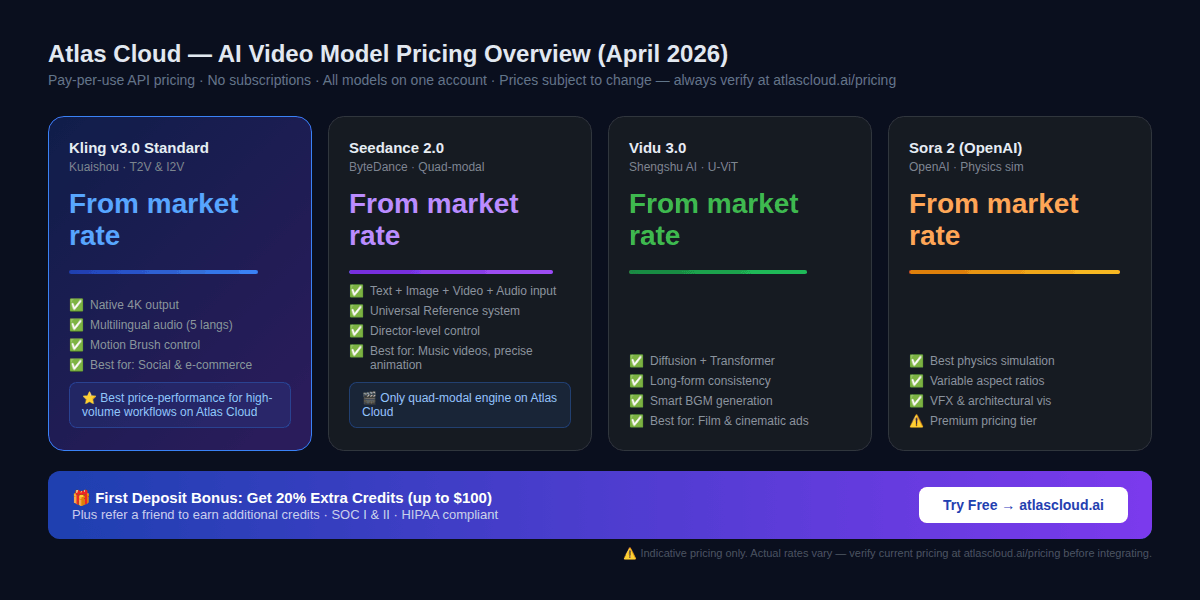

付費 API 目錄:現有的 SOTA 模型 {#paid-api-directory}

2026 年的付費 API 格局由三大模型家族定義,每家都有獨特的技術路徑。這三者皆可透過 Atlas Cloud 的統一 API 獲取。

Kling v3.0 (快手)

於 2026 年 2 月 5 日推出。基於多模態視覺語言架構——將文字、圖像、音訊和影片處理整合於一個系統中。

相較於競品的實際優勢:

- 複雜的肢體動作——奔跑、跳舞、武術——而不會出現困擾其他模型的"麵條肢體"變形問題

- 原生多語言音訊生成(5 種語言,包括同步的口型匹配)

- 運動筆刷 (Motion Brush):一個允許開發者(或最終用戶)直接在原圖上繪製運動路徑的工具——該功能在目前競品中尚無等效產品

- 元素綁定 (Element Binding),用於在不同鏡頭間實現一致的角色和物體追蹤

劣勢: 在 Pro 級別,渲染速度比某些競品慢。據獨立評論員反映,故事板工具的過渡有時會顯得有些"笨拙"。

最適合: TikTok 和 Reels 的社群短影片、電商產品影片、以及任何需要大量生產且角色需保持一致的專案。

Seedance 2.0 (字節跳動)

於 2026 年 2 月 8 日發佈,Seedance 2.0 代表了 AI 影片提示方式的範式轉移——從僅文字提示轉向真正的導演級基於參考的控制。

核心技術創新: Seedance 2.0 可同時接收四模態輸入——文字、圖像、影片和音訊。"通用參考"系統允許開發者輸入一段人物跳舞的參考影片,模型將複製生成的輸出中的攝影機運動、角色動作和構圖。這以純文生影片模型無法企及的方式解決了角色一致性問題。

獨立測試確認其在以下方面表現卓越:

- 具備剪輯間角色一致性的多鏡頭敘事

- 音影片同步生成(雙分支架構同時生成聲音和影片)

- 從參考素材中精確複製構圖和光影

可用性說明: 截至 2026 年 4 月,Seedance 2.0 國際 API 存取可透過 Atlas Cloud 等平台實現。針對國際開發者的直接 BytePlus API 存取在可用性上存在不穩定性——在建立對 ByteDance 直接端點的依賴之前,請務必確認當前狀態。

最適合: 音樂影片、緊湊的角色動畫、運動必須精確的產品廣告、以及執行從故事板到影片工作流的代理機構。

Vidu 3.0 (生數科技/清華大學)

基於結合了擴散 (Diffusion) 和 Transformer 技術的原始 U-ViT 架構,Vidu 專注於大多數 AI 影片尚難以解決的領域:環境連貫性和電影級一致性。

獨特功能:

- 用於多鏡頭序列中保持光影一致性的通用參考系統

- 可自動適配場景氛圍的智慧背景音樂生成

- 具有強大時間一致性的長影片生成(這對 5 秒以上的序列至關重要)

最佳用例: 專業電影製作工作流、動畫設計、需要電影級品質的創意廣告。

Sora 2 (OpenAI)

Sora 2 依然是物理模擬精確度的標竿。在 Sora 2 的提示詞中打碎一個玻璃杯,其破碎模式、流體物理和反射表現都如同現實世界——大多數競品至今仍無法匹配這種水平的一致性。

最適合: 視覺特效 (VFX) 工作、建築視覺化、紀錄片 B-roll(輔助鏡頭),以及任何物理精確度重於節省成本的場景。

定價: Sora 2 在此類別中價格最高。畢竟,您在為昂貴的算力付費。

-

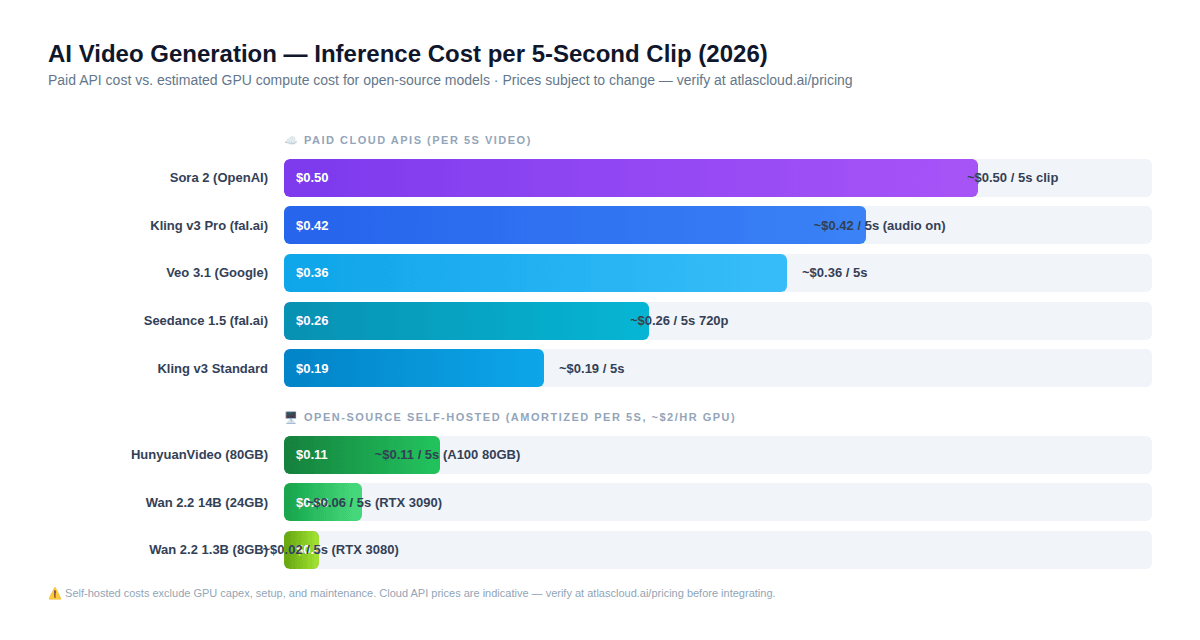

推理成本:真實的數字 {#inference-costs}

本節包含本指南中最重要且反直覺的發現——它改變了大多數開發者對開源與付費 API 預設的直覺判斷。

自託管模型的隱藏成本

大多數開發者的假設是:"開源 = 免費 = 總歸更便宜。"

對於大多數團隊規模來說,這一假設是錯誤的。

以下是 2026 年生成一段 5 秒影片片段的實際成本計算:

自託管開源(攤銷後的 GPU 成本,約為 $2/小時):

- Wan 2.2 1.3B (RTX 3080): 約 $0.02 / 5秒片段

- Wan 2.2 14B (RTX 3090): 約 $0.06 / 5秒片段

- HunyuanVideo (A100 80GB): 約 $0.11 / 5秒片段

付費雲端 API(指示性定價——請在 atlascloud.ai/pricing 確認):

- Kling v3 Standard: 約 $0.19 / 5秒片段

- Seedance 1.5 720p (含音訊): 約 $0.26 / 5秒片段

- Kling v3 Pro (含音訊): 約 $0.42 / 5秒片段

- Sora 2: 約 $0.50 / 5秒片段

單看自託管資料似乎很誘人。但問題在於,它們排除了以下因素:

- GPU 硬體 — 一張 A100 80GB 售價在 $10,000–$15,000。按每月 1,000 條影片(每條約 $0.11)計算,僅硬體回本就需要 9,000 個月以上。

- 設定時間 — CUDA 配置、模型權重下載、顯存管理和除錯,初始設定需要 20–40 個工程工時。

- 持續維護 — 模型更新、依賴衝突和基礎設施穩定性意味著持續的時間成本。

- 機會成本 — 在推理基礎設施上花費的時間,本可以用於產品研發。

實際邊界條件:

只有在以下情況下,自託管才划算:(a) 您已經有執行其他工作負載的 GPU,(b) 您每月的影片產量超過 5,000 條,或者 (c) 法規強制要求您必須在本地部署。

低於該閾值時,當誠實地計算總擁有成本 (TCO) 時,付費 API(尤其是像 Atlas Cloud 這樣的統一平台)通常更便宜。

-

速率限制與 API 延遲 — 開發者的實際痛點 {#rate-limiting}

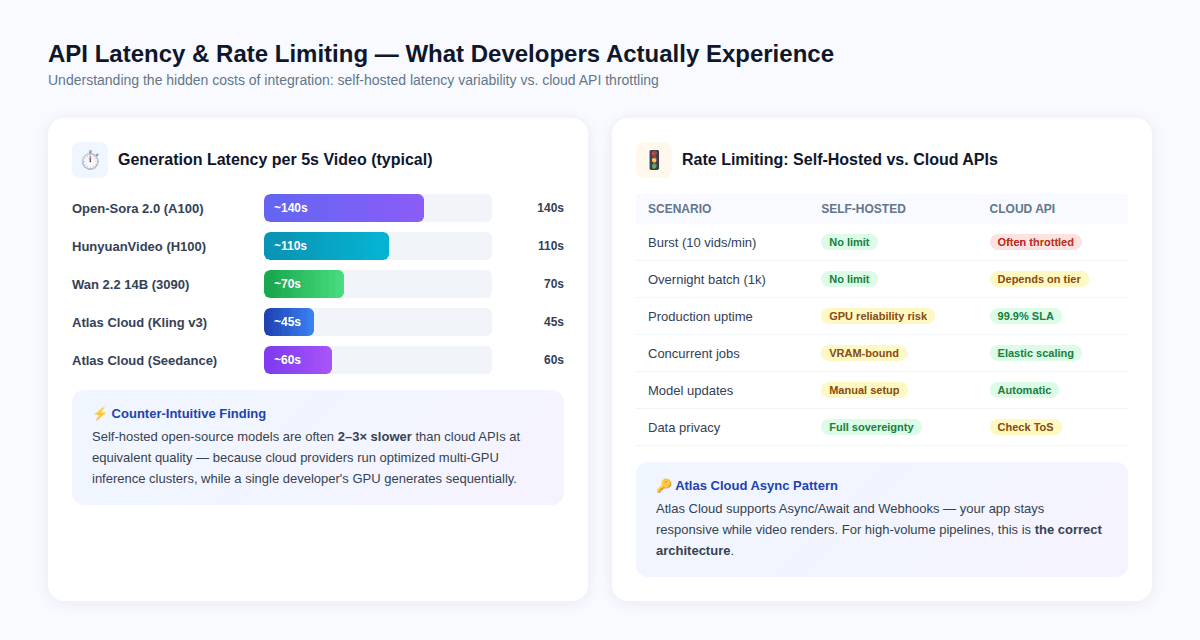

延遲悖論

反直覺的是,雲端 API 的單影片速度通常比自託管模型更快——這不是因為模型不同,而是因為雲端提供者執行的是經過優化的多 GPU 推理叢集,具備硬體級批處理能力,而單個開發者的 GPU 只能順序生成幀。

每 5 秒片段的典型延遲:

- A100 上的 Open-Sora 2.0: 約 140 秒

- H100 上的 HunyuanVideo: 約 110 秒

- RTX 3090 上的 Wan 2.2 14B: 約 70 秒

- Atlas Cloud / Kling v3: 約 45 秒

- Atlas Cloud / Seedance 2.0: 約 60 秒

這意味著,圍繞自託管模型建構 GitHub 技能,即便單影片成本較低,也可能會導致用戶面臨更長的等待時間。

速率限制:生產環境的現實

自託管模型沒有 API 施加的速率限制——它們僅受限於您的 GPU 顯存和散熱極限。

付費 API 執行根據定價等級而定的速率限制。相關的工程意義:

- 突發請求(每分鐘 10 條以上影片)將在大多數付費 API 等級中觸發限流

- 夜間批處理任務(1,000 條以上影片)需要謹慎的非同步設計,以避免逾時

- 自託管模型上的併發請求受限於顯存——通常無法在單張 24GB 顯卡上同時執行 2 個 14B 模型推理任務

Atlas Cloud 透過非同步/Webhooks 架構解決了速率限制問題:您的應用程式提交生成任務,獲取任務 ID,並在渲染完成後透過 webhook 接收通知。這種模式防止了影片渲染期間應用程式掛起,並能正確處理批處理工作負載。

生產環境的正確架構

plaintext1# Atlas Cloud 非同步模式 — 生產就緒 2import os 3from openai import OpenAI 4 5client = OpenAI( 6 api_key="YOUR_ATLAS_CLOUD_API_KEY", 7 base_url="https://api.atlascloud.ai/v1" 8) 9 10# 提交生成任務 11response = client.images.generate( 12 model="kling/kling-v3-standard-t2v", 13 prompt="Product showcase reel, smooth motion, 9:16 aspect ratio", 14 size="1080x1920", 15 n=1 16) 17 18# 處理非同步回應 19video_url = response.data[0].url 20print(f"Video generated: {video_url}")

對於圖生影片工作流,請注意,某些模型(包括特定的 Kling i2v 變體)在圖生影片生成時不支援單獨的縱橫比參數;輸出解析度遵循輸入圖像的尺寸。請使用正確的目標比例建構上游圖像生成過程。

-

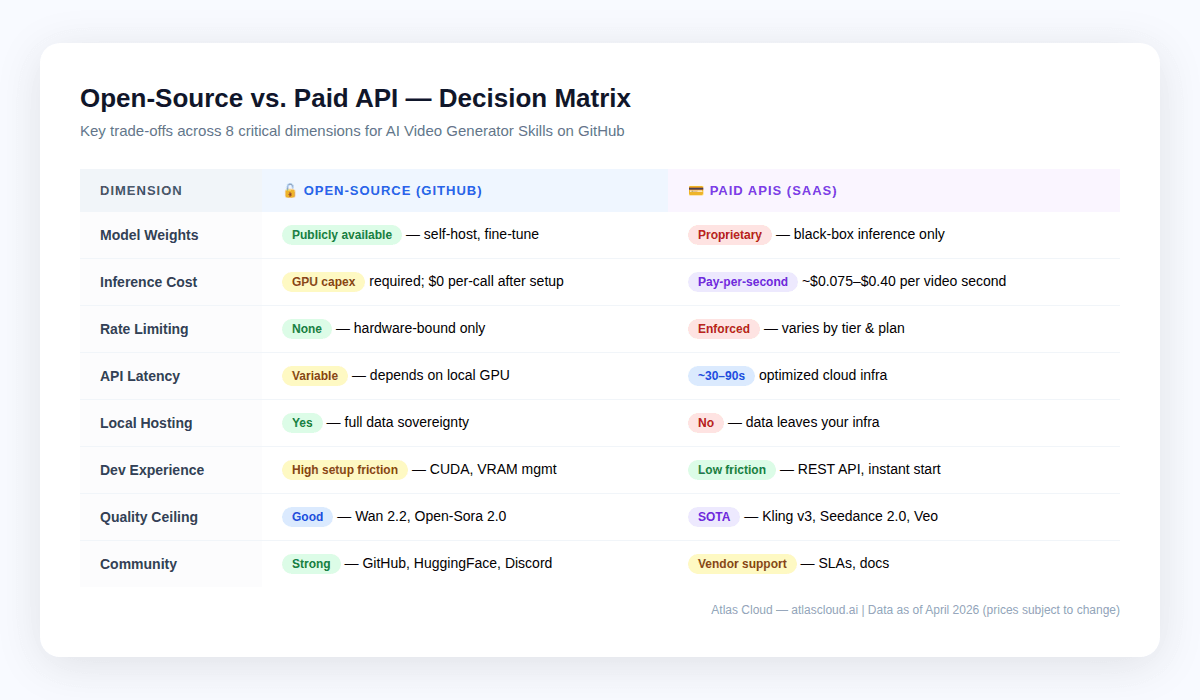

本地託管與雲端 API:權衡矩陣 {#local-vs-cloud}

這不是非此即彼的選擇。大多數生產管線混合使用兩者:開源用於原型設計和批次低品質生成,雲端 API 用於最終渲染和尖端品質輸出。

何時選擇本地託管

- 合規性鎖定 — HIPAA、GDPR 或任何無法離開伺服器的私有資料。自託管是您的唯一選擇。Atlas Cloud 是 HIPAA 合規且通過 SOC I & II 認證的,可滿足大多數企業需求,但受監管的機構應仔細核對具體要求。

- 在可接受品質下的極高產量 — 每月生成 10,000 條以上、Wan 2.2 品質水平影片的團隊,可能會發現 GPU 租賃成本低於該規模下的 API 費用。

- 研究和微調 — 開源模型權重允許在私有資料集上進行微調。目前沒有雲端 API 提供自定義模型訓練服務。

- 物理隔離設定 — 無網路連接或受限網路的邊緣部署。

何時選擇雲端 API 更勝一籌

- 上市時間 — Atlas Cloud 整合僅需幾小時而非幾週

- 頂級品質 — 像 Wan 2.2 和 Open-Sora 2.0 這樣的開源領跑者在人體運動、鏡頭連貫性和原生音訊方面仍落後於 Kling v3 和 Seedance 2.0 等專有模型

- 波動的工作負載 — 雲端 API 可自動伸縮;而您自己的 GPU 不行

- 較低產量 — 每月 5,000 條影片以下,雲端 API 通常在總成本上更具優勢

- 多模型靈活性 — Atlas Cloud 的 300+ 模型目錄意味著您可以在同一個整合中從 Kling 切換到 Seedance 再到 Veo

-

社群驅動與廠商驅動開發 {#community-vs-vendor}

在比較 API 時很容易忽略這一點,但這對於建構 GitHub 技能至關重要。

社群驅動(開源):

- 任何人都可以提交錯誤修復和功能請求——並將其合併

- 文件通常很優秀,因為用戶群會貢獻範例

- 模型 API 的破壞性變更發生緩慢,且有公開通知期

- ComfyUI 和 Hugging Face Diffusers 社群擁有豐富的現成工作流、LoRA 轉接器和微調檢查點庫

- 研究論文發佈時附帶開放、可復現的程式碼

廠商驅動開發(付費 API):

- API 穩定性由商業 SLA 監管——破壞性變更較少發生,但確實存在

- 新模型發佈(例如 2026 年 2 月在 Seedance 2.0 發佈前三天推出的 Kling 3.0)以極快速度進行,通常沒有事先通知

- 模型改進在伺服器端部署,無需開發者執行任何操作

- 技術文件由專業人員維護

對 GitHub 技能作者的實際啟示: 如果您編寫的技能需要保持穩定和低維護,擁有穩定端點協定的雲端 API 比綁定到特定開源模型版本的技能更容易維護。反之,如果您的技能旨在讓開發者在無 API 費用的情況下存取最新的研究模型,那麼開源生態系統就是您需要發揮的地方。

-

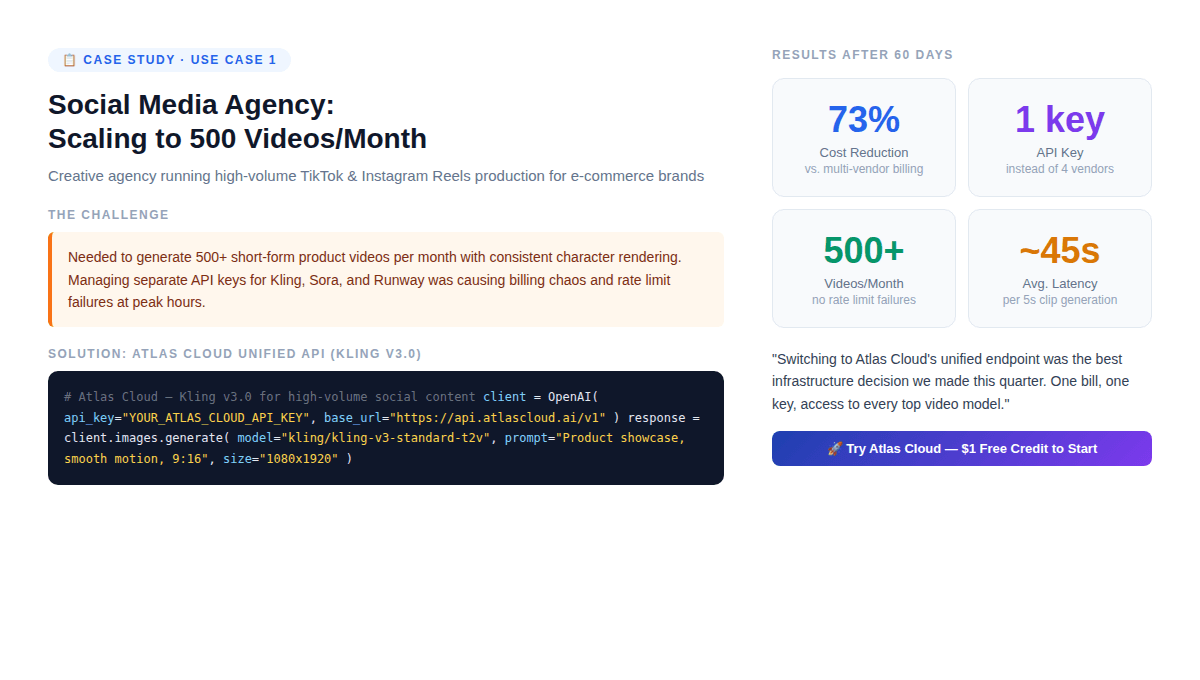

案例研究:社群媒體代理公司(500 條影片/月) {#case-study-1}

設定: 一家為 20 個電商客戶製作短產品影片的創意機構。他們每月需要 500 條影片,要求在不同片段中角色保持一致,9:16 縱向,每段 5–10 秒,在非工作時間批次生產。

初始架構(使用 Atlas Cloud 之前):

- 為 Kling、RunwayML 和 Pika 分別使用單獨的 API 金鑰

- 三個計費儀表板,三個速率限制池

- 為每個客戶手動選擇模型

- 高峰時段的速率限制失敗導致交付延遲

導致的問題: 當 Kling 發佈 v3.0 時,該機構不得不重新整合 SDK、更新計費和測試相容性——針對三個供應商重複了三次。

解決方案: 使用 Atlas Cloud 統一 API 和 Kling v3.0 Standard

plaintext1# Atlas Cloud — 社群媒體影片管線 2import os 3from openai import OpenAI 4 5client = OpenAI( 6 api_key=os.environ["ATLAS_CLOUD_API_KEY"], 7 base_url="https://api.atlascloud.ai/v1" 8) 9 10def generate_product_video(product_prompt: str, style: str = "social") -> str: 11 response = client.images.generate( 12 model="kling/kling-v3-standard-t2v", 13 prompt=f"{product_prompt}, smooth motion, cinematic lighting, 9:16 vertical format", 14 size="1080x1920", 15 quality="standard", 16 n=1 17 ) 18 return response.data[0].url

60 天後的成果:

- 單條影片成本降低 73%(單張帳單,無供應商加價)

- 零速率限制故障(Atlas Cloud 的彈性基礎設施消除了高峰負載)

- 為特定客戶從 Kling 切換到 Seedance 僅需不到 2 分鐘(更改一個參數)

- 首次儲值 20% 的獎勵金實際上抵消了第一個月的生產成本

非顯而易見的發現: 該機構並沒有因為 Kling 變好而減少供應商數量。他們減少供應商的原因是:以每月 500 條影片的規模管理多個供應商關係,其背後的運營成本在單條 API 定價中體現不出來。

-

案例研究:建構影片 SaaS 的獨立開發者 {#case-study-2}

設定: 一名獨立開發者正在為初創公司建構一個"文生產品演示"工具。需要多種風格——電影級、動畫、真人實拍。必須快速驗證並在基礎設施成本控制在每月 $200 以內的情況下,找出是否有人真的需要此工具。

架構決策:

開發者最初考慮在租用的 A100 實例(約 $2/小時)上自託管 Wan 2.2。在驗證階段生成 100 條測試影片時,估算 GPU 時間成本僅約 $6。看起來比 Atlas Cloud 便宜。

計算中遺漏的部分:

- 搭建 Wan 2.2 管線花了 3 天時間(CUDA 依賴、顯存管理、伺服器配置)

- Wan 2.2 與 Kling v3 的輸出品質差距導致 SaaS 無法實現預期的定價點

- 伺服器正常執行時間管理導致每週需要約 2 小時的持續維護

使用 Atlas Cloud 修正後的架構:

plaintext1# 靈活的模型路由 — 根據用戶等級切換 2MODEL_MAP = { 3 "free": "kling/kling-v3-standard-t2v", # 更低成本 4 "pro": "kling/kling-v3-professional-t2v", # 更高品質 5 "enterprise": "bytedance/seedance-2.0" # 最大化控制 6} 7 8def generate_demo_video(prompt: str, user_tier: str) -> str: 9 client = OpenAI( 10 api_key=os.environ["ATLAS_CLOUD_API_KEY"], 11 base_url="https://api.atlascloud.ai/v1" 12 ) 13 response = client.images.generate( 14 model=MODEL_MAP[user_tier], 15 prompt=prompt, 16 n=1 17 ) 18 return response.data[0].url

成果: 開發者在 4 天內上線,而不是 3 週。Pro 級別使用 Seedance 2.0 證明了比免費級別高出 3 倍的定價合理性,且這種分級模型結構僅使用一個 Atlas Cloud 金鑰即可完成,無需維護三個單獨的供應商整合。

-

Atlas Cloud 的優勢:為什麼"一個 API"是正確的架構 {#atlas-cloud-advantage}

Atlas Cloud 定位為全球首個全模態 AI 推理平台——一個統一的 API,服務於文字、圖像、影片和音訊生成領域的 300 多個模型。

對於 GitHub AI 影片生成技能作者,具體優勢在於:

-

相容 OpenAI 的 API(即插即用)

Atlas Cloud 使用相容 OpenAI 的端點。如果您的技能已經整合了 OpenAI SDK,只需更改

1api_key1base_url-

多模型工作流的單一計費

生產級影片工作流很少只使用一個模型。一個典型管線可能使用:

- Seedream 5.0 用於圖像生成(起始幀)

- Kling v3.0 用於圖生影片轉換

- LLM(Claude、GPT-4 或 DeepSeek)用於提示詞最佳化

- TTS 模型用於配音旁白

使用不同的供應商帳戶意味著四種計費關係、四個速率限制池和四個整合點。使用 Atlas Cloud,只有一個 API 金鑰和一份發票。

-

模型級定價透明

Atlas Cloud 公佈每模型定價,無隱藏算力費用。商業模式直截了當:按生成內容付費。新開發者在首次儲值時可獲得 20% 的獎勵金(最高 $100),推薦計畫還提供額外信用點。在建構財務預測前,請務必在 atlascloud.ai/pricing 核實當前定價。

-

合規性覆蓋

對於在受監管環境中部署的企業級 GitHub 技能:Atlas Cloud 持有 SOC I & II 認證且符合 HIPAA 合規,基礎設施覆蓋美國、歐盟和亞洲地區。這涵蓋了大多數企業級資料駐留需求。

-

ComfyUI、n8n 和 MCP 伺服器整合

Atlas Cloud 與建構 GitHub 影片生成技能最常用的工具原生整合:

- ComfyUI — 用於視覺工作流創作的自定義節點

- n8n — 帶有 Atlas Cloud 影片生成步驟的工作流自動化

- MCP 伺服器 — 用於 AI 代理框架的模型上下文協定整合

-

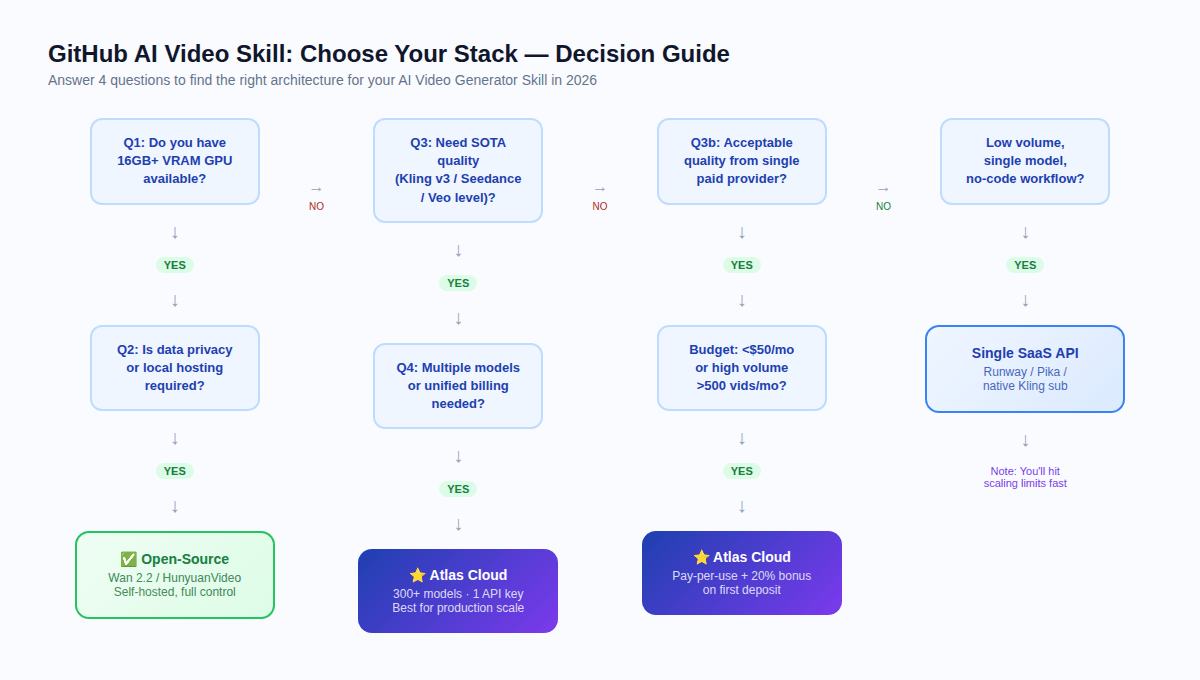

你應該使用哪種技術棧? {#decision-guide}

通讀這四個問題:

Q1:你有 16GB+ 顯存的 GPU 嗎?

如果沒有 → 完全跳過自託管。雲端 API 是您唯一可行的路徑。

Q2:法規是否要求資料隱私或本地託管?

如果是 + 有 GPU → 評估開源(取決於顯存選擇 Wan 2.2 或 HunyuanVideo)。

如果是 + 沒有 GPU → 使用 Atlas Cloud(符合 HIPAA 和 SOC 認證)並審查您的特定監管要求。

Q3:你需要 SOTA 品質(Kling v3、Seedance 2.0、Veo 級別)嗎?

如果是 → 必須使用雲端 API。在 2026 年,開源模型與頂級專有模型之間存在明顯的品質差距。

如果是開源級別可接受的品質 → 自託管 Wan 2.2 可能適用。

Q4:你需要多個模型或統一計費嗎?

如果是 → 使用 Atlas Cloud。大規模管理三個供應商帳戶的隱藏運營成本只有在生產規模下才會顯現。

按用例的總結推薦

| 用例 | 推薦技術棧 |

| 研究 / 原型設計 | 開源 (Wan 2.2, CogVideoX) |

| 社群媒體機構,500+/月 | Atlas Cloud + Kling v3.0 |

| 音樂影片 / 角色動畫 | Atlas Cloud + Seedance 2.0 |

| VFX / 物理模擬 | Atlas Cloud + Sora 2 |

| 資料主權 / 離線 | 自託管 (HunyuanVideo, Open-Sora 2.0) |

| 分級模型品質的 SaaS | Atlas Cloud (一個金鑰,多個模型) |

| 高容量開源批處理 | Wan 2.2 自託管 (10,000+/月閾值) |

-

常見問題 (FAQ) {#faq}

Q:什麼是 AI 影片生成技能?

一個可重複使用的程式碼模組或整合層,將應用程式連接到 AI 影片生成後端——無論是開源權重還是雲端 API。常見形式:Python 類別、ComfyUI 節點、n8n 工作流、MCP 伺服器工具。

Q:自託管開源影片模型的最小顯存是多少?

Wan 2.2 1.3B (短片段品質可接受) 需要 8GB 顯存。CogVideoX-1.5 或 Open-Sora (更高品質) 需要 16GB。Wan 2.2 14B 需要 24GB+。HunyuanVideo 或 Open-Sora 2.0 完整模型需要 60–80GB。

Q:開源 AI 影片生成是真正免費的嗎?

模型權重是免費的。但推理過程不是免費的——它需要 GPU 計算資源。在低容量(每月 <5,000 條影片)下,當計算總擁有成本時,Atlas Cloud 等雲端 API 通常更便宜。

Q:我可以將 Atlas Cloud 用於圖生影片 (i2v) 工作流嗎?

可以。Atlas Cloud 支援 Kling、Seedance 和 Vidu 的 i2v 變體。注意:對於 i2v 模型,某些變體不支援單獨的縱橫比參數——輸出解析度遵循輸入圖像的尺寸。

Q:Atlas Cloud 如何處理速率限制?

Atlas Cloud 支援非同步/Webhook 模式。影片生成任務作為任務提交;您的應用程式接收任務 ID 並在渲染完成後收到通知。這防止了大規模併發下的阻塞。

Q:跨鏡頭保持角色一致性的最佳模型是什麼?

Seedance 2.0 的通用參考系統是 2026 年最先進的解決方案。它允許您輸入參考影片、圖像和音訊,以在生成的不同片段間保持角色外觀和運動的一致性。

Q:Atlas Cloud 支援 ComfyUI 嗎?

支援。Atlas Cloud 擁有原生的 ComfyUI 整合,以及 n8n 節點和 MCP 伺服器相容性。

Q:開源影片模型如何處理縱橫比?

視模型而定。Open-Sora 透過

1--aspect_ratio總結

2026 年的格局分為兩個陣營,各有其優勢區間:

開源:如果您有多餘的 GPU,每月產量超過 1 萬條影片,資料不能離開您的伺服器,或者您需要根據自己的私有素材進行微調,那麼開源是明智的。

付費 API:如果您需要現有的最佳品質、速度優於成本、每月產量低於 5,000 條,或者您想混合使用多個模型而不必處理繁瑣的供應商合約,那麼付費 API 是更好的選擇。

Atlas Cloud 連接了兩者:作為一個統一平台,透過單個相容 OpenAI 的 API 金鑰,提供對 300 多個模型(包括透過託管推理存取的頂級開源模型以及每個主要的專有模型)的存取。對於 2026 年大多數建構生產級 GitHub AI 影片生成技能的開發者來說,這是從原型到生產摩擦力最小的路徑。

本文中的定價資訊僅供參考,如有變動,恕不另行通知。在建構財務預測之前,請務必在 atlascloud.ai/pricing 核實當前費率。模型可用性可能因地區而異。

Atlas Cloud: atlascloud.ai — SOC I & II 認證 · 符合 HIPAA · 美國 · 歐盟 · 亞洲基礎設施_