什么是 GLM-5.1?智谱 AI 的自主编程模型

GLM 5.1 模型即将登陆 Atlas Cloud!

- 什么是 GLM-5.1: GLM 5.1 是智谱 AI 最先进的开源模型,拥有开源模型中最强的编程能力,可媲美 Opus 4.6!

- 核心功能: GLM 5.1 具备顶尖的编码能力。它能自动执行任务长达八小时,并通过自适应问题解决机制确保工作流顺畅,交付功能完整的结果。

- 上线时间: 本月。

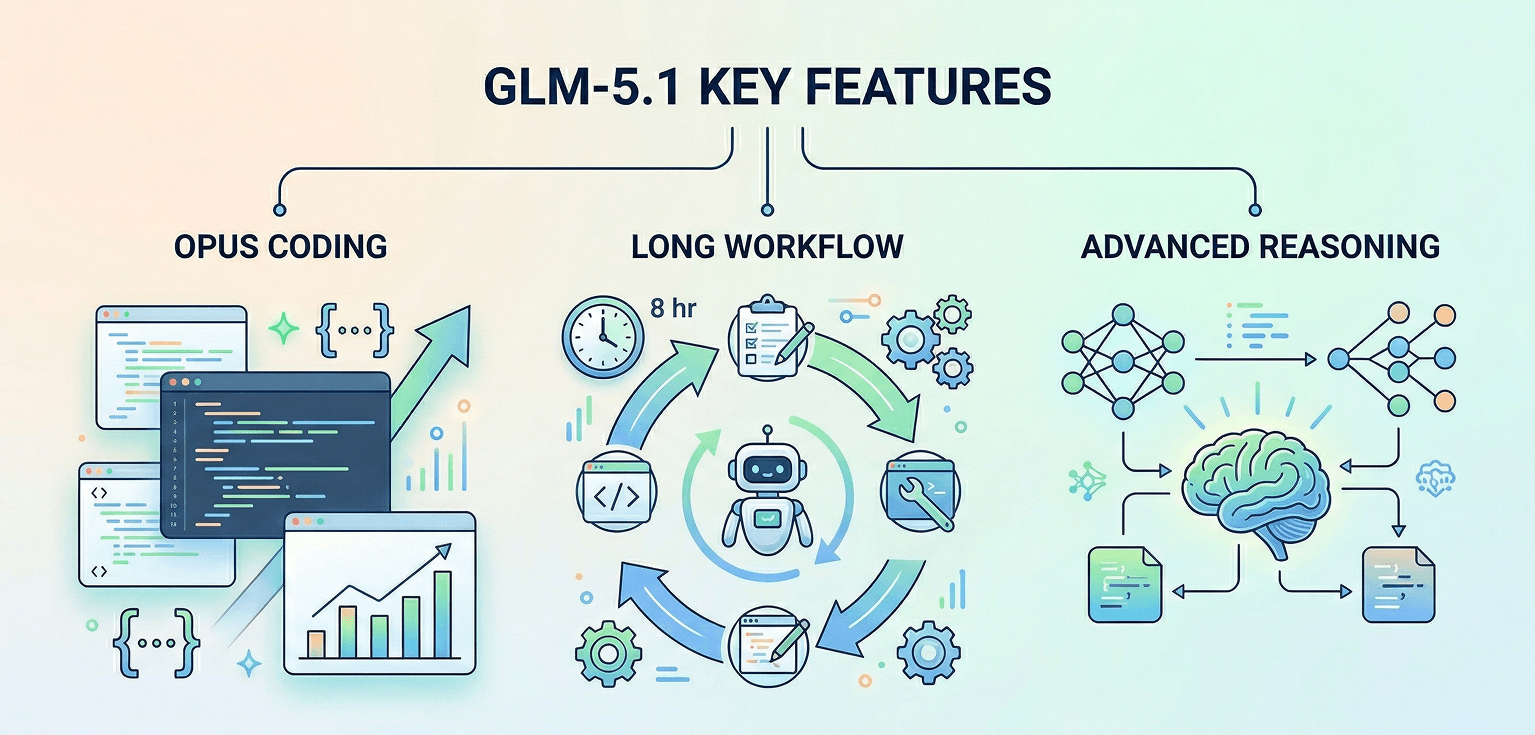

GLM-5.1 核心功能

编码性能:Opus 4.6 级别

GLM-5.1 在编码任务中取得了最强的基准测试结果,表现与 Claude Opus 4.6 持平。在各大公开基准测试中,它稳居开源模型之首。

与 Claude 3.5 Sonnet 对比:

- Claude 3.5 Sonnet:强大的编码能力,被广泛应用于开发场景

- GLM-5.1:达到 Opus 4.6 级别的性能,价格更具竞争力

与 DeepSeek V3.2 对比:

- DeepSeek V3.2:出色的开源编码模型,具备广泛的能力

- GLM-5.1:在专业编码基准测试中表现更优,并具备独特的长周期执行能力

长周期任务执行:8 小时自主性

GLM-5.1 不仅仅限于对话。当面对真实的工程项目时,它能够规划工作流、编写代码、运行测试、在受阻时切换策略、在出错时修复问题——并持续工作长达 8 小时以交付完整结果。很少有模型具备这种能力。

与 GPT-4o 对比:

- GPT-4o:非常适合多轮对话和短时任务

- GLM-5.1:专为具有状态管理的长时间自主执行而设计

与 Qwen2.5 对比:

- Qwen2.5:在多样化任务中表现强劲

- GLM-5.1:专注于长周期、复杂的工程工作流

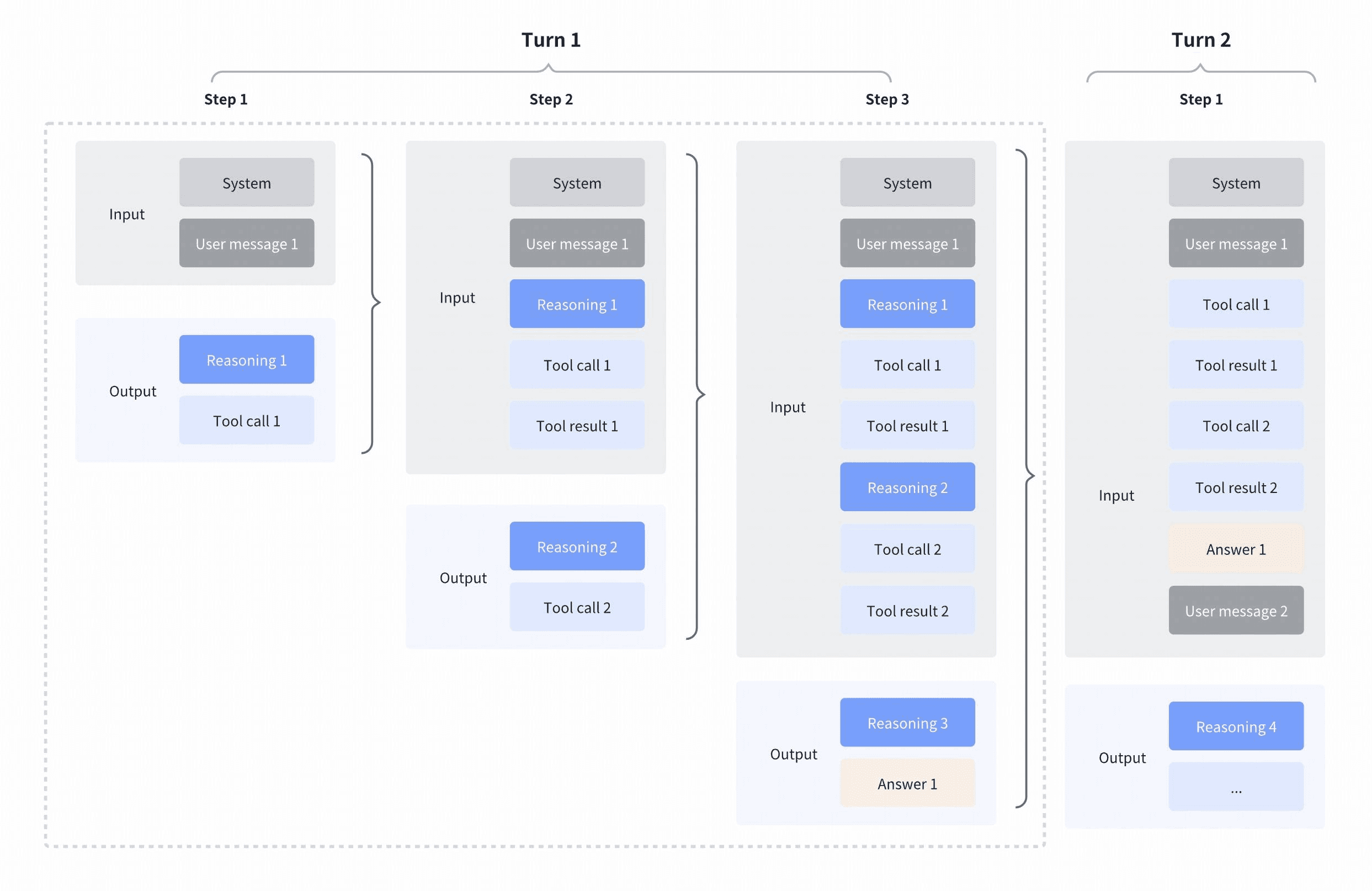

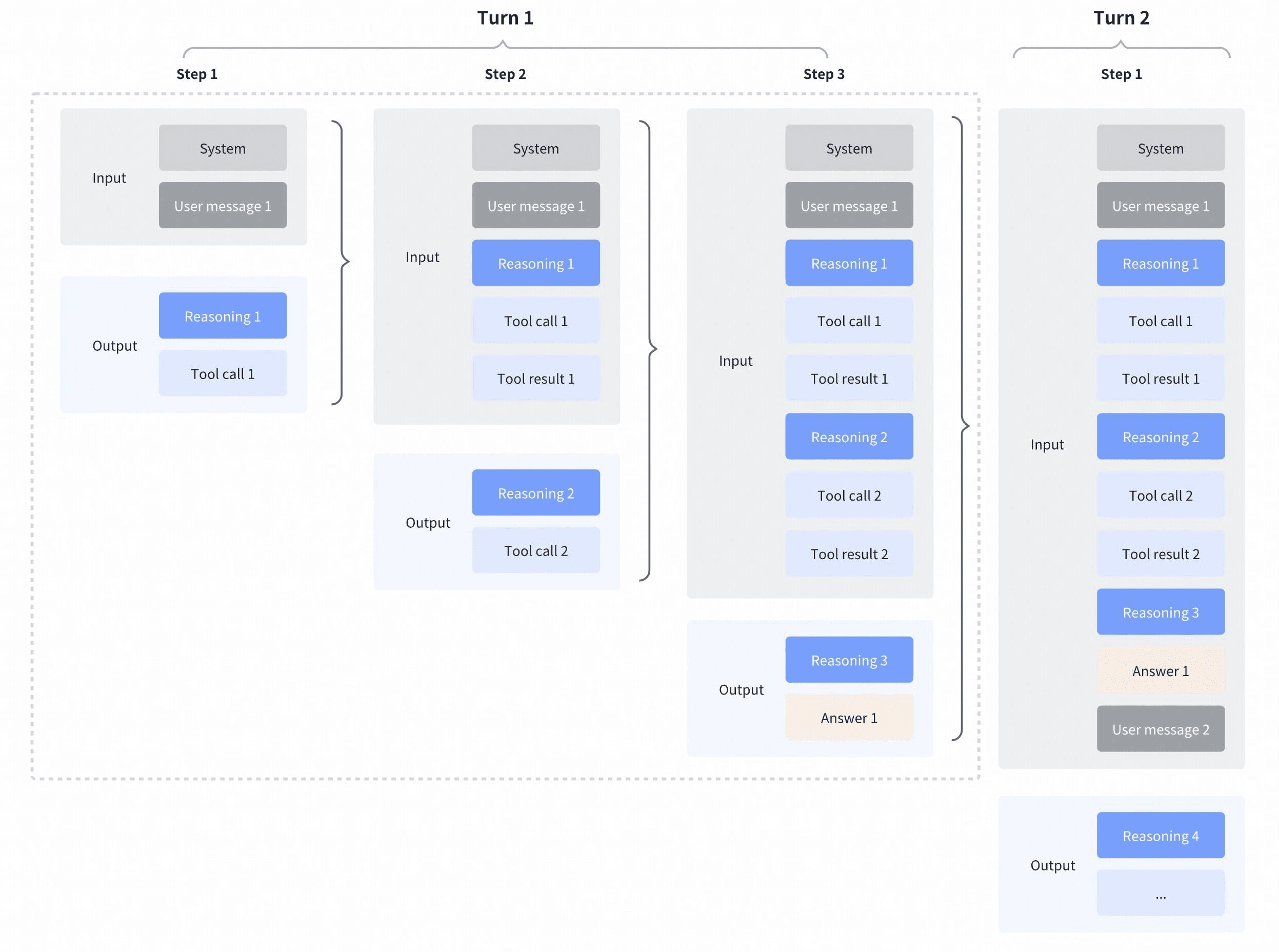

交错与保留式思考

- 交错思考 (Interleaved Thinking)

允许 GLM 在工具调用之间及之后进行推理,实现步步为营的思考:解读输出、链接调用,并根据中间结果做出精准决策。

- 保留思考 (Preserved Thinking)

GLM-5.1 保留了之前轮次的推理过程,确保了连续性,提升了性能,增加了缓存命中率,并在实际任务中节省了 token 消耗。

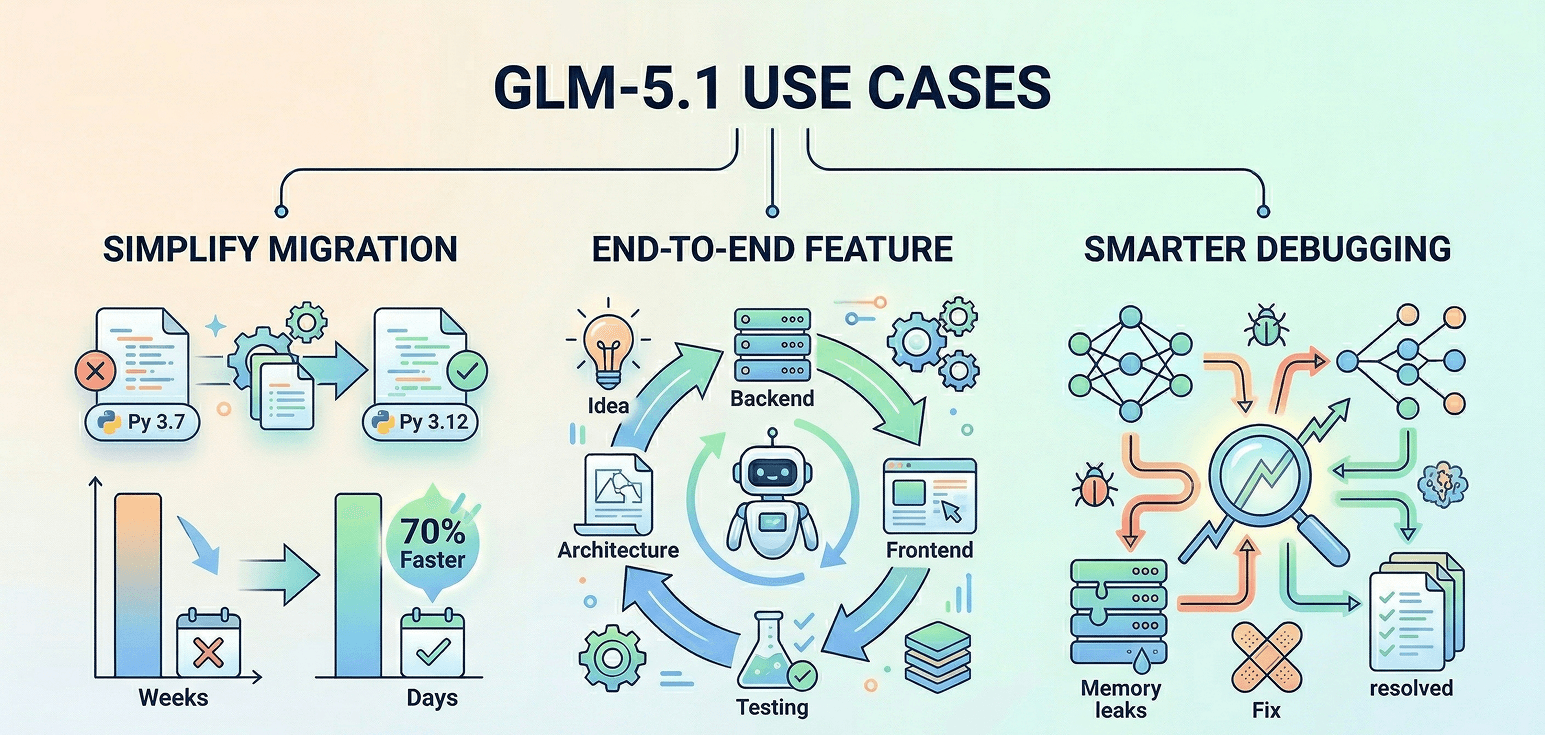

GLM-5.1 应用场景:代码迁移、功能开发、调试

简化代码迁移

GLM-5.1 承担了耗时的代码迁移任务,将数周的工作缩短至几天内完成。它审阅代码库、制定策略、大规模编辑文件并执行全面测试。这使得升级 Python 版本或现代化框架等常见项目的工作效率提升了 70% 以上,且更为简单。

端到端功能开发

从最初的创意到完全构建的应用,GLM-5.1 运行整个过程。它规划架构、构建后端和前端系统、编写测试,甚至处理文档编写。无需持续监督,它即可交付随时可部署的完整解决方案,包括安全性、数据库和生产环境配置。

智能调试

当大型系统中出现复杂的 bug 时,GLM-5.1 可以承担重任。它会持续追踪问题,无论是竞争条件还是内存泄漏,并基于仔细的测试应用修复程序。每一步都有详细记录,让开发者能够在此基础上进行构建。

为什么在 Atlas Cloud 上使用 GLM-5.1?

什么是 Atlas Cloud?

这是一个简化 AI 使用的平台,让您可以在一个地方访问 300 多种顶级模型——涵盖文本、图像、视频等。

适合谁?

• 需要简单、经济实惠的 AI 访问权限的开发者。 • 处理需要跨多个领域 AI 支持项目的团队。 • 需要可靠 AI 来完成重要工作的企业。 • 使用 ComfyUI 和 n8n 等工具的用户。

为什么选择它?

• 一个 API 即可调用所有模型——仅需一个密钥。 • 价格透明,无隐藏费用,成本低廉。 • 为企业打造:稳定、安全,并提供专家支持。 • 与您现有的工具完美兼容。 • 您的数据受到安全保护,并符合合规性要求。

如何对比其他平台?

• Fal.ai:Atlas 模型更多,价格更优。 • Wavespeed:Atlas 成本更低,且包含企业级支持。 • Kie.ai:Atlas 定价更清晰,选择范围更广。 • Replicate:库规模较小,成本较高。 • 其他供应商(如 OpenAI):Atlas 将所有功能整合在一个简单的平台中。

如何在 Atlas Cloud 上使用 GLM-5.1

Atlas Cloud 让您可以并排使用多个模型——先在 playground 中测试,然后通过单个 API 调用。

方法 1:直接在 Atlas Cloud playground 中使用

方法 2:通过 API 访问

第一步:获取 API 密钥

在您的 控制台 中创建一个 API 密钥并复制以供后续使用。

第二步:查看 API 文档

在我们的 API 文档 中查看端点、请求参数和身份验证方法。

第三步:发出您的第一个请求(Python 示例)

示例:使用 GLM-5-Turbo 生成视频

plaintext1import os 2from openai import OpenAI 3 4client = OpenAI( 5 api_key=os.getenv("ATLASCLOUD_API_KEY"), 6 base_url="https://api.atlascloud.ai/v1" 7) 8 9response = client.chat.completions.create( 10 model="zai-org/glm-5-turbo", 11 messages=[ 12 { 13 "role": "user", 14 "content": "hello" 15 } 16], 17 max_tokens=1024, 18 temperature=0.7 19) 20 21print(response.choices[0].message.content)

FAQ:GLM-5.1 常见问题解答

问:GLM-5.1 在编码方面与 Claude 3.5 Sonnet 相比如何?

答:GLM-5.1 在编码基准测试中与 Claude Opus 4.6 持平,优于 Claude 3.5 Sonnet。其处理长周期任务的能力使其脱颖而出。

问:"长周期任务执行"有何特别之处?

答:常规聊天模型只响应单个提示。而 GLM-5.1 可以保持任务状态长达 8 小时,并在整个过程中进行调整和自我纠正。

问:GLM-5.1 是开源的吗?

A:是的,它是完全开源的。由智谱 AI 开发,您可以在官方文档中找到许可详细信息。

问:它准备好用于生产环境了吗?

A:当然!GLM-5.1 提供 128K 上下文窗口,并运行在 Atlas Cloud 可靠的基础设施上,完全具备生产就绪能力。

问:我该如何集成它的 8 小时执行能力?

A:对于长时间任务,请使用 Webhook 或轮询设置。Atlas Cloud 会处理后端逻辑,并在任务完成后向您的应用程序发送最终输出。

问:GLM-5.1 最适合哪些任务?

A:它非常适合代码迁移、复杂系统调试和全栈软件开发等具有挑战性的项目。