Wan 2.7 image 是由阿里巴巴通义实验室开发的一款大型文生图模型。其全新的"思维模式"(Thinking Mode)通过在渲染前理解空间逻辑和意图,彻底变革了文生图技术。它不再是一个需要你不断精细调整的基础工具,而是成为了真正的创意合作伙伴。下一个时代的关键不在于更高的分辨率,而在于模型能否真正理解你的构想。

WAN 2.6 与 WAN 2.7 思维模式 – 工作流及成本对比表

| 对比维度 | Wan 2.6 image | Wan 2.7 image (思维模式) |

| 输入提示词 | 需要更精确、精心设计的提示词;对措辞敏感。 | 理解自然语言。你可以像和人交流一样描述你的想法。 |

| 生成过程 | 直接生成,内部推理有限;迭代优化较少。 | 先思考。在渲染前分析布局、光影以及主体间的互动。 |

| 输出结果 | 质量不错,但在复杂场景中可能会偏离意图或产生不一致。 | 场景高度连贯。通常在第一次或第二次尝试时就能准确把握氛围和结构。文本渲染能力可直接将清晰可读的文字嵌入图像中,无需后期处理。 |

| 用户成本 | 单次生成成本较低,但可能需要多次重试 → 总成本更高。 | 低。工作流程更快捷,重做次数大幅减少,整体生产成本更低。 |

什么是思维模式?文生图生成三个阶段的真正升级之处是什么?

WAN 2.6 模型基本上只是"你说什么它就画什么"——即使物理逻辑完全不合理。而 Wan 2.7 image 的思维模式彻底改变了这一点。它会先尝试理解你试图表达的内容,然后协助你构建最终作品。

它不再是一台盲目的艺术机器,更像是一位联合导演。让我们来看看在三个主要生成阶段,幕后究竟发生了什么。

阶段 ① – 意图解读(从关键词到逻辑关系)

过去,如果你要求"骑士和龙",通常只能得到两个生硬拼接在一起的独立对象。WAN 2.6 image 在处理多主体 AI 生成时一直表现欠佳。

Wan 2.7 image 可以解读你文字背后的意图。它不再仅仅是将元素堆砌在画布上,而是会在主体之间建立实际的联系。如果角色有互动,它会观察眼神交流、姿势和物理连接。它不只是读取孤立的关键词,而是解码动作。这彻底解决了编写复杂 AI 图像提示词的痛点。

阶段 ② – 空间与逻辑推理(从平面生成到深度感知)

我们都见过那些奇怪的 AI 故障:手部与桌子融合,或者阴影方向错误。这主要是因为 WAN 2.6 image 模型渲染图像时是平面的。

Wan 2.7 image 应用了深度 AI 空间推理。它在开始绘图前会全局计算前景和背景的逻辑。它能算出透视关系,并追踪光源,从而使阴影自然落下。通过利用真正的 AI 图像布局控制,它确保物体切实占据 3D 空间。结果呢?图像看起来是一个真实、统一的世界,而不是一本平面贴纸书。

阶段 ③ – 场景构建(从单张图片到叙事表达)

我们大多数人并不擅长描述每一个微小的视觉细节。说实话,这没关系。在最后阶段,AI 会主动介入并自动填充你的视觉空白。

假设你想要利用 AI 生成海报,但只提供了一个基本轮廓。Wan 2.7 image 利用其多模态 AI 理解力来选择最佳的电影级构图。它为你调节叙事氛围——比如添加一些有情绪感的雾气或特定的色彩分级。它将一个简单、不完整的想法转化为引人入胜的故事。

案例研究:WAN 2.6 image vs WAN 2.7 image 在生产环境中的表现

文生图技术真正的转折点不仅仅是让画面看起来还可以。它终于跨越到了可以真正应用于实际项目的地步。Wan 2.7 image 的思维模式似乎是推动这一巨大转变的核心引擎。它将 AI 生成推向了真正的生产级领域。

视觉测试:"雨中街景"

为了看看实际效果,我们进行了一个快速视觉测试。我向 Wan 2.6 和 Wan 2.7 image 输入了完全相同的提示词。

提示词: "一个女孩在雨中城市街道上遛狗,电影感,夜间霓虹灯。"

看起来很普通,对吧?但输出的结果却天差地别。

对比评估总结

WAN 2.6 image 输出: 第一眼看似乎还可以。但仔细观察:狗的身体后面或下方莫名其妙地喷涌出一团巨大的厚白烟雾。女孩握伞的手指完全融化了——手指数量错误,关节结构扭曲,并直接与伞柄融合在一起。它可能骗过随意滑动屏幕的人,但在细看之下完全站不住脚。

由 WAN 2.6 image 生成的图像

WAN 2.7 image 思维模式输出: 这张图确实让我感到惊艳。地面的反射与发光的标志完美匹配。女孩和狗之间有真正的互动。得益于其先进的 AI 空间推理,场景具有真实的物理深度。你可以直接拿这张图去使用。

由 WAN 2.7 image 生成的图像

WAN 2.6 image 与 WAN 2.7 image 思维模式 – 视觉质量对比表

| 指标 | WAN 2.6 image | WAN 2.7 image 思维模式 |

| 构图 | 整体构图尚可,但在复杂场景中可能显得平庸或略微失衡。 | 利用智能 AI 图像布局控制实现电影级构图,更好的主体突出和平衡感。 |

| 光影 | 光影尚可,但有时显得平面或各元素间不一致。 | 光影更强、更连贯,现实感和氛围控制力更佳。 |

| 空间逻辑 | 偶尔出现透视错误;物体关系在细节处可能破裂。 | 显著改善了空间连贯性和物体一致性。 |

| 提示词遵循度 | 能较好地遵循提示词,但在处理复杂 AI 图像提示词时会丢失细节,可能会忽略微妙的约束。 | 对细腻提示词和多步指令的保真度更高。 |

| 成功率 | 中等(~70–80%):方差明显,尤其是在处理复杂提示词时。 | 高(~85–95%):输出更可靠,所需的重试次数更少。 |

商业价值:为什么 WAN 2.7 image "思维模式"是一个游戏规则改变者

当文生图技术从"制造图片"转向真正理解你的需求时,一切都改变了。我注意到这不仅仅是为了获得更漂亮的输出。真正的赢家在于效率和商业价值上的巨大飞跃。它将 AI 从一个需要不断精细调整的工具,转变成了一个真正的协作队友。

门槛更低,效率更高

我还记得为了得到一张可用的图片,我不得不输入各种奇怪的括号和负面权重。现在这些基本都结束了。有了 Wan 2.7 image 的多模态 AI 理解力,自然语言终于取代了那些复杂 AI 图像提示词。

你基本上只需要和它对话。因为它在执行前先进行思考,成功率高得惊人。命中率高意味着工作流显著加速。你可以在两分钟内拿到素材,而不是花费漫长的时间。

商业应用中无与伦比的可控性

长期以来,AI 艺术大多只适用于奇怪、抽象的概念图。它通常不够稳定,无法用于实际的商业任务。但 Wan 2.7 提供了出色的 AI 图像布局控制。

其构图极其稳固。这意味着你终于可以信任它来制作实际的品牌营销活动和电子商务产品模型。它处理带有可读文字的 AI 图像的能力远超 WAN 2.6 image 模型。

团队 ROI 最大化

将该模型引入你的公司会改变每个人的工作方式。当你减少对试错的依赖时,投资回报率就会飙升。以下是不同团队的实际使用方式:

设计师: 不要从零开始。你可以通过其广受好评的文本渲染、多语言布局、图像集模式,以及处理多达 3,000 个 Token 和支持 12 种语言的能力,快速利用 AI 生成海报,然后将宝贵的时间花在精修细节上。

营销团队: 需要广告的五个视觉版本?它能轻松处理多主体 AI 生成,让你的模特和产品每次都呈现出完美效果。

开发者: 你可以将这些 API 功能集成到你的应用中,无需担心用户生成出乱七八糟、无法使用的垃圾内容。

内容创作者: 瞬间将博客概念转化为高质量缩略图,同时在整个频道保持一致的视觉风格。

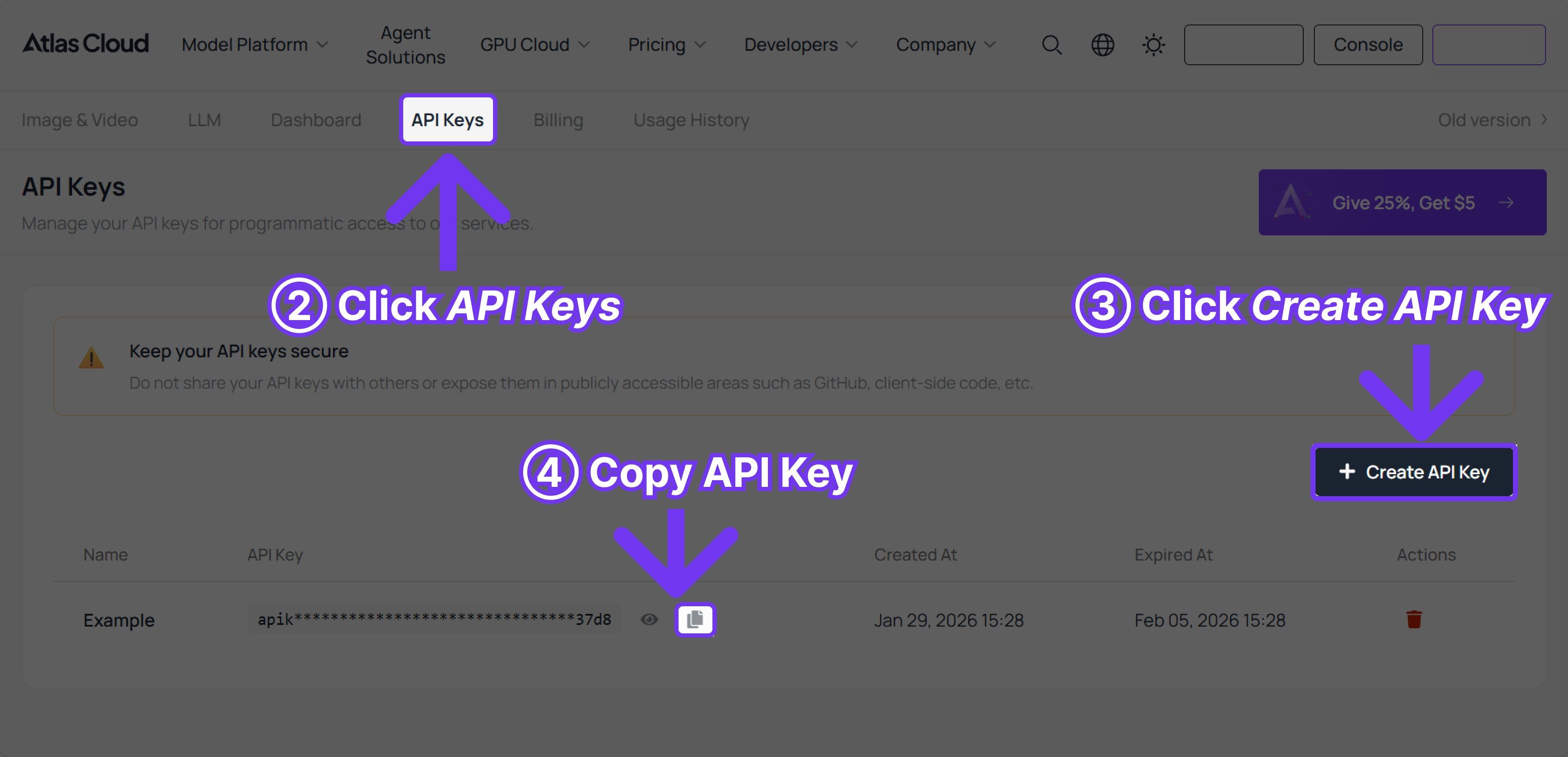

扩展 WAN 2.7 image:为什么全球团队使用 Atlas Cloud 的文生图 API

新的"思维模式"令人难以置信,但我吃一堑长一智,强大的功能需要非常强大的基础设施支持。仅依赖单一的官方 API 来进行文生图生成通常会导致巨大的麻烦。你会遇到突如其来的速率限制、恼人的队列延迟以及在你最需要扩展时出现的深度集成瓶颈。

这就是为什么精明的全球团队正在转向聚合平台。通过 Atlas Cloud 调用 Wan 2.7 image 模型最终是一个更安全、更明智的选择。

选择 Atlas Cloud 进行开发的 4 个理由

- 真正的聚合灵活性

使用官方 API 意味着你被锁定在单一模型中。此外,你必须自行编写所有的错误处理和自定义路由逻辑。这真的很麻烦。Atlas Cloud API 为你提供了一个统一的端点。你可以即刻访问 Wan 2.7 image 以及其他顶级模型。你可以根据任务轻松切换模型。输入和输出是完全标准化的。每当有全新的模型发布时,你无需重写代码就能在第一天进行测试。

- 低延迟与高速度

官方 API 经常受到大量用户流量的冲击。这意味着你的请求会卡在队列中,导致你的应用运行缓慢。Atlas Cloud 本质上绕过了这种官方拥堵。他们提供企业级速度,几乎没有速率限制,确保你的图像生成请求能够快速处理。

- 企业级稳定性

在高峰使用期间,Atlas Cloud 拥有实时负载均衡功能。它均匀分配 Token 并减少节点负载过高时的延迟峰值,确保在任何条件下都能获得稳定的性能。

- 极高的成本效益

Atlas Cloud 平台真正降低了你的基础生成成本,成本低至每张图 0.03 美元。你最终支付的单图成本显著降低,且不会牺牲任何视觉质量或速度。

FAQ:WAN 2.7 image 与文生图 API

你可能对这一切在实践中是如何运作的还有一些疑问。以下是人们开始研究这种新一代技术时最常问的问题。

WAN 2.7 思维模式会增加文生图的生成时间吗?

是的,Wan 2.7 image 的思维模式会产生轻微的推理延迟(毫秒到秒级),因为它在生成前利用了一个思维链(Chain-of-Thought)推理层。然而,你的项目总时间会大幅下降。因为你不再需要多次点击"生成"按钮才能得到一张可用的图,所以整体上节省了时间。

Wan 2.7 与 Midjourney 或 Flux 有什么不同?

Midjourney 以华丽、高度风格化的艺术氛围著称。Flux 因其原始速度而广受赞誉。但 Wan 2.7 image 的构建方式不同。它依赖于深度的多模态 AI 理解力。它优先考虑逻辑、物理和关系,而不是仅仅让画面看起来漂亮。如果你需要可靠的、角色能够真正互动且不会互相融合的多主体 AI 生成,Wan 2.7 image 通常是更明智的选择。

Wan 2.7 image 能在图像中渲染文字吗?

是的,Wan 2.7 image 拥有强大的多语言文字渲染能力,适用于 UI 设计和海报制作。

Wan 2.7 image 是开源的吗?

不,目前尚未得到官方证实。

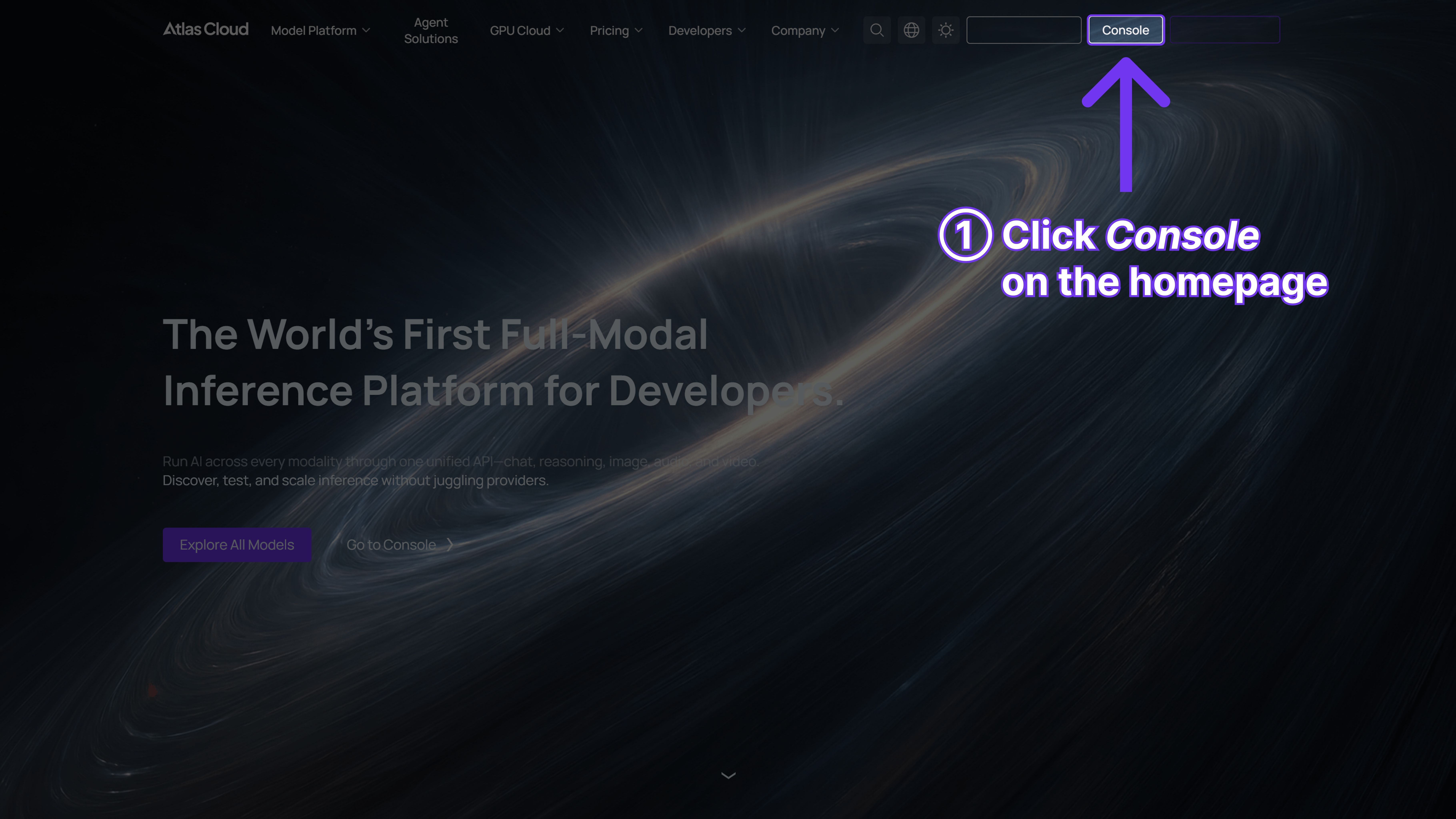

如何将 Atlas Cloud 的文生图 API 集成到我的应用程序中?

是的,你只需将当前的 URL 替换为 Atlas Cloud 的统一端点即可。他们使用标准的 REST 调用并返回简洁的 JSON。开发者通常在一个下午就能搞定。

结论

回首过去,文生图技术的发展历程非常狂野。几年前,我们从模糊、扭曲的形状开始。然后我们进入了高分辨率图像时代,但它们仍然完全缺乏基本的物理逻辑。现在,我们终于迈入了一个 AI 在绘图前会先进行思考的时代。

像 Wan 2.7 image 这样的模型不再仅仅是盲目的图形生成器。它们已经成为了协作设计伙伴。通过理解复杂提示词并提供真正的布局控制,它们弥合了原始想法与成品、商业级资产之间的最后一英里差距。

准备好升级你的应用程序生成能力了吗?

别再为了令人沮丧的提示词工程和不可预测的官方 API 队列而烦恼了。让你的 AI 成为真正的生产力引擎。今天就在 Atlas Cloud 获取免费 API 密钥,并立即测试 Wan 2.7 image。

阅读我们的 API 文档,现在就开始你的第一次 Wan 2.7 image 调用吧。