大多数人仍然认为,更好的文字就等于更好的图像。这在两年前或许是真的,但现在已经不是了。

在 2026 年,模型之间的差距早已不是重点。真正的差距存在于"描述型用户"和"构建型用户"之间。前者只会输入"电影级光影、4k、超精细";后者则是在构建场景——明确光线方向、深度层次和拍摄角度。

如果你的图像看起来依然单调,问题通常不在模型本身,而在于你没有告诉它什么。

为什么你的提示词还不够用(2026 年视角)

通用的提示词已经失效了。模型已经见过数百万次"最佳质量"、"高细节"之类的词汇。这些词现在几乎无法产生任何影响。

什么才是关键?结构化的输入。光线从哪里来?前景和背景分别有什么?你使用了哪种镜头?现代模型会对这些变量做出响应,它们会忽略无用的冗余信息。

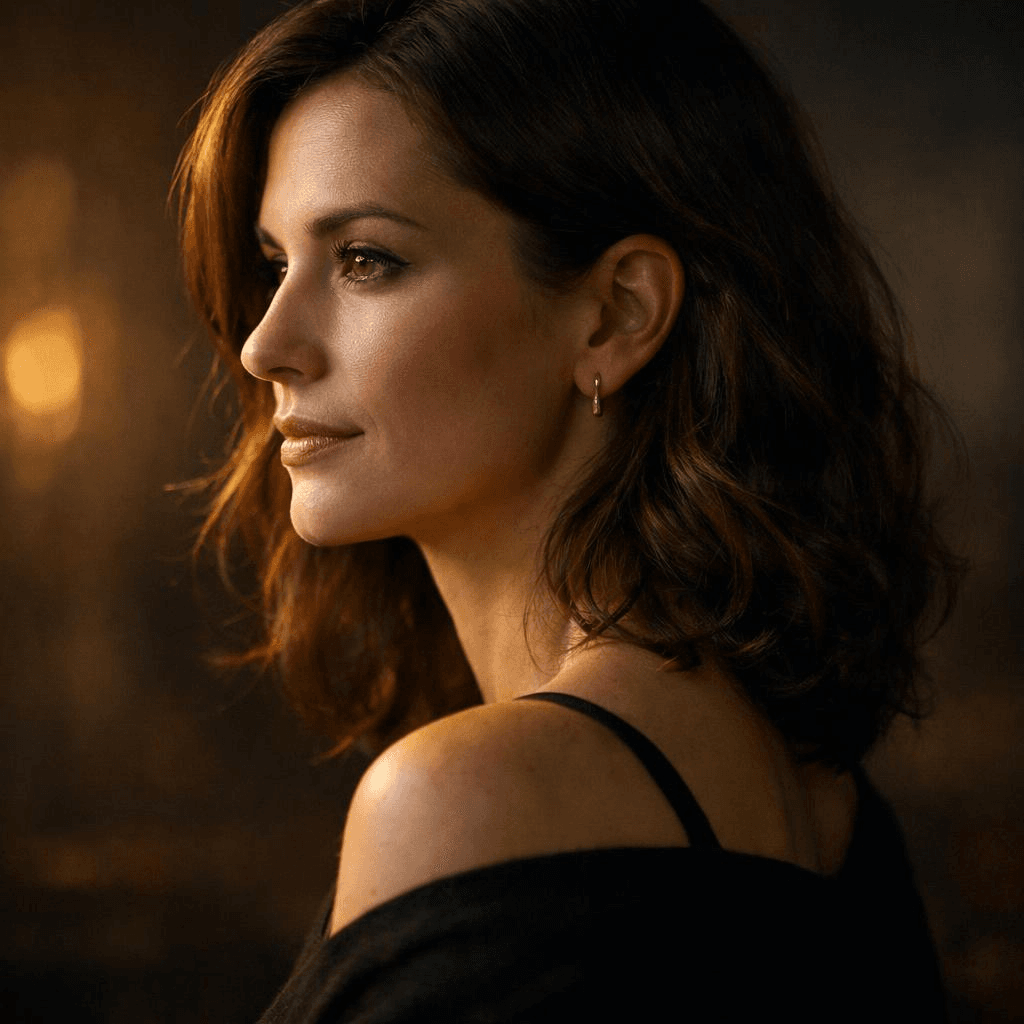

这是一个常见的模式。有人写道:"一张带有柔和光影的美丽肖像。"结果模型给出了一张单调的图像。为什么?因为缺乏光线方向,没有深度分离,也没有拍摄角度。模型不得不去猜测,而猜测往往导致平庸的结果。

你需要做的转变很简单:停止描述结果,开始构建场景。

7 个高级技巧

-

指明光线方向

"柔和光影"太模糊了。侧光、逆光、顶部光——这些词能给模型具体的指令。方向产生阴影,阴影产生深度,深度使图像看起来真实。

试着把"柔和的肖像光影"改成这样:

一位女性的肖像,左侧侧光,脸部右侧有柔和阴影,背景有微妙的环境光

你可以立即看到差别。模型精准地知道光线的位置。

-

使用真实的摄影布光设置

三点布光、轮廓光、伦勃朗光。这些不仅仅是时髦术语,它们是模型在训练过程中见过成千上万次的模式。使用它们,你的输出将变得更加稳定。

示例:

运动鞋产品特写,三点布光设置,强主光,柔和补光,微妙的轮廓光将产品与深色背景分离

这比"戏剧性光影"每次都要有效得多。

-

分层构建深度

单调的图像通常是因为所有元素都位于同一平面。通过明确指出前景、中景和背景来修复它。

示例:

木桌上的咖啡杯(前景),一个人正在笔记本电脑前工作(中景),带有温暖灯光的模糊咖啡馆内部(背景)

现在模型有了可以处理的空间关系。

-

使用摄影术语,而非风格标签

"赛博朋克风格"很模糊。"35mm 镜头、低角度、广角"则非常精确。摄影参数直接对应于图像的构建方式。

请记住这些:

- 35mm:适合自然、日常的视角

- 85mm:适合带有压缩感的肖像

- 广角:适合展现戏剧性和规模感

- 低角度、平视、俯视:用于控制视角

示例:

特写肖像,85mm 镜头,浅景深,平视角度,柔和的背景虚化

这比"审美肖像"给模型提供了清晰得多的指令。

-

通过对比引导注意力

到处都是高细节并不是目标,对比才是。光与影的对比,冷与暖的对比,清晰主体与模糊背景的对比。

三种有效的对比方式:

- 光影对比:深色背景下的明亮主体

- 色彩对比:冷色调背景下的暖色聚光灯

- 细节对比:清晰的主体,模糊的环境

示例:

被暖色聚光灯照亮的主体,置于深色冷调背景中,高对比光影,突出主体聚焦

观众的视线会准确地落向你想让他们看的地方。

-

添加限制以消除混乱

冗长的提示词会变得杂乱。与其增加更多细节,不如加上限制。明确告诉模型你不需要什么:没有杂物,没有畸变,没有多余的物体。

示例:

极简主义产品拍摄,居中构图,干净的白色背景,无杂物,无文字,无畸变

限制往往比额外的描述更有效。

-

像导演一样迭代,而不是像赌徒一样碰运气

没人能一次性就得到完美的图像。专业人士的做法是:生成,微调,再次生成。

一个简单的工作流:

- 第一步:基础构图、主体和环境

- 第二步:增加定向光和对比度

- 第三步:细化细节,清除干扰

每一次迭代都会改善结果。这就是你如何从靠运气转变为保持高质量的一致性。

综合应用——专业的提示词框架

别再写长句子提示词了,试着将它们模块化。

这是一个行之有效的结构:

plaintext1[主体] + [环境] + [光影] + [相机参数] + [构图] + [色彩] + [限制条件]

看看基础提示词与结构化提示词的区别。

示例:从基础提示词到专业提示词

基础提示词(典型用户):

一位穿着白色夏装的女模特,干净的背景,摄影棚灯光,高细节,电商风格

专业提示词(结构化):

一位穿着白色夏装的女模特(主体),站在极简主义摄影棚内,背景是柔和的米色纹理(环境),右侧侧光在身体左侧形成柔和阴影,微妙的轮廓光将轮廓与背景分离(光影),使用 85mm 镜头拍摄,平视角度(相机),主体略微偏离中心,浅景深,前景轻微虚化增加深度(构图),温暖的自然色调,柔和对比度(色彩),构图干净,无杂物,无畸变,无多余物体(限制条件)

结论:从提示词书写到场景执导

得到一张很棒的图像是好事,但真正的项目需要成百上千张风格一致的高质量视觉素材。手动编写提示词无法规模化。

你会遇到实际的问题:延迟、单次生成成本、以及跨批次维持视觉风格的一致性。仅靠提示词设计无法解决这些,你需要一套系统。

这就是基于 API 的图像生成变得必不可少的原因。无需每次都在 Playground 输入提示词,你可以将生成功能直接集成到工作流中。结构化的提示词可以被复用、自动化,并随着时间推移不断优化。

像 Atlas Cloud 这样的平台提供了统一的 API 层。

如果你是:

• 需要轻松、经济实惠 AI 接入的开发者。 • 正在处理需要 AI 赋能多领域项目的团队。 • 需要可靠 AI 助力重要业务的企业。 • 使用 ComfyUI 或 n8n 等工具的用户。

尝试 Atlas Cloud,你会发现自己可以从实验走向生产,无需从头开始构建基础设施。

未来不在于孤立地写出更好的提示词,而在于建立可控、可重复、生产就绪的视觉系统。

常见问题解答

为什么我的 AI 图像看起来依然单调?

图像单调通常是因为你忽略了深度提示。想想摄影的原理,深度感来自阴影、物体遮挡和焦距差异。你的提示词必须明确写出这些。

以简单的"人坐在桌边"为例,这几乎没有提供任何关于深度的信息。试着改成:"人坐在桌边(中景),模糊的城市夜景窗户(背景),焦点清晰的咖啡杯(前景)"。现在模型就有了可以处理的层次。

光影是另一个人们常出错的地方。许多提示词只提到了环境光,这会导致整张图光线均匀、平淡。增加一个定向光源吧。侧光、逆光、轮廓光。任选其一,模型就会开始投射阴影,画面瞬间就会有立体感。

还有一点,不要试图用细节填满画面的每个角落。留白和模糊非常有用,它们会引导观众的视线。有时更少的细节反而能带来更强的深度感。

AI 能取代产品摄影吗?

在很多情况下可以。但我们得诚实地评估它的适用范围。

如果你需要拍摄一款豪华手表的宣传照——那种每一处金属反射都极其考究、皮革表带纹理必须精准的照片——传统摄影依然是赢家。在这一点上,你无法超越真实的摄影棚。

但对于几乎其他所有场景,AI 的速度更快、成本更低。产品目录图、生活场景图、季节性变体、A/B 测试素材——你可以在几秒钟内生成一张白色背景的干净产品图,然后利用 AI 产品摄影生成器将其放置到海滩、冬季木屋或现代厨房中。

无需租赁摄影棚、无需灯光设备、无需精修,每张图片的成本仅为几分钱。

对于小品牌和 DTC 初创公司来说,这彻底改变了游戏规则。他们现在可以生产出与拥有大预算公司相媲美的视觉素材,这在两年前是不可能的。

OpenAI 的视觉生成模型与之前的版本有何不同?

新模型 GPT‑image‑1.5 在内部架构上做了一些调整。它使用了扩散 Transformer(Diffusion Transformer),简单来说,这意味着它能更好地处理空间关系。

旧版本通常会将复杂的场景拆解成碎片,导致物体组合不自然——比如手漂浮在杯子旁边而不是握住它,或者阴影投射方向错误。新版本让元素关联更紧密,手可以真正握住杯子,阴影也会落在正确的位置。

文字渲染也是一大进步。早期的模型产生的乱码就像随机符号。GPT‑image‑1.5 可以生成多语言的可读文字。你甚至可以在同一张图里混合使用英文和中文,这现在完全可以实现。

模型还原生支持更高的分辨率——无需超分即可达到 2K,伪影更少,细节更清晰。

当然,它也有缺点:模型对模糊的提示词包容度降低了。你不能只说一句"一张精美的肖像"就期待奇迹。你必须更加谨慎。但当你提供结构化的指令——如光线方向、深度层次、相机参数时,其输出质量将远超以往任何一代模型。