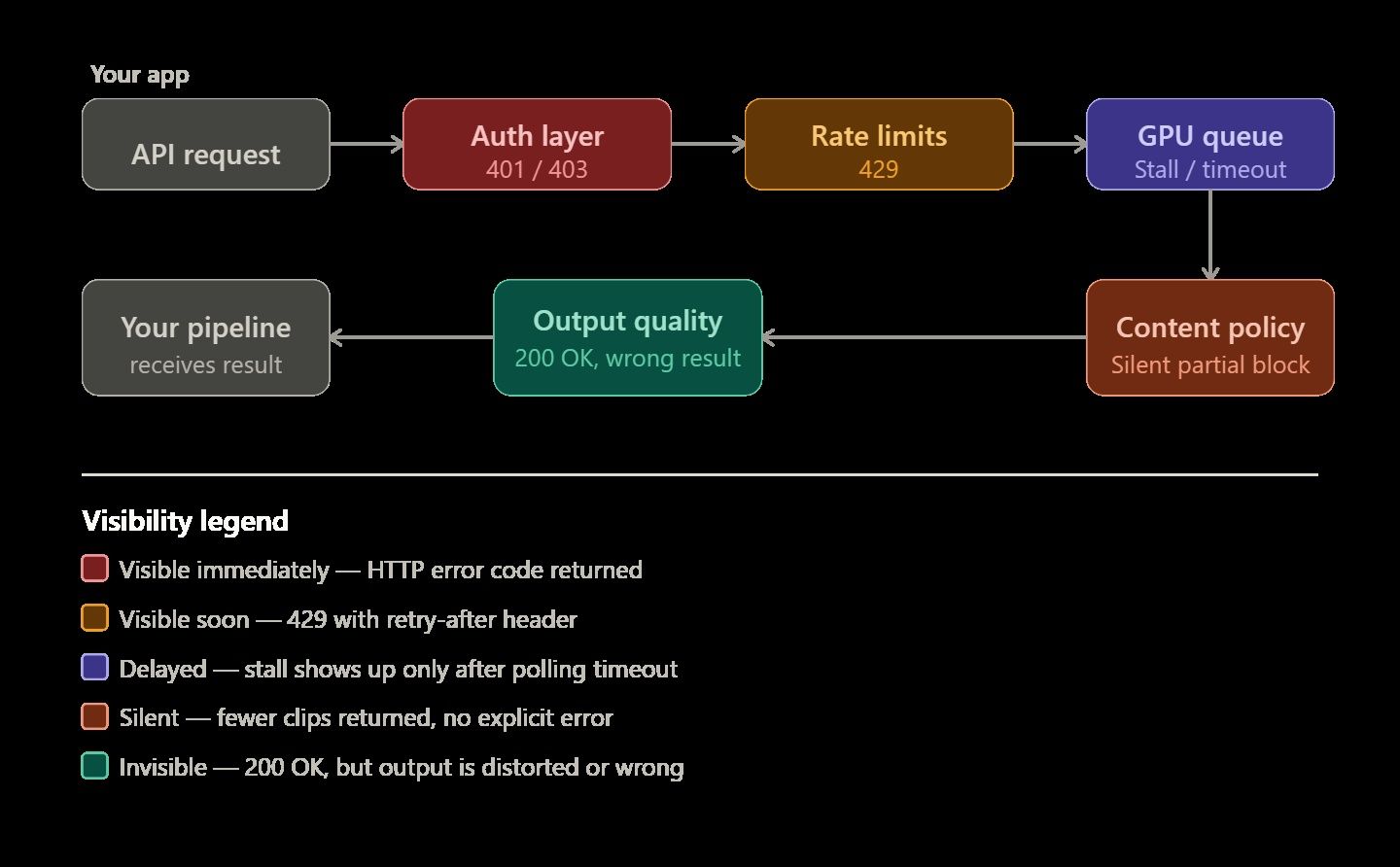

AI 视频生成 API 以“反复无常”著称,这并非毫无根据。文本补全任务一旦出错,会立即返回 400 错误。视频渲染则更为复杂且不可预测。任务可能会在 GPU 队列中无限期等待而没有任何警告;可能只返回请求片段的一半;有时渲染看似完美结束,但最终生成的视频看起来却不符合物理规律或严重扭曲。

你需要了解这些具体错误产生的原因,才能构建可靠的系统。这种知识是区分简单演示与能够真正服务于用户的视频生产流程的核心关键。

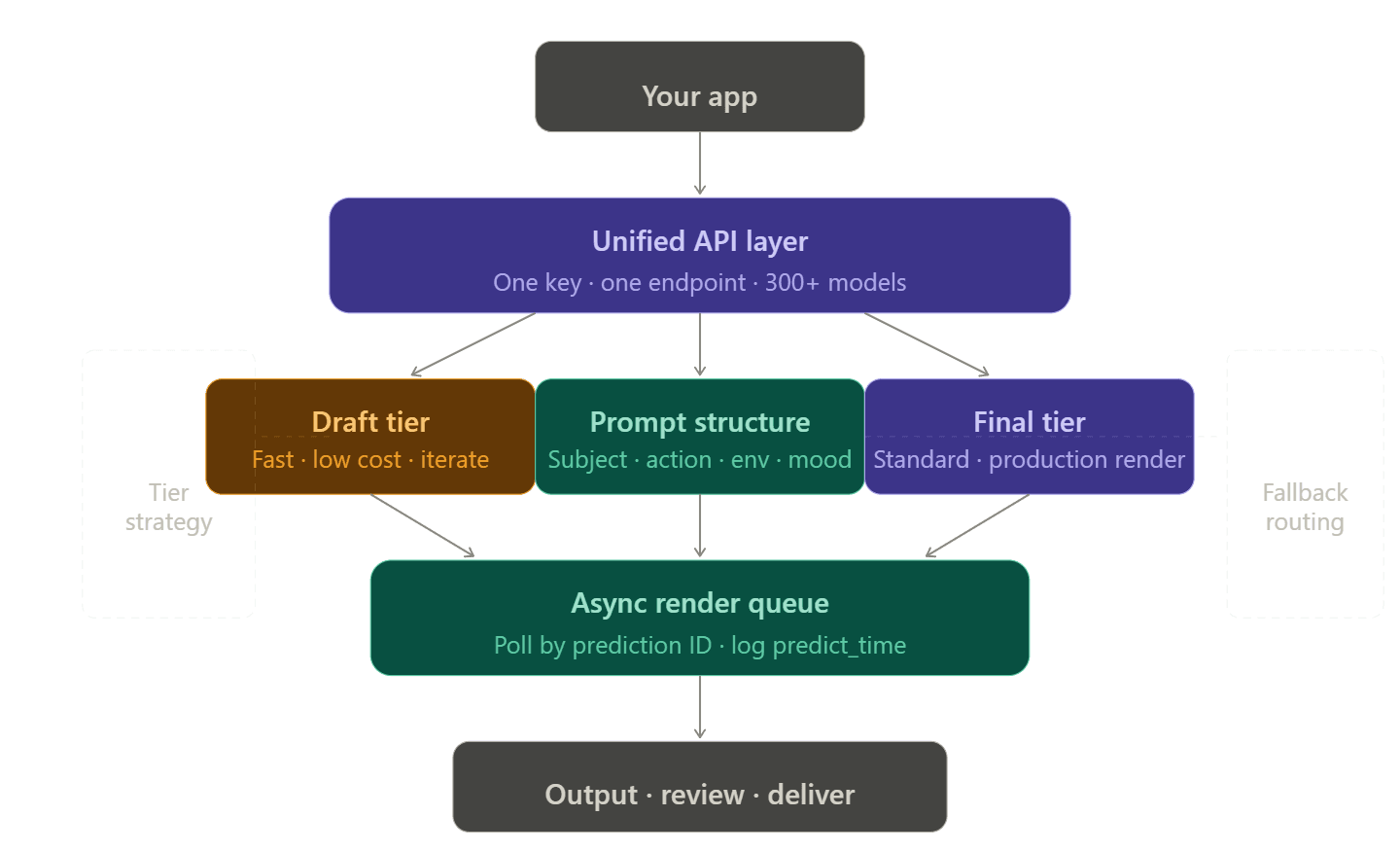

本指南将详细介绍最常见的失败模式、如何准确解读 API 响应,以及构建低成本、高稳定性视频渲染流程的具体策略。代码示例使用了 Atlas Cloud API,这是一个统一的推理平台,可通过单一端点调用 300 多种视频和多模态模型,是研究多模型模式的实用参考。

AI 视频 API 错误的五大分类

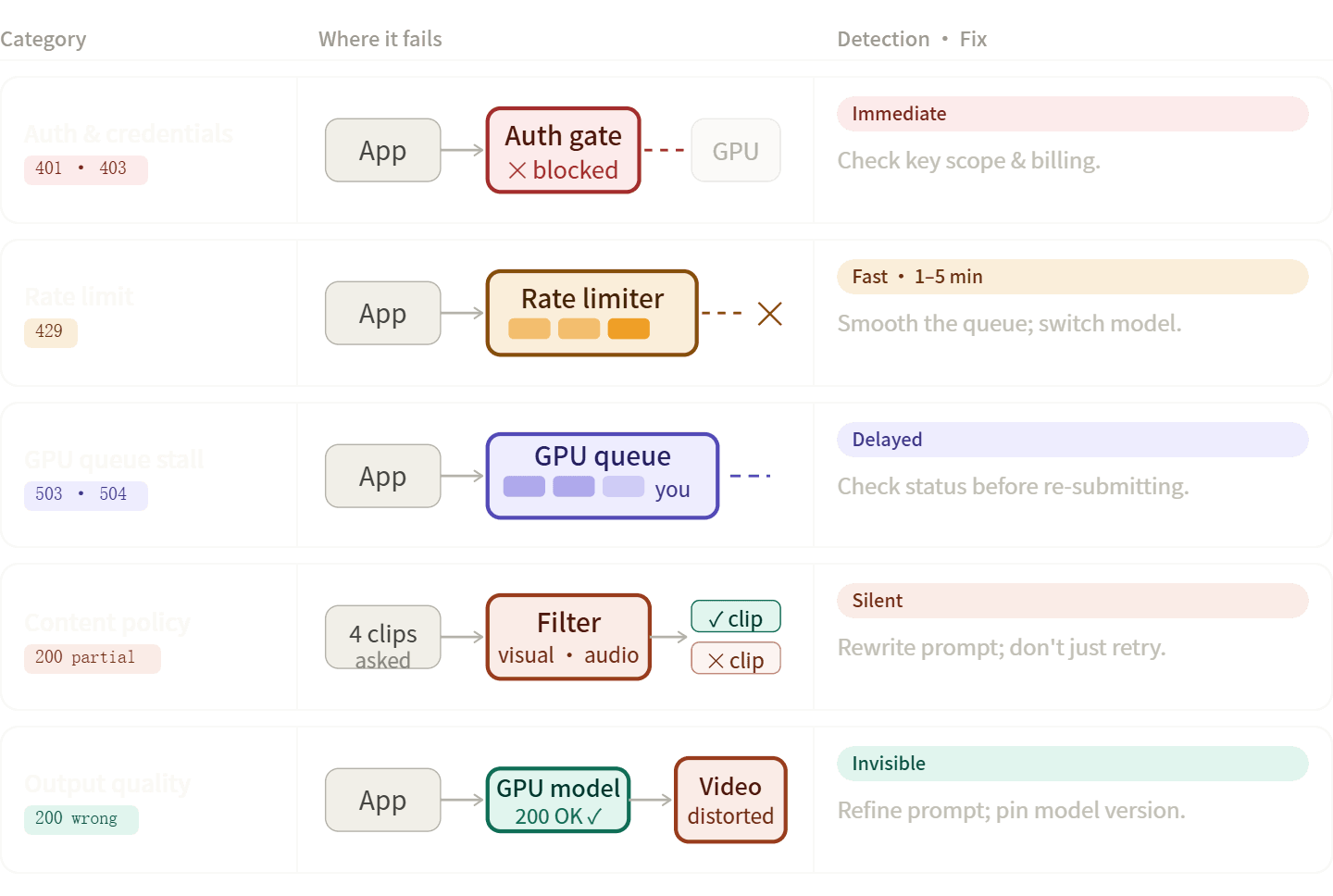

AI 视频处理流程中的错误通常归入五个特定类别。掌握这些分类有助于你更快地解决问题,例如判断是该修改代码、重写提示词,还是只需等待。

认证与凭据错误 (401, 403)

| 错误代码 | 典型原因 | 解决方法 |

| 401 Unauthorized | 缺失或格式错误的 Authorization: Bearer 标头 | 验证密钥是否从环境变量加载,而非硬编码 |

| 403 Forbidden (配额) | API 额度耗尽 | 添加账单信息或升级套餐 |

| 403 Forbidden (权限) | 密钥缺少所请求模型的访问范围 | 使用正确的权限重新生成密钥 |

人们经常在此处感到困惑。因配额不足导致的 403 错误和因权限拒绝导致的 403 错误代码相同,但解决方法不同。不要只看状态码,务必阅读响应主体中的完整错误信息,以确定问题所在。

在像 Atlas Cloud 这样的平台上,单一 API 密钥覆盖所有模型,这意味着不会出现“认证漂移”(即提供商 A 的密钥可用,而提供商 B 的密钥已过期)的情况。

速率限制错误 (429)

视频 API 中的速率限制比文本 API 更具惩罚性,因为每个请求都会占用一个 GPU 插槽 30–90 秒。少量的并发请求就可能使在纸面上看起来很宽松的限制达到饱和。

首先要检查的关键区别:

- RPM (每分钟请求数): Google Veo 3.1 API 的生产模型允许 50 RPM;预览模型限制为 10 RPM,每个项目最多 10 个并发请求。

- 并发请求限制: 即使在 RPM 预算内,达到并发上限也会导致 429 错误。

- TPM (每分钟令牌数): 虽然在视频领域较少见,但在跨模态统一计费的平台上具有参考价值。

真正有效的方法:

| 方法 | 适用场景 | 不适用场景 |

| 指数退避 + 重试 | 瞬时爆发导致的 429 错误 | 达到并发上限的情况 |

| 流量平滑 / 请求排队 | 大规模批量处理流程 | 对延迟敏感的交互式体验 |

| 错峰调度 (夜间批处理) | 内容预生成工作流 | 实时生成场景 |

| 路由到较为空闲的模型变体 | 拥有多个同类模型的统一平台 | 单一提供商设置 |

内容策略与安全过滤器拦截

这些错误很容易被误诊,因为 API 响应并不总是明确的错误,可能只是返回的片段比你要求的少。Google 的 Veo 文档明确指出,如果返回的视频少于请求数量,说明部分输出可能被安全过滤器拦截,而不是整个请求在传输层失败。

两个不同的触发维度:

- 视觉提示词: 主题内容、场景背景或隐含的暴力/露骨内容。

- 音频/对话提示词: 语音内容、歌曲请求以及复杂的音景都会触发独立的过滤器堆栈。

如果你的片段仅在提示词包含音频时失败,请将音频与视觉场景分开进行调试。对被策略拦截的提示词进行重试通常无效,必须修改提示词本身。

传输与基础设施错误 (500, 503, 504)

| 错误代码 | 典型恢复时间 | 处理措施 |

| 429 RESOURCE_EXHAUSTED | 1–5 分钟 | 退避并重试 |

| 503 Service Unavailable | 30–120 分钟 | 等待;查看状态仪表板 |

| 504 Gateway Timeout | 不定 | 在重新提交前检查渲染是否仍在处理中 |

| 500 Internal Server Error | 不定 | 记录预测 ID;在未检查状态前不要自动重试 |

处理 500/504 错误的关键原则:在重新提交之前,务必检查渲染任务是否仍在处理中。对 504 错误进行盲目重试会导致重复渲染,从而增加双倍成本。

输出质量失败

这些不是 HTTP 错误,API 返回 200,但输出结果不正确。常见形式包括:

- 视觉伪影或几何不准确: AI 视频是概率性的。模型是解释输入内容,而非进行物理计算。

- 支持音频的模型却缺失音频: 通常是提示词或参数问题,而非基础设施故障。

- 持续时间或分辨率错误: 由不支持的组合触发,并非所有模型都支持所有持续时间/分辨率对。

- 静默丢弃: 一些编码流程会在特定格式下静默丢弃视频,仅在质检时才会发现。

解读异步响应:预测 ID 与状态轮询

AI 视频生成本质上是异步的。请求-响应周期分为两个阶段:

- POST 请求到生成端点 → 接收一个 prediction_id

- GET 请求结果端点(使用该 ID)→ 轮询直到达到终止状态

Atlas Cloud 的响应结构展示了一个完成的预测结果示例:

plaintext1{ 2 "id": "pred_abc123", 3 "status": "completed", 4 "model": "bytedance/seedance-2.0/text-to-video", 5 "outputs": ["https://storage.atlascloud.ai/outputs/result.mp4"], 6 "metrics": { "predict_time": 45.2 }, 7 "created_at": "2025-01-01T00:00:00Z", 8 "completed_at": "2025-01-01T00:00:45Z" 9}

三种终止状态:

| 状态 | 含义 | 操作 |

| completed | 渲染成功;输出已就绪 | 在有效期内下载 |

| failed | 渲染失败;检查错误字段 | 记录错误消息;决定是否重试 |

| expired | 输出已不可用 | 如有需要,重新提交 |

最常见的轮询错误

开发人员习惯检查 status === "failed",但从不读取后续的 error 字段。该字段包含可操作的关键信息——没有它,你只能知道渲染失败,却无法判断是该修改提示词、检查额度,还是等待基础设施故障修复。

生产环境轮询模式

plaintext1import time 2import requests 3 4def poll_prediction(prediction_id: str, api_key: str, max_wait: int = 600) -> dict: 5 url = f"https://api.atlascloud.ai/api/v1/model/prediction/{prediction_id}" 6 headers = {"Authorization": f"Bearer {api_key}"} 7 terminal_states = {"completed", "failed", "expired"} 8 wait = 5 9 10 for _ in range(max_wait // wait): 11 resp = requests.get(url, headers=headers).json() 12 status = resp.get("status") 13 14 if status in terminal_states: 15 if status == "failed": 16 print(f"渲染失败: {resp.get('error')}") 17 return resp 18 19 time.sleep(wait) 20 wait = min(wait * 1.5, 60) # 将退避时间限制在 60 秒 21 22 raise TimeoutError(f"预测任务 {prediction_id} 未能在 {max_wait} 秒内完成")

在每次成功渲染后记录 metrics.predict_time。该数值的飙升是基础设施退化的预警指标——这在显性故障发生前是非常有用的信号。

构建稳健的渲染流程

单一供应商与统一 API 架构

为每个视频提供商管理多个账户、令牌和账单页面是非常麻烦的。开发人员常称之为“集成税”。如果一个模型达到限制,你需要备用方案,而备用方案又需要各自的 API 密钥、账单设置及处理错误的代码。问题会迅速恶化。

统一 API 平台通过单一端点路由多个提供商来消除这一痛点。在 Atlas Cloud 上,将模型从 openai/sora-2/text-to-video 切换到 bytedance/seedance-2.0/text-to-video 仅需修改一个字符串,其余标头、认证和计费逻辑保持不变。

草稿到成品的分级处理

选择最适合工作流程阶段的模型层级,是提升成本效益和可靠性的最有力手段:

| 阶段 | 推荐模型层级 | 原因 |

| 提示词探索 / 概念测试 | 快速/预算层 | 比标准版节省 78% 以上成本;错误暴露成本低 |

| 内部评审草稿 | 快速层 | 足以满足利益相关者评审需求 |

| 最终成品渲染 | 标准/专业层 | 质量差异足以抵消成本 |

| 批量内容 (社交媒体、营销) | 快速层 | 规模效应使得成本差异显著 |

在 Atlas Cloud 上,Seedance 2.0 的快速层运行成本为 $0.081/秒,而标准层为 $0.10/秒。这在规模化后差距显著:每月生成 200 个 10 秒短片的团队,快速层费用为 $162,而标准层为 $200。

将提示词工程作为防错手段

模糊的提示词是导致流程失败的被低估的原因。像“一个人在走路”这样的提示词会迫使模型进行过多的随意选择,产生不一致的输出,进而需要更多重试。

可靠的 4 组件提示词结构:

plaintext1[主题 + 细节] + [动作 + 运动风格] + [环境 + 灯光] + [运镜 + 氛围] 2 3示例: 4"一名穿着红色外套的女性在夜晚雨后的东京街道上快步前行, 5湿润路面反射着霓虹灯光,中景跟随拍摄,电影感,紧张氛围"

在使用支持多模态输入的模型时(Seedance 2.0 最多接受 12 个参考文件,包括图像、视频片段和音频),提供视觉参考可以减少歧义,从而降低输出质量问题。

选择合适的模型

并非所有的 AI 视频工具失败原因都相同,因为它们的目标各异。为特定任务选择错误模型是一个严重错误。这会导致看起来像技术故障的糟糕结果,但通常是因为模型本身并不擅长执行该任务。

模型能力参考

| 模型 | 优势 | 注意点 | 定价 (Atlas Cloud) |

| wan 2.7 | 物理模拟,真实的物体交互 | 仅限单图参考;成本较高 | $0.1/秒 |

| Kling 3.0 | 高分辨率输出;原生口型同步;免费额度 (每天 66 积分) | 最高分辨率下生成时间较长 | $0.071–0.143/秒 |

| Veo 3.1 | 电影级质量;强大的安全合规性 | 预览版模型速率限制 (10 RPM) | $0.05–0.20/秒 |

| Seedance 2.0 | 多参考输入控制;原生音频 | 需要更仔细的提示词构建 | $0.081–0.10/秒 |

| Wan 2.6 | 最低成本;大批量内容 | 无原生音频;最高 1080p | $0.018–0.07/秒 |

定价数据源自 Atlas Cloud 文档,2026 年 4 月。具体定价请咨询官方网站。

何时切换模型与修正请求

切换模型的情况:

- 当提示词中包含音频或对话时,片段持续失败(模型可能缺乏音频能力)

- 失败原因是物理规律或物体交互质量,而非提示词问题

- 你使用的是受速率限制的预览模型,而生产模型没有此类限制

修正提示词的情况:

- 输出结果在风格上不符,但在结构上正确

- 安全过滤器拦截了特定语言

- 持续时间或分辨率参数被拒绝

锁定特定版本字符串(例如 kling-v3.0-std 而不是 kling-latest)。静默的模型更新可能引入难以调试的质量回退,锁定版本可避免此类问题。

调试工具包

各阶段应记录的内容

日志记录是将调试时间减半的最快方法。有效的最小化日志应包含:

请求时:

- 模型 ID 和版本

- 提示词哈希(而非完整提示词,以保持日志精简)

- 持续时间、分辨率和模式参数

- 时间戳

响应时:

- 预测 ID

- 初始状态

- 任何即时的错误信息

轮询完成时:

- 最终状态

- metrics 中的 predict_time

- 错误字段内容(如果失败)

- 输出 URL(如果完成)

解读基础设施错误与应用错误

当生成失败时,以下诊断顺序可节省时间:

- 首先查看 API 健康仪表板 — 如果平台本身运行异常,那么调试方向就是错的。

- 读取 x-deny-reason 响应标头 — egress 代理拒绝会在此处体现,若无此标头,它们看起来很像模型错误。

- 如果是从前端调用,请检查 CORS 错误 — 它们在浏览器开发者工具中表现出的症状与认证失败相同。

- 在假设模型错误前检查文件约束 — 大多数平台强制规定最大输入文件大小(通常为 16 MB)以及受支持的有限格式集。

Atlas Cloud 的监控面板会显示自动缩放状态和每请求使用数据,这有助于区分是基础设施较慢还是提示词/代码问题。

成本优化

三大杠杆

渲染成本由三个变量决定。同时优化这三者(而非单纯选择更便宜的模型)能带来最大收益:

| 杠杆 | 低成本选择 | 高成本选择 | 典型倍数 |

| 模型层级 | 快速 | 标准/专业 | 3–5 倍 |

| 持续时间 | 4–5 秒 | 12–15 秒 | 3 倍 |

| 分辨率 | 720p | 4K | 2–4 倍 |

单个 8 秒 4K 标准渲染的成本可能是同等时长的快速 720p 渲染的 6–8 倍。如果你的分发渠道是社交媒体或网页,用户通常无法察觉 720p 与 1080p 的区别。

按使用量计费 vs. 订阅计费

消费者 AI 套餐(例如 $19.99/月的 Google AI Pro 或 $249.99/月的 AI Ultra)虽然通过 Google AI 界面提供有限的视频生成能力,但不包含 API 访问权限。这是团队从消费者工具迁移到生产流程时常犯的预算规划错误。

Atlas Cloud 采用按使用量计费模式,使你的成本与实际构建量相符。这最适合需求随周变化的项目。你应该追踪单位完成视频的秒成本,这是公平比较不同模型和价格层级的最佳方式。

参考资源复用

如果你生成了许多包含相同角色、场景或风格参考的片段,请预先注册这些资源:

- 仅上传一次参考图像或视频,并存储返回的资源 ID

- 在后续请求中直接传入 asset://<ark_asset_id>,而非重复上传

- 大多数平台不计算参考文件上传的用量,仅对生成的输出时长计费

生产就绪检查清单

在将视频生成流程推向生产环境前,请确认以下每一项:

认证

- API 密钥从环境变量加载,而非硬编码

- 密钥拥有所用所有模型的正确权限范围

- 密钥轮换策略已到位

速率限制与并发

- 已确认每个模型层级的 RPM 和并发请求限制

- 批量工作流已实现流量平滑或排队机制

- 速率限制场景下已配置备用模型

错误处理

- 所有终止状态(completed, failed, expired)均已处理

- 每次失败状态均已捕获并记录 error 字段

- 子进程/请求超时时间设置为 ≥ 10 分钟以应对长渲染

- 在检查状态前不会对 500/504 错误进行盲目自动重试

内容与提示词

- 提示词已针对平台内容准则进行预审

- 测试中已隔离音频和视觉触发条件

- 已将 4 组件提示词结构采用为团队标准

模型配置

- 已锁定特定版本字符串(而非 latest)

- 模型层级与工作流程阶段匹配(草稿用快速层,成品用标准层)

- 已确认所选模型的所有必需参数(持续时间、分辨率、音频)

成本控制

- 按使用量计费仪表板已配置预警

- 所有非成品渲染默认使用快速层

- 重复使用的资源已使用资源 ID

可观测性

- 每次渲染均记录预测 ID、状态和 predict_time

- API 健康仪表板已收藏,并在深入调试前先行查看

- 已配置 predict_time 飙升告警

构建一个能够处理错误的视频流程并不比一个容易崩溃的流程难多少。你只需要在每一步处理失败时保持清醒,确保日志记录扎实并锁定具体的模型版本。在考虑其他事情之前,先建立一个能从快速草稿到成品渲染的完整流程,其余的自然水到渠成。

常见问题解答

预览版套餐中出现的 429 Resource Exhausted 错误是由什么引起的?

429 错误仅表示你已触及速率限制。为了系统顺畅运行,提供商会限制你的请求和令牌额度。

- 解决方法: 在你的代码中添加指数退避策略。这有助于系统自动等待并重试。同时检查仪表板中的“使用层级”。你需要增加预算以解锁更快的速度。

如何避免“内容审核”误报?

安全过滤器经常将技术性提示词误解为违规内容。

- 解决方法: 通过将模糊词替换为专业词汇来修正提示词。例如,不要说“混乱能量”,而应说“高速摄像机运动”。你也可以使用 LLM 来优化你的提示词,将其转化为机器更易理解的清晰描述,从而避免错误。

如何降低渲染流程的延迟?

延迟通常源于糟糕的轮询机制或巨大的模型尺寸。使用 Webhooks 代替手动轮询以接收完成数据。如果自建托管,应用 FP8 量化以加速推理。对于 API 用户,切换到 异步处理以并行处理多个生成任务,而非串行执行。