4 月初,一款名为"HappyHorse-1.0"的模型突然出现。它在 Artificial Analysis 视频排行榜的四个类别中均名列榜首,以显著优势击败了字节跳动的 Seedance 2.0 和 Kling。

当时没有新闻发布会,没有博客文章,公司名称也模糊不清。模型页面上只是简单地写着"即将推出 (coming soon)"。

4 月 10 日,阿里巴巴的 ATH 部门确认了该项目。HappyHorse 是 ATH 创新部门的一个内部研发项目,目前处于内测阶段。API 将于 4 月 30 日发布。

此外,HappyHorse-1.0 将完全开源。它被誉为首个能够原生同步生成音视频的开源视频模型。

这种"静默发布"后紧跟"重磅官宣"的做法正成为中国 AI 公司的一种趋势。小米在"Hunter Alpha"代号模型上采用了这种做法,智谱 AI 也在其新的 GLM 模型中使用了"Pony Alpha"。

在本文中,我们将为您揭开有关 HappyHorse 的已知事实及其背后的意义。

HappyHorse 在排行榜上的位置

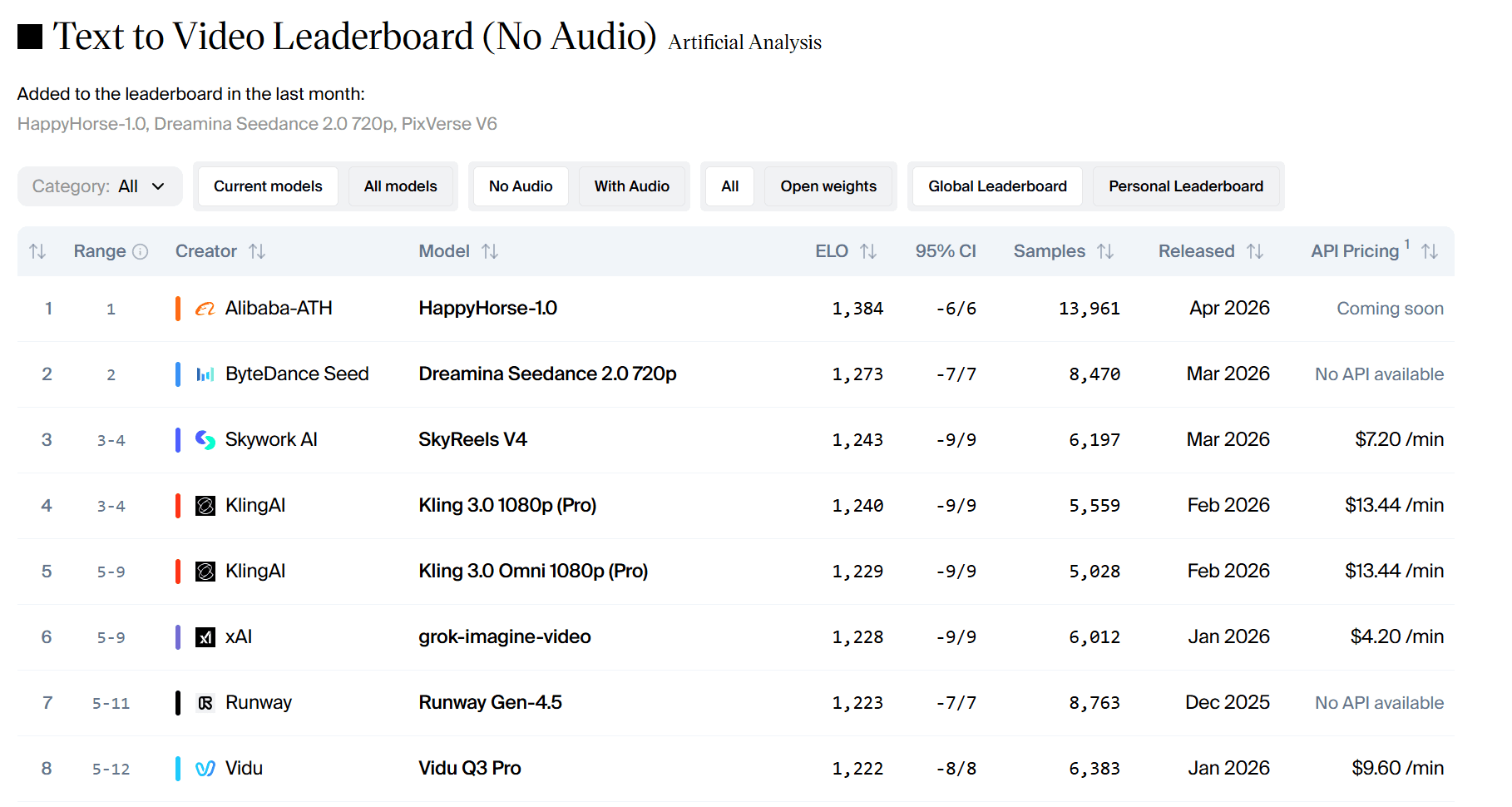

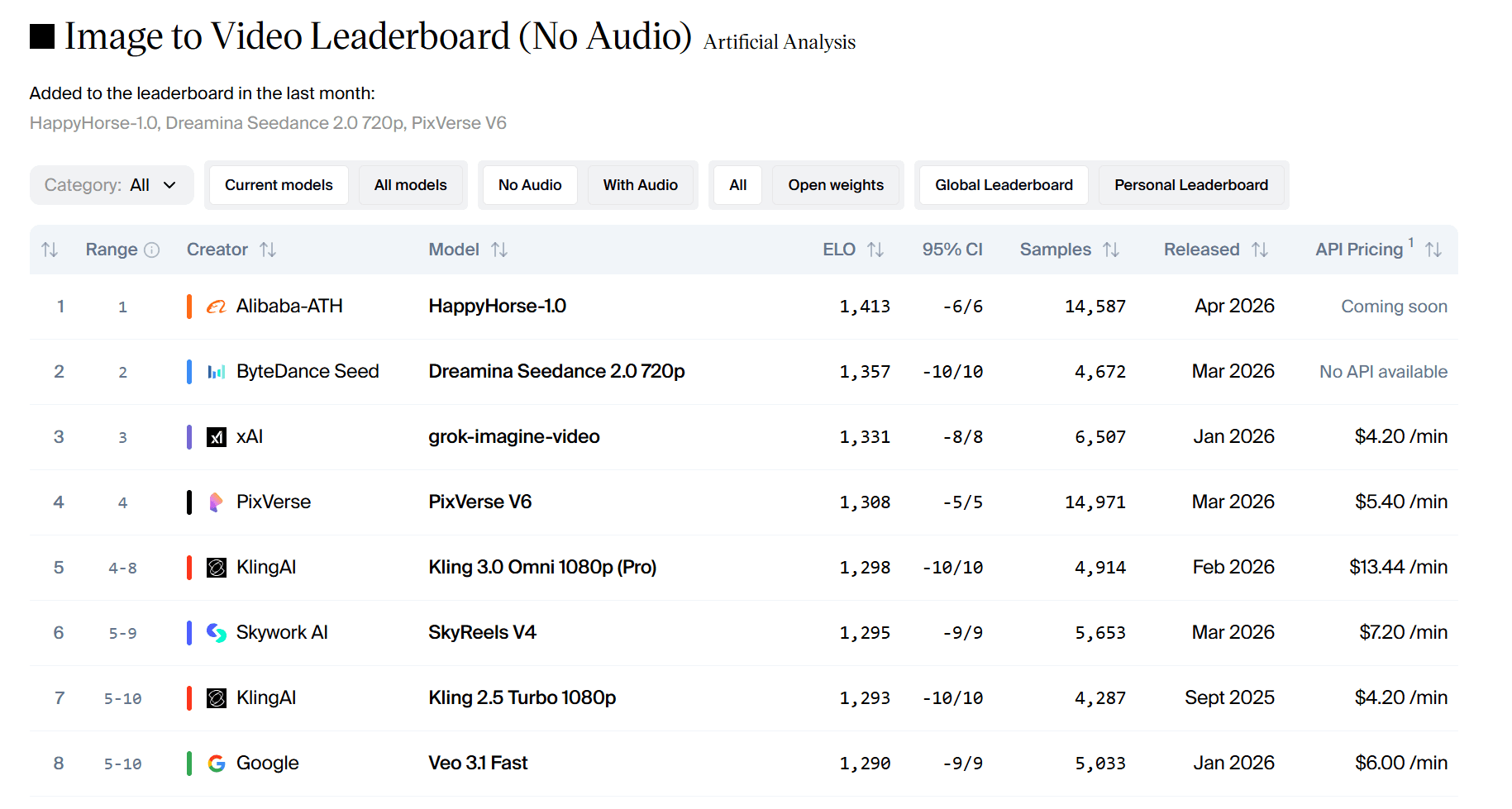

Artificial Analysis 运营着四个排行榜:无音频文生视频、无音频图生视频、有音频文生视频以及有音频图生视频。

截至 4 月 13 日中午的数据如下:

- 文生视频(无音频):1384 Elo 分。比 Seedance 2.0 高出 111 分。

- 图生视频(无音频):1413 Elo 分。这是该平台有史以来记录的最高分。

在 Elo 分数中,超过 60 分的差距表明了明显的偏好。111 分的差距意味着在盲测中,用户绝大多数选择了 HappyHorse。

然而,当加入音频时,情况发生了变化。差距缩小到仅 1-2 分,实际上打成了平手。这表明 HappyHorse 的音视频同步和音质并没有表现出压倒性优势。在这方面,它与 Seedance 基本持平。

HappyHorse 与 Seedance 2.0 的对比

| 项目 | HappyHorse-1.0 | Seedance 2.0 |

| 模型性质 | 开源 | 封闭商业系统 |

| 架构 | 统一 Transformer (Unified Transformer) | 双向扩散 Transformer (DB-DiT) |

| 多模态能力 | 同时音视频生成 (One-pass) | 多模态输入 (文本、图像、视频、音频) |

| 视频生成模式 | 一步生成 (One-pass) | 流水线生成 (Pipeline-based) |

| 视频生成时长 | 约 5–10 秒 (1080p) | 最长约 60 秒 (2K) |

两者代表了不同的理念。

HappyHorse‑1.0:开源。统一 Transformer 架构。同步音视频生成。单次生成处理。原生支持 7 种语言的口型同步。150 亿参数。在 H100 环境下生成 5 秒 1080p 视频需要 38 秒。

Seedance 2.0:封闭商业系统。双向扩散 Transformer (DB‑DiT)。多模态输入。能够生成 60 秒 2K 视频。支持 8 种以上语言的口型同步。

就纯视觉质量而言,HappyHorse 在盲测中明显胜出。就音视频同步和音质而言,两者大致相当。就易用性而言,Seedance 通过火山引擎等服务已经提供了成熟的 API。HappyHorse 的 API 计划于 4 月 30 日发布,其内测性能仍待验证。

由 Artificial Analysis 提供的 HappyHorse-1.0 与 Dreamina Seedance 2.0 的生成示例对比(有音频文生视频):

提示词:一部皮克斯风格的短动画,关于一个胆小的交通锥,梦想成为大型比赛终点线上的路标。其他的交通锥嘲笑它的雄心壮志。一名建筑工人无意中把它放在了马拉松比赛的终点线上。当赛跑选手经过时,交通锥的表情从恐惧变成了喜悦。五彩纸屑从头顶飘落。其他交通锥在电视上看到了这一幕,深受鼓舞。音频:从交通噪音到人群欢呼声,再到振奋人心的音乐。

关于架构

HappyHorse 采取了一种不同寻常的方法。

它拥有 150 亿参数,使用 40 层统一自注意力 Transformer。文本、视频和音频标记都输入到同一个序列中并进行联合建模。这与常见的"先生成视频,再添加音频"的流水线模式有显著不同。在这里,声音和场景从一开始就存在于同一个语义空间中。

该模型使用了 DMD-2 蒸馏技术和 MagiCompiler 的全图优化。在单块 H100 GPU 上,生成 5 秒 1080p 视频大约需要 38 秒。

它原生支持 7 种语言的口型同步:英语、普通话、粤语、日语、韩语、德语和法语。其词错误率 (WER) 是所有开源模型中最低的之一。

参加 Artificial Analysis 盲测的用户表示,HappyHorse 在人物刻画方面表现尤为突出。皮肤质感和动作的流畅度更胜一筹。测试样本中有超过 60% 是肖像或谈话头像片段,这也是推动该模型登顶的一个因素。

然而,也存在批评的声音。泄露的视频指出,画面存在不自然的波纹、快速移动主体上的条纹伪影,以及在大屏幕上画质下降的问题。

开源与访问计划

4 月 9 日,HappyHorse‑1.0 宣布将完全开源。GitHub 存储库已经上线,权重完全公开,且没有商业限制。

官方网站提供了文生视频和图生视频的在线演示。据阿里巴巴 ATH 称,API 计划于 4 月 30 日向公众发布。

不过需要提醒的是:据官方团队称,网上流传的大多数"官方网站"都是假冒的。真正的官网尚未完全投入运营。

市场影响与意义

HappyHorse 在 OpenAI 停止开发 Sora 两周后出现。其动作曾被视为 AI 视频领域停滞的迹象,但中国模型接过了接力棒。

市场反应迅速。阿里巴巴股价在确认消息后飙升超过 7%,并持续上涨。4 月 10 日收盘时,涨幅超过 3%,达到 126.6 港元。

从战略层面来看,HappyHorse 表明 ATH 拥有一支能够构建顶级多模态模型的第二梯队。这支团队拥有商业背景,理解用户需求和商业场景。这创造了一种双引擎结构:通义实验室(专注于基础研究)和创新部门(从实际商业挑战中构建应用)。

回顾时间线:林俊阳在 3 月初离职,ATH 于 3 月 16 日成立。4 月 2 日,Qwen 3.6 Plus 在 OpenRouter 的全球调用量中排名第一,4 月 8 日,HappyHorse 登顶 Artificial Analysis 榜单。在一个月内,阿里巴巴在语言模型和视频模型方面都取得了强大的成果。

团队背景:张迪与阿里巴巴 ATH

HappyHorse 背后的核心人物是重量级的张迪。

他曾是快手的副总裁,担任可灵 AI 的技术负责人,被称为"可灵之父"。他于 2025 年 11 月离开快手,接任阿里巴巴"未来生活实验室"负责人,直接向首席科学家郑博汇报。

五个月后,他的团队打造了 HappyHorse‑1.0,并击败了快手可灵和字节跳动的 Seedance 2.0。

该团队最初是淘宝未来生活实验室的一部分,但在阿里巴巴最新重组后,被划归至 ATH 业务集团的 AI 创新部门。

ATH 代表"Alibaba Token Hub",由 CEO 吴泳铭于 3 月 16 日建立并亲自领导。其使命是"代币的创造、提供和应用",整合了通义实验室、MaaS 业务线、千问部门、悟空部门和 AI 创新部门。

常见问题

在本地运行 HappyHorse 需要什么样的 GPU?

该模型拥有 150 亿参数,体量并不小。在单块 H100 环境下,生成 5 秒 1080p 视频大约需要 38 秒。像 RTX 4090 (24GB 显存) 这样的消费级 GPU 将需要量化或模型卸载。FP16 推理很可能超过 24GB 显存。一些用户报告通过 4-bit 量化取得了成功,但质量有所下降。对于严肃使用,建议使用具有 40GB 以上显存的云端 GPU。或者,明智的做法是等待 4 月 30 日的 API 发布。

我可以用自己的数据微调 HappyHorse 吗?

可以,在许可范围内。没有商业使用限制。然而,微调一个 150 亿参数的视频模型并不容易。它需要 H100 或 A100 集群、大量的视频-音频对数据集以及相当大的工程资源。GitHub 存储库目前不包含微调脚本,仅支持推理。团队已暗示未来会发布训练代码,但尚未确定日期。

是否有 Discord 或微信社区群?

有,但它们是非官方的。几个 AI 社区已经在 Discord 和微信上建立了讨论帖。官方团队尚未开设正式的社区频道。如果您加入群组,请当心虚假链接和钓鱼诈骗。最好查看 GitHub 存储库和阿里巴巴 ATH 的官方公告以获取最新信息。

该模型是否在 Hugging Face 上可用?

截至撰写本文时还没有。团队表示他们正在进行 Hugging Face 上的发布工作,但尚未完成。目前,权重仅在 GitHub 上。社区成员已经开始将转换后的检查点上传到 Hugging Face,但这些是非官方的。为安全起见,请在官方 Hugging Face 页面出现之前,使用 GitHub 来源。