AI 视频真正的瓶颈不在于输出看起来不对劲,而在于它感觉_太慢_了。

m2TCkQo3cYg

1. 为什么 15 秒的 AI 动作视频总是显得平淡

任何深入使用过 Seedance 2.0 的人都遇到过同样的限制:当你要求生成 15 秒的片段时,模型只会给你三四个镜头——仅此而已。

如果你输入一段打斗场景,出来的结果往往是:“战士走进来 → 举起武器 → 定格”。起势、动作、结束。片尾字幕。

但电影中的打斗并非如此。在重拳击出之前,肩膀先有转动;在闪避之后,反击已经蓄势待发。从全景追逐剪接到极限特写,再切至慢动作冲击——紧张感源于剪辑密度,而不是让单个镜头看起来更漂亮。

无论你如何写提示词,模型本身都不会自动为你提供十六个镜头。

这就是问题所在。以下是我们破解这一难题的方法。

2. 改变工作流的三个关键点

在完成了全流程的单角色动作演示后,我们总结了三个核心点:

① 动作的紧张感源于剪辑密度,而非单镜头质量。 别再执着于打磨一个完美的镜头了。请_先_将 15 秒内容拆解为 16 格分镜故事板,然后再交给视频模型。

② GPT Image 2 的真正强项在于剧本理解和镜头布局,而非风格统一。 我们最初希望 GPT Image 2 能在整个链路中锁定单一风格。经过测试,我们发现从参考图到视频的生成过程自然会向 CG 偏移,很难强制锁定。但 GPT Image 2 的真正强项在于——解读剧本、规划镜头、铺设 16 格故事板,这是我们模型池中其他模型无法比拟的。

③ 整个工作流运行在一个 AtlasCloud API Key 上。 GPT Image 2、Nano Banana 2 和 Seedance 2.0 都位于 AtlasCloud 的同一个模型池中。一个 Key,一个接口,一张账单,一个配额。无需繁琐的多供应商对接。

3. 单角色压力测试

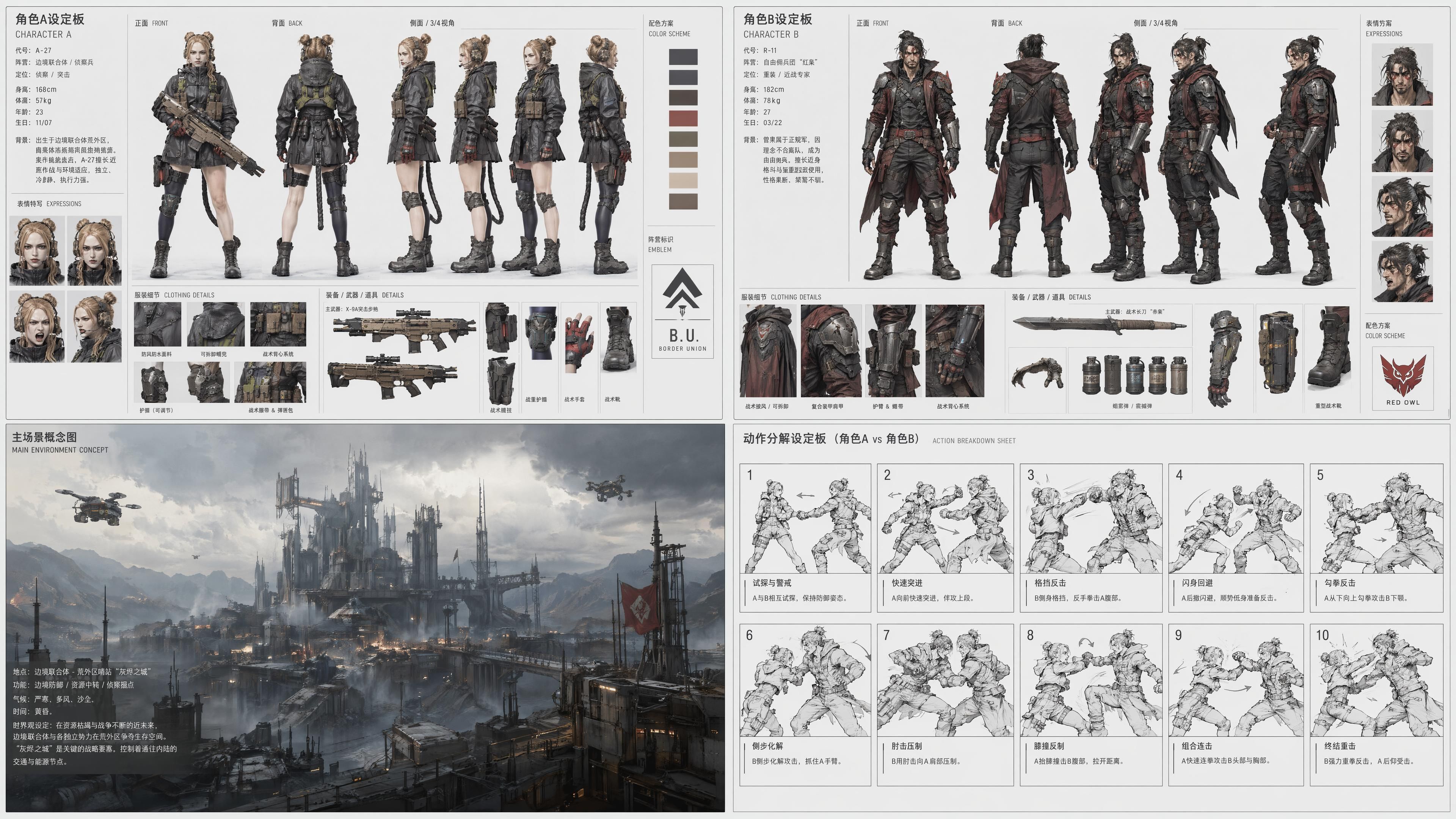

为了彻底测试 GPT Image 2,我们挑选了一个极具挑战性的角色。

来看看 Ranx——一名赛博战术特工。沙金色双丸子头。并且拥有四处完全非对称的装备设计:

- 仅右腿有黑色过膝袜

- 仅右大腿有红色硬壳枪套

- 仅右膝盖有青色管线

- 一根粗大的黑色线缆从腰带右后方一直缠绕到左小腿

我们只给模型提供了一张背部四分之三侧的参考图。模型必须自行推导出正面、侧面、表情和武器细节——并且在四处非对称设计中没有出现一次镜像翻转。

结果: 一次生成。六个转面图、四个头部特写、四个表情、武器面板、手部、脚部——全部在一张图上。所有四处非对称特征均被锁定。零镜像错误。

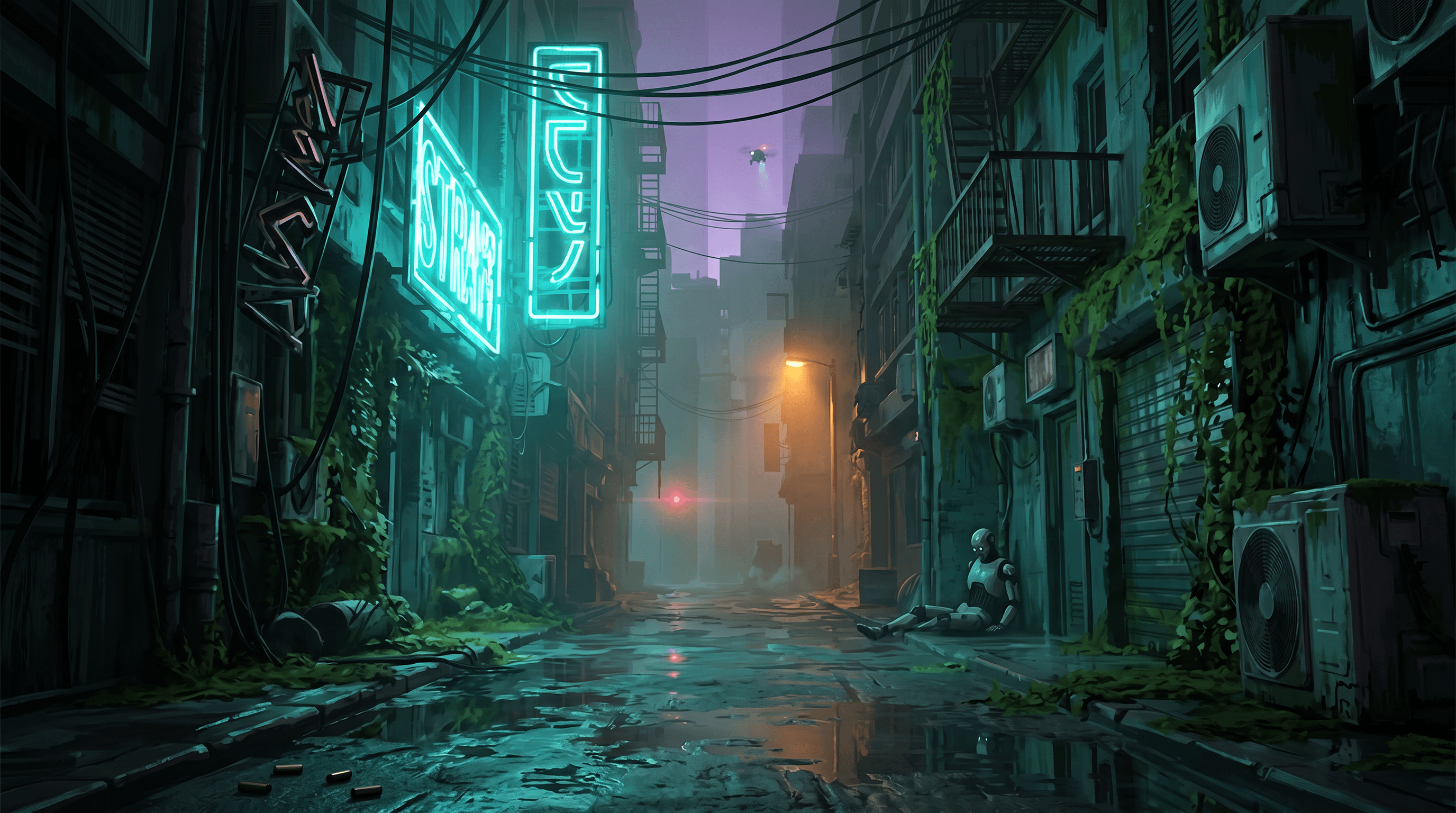

我们将环境视为成品设计参考(赛博朋克湿润后巷,类似《Stray》游戏的审美):

4. 验证方法的 A/B 对比

这是整个工作流赖以生存的实验。同样的剧本、同样的角色设定、同样的场景参考。唯一的变量是:是否有故事板。

对照组:仅有文字提示,无故事板

输入到 Seedance 2.0 的参考转视频流程:

- 1× 角色设定图

- 1× 场景参考图

- 一段详细描述了四个硬剪辑点的 15 秒文字提示

E6uub9qOmFM

画面清晰,制作尚可。但整个片段看起来大概只有 三个缓慢的节奏点 ——走进小巷、举起武器、定格。它读起来更像是一个角色演示,而非一场战斗。

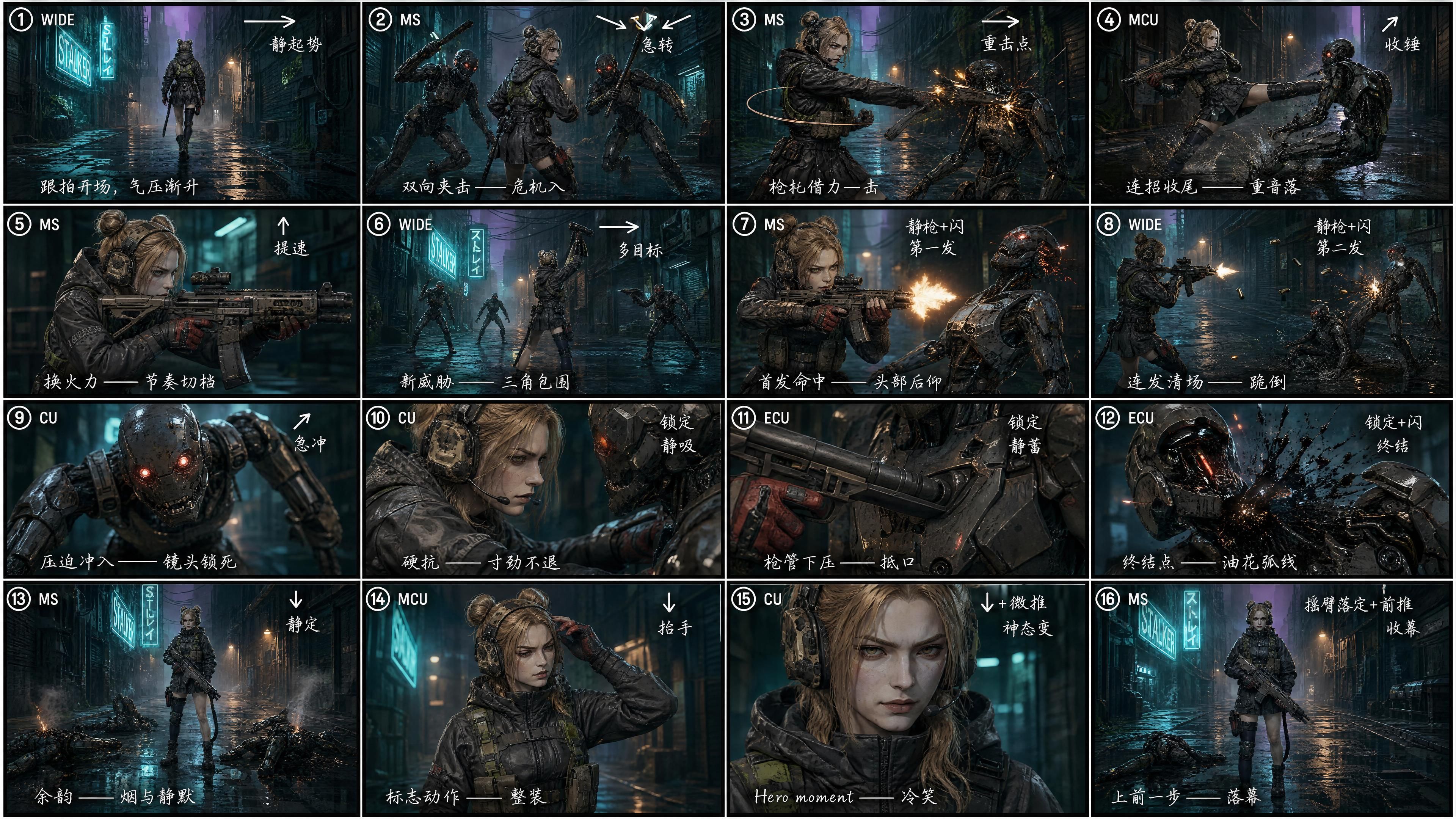

测试组:使用 16 格故事板

我们要求 GPT Image 2 将同一剧本拆解为 4×4 = 16 格 的故事板,每格都标记了:

- 镜头编号 (① ② ③ … ⑯)

- 镜头景别 (WIDE / MS / CU / ECU)

- 运镜箭头 (→ ↘ ↙ ↑ ↓ ↗)

- 节奏标记 ("static rise" / "hard cut" / "impact" / "kill shot" / "outro")

- 中文手绘导演备注 —— 这完全是基于密度考量,中文可以在有限的分镜格中容纳更多导演意图(GPT Image 2 和 Seedance 2.0 对中英文的理解能力同样出色)

随后,只需一行提示词输入到 Seedance 2.0 的参考转视频功能中:

"生成一个严格遵循参考图 3 作为故事板的视频。强烈的电影感和镜头语言,夸张的动态效果,冲击力强的动作表现。"

l-btYYAZfHk

无需测量,差异显而易见。剪辑密度提升了约 4 倍。 从远景追逐到中景肩扛拍摄,再到枪口的极限特写,最后以英雄姿态定格——十五秒内容,被完全填满。同样的剧本,截然不同的节奏感。第一个版本感觉像演示,第二个则读起来像预告片。

这就是本工作流的核心逻辑:GPT Image 2 不是用来锁定风格的,它是用来将剧本拆解为高密度镜头序列的。

5. 进阶应用:双人对决

在单角色版本流畅后,我们挑战了双人对决。双人打斗最难的部分在于同时锁定 四件事 —— 角色 A、角色 B、环境以及动作节奏。

我们没有生成四张独立图片再拼凑,而是要求 GPT Image 2 在单张图像中处理所有四个要素:

- 角色 A (A-27):Ranx 的微调版——扎着沙金色马尾辫、身穿短款作战服的战术特工

- 角色 B:原创男性雇佣兵设计——黑红长风衣,束发,腰间佩戴大剑

- 环境:一个被称为_灰烬城 (Ash City)_的工业废土要塞——黄昏琥珀色光线,远处炉火闪烁,烟雾弥漫

- 十个手绘动作节拍:试探 → 冲刺 → 格挡 → 闪避 → 勾拳 → 反击 → 压制 → 膝撞 → 近身 → 倒地

需要指出的是:只有角色 A 使用了参考图(之前的 Ranx)。角色 B、整个环境以及所有十个动作节拍——都是 GPT Image 2 自行设计的。我们描述了氛围,它完成了其余部分。

风格、两个角色的身份、环境以及十个节拍——全部在一次生成中锁定。图像之间没有任何漂移,角色的服装在中间没有发生任何改变。

然后直接进入 Seedance 2.0 参考转视频:

tfYkRiuq-sY

以平台地板上的两个阵营徽记为锚点的屋顶对峙、中段的格斗擒拿,以及最后的摔技终结——十五秒的双人编舞,一次生成。

6. 为什么这个工作流仅需一个 API Key

过去,实现“角色→场景→分镜→视频”这一链路,意味着要在多个供应商之间不断切换 API Key、SDK、文档、计费和速率限制。你懂的,这很繁琐。

在 AtlasCloud 上,这一切都集成在一个接口之后:

| 步骤 | 模型 | 平台 |

|---|---|---|

| 角色设定 | GPT Image 2 | AtlasCloud |

| 场景概念 | Nano Banana 2 | AtlasCloud |

| 分镜故事板 | GPT Image 2 | AtlasCloud |

| 视频生成 | Seedance 2.0 | AtlasCloud |

一个 Key。一个接口。一个配额。一张账单。集成和运营开销降至几乎为零。

7. 总结:停止追求跨模型风格一致,开始发挥每个模型的长处

我们曾投入大量精力试图在链路的每一步锁定单一风格。但在参考转视频模式下,这是一场必输的战役——你越强求,输出效果反而越差。

当我们放弃这一目标后,工作流豁然开朗。让每个模型做它真正擅长的事情。

- GPT Image 2 —— 拆解剧本,规划分镜

- Seedance 2.0 —— 展开时间轴,渲染动作

- AtlasCloud —— 一个 Key,一条链路

如果你正在使用 AI 制作动作短片、打斗场景或双人编舞,这正是我们推荐的最佳工作流。

亲手试试

所有模型都在同一个 AtlasCloud 模型池中——一个 API Key 即可跑通整个链路:

- Seedance 2.0 (参考转视频) → atlascloud.ai/collections/seedance2

- GPT Image 2 (角色设定 + 分镜故事板) → atlascloud.ai/collections/gpt-image-2

- Nano Banana 2 (场景概念) → atlascloud.ai/collections/nanobanana-2

完整的步骤说明和本文使用的所有提示词,已随 YouTube 视频演示 一并发布。

去创作点什么吧。