مقدمة: ما هو Seedance 2.0؟

Seedance 2.0 هو الخلف المنتظر لنموذج توليد الفيديو متعدد الوسائط من ByteDance.

- الترقية: بينما أرسى Seedance 1.5 Pro الأساس للتوليد السمعي البصري الأصلي، من المتوقع أن يقدم الإصدار 2.0 "حقول الفيزياء الصوتية" و**"نماذج العالم المسبقة"**.

- الهدف: سد الفجوة بين توليد الذكاء الاصطناعي والواقع الفيزيائي. يهدف إلى العمل كمخرج شامل، يدير السرد السمعي البصري المعقد للفيديوهات التي تتجاوز 30 ثانية.

توقعات رئيسية: 3 ترقيات كبرى في Seedance 2.0 (متوقعة)

1. من مزامنة الصوت إلى "الفيزياء الصوتية"

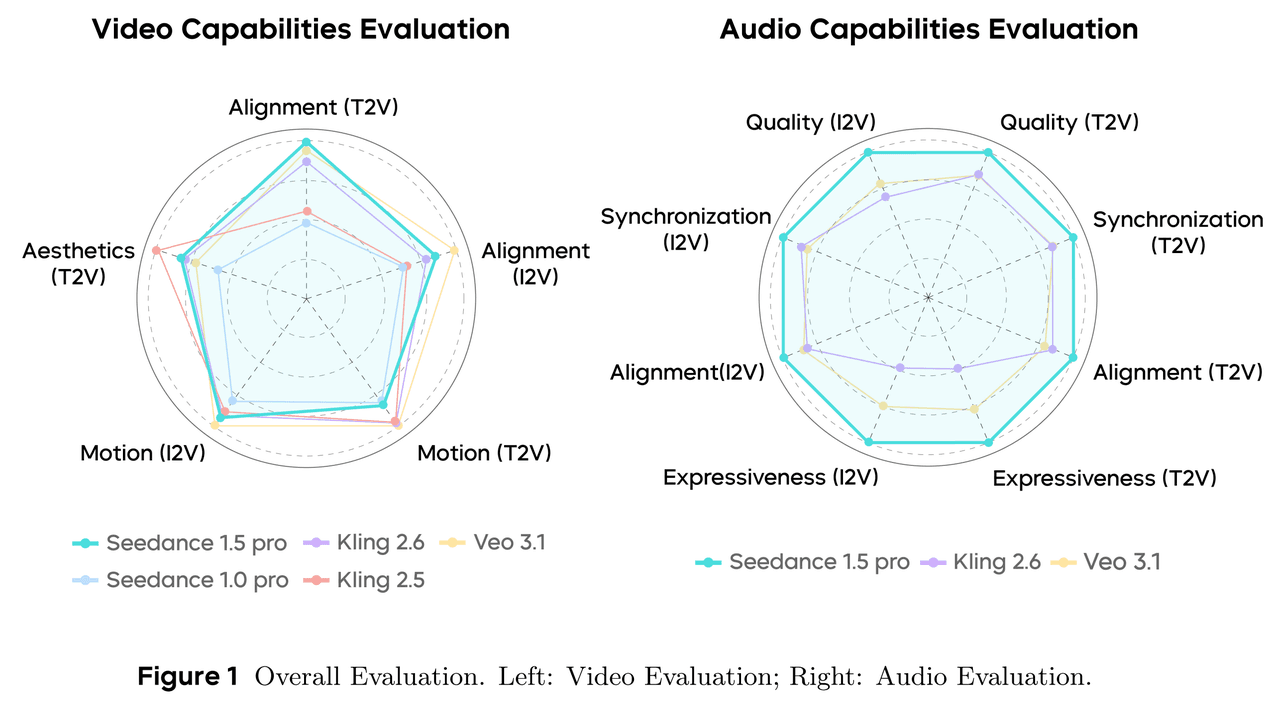

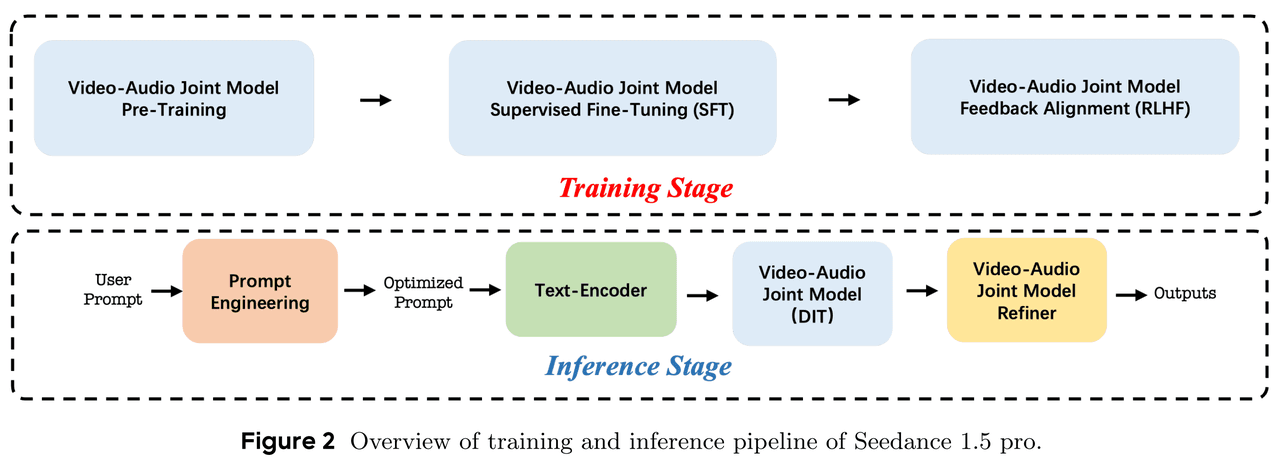

استخدم Seedance 1.5 Pro محول الانتشار ثنائي الفرع (MMDiT) لحل مشكلات مزامنة الشفاه. ومع ذلك، من المتوقع أن يقوم Seedance 2.0 بمحاكاة حقل صوتي كامل.

- فيزياء حقيقية متعددة الوسائط: إذا انكسر كوب زجاجي في الفيديو، فلن يكون الصوت الناتج مجرد تأثير صوتي عام. بل سيقوم بحساب الارتداد بناءً على مادة الأرضية (مثل السجاد مقابل البلاط) الظاهرة في الإطار.

- النماذج المسبقة الكامنة: يتضمن ذلك إضافة نماذج محرك فيزيائي مسبقة إلى بنية MMDiT، مما يعطي الصوت "ثقلاً" و"تأثيراً".

2. منافسة Wan 2.6: الاتساق في الفيديوهات الطويلة

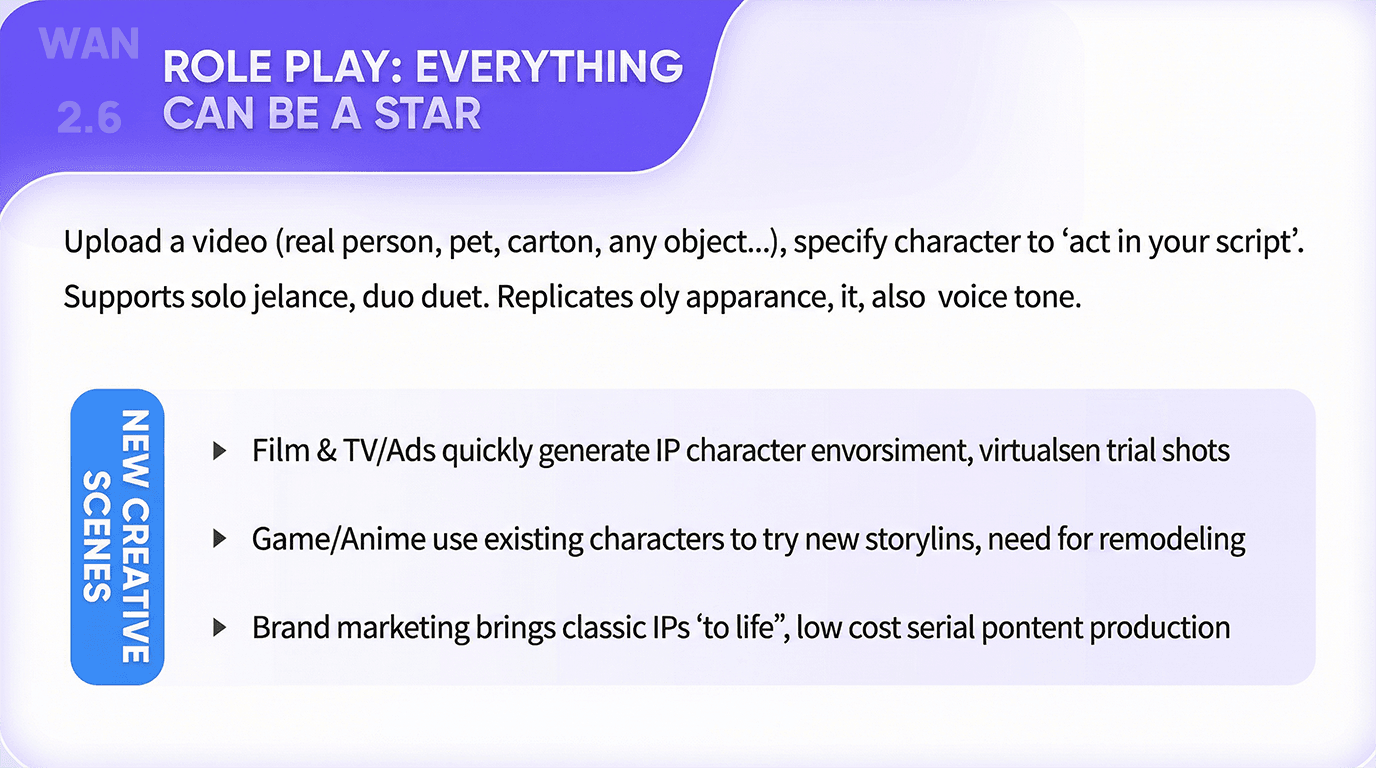

- حالياً، يهيمن Wan 2.6 على اتساق الشخصيات من خلال ميزة المرجع إلى الفيديو، والتي تعمل كشخصية LoRA بدون تدريب مسبق (zero-shot). ومن المتوقع أن يواجه Seedance 2.0 ذلك من خلال قفل "معرف العالم" (World ID).

- توليد أطول: بكسر "لعنة الـ 12 ثانية"، يستهدف Seedance 2.0 التماسك الأصلي لفيديوهات مدتها 30-60 ثانية.

- الانتباه الزمني: من المرجح أن يسمح تحسين ما بعد التدريب المعزز للنموذج بـ "تذكر" الأحداث من الثانية الأولى والإشارة إليها في نهاية المقطع.

3. تحكم بمستوى المخرج

- من المتوقع أن يقدم Seedance 2.0 إمكانيات التحكم القائم على العقد والمعاينة في الوقت الفعلي.

- الترميم الجزئي وإعادة مزج الصوت: قد يتمكن المستخدمون من اختيار شخصية وتعديل حركتها أو عاطفة الحوار (مثلاً، من الغضب إلى التوسل) مع الحفاظ على موسيقى الخلفية والبيئة دون تغيير.

مقارنة: Seedance 2.0 مقابل المنافسين

| الميزة | Seedance 1.5 Pro | Seedance 2.0 (متوقع) |

| البنية | MMDiT (سمعي بصري) | World-MMDiT (فيزياء + سمعي بصري) |

| الصوت | مزامنة الشفاه، محاذاة العواطف | محاكاة الفيزياء، التفاعل مع البيئة |

| المدة | قصيرة (~10 ثوانٍ) | طويلة (30-60 ثانية) |

| حمل الحوسبة | عالٍ | عالٍ جداً |

كيفية الوصول إلى Seedance 2.0: تحدي الأجهزة

توضح الوثائق التقنية لنسخة 1.5 Pro أنه على الرغم من أن التحسين زاد السرعة بمقدار 10 أضعاف، فإن الانتقال إلى إمكانيات "نموذج العالم" في Seedance 2.0 سيزيد بشكل هائل من متطلبات ذاكرة الفيديو (VRAM) والحوسبة.

من المرجح أن يكون تشغيل Seedance 2.0 محلياً — حتى على بطاقة NVIDIA RTX 4090 — مستحيلاً لمعظم المستخدمين بسبب حمل المعالجة الضخم متعدد الوسائط.

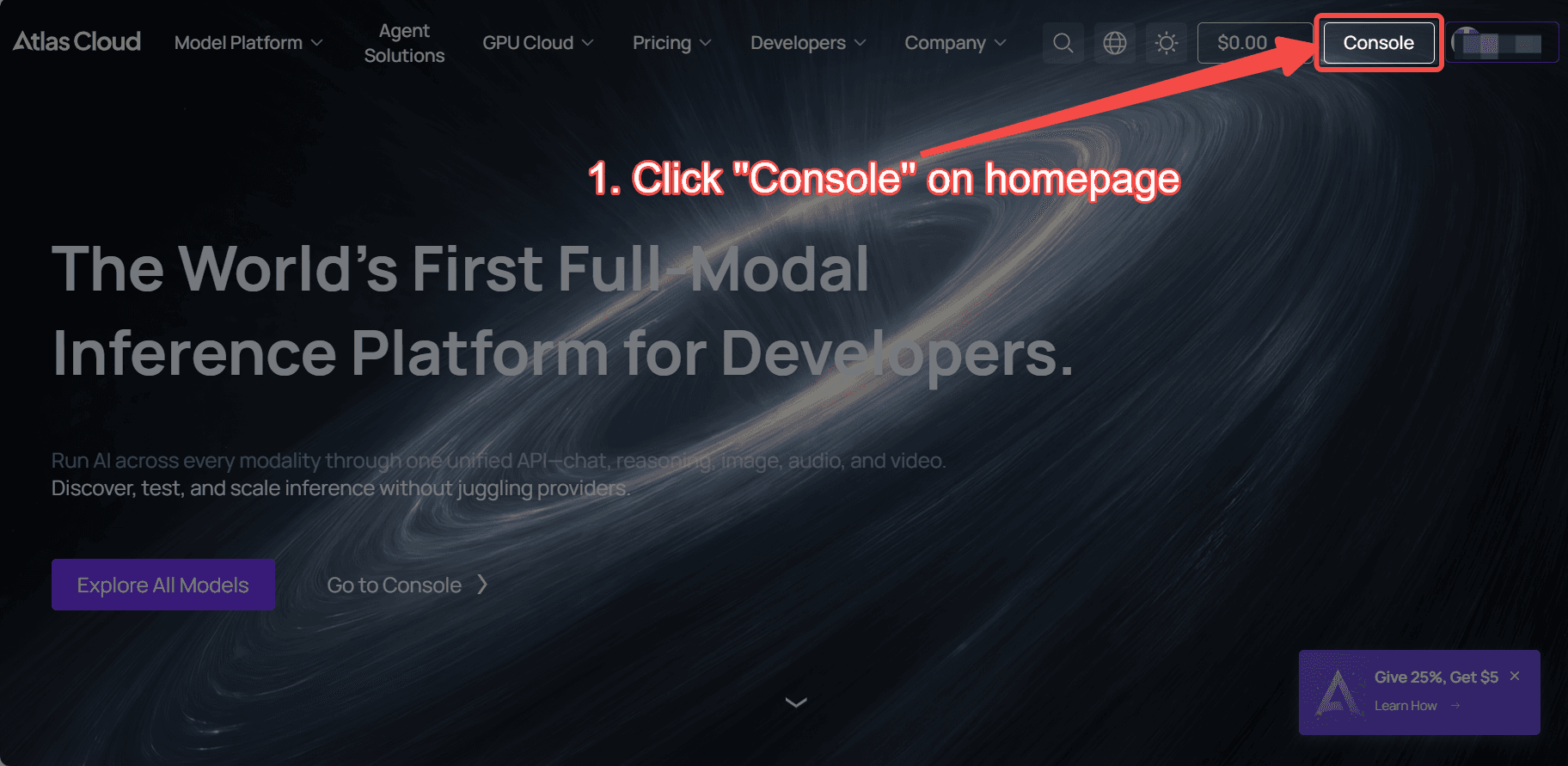

الحل: Atlas Cloud

منصة Atlas Cloud مستعدة للإطلاق. لقد دمجنا عائلة نماذج Seedance بالكامل وسندعم Seedance 2.0 في اليوم الأول من إصداره.

- نشر بدون تكوين: الوصول إلى نماذج مثل Seedance وKling وSora دون تعقيدات إعداد Python أو CUDA.

- الحوسبة المرنة: رفع قدرة وحدة معالجة الرسومات (GPU) لديك فوراً. ادفع بالثانية لتوليد فيديوهات طويلة ومعقدة دون إجهاد أجهزتك المحلية.

- الوصول عبر واجهة برمجة التطبيقات (API): يمكن للمطورين دمج قدرات Seedance 2.0 مباشرة في تطبيقاتهم عبر Atlas Cloud API فور إطلاقه.

لا تدع الأجهزة تحد من إبداعك. [سجل في Atlas Cloud] لتأمين وصولك الأولي لإطلاق Seedance 2.0 في منتصف فبراير.

كيفية الاستخدام على Atlas Cloud

tlas Cloud تتيح لك استخدام النماذج جنباً إلى جنب — أولاً في بيئة التجربة (playground)، ثم عبر واجهة برمجة تطبيقات واحدة.

الطريقة 1: الاستخدام مباشرة في بيئة تجربة Atlas Cloud

الطريقة 2: الوصول عبر واجهة برمجة التطبيقات (API)

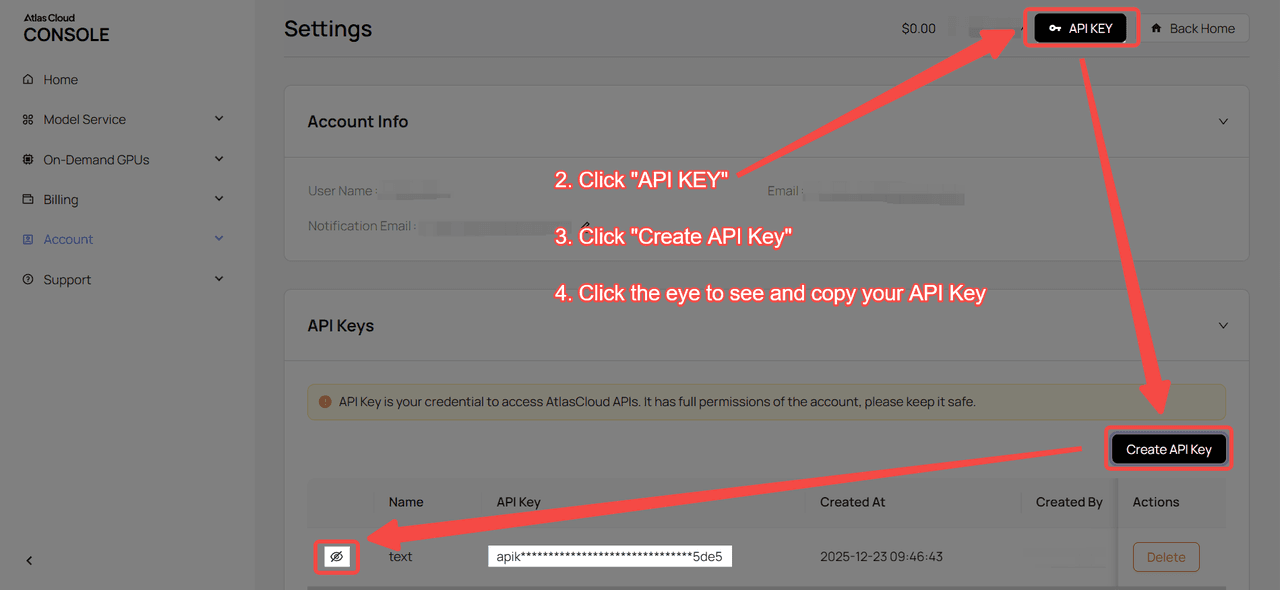

الخطوة 1: احصل على مفتاح واجهة برمجة التطبيقات الخاص بك

قم بإنشاء مفتاح API في لوحة التحكم وانسخه لاستخدامه لاحقاً.

الخطوة 2: تحقق من وثائق واجهة برمجة التطبيقات

راجع نقطة النهاية (endpoint)، ومعلمات الطلب، وطريقة المصادقة في وثائق واجهة برمجة التطبيقات.

الخطوة 3: قم بإجراء طلبك الأول (مثال بلغة بايثون)

مثال: توليد فيديو باستخدام Seedance 1.5 Pro:

plaintext1import requests 2import time 3 4# Step 1: Start video generation 5generate_url = "https://api.atlascloud.ai/api/v1/model/generateVideo" 6headers = { 7 "Content-Type": "application/json", 8 "Authorization": "Bearer $ATLASCLOUD_API_KEY" 9} 10data = { 11 "model": "bytedance/seedance-v1.5-pro/image-to-video-fast", 12 "aspect_ratio": "16:9", 13 "camera_fixed": False, 14 "duration": 5, 15 "generate_audio": True, 16 "image": "https://static.atlascloud.ai/media/images/06a309ac0adecd3eaa6eee04213e9c69.png", 17 "last_image": "example_value", 18 "prompt": "Use the provided image as the first frame.\nOn a quiet residential street in a summer afternoon, a young girl in high-quality Japanese anime style slowly walks forward.\nHer steps are natural and light, with her arms gently swinging in rhythm with her walk. Her body movement remains stable and well-balanced.\nAs she walks, her expression gradually softens into a gentle, warm smile. The corners of her mouth lift slightly, and her eyes look calm and bright.\nA soft breeze moves her short hair and headband, with individual strands subtly flowing. Her clothes show slight natural motion from the wind.\nSunlight comes from the upper side, creating soft highlights and natural shadows on her face and body.\nBackground trees sway gently, and distant clouds drift slowly, enhancing the peaceful summer atmosphere.\nThe camera stays at a medium to medium-close distance, smoothly tracking forward with cinematic motion, stable and controlled.\nHigh-quality Japanese hand-drawn animation style, clean linework, warm natural colors, smooth frame rate, consistent character proportions.\nThe mood is calm, youthful, and healing, like a slice-of-life moment from an animated film.", 19 "resolution": "720p", 20 "seed": -1 21} 22 23generate_response = requests.post(generate_url, headers=headers, json=data) 24generate_result = generate_response.json() 25prediction_id = generate_result["data"]["id"] 26 27# Step 2: Poll for result 28poll_url = f"https://api.atlascloud.ai/api/v1/model/prediction/{prediction_id}" 29 30def check_status(): 31 while True: 32 response = requests.get(poll_url, headers={"Authorization": "Bearer $ATLASCLOUD_API_KEY"}) 33 result = response.json() 34 35 if result["data"]["status"] in ["completed", "succeeded"]: 36 print("Generated video:", result["data"]["outputs"][0]) 37 return result["data"]["outputs"][0] 38 elif result["data"]["status"] == "failed": 39 raise Exception(result["data"]["error"] or "Generation failed") 40 else: 41 # Still processing, wait 2 seconds 42 time.sleep(2) 43 44video_url = check_status()