Alte KI-Bewegungstools waren voller Fehler und Body-Horror. 🫠

Die größten Mängel? Schlechte Hände, null Gesichtsemotionen und Körper, die sich wie Gummibänder dehnten.

Auftritt Kling 2.6. Es behebt die Bewegungssteuerung vollständig:

1️⃣ Gestochen scharfe Details: Perfekte Finger & Mikroexpressionen. Keine Unschärfe mehr.

2️⃣ Anatomie-Lock: Intelligentes Rigging hält die Körperproportionen zu 100 % konsistent. Kein Verzerren.

Wir haben 4 extreme „Gauntlet"-Tests durchgeführt, um es zu beweisen. Die Ergebnisse sind wahnsinnig. 👇

01 Die Daten: Die Konkurrenz im Staub zurücklassen

Nachdem Sie das Intro gesehen haben, fragen Sie sich vielleicht: „Es gibt viele Modelle da draußen, die Video-Referenzen unterstützen. Wan hat auch eine solide Bewegungssteuerung. Warum also behaupten, dass Kling 2.6 meilenweit voraus ist?"

Sehen Sie sich den Vergleich unten an, und die Antwort wird offensichtlich sein 👇:

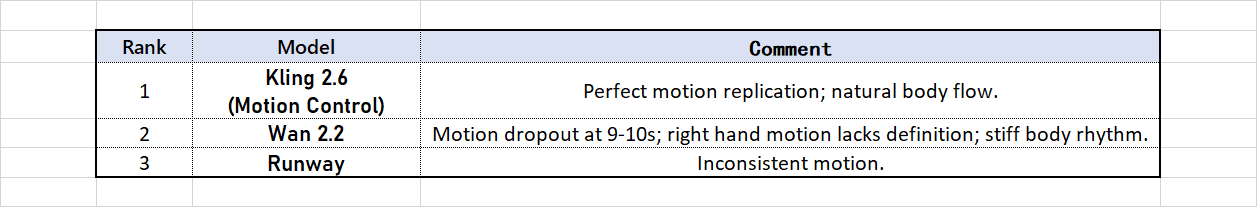

[Analyse-Aufschlüsselung] Diese vom Boxen inspirierte Tanzroutine stellt einen großen Belastungstest dar: das schnelle Armkreisen kombiniert mit dem rhythmischen Groove des Oberkörpers.

Kling 2.6 Motion Control liefert eine Meisterleistung ab. Achten Sie auf die Handroll-Bewegung bei der Marke 0:09: Kling repliziert nicht nur die Trajektorie perfekt; es fängt tatsächlich die kinetische Energie ein – man kann den Impuls spüren, der von der Schultermuskulatur ausgeht. Es maximiert die rhythmische Treue bei absoluter struktureller Integrität, ohne Verzerren oder Kollabieren.

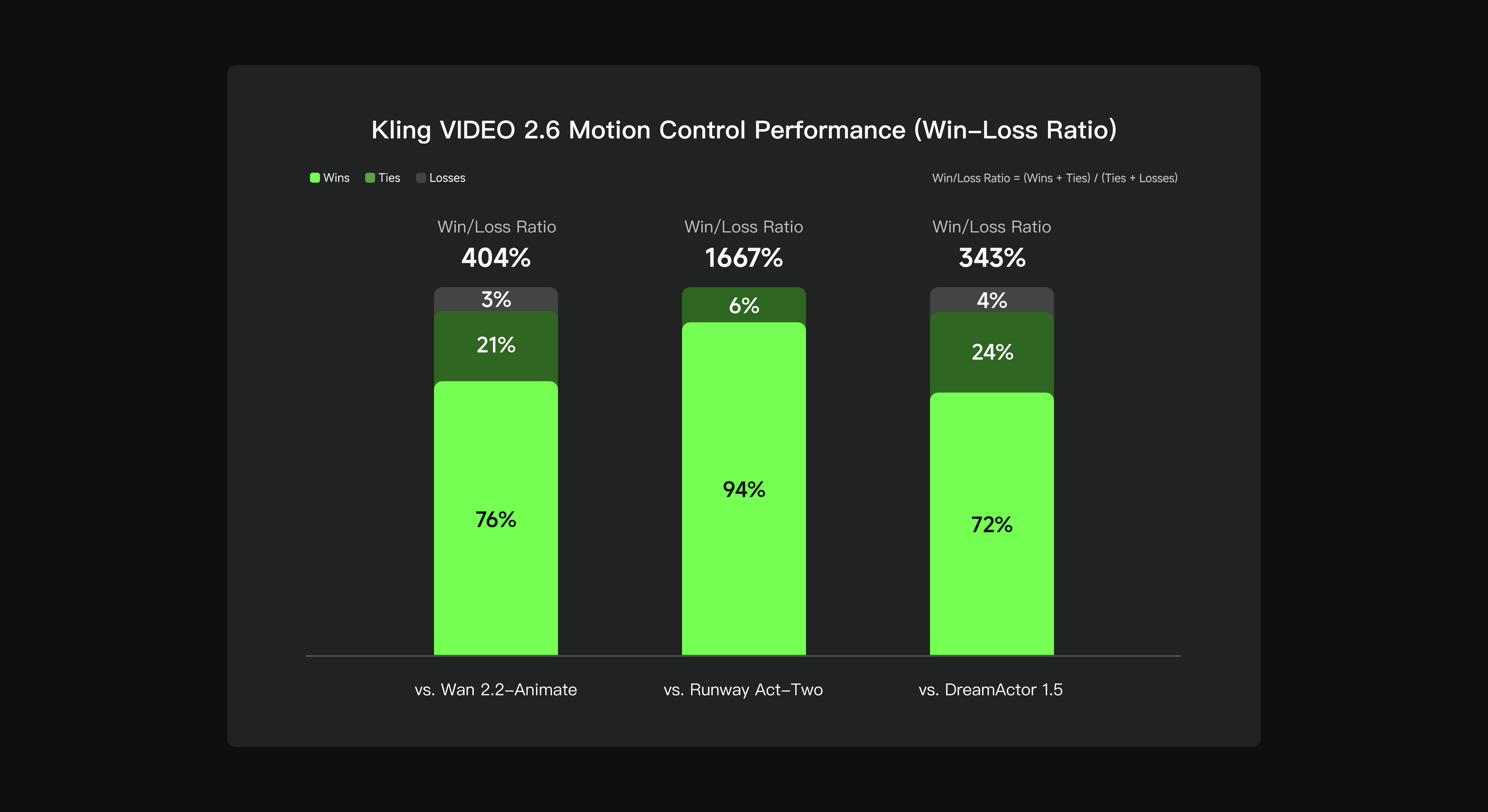

Wenn Sie nun denken, dass dieser Kobe-Clip nur ein Zufall war – oder dass wir einfach Glück hatten und ein perfektes Ergebnis „handverlesen" haben – werfen Sie einen Blick auf dieses offizielle Blindtest-Diagramm. Die Daten sprechen für sich.

The logik ist einfach: Grün bedeutet, Kling gewinnt, Dunkelgrün ist ein Unentschieden, und dieser winzige graue Streifen ganz oben? Das ist der einzige Bereich, in dem es verloren hat.

Schauen Sie auf die linke Seite gegen Wan 2.2. Wan ist ein harter Konkurrent, weshalb man mehr Dunkelgrün sieht (etwa 21 % Unentschieden). Aber selbst dann dominiert Kling mit einer massiven Gewinnrate von 76 %.

Was Runway in der Mitte betrifft? Klings Gewinnrate schießt auf 94 % hoch. Das ist ein absoluter Durchmarsch. Dies entspricht exakt dem, was wir bei unseren Tests gefühlt haben: Wenn es um Bewegungsradius und Präzision geht, wurde Runway im Staub zurückgelassen.

02 Tiefenanalyse: Auflösung von 5 Hauptengpässen

Zuvor verließ sich die KI-Videosteuerung stark auf Motion Brushes und Prompts. Dies erforderte manuelles Maskieren und das Zeichnen von Richtungspfeilen – ein mühsamer Prozess, der auf einfache Schwenk- oder Rütteleffekte beschränkt war. Später erschienen „Video Reference"-Methoden, die jedoch oft scheiterten, die Prompt-Treue mit präziser Bewegungsreplikation in Einklang zu bringen.

Kling 2.6 überwindet diese Hürde durch tiefes semantisches Mapping in einem Video-zu-Video-Kontext. Das Konzept ist elegant: Sie liefern das statische Bild (die visuelle Identität) und ein Referenzvideo (die Seele der Bewegung).

Dies fungiert effektiv als ein unsichtbarer MoCap (Motion Capture)-Anzug für Ihren Charakter. Die Einstiegshürde ist weg – keine teure Studioausrüstung erforderlich; ein einfaches, mit dem Smartphone aufgenommenes Video funktioniert perfekt.

Perfekt synchronisierte Bewegungen, Ausdrücke und Lip-Sync

Meisterhafte Darstellung komplexer Bewegungen

Präzision bei Handbewegungen

30s One-Shot-Action

Szenendetails nach Ihren Wünschen

03 Null Barrieren: Rechenfreiheit für alle

Nachdem Sie diese massiven Upgrades gesehen haben, verspüren Sie vielleicht eine Mischung aus Aufregung und Angst: „Um dieses Niveau der Bewegungssteuerung zu erreichen, muss ich eine High-End-GPU für Tausende von Dollar kaufen? Muss ich wie ein Entwickler programmieren können, nur um die lokale Umgebung einzurichten?"

Die Antwort lautet: Nein.

Wir befinden uns an einem technologischen Wendepunkt, an dem die Barrieren für die Erstellung verschwinden. Die einzigen Dinge, die Kreative zurückhalten, sind Rechenengpässe und komplizierte Installationsprozesse.

Genau deshalb gibt es Atlas Cloud.

Wir kümmern uns um die komplexe Bereitstellung und die schwere Arbeit, damit Sie sich rein auf Ihre kreative Freiheit konzentrieren können. Das Einreißen dieser letzten Mauer kostet weniger als eine Tasse Kaffee. Wir bringen Hollywood-VFX von teuren Workstations direkt in Ihren Alltag.

Die Werkzeuge sind bereit. Der Rest liegt an Ihrer Fantasie. Klicken Sie hier, um Atlas Cloud zu starten und Ihre Reise als Regisseur zu beginnen. 🚀

Auf Atlas Cloud können Sie:

- Ausgabequalität vs. Kosten direkt nebeneinander vergleichen

- Entscheiden, welches Modell den besten ROI für Ihren spezifischen Workflow bietet

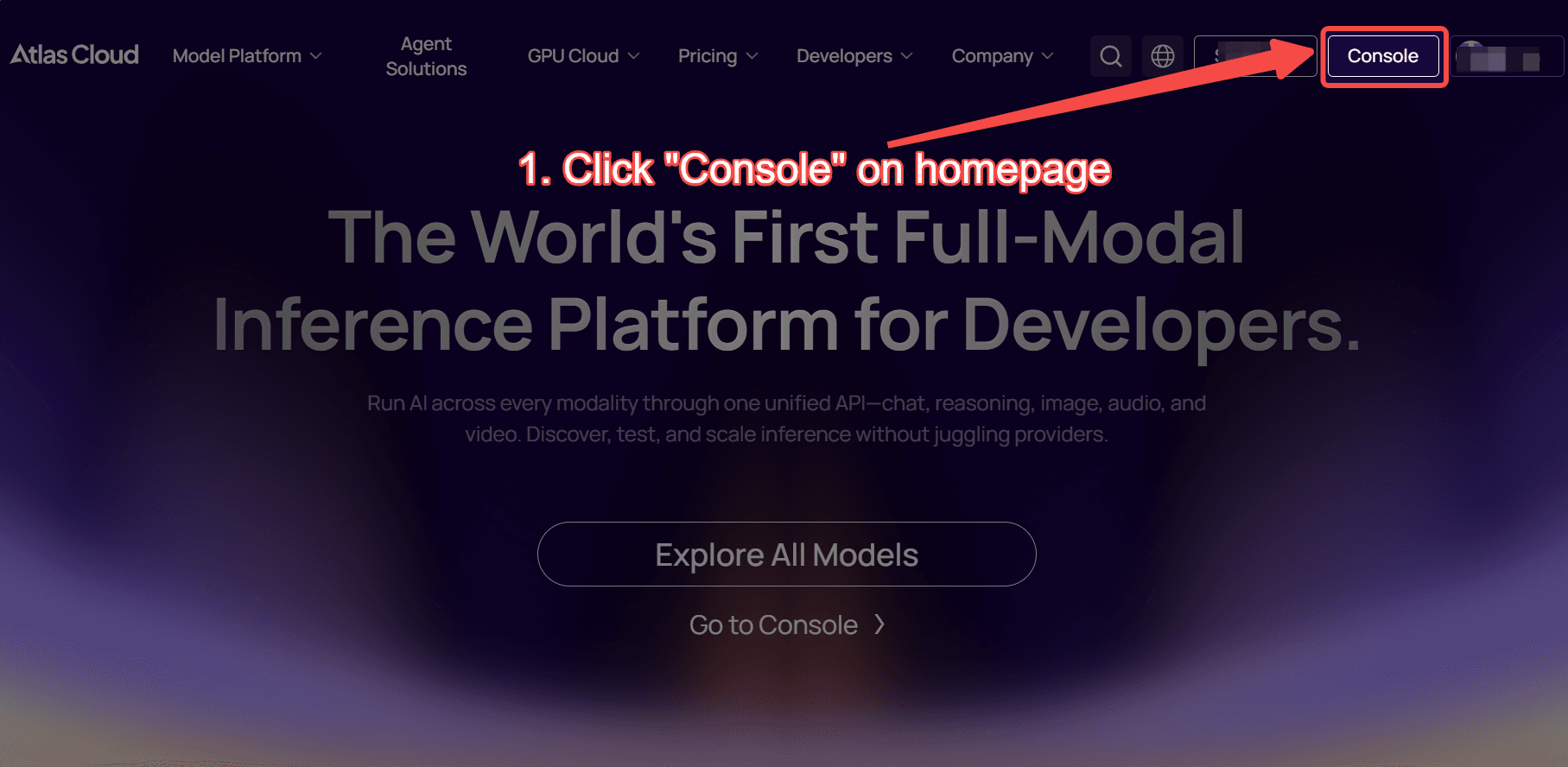

So verwenden Sie Modelle auf Atlas Cloud

Mit Atlas Cloud können Sie Modelle nebeneinander verwenden – erst in einem Playground, dann über eine einzige API.

Methode 1: Direkt im Atlas Cloud Playground verwenden

Methode 2: Zugriff über API

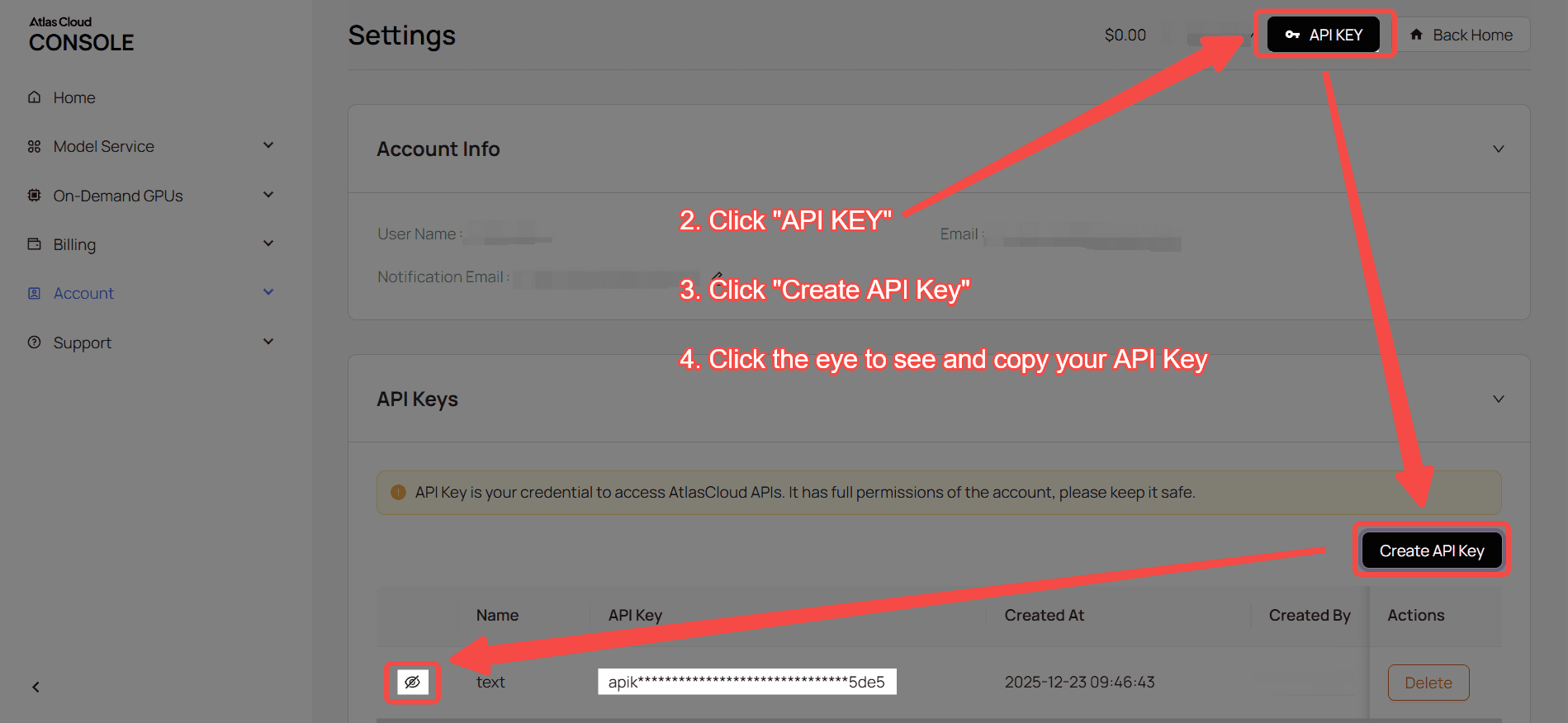

Schritt 1: API-Key abrufen

Erstellen Sie einen API-Key in Ihrer Konsole und kopieren Sie ihn für die spätere Verwendung.

Schritt 2: API-Dokumentation prüfen

Überprüfen Sie den Endpunkt, die Anfrageparameter und die Authentifizierungsmethode in unseren API-Docs.

Schritt 3: Die erste Anfrage stellen (Python-Beispiel)

Beispiel: Video generieren mit kwaivgi/kling-v2.6-std/motion-control

plaintext1import requests 2import time 3 4# Schritt 1: Videogenerierung starten 5generate_url = "https://api.atlascloud.ai/api/v1/model/generateVideo" 6headers = { 7 "Content-Type": "application/json", 8 "Authorization": "Bearer $ATLASCLOUD_API_KEY" 9} 10data = { 11 "model": "kwaivgi/kling-v2.6-std/motion-control", 12 "character_orientation": "video", 13 "image": "https://static.atlascloud.ai/media/images/dc0051d2c757c405abcc66db9e73731b.jpg", 14 "keep_original_sound": True, 15 "prompt": "Replace the characters in the video with the characters from the image, while strictly maintaining the characters' movements.", 16 "video": "https://static.atlascloud.ai/media/videos/29538d8995e0a9ba017469aab11b2172.mp4" 17} 18 19generate_response = requests.post(generate_url, headers=headers, json=data) 20generate_result = generate_response.json() 21prediction_id = generate_result["data"]["id"] 22 23# Schritt 2: Ergebnis abfragen (Polling) 24poll_url = f"https://api.atlascloud.ai/api/v1/model/prediction/{prediction_id}" 25 26def check_status(): 27 while True: 28 response = requests.get(poll_url, headers={"Authorization": "Bearer $ATLASCLOUD_API_KEY"}) 29 result = response.json() 30 31 if result["data"]["status"] in ["completed", "succeeded"]: 32 print("Generiertes Video:", result["data"]["outputs"][0]) 33 return result["data"]["outputs"][0] 34 elif result["data"]["status"] == "failed": 35 raise Exception(result["data"]["error"] or "Generation failed") 36 else: 37 # Verarbeitet noch, 2 Sekunden warten 38 time.sleep(2) 39 40video_url = check_status()