Introducción: ¿Qué es Seedance 2.0?

Seedance 2.0 es el esperado sucesor del modelo de generación de vídeo multimodal de ByteDance.

- La actualización: Mientras que Seedance 1.5 Pro estableció las bases para la generación audiovisual nativa, se prevé que la versión 2.0 introduzca «Campos de Física Acústica» y «Priores de Modelo de Mundo».

- El objetivo: Cerrar la brecha entre la generación de IA y la realidad física. Aspira a actuar como un director integral, gestionando narrativas audiovisuales complejas para vídeos que superen los 30 segundos.

Predicciones clave: 3 actualizaciones principales en Seedance 2.0 (Previstas)

1. De la sincronización de audio a la «Física Acústica»

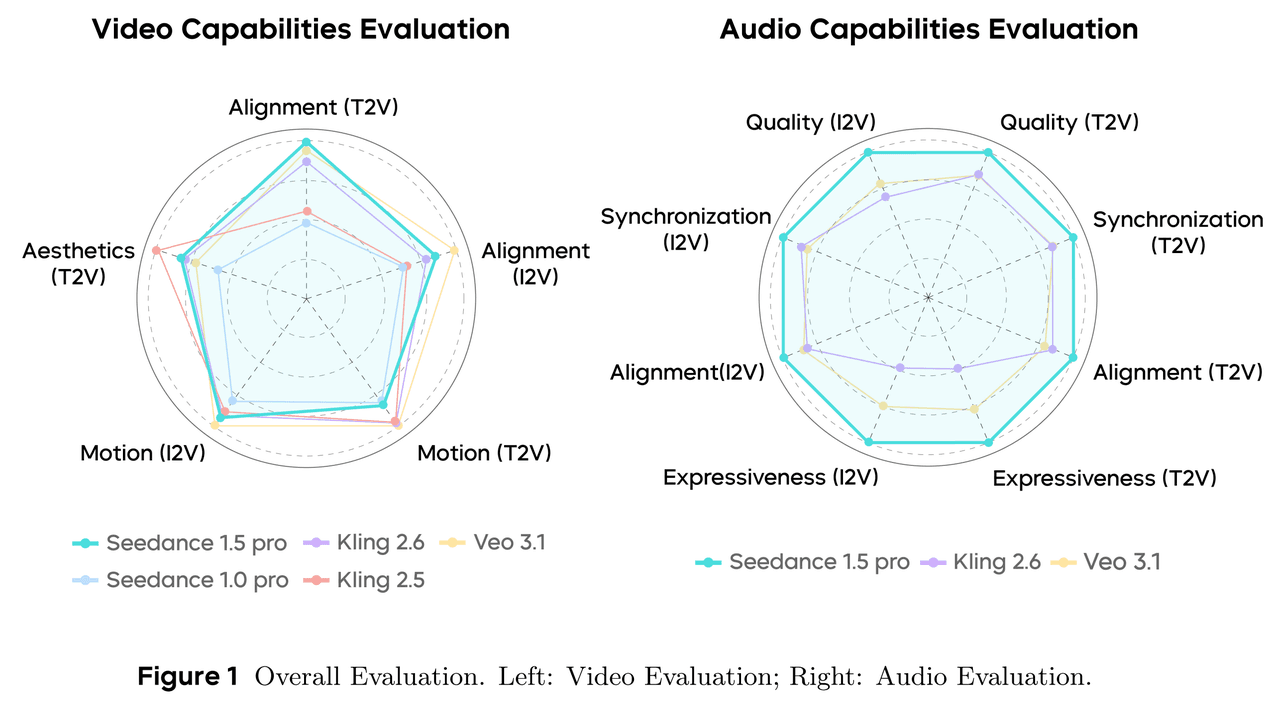

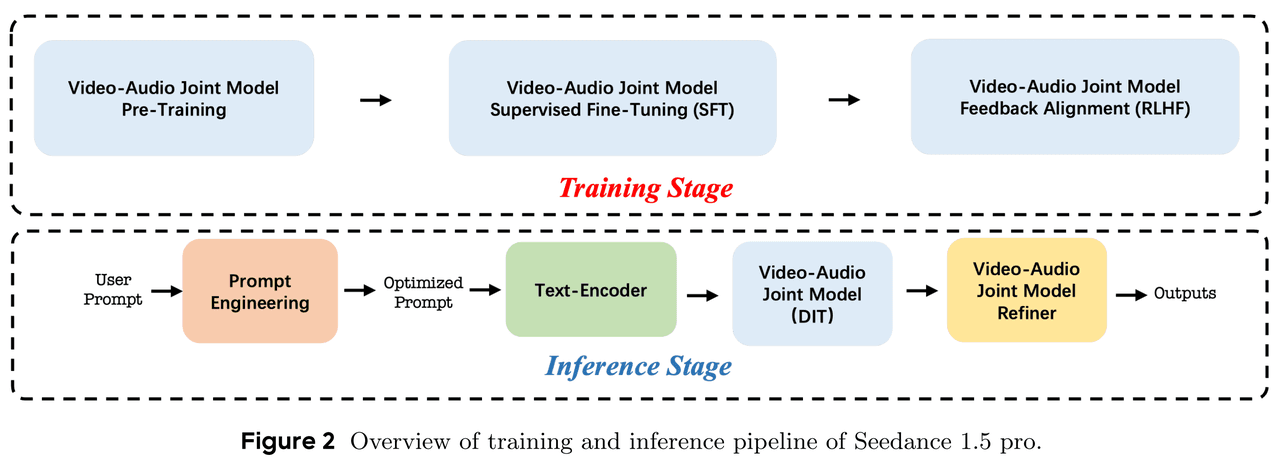

Seedance 1.5 Pro utilizó un Transformer de Difusión de doble rama (MMDiT) para resolver problemas de sincronización labial. Sin embargo, se espera que Seedance 2.0 simule un Campo Acústico completo.

- Física multimodal real: Si un vaso se rompe en el vídeo, el audio generado no será simplemente un efecto de sonido genérico. Calculará la reverberación basándose en el material del suelo (por ejemplo, alfombra frente a baldosa) visible en el encuadre.

- Priores latentes: Esto implica añadir priores de motores físicos a la arquitectura MMDiT, otorgando al sonido «peso» e «impacto».

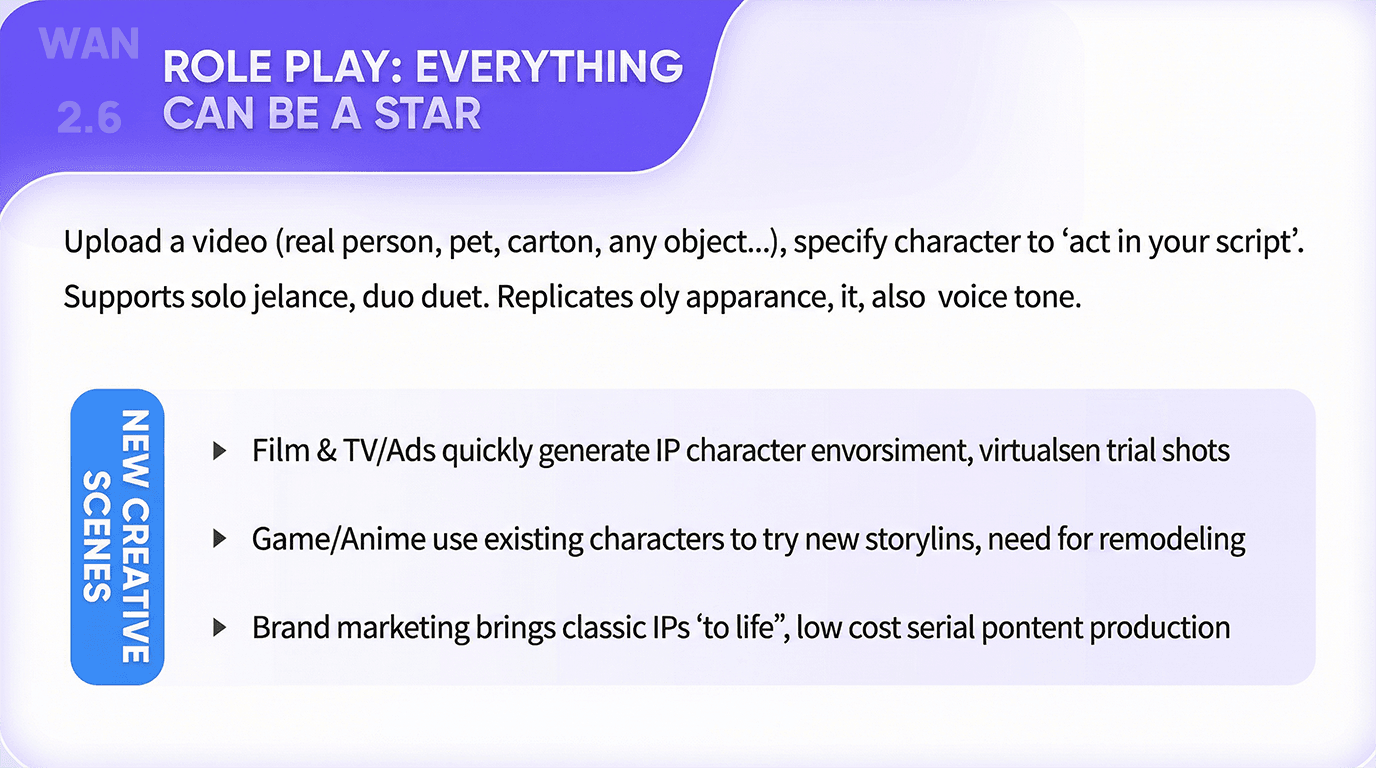

2. Compitiendo con Wan 2.6: consistencia en vídeos largos

- Actualmente, Wan 2.6 domina la consistencia de personajes con su función Reference-to-Video, que actúa como un LoRA de personaje zero-shot. Se espera que Seedance 2.0 contrarreste esto bloqueando el «World ID».

- Generación más larga: Rompiendo la «maldición de los 12 segundos», Seedance 2.0 apunta a una coherencia nativa para vídeos de 30 a 60 segundos.

- Atención temporal: Una optimización mejorada del post-entrenamiento probablemente permitirá al modelo «recordar» eventos del primer segundo y referenciarlos al final del clip.

3. Control a nivel de director

- Se prevé que Seedance 2.0 introduzca capacidades de Control basado en nodos y Vista previa en tiempo real.

- In-painting parcial y remezcla de audio: Los usuarios podrían seleccionar un personaje y modificar su acción o la emoción del diálogo (por ejemplo, de enfadado a suplicante) manteniendo la música de fondo y el entorno sin cambios.

Comparación: Seedance 2.0 frente a la competencia

| Función | Seedance 1.5 Pro | Seedance 2.0 (Previsto) |

| Arquitectura | MMDiT (Audio-Visual) | World-MMDiT (Física + AV) |

| Audio | Sincronización labial, alineación de emociones | Simulación física, interacción con el entorno |

| Duración | Corta (~10s) | Larga (30s-60s) |

| Carga de cómputo | Alta | Extremadamente alta |

Cómo acceder a Seedance 2.0: el desafío del hardware

La documentación técnica de 1.5 Pro destaca que, si bien la optimización aumentó la velocidad 10 veces, el salto a las capacidades de «Modelo de Mundo» de Seedance 2.0 aumentará exponencialmente los requisitos de VRAM y cómputo.

Ejecutar Seedance 2.0 localmente —incluso en una NVIDIA RTX 4090— será probablemente imposible para la mayoría de los usuarios debido a la enorme carga de procesamiento multimodal.

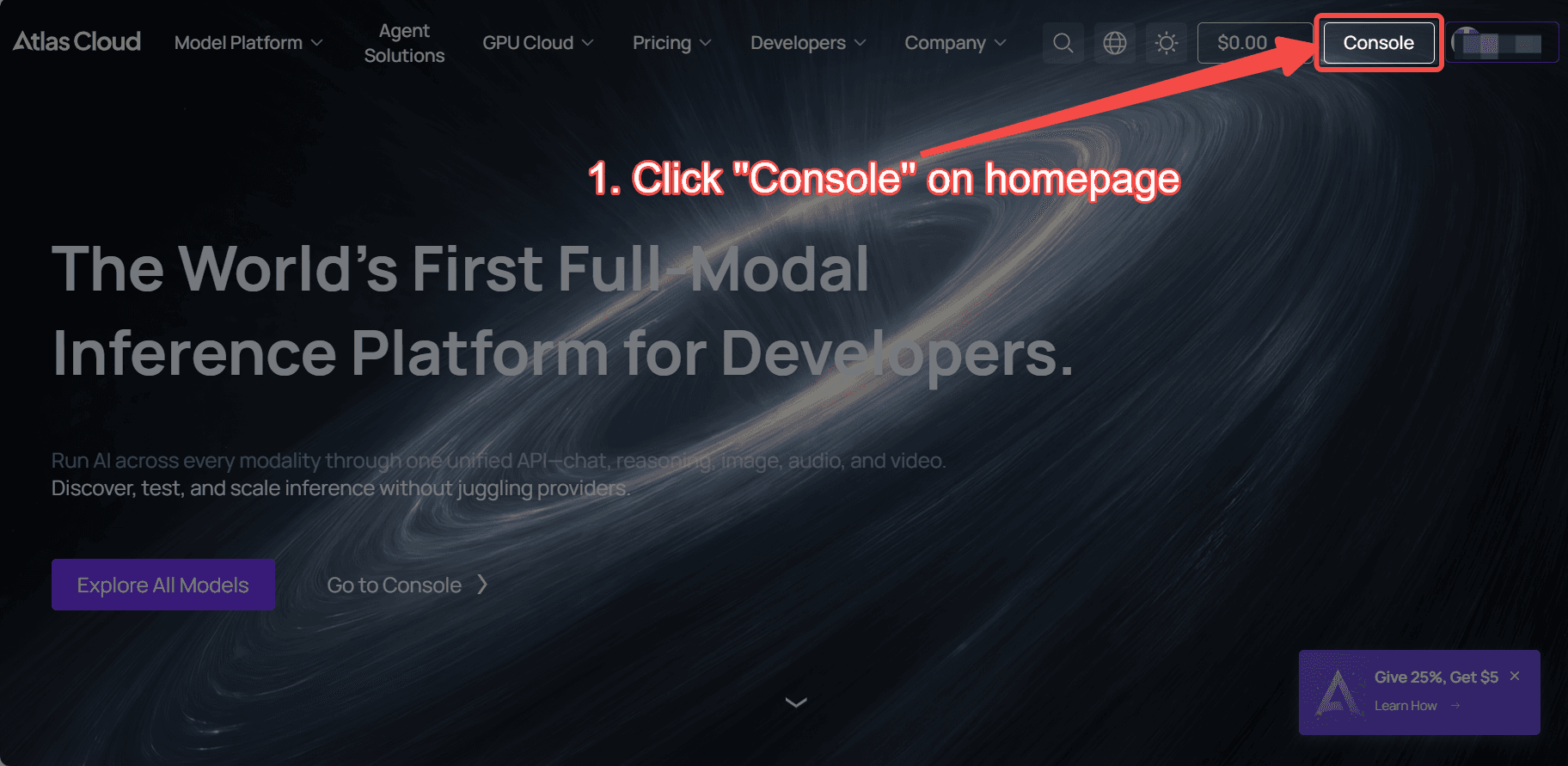

La solución: Atlas Cloud

Atlas Cloud está preparada para el lanzamiento. Hemos integrado toda la familia de modelos Seedance y daremos soporte a Seedance 2.0 el mismo día de su lanzamiento.

- Despliegue sin configuración: Accede a Seedance, Kling y modelos similares a Sora sin complejas instalaciones de Python o CUDA.

- Computación elástica: Escala la potencia de tu GPU al instante. Paga por segundo para renderizar vídeos largos y complejos sin agotar tu hardware local.

- Acceso por API: Los desarrolladores podrán integrar las capacidades de Seedance 2.0 directamente en sus aplicaciones a través de la API de Atlas Cloud inmediatamente después de su lanzamiento.

No permitas que el hardware limite tu creatividad. [Regístrate en Atlas Cloud] para asegurar tu acceso prioritario al lanzamiento de Seedance 2.0 a mediados de febrero.

Cómo usarlo en Atlas Cloud

Atlas Cloud te permite usar modelos en paralelo: primero en un playground y luego a través de una única API.

Método 1: Usar directamente en el playground de Atlas Cloud

Método 2: Acceso vía API

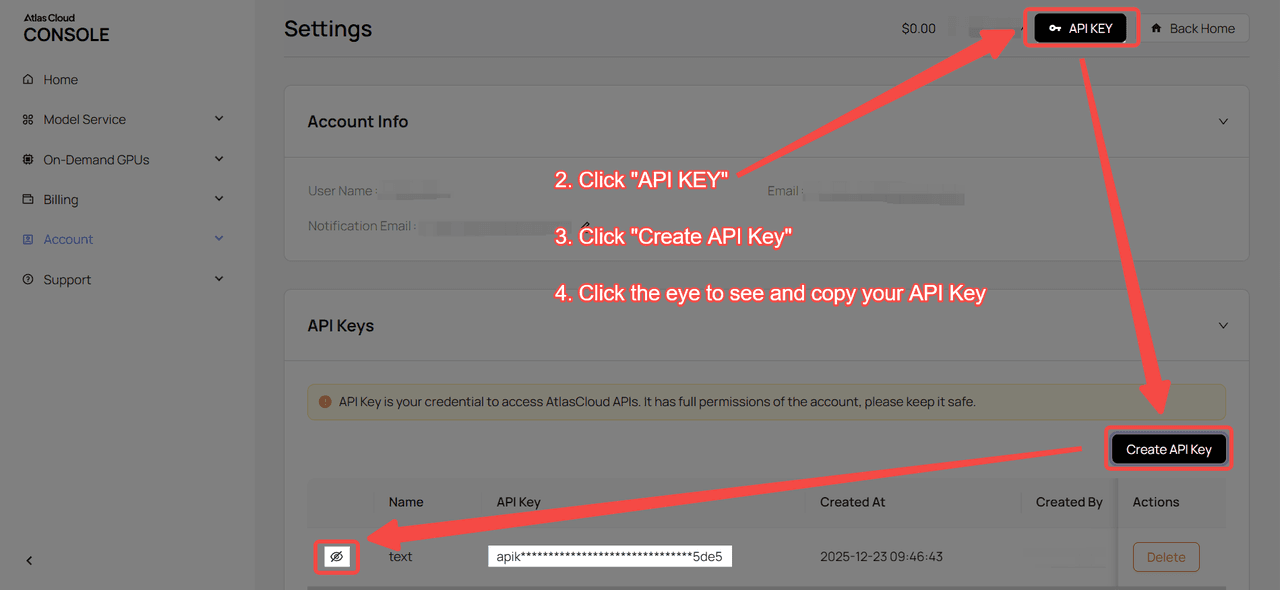

Paso 1: Obtén tu clave de API

Crea una clave de API en tu consola y cópiala para usarla más tarde.

Paso 2: Consulta la documentación de la API

Revisa el endpoint, los parámetros de solicitud y el método de autenticación en nuestra documentación de la API.

Paso 3: Realiza tu primera solicitud (ejemplo en Python)

Ejemplo: generar un vídeo con Seedance 1.5 Pro:

plaintext1import requests 2import time 3 4# Step 1: Start video generation 5generate_url = "https://api.atlascloud.ai/api/v1/model/generateVideo" 6headers = { 7 "Content-Type": "application/json", 8 "Authorization": "Bearer $ATLASCLOUD_API_KEY" 9} 10data = { 11 "model": "bytedance/seedance-v1.5-pro/image-to-video-fast", 12 "aspect_ratio": "16:9", 13 "camera_fixed": False, 14 "duration": 5, 15 "generate_audio": True, 16 "image": "https://static.atlascloud.ai/media/images/06a309ac0adecd3eaa6eee04213e9c69.png", 17 "last_image": "example_value", 18 "prompt": "Use the provided image as the first frame.\nOn a quiet residential street in a summer afternoon, a young girl in high-quality Japanese anime style slowly walks forward.\nHer steps are natural and light, with her arms gently swinging in rhythm with her walk. Her body movement remains stable and well-balanced.\nAs she walks, her expression gradually softens into a gentle, warm smile. The corners of her mouth lift slightly, and her eyes look calm and bright.\nA soft breeze moves her short hair and headband, with individual strands subtly flowing. Her clothes show slight natural motion from the wind.\nSunlight comes from the upper side, creating soft highlights and natural shadows on her face and body.\nBackground trees sway gently, and distant clouds drift slowly, enhancing the peaceful summer atmosphere.\nThe camera stays at a medium to medium-close distance, smoothly tracking forward with cinematic motion, stable and controlled.\nHigh-quality Japanese hand-drawn animation style, clean linework, warm natural colors, smooth frame rate, consistent character proportions.\nThe mood is calm, youthful, and healing, like a slice-of-life moment from an animated film.", 19 "resolution": "720p", 20 "seed": -1 21} 22 23generate_response = requests.post(generate_url, headers=headers, json=data) 24generate_result = generate_response.json() 25prediction_id = generate_result["data"]["id"] 26 27# Step 2: Poll for result 28poll_url = f"https://api.atlascloud.ai/api/v1/model/prediction/{prediction_id}" 29 30def check_status(): 31 while True: 32 response = requests.get(poll_url, headers={"Authorization": "Bearer $ATLASCLOUD_API_KEY"}) 33 result = response.json() 34 35 if result["data"]["status"] in ["completed", "succeeded"]: 36 print("Generated video:", result["data"]["outputs"][0]) 37 return result["data"]["outputs"][0] 38 elif result["data"]["status"] == "failed": 39 raise Exception(result["data"]["error"] or "Generation failed") 40 else: 41 # Still processing, wait 2 seconds 42 time.sleep(2) 43 44video_url = check_status()