귀하의 프롬프트가 거부 벽에 부딪혔습니다. 유해해서가 아니라, 키워드가 필터를 트리거했기 때문입니다.

Ollama 커뮤니티의 개발자들은 이를 "거부 벡터(refusal vectors)"라고 부릅니다. 이는 실제 유해성과는 아무런 관련이 없는, 키워드에 의해 발생하는 차단 현상입니다. 보안 연구를 위한 멀웨어 리버스 엔지니어링, 의학 사례 연구 문서화, 성인 콘텐츠 제작, 다크 픽션 집필 등 주류 AI는 이 모든 것을 차단합니다. 본 리스트는 마케팅 문구가 아닌 실제 커뮤니티 데이터를 바탕으로 2026년 최고의 비검열 AI 모델을 순위별로 정리했습니다. 여기에는 텍스트 및 코드용 비검열 LLM, 개인 하드웨어 배포를 위한 2026년 최고의 비검열 로컬 AI 모델, 그리고 API를 통한 이미지 및 비디오 생성용 비검열 AI 모델 등 세 가지 카테고리가 포함됩니다. 모든 수치는 2026년 5월 기준으로 출처가 명시되었습니다.

더 광범위한 도구 환경을 처음 접하는 독자라면, 특정 모델을 선택하기 전에 비검열 AI 이미지 생성기 가이드를 먼저 살펴보는 것이 유용한 출발점이 될 것입니다.

2026년 최고의 비검열 AI 모델 선정 기준

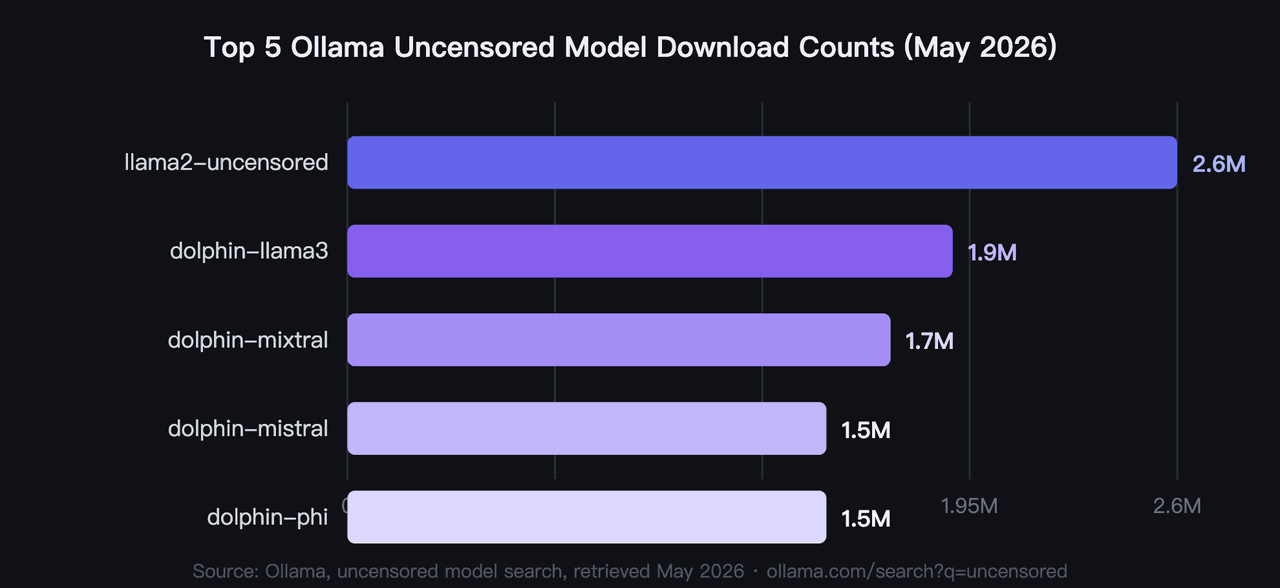

2026년 기준, Ollama의 커뮤니티 다운로드 수는 실제 성능과는 무관하게 보도 자료를 위해 선별될 수 있는 벤치마크 점수보다 더 신뢰할 수 있는 순위 지표를 제공합니다(Ollama, 비검열 모델 검색, 2026). 수백만 건의 풀(pull)은 수천 가지의 하드웨어 설정과 프롬프트 유형을 대변합니다. 이는 선별된 평가 세트보다 조작하기가 훨씬 어렵습니다.

본 기사 전반에서 세 가지 순위 신호를 사용합니다. Ollama 비검열 모델의 경우, 주된 신호는 2026년 5월에 집계된 ollama.com의 풀(pull) 횟수입니다. OpenRouter 모델의 경우, 플랫폼에서 풀 횟수가 공개되지 않기 때문에 파라미터 수와 컨텍스트 창을 기준으로 순위를 매겼습니다. 이미지 및 비디오 모델은 출력당 가격을 기준으로 하며, 각 그룹 내에서 비용이 저렴할수록 상위에 배치했습니다.

대부분의 2026년 비검열 AI 모델은 미세 조정(fine-tuned) 모델과 삭제(abliterated) 모델이라는 두 가지 기술적 범주에 속합니다. Dolphin 시리즈와 같은 미세 조정 모델은 거부 동작을 강화하지 않는 데이터셋으로 학습되었습니다. 삭제 모델은 거부 가중치를 외과적으로 제거한 모델입니다. 커뮤니티는 일관되게 미세 조정 모델이 다양한 프롬프트 유형에서 더 안정적이라고 평가합니다.

실제로 다운로드 수는 모델의 안정성과도 상관관계가 있습니다. 100만 회 이상의 풀을 기록한 모델은 다양한 하드웨어 구성에서 테스트를 거쳤으므로, 작은 테스트 그룹이 놓치는 버그나 불안정성이 노출되었음을 의미합니다.

가장 많이 다운로드된 Ollama 비검열 모델 Top 5는?

2026년, 가장 많이 다운로드된 Ollama 비검열 모델 5종의 총 풀 횟수는 920만 회를 상회하며, 그중

1llama2-uncensored1. llama2-uncensored: Ollama에서 가장 많이 다운로드된 비검열 AI 모델

비검열 로컬 AI를 위한 오리지널 커뮤니티 벤치마크 모델입니다. George Sung과 Jarrad Hope가 Llama 2의 일반적인 능력을 저하시키지 않으면서 거부 동작을 제거하기 위해 공개한 미세 조정 모델입니다. 많은 개발자가 처음 시작할 때 사용하는 모델이며, 260만 회의 풀 횟수는 2년 이상의 실사용 데이터를 반영합니다. 이 정도 다운로드 수를 기록한 비검열 LLM은 없습니다.

- 파라미터: 7B 또는 70B

- VRAM: ~6GB (7B); ~40GB (70B)

- 용도: 범용 제한 없는 채팅 및 콘텐츠 생성

- 플랫폼: Ollama

2. dolphin-llama3: 에이전트 워크플로우를 위한 최고의 비검열 Llama 3 LLM

Llama 3 기반으로 Eric Hartford가 제작한 Dolphin 모델로, 190만 회의 풀을 기록하며 현대적 아키텍처를 기반으로 한 가장 많이 다운로드된 비검열 모델입니다(Ollama, dolphin-llama3 모델 페이지, 2026). 설정에 따라 함수 호출(function calling)과 8K에서 256K 토큰까지 확장 가능한 컨텍스트 창을 지원합니다. 8B 버전은 4.7GB로 대부분의 중급 소비자용 GPU에서 실행 가능합니다.

- 파라미터: 8B 또는 70B

- VRAM: ~5GB (8B); ~40GB (70B)

- 용도: 코딩, 에이전트 워크플로우, 함수 호출

- 플랫폼: Ollama

3. dolphin-mixtral 8x7B: 복합 추론을 위한 비검열 MoE AI 모델

전문가 혼합(MoE) 아키텍처는 각 토큰을 8개의 전문가 레이어 중 일부로 라우팅합니다. 이를 통해 전체 파라미터 수가 동일한 밀집 모델보다 더 낮은 추론 비용으로 70B급의 추론 품질을 제공합니다. Eric Hartford의 비검열 미세 조정 모델은 전반적으로 코딩 능력이 매우 뛰어납니다.

- 파라미터: 8x7B (추론 시 활성 파라미터 수는 전체보다 훨씬 적음)

- VRAM: 양자화 적용 시 ~12-16GB

- 용도: 복잡한 코딩 작업, 기술적 추론, 긴 지시사항 체인

- 플랫폼: Ollama

4. dolphin-mistral: 빠른 응답을 위한 비검열 7B 로컬 AI 모델

CPU 기반 하드웨어에서 dolphin-mixtral보다 가볍고 빠릅니다. 고성능 GPU 없이 코드 완성(code completion)을 위해 반응형 로컬 모델을 찾는 개발자들로부터 150만 회의 풀을 기록했습니다. Mistral 기반 아키텍처 덕분에 7B 모델로서 매우 강력한 성능 대 크기 비율을 보여줍니다.

- 파라미터: 7B

- VRAM: ~5-6GB

- 용도: 가벼운 코딩 지원 및 빠른 채팅 응답

- 플랫폼: Ollama

5. dolphin-phi 2.7B: 가장 가벼운 비검열 로컬 AI 모델

Microsoft의 Phi 아키텍처를 기반으로 2.7B 파라미터 안에 강력한 추론 능력을 담았습니다. Eric Hartford의 비검열 미세 조정은 그 효율성을 그대로 유지합니다. 4GB 미만의 VRAM으로 외장 GPU가 장착된 대부분의 일반 노트북에서 실행 가능하며, 2026년 최고의 비검열 로컬 AI 모델을 시작하기에 가장 적합합니다.

- 파라미터: 2.7B

- VRAM: 4GB 미만

- 용도: 노트북 배포, 빠른 테스트, 하드웨어 제약이 있는 환경

- 플랫폼: Ollama

비검열 LLM 모델 6-10위: 코딩, 롤플레잉, 긴 컨텍스트

2026년, Dolphin 시리즈는 Ollama의 비검열 카테고리에서 다운로드 수 기준 상위 10위 중 5자리를 차지하고 있으며, 이는 Eric Hartford의 일관된 미세 조정 방법론이 다양한 기반 아키텍처에 성공적으로 적용되었음을 보여줍니다(Ollama, hermes3 모델 페이지, 2026). 6위부터 10위까지의 모델은 롤플레잉, 일반 대화, 개발자 도구, 지시사항 이행 및 확장된 컨텍스트 등 주류 AI의 거부가 가장 방해가 되는 사용 사례를 다룹니다.

6. hermes3: 롤플레잉 및 에이전트 작업을 위한 비검열 AI 모델

Nous Research에서 롤플레잉의 깊이와 구조화된 도구 사용을 위해 제작했습니다. 3B부터 405B까지 4가지 크기로 제공되어 본 리스트 중 가장 폭넓은 범위를 자랑합니다. 130만 회의 풀을 기록한 8B 버전은 창의적인 글쓰기와 에이전트 계획 워크플로우에 매우 실용적입니다(Ollama, hermes3 모델 페이지, 2026).

- 파라미터: 3B, 8B, 70B, 405B

- VRAM: ~2GB (3B); ~5GB (8B); ~40GB (70B)

- 용도: 롤플레잉, 창의적 픽션, 에이전트 작업 계획

- 플랫폼: Ollama

7. wizard-vicuna-uncensored: 범용을 위한 다중 크기 비검열 AI 모델

Llama 2를 기반으로 구축된 검증된 모델로, 30B까지 세 가지 크기로 제공됩니다. 120만 회의 풀은 더 넓은 파라미터 범위를 가진 신뢰할 수 있는 비검열 옵션을 찾는 사용자들로부터 기인합니다. dolphin-llama3 수준의 컨텍스트 창은 아니지만, 일반 대화와 창의적인 콘텐츠를 일관되게 처리합니다.

- 파라미터: 7B, 13B, 30B

- VRAM: ~5GB (7B); ~9GB (13B); ~20GB (30B)

- 용도: 범용 대화 및 다양한 크기의 창의적 콘텐츠 제작

- 플랫폼: Ollama

8. dolphincoder: StarCoder2 기반 비검열 AI 코딩 모델

StarCoder2를 기반으로 하여 코딩 전문성을 강화했습니다. 다른 Dolphin 모델들이 비검열 미세 조정을 거친 범용 모델이라면, 이 모델은 소프트웨어 개발에 특화되어 있습니다. 94만 3천 회의 풀은 창의적 사용자가 아닌 개발자로부터 대부분 발생합니다. 15B 버전은 7B보다 더 큰 코드베이스를 다룰 수 있습니다.

- 파라미터: 7B, 15B

- VRAM: ~5GB (7B); ~10GB (15B)

- 용도: 코드 생성, 디버깅, 기술 문서화

- 플랫폼: Ollama

9. wizardlm-uncensored: 연구 워크플로우를 위한 비검열 지시사항 이행 LLM

61만 회의 풀을 기록한 13B 지시사항 이행 모델입니다. 복잡한 다단계 지시사항을 거부하거나 주저함 없이 수행하는 것이 강점입니다. 거부 한 번이 긴 작업 체인을 깨뜨릴 수 있는 연구 워크플로우에서 이러한 신뢰성은 생산성 측면에서 큰 가치가 있습니다. dolphin-llama3 같은 현대적 기반 아키텍처는 아니지만, 지시사항 수행 능력이 매우 일관됩니다.

- 파라미터: 13B

- VRAM: ~9GB

- 용도: 복잡한 다단계 지시사항 및 연구 워크플로우

- 플랫폼: Ollama

10. everythinglm: 16K 컨텍스트 창을 지원하는 비검열 LLM

가장 두드러진 특징은 Llama 2 기반의 16K 컨텍스트 창 지원입니다. 대부분의 7B 모델은 4K 또는 8K 토큰에 그칩니다. 이 추가 컨텍스트를 통해 everythinglm은 전체 코드베이스, 긴 문서 또는 확장된 대화 내역을 잘림 없이 처리할 수 있습니다. 53만 6천 회의 풀은 본 리스트 기준으로는 낮지만, 이 크기에서 다른 모델이 제공하지 못하는 기능을 수행합니다.

- 파라미터: 13B

- VRAM: ~9GB

- 용도: 긴 문서 분석, 확장된 컨텍스트 채팅, 전체 코드베이스 검토

- 플랫폼: Ollama

Dolphin 시리즈가 Ollama 다운로드 수에서 우위를 점하는 것은 커뮤니티가 입증한 패턴입니다: 단일 저자의 일관된 방법론을 사용한 미세 조정 모델이 일회성 삭제 시도보다 뛰어납니다. 삭제 모델은 단일 모델에서 거부 가중치를 제거하지만, 미세 조정 모델은 다양한 프롬프트 유형 전반에 걸쳐 안정적인 비검열 동작을 구축합니다. 이러한 일관성 때문에 상위 10개 중 5개가 Eric Hartford의 결과물입니다.

Ollama 비검열 모델 로컬 설치 방법

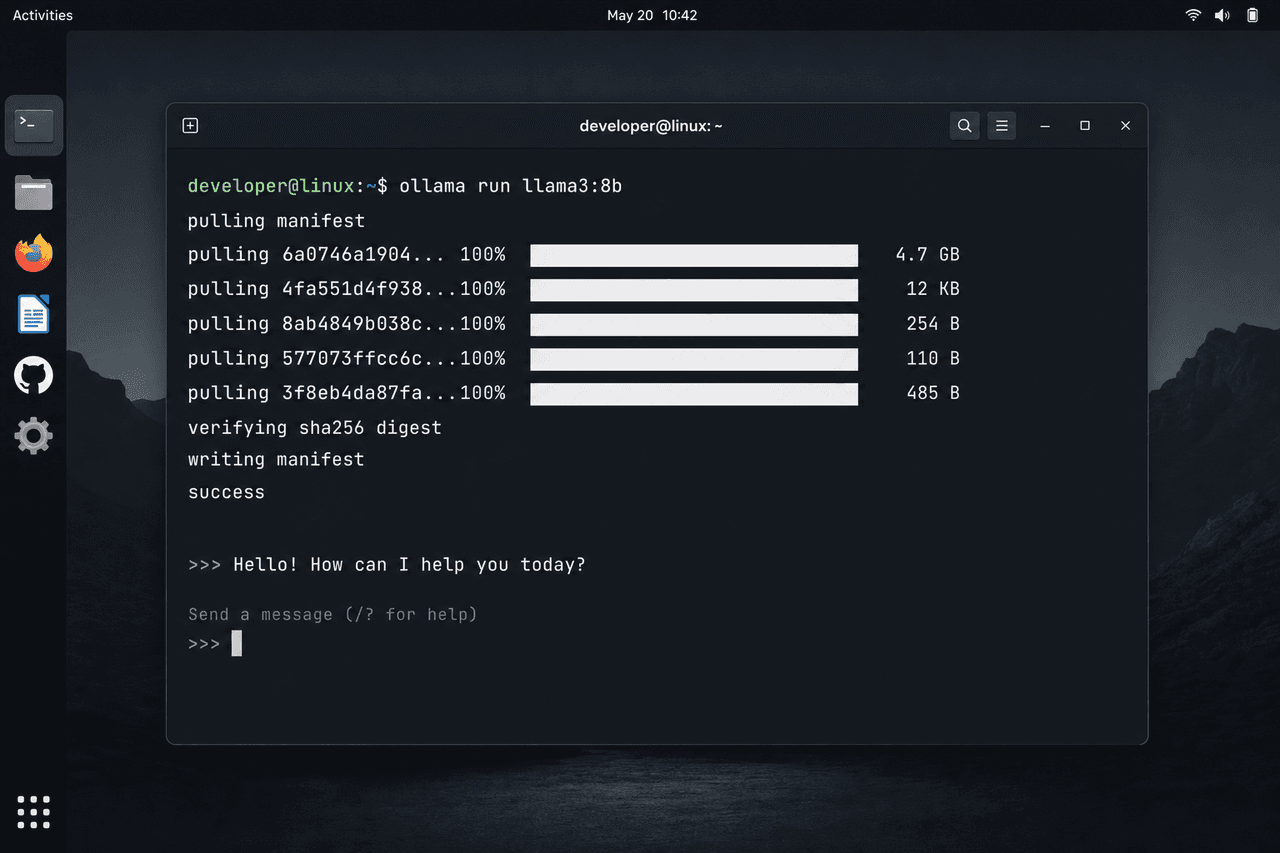

2026년 기준, Mac, Linux 또는 Windows에서 Ollama 모델을 설치하는 방법은 간단합니다: ollama.com에서 Ollama를 설치하고,

1ollama pull [모델명]1ollama run [모델명]dolphin-llama3를 예로 들면:

1ollama pull dolphin-llama31ollama run dolphin-llama3터미널 작업이 불편한 사용자를 위해 LM Studio는 데스크톱 GUI를 제공합니다. 이는 Ollama와 동일한 GGUF 모델 파일을 사용하며, 모델 선택과 파라미터 조정을 위한 시각적 인터페이스를 제공합니다. llama.cpp는 두 도구 모두의 기본 추론 엔진이며, 양자화 수준과 컨텍스트 길이를 더 정밀하게 제어해야 할 때 직접 명령줄에서 사용할 수 있습니다.

소비자용 GPU에서 2026년 최고의 비검열 로컬 AI 모델을 실행하기 위한 특정 하드웨어 요구 사항과 양자화 설정이 필요한 개발자들은 전체 로컬 설정 가이드에서 최소 VRAM 구성과 일반적인 설정 오류에 대한 세부 내용을 확인할 수 있습니다.

로컬 GPU 없이 이용 가능한 OpenRouter 비검열 모델은?

2026년, OpenRouter는 API를 통해 비검열 LLM을 호스팅하여 GPU 요구 사항을 완전히 제거합니다.

1venice/uncensored단점은 명확합니다: OpenRouter는 귀하의 프롬프트를 인프라를 통해 전달하므로, 로컬 모델처럼 완벽하게 비공개는 아닙니다. 로컬 Ollama 모델은 모든 데이터를 기기에 유지합니다. 두 방식 모두 장단점이 있으므로, 위협 모델과 하드웨어 가용성에 따라 선택하십시오.

11. venice/uncensored: 무료 비검열 OpenRouter 모델

OpenRouter 무료 티어의 Venice 비검열 모델입니다. 24B Mistral-Small을 기반으로 Venice.ai와 협업하여 Cognitive Computations에서 미세 조정했습니다. 32K 컨텍스트 창, 100만 토큰당 $0입니다. OpenRouter 무료 티어는 플랫폼 전체에서 무료 모델에 대해 하루 200건의 요청 제한을 적용합니다.

- 파라미터: 24B

- VRAM: 필요 없음 (클라우드 호스팅)

- 용도: 로컬 하드웨어 없이 비검열 LLM 테스트; 플랫폼 제한 내 무료

- 플랫폼: OpenRouter

12. Sao10K: Llama 3.3 Euryale 70B: OpenRouter를 통한 대규모 비검열 모델

Sao10k가 비검열 출력을 위해 미세 조정한 70B 창의적 롤플레잉 및 지시사항 이행 모델입니다. 131K 컨텍스트를 가진 Llama 3.3 70B 기반입니다. OpenRouter에서 활발히 사용되고 있으며 플랫폼 글로벌 검색에서 이름으로 검색 가능합니다.

- 파라미터: 70B

- VRAM: 필요 없음 (클라우드 호스팅)

- 용도: 로컬 하드웨어 없이 복잡한 창의적 글쓰기, 롤플레잉, 긴 지시사항 체인

- 플랫폼: OpenRouter

13. Sao10K: Llama 3 8B Lunaris: OpenRouter를 통한 경량 비검열 모델

Lunaris 8B는 Llama 3 8B 기반의 다재다능한 범용 및 롤플레잉 모델입니다. 창의성과 향상된 논리, 일반 지식의 균형을 맞추기 위해 여러 모델을 전략적으로 결합했습니다. 100만 토큰당 0.04/0.04/0.04/0.05로 OpenRouter에서 가장 저렴한 비검열 옵션이며, 플랫폼에서 이미 60억 개 이상의 토큰이 사용되었습니다.

- 파라미터: 8B

- VRAM: 필요 없음 (클라우드 호스팅)

- 용도: 최소 비용으로 즐기는 가벼운 비검열 대화 및 창의적 글쓰기

- 플랫폼: OpenRouter

14. TheDrummer: Cydonia 24B V4.1: OpenRouter를 통한 비검열 창의적 글쓰기 모델

Mistral Small 3.2 24B 기반으로 뛰어난 회상 능력, 프롬프트 준수, 지능을 갖춘 비검열 창의적 글쓰기 모델입니다. 131K 컨텍스트 창을 지원하며 OpenRouter 글로벌 검색에서 직접 검색할 수 있습니다.

- 파라미터: 24B

- VRAM: 필요 없음 (클라우드 호스팅)

- 용도: 로컬 하드웨어 없이 즐기는 비검열 창의적 글쓰기 및 롤플레잉

- 플랫폼: OpenRouter

Atlas Cloud를 통한 비검열 이미지 및 비디오 모델 접속 방법

2026년, 대부분의 비검열 이미지 및 비디오 모델은 주류 클라우드 제공업체가 추론 수준에서 NSFW 출력을 차단하는 콘텐츠 필터를 적용하기 때문에 로컬 GPU 하드웨어나 전용 API 플랫폼이 필요합니다. Atlas Cloud는 해당 제약을 제거하기 위해 특별히 구축된 모델 API 플랫폼으로, 텍스트, 이미지, 비디오, 오디오 전반에 걸쳐 300개 이상의 엄선된 모델을 제공합니다.

시작은 세 단계로 이루어집니다:

- atlascloud.ai 계정 생성

- 대시보드에서 API 키 생성

- 키를 사용하여 모델 엔드포인트 호출 — 이미지 및 비디오 모델은 자체 REST 형식을 사용하며, LLM 엔드포인트는 OpenAI Chat Completions 형식을 따릅니다.

Atlas Cloud가 비검열 사용 사례에 적합한 이유:

- 플랫폼 개인정보 보호정책에 명시: "귀하가 생성한 콘텐츠는 학습에 사용되지 않으며 누구에게도 검토되지 않습니다." 이는 기본 가정사항이 아니라 공식적으로 게시된 명시적 약속입니다.

- 카탈로그 내 모든 모델에 대해 일일 생성 제한이 없습니다.

- 비검열 이미지 카탈로그는 이미지당 $0.003부터 시작하는 33개의 텍스트-이미지 변환 모델을 포함합니다.

- 비검열 비디오 카탈로그는 초당 $0.01부터 시작하는 10개 이상의 NSFW 비디오 모델을 포함합니다.

전체 비검열 모델 카탈로그는 atlascloud.ai/models/explore/uncensored에서 확인할 수 있습니다. 본 리스트의 #15~#20 모델은 모두 단일 Atlas Cloud API 키를 통해 액세스할 수 있습니다.

NSFW 및 성인 콘텐츠 생성을 위한 최고의 비검열 AI 이미지 모델

2026년, FLUX 아키텍처는 고품질 비검열 이미지 생성의 대부분을 구동하며, Atlas Cloud API를 통해 가격 및 품질 등급별로 제공됩니다(Atlas Cloud, 텍스트-이미지 모델 리스트, 2026). Atlas Cloud 카탈로그는 총 33개의 텍스트-이미지 모델을 다룹니다. 사용 사례에는 순수 예술, 캐릭터 디자인, 비검열 란제리 모델 및 성인 인물 사진 생성, 게임 자산 제작, 대량 일괄 일러스트레이션 등이 포함됩니다.

브라우저 기반 및 API 비검열 이미지 도구에 대한 전체 분석을 원하시면, 최고의 비검열 AI 이미지 생성기 가이드에서 능력 비교를 확인할 수 있습니다. 특히 FLUX 아키텍처에 집중하는 개발자는 FLUX 비검열 이미지 생성기 가이드를 통해 미세 조정 및 워크플로우 세부 정보를 읽어보실 수 있습니다.

15. FLUX Schnell: 일괄 생성을 위한 가장 빠른 비검열 AI 이미지 모델

Atlas Cloud 이미지 카탈로그에서 가장 저렴한 옵션입니다. 이미지당 $0.003로, 세부 묘사보다 속도와 양이 중요한 일괄 생성 워크플로우에 적합한 도구입니다. 일일 제한은 없으며, 학습을 위해 콘텐츠가 저장되지도 않습니다.

- 가격: 이미지당 $0.003

- VRAM: 필요 없음 (API 액세스)

- 용도: 일괄 이미지 생성, 빠른 프로토타이핑, 고용량 비검열 출력

- 플랫폼: Atlas Cloud API

이미지당 0.003라면0.003라면 0.003라면3.00의 예산으로 1,000장의 이미지를 생성할 수 있습니다. 이러한 출력 비용은 대부분의 클라우드 제공업체에서 결과 파일을 저장하는 스토리지 비용보다 저렴합니다. 이는 과거에 일괄 생성을 위해 값비싼 로컬 GPU를 밤새 구동하던 스튜디오의 경제 모델을 완전히 뒤집어 놓았습니다. 이제 API 접근 방식이 대량 작업에 훨씬 저렴하고 빠릅니다.

16. FLUX Dev: 최종 프로덕션을 위한 최고 품질의 비검열 AI 이미지 모델

FLUX Schnell 가격의 4배이지만, 해부학적 구조, 조명 및 질감 묘사가 확연히 뛰어납니다. 개별 이미지의 품질이 중요한 최종 결과물에서는 $0.012의 가격대가 실질적인 업그레이드입니다. 포트폴리오 작품, 상업적 성인 콘텐츠, 그리고 품질이 가장 중요한 프로덕션 자산에 적합합니다.

- 가격: 이미지당 $0.012

- VRAM: 필요 없음 (API 액세스)

- 용도: 고품질 단일 이미지, 포트폴리오 작품, 최종 프로덕션 자산

- 플랫폼: Atlas Cloud API

17. FLUX Dev LoRA: 사용자 정의 스타일 학습을 지원하는 비검열 이미지 모델

LoRA 미세 조정은 FLUX Dev 베이스에 사용자 정의 스타일, 캐릭터 외형 또는 피사체를 주입합니다. 배치 전반에 걸쳐 캐릭터의 일관성을 유지해야 하거나 모든 이미지에 특정 하우스 스타일을 적용하고 싶을 때 사용해야 하는 모델입니다. Atlas Cloud는 서버 측에서 LoRA 로딩을 처리합니다.

- 가격: 이미지당 $0.015

- VRAM: 필요 없음 (API 액세스)

- 용도: 캐릭터 일관성, 사용자 정의 스타일 학습, 브랜드 이미지 시리즈

- 플랫폼: Atlas Cloud API

18. Z-Image Turbo: 중간 품질의 예산형 비검열 AI 이미지 모델

가격-품질 곡선에서 FLUX Schnell과 FLUX Dev 사이에 위치합니다. 이미지당 $0.01인 Z-Image Turbo는 Schnell이 저가형에서 보여주는 단순화 없이 속도에 최적화된 다른 아키텍처를 제공합니다. Schnell의 품질이 충분하지 않고 FLUX Dev의 비용이 필요한 양을 감당하기 너무 높을 때의 실용적인 선택입니다.

- 가격: 이미지당 $0.01

- VRAM: 필요 없음 (API 액세스)

- 용도: 품질과 비용의 균형이 필요한 적정 물량 생성

- 플랫폼: Atlas Cloud API

2026년 NSFW 애니메이션을 위한 최고의 비검열 AI 비디오 모델

2026년, 비검열 비디오 생성은 이미지 생성과는 별도의 파이프라인이 필요합니다. 주류 비디오 플랫폼은 원본 이미지가 어디서 생성되었든 관계없이 동일한 콘텐츠 필터를 적용하여 NSFW 콘텐츠 애니메이션을 거부하기 때문입니다(Atlas Cloud, 비검열 모델 카탈로그, 2026). Atlas Cloud의 비검열 비디오 페이지는 "제한 없는 창의적 자유. 필터 없음. 제한 없음."이라는 문구를 내걸고 있으며, Wan 2.6, Wan 2.5 및 Van 시리즈 변형을 포함하여 10개 이상의 NSFW 비디오 모델을 다룹니다.

19. Wan 2.2 Turbo Spicy Infinite I2V: 가장 저렴한 비검열 비디오 모델

스틸 이미지로부터 NSFW 애니메이션을 만드는 입문용 옵션입니다. 초당 $0.01로 정적 이미지를 NSFW 비디오 콘텐츠로 애니메이트하는 가장 비용 효율적인 방법입니다. 가변 클립 지속 시간으로 1080p 해상도까지 지원하므로 예산을 중시하는 프로덕션 파이프라인의 올바른 시작점입니다.

- 가격: 초당 $0.01

- 해상도: 1080p

- 지속 시간: 가변

- 용도: 비용 효율적인 NSFW 애니메이션 및 모션 컨셉 미리보기

- 플랫폼: Atlas Cloud API

20. Seedance v1.5 Spicy: 최종 출력물을 위한 최고 품질의 비검열 비디오 모델

카탈로그에서 영화급 품질을 제공하는 옵션입니다. 초당 $0.049로 Wan 2.2 Turbo Spicy Infinite보다 약 2.5배 비싸지만, 더 부드러운 움직임, 프레임 간 더 나은 피사체 일관성, 자연스러운 전환을 생성합니다. 시각적 충실도가 가장 중요한 최종 품질의 NSFW 비디오 출력의 경우, Atlas Cloud 비검열 비디오 라인업에서 가장 뛰어난 옵션입니다.

- 가격: 초당 $0.049

- 해상도: 720p

- 지속 시간: 5초

- 용도: 최종 품질의 NSFW 비디오, 전문 성인 콘텐츠, 즉시 배포 가능한 결과물

- 플랫폼: Atlas Cloud API

최고의 비검열 AI 비디오 생성기 가이드에서 모든 지속 시간 및 해상도 옵션을 포함한 Wan 2.7 및 Wan 2.2 Spicy 시리즈 변형 전체 카탈로그를 확인할 수 있습니다.

비검열 AI 모델 빠른 선택 가이드

| 필요 항목 | 권장 사항 |

|---|---|

| 최고의 종합 비검열 LLM | llama2-uncensored 또는 dolphin-llama3 |

| 코딩 작업 | dolphin-mixtral 8x7B 또는 dolphincoder |

| 롤플레잉 및 창의적 글쓰기 | hermes3 |

| 4GB VRAM 미만 | dolphin-phi 2.7B |

| 비검열 이미지 생성 | Atlas Cloud를 통한 FLUX Schnell (이미지당 $0.003) |

| 이미지 기반 NSFW 비디오 | Atlas Cloud를 통한 Wan 2.2 Turbo Spicy Infinite (초당 $0.01) |

비검열 AI 모델 FAQ

2026년 가장 비검열적인 AI 모델은 무엇인가요?

Ollama 다운로드 수 기준

1llama2-uncensored1dolphin-llama3Ollama에서 실행 가능한 비검열 모델은 무엇인가요?

이 리스트 중 10개 모델이 Ollama 비검열 모델로 실행됩니다:

1llama2-uncensored1dolphin-llama31dolphin-mixtral1dolphin-mistral1dolphin-phi1hermes31wizard-vicuna-uncensored1dolphincoder1wizardlm-uncensored1everythinglm1jaahas/qwen3.5-uncensored1ollama pull [모델명]OpenRouter에서 사용 가능한 비검열 모델은 무엇인가요?

2026년, OpenRouter는 API를 통해 비검열 LLM을 호스팅하여 GPU 요구 사항을 완전히 제거합니다. 옵션으로는 100만 토큰당 $0(하루 200건 요청)인 무료 티어

1venice/uncensored1Sao10K Euryale 70B1Lunaris 8B1TheDrummer Cydonia 24B삭제(abliterated) 모델과 미세 조정(fine-tuned) 비검열 모델의 차이는 무엇인가요?

삭제 모델은 모델의 가중치 수준에서 외과적으로 거부 가중치를 제거합니다.

1Dolphin노트북에서 비검열 AI 모델을 로컬로 실행할 수 있나요?

네.

1dolphin-phi 2.7B결론

2026년 최고의 비검열 AI 모델은 전적으로 귀하의 사용 사례에 달려 있습니다. 일반적인 LLM 작업에는

1dolphin-llama31dolphin-phi1venice/uncensored이미지, 비디오, 편집기 전반에 걸친 비검열 AI 도구의 완전한 개요를 찾으시는 독자라면 비검열 AI 이미지 생성기 가이드에서 전체 환경을 파악하실 수 있습니다.