DeepSeek-V4 預覽版發布:100 萬 Token 上下文、Agent 升級與開源權重

今日(4 月 24 日),DeepSeek 正式發布並開源了其全新模型系列 DeepSeek-V4 的預覽版本。

DeepSeek-V4 支援高達 100 萬 token 的上下文窗口,並在智能體(Agent)能力、世界知識與推理能力方面,達到國內及開源模型的領先水準。該系列包含兩種規格:

- DeepSeek-V4-Pro — 旗艦模型,這是一個擁有 1.6 兆(1.6T)總參數的巨型 MoE(混合專家模型),但每次前向傳遞僅激活 49B 參數——這是其高效能的關鍵。

- DeepSeek-V4-Flash — 更快速、更具成本效益的選擇。它採用相同的 MoE 架構,但規模更小(總參數 284B,激活 13B),可實現更快、更便宜的推理。

- 兩款模型均共享 100 萬 token 上下文窗口,並全面開源且提供 API 訪問。

| 模型 | 參數量 | 激活參數 | 預訓練數據 | 上下文長度 | 是否開源 | API 服務 | 網頁/App 模式 |

| deepseek-v4-pro | 1.6T | 49B | 33T | 1M | ✓ | ✓ | 專家模式 (Expert) |

| deepseek-v4-flash | 284B | 13B | 32T | 1M | ✓ | ✓ | 快速模式 (Fast) |

從即日起,您可以透過 chat.deepseek.com 或官方 App 與 DeepSeek-V4 對話。API 也已上線——只需將

1model_name1deepseek-v4-pro1deepseek-v4-flash我們此前已報導過相關預測與發布前分析(請參閱我們的 DeepSeek V4 期待指南 與 技術深度解析),現在我們獲得了來自官方的第一手確切細節。以下內容涵蓋了本次發布的具體細節、新功能,以及這對於目前正在開發或評估 AI 模型的使用者意味著什麼。

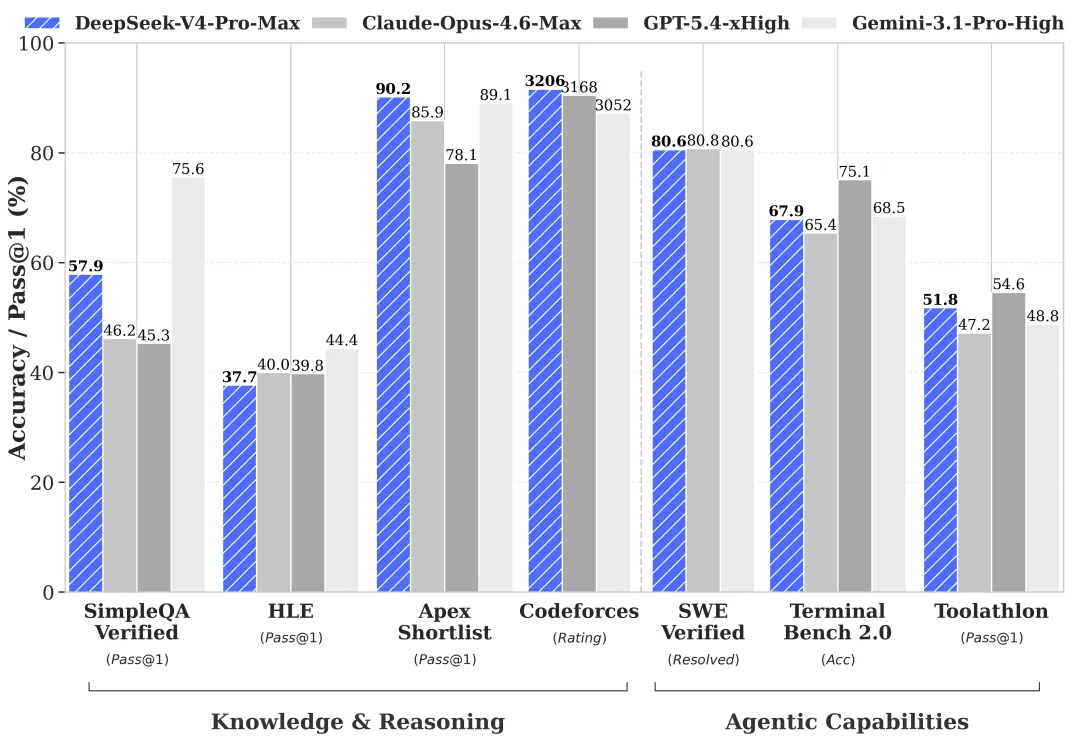

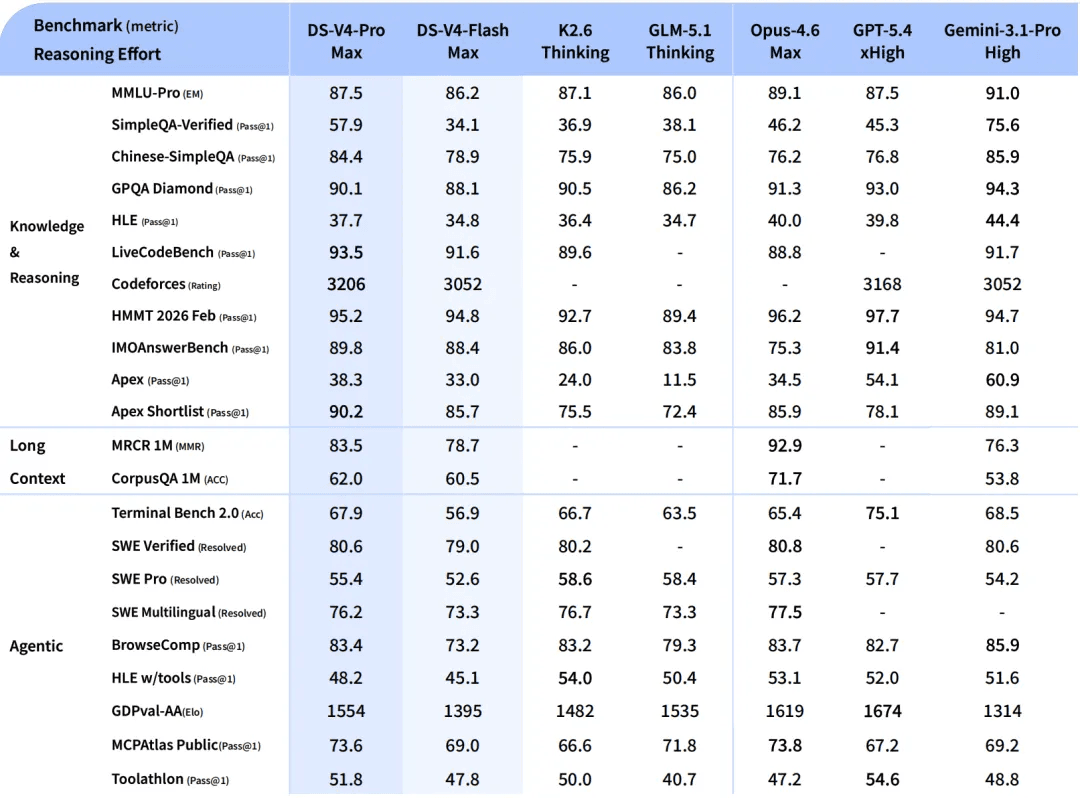

DeepSeek-V4-Pro:對標頂級閉源模型

大幅增強的智能體(Agent)能力。 與前代產品相比,DeepSeek-V4-Pro 在智能體任務表現上有顯著提升。在智能體編碼基準測試中,V4-Pro 目前在所有開源模型中處於領先地位。DeepSeek 內部已將 V4-Pro 作為公司首選的編碼智能體使用——員工回饋顯示其體驗超越了 Claude Sonnet 4.5,輸出品質在非思考模式下接近 Claude Opus 4.6,儘管與 Opus 4.6 的思考模式相比仍有差距。

豐富的世界知識。 DeepSeek-V4-Pro 在世界知識基準測試中顯著優於其他開源模型,僅略遜於頂級閉源模型 Gemini Pro 3.1。

世界級的推理能力。 在數學、STEM 和競賽級程式設計評估中,DeepSeek-V4-Pro 超越了所有此前評測過的開源模型,並達到了全球頂尖閉源模型的效能水準。

DeepSeek-V4-Flash:快速且經濟的選擇

與 V4-Pro 相比,DeepSeek-V4-Flash 在世界知識方面略有不足,但提供相當的推理效能。由於參數量更小且激活成本更低,V4-Flash 提供了更快的響應速度與更經濟的 API 定價。

在智能體基準測試中,V4-Flash 在簡單任務上與 V4-Pro 持平,但在複雜任務上仍存在一定差距。

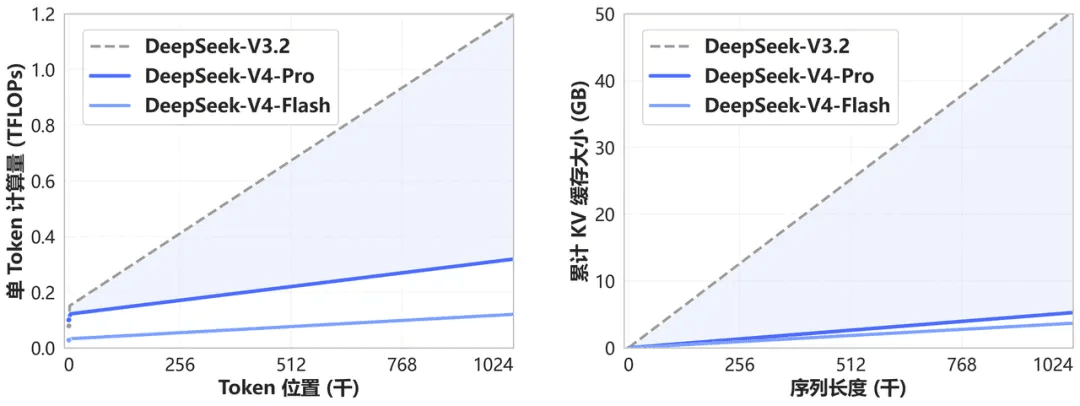

架構創新與極致的上下文效率

DeepSeek-V4 引入了一種全新的注意力機制,可在 token 維度上執行壓縮。結合 DSA (DeepSeek Sparse Attention),此設計實現了世界領先的長上下文效能,同時與傳統方法相比,顯著降低了計算與記憶體需求。

展望未來,100 萬(1M)token 上下文將成為所有 DeepSeek 官方服務的標配。

針對智能體(Agent)使用場景的專項優化

DeepSeek-V4 已針對包括 Claude Code、OpenClaw、OpenCode 和 CodeBuddy 在內的主流智能體產品進行了微調與優化。在程式碼生成、文件撰寫及其他由智能體驅動的任務中,均觀察到了效能提升。

這種針對框架的特定調優在實踐中極為重要。一個在孤立環境表現良好,但在結構化智能體循環中行為不一致的模型,很難被可靠地部署。將主流智能體框架視為一等優化目標的決策,反映了生產環境中 AI 使用方式的演進。

DeepSeek-V4 API 訪問

V4-Pro 與 V4-Flash 現已透過 DeepSeek API 提供,支援 OpenAI ChatCompletions 介面與 Anthropic 介面,這意味著現有的整合專案只需極少的程式碼修改即可指向 V4 模型。

1base_url1deepseek-v4-pro1deepseek-v4-flash兩款模型均支援最高 100 萬 token 的上下文長度,並提供非思考 (non-thinking) 與 思考 (thinking) 模式。在思考模式下,可設定

1reasoning_effort⚠️ 棄用通知: 舊版模型名稱

與text1deepseek-chat將於 三個月後(2026 年 7 月 24 日) 停止服務。過渡期間,它們將分別映射至text1deepseek-reasoner的非思考模式與思考模式。若您的生產環境正在使用這些名稱,請盡早規劃遷移。text1deepseek-v4-flash

開源權重與本地部署

- 模型權重:Hugging Face | ModelScope

- 技術報告:DeepSeek-V4 PDF

對於考慮進行本地或私有化部署的團隊,需要注意的是,此參數規模的模型(特別是總參數 1.6T 的 V4-Pro)對硬體要求極高。開源可用性對於企業合規與客製化場景而言是重要的優勢,但對大多數團隊來說,雲端 API 訪問會是更實際的起點。

DeepSeek-V4 發布的真正意義

綜合來看,本次發布有三個重點值得關注。

首先,100 萬上下文的承諾比表面看起來更具意義。DeepSeek 並非將其作為高階付費層級,而是作為所有官方服務的基礎門檻。這釋出了一個關於開源技術前沿發展方向的訊號,並悄然推動其他所有供應商跟進。

其次,以智能體為先的優化工作——特別是針對 Claude Code、OpenCode 等進行的適配——反映了 DeepSeek 在部署策略上的成熟。基準測試效能只是敲門磚,在生產環境中真正重要的是模型在開發者實際工具中的表現。

第三,相對於 Claude Opus 4.6 的誠實競爭定位值得注意。DeepSeek 並未宣稱全方位超越,而是給出了分層評估:優於 Sonnet 4.5,非思考模式接近 Opus 4.6,思考模式仍落後於 Opus 4.6。這種明確性使得其聲明更具可信度。

對於正在評估模型以用於智能體工作流、長文檔處理或複雜推理任務的開發者來說,DeepSeek-V4-Pro 現已成為極具競爭力的開源選項。而對於成本優先或對延遲敏感的流程,V4-Flash 提供了一個可靠的輕量級替代方案。

在 Atlas Cloud 上嘗試 DeepSeek-V4

Atlas Cloud 是一個生產級的 AI 平台,專為希望在不管理底層基礎設施的情況下,獲得可靠、高性價比、全球頂級 AI 模型訪問權的開發者與團隊而設計。透過統一的 API、透明的定價與企業級合規(符合 SOC 2 標準,支援 HIPAA),Atlas Cloud 讓您能專注於開發而非營運。

DeepSeek on Atlas Cloud。 我們已支援 DeepSeek 模型家族,包括 DeepSeek V3.2、V3.2 Fast、V3.2 Speciale 與 V3.2 Exp,現已可透過單一 API 端點以具競爭力的價格使用。Atlas Cloud 上的 DeepSeek 模型針對長上下文任務與智能體管道進行了優化,提供完整的上下文窗口支援且無量化損失。除了 DeepSeek 之外, Atlas Cloud 還讓您能存取 LLM 領域中的 300 多個模型。

DeepSeek-V4 即將登陸 Atlas Cloud。 我們正積極整合 DeepSeek-V4-Pro 與 V4-Flash。敬請關注發布公告——在此期間,歡迎探索平台現有的豐富模型資源。