摘要: GLM-5-Turbo 由智譜 AI (Z.ai) 開發,是一款專為 OpenClaw 應用場景設計的大型語言模型,也是該公司首個閉源發佈的產品(此前以代號 Pony-Alpha-2 進行測試),即將於 Atlas Cloud 上線。

該模型在工具使用、指令執行、多步工作流和長週期任務處理方面帶來了顯著改進,並支持高達 200K token 的上下文窗口。其數據分析能力可與 Claude Opus 4.6 相媲美,在自動化和信息處理任務中表現優於 GLM-5。利用 Atlas Cloud 的統一 API 和多模型生態系統,GLM-5-Turbo 能夠高效部署於複雜的業務自動化、長文檔分析和軟體開發場景中,為開發者和企業提供了一種高性價比且易於整合的 AI 解決方案。

我們很高興地宣佈,GLM-5-Turbo 即將登陸 Atlas Cloud!

- 什麼是 GLM-5-Turbo:GLM-5-Turbo 由智譜 AI (Z.ai) 開發,是專為 OpenClaw 用例量身訂製的大型語言模型。它是該團隊發佈的首個閉源模型,相比 GLM-5,其運行效率更高,且單次調用成本更低。在此之前,智譜 AI 以 Pony-Alpha-2 的代號對該新一代模型進行了非正式測試。

- 核心功能:GLM-5-Turbo 在工具使用、指令遵循、多步工作流和持久化任務執行方面提供了實質性的改進。它支持跨場景的動態推理模式、即時串流輸出、增強的工具整合,以及高達 200K token 的長上下文處理能力。

- 發佈日期:已經上線 Atlas Cloud。

GLM-5 此前作為 Artificial Analysis Intelligence Index 上表現最佳的開源模型備受關注,超越了 Gemini 3 Pro。作為其繼任者,GLM-5-Turbo 引入了一系列迭代升級,詳情如下。

核心定位:針對 ClawBench 優化的模型

強勁的基準測試性能

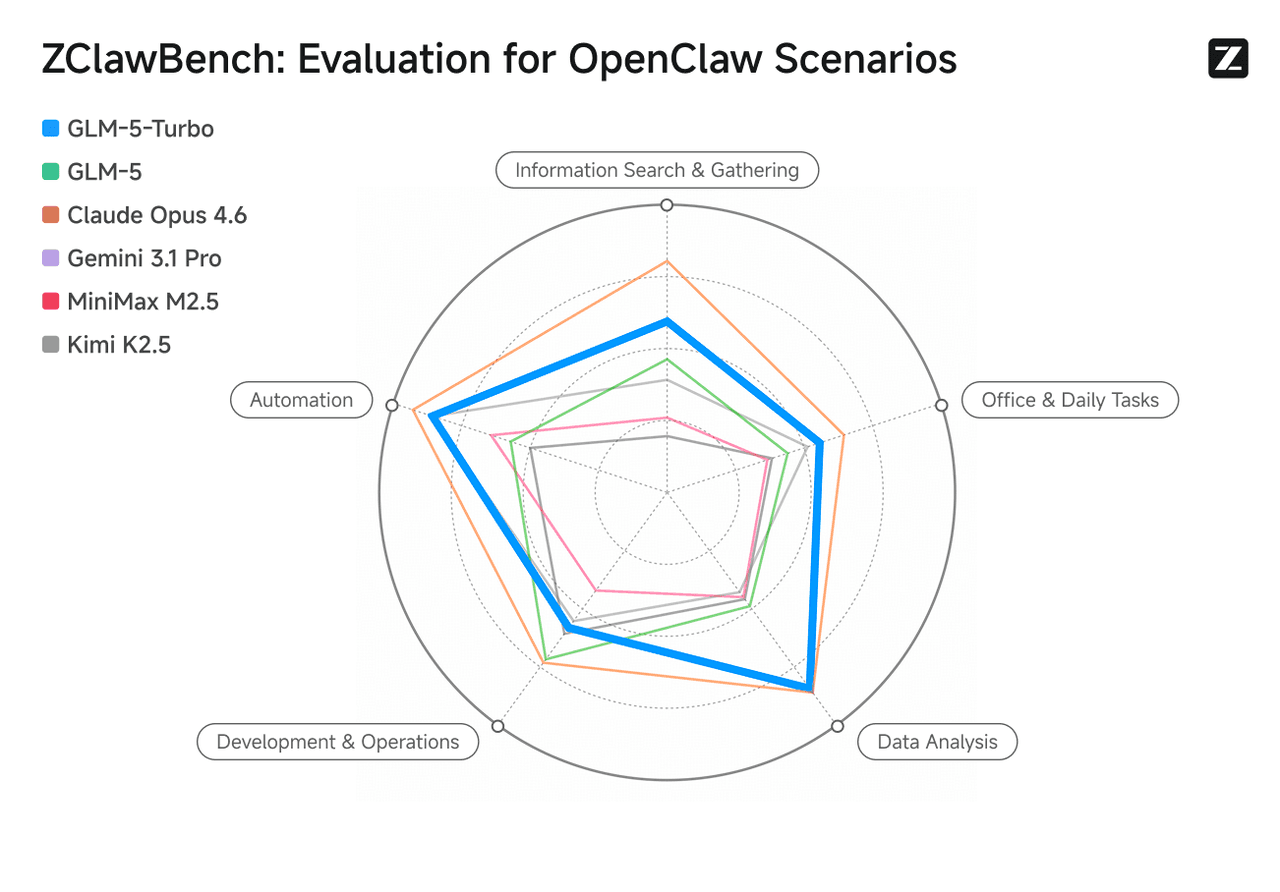

GLM-5-Turbo 針對 OpenClaw 場景進行了優化,顯著增強了工具調用、指令執行和複雜任務編排的能力。其數據分析性能與 Claude Opus 4.6 持平,並在自動化、信息檢索、辦公效率和分析任務方面超越了 GLM-5。

圖片來源:智譜 AI (Z.ai) 官網。

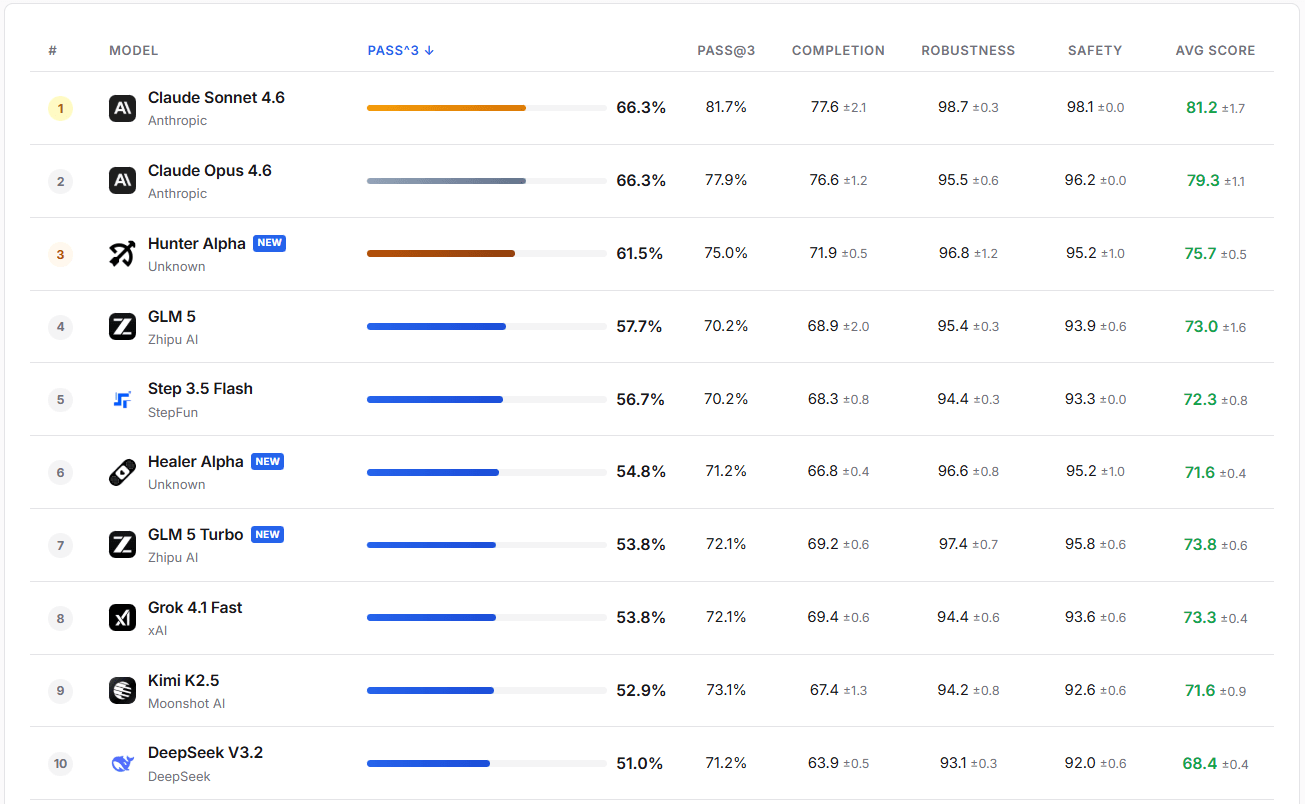

在實際評估中,GLM-5-Turbo 表現出極高的穩健性和安全性。其 PASS@3 成功率超過了 GLM-5、Step 3.5 Flash 和 Kimi K2.5。

圖片來源:https://claw-eval.github.io/

增強的工具使用與外部整合

Z.ai 在訓練過程中強化了 GLM-5-Turbo 的智慧體 (Agentic) 能力,使其能夠與外部工具無縫互動。這種以執行為導向的設計存在一定的取捨:一些用戶反饋稱,在角色扮演場景中,其語氣相比 GLM-5 略顯機械。

為了兼顧各模型的優勢,Atlas Cloud 提供了統一接口,允許用戶同時查詢多個模型,從而進行並排比較和選擇。

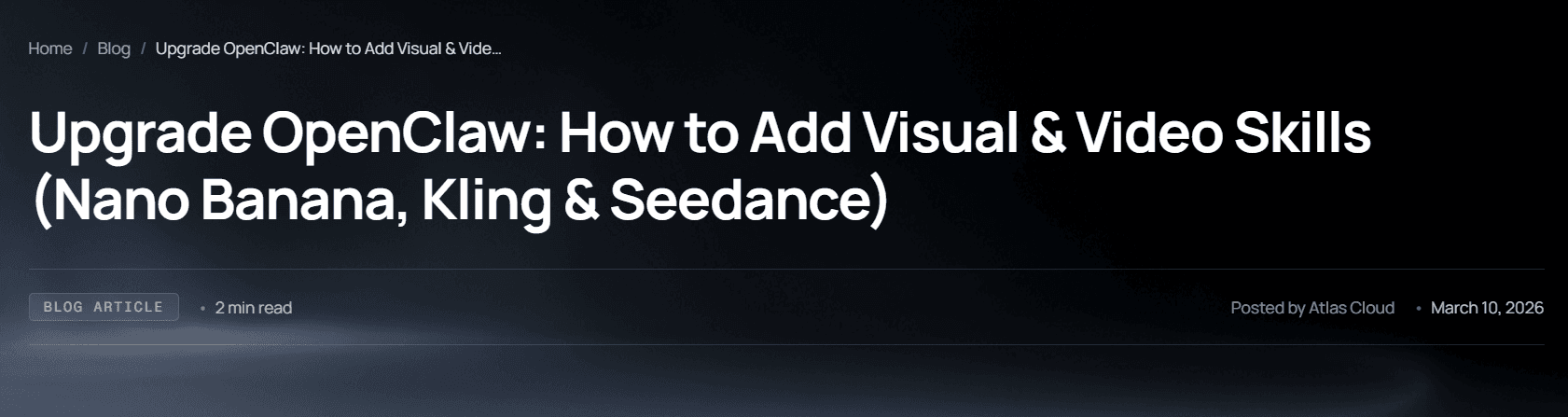

此外,用戶可以定義自訂技能,或者允許 GLM-5-Turbo 自主發現並安裝這些技能。

圖片來源:Atlas Cloud

長週期自主執行

GLM-5-Turbo 針對需要定時觸發或長時間運行的任務進行了優化。它能夠處理具有強任務連續性的持久化、多階段和跨時間工作流。

該模型能根據任務複雜度主動建議執行策略。在程式碼優化的對比測試中,GLM-5-Turbo 提出的建議在約 10% 的案例中優於競爭模型。

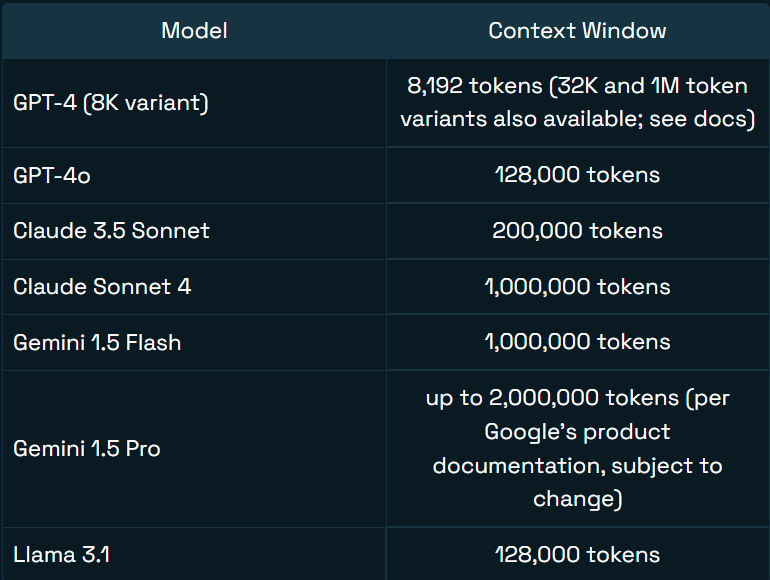

200K Token 上下文窗口

支持高達 200K token(約 13.3 萬個英文單詞),GLM-5-Turbo 能夠在單次對話中保留並利用大量上下文信息。即使在對話的後期階段,也能實現對早期信息的準確檢索。

圖片來源:Jim Allen Wallace (Redis)

應用場景

自動化複雜工作流

憑藉其增強的 OpenClaw 能力,GLM-5-Turbo 可以拆解複雜的業務流程,識別底層邏輯,並自主定位或生成執行任務所需的技能。

例如,在短影音製作中,該模型可以搜索、安裝並編排寫作、圖像生成和影片製作工具——從頭到尾規劃並執行整個工作流。

長文檔問答與深度分析

該模型在單次對話中保持跨長文檔的完整上下文,從而實現準確的多輪問答。其高 token 效率確保了在較低計算成本下實現快速響應。

在大規模程式碼庫中,GLM-5-Turbo 可以分析架構設計,映射組件間的依賴關係,並標記低級程式碼更改可能引發的潛在連鎖反應。

"Vibe Coding"(氛圍程式設計)

在軟體開發生命週期中,GLM-5-Turbo 更像是一位嵌入複雜工作流的全端工程師。開發者可以概述高層邏輯,而模型則即時、增量地構建應用架構。

結合多模態技能,用戶可以上傳 UI 圖片、螢幕錄影或草圖,模型可直接將其轉換為功能性的前端組件。

為什麼在 Atlas Cloud 上使用 GLM-5-Turbo?

作為全模態 AI 基礎設施平台,Atlas Cloud 為用戶提供了統一的 API 接口。連接後,用戶可以輕鬆調用 300 多種先進的 AI 模型,涵蓋文本、圖像、影片生成或多模態模型。

目標受眾

- 獨立開發者:尋求低成本、簡化的方案來調用各種 AI 模型。

- 企業:需要穩定、安全且可擴展的設施來支持核心業務。

- 開發團隊:需要將多種跨模態模型高效整合到專案中。

- 工作流用戶:優先考慮工具鏈相容性,使用 ComfyUI 或 n8n 的用戶。

產品特色

- 極大簡化整合:平台提供與 OpenAI 相容的 API,瞬間簡化開發者的工作量。無需再在多個供應商金鑰之間切換,也無需為各平台的維護成本而煩惱。

- 成本優勢:與競爭對手相比,Atlas Cloud 的部署成本更低。Nano Banana 2 成本為 $0.056/張圖片(競爭對手為 $0.07/張圖片);Veo 3.1 價格為 $0.09/秒(競爭對手為 $0.1/秒)。此外,Playground 界面提供完全透明的價格,"運行"按鈕直接標註了每張圖片或每秒影片的扣費金額。

- 企業級穩定性與支持:Atlas Cloud 確保數據保護符合嚴格的隱私標準,並能夠處理敏感信息。

- 即插即用:專為與 ComfyUI 和 n8n 等工具無縫協作而構建,幫助企業削減切換成本並快速上手。

同類產品比較

- Fal.ai:雖然提供了一些模型,但 Atlas Cloud 擁有更豐富的選擇(300+)、更具競爭力的價格,且新註冊用戶可獲得 $1 試用金。

- Wavespeed:定價顯著更高。Atlas Cloud 提供 Wavespeed 未強調的額外企業合規支持和專家技術指導。

- Kie.ai:使用不透明的信用額度系統。Atlas Cloud 在界面上直接顯示每次運行的精確成本。模型數量也多於 Kie.ai。

- Replicate:專注於模型託管。Atlas Cloud 的優勢在於 API 的統一性、模型部署速度以及更具開發者友好的支持策略。

- OpenAI 或 Google:這些供應商僅提供自家的模型。有跨模態需求的用戶通常需要整合多種服務。Atlas Cloud 將專有模型和開源模型整合在同一個 API 下,降低了系統複雜性。

如何在 Atlas Cloud 上使用 GLM-5-Turbo?

方法 1:直接在平台上使用

方法 2:通過 API 整合使用

第 1 步: 獲取您的 API Key。在 控制台 創建並貼上您的 API key:

第 2 步: 查看 API 文檔。檢查請求參數、身份驗證方法等。

第 3 步: 發起您的第一個請求(Python 範例)

以 GLM-5 為例。

plaintext1{ 2 "model": "zai-org/glm-5", 3 "messages": [ 4 { 5 "role": "user", 6 "content": "Hello" 7 } 8 ], 9 "max_tokens": 1024, 10 "temperature": 0.7, 11 "stream": false 12}

常見問題

GLM-5-Turbo 與 GLM-5 有什麼區別? GLM-5-Turbo 更快且更具成本效益,token 效率顯著提高——據稱是 GLM-5 的三倍。它還專門針對 OpenClaw 場景進行了優化。

GLM-5-Turbo 與 MiniMax M2.7 相比如何? 兩個模型都針對智慧體工具使用進行了優化,並且比 GLM-5 具有更高的 token 效率。每個模型都支持約 200K token 的上下文窗口(MiniMax M2.7 支持 196,608 個 token)。我們正在準備一篇部落格進行更深入的對比評估,敬請期待!

建議使用哪種 GLM 模型進行 OpenClaw 部署? 建議使用 GLM-5-Turbo,因為它專門針對 OpenClaw 場景進行了優化,並實現了媲美 Claude Opus 4.6 的數據分析性能。