Atlas Cloud 正式接入备受瞩目的 GLM-5 模型,进一步拓展平台强大的生成式 AI 版图。

- 模型定位: 这款由 智谱 AI (ZHIPU AI/Z.ai) 打造的全新旗舰模型,在 GLM-4 系列 坚实的基础上实现了质的飞跃。凭借 7440 亿参数的 MoE 架构与突破性的 "slime" 后训练技术,GLM-5 将复杂推理、代码编程及智能体 (Agentic) 能力推向了新的高度。

- 核心特征: 专为解决高难度任务而生,旨在轻松驾驭复杂系统工程、长程自主智能体工作流以及深度逻辑问题求解。

- 价格:$0.95/3.15M 输入/输出。

核心技术:搭配 Slime 新技术与 MoE 架构,让模型逻辑更严密、编程更智能

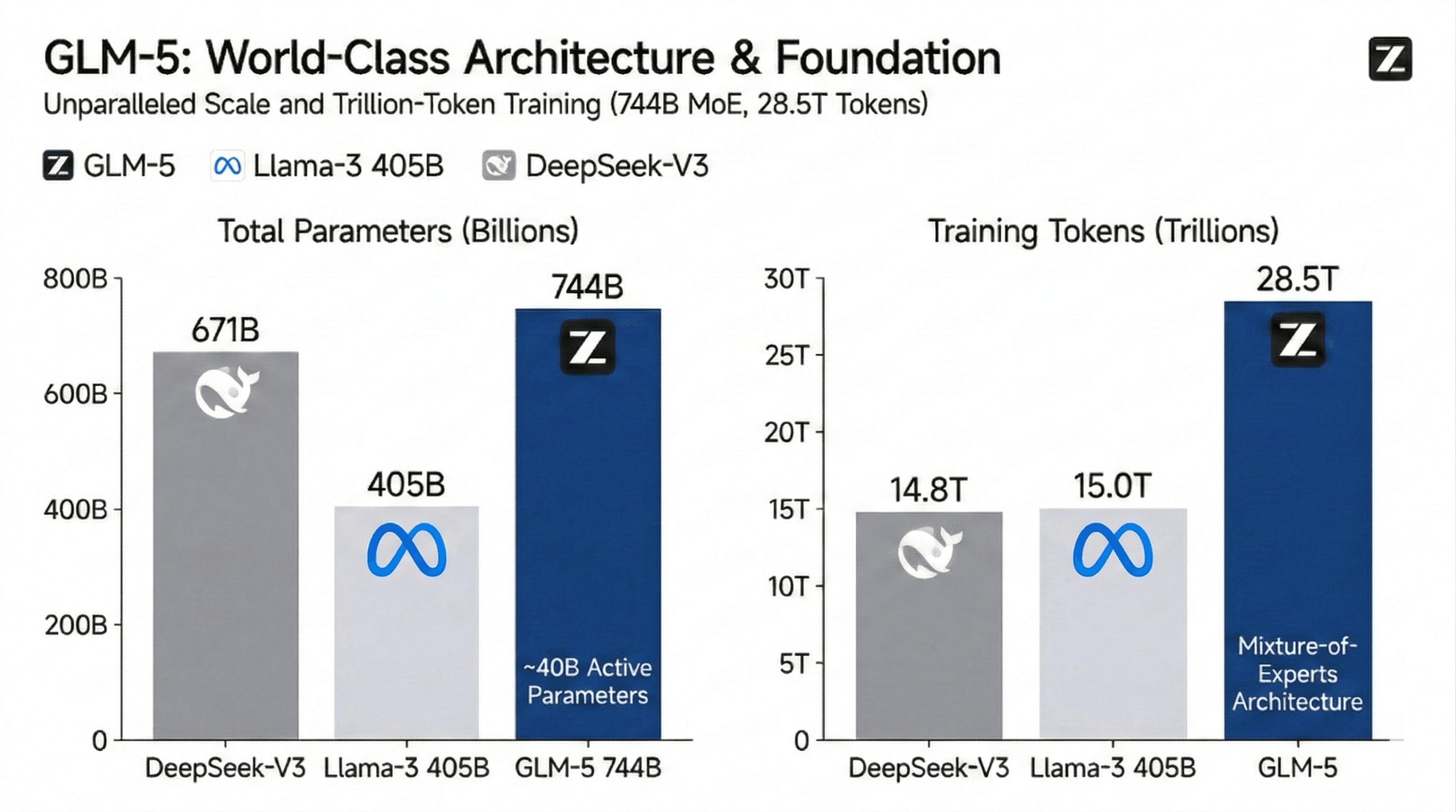

7440亿参数 MoE 架构与海量数据基座

GLM-5在模型规模和数据广度上实现了量级跨越,奠定了其“开源界天花板”的基础。

- 超大规模参数: 模型参数量扩展至 7440 亿(激活参数约 400 亿),采用混合专家(MoE)架构。相比 Llama-3 405B 或 DeepSeek-V3,GLM-5 在参数容量上更具优势,能够容纳更庞大的世界知识。

- 万亿级 Token 训练: 预训练数据高达 28.5 Trillion tokens。

- 部署优势: 通过 AtlasCloud 提供的 兼容 OpenAI 格式的 API直接调用,享受企业级的推理速度。

突破性的“智能体(Agentic)”系统工程能力

GLM-5专为处理长程、复杂的系统性任务而设计。

- 长程任务规划: 针对需要数十步推理的复杂任务(如自动化软件开发、法律文书撰写),GLM-5 展现了卓越的稳定性。

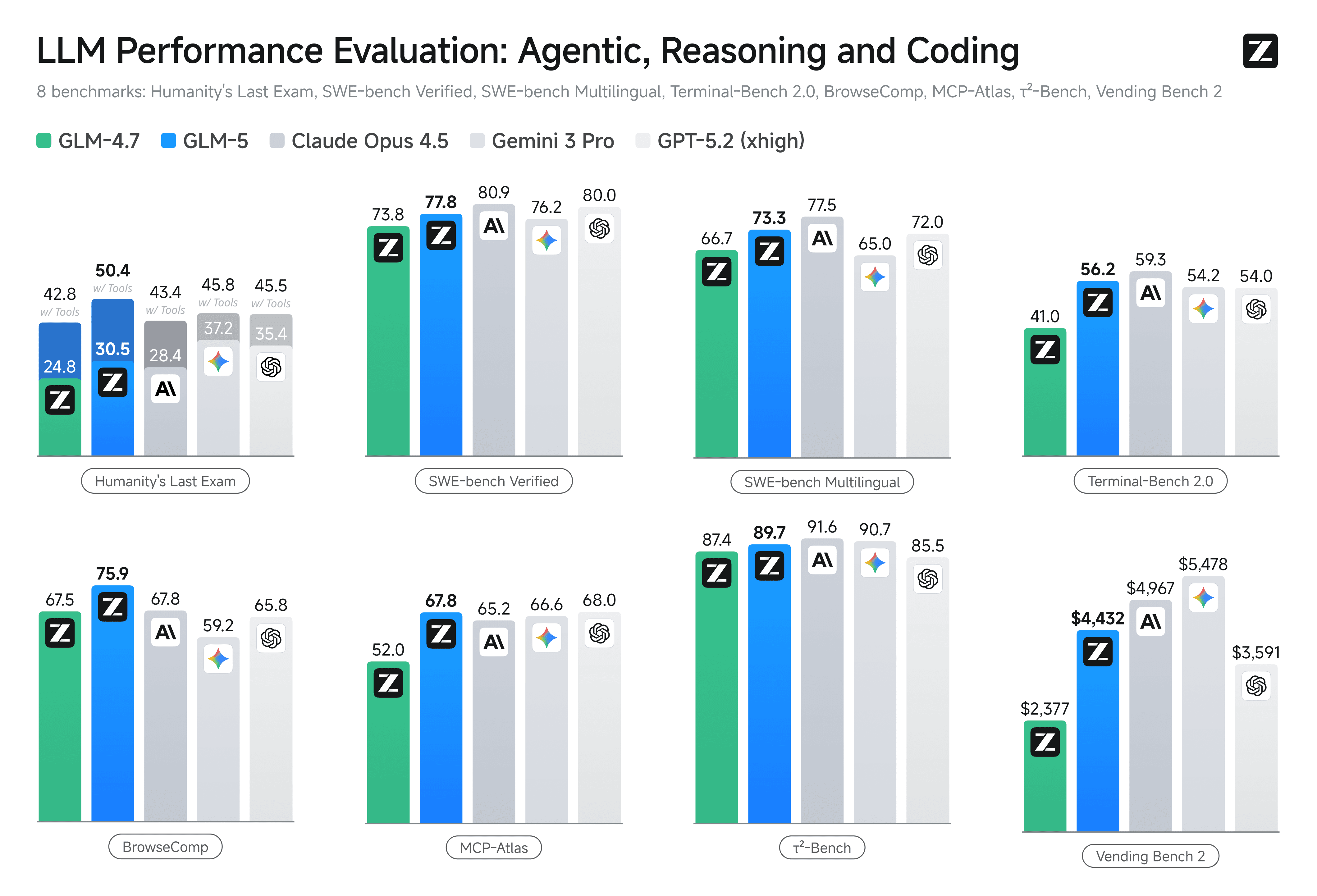

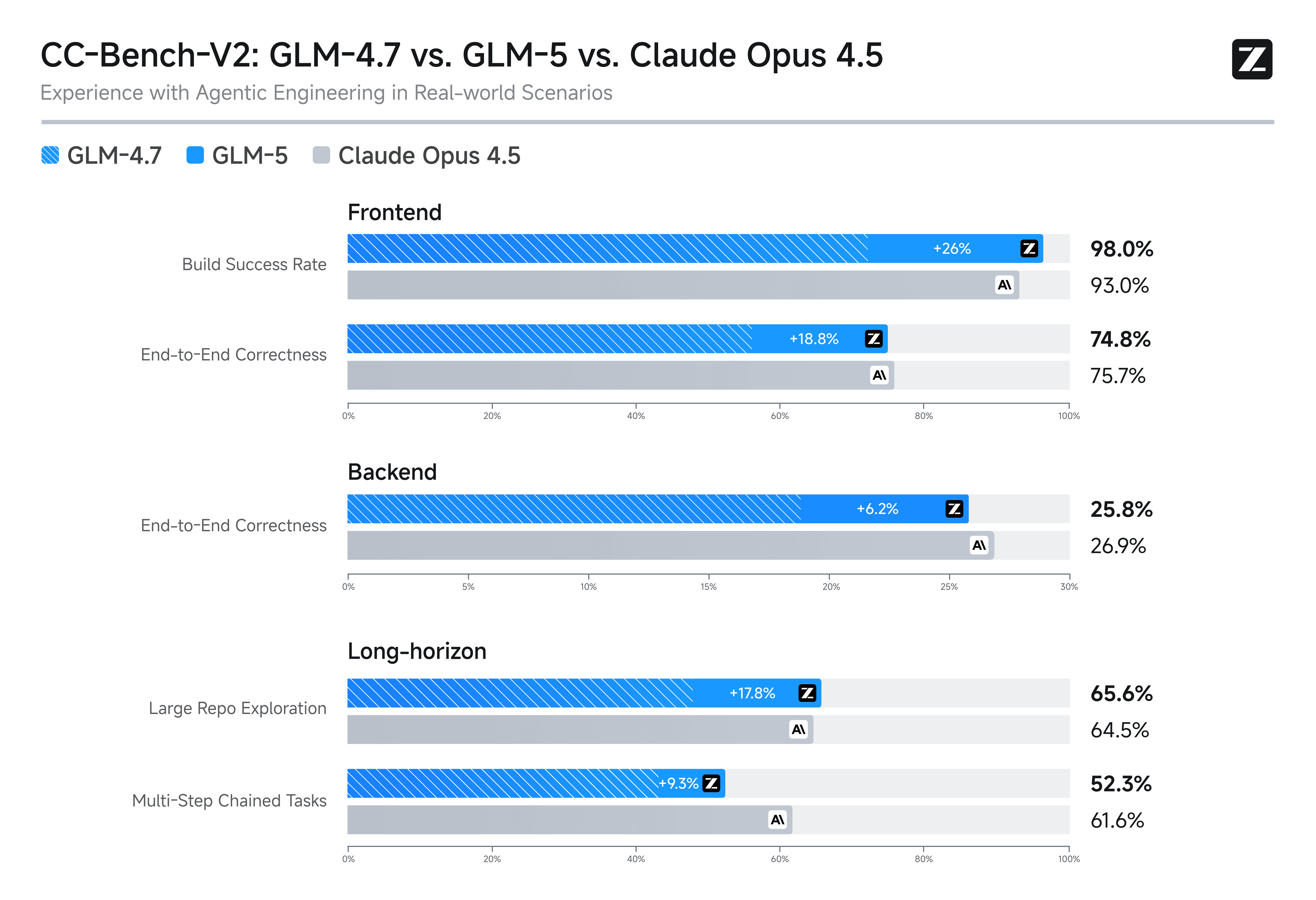

- 竞品对比: 在官方评测中,其智能体能力已大幅缩小了与 Claude Opus 4.5、 Gemini 3 Pro、GPT-5.2(xhigh) 系列等顶尖闭源模型的差距。

- API 应用场景: 对于希望构建自主 AI Agent 的开发者,利用 Atlas Cloud 的高并发 API 接入 GLM-5,可以更低成本地复现类似于 Devin 的自动化编程体验,且无需担心复杂的模型后端维护。

"Slime" 异步强化学习与编程逻辑跃升

智谱 AI 在 GLM-5 中引入了全新的后训练技术,显著提升了模型的逻辑严密性和代码生成质量。

- 技术创新: 引入名为 "Slime" 的异步强化学习(RL)基础设施,解决了大规模模型后训练效率低下的痛点。

- 能力对比: 在内部及学术基准测试中,GLM-5 在前端、后端开发及长期规划任务上大幅超越了前代模型GLM-4.7,并在开源模型中排名第一。

- 接入便利性: 这种高精度的代码和逻辑能力,使其成为编程辅助工具的理想后端。通过 Atlas Cloud,用户可以无缝切换调用 GLM-5 与平台上的其他主流视觉/语言模型(如Qwen、MiniMax等)进行对比测试,利用统一的 API 接口快速验证 GLM-5 在特定业务逻辑中的优越性。

实际应用:自动重构遗留代码,像专家一样深度分析海量研报

复杂软件工程与“遗留代码”自动化重构

资深开发者常面临接手遗留代码(文档缺失、逻辑混乱)的痛苦,普通模型因上下文窗口限制或逻辑能力不足,无法理解整个项目仓库的依赖关系,生成的代码往往无法通过编译或引入新 Bug。

- 全库级理解与修复: 得益于 GLM-5 强大的 7440 亿参数架构与长上下文能力,它不仅能补全代码,还能充当“AI 架构师”。用户可以上传整个项目库,让模型分析模块间的耦合关系,自动规划并执行跨文件的重构任务,例如将单体架构拆分为微服务。

- 无缝集成开发环境: 通过Atlas Cloud的API,以极低的迁移成本在本地开发流中接入GLM-5的代码推理能力,实现从“辅助写代码”到“自主修 Bug”的质变。

- 端到端测试生成: 针对缺乏测试用例的老旧系统,GLM-5 能根据代码逻辑反向推导业务规则并编写高覆盖率的单元测试,大幅降低系统维护风险。

深度研报分析与跨语种报告综述

分析师和科研人员每天需要面对海量信息,LLM通常难以无法进行深度推理、交叉验证数据真实性,且在处理多语言长文档时容易产生“幻觉”或丢失关键细节。

- 海量知识库的深度推理: 基于 28.5T tokens 训练的 GLM-5 拥有近乎全知的数据储备。在处理复杂的行业分析时,它不仅能总结信息,还能指出研报中的逻辑漏洞,甚至结合历史数据推演市场趋势,提供具有“专家直觉”的洞察,而非简单的文字堆砌。

- 高并发与低延迟的即时响应: 对于需要实时监控全球舆情的机构,直接部署超大模型成本极高。通过 Atlas Cloud 的高可用 API 服务接入 GLM-5,用户无需维护昂贵的 GPU 集群,即可利用云端的弹性算力并发处理数百份多语言文档。

- 结构化数据清洗: GLM-5 卓越的指令遵循能力使其能从非结构化的新闻、文档中精准提取数据(如营收、增长率)。

- (图示为GLM-5生成的docx文档)

Atlas Cloud: 使用 GLM-5 的最佳平台

在 AtlasCloud,告别繁琐的 API 密钥管理与平台切换。你可以:

怎么在 Atlas Cloud 使用GLM-5?

方法一:直接在平台上使用

方法二:接入API使用

步骤 1: 获取你的API

在控制台中创建并粘贴你的API

步骤 2:查阅 API 文档

请在我们的API 文档中查看接口端点、请求参数及认证方式。

步骤 3:发起您的首次请求(Python 示例)

这里以GLM-5为例

plaintext1import requests 2 3url = "https://api.atlascloud.ai/v1/chat/completions" 4headers = { 5 "Content-Type": "application/json", 6 "Authorization": "Bearer $ATLASCLOUD_API_KEY" 7} 8data = { 9 "model": "zai-org/glm-5", 10 "messages": [ 11 { 12 "role": "user", 13 "content": "what is difference between http and https" 14 } 15 ], 16 "max_tokens": 1024, 17 "temperature": 0.7, 18 "stream": True 19} 20 21response = requests.post(url, headers=headers, json=data) 22print(response.json())