DeepSeek-V4 预览版发布:支持 100 万 token 上下文、智能体升级及开源权重

今日(4 月 24 日),DeepSeek 正式发布并开源了其全新模型系列 DeepSeek-V4 的预览版本。

DeepSeek-V4 支持高达 100 万 token 的上下文窗口,在智能体能力、世界知识和推理方面达到了国内及开源模型中的领先水平。该系列包含两个尺寸:

- DeepSeek-V4-Pro — 旗舰模型,采用大规模 MoE(混合专家模型)架构,总参数量达 1.6 万亿,但单次前向传播仅激活 49B 参数——这是其高效运行的关键。

- DeepSeek-V4-Flash — 更快速、更具性价比的选择。它采用同样的 MoE 设计,但在更小的规模下运行(总参数 284B / 激活 13B),实现了更快的推理速度与更低的成本。

- 两款模型均支持 100 万 token 上下文窗口,并提供完全开源和 API 访问权限。

| 模型 | 参数量 | 激活参数 | 预训练数据 | 上下文长度 | 开源 | API 服务 | Web/App 模式 |

| deepseek-v4-pro | 1.6T | 49B | 33T | 1M | ✓ | ✓ | 专家模式 (Expert Mode) |

| deepseek-v4-flash | 284B | 13B | 32T | 1M | ✓ | ✓ | 快速模式 (Fast Mode) |

即日起,您可以通过 chat.deepseek.com 或官方 App 与 DeepSeek-V4 对话。API 服务也已同步上线——只需将 model_name 设置为 deepseek-v4-pro 或 deepseek-v4-flash 即可开始使用。

此前我们已分享过相关的预测与发布前分析(参阅我们的 DeepSeek V4 预期指南 和 技术深度解析),现在我们从源头获取了确认的官方细节。以下内容涵盖了本次发布的核心内容、新特性,以及这些变动对当前 AI 模型构建者和评估者的影响。

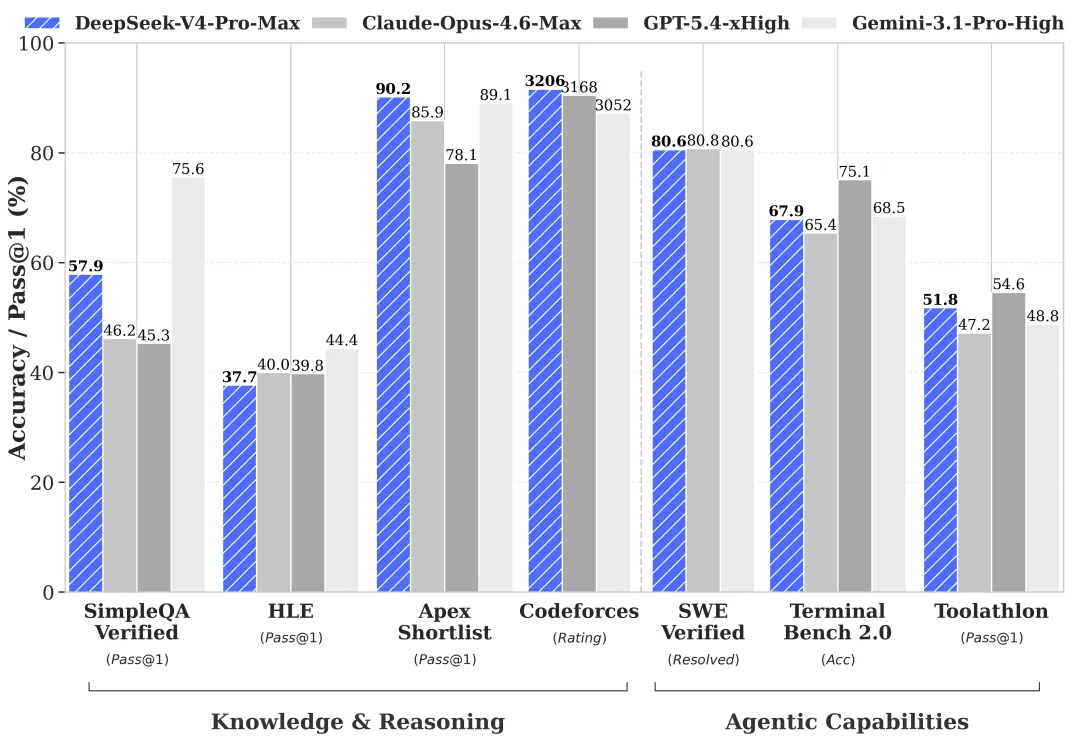

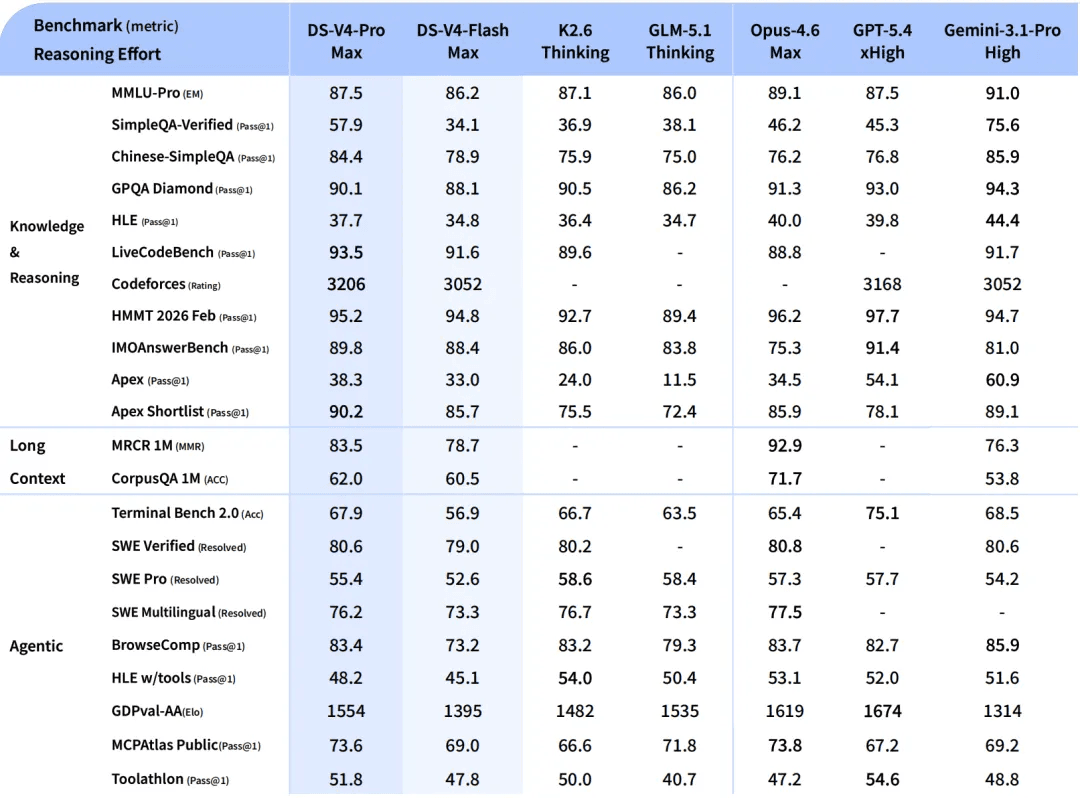

DeepSeek-V4-Pro:比肩顶级闭源模型

显著增强的智能体能力。 与前代产品相比,DeepSeek-V4-Pro 在智能体任务中展现出了质的飞跃。在智能体编程基准测试中,V4-Pro 现已处于所有开源模型的领先地位。DeepSeek 内部也已将 V4-Pro 作为首选编程智能体——员工反馈显示,其体验已超过 Claude Sonnet 4.5,在非思考模式下的输出质量接近 Claude Opus 4.6,虽在思考模式下仍略逊于 Opus 4.6。

丰富的世界知识。 在世界知识基准测试中,DeepSeek-V4-Pro 显著优于其他开源模型,仅略微落后于顶级闭源模型 Gemini Pro 3.1。

世界级的推理能力。 在数学、STEM 和算法竞赛评估中,DeepSeek-V4-Pro 超越了所有此前测试过的开源模型,并与全球顶尖闭源模型表现持平。

DeepSeek-V4-Flash:快速与高性价比之选

与 V4-Pro 相比,DeepSeek-V4-Flash 在世界知识储备上稍逊一筹,但提供了相当的推理性能。得益于较小的参数规模和更低的激活成本,V4-Flash 带来了更快的响应速度和更经济的 API 定价。

在智能体基准测试中,V4-Flash 在简单任务上与 V4-Pro 持平,但在处理复杂任务时仍存在一定差距。

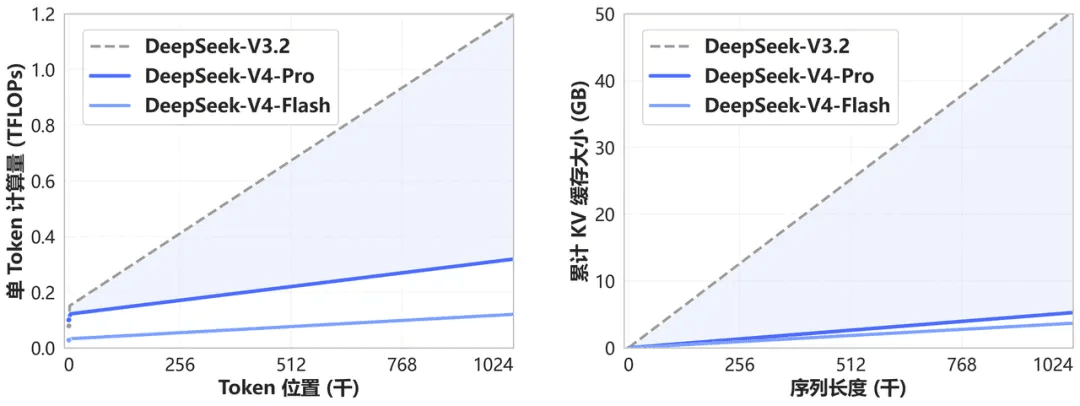

架构创新与极致的上下文效率

DeepSeek-V4 引入了一种全新的注意力机制,可沿 token 维度进行压缩。结合 DSA(DeepSeek 稀疏注意力机制),该设计实现了世界领先的长上下文性能,同时相较于传统方法大幅降低了计算和内存需求。

未来,100 万(1M)token 上下文将成为所有 DeepSeek 官方服务的标配。

针对智能体用例的专项优化

DeepSeek-V4 已针对包括 Claude Code、OpenClaw、OpenCode 和 CodeBuddy 在内的热门智能体产品进行了微调和优化。在代码生成、文档编写及其他智能体驱动的任务中,其性能表现均有所提升。

这种针对特定框架的调优在实践中意义重大。一个模型如果脱离框架表现尚可,但在结构化的智能体循环中表现不稳定,那么它将难以可靠地投入生产。将主流智能体框架视为首要优化目标的决定,反映了生产环境 AI 使用方式的演变。

DeepSeek-V4 API 访问

V4-Pro 和 V4-Flash 均已通过 DeepSeek API 提供服务,并支持 OpenAI ChatCompletions 接口和 Anthropic 接口,这意味着现有的集成只需极少的代码改动即可切换至 V4 模型。Base_url 保持不变;只需将模型参数更新为 deepseek-v4-pro 或 deepseek-v4-flash 即可。

两款模型均支持最大 100 万 token 的上下文长度,并提供非思考模式和思考模式。在思考模式下,可以通过 reasoning_effort 参数设置思考强度(high 或 max)。对于复杂的智能体工作流,建议使用 max 强度的思考模式。API 访问文档:https://api-docs.deepseek.com/zh-cn/guides/thinking_mode

⚠️ 弃用通知: 旧版模型名称 deepseek-chat 和 deepseek-reasoner 将在 三个月后(2026 年 7 月 24 日) 停用。在过渡期内,它们将分别映射到 deepseek-v4-flash 的非思考模式和思考模式。如果您在生产环境中使用这些名称,请尽早规划迁移。

开源权重与本地部署

- 模型权重:Hugging Face | ModelScope

- 技术报告:DeepSeek-V4 PDF

对于考虑本地或私有化部署的团队,需要注意的是,该量级的模型(特别是总参数 1.6T 的 V4-Pro)对硬件要求极高。开源提供对于企业合规性和定制化用例是一个巨大的优势,但对大多数团队而言,云端 API 访问依然是更实用的起步方案。

DeepSeek-V4 发布的核心意义

此次发布有三个显著亮点。

首先,100 万上下文的承诺意义远超表面。DeepSeek 并非将其作为高级会员特权,而是作为所有官方服务的底线。这标志着开源模型的前沿阵地正在向此看齐,并悄然推动其他所有服务商跟进。

其次,以智能体为先的优化工作——特别是针对 Claude Code、OpenCode 等进行的适配——反映了 DeepSeek 在部署策略上的成熟。基准测试成绩只是敲门砖,在开发者实际使用的工具中表现如何才是生产环境的关键。

第三,对 Claude Opus 4.6 坦诚的定位对比值得称道。DeepSeek 没有标榜全面超越,而是给出了分层的评估:优于 Sonnet 4.5,非思考模式接近 Opus 4.6,思考模式略逊于 Opus 4.6。这种具体且精准的对比使声明更具可信度。

对于评估智能体工作流、长文档处理或复杂推理任务模型的开发者而言,DeepSeek-V4-Pro 现在是一个极具竞争力的开源选择。而对于注重成本优化或延迟敏感的 pipeline,V4-Flash 提供了一个可靠的轻量级替代方案。

在 Atlas Cloud 上体验 DeepSeek-V4

Atlas Cloud 是一款生产级的 AI 平台,专为寻求可靠、高性价比 AI 模型访问且无需自行管理基础设施的开发者和团队打造。凭借统一的 API、透明的定价和企业级合规性(符合 SOC 2 和 HIPAA 标准),Atlas Cloud 让您可以专注于构建应用,而非运维。

Atlas Cloud 上的 DeepSeek。 我们现已支持 DeepSeek 模型家族,包括 DeepSeek V3.2、V3.2 Fast、V3.2 Speciale 和 V3.2 Exp,通过单一 API 端点以极具竞争力的价格即可调用。Atlas Cloud 上的 DeepSeek 模型针对长上下文工作流和智能体 pipeline 进行了优化,提供完整的上下文窗口支持且无量化损失。除了 DeepSeek, Atlas Cloud 还为您提供 LLM 生态系统中超过 300 种模型的访问权限。

DeepSeek-V4 即将上线 Atlas Cloud。 我们正全力推动 DeepSeek-V4-Pro 和 V4-Flash 的集成。请关注后续的发布公告,同时欢迎探索平台上现已提供的所有资源。