摘要: GLM-5-Turbo 由智谱 AI (Z.ai) 开发,是一款专为 OpenClaw 应用场景设计的大型语言模型,也是该公司首个闭源发布的产品(此前以代号 Pony-Alpha-2 进行测试),即将于 Atlas Cloud 上线。

该模型在工具使用、指令执行、多步工作流和长周期任务处理方面带来了显著改进,并支持高达 200K token 的上下文窗口。其数据分析能力可与 Claude Opus 4.6 相媲美,在自动化和信息处理任务中表现优于 GLM-5。利用 Atlas Cloud 的统一 API 和多模型生态系统,GLM-5-Turbo 能够高效部署于复杂的业务自动化、长文档分析和软件开发场景中,为开发者和企业提供了一种高性价比且易于集成的 AI 解决方案。

我们很高兴地宣布,GLM-5-Turbo 即将登陆 Atlas Cloud!

- 什么是 GLM-5-Turbo:GLM-5-Turbo 由智谱 AI (Z.ai) 开发,是专为 OpenClaw 用例量身定制的大型语言模型。它是该团队发布的首个闭源模型,相比 GLM-5,其运行效率更高,且单次调用成本更低。在此之前,智谱 AI 以 Pony-Alpha-2 的代号对该新一代模型进行了非正式测试。

- 核心功能:GLM-5-Turbo 在工具使用、指令遵循、多步工作流和持久化任务执行方面提供了实质性的改进。它支持跨场景的动态推理模式、实时流式输出、增强的工具集成,以及高达 200K token 的长上下文处理能力。

- 发布日期:已经上线Atlas Cloud。

GLM-5 此前作为 Artificial Analysis Intelligence Index 上表现最佳的开源模型备受关注,超越了 Gemini 3 Pro。作为其继任者,GLM-5-Turbo 引入了一系列迭代升级,详情如下。

核心定位:针对 ClawBench 优化的模型

强劲的基准测试性能

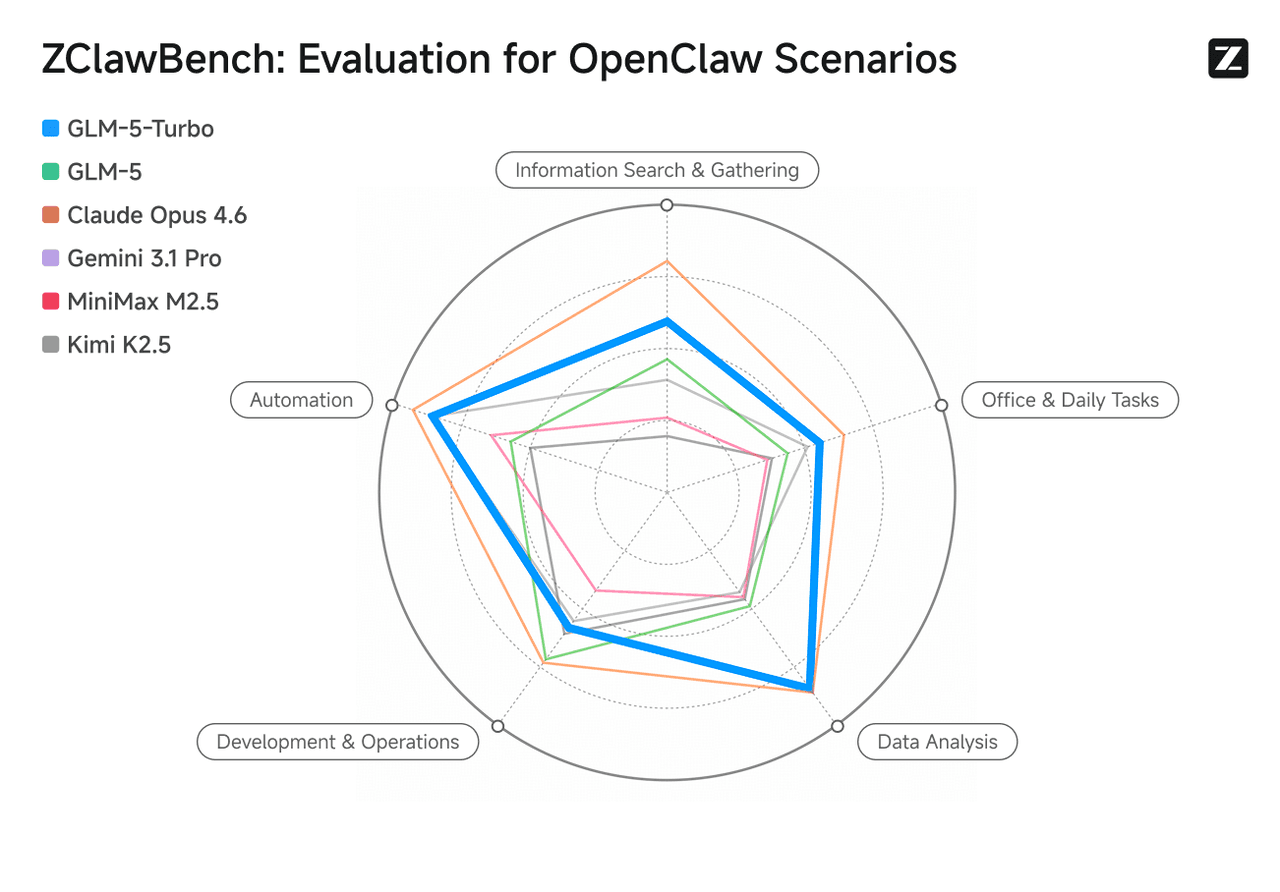

GLM-5-Turbo 针对 OpenClaw 场景进行了优化,显著增强了工具调用、指令执行和复杂任务编排的能力。其数据分析性能与 Claude Opus 4.6 持平,并在自动化、信息检索、办公效率和分析任务方面超越了 GLM-5。

图片来源:智谱 AI (Z.ai) 官网。

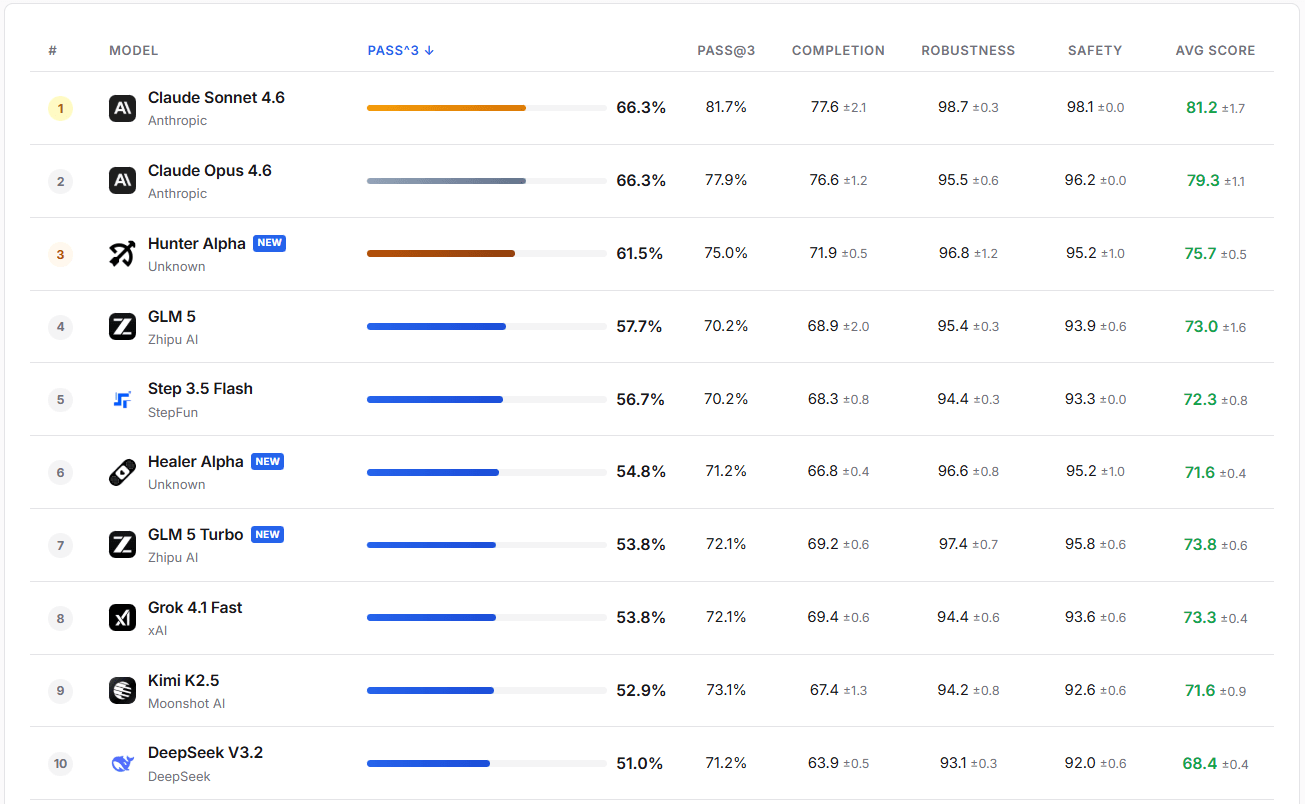

在实际评估中,GLM-5-Turbo 表现出极高的稳健性和安全性。其 PASS@3 成功率超过了 GLM-5、Step 3.5 Flash 和 Kimi K2.5。

图片来源:https://claw-eval.github.io/

增强的工具使用与外部集成

Z.ai 在训练过程中强化了 GLM-5-Turbo 的智能体 (Agentic) 能力,使其能够与外部工具无缝交互。这种以执行为导向的设计存在一定的取舍:一些用户反馈称,在角色扮演场景中,其语气相比 GLM-5 略显机械。

为了兼顾各模型的优势,Atlas Cloud 提供了统一接口,允许用户同时查询多个模型,从而进行并排比较和选择。

此外,用户可以定义自定义技能,或者允许 GLM-5-Turbo 自主发现并安装这些技能。

图片来源:Atlas Cloud

长周期自主执行

GLM-5-Turbo 针对需要定时触发或长时间运行的任务进行了优化。它能够处理具有强任务连续性的持久化、多阶段和跨时间工作流。

该模型能根据任务复杂度主动建议执行策略。在代码优化的对比测试中,GLM-5-Turbo 提出的建议在约 10% 的案例中优于竞争模型。

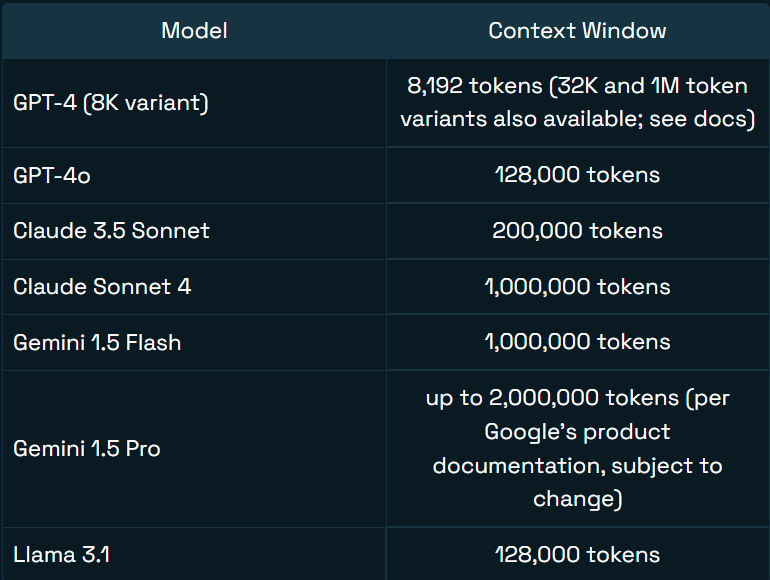

200K Token 上下文窗口

支持高达 200K token(约 13.3 万个英文单词),GLM-5-Turbo 能够在单次对话中保留并利用大量上下文信息。即使在对话的后期阶段,也能实现对早期信息的准确检索。

图片来源:Jim Allen Wallace (Redis)

应用场景

自动化复杂工作流

凭借其增强的 OpenClaw 能力,GLM-5-Turbo 可以拆解复杂的业务流程,识别底层逻辑,并自主定位或生成执行任务所需的技能。

例如,在短视频制作中,该模型可以搜索、安装并编排写作、图像生成和视频制作工具——从头到尾规划并执行整个工作流。

长文档问答与深度分析

该模型在单次对话中保持跨长文档的完整上下文,从而实现准确的多轮问答。其高 token 效率确保了在较低计算成本下实现快速响应。

在大规模代码库中,GLM-5-Turbo 可以分析架构设计,映射组件间的依赖关系,并标记低级代码更改可能引发的潜在连锁反应。

"Vibe Coding"(氛围编程)

在软件开发生命周期中,GLM-5-Turbo 更像是一位嵌入复杂工作流的全栈工程师。开发者可以概述高层逻辑,而模型则实时、增量地构建应用架构。

结合多模态技能,用户可以上传 UI 图片、屏幕录像或草图,模型可直接将其转换为功能性的前端组件。

为什么在 Atlas Cloud 上使用 GLM-5-Turbo?

作为全模态 AI 基础设施平台,Atlas Cloud 为用户提供了统一的 API 接口。连接后,用户可以轻松调用 300 多种先进的 AI 模型,涵盖文本、图像、视频生成或多模态模型。

目标受众

- 独立开发者:寻求低成本、简化的方案来调用各种 AI 模型。

- 企业:需要稳定、安全且可扩展的设施来支持核心业务。

- 开发团队:需要将多种跨模态模型高效集成到项目中。

- 工作流用户:优先考虑工具链兼容性,使用 ComfyUI 或 n8n 的用户。

产品特色

- 极大简化集成:平台提供与 OpenAI 兼容的 API,瞬间简化开发者的工作量。无需再在多个供应商密钥之间切换,也无需为各平台的维护成本而烦恼。

- 成本优势:与竞争对手相比,Atlas Cloud 的部署成本更低。Nano Banana 2 成本为 $0.056/张图片(竞争对手为 $0.07/张图片);Veo 3.1 价格为 $0.09/秒(竞争对手为 $0.1/秒)。此外,Playground 界面提供完全透明的价格,"运行"按钮直接标注了每张图片或每秒视频的扣费金额。

- 企业级稳定性与支持:Atlas Cloud 确保数据保护符合严格的隐私标准,并能够处理敏感信息。

- 即插即用:专为与 ComfyUI 和 n8n 等工具无缝协作而构建,帮助企业削减切换成本并快速上手。

同类产品比较

- Fal.ai:虽然提供了一些模型,但 Atlas Cloud 拥有更丰富的选择(300+)、更具竞争力的价格,且新注册用户可获得 $1 试用金。

- Wavespeed:定价显著更高。Atlas Cloud 提供 Wavespeed 未强调的额外企业合规支持和专家技术指导。

- Kie.ai:使用不透明的信用额度系统。Atlas Cloud 在界面上直接显示每次运行的精确成本。模型数量也多于 Kie.ai。

- Replicate:专注于模型托管。Atlas Cloud 的优势在于 API 的统一性、模型部署速度以及更具开发者友好性的支持策略。

- OpenAI 或 Google:这些供应商仅提供自家的模型。有跨模态需求的用户通常需要集成多种服务。Atlas Cloud 将专有模型和开源模型整合在同一个 API 下,降低了系统复杂性。

如何在 Atlas Cloud 上使用 GLM-5-Turbo?

方法 1:直接在平台上使用

方法 2:通过 API 集成使用

第 1 步: 获取您的 API Key。在 控制台 创建并粘贴您的 API key:

第 2 步: 查看 API 文档。检查请求参数、身份验证方法等。

第 3 步: 发起您的第一个请求(Python 示例)

以 GLM-5 为例。

plaintext1{ 2 "model": "zai-org/glm-5", 3 "messages": [ 4 { 5 "role": "user", 6 "content": "Hello" 7 } 8 ], 9 "max_tokens": 1024, 10 "temperature": 0.7, 11 "stream": false 12}

常见问题

GLM-5-Turbo 与 GLM-5 有什么区别? GLM-5-Turbo 更快且更具成本效益,token 效率显著提高——据称是 GLM-5 的三倍。它还专门针对 OpenClaw 场景进行了优化。

GLM-5-Turbo 与 MiniMax M2.7 相比如何? 两个模型都针对智能体工具使用进行了优化,并且比 GLM-5 具有更高的 token 效率。每个模型都支持约 200K token 的上下文窗口(MiniMax M2.7 支持 196,608 个 token)。我们正在准备一篇博文进行更深入的对比评估,敬请期待!

建议使用哪种 GLM 模型进行 OpenClaw 部署? 建议使用 GLM-5-Turbo,因为它专门针对 OpenClaw 场景进行了优化,并实现了媲美 Claude Opus 4.6 的数据分析性能。