到了2026年,“AI生成视频”的新鲜感已褪去,取而代之的是对极致视觉真实感的渴求。目前的主要挑战依然是“恐怖谷”效应——免费AI图生视频工具常出现的“空间融化”或光影闪烁,往往会破坏沉浸感。对于创作者而言,“逼真”不仅是一种审美,更是专业级内容的硬性指标。

“快速精选”对比表

| 工具名称 | 逼真度得分 /10 | 免费额度获取 | 核心特长 | 最佳用途 |

|---|---|---|---|---|

| Wan 2.7 | 9.8 | 每日10积分(生成1个视频) | 动态逻辑与物理模拟 | 专业B-roll素材与写实风格 |

| Runway Gen-4 Turbo | 9.5 | 注册即送125积分 | 直接操控 | 精准的创意控制 |

| Google Veo 3.1 | 9.3 | 每日创意实验室津贴 | 深度色彩与环境表现 | 电影级叙事 |

| Kling 3.0 | 9 | 注册即送66积分 | 人体结构一致性 | 时尚与人像摄影 |

| Pika Labs | 8.8 | 注册即送80积分 | 氛围真实感 | 天气与光影效果 |

| Vidu 2.0 | 8.7 | 注册即送20积分 | 3D空间深度 | 推拉镜头与镜头平移 |

| WAN 2.6 | 8.5 | 每日10积分(生成1个视频) | 细微微动作 | 自然风光与背景 |

| PixVerse | 8.4 | 每日60免费积分 | 面部映射 | 对口型照片与口型同步 |

| Hailuo 2.3 | 8.2 | 注册即送300积分(有效期3天) | 生成速度 | 社交媒体快速原型制作 |

| Van 2.6 | 8 | 每日10积分(生成1个视频) | 传承一致性 | 大批量内容制作 |

三大巨头:“制作级”领军者

免费AI图生视频工具领域已转向“动力学逻辑(Kinetic Logic)”,即AI在渲染像素之前先理解引力和光线。以下三款模型是目前公认的顶尖AI视频模型,能够输出专业级内容。

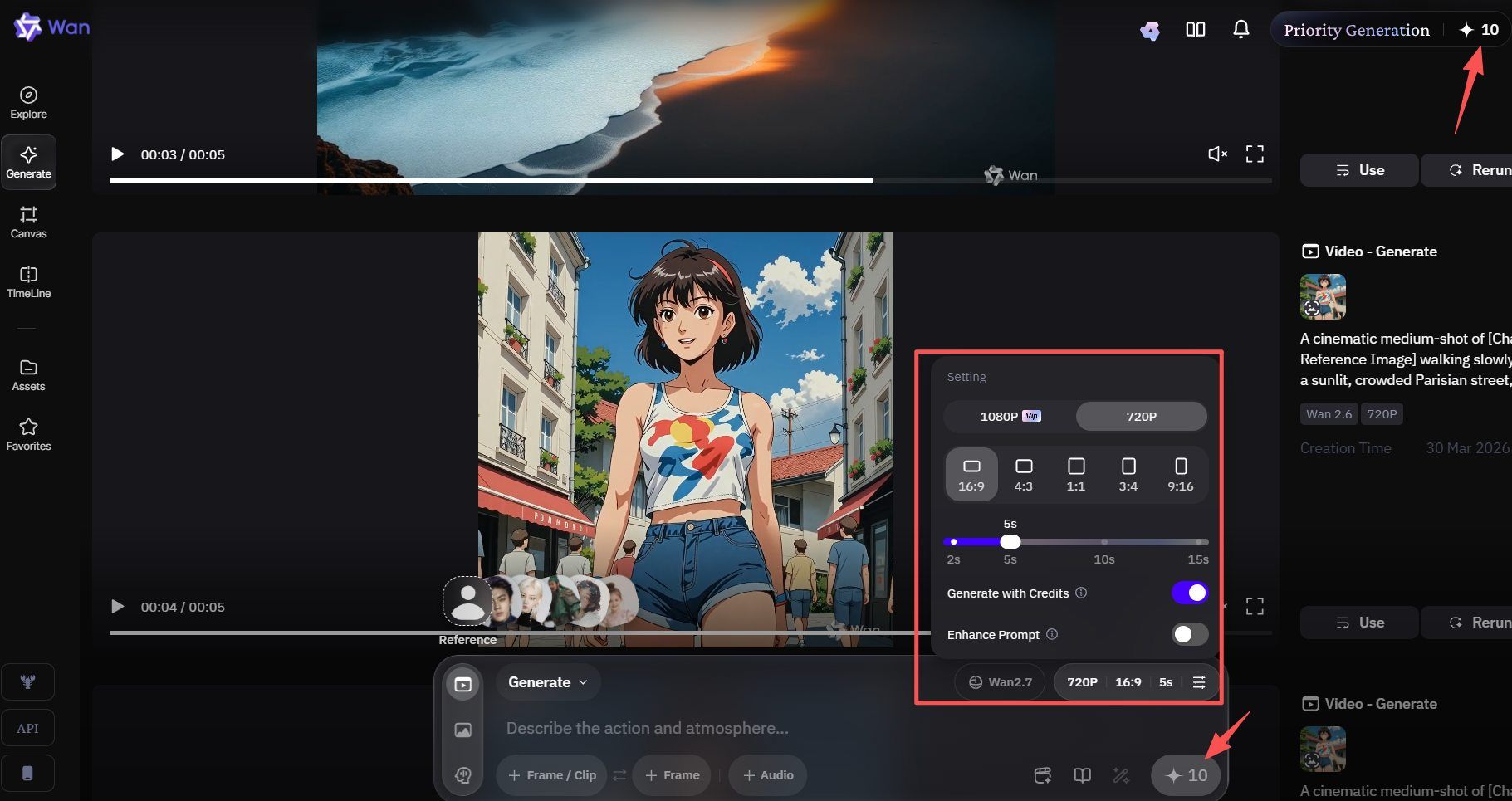

Wan 2.7 Image-to-Video (物理大师)

Wan 2.7 是目前 Qwen 系列中 2026 年最顶级的 AI 视频模型,也是当下最栩栩如生的 AI 视频工具。此版本较 Wan 2.6 进行了大幅升级,细节更锐利,动态更平滑。

为了省去去除水印的麻烦,我直接使用 Atlas Cloud 的 WAN 2.7 生成了一个 5 秒的视频,花费了 0.75 美元。

zAvoCnz1eNQ

优势:高级合成与控制

Wan 2.7 的过人之处在于它将视频创作的各个环节集于一体。它能轻松将静态照片转变为电影般的场景,生成清晰的 1080P 片段,时长从 2 秒到 15 秒不等,同时保持画面的锐度和愿景的准确性。

核心技术优势包括:

- 首尾帧控制: 创作者可以定义场景的起点和终点,确保过渡逻辑顺畅。

- 多参考支持: 该工具支持同时使用多达五个片段,有助于在每个镜头中保持角色和风格的高度一致。

- 指令式编辑: 只需输入简单的注释即可调整视频,就像拥有一个创意伙伴,而不仅仅是一个机器。

- 3x3 网格合成: 利用此特殊模式进行快速原型制作,可以并排对比测试场景的多个版本。

性能指标

Wan 2.7 在音频同步和环境物理效果方面始终优于 Jimeng 等同类模型。

| 特性 | Wan 2.7 能力 |

|---|---|

| 最高分辨率 | 1080P 高清 |

| 片段时长 | 2 至 15 秒 |

| 输入灵活性 | 真人图像与多参考图 |

| 一致性引擎 | 物理感知运动逻辑 |

无障碍访问与免费额度

对于寻求免费AI图生视频解决方案的用户,Wan 2.7 提供了一个可预测且可持续的入口。该站点采用每日签到机制,登录并点击“Check In”即可获得 10 积分。通常制作一个高端视频需消耗 10 积分,这意味着你每天都能免费制作一个专业级的视频片段。它是数字叙事者和精品营销机构在不增加额外成本的情况下,将高质量视频融入内容策略的首选。

Runway Gen-4 Turbo (精准操控利器)

当你需要快速获得令人惊艳的结果时,Runway Gen-4 Turbo 是绝佳选择。它被评为 2026 年领先的视频工具,专为追求效率的专业人士打造。你可以快速制作项目的多个版本,同时确保每个片段都保持高端、精致的质感。

QfKH9DZz64Q

优势:速度与控制并重

“Turbo”模型专为速度而生,仅需约半分钟即可将图像转化为 10 秒的视频片段。许多免费视频工具在提升速度的同时会损失质量,但它保留了标准 Gen-4 版本的高质量纹理。该模型中最有用的功能是“直接操控(Direct Manipulation)”,通过在图像上拖拽区域,可以直接指示 AI 对特定部位进行移动。这使得基础的平移、倾斜或缩放操作不再是随机的,而是变成了专业且可控的运镜效果。

性能概览

为了让你了解 Gen-4 Turbo 与其他模型的对比,我们根据 2026 年的审计结果分析了其关键性能指标:

| 指标 | Gen-4 Turbo 表现 |

|---|---|

| 生成速度 | ~30 秒(10秒片段) |

| 逼真度重点 | 高保真纹理保持 |

| 运动控制 | 高(直接操控) |

| 最佳用途 | 社交媒体广告、快速原型制作 |

无障碍访问与免费额度

Runway 为探索 2026 年最逼真的 AI 视频生成器的用户提供了便捷的入口。新账户通常会收到 125 个不可重复获得的积分,足以深入测试模型的各项功能。虽然在高峰时段其处理优先级较低,但它依然是在零成本下产出高质量 AI 视频内容的强大方式。

Google Veo 3.1 (电影级标准)

作为 Google DeepMind 生态系统中功能最强大的创意模型,Google Veo 3.1 通过优先考虑艺术质感和叙事深度,巩固了其作为顶尖 AI 视频模型的地位。不同于仅关注像素匹配的工具,Veo 3.1 是专为电影制作人打造的,能够实现高保真的“深层色彩(Deep Color)”渲染和模仿传统胶片的自然颗粒感。

Ve6PuDT3bps

氛围:环境叙事

Veo 3.1 擅长复杂的镜头移动(如宏大的电影级平移和跟拍镜头),并能保持光影和视角的一致性。许多专家称其为 2026 年自然场景表现力最强的 AI 视频工具。其定制的“物理感知”引擎是关键所在,该系统能以惊人的细节管理光线、阴影和自然运动,精准捕捉织物随风飘动或阳光照射在镜头上的质感。

此外,该工具在生成过程中内置了 48kHz 音频,你可以导出清晰且音画匹配度极高的 1080p 或 4K 视频,让高质量视频制作变得简单快捷。

性能分析:电影级 vs. 极速模式

根据 Google AI Studio 的最新基准测试,用户可以根据项目需求切换两种不同的生成模式:

| 特性 | Veo 3.1 (标准) | Veo 3.1 (极速) |

|---|---|---|

| 最高质量 | 超高保真 / 4K | 速度优化 / 1080p |

| 主要用途 | 最终电影制作 | 快速原型制作与迭代 |

| 物理准确度 | 最高(复杂模拟) | 标准(受控运动) |

| 音频质量 | 48kHz 专业级 | 标准立体声 |

免费额度:Google 创意实验室津贴

对于正在寻找免费AI图生视频入口的用户,Google 已将 Veo 3.1 集成到 Google Creative Lab 和 AI Studio 中。每个个人 Google 账户每天都会收到积分津贴。虽然具体额度会根据区域需求波动,但用户通常每天都有足够的积分生成多个“极速”模式视频或一个高端“质量”模式视频。

每天 30 积分。初始登录还可获得 100 积分的额外奖励,有效期一个月。

专业竞品(第 4-10 名)

虽然“三大巨头”在高端制作中占据主导地位,但几款专业工具通过攻克特定的视觉挑战也占据了一席之地。这些顶尖 AI 视频模型在各自的类别中往往比通用模型拥有更独特的优势。

专业 AI 视频工具的核心特性

| 排名 | 工具名称 | 核心专业方向 | 理想用例 |

|---|---|---|---|

| 4 | Kling 3.0 | 人体解剖结构 | 时尚与人像摄影 |

| 5 | Pika Labs | 氛围真实感 | 情绪化光影、雨水与雾气 |

| 6 | Hailuo 2.3 | 生成速度 | 社交媒体原型制作 |

| 7 | WAN 2.6 | 细微动作 | 背景与柔和的自然镜头 |

| 8 | PixVerse | 面部映射 | 逼真的对口型照片 |

| 9 | Vidu 2.0 | 3D空间深度 | 推拉镜头与 3D 导航 |

| 10 | Van 2.6 | 大批量高性价比 | 大批量任务的一致性质量 |

专业建议:如何压榨免费额度的逼真效果

最大化利用免费AI图生视频的工作流不仅仅需要一张好的底图,更需要理解 2026 年顶级引擎如何解读物理规律。即便是使用顶尖 AI 视频模型,产生“塑料感”和“真实感”的区别往往在于设置。

“运动滑块”的秘密

初学者常见的一个错误是拉满运动强度。在 2026 年,最逼真的 AI 视频生成器模型会使用“动态过载(Kinetic Overdrive)”,在过高数值下会导致画面扭曲。

- 甜蜜点: 将运动滑块设置为“3”或“4”可以模拟自然的人类动作和细微的环境变化。

- 原因: 较低的数值让 AI 能优先考虑“时间一致性”而非激进的像素位移,从而避免出现“融化”效应。

2026 年的高级提示词技巧

要想获得制作逼真人类的最佳 AI 称号,你必须使用专业的摄像技术术语。通过使用特定的摄影关键字,强制 AI 模拟真实的相机硬件。

| 技巧 | 建议关键词 | 结果 |

|---|---|---|

| 动态模糊 | "1/50 shutter speed blur" | 自然的运动感,且没有 AI 带来的“闪烁感”。 |

| 景深 | "f/1.8 aperture bokeh" | 将主体与背景真实地分离开来。 |

| 光影 | "Subsurface scattering" | 确保肤色呈现有机质感,而非蜡像感。 |

分辨率叠加

免费版通常为了节省计算资源以 720p 导出。要掩盖这些导出视频的“柔和度”,请使用分辨率叠加(Resolution Stacking)。通过将你的最终 AI 视频通过像 Google Creative Lab 套件中提供的二级免费放大器进行处理,你可以重构出在初始生成中丢失的皮肤毛孔和织物纹理等细节。

故障排除:为什么你的视频看起来很“假”?

即使在使用顶尖 AI 视频模型时,许多创作者仍会遇到令人头疼的“假”感——视频看起来像是一场扭曲的梦,而非真实的录像。

常见元凶:全局运动

最大的问题是“全局运动(Global Motion)”。这发生在 AI 误以为你想要整个画面移动,而不仅仅是主体。这会导致背景看起来像是在漂浮或弯曲,瞬间破坏了真实感。

修复方案:区域提示

为了让你的视频显得稳重,必须将运动隔离开来。大多数专业工作流现在都利用**区域提示(Regional Prompting)**或“运动笔刷”。

- 锁定背景: 在提示词中将背景定义为“静态”或“固定”。

- 隔离主体: 专门对主体应用运动,例如“主体行走,背景保持静态”。

- 使用首帧: 始终提供一张高质量静态图像作为基础,帮助 AI 理解固定的环境。

结论:选择你的真实之路

2026 年支撑最逼真 AI 视频模型的技术飞速发展。这些工具已经从简单的实验变为了真正的专业级资产。

在你测试这些工具时,请记住伟大的结果往往来自于反复试验。哪款生成器处理照片中的光影和运动效果最好?欢迎在评论区分享你的想法!

常见问题解答

我可以使用“免费AI图生视频”工具生成 4K 分辨率吗?

到 2026 年,4K 将成为高端视频模型的标配。然而,免费且不限量的使用权很难获得,因为运行它需要巨大的计算力。为了控制服务器负载,大多数免费计划将输出限制在 720p 或 1080p。

为什么我的 10 秒视频比短片闪烁得更严重?

闪烁(即人们所说的“时间抖动”)发生在模型未能保持对象一致性时。在较长的时间跨度内,AI 会丢失其“身份锚定”。

- 原因: AI 模型通常在 5 秒后会“忘记”初始种子图像,导致纹理和面部特征漂移。

- 解决方案: 对于较长的序列,请使用 Wan 2.7,因为其架构专为“动作连贯(Action Chaining)”设计。通过提示特定的“时间节奏”(例如:第一幕:环顾,第二幕:眨眼),你可以提供维持稳定、无闪烁 10 秒渲染所需的锚点。

如何在视频中实现逼真人类的最佳 AI 效果?

人体角色的真实感失败往往是因为“纹理爬行”。要解决这个问题,请使用 Kling 3.0 或 Van 2.7,并在提示词中加入技术术语,例如“次表面散射(subsurface scattering)”和“1/50 快门模糊”,强制 AI 模拟真实的相机硬件。