告别2026年AI视频领域那种依靠基础文本提示词的“随机猜测”方法。如果你想在不产生高昂工作室成本的情况下获得电影级的视觉效果,就需要一套稳固的策略。为了保持逼真的质感,专业创作者通常采用严格的多层工作流。

请遵循以下四个清晰步骤:

- 高分辨率起点: 从清晰的源图像开始。

- 运动控制: 手动引导摄像机的运动轨迹。

- 4K精修: 使用放大工具以实现清晰的画质。

- 音频层: 添加自定义音效作为最终润色。

这种方法消除了AI视频中常见的“怪异感”,并确保了精良的产出。这是免费获取高端质量视频的最佳途径。

向电影级写实的转变

这场“零成本”革命由新一代最先进的模型驱动。通过利用免费的专业工具和开源堆栈,创作者现在可以绕过早期AI视频中常见的“融化”外观。

| 模型 | 核心优势 | 免费层级可及性 |

| Veo | 电影级物理效果与一致的灯光 | 可通过Google Labs使用 |

| Kling | 复杂的人体动作与长时长生成 | 每日免费积分 |

| Seedance | 高速运动与节奏同步 | 丰厚的试用期 |

| Luma Dream Machine | 流畅的转场与摄像机写实度 | 每月30次免费渲染 |

精通“以图生视频”4K放大工作流

专业效果的秘诀在于混合式的以图生视频4K放大工作流。专家们不依赖原始的文生视频(往往缺乏结构完整性),而是从高分辨率的底图开始。这张图像充当了“视觉锚点”。

- 生成底图: 使用高质量图像生成器制作初始帧。

- 动画处理: 将该帧导入Veo或Luma等模型中。

- 放大: 利用Topaz或Real-ESRGAN等开源工具达到真正的4K画质。

本指南将向你展示如何在不花一分钱的情况下掌握这些工具。

第一步:高分辨率源文件的架构

在AI视频生成领域,“文生视频”通常是一场赌博。如果你想要专业的结果,必须将第一帧视为制作的北极星。

为什么“静态图像”才是王者

从静态图像到电影级AI视频的工作流提供了比直接文生视频高出约10倍的最终输出控制力。当仅使用文本提示视频模型时,AI必须同时计算角色设计、背景几何结构和运动。这通常会导致“变形”伪影。通过提供高质量的源图像,你锁定了空间数据,使AI能够将100%的计算能力集中在时间物理特性上。

提示词框架:掌握“镜头语言”

要超越业余片段,你的图像提示词必须使用摄影师的语言。不要只说“城市里的男人”,而要使用定义镜头、灯光和深度的框架。

- 镜头:35mm变形镜头,70mm IMAX,或f/1.8焦外成像。

- 灯光:黄金时刻轮廓光,体积雾,或高对比度黑色电影风格。

- 胶片质感:柯达Portra 400或颗粒感16mm胶片美学。

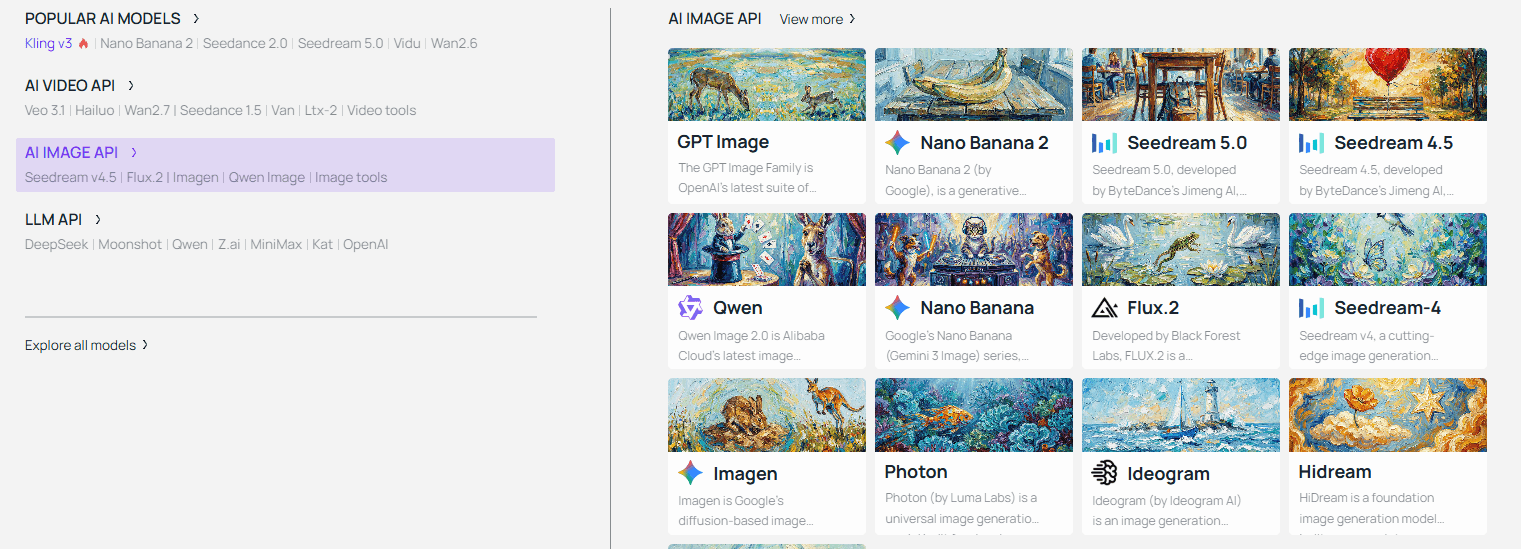

工具聚焦:基础帧生成

对于2026年最佳免费以图生视频AI入门,我建议从nano-banana-2开始。它擅长照片级的提示词遵循能力,提供一个防止早期阶段失真的“干净”底图。标准工作流是将导出的图像渲染件输入到Kling或Luma等专业的视频动画工具中。

这是我使用Atlas Cloud的nano-banana-2生成的图像,我打算用它来创作一段新黑色电影风格的视频。

第二步:导演运动(核心操作指南)

一旦你的高分辨率“英雄帧”准备就绪,下一阶段就是让它栩栩如生,同时保持电影质感。

Luma Dream Machine与Kling AI:物理特性之王

Kling AI 3.0和Luma Dream Machine 2.5在物理真实性方面处于市场领先地位。

- Kling AI: 提供66个刷新积分,使其成为高动作场景的首选。

- Luma: 提供每月30次渲染,专精于“推拉变焦”和“轨道拍摄”等以图生视频的电影级摄像机运动。

Y38guSWkZDo

我使用Kling 3.0的免费积分制作了这个5秒的视频;花费了50积分,分辨率限制在720p。

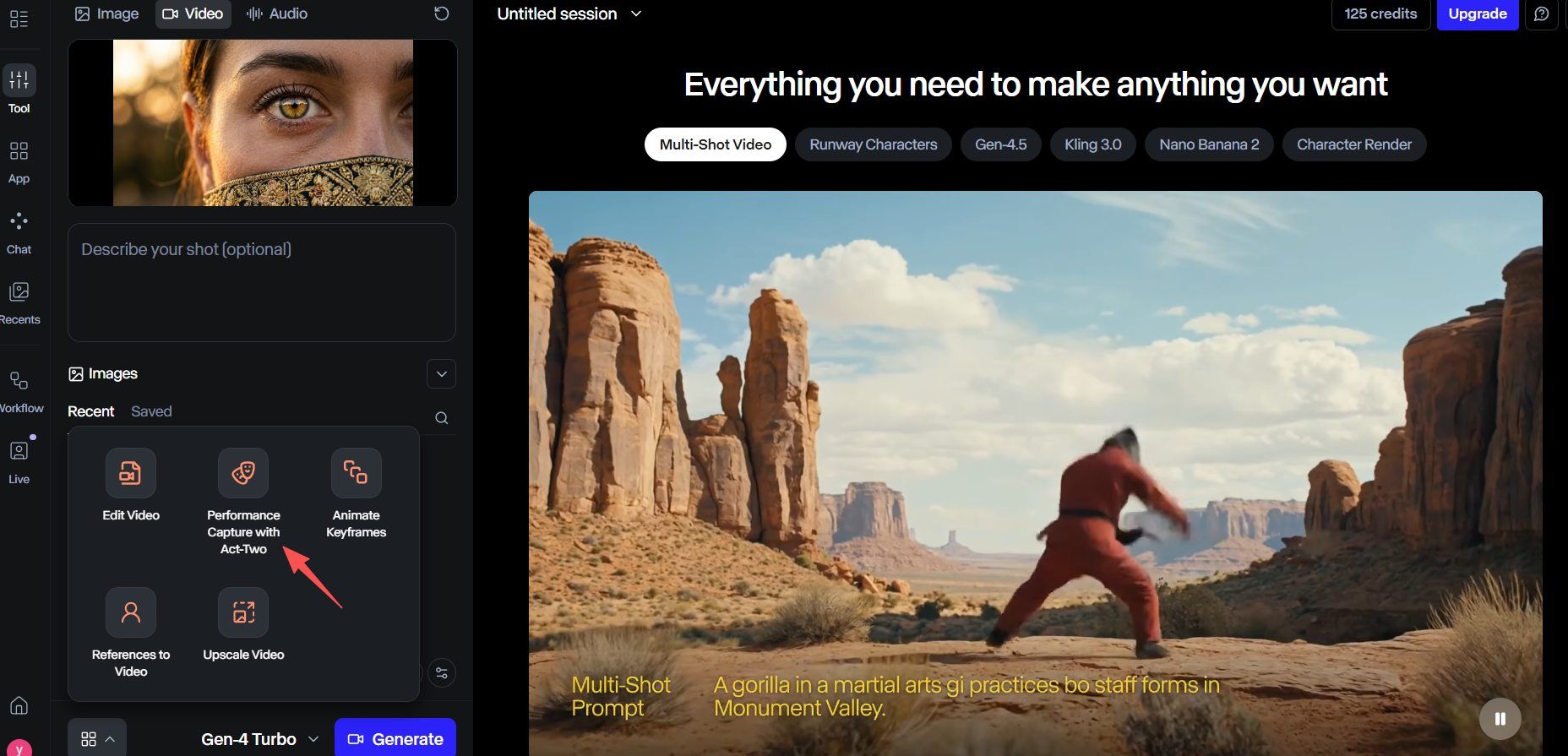

秘诀:运动笔刷

修复AI视频面部畸变最有效的方法之一是:如果面部不需要运动,就根本不要对其进行动画处理。虽然Runway Gen-2等早期模型普及了“运动笔刷”的概念,但最新的高端模型——例如Runway Gen-4 Turbo和Pika 2.5——已将其演变为区域控制(Region Control)和动画关键帧。

使用这些工具仅对特定部分进行动画处理,例如移动的头发或波浪,同时保持背景静止。这样,你的主体就能保持形态,防止在视频渲染时出现面部变形或“融化”。

注意:值得一提的是,此功能并非免费,使用它需要付费升级。

保持一致性与质量

要实现免费的高比特率4K AI视频,请遵循以下一致性核对清单:

| 制作目标 | 推荐策略 |

| 角色相似度 | 在Kling 3.0中通过上传3个参考角度使用“角色ID”。 |

| 面部修复 | 应用“柔和正面灯光”提示词,以减少阴影伪影。 |

| 流畅度 | 将运动滑块设置为3–5;更高的数值往往会导致变形。 |

| 分辨率 | 生成1080p,然后应用以图生视频4K放大工作流。 |

将你的镜头进行分组。在拍摄广角镜头之前,先完成所有的特写镜头。这能保持视觉风格的稳定。它能让你的最终剪辑看起来像一部真正的电影,而不是一堆独立的片段。

第三步:4K电影放大工作流

尽管现代AI模型具有革命性,但它们有一个隐藏的限制:计算成本。目前大多数免费的AI视频生成工具为了节省服务器资源,输出分辨率通常为720p或1080p。要实现免费的高比特率4K AI视频,你必须将制作转移到本地或专门的云放大环境中。

lfbBx9cd68o

这些是使用free.upscaler.video进行AI视频放大的结果。如果查看对比,清晰度确实有了显著提高。

关于原生输出的真相

标准的AI视频通常会有“像素爬行”现象。这是一种在帧与帧之间细节变得模糊的抖动效应。如果你直接从生成器导出4K,文件虽然很大,但画面依然柔和。你需要一个独立的4K放大步骤。这个过程会重构丢失的纹理,使画面看起来锐利。

2026年的免费放大解决方案

到2026年,你不再需要300美元的Topaz订阅费来获得专业效果。几种高性能替代方案已经实现了这一过程的民主化:

| 工具 | 最适合 | 技术优势 |

| CapCut Desktop | 快速的社交媒体4K导出 | 使用云端“图像增强”模型进行免费4K放大。 |

| free.upscaler.video | 开源、基于浏览器的处理 | 提供透明、无需注册、无水印的浏览器内处理工作流。 |

| WebGPU Upscaler | 无需安装,注重隐私 | 通过浏览器利用本地GPU算力,进行100%私密且无水印的放大。 |

| Artplayer upscaler | 浏览器内超分辨率 | 完全在本地使用WebGPU/WebGL运行;确保文件绝不离开设备。 |

帧插值:丝滑60fps的秘密

AI视频通常以24fps生成。为了获得那种超平滑的电影感,你需要帧插值。像SVP或RIFE神经网络(可在各种免费GUI封装中找到)这样的工具可以在原始帧之间插入“预测”帧。这能将卡顿的2秒片段变成平滑的高帧率视频。它修复了基础AI生成结果中常见的“stutter”(断续)问题。

第四步:声景与最终润色

电影体验的50%是视觉,50%是音频。没有空间声景,即使是最完美的以图生视频AI输出也会显得毫无生机。

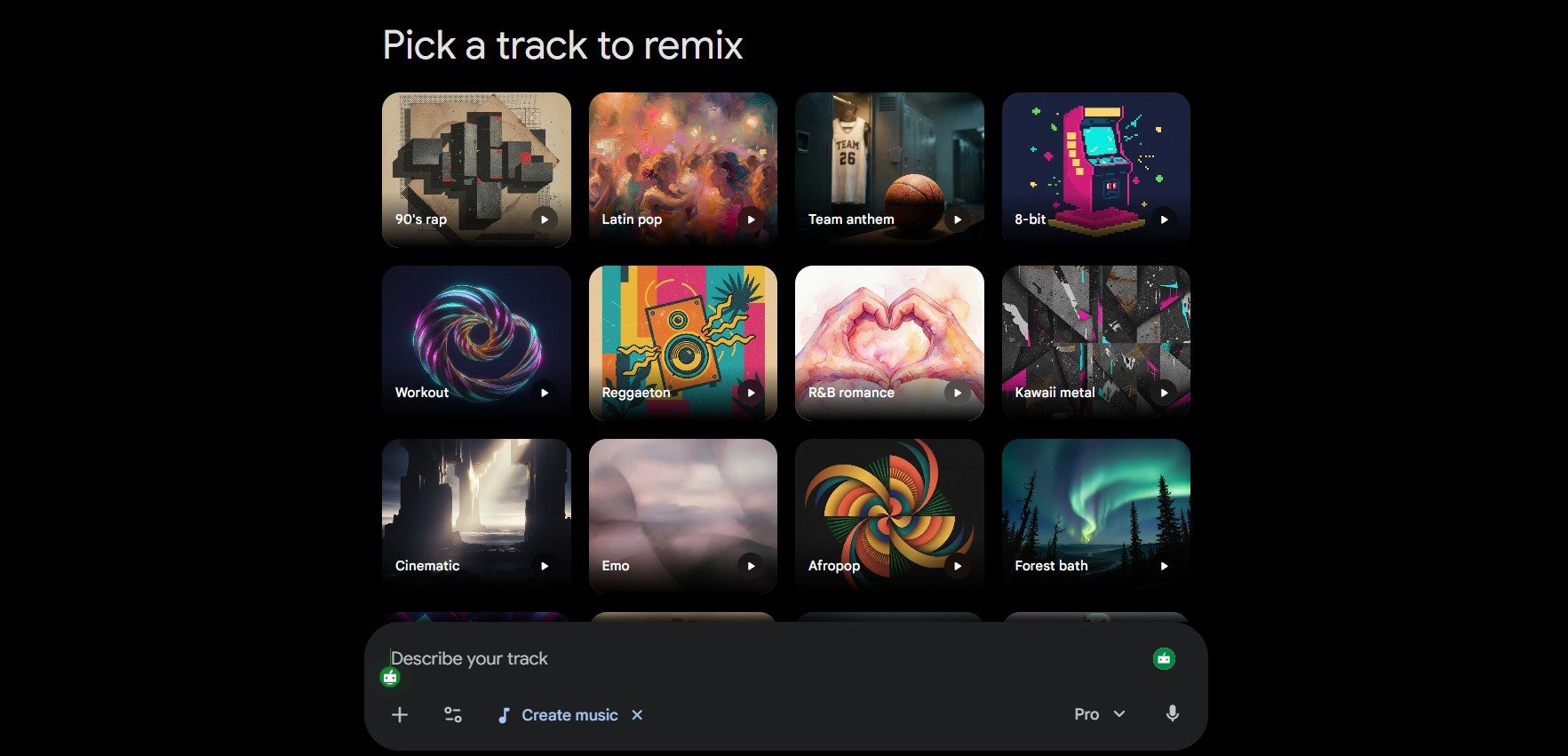

利用Lyria 3进行AI拟音与配乐

Google的Lyria 3现在是预算有限的创作者的首选。它比基础的素材音频更好,因为它提供了“图生音乐”工具。只需上传视频中的一帧。AI会读取其中的“氛围”,比如gritty科幻场景或潮湿的城市街道。然后,它会为你的项目量身打造一段30秒的曲目。

- 环境拟音: 制作独特的音效,如山谷中的风声或轻微的机械嗡嗡声。

- 节奏同步: 使用“速度匹配”(Tempo Match)设置。这能将音乐的节奏锁定在摄像机的移动上,实现更流畅的流动感。

调色:打败“AI味”

AI生成的片段往往有一种感觉太数字化的“光泽感”。你可以通过使用CapCut或免费的DaVinci Resolve轻松修复这个问题。只需添加一个专业的LUT,如“青橙色”(Teal and Orange)或“Kodak 2383”胶片风格。这有助于融合色彩。它能让素材感觉更像真实的电影,而不是计算机渲染的结果。这一步对于AI视频角色在图像间的一致性至关重要,因为它掩盖了不同生成镜头之间轻微的颜色偏移,使它们看起来像是用同一个物理相机传感器拍摄的。

专业建议: 对于开发者和机构而言,“一键式”工作流的目标是建立一条“一键”管道:输入图像路径 → 运动提示词 → API调用(Kling/Seedance) → 自动放大(4K) → 输出到本地存储。

“信任”因素:伦理AI与最佳实践

AI视频工具现已被广泛使用,使得区分真实片段和数字片段变得困难。合乎伦理地创作内容不仅仅是为了高质量。它还重点关注公开你的方法并保护在线空间的完整性。

水印与透明度

到2026年,Google等顶级公司开始使用两层保护。像Veo 3.1和Lyria 3这样的新工具现在包含了SynthID。这项技术在视频像素和声音中隐藏了一个数字标记。即使你裁剪或缩小文件,该标记依然存在。专业软件仍能识别它以证明该内容由AI生成,这有助于阻止谎言的传播。

使用权:免费 vs 专业版

如果你想从工作中获利,了解“免费”工具的规则是必须的。许多网站为你提供充足的免费试用来入门。但是,你通常需要支付订阅费才能获得完整的商业使用权。

| 工具 | 免费层级使用 | 商业使用权触发条件 | 水印状态 |

| Veo 3.1 | 个人/试用 | 仅限Pro/企业版 | 可见 + SynthID |

| Kling 3.0 | 个人使用 | 仅限付费层级 | Pro版可选 |

| Luma Dream Machine | 个人使用 | 订阅计划及以上 | 免费版可见 |

| Seedance 2.0 | 仅限测试 | 仅限Pro层级 | 强制水印 |

要为商业客户实现免费的高比特率4K AI视频,最佳做法是利用免费工具进行“概念验证”阶段,并为最终的、有授权的导出进行升级。

扩展生产:向“工作室”转型

当你从制作孤立的5秒片段转向制作完整的电影叙事时,你不可避免地会遇到“手动瓶颈”。管理数十个浏览器标签页、跟踪多个订阅配额以及为数百个镜头手动触发放大工具,是许多AI项目在后期制作阶段停滞的主要原因。

要超越基础测试,你需要从“一个一个来”的模式切换到批处理工作流。停止在Kling、Seedance或Luma的不同账号间来回跳跃。相反,顶级创作者使用单一枢纽来运行整个生产线。像Atlas Cloud这样的统一API系统在此提供了坚实的基础,它们充当了真正的基础设施,而不仅仅是另一个应用程序。

| 扩展挑战 | 传统手动工作流 | 使用Atlas Cloud扩展 |

| 模型多样性 | 切换标签页并重新上传素材。 | 通过一个API在Kling 3.0和Vidu之间切换。 |

| 成本管理 | 每个工具每月支付30美元以上(沉没成本)。 | 按秒计费;仅支付活跃GPU时间。 |

| 吞吐量 | 顺序渲染(一个接一个)。 | 并行批处理;同时生成50个以上的片段。 |

| API稳定性 | 免费层级上出现“服务繁忙”错误。 | 企业级稳定性,应对繁重的工作负载。 |

解决“大规模分辨率”问题

扩展过程中最大的障碍是4K放大。在标准消费级GPU上,手动对200个片段运行本地Real-ESRGAN脚本可能需要几天时间。

通过利用Atlas Cloud的自动化管道,“放大即服务”模式使你能够:

- 标准化质量: 在所有导出中应用固定的比特率,以保持片段的清晰和专业。

- 缩短等待时间: 使用云端的A100/H100集群,渲染速度比任何桌面设置快10倍。

- 简化授权: 在一处管理商业权利,确保每段批处理视频都已准备好合法发布。

成本对比分析:2026年行业标准

根据近期关于云算力效率的行业基准,利用专门的AI聚合器可以显著降低小型工作室的管理开销。

- 标准专业订阅(如果使用3个工具): 约90–120美元/月。

- Atlas Cloud“快速”层级: 由于“按使用付费”的架构,用户在高产量项目中通常能实现70%到90%的成本削减。

查看Atlas Cloud的按需定价:为每个Atlas Cloud API提供透明的按需定价。只为你的使用量付费。

通过消除Web UI的手动摩擦,你将工作空间从一个数字沙盒转变为一个高保真的电影工厂。

常见问题解答

为什么从静态图像开始比直接使用文生视频更好?

直接文生视频生成通常强迫AI同时计算构图、角色身份和运动,这经常导致“变形”或“融化”伪影。通过利用**以图生视频(I2V)**工作流,你提供了一个“空间锚点”。这允许模型将100%的计算能力专门用于时间物理特性——即物体的运动方式——而不是它们看起来的样子。

- 控制力: 角色相似度的一致性提高10倍。

- 质量: 防止背景偏移和几何结构扭曲。

- 效率: 减少为了“修复”角色面部而进行多次重试的需求。

我如何只用免费工具实现真正的4K分辨率?

大多数免费层级的AI模型(如Kling 3.0或Luma)将原生输出上限设为720p或1080p,以管理服务器负载。要达到4K,你必须实现一个外部放大阶段。在此,我推荐free.upscaler.video和Artplayer Upscaler。这两个工具都不需要注册,且完全免费——使用起来非常方便。

免费层级创建的内容允许商用吗?

对于专业创作者来说,明确使用权限至关重要。虽然2026年的工具功能强大,但它们的法律保护范围因层级而异。

| 模型 | 免费层级权限 | 商业使用权触发条件 | 2026年的关键约束 |

| Google Veo 3.1 | 仅限个人/试用 | Gemini Enterprise / Vertex AI | 必须包含SynthID水印;YouTube需标注“已更改内容”标签。 |

| Kling 3.0 | 非商业 | 任何付费层级(标准版、Pro版等) | 付费用户可享1080p+且无水印;免费层级限制为720p且带有徽标。 |

| Luma Dream Machine | 仅限个人 | Plus计划($30/月)及以上 | Lite/免费版即使单独购买积分也不授予商业权利。 |