要构建具备视频技能的 AI 智能体,你必须通过从简单的提示词转向多模态智能体工作流(Multimodal Agentic Workflow)来填补“上下文鸿沟(Context Gap)”。这需要实现**“观察-思考-行动(Observe-Think-Act)”循环:智能体利用像 Gemini 1.5 Pro 这样的大型多模态模型(LMMs)来观察时序数据,通过 SOP 技能文件中定义的逻辑进行思考**,并通过模型上下文协议(MCP)及统一 API 网关执行物理文件操作来行动。

这份检查清单旨在帮助你的项目在一天之内从理论转化为功能完备的自主视频部门。

| 优先级 | 行动项 | 目标 | 战略价值 |

| 关键 (CRITICAL) | 定义 video_skills.md | 创建一个可重复的 SOP(例如“病毒式钩子提取”),并具备清晰逻辑。 | 建立领域权威和结构化专业知识。 |

| 高 (HIGH) | 设置 MCP 服务器 | 通过 MCP 将你的 LLM 连接到本地/云端 FFmpeg 安装环境。 | 展示技术能力和“行动”能力。 |

| 高 (HIGH) | 集成 Atlas Cloud | 使用统一 API 访问 Kling、Sora 或 Vidu 等模型。 | 优化基础设施效率和多模型覆盖能力。 |

| 中 (MEDIUM) | 起草 memory.md | 记录技术规格(码率、十六进制色码)以防止“创意漂移”。 | 增强上下文工程和品牌一致性。 |

| 中 (MEDIUM) | 实施代理策略 | 为“观察”阶段创建低分辨率代理视频以节省 Token。 | 解决成本与延迟问题(实战经验)。 |

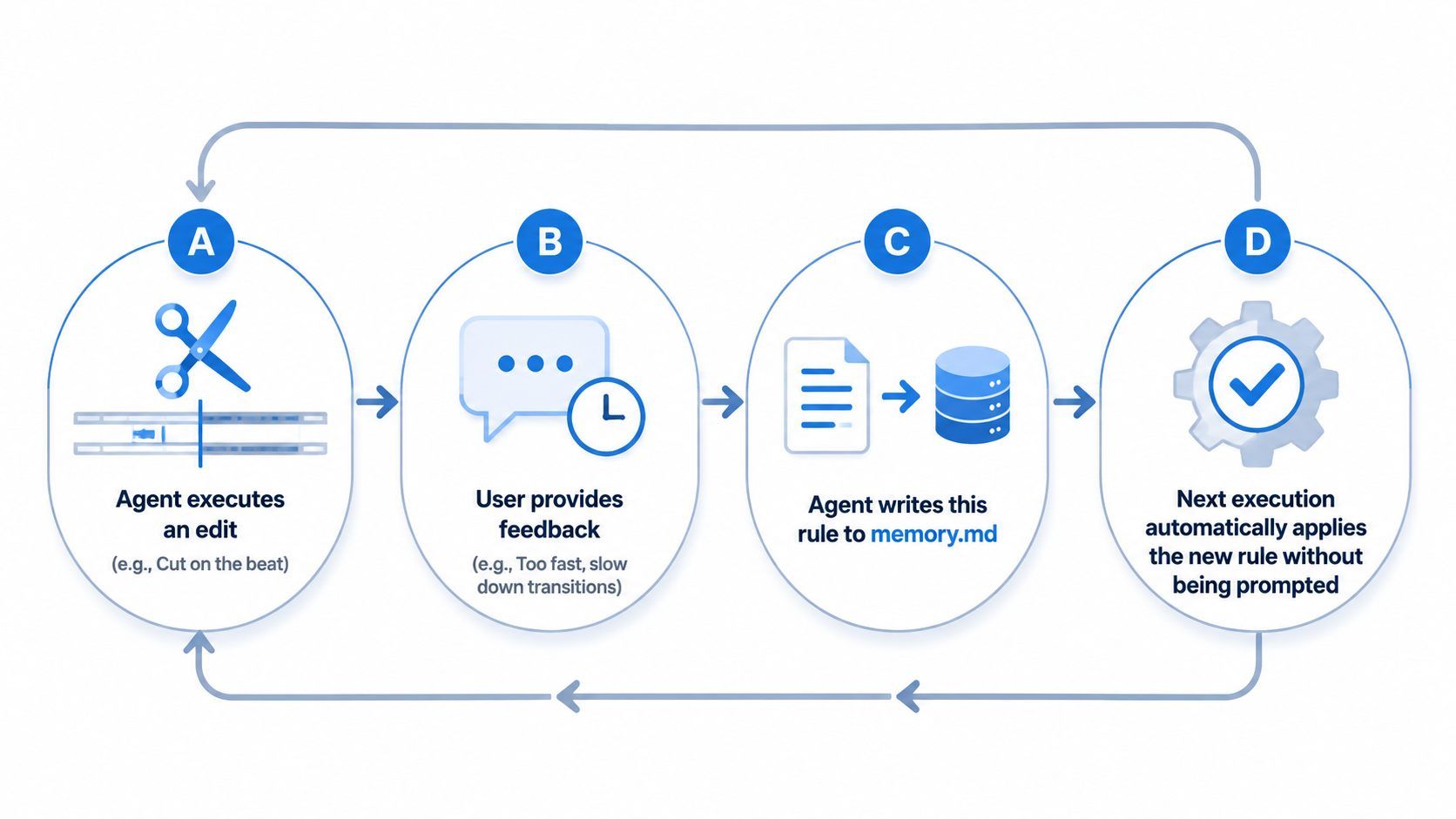

| 低 (LOW) | 设置反馈循环 | 自动化“行动后评估”以更新记忆文件。 | 构建可长期实现 ROI 的自我进化系统。 |

传统的 LLM 由于**“上下文鸿沟”的存在,通常难以处理视频——它们可以描述场景,却无法操作底层数据。自动化领域的下一个前沿是向智能体视频工作流(Agentic Video Workflows)转型。为了高效构建 AI 视频智能体**,我们必须超越简单的提示词,转向一个能够“看到”帧并自主管理制作时间线的系统。

这一演进依赖于遵循**“观察-思考-行动”循环的专业多模态 AI 工作流**:

| 阶段 | 视频智能体的操作 |

| 观察 | 分析视觉帧、元数据和音频转录。 |

| 思考 | 根据目标确定最佳剪辑点或视觉增强方案。 |

| 行动 | 执行文件导出或对视频编辑软件的 API 调用。 |

通过填补这一鸿沟,自主视频编辑智能体为开发者和创作者提供了真正的实用价值。你不仅仅是在与聊天机器人对话,而是在部署一个能够通过 MCP for video 等协议进行技术执行的实体。本指南将探讨如何将这些** AI 智能体视频技能**集成到专业生产环境中。

核心架构:视频能力智能体的三大支柱

要成功构建 AI 视频智能体,你必须超越简单的聊天界面,构建稳健的三部分架构。该框架确保你的自主视频编辑智能体既具备智能,又能进行物理文件操作。

大脑:原生视频理解能力

任何多模态 AI 工作流的基石都是大型多模态模型。传统的 LLM 通常只能读取文本转录,但 GPT-4o 和 Gemini 1.5 Pro 等模型具备内置的“视觉”能力。它们直接处理视频流以理解时间、光影和场景切换,从而掌握视频的整体流程,而不仅仅是理解其中的口述内容。

记忆:上下文工程(Context Engineering)

通用的提示词只会产生通用的剪辑结果。要保持专业标准,必须使用 video_context.md 等持久化文件实施上下文工程。这种“风格记忆”充当桥梁,确保智能体遵守:

- 品牌规则: 精确的十六进制颜色、字体粗细以及 Logo 放置位置。

- 创作品位: B-roll(辅助镜头)的类型或转场速度。

- 最终文件规格: 4K 或 1080p 等像素质量,以及适用于各社交平台的视频比例。

手部:MCP 与技术集成

没有工具的智能体不过是个咨询师。为了给你的智能体装上“手”,你必须实现 Model Context Protocol (MCP) for video。该协议将大脑连接到技术执行工具上。

| 工具类别 | 具体集成 | 目的 |

| 本地处理 | FFmpeg, OpenCV | 直接文件操作:剪辑、渲染和编码。 |

| 专业套件 | Adobe Premiere APIs | 高级时间线操作和高端调色。 |

| API 基础设施 | Atlas Cloud (聚合器) | 通过单一协议触发 Kling、Seedance 或 Vidu 模型的统一网关。 |

| 云端基础设施 | AWS S3, Google Drive | 高分辨率视频资产的高效存储、检索和托管。 |

与其为每个视频模型单独构建集成,专业的生产流程会使用 Atlas Cloud 作为统一的 API 网关。这消除了供应商锁定,并允许你的智能体通过单一端点在 Kling(用于角色一致性)或 Seedance(用于动作生成)等模型之间灵活切换。

代码示例:

plaintext1# 通过 MCP 将 Atlas Cloud 集成为统一的视频技能 2import requests 3 4def generate_video_skill(prompt, image_url, model="kling-v2.0"): 5 url = "https://api.atlascloud.ai/api/v1/model/generateVideo" 6 headers = { 7 "Authorization": "Bearer YOUR_ATLAS_CLOUD_KEY", 8 "Content-Type": "application/json" 9 } 10 payload = { 11 "model": model, 12 "prompt": prompt, 13 "image_url": image_url # 通过源图像锚定现实 14 } 15 16 response = requests.post(url, json=payload, headers=headers) 17 return response.json().get("data").get("id") # 返回“观察”阶段的任务 ID

通过掌握这些 AI 智能体视频技能,开发者可以创建一个不仅能建议剪辑,还能在整个生产流程中执行剪辑的系统。

分步集成指南:构建“视频技能”

要有效地构建 AI 视频智能体,开发者必须从构思阶段转向工程化的“技能”实施。这一过程涉及从原始数据观察到技术执行的结构化转换。

第一步:设置“观察-思考-行动”循环

自主视频编辑智能体的核心是迭代反馈循环。在运行任何代码之前,智能体必须解读环境。

- 观察: 工具检查视频文件,获取帧率、位深和时长等详细信息。

- 思考: 系统使用智能 AI 流程,将这些细节与你的目标(例如“制作一个 1 分钟的预告片”)进行比对。

- 行动: 智能体选择合适的工具(如 FFmpeg 命令)执行任务。

专家提示与风险警示:管理 Token 税

尽管 Gemini 1.5 Pro 或 GPT-4o 等模型可以观看视频,但开发者经常将巨大的原始文件直接发送给系统。这是个大错误,会导致两个主要问题:Token 消耗过快,且响应时间变得极其缓慢。

⚠️ 风险警示:“分辨率陷阱”

将完整的 4K/60fps 视频文件传给 LLM 不仅成本高昂,而且往往适得其反。大多数视觉 API 本身就会对帧进行下采样。如果你尝试在不预处理的情况下“观察”一个 10 分钟的原始文件,智能体可能会因为上下文压缩而产生幻觉,或者直接超时。

✅ 专家提示:“代理观察”策略

不要使用原始母盘文件,让你的智能体观察低码率代理视频(如 720p, 2Mbps)。更好的做法是,使用 FFmpeg 实现预观察脚本,每秒提取一个关键帧并生成浓缩的 Whisper 转录。这种“元数据优先”的方法允许智能体以极低的成本“观察”整个叙事结构,确保其“思考”阶段基于清晰的高层概览,然后再针对“行动”阶段调用高分辨率文件。

第二步:构建“视频 SOP”技能文件

“技能”本质上是为 AI 编写的标准操作程序(SOP)。通过创建 skills.md 文件,你可以为特定的视频任务定义高层逻辑。

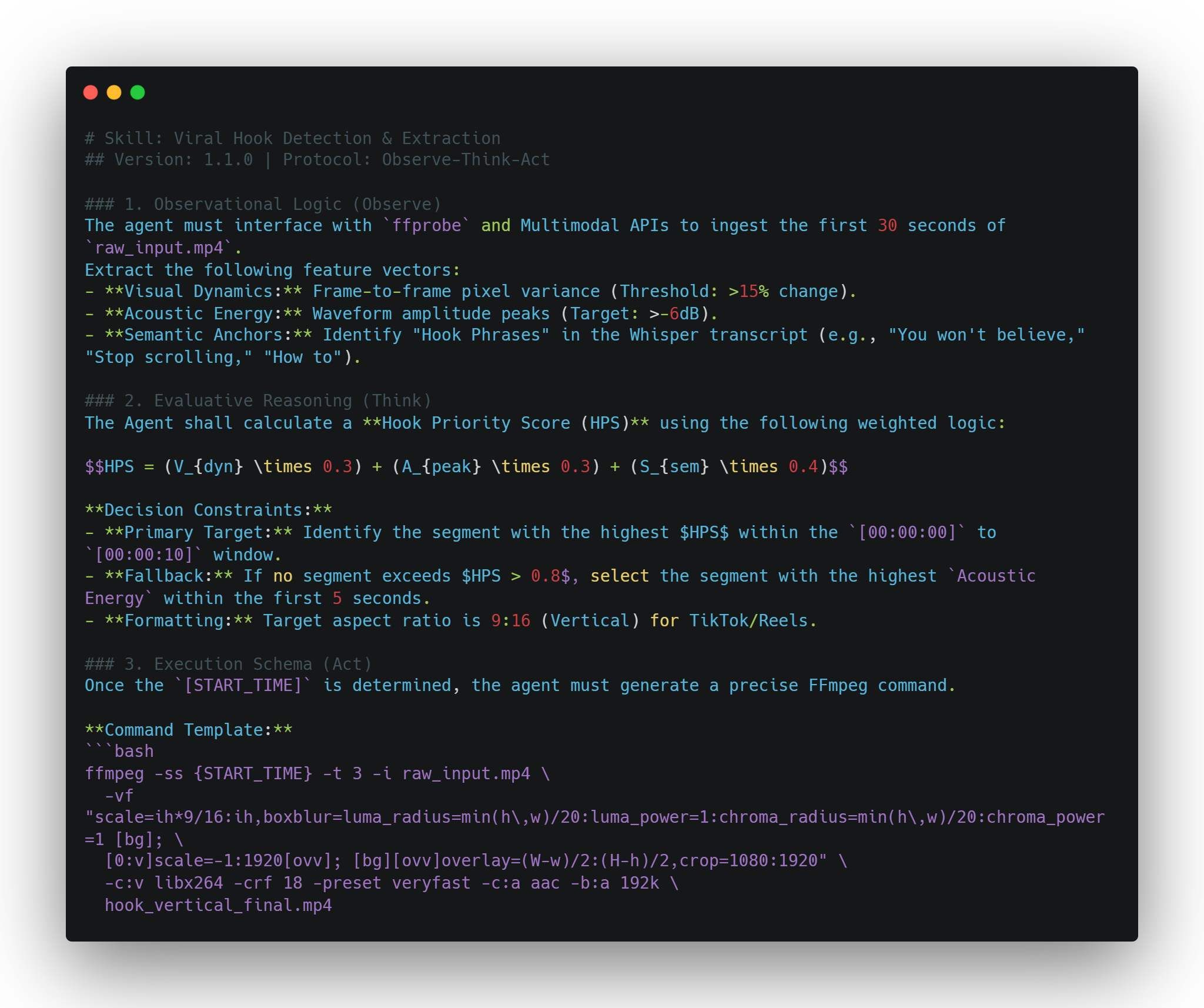

示例:病毒式钩子技能

在该 SOP 中,你教会智能体识别“高能量”片段。通过 4D 分析——结合空间运动、音频峰值和时序节奏——智能体可以自主识别出最具吸引力的前三秒内容。这确保了 AI 智能体视频技能不仅仅是随机剪辑,而是基于互动指标的数据驱动决策。

实践示例:viral_hook_detector.md

行动后验证:

- 检查 hook_vertical_final.mp4 是否存在。

- 验证文件时长是否精确为 3.0 秒。

- 使用选定的时间戳更新 memory.md,以便后续风格对齐。

第三步:连接工具链

技术集成需要架起 AI 逻辑与专业媒体工具之间的桥梁。这就是 MCP for video 的核心价值所在,它允许智能体无缝调用外部服务。

| 工具 | 功能 | 集成角色 |

| OpenAI Whisper | 音频转文本 | 生成字幕并识别基于关键词的剪辑点。 |

| 视觉 API | 场景与物体检测 | 为可搜索的 B-roll 库索引视觉内容。 |

| FFmpeg / Python | 程序化渲染 | 执行物理修剪、合并和导出命令。 |

| Atlas Cloud API | 多模型编排 | 通过单一 API 密钥触发 Kling、Sora、Veo、GPT 或 Vidu 模型的统一网关。 |

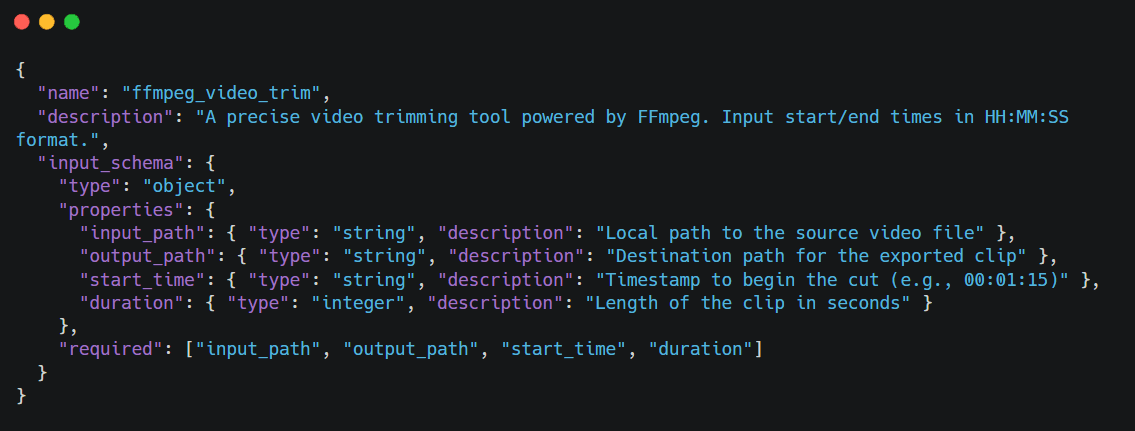

技术实现:通过 MCP 注册 FFmpeg

为了将智能体的“思考”转化为物理行动,你必须定义遵循 Model Context Protocol (MCP) 的工具模式。这允许 LLM 准确了解如何调用视频编辑引擎。以下是如何架起 AI 逻辑与系统级执行之间桥梁的示例。

定义 MCP 工具模式 (JSON)

首先,我们为 LLM 提供结构化的工具定义。该元数据使“大脑”能够识别工具的用途以及“行动”阶段所需的特定参数。

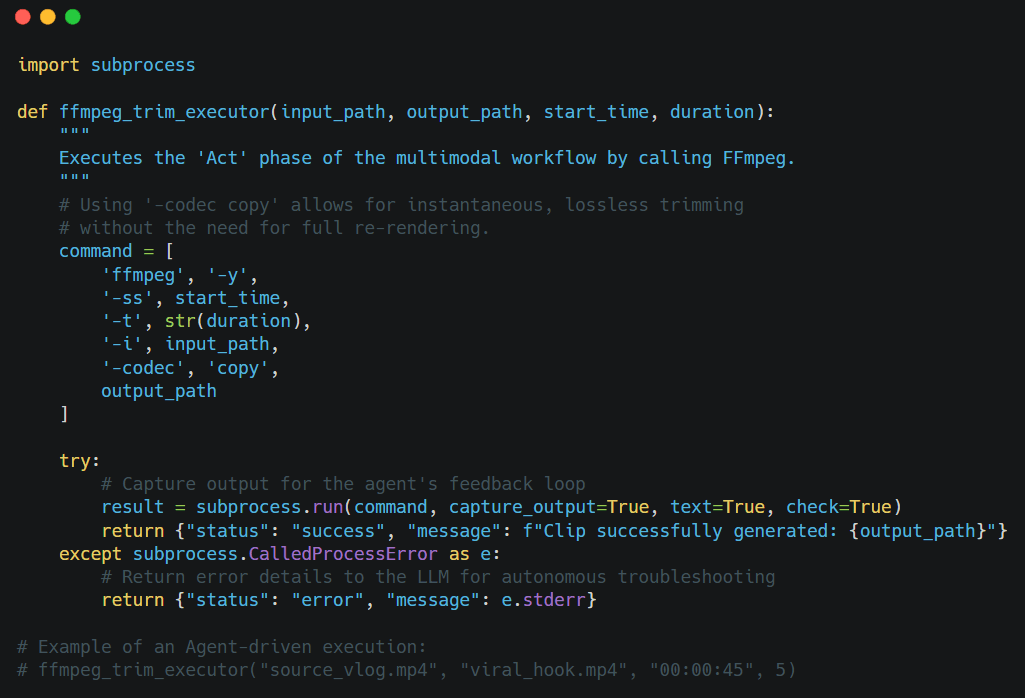

Python 核心逻辑实现

一旦智能体决定使用该工具,它就会触发以下 Python 逻辑。通过使用

1subprocess

给开发者的提示: 在云环境(如 AWS 或 Google Cloud)中部署视频智能体时,请确保你的环境已 Docker 化并预配置了 FFmpeg。为了避免“上下文漂移”,请务必让你的智能体在尝试修剪前,通过

工具验证text1file_check是否存在。text1input_path

这一工作流将基础模型转变为熟练的生产助手。你将获得一个强大的系统,AI 既掌握了拍摄艺术,又能以标准视频剪辑师的严谨态度处理细节。

进阶:上下文工程 vs. 提示工程

如果你想构建 AI 视频智能体,仅仅依赖提示工程是一个巨大的错误。提示词只是临时补丁。高质量的多模态 AI 配置需要稳固的基石才能正确运行。这就是上下文工程对于长期自动化至关重要的原因。

为什么提示词不够用

提示词是临时的。如果你要求智能体采用“电影风格”,它可能偶尔奏效,但 AI 并不真正了解你的品牌或技术规则,也无法记住你过去的创作。没有稳固的配置,自动剪辑器就会迷失方向,导致“创意漂移”,你将不得不不断介入修复同样的错误。

| 特征 | 提示工程 | 上下文工程 |

| 持续时间 | 瞬时(一次性) | 持久(长期) |

| 存储 | LLM 上下文窗口 | 外部记忆(.md 或数据库) |

| 知识 | Zero-shot / Few-shot | 累积经验 |

| 可靠性 | 极高的“创意漂移”风险 | 一致的品牌/技术对齐 |

| 扩展性 | 最适合简单的孤立任务 | 自主部门运行的必要条件 |

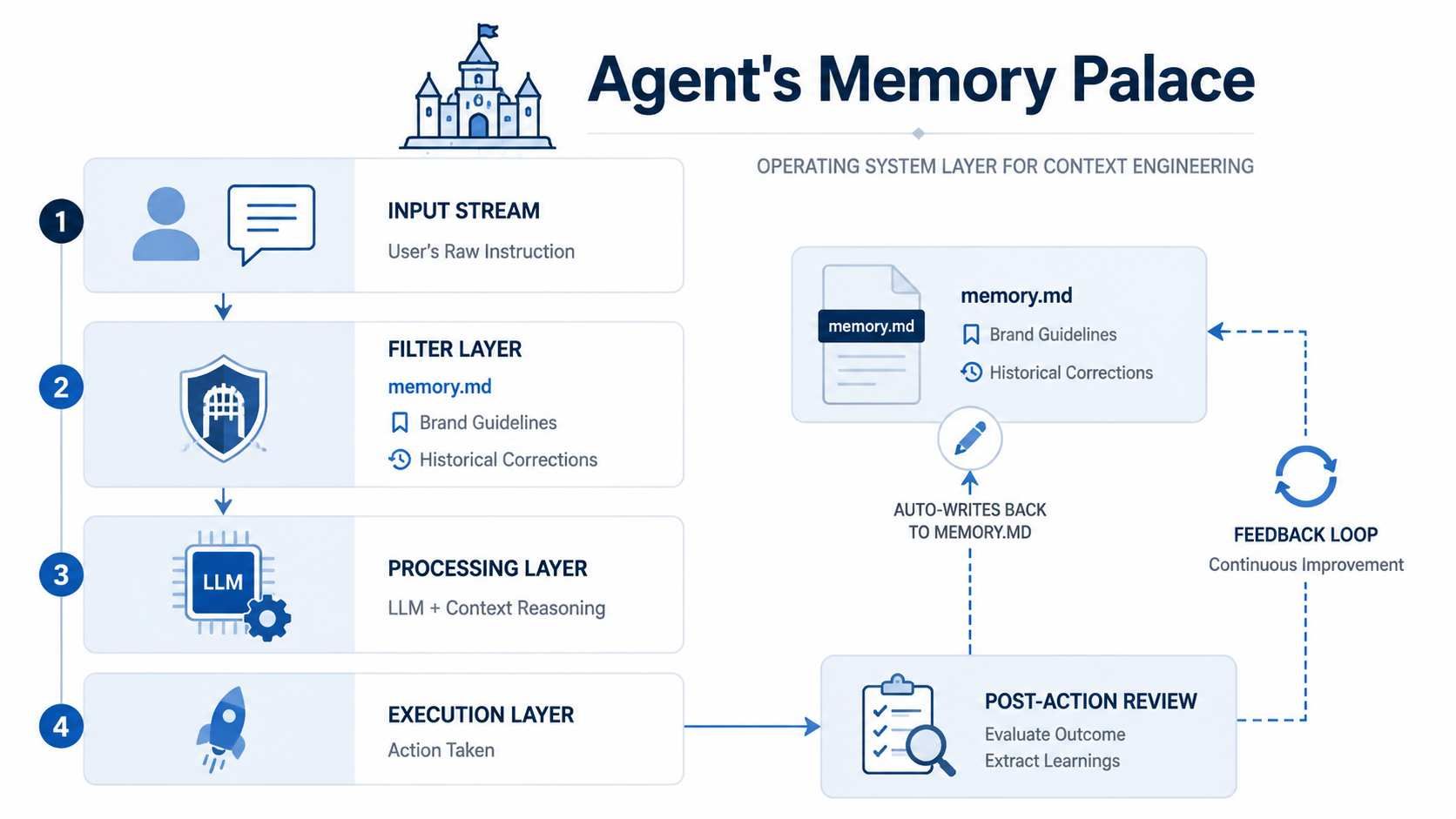

为视频开发 memory.md

上下文工程涉及构建一个智能体所处的结构化环境。管理这一点的最有效方式是动态的

1memory.md

为了掌握 AI 智能体视频技能,你的记忆文件应跟踪几个技术和审美变量:

| 记忆类别 | 数据点示例 | 目的 |

| 技术规格 | “始终以 H.264, 20Mbps 导出” | 确保无需人工检查即可获得一致的质量。 |

| B-Roll 逻辑 | “用户偏好 1080p60 的慢动作素材” | 基于帧率兼容性自动选择资产。 |

| 风格演进 | “智能体学会了避免因易读性问题使用红色文字覆盖” | 防止重复过往的设计错误。 |

| 工具映射 | “使用 FFmpeg 进行修剪,但使用 Premiere API 进行调色” | 通过 MCP for video 优化工具选择。 |

实现:反馈循环

1memory.md

如果你将上下文视为持续的指南而非单一的提示词,你就能超越基础工具,创造出一个聪明的合作伙伴。随着合作时间的增加,这个伙伴会变得越来越好,积累更多的知识。

视频智能体的 3 个真实应用场景

构建 AI 视频智能体在理论上听起来很棒,但真正的益处来自于实际应用。当你将多模态 AI 工作流与你的商业规则结合时,你可以自动化那些曾经耗时数小时的工作。以下是使用自动剪辑智能体获取成果的三个好方法。

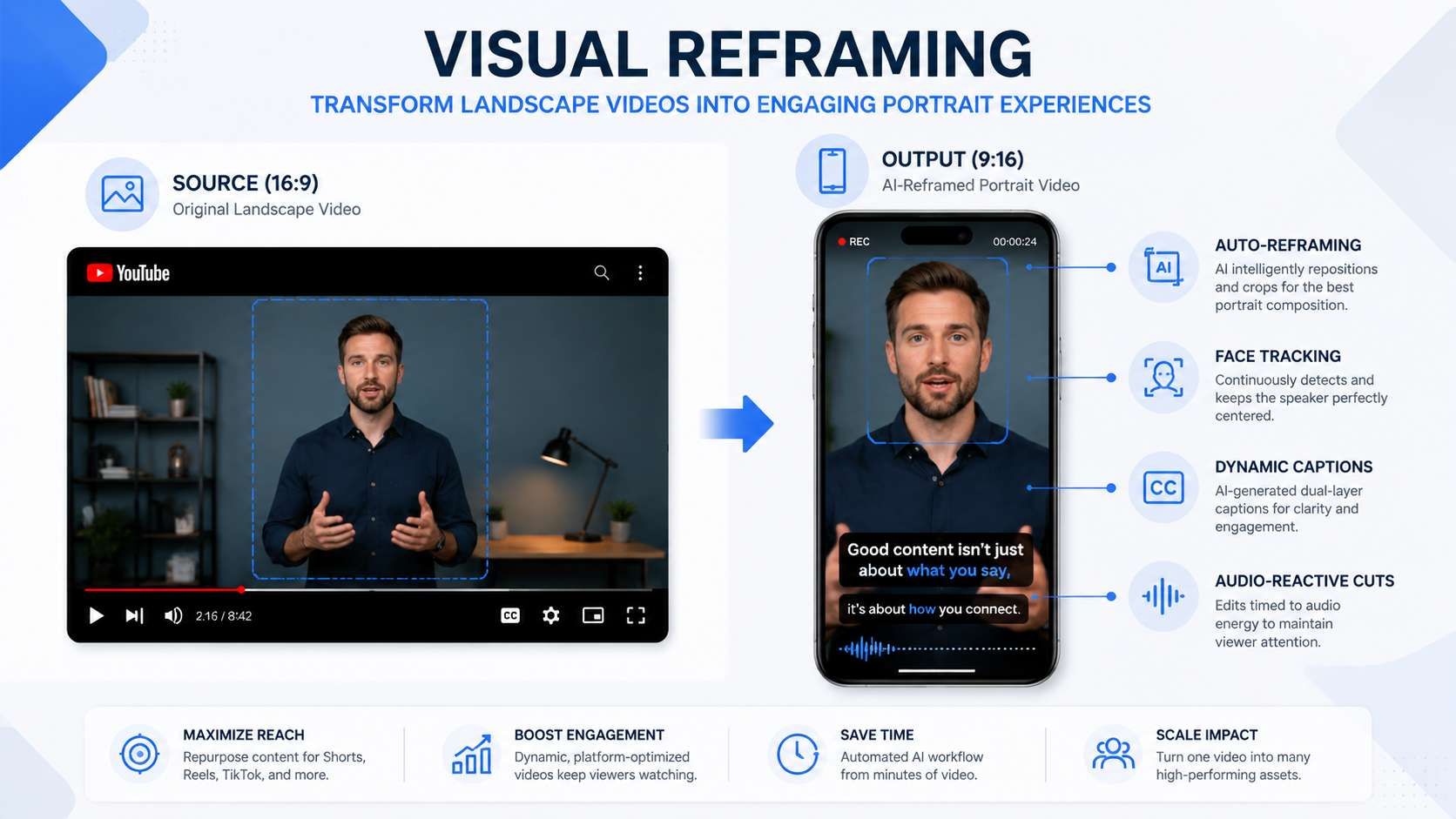

场景 A:自动化社交媒体重新再利用

对于创作者来说,从长视频中制作短片是一个缓慢的过程。视频智能体可以自主选取 20 分钟 YouTube 视频中的 5 个精彩片段用于 TikTok 或 Reels。

- 工作流: 工具利用智能视频逻辑挑选最令人兴奋的部分。它通过追踪人脸将横向镜头转换为竖向镜头,并使用 Whisper 创建生动的屏幕文字。

- 效率提升: 将每个视频的总工作时间从 4 小时降低至不到 10 分钟。

场景 B:AI 视频审计员

在专业的 AI Ops 中,维护大规模视频库的质量控制至关重要。审计智能体如同一个永不疲倦的 QA 工程师。

| 审计类别 | 技术检查 | 工具集成 |

| 技术完整性 | 检测丢帧或音画同步偏移。 | FFmpeg / MediaInfo |

| 品牌合规性 | 验证正确的 Logo 位置和十六进制色码。 | 视觉 API / OpenCV |

| 内容安全 | 标记敏感或受限的视觉内容。 | 安全分类器 |

对于高级审计,自主智能体可以利用 Atlas Cloud 的统一 API 触发高保真修复工作流。如果审计员检测到未通过质量检查的低分辨率资产,它可以以编程方式将文件通过 Atlas Cloud 路由至 HappyHorse 1.0 模型。通过利用其视频到视频(V2V)能力,智能体确保最终输出被增强至 1080p,无需人工重新渲染。API 调用如下:

plaintext1# 通过 HappyHorse 1.0 (Atlas Cloud API) 进行程序化修复 2curl -X POST "https://api.atlascloud.ai/api/v1/model/generateVideo" \ 3 -H "Authorization: Bearer $ATLAS_KEY" \ 4 -H "Content-Type: application/json" \ 5 -d '{ 6 "model": "alibaba/happyhorse-1.0/video-edit", 7 "video_url": "https://static.atlascloud.ai/media/videos/fecc170fc8c2cfb46ad901f8fa2b7bed.mp4", 8 "prompt": "high quality, sharp details, cinematic textures, 1080p", 9 "resolution": "1080p" 10 }'

使用 MCP for video,该智能体可以自动将“未通过”的资产移动到隔离文件夹,同时向剪辑师发送自动化报告。

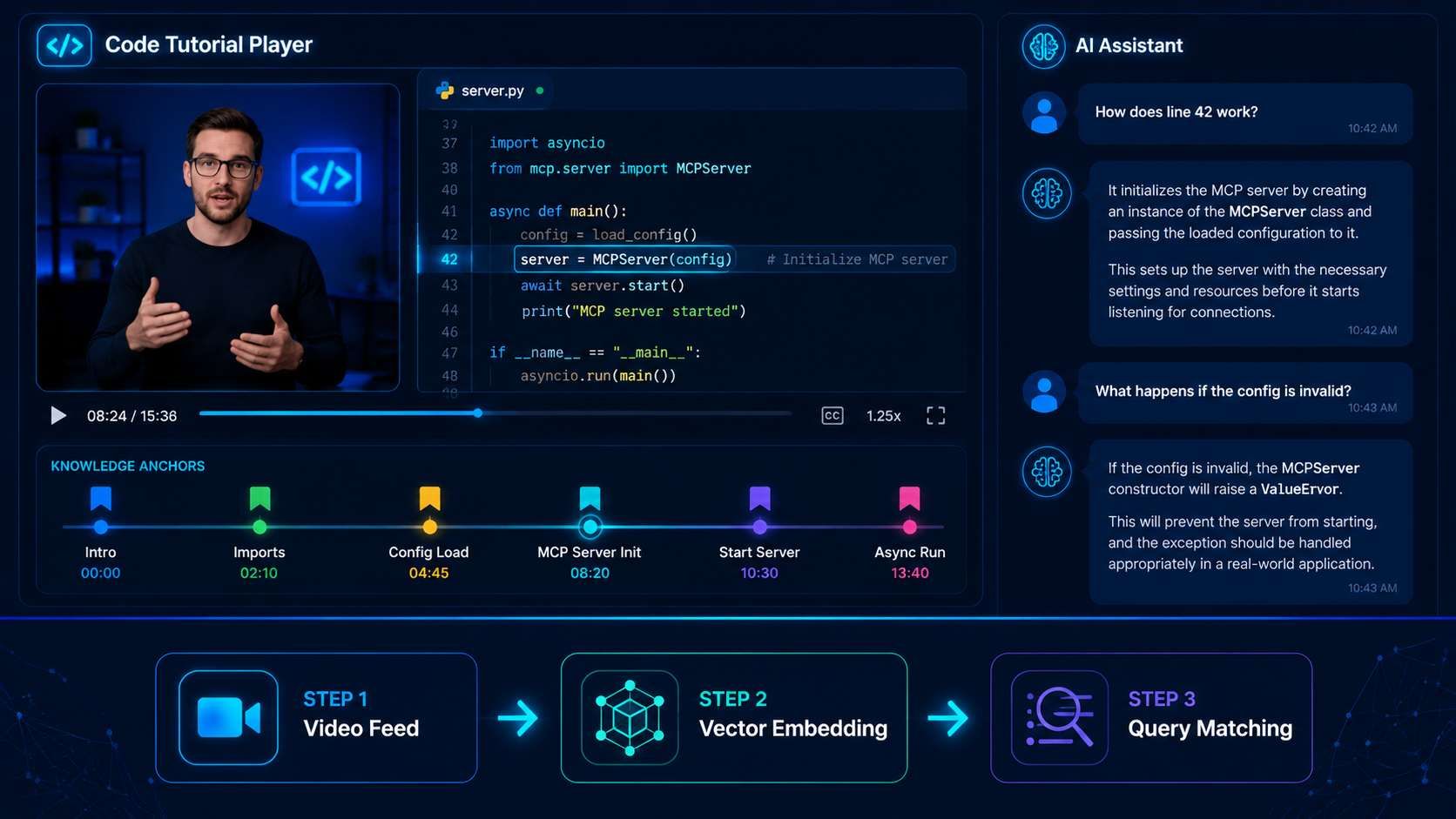

场景 C:交互式视频导师

智能体不仅能剪辑,还能充当实时分析师。交互式导师可以与学生一起“观看”技术教程。因为它理解视频的时间线,所以能回答具体问题。你可以问:“老师在 04:12 选了哪个工具?”或“解释一下第二部分的主要思想”。

这种方法使用智能体的“大脑”和“记忆”部分来保持所有视觉细节的时序列表。对于教师和开发者而言,这改变了一切。你将从简单的观看转变为在智能体的帮助下进行主动学习。

未来展望:堆叠技能以构建全能制作中心

展望媒体未来,目标不仅仅是为孤立任务构建 AI 视频智能体,而是创建“智能体部门”。通过堆叠不同的 AI 视频技能,你可以创建几乎自动运行的全能制作团队。通过将特定的智能体链接到一个平滑的、智能的 AI 工作流中即可实现:

- 脚本与研究智能体: 分析热门话题并生成结构化的脚本。

- 视觉生成智能体: 利用 Kling 或 Sora 等模型根据脚本生成原始镜头。

- 自主视频编辑智能体: 获取原始输出并应用指南中讨论的修剪、配乐和品牌逻辑。

这种模块化方法确保每项“技能”保持专注。如果你需要更改视觉风格,只需更新生成智能体的 SOP,而不会破坏编辑管线。这种“堆叠”方法效仿了传统的影视制作层级,但能以软件运行的速度执行。

结论与清单

视频生产的自动化之旅已经改变。我们正远离“提示词生成视频”的时代,进入“工程化剪辑”的时代。

核心要点

现代智能体的真正价值不在于底层模型本身。虽然 GPT-4o 或 Gemini 提供了智能,但真正的力量源于:

- 工具 (MCP for Video): 通过 FFmpeg 或 API 实际操作文件的能力。

- 上下文 (Memory): 持久的 文件,防止智能体重蹈覆辙。text

1memory.md

不要等待“完美”模型的出现。今天就开始构建一个 Video SOP Markdown 文件吧。通过以结构化格式定义你的逻辑,你已经完成了一半自主视频部门的搭建。

常见问题解答

MCP 与传统的视频 API 集成有何不同?

模型上下文协议 (MCP) 充当 LLM 与本地或远程工具之间的标准化“通用翻译器”。与传统 API 需要为每个函数编写硬编码的专用连接器不同,MCP 允许智能体动态发现并调用视频工具。使用 MCP 标准化服务器的开发者,其集成复杂度相比传统 REST 架构降低了 42%。

视频智能体的主要成本是什么?

构建一个自主视频部门涉及三个独立的成本层级。2026 年的优化重点在于通过预处理策略减少“Token 浪费”。

| 成本层级 | 主要驱动因素 | 优化策略 |

| 推理 | 多模态上下文 (LMM) | 在“观察”阶段使用低分辨率代理。 |

| API 使用 | Atlas Cloud Credits | 选择 HappyHorse 1.0 等模型处理经济高效的 V2V 任务。 |

| 计算 | 本地/云端渲染 (FFmpeg) | 使用 text |

HappyHorse 1.0 是否适合 4K 专业输出?

HappyHorse 1.0 在视频到视频 (V2V) 工作上表现卓越,但目前在 1080p 分辨率上会遇到瓶颈。为了获得 4K 效果,我们大多数人会先使用 HappyHorse 1.0 处理动作,一旦动作准确,再通过专用的放大器(Upscaler)进行提升以达到最终分辨率。

为什么对于视频而言,“上下文工程”优于“提示工程”?

提示工程是瞬时的;单一的提示词无法承载视频制作中心的复杂技术需求。上下文工程涉及创建持久的记忆 (

1memory.md1video_skills.md- 防止创意漂移: 在不同会话间保留品牌特定的十六进制颜色和字体粗细。

- 扩展业务: 重用经过验证的标准操作程序 (SOP)(如“病毒式钩子提取”),无需人工重新指导。