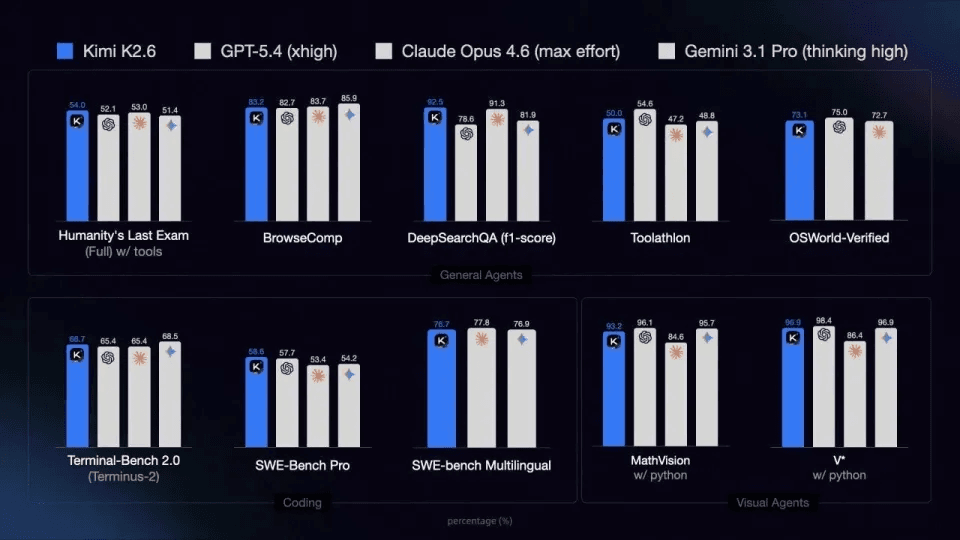

أطلقت Kimi للتو K2.6 — وهي نسخة مفتوحة المصدر على HuggingFace، تمت مقارنتها بـ GPT-5.4 و Claude Opus 4.6 و Gemini 3.1 Pro. تتفوق K2.6 على النماذج الثلاثة في اختبارات Humanity's Last Exam، و DeepSearchQA، و SWE-Bench Pro، مع تحسن في قدرات البرمجة بنسبة تقارب 20% مقارنة بإصدار K2.5، وانخفاض في متوسط خطوات المهام بنسبة 35%، وتسعير يبلغ 1/8 سعر Claude Opus 4.6 لأعباء عمل الوكلاء (Agent workloads).

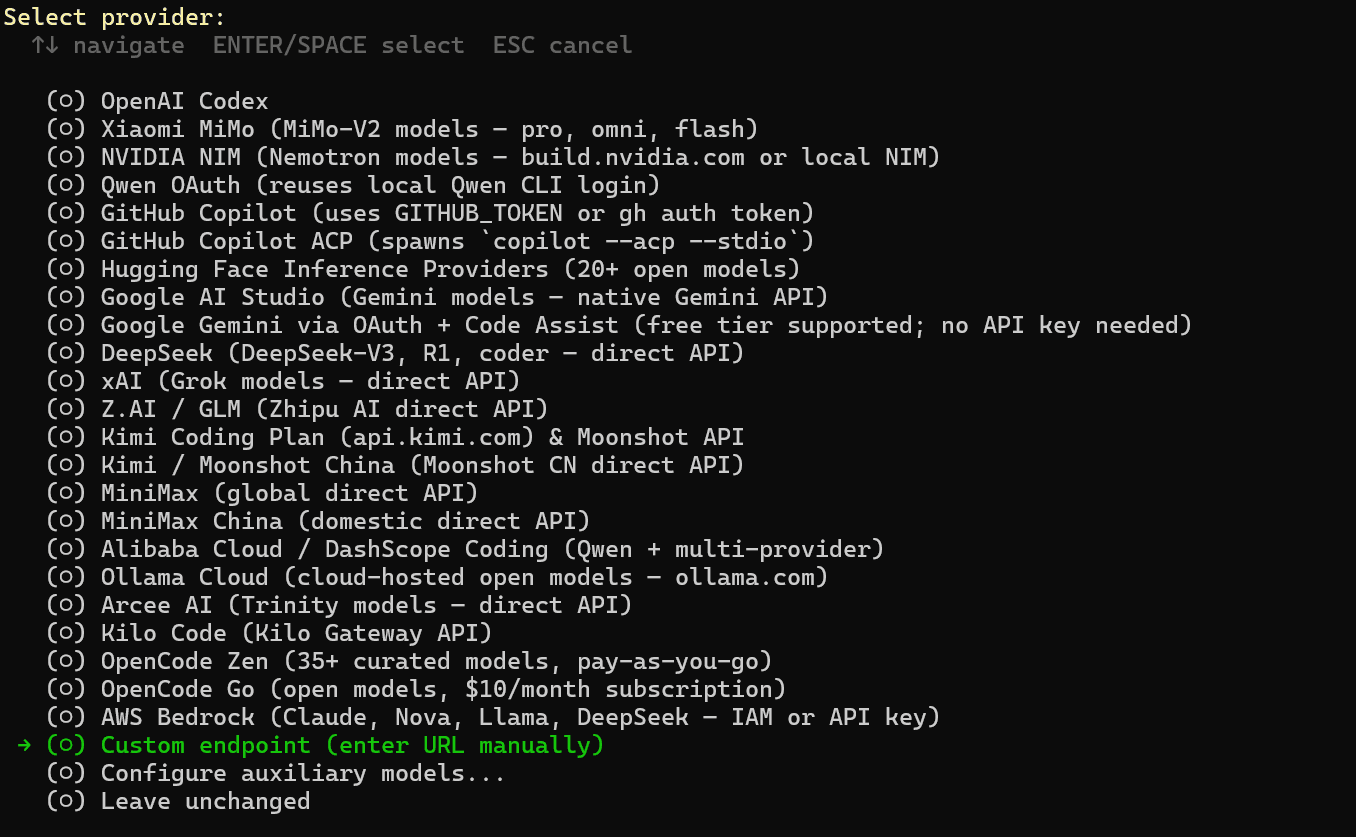

إذا كنت تدير وكلاء ذكاء اصطناعي (AI Agents) وترغب في دمج K2.6 في سلسلة أدواتك الحالية، فإن هذا الدليل يغطي أربعة إطارات عمل رئيسية — Claude Code و OpenCode و OpenClaw و Hermes Agent — مع نقطة نهاية (API endpoint) موحدة عبر atlascloud.ai. يستعرض النصف الثاني من المقال الأداء الفعلي لنموذج K2.6 أثناء التشغيل.

مرجع سريع

| الأداة | موقع الإعدادات | تبديل النموذج | ملاحظة هامة |

| Claude Code | متغيرات البيئة ANTHROPIC_* | تغيير المتغير أو استخدام /model | لا يوجد |

| OpenCode | ~/.config/opencode/config.json | تعديل حقل model | يجب استخدام @ai-sdk/openai-compatible |

| OpenClaw | ~/.openclaw/openclaw.json | تعديل حقل primary | يجب تشغيل البوابة (gateway) أولاً |

| Hermes Agent | إعدادات hermes التفاعلية | إعادة تشغيل الإعدادات | يجب أن يكون تنسيق معرف النموذج دقيقاً |

تم تنفيذ جميع الدروس التعليمية في هذا المقال على نظام Windows باستخدام WSL2.

الجزء الأول — الإعداد

-

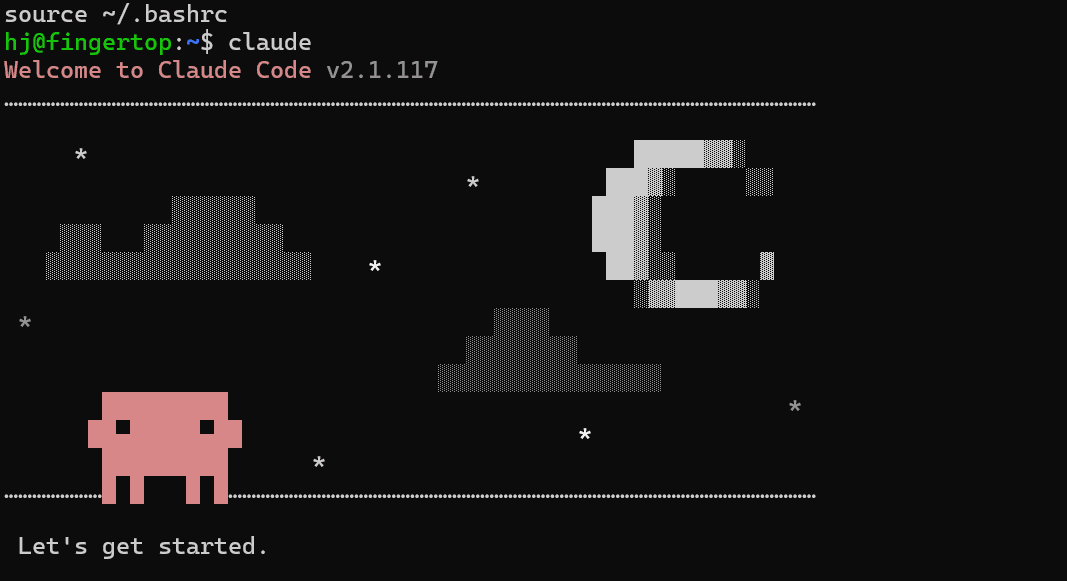

Claude Code (الأسهل)

الوثائق الرسمية لتنزيل Claude Code: https://github.com/anthropics/claude-code

يدعم Claude Code تنسيق Anthropic أصلياً. قم بضبط متغيرات البيئة الثلاثة التالية وانتهى الأمر:

plaintext1# أضفها إلى ~/.bashrc أو ~/.zshrc 2export ANTHROPIC_BASE_URL="https://api.atlascloud.ai" 3export ANTHROPIC_AUTH_TOKEN="apikey-xxx" 4export ANTHROPIC_MODEL="moonshot/kimi-k2.6" 5export ANTHROPIC_SMALL_FAST_MODEL="moonshot/kimi-k2.6"

بعد تنفيذ

1source ~/.bashrc1/model2. OpenCode (ملف الإعدادات)

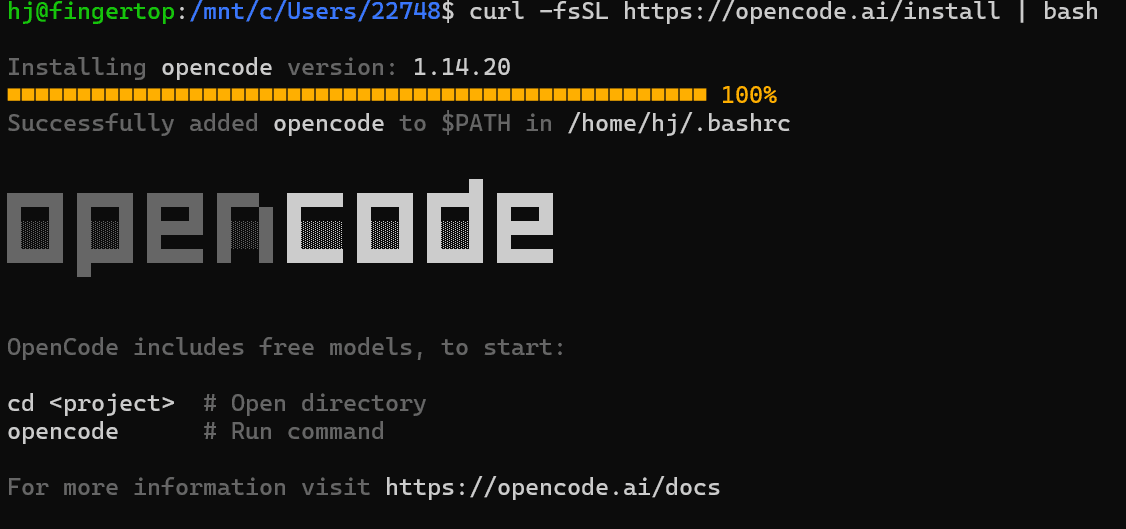

الوثائق الرسمية لتنزيل OpenCode: https://github.com/anomalyco/opencode

يحتوي OpenCode على مزود

1openai1openai/1@ai-sdk/openai-compatible1~/.config/opencode/config.jsonjson

plaintext1{ 2 "$schema": "https://opencode.ai/config.json", 3 "provider": { 4 "atlascloud": { 5 "npm": "@ai-sdk/openai-compatible", 6 "name": "AtlasCloud", 7 "options": { 8 "baseURL": "https://api.atlascloud.ai/v1", 9 "apiKey": "apikey-xxx" 10 }, 11 "models": { 12 "moonshot/kimi-k2.6": { "name": "Kimi K2.6" } 13 } 14 } 15 }, 16 "model": "atlascloud/moonshot/kimi-k2.6" 17}

يتبع حقل

1model1providerName/modelKey

3. OpenClaw (ملف الإعدادات + نافذتي أوامر)

يعمل OpenClaw كعمليتين منفصلتين: بوابة (gateway) وواجهة مستخدم نصية (TUI). يجب تشغيل كلتيهما قبل البدء.

1~/.openclaw/openclaw.jsonjson

plaintext1{ 2 "agents": { 3 "defaults": { 4 "model": { 5 "primary": "custom-api-atlascloud-ai/moonshot/kimi-k2.6" 6 } 7 } 8 }, 9 "models": { 10 "providers": { 11 "custom-api-atlascloud-ai": { 12 "baseUrl": "https://api.atlascloud.ai/v1", 13 "api": "openai-completions", 14 "apiKey": "apikey-xxx", 15 "models": [ 16 { 17 "id": "moonshot/kimi-k2.6", 18 "name": "Kimi K2.6", 19 "api": "openai-completions" 20 } 21 ] 22 } 23 } 24 } 25}

ترتيب التشغيل:

bash

plaintext1# النافذة 1 2openclaw gateway 3 4# النافذة 2 5openclaw tui

لإعادة الإعداد بشكل تفاعلي:

1openclaw configureلتبديل النماذج، قم بتعديل حقل

1primary4. Hermes Agent (الإعداد التفاعلي)

يستخدم Hermes معالج إعداد بدلاً من ملف الإعدادات:

bash

plaintext1hermes setup

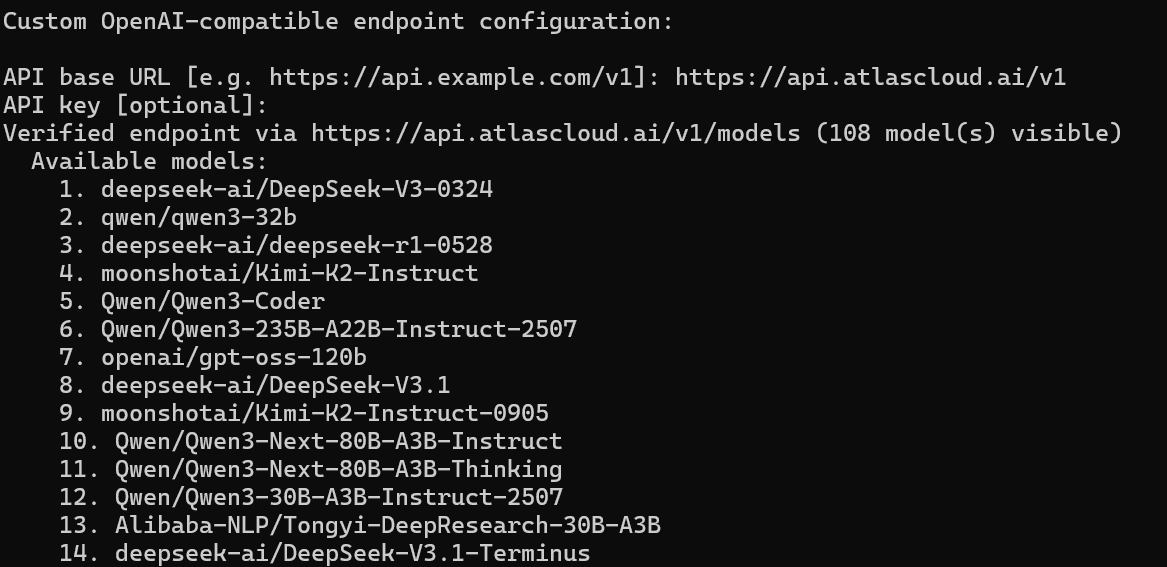

قم بملء البيانات المطلوبة:

- المزود (Provider): text

1custom - نقطة النهاية (Endpoint): text

1https://api.atlascloud.ai/v1 - مفتاح API: text

1apikey-xxx - النموذج (Model): text

1moonshot/kimi-k2.6

هام: يجب أن يتضمن معرف النموذج بادئة

. إدخالtext1moonshot/وحده سيؤدي إلى خطأ 404.text1kimi-k2.6

لتبديل النماذج لاحقاً، أعد تشغيل

1hermes setup

الجزء الثاني — ماذا يفعل نموذج K2.6 فعلياً؟

Claude Code × K2.6 — ماذا يحدث عند تشغيل 23 وكيلاً في وقت واحد؟

ما الذي يتعطل أولاً عند دفع نظام ذكاء اصطناعي إلى أقصى حدوده؟

قرر أحد المطورين اختبار ذلك بالضبط — من خلال تشغيل 23 وكيلاً في وقت واحد عبر Claude Code ليوم كامل. عبر 26 جلسة، تعامل النظام مع استدعاءات الأدوات عالية التردد، وخطوط الأنابيب متعددة الخطوات، والمهام طويلة السلسلة مثل كتابة وثائق متطلبات المنتج (PRD) والتخطيط لتحسين محركات البحث (SEO). بعبارة أخرى، عبء عمل "يشبه الإنتاج" حيث تبدأ الأمور عادةً في الانهيار.

لكن هذه المرة، حدث شيء غير معتاد.

لم تكن هناك أي أخطاء تجاوز معدل الطلبات (429 rate-limit errors).

بالنسبة لأي شخص حاول توسيع نطاق سير عمل الوكلاء، فهذا أمر ملفت للنظر. في ظروف مماثلة، تميل نماذج مثل GLM 5.1 إلى الوصول إلى حدود المعدل بشكل متكرر، مما يضطر النظام لإعادة المحاولة، ويقطع تدفق العمليات ويجلب عدم الاستقرار. في المقابل، ظل K2.6 ثابتاً — ليس لأنه الأسرع، بل لأنه موثوق باستمرار تحت الضغط.

وهذا التمييز أكثر أهمية مما يبدو.

لأنك بمجرد تجاوز مرحلة المطالبات الفردية إلى أنظمة الوكلاء المتعددين، لم يعد التحدي هو "هل يستطيع النموذج الإجابة بشكل جيد؟" بل:

هل يمكنه الاستمرار في الإجابة بشكل جيد — عبر عشرات المهام المتوازية — دون كسر النظام؟

جودة تشبه التخطيط، لا مجرد توليد للنصوص

لم يكن الفرق في الاستقرار فقط، بل ظهر أيضاً في كيفية تعامل K2.6 مع المهام المعقدة.

عند الطلب منه كتابة وثيقة متطلبات منتج (PRD)، لم يكتفِ النموذج بالرد — بل قام بهيكلة مشكلة العمل بنفسه. التحليل التنافسي، قصص المستخدمين، تحديد أولويات الميزات — لم تُطلب هذه الأمور صراحةً، ومع ذلك ظهرت وكأن النظام يفهم كيف يجب أن تبدو وثيقة الـ PRD "الكاملة".

في مهام SEO، كان السلوك مشابهاً. بدلاً من القفز مباشرة إلى اقتراحات الكلمات الرئيسية، استنتج K2.6 أولاً نية البحث (search intent)، ثم قام بمواءمة اتجاه المحتوى وفقاً لذلك. كان المخرج يبدو أقل كونه توليداً خاماً وأشبه بالتخطيط الاستراتيجي في مرحلة مبكرة.

هذا تحول دقيق، ولكنه مهم:

أنت لم تعد تحصل على إجابات فحسب — بل تحصل على تفكير منظم.

وفي بيئات الوكلاء المتعددين، يتضاعف هذا الأثر. عندما ينتج كل وكيل مخرجات منظمة وعالية الجودة، فإن طبقة التنسيق يكون لديها الكثير من العمل الأقل فيما يخص التنظيف والترتيب.

المقايضة: الاستقرار له ثمن

ومع ذلك، هذا الأداء ليس مجانياً.

يعد K2.6 أبطأ بشكل ملحوظ من GLM 5.1، خاصة فيما يتعلق بزمن الوصول لأول رمز (first-token latency). التأخير ليس هامشياً — فهو أكبر بنحو درجة من حيث المقدار. في تفاعل واحد، قد يكون هذا محتملاً. ولكن في نظام تعمل فيه 23 وكيلاً بالتوازي، فإن كل خطوة تقدم توقفاً قصيراً، وتتراكم هذه التوقفات.

جزء من هذا يأتي من بنيته. يستخدم K2.6 تصميم خليط الخبراء (Mixture-of-Experts - MoE)، مع حوالي 1 تريليون معامل إجمالي و32 مليار معامل يتم تنشيطها لكل استنتاج. هذا الحجم يجلب القدرة، ولكنه يجلب أيضاً عبئاً على الجدولة. وبما أن هذا لا يزال إصداراً تجريبياً، فمن المرجح أن تحسين الاستنتاج لم يتم دفعه إلى أقصى حد بعد.

لذا تصبح المقايضة واضحة:

- إذا كنت تهتم بالإنتاجية والسرعة، فهذا أمر مهم.

- إذا كنت تهتم بالاستقرار والمخرجات المنظمة على نطاق واسع، فقد يكون الأمر يستحق ذلك.

OpenCode × K2.6 — من مطالبة واحدة إلى تسعة مسارات عمل متوازية

إذا كانت تجربة Claude Code تظهر كيف يتصرف K2.6 تحت الضغط، فإن OpenCode يكشف شيئاً آخر: كيف ينظم العمل.

يقدم K2.6 طبقة تنسيق تسمى AgentSwarm، حيث يمكن لوكيل "منسق" واحد إنشاء عشرات الوكلاء الفرعيين المتخصصين، مع تعيين دور محدد لكل منهم. بدلاً من التعامل مع المهمة خطوة بخطوة في سلسلة واحدة، يقوم النظام بتفكيكها وتشغيل عمليات متعددة بالتوازي.

لرؤية كيف يبدو ذلك في الممارسة العملية، خذ هذا المثال.

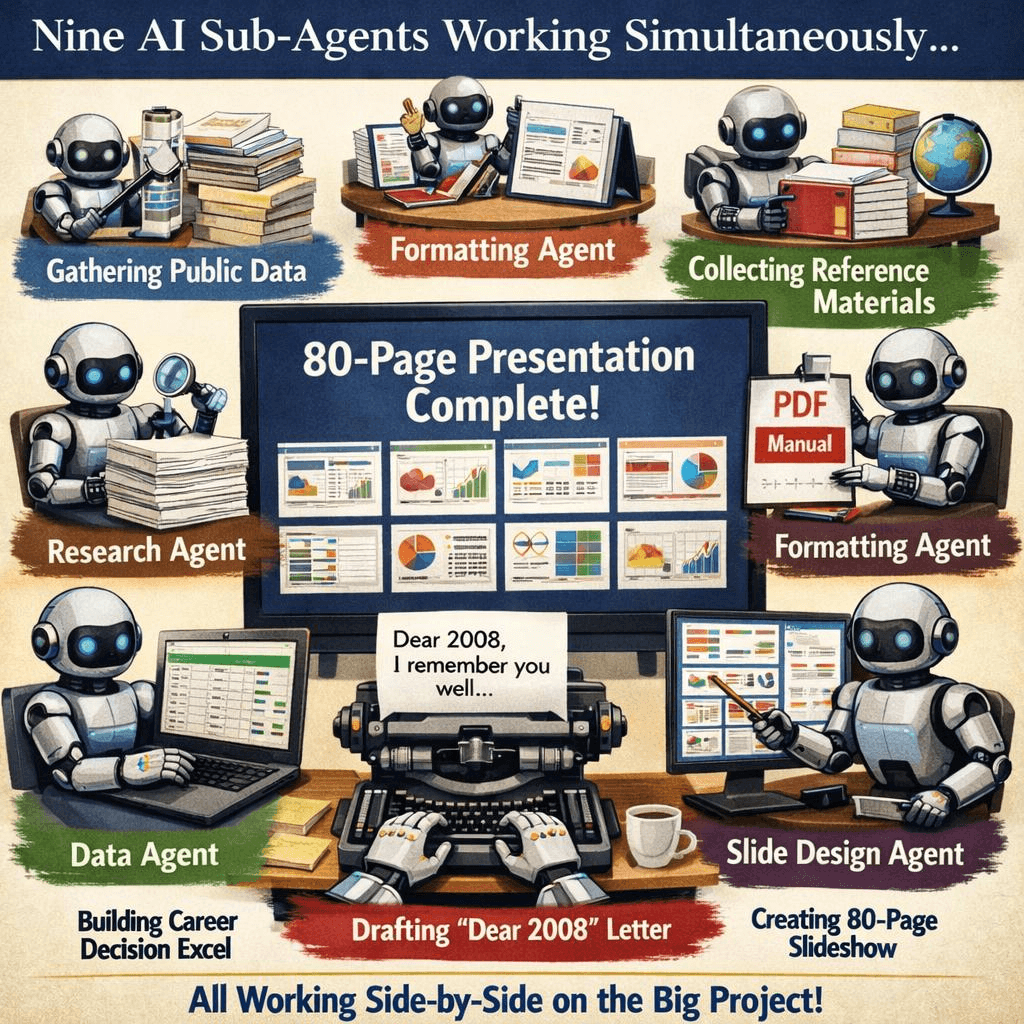

طلب باحث من K2.6 إنتاج ملف تعريف متعمق لداريو أمودي، يتتبع رحلته من حصوله على درجة الدكتوراه في الفيزياء من برينستون إلى تأسيس شركة Anthropic. بدلاً من معالجة هذا كمهمة توليد واحدة طويلة، قام K2.6 بتفكيكها إلى تسعة مسارات متوازية.

كان لكل مسار مسؤولية متميزة. ركز أحد الوكلاء فقط على البحث، وجمع المعلومات العامة. تعامل آخر مع التخطيط، وتنسيق المواد في ملف PDF منظم. وقام وكيل منفصل بإنشاء مجموعة بيانات لنقاط القرار المهنية الرئيسية. وفي الوقت نفسه، أنتج وكيل كتابة سرداً بضمير المتكلم بعنوان "عزيزي 2008".

عمل كل هذا في نفس الوقت.

لم تكن النتيجة مجرد مخرج واحد، بل حزمة منسقة: عرض شرائح مكون من 80 صفحة، مدعوم ببيانات منظمة ومستندات منسقة. ما كان يتطلب عادةً أدوات متعددة، وجلسات عمل، وتجميعاً يدوياً، تم إنتاجه كمخرج نهائي موحد.

لماذا يغير هذا كيفية استخدامك للذكاء الاصطناعي

العامل الممكن الرئيسي هنا هو نظام المهارات (Skill system).

بدلاً من التعامل مع كل مهمة كمطالبة جديدة، يسمح لك K2.6 بتحميل معرفة منظمة — مثل تقرير Goldman Sachs، أو تحليل المنافسين، أو مواصفات منتج مكتوبة جيداً — وتحويلها إلى "مهارة" قابلة لإعادة الاستخدام. عندما يعمل وكيل فرعي، فإنه يرث ذلك الإطار: الأسلوب التحليلي، النبرة، وحتى الهيكل.

بمرور الوقت، يحول هذا نظامك إلى شيء مختلف تماماً عن سير العمل القائم على المطالبات.

إنه يصبح خط إنتاج قابلاً للتكرار.

وهذا يؤدي إلى تحول في كيفية تفكيرك في استخدام الذكاء الاصطناعي:

أنت لم تعد تطالب نموذجاً — أنت تدير فريقاً.

إذا كنت تبني سير عمل قائماً على الوكلاء، فهذا الفرق يصعب تجاهله.

تتصل جميع الأدوات الأربع عبر

1https://api.atlascloud.ai/v11moonshot/kimi-k2.6أسئلة شائعة (FAQ)

-

ما الفرق بين استخدام Hermes Agent والاتصال بـ API نموذج Kimi K2.6 مباشرة؟

الفرق الجوهري يكمن في التنفيذ مقابل الاستجابة.

عند الاتصال بـ API نموذج Kimi K2.6 مباشرة، فأنت تحصل أساساً على استجابة واحدة لكل طلب. حتى بالنسبة للمهام المعقدة، لا تزال بحاجة إلى تفكيكها يدوياً، والتكرار عبر مطالبات متعددة، ودمج المخرجات بنفسك. يعمل هذا بشكل جيد لحالات الاستخدام البسيطة أو التفاعلية، ولكنه يصبح غير فعال بسرعة لسير العمل المنظم.

يغير Hermes هذا من خلال تقديم تنسيق سير العمل. بدلاً من مطالبة واحدة، يمكنك تحديد خط أنابيب بخطوات متعددة — البحث، التخطيط، التنفيذ، إلخ — ويقوم Hermes بتعيين كل خطوة لوكيل. يمكن لهؤلاء الوكلاء تمرير النتائج لبعضهم البعض، والتحقق من المخرجات الوسيطة، وحتى إعادة تنفيذ الخطوات عند حدوث خطأ ما.

في الممارسة العملية، هذا يعني أنك تنتقل من "هندسة المطالبات" إلى تنسيق المهام. تصبح الـ API مكوناً داخل نظام، بدلاً من كونها النظام نفسه.

-

هل يعتبر Kimi K2.6 جيداً لسير عمل الوكلاء المتعددين والأتمتة؟

نعم — هذا هو المجال الذي يؤدي فيه بشكل ملحوظ.

في إعدادات الوكلاء المتعددين، تكون أكبر التحديات عادةً:

- الاتساق عبر الخطوات

- الاستقرار أثناء التشغيل الطويل

- القدرة على اتباع المهام المنظمة

يُظهر Kimi K2.6 أداءً قوياً في المجالات الثلاثة. عند استخدامه داخل Hermes، يمكنه الحفاظ على مخرجات منظمة عبر مراحل متعددة، والتعامل مع سلاسل المهام المعقدة دون كسر التنسيق أو فقدان الاتجاه.

جانب آخر مهم هو التصحيح الذاتي. إذا انحرفت نتيجة وسيطة عن الهدف، يمكن للنظام إعادة توليد تلك الخطوة بدلاً من الاستمرار ببيانات معيبة. هذا يجعله أكثر ملاءمة لسيناريوهات الأتمتة حيث لا ترغب في الإشراف اليدوي على كل خطوة.

بشكل عام، يبدو أقرب إلى طبقة تنفيذ موثوقة من كونه مجرد مولد نصوص بسيط.

-

لماذا يعتبر Kimi K2.6 أبطأ في سير عمل الوكلاء مقارنة بالنماذج الأخرى؟

يرجع البطء في المقام الأول إلى كيفية استخدامه، وليس النموذج نفسه فحسب.

في سيناريو الدردشة القياسي، تنتظر استجابة واحدة فقط. في سير عمل الوكلاء، قد تتضمن المهمة الواحدة خطوات متعددة — كل منها يتطلب استدعاء نموذج منفصل، بالإضافة إلى عبء التنسيق بين الوكلاء. هذا يؤدي بطبيعة الحال إلى تأخير في كل مرحلة.

بالإضافة إلى ذلك، تم تصميم Kimi K2.6 ببنية أكثر تعقيداً (مثل التوجيه بأسلوب MoE)، مما قد يزيد من عبء الاستنتاج مقارنة بالنماذج الأصغر أو الأكثر تحسيناً. عند دمج ذلك مع تنسيق الوكلاء المتعددين، يصبح التأخير أكثر وضوحاً.

ومع ذلك، فإن المقايضة هي أن كل خطوة تنتج مخرجات ذات جودة أعلى وأكثر تنظيماً، مما يقلل الحاجة إلى عمليات إعادة المحاولة أو الإصلاحات اليدوية. لذا، ورغم كونه أبطأ في زمن الاستجابة الخام، إلا أنه يمكن أن يكون أكثر كفاءة على مستوى سير العمل.