OpenAI Sora 2は、AI動画生成、特に物理シミュレーションの分野において最先端をいくモデルです。物体が落下、バウンド、破壊され、周囲と相互作用する様子は極めて説得力があり、競合モデルでここまでの精度を実現できているものはありません。本Sora 2チュートリアルでは、開発者がSora 2を自身のワークフローに統合するために必要なすべてを網羅します。Atlas Cloud APIを介した利用方法、料金、Pythonコードの例、プロンプトエンジニアリング、そしてSeedance 2.0、Kling 3.0、Veo 3.1との直接比較についても解説します。

Sora 2のデモ動画:Sora 2 APIはAtlas Cloudから利用可能で、料金は動画生成1秒あたり0.15ドルです。Atlasでは登録時に1ドルの無料クレジットも提供しています。Atlasの顧客は、OpenAI、快手(Kuaishou)、ByteDance、Googleの個別の契約なしで、1つのAPIキーでSora 2を含む300以上のモデルにアクセスできます。

Sora 2の概要

- 開発元: OpenAI

- モデルID: text

1openai/sora-2/text-to-video-pro-developer - 最大解像度: 高精細(High Definition)

- 最大動画時間: 12秒

- フレームレート: 30fps

- ネイティブ音声: 対応

- 参照入力: 画像1枚

- 主な強み: 物理シミュレーション、リアルな物体間の相互作用

- Atlas Cloud料金: 0.15ドル/秒

Sora 2の主な特徴

物理シミュレーション

Sora 2が他と一線を画しているのはこの領域です。重力、運動量、流体力学、衝突力学が、他のモデルでは再現困難な一貫性をもってシミュレートされます。ボーリングの玉がピンに当たるようなプロンプトを入力すると、適切な力の分散、ピンの飛び散り方、フォロースルーが描かれます。Kling 3.0やSeedance 2.0はこうした相互作用を推定することが多いのに対し、Sora 2はそれを正確にシミュレーションします。

リアルな物体間の相互作用

Sora 2モデルは、単一物体を超えた物理現象も理解しています。グラスに液体を注ぐ、積み木が傾いて崩れる、猫がテーブルから物を落とすといった動作には、物体同士がどう影響し合うかという因果推論が必要です。Sora 2モデルは、公開APIで利用可能な他のどのモデルよりも、複雑で複数物体の相互作用に対して高い堅牢性を示します。

素材と表面のレンダリング

ガラス、金属、水、布、木材などは、Sora 2の出力においてそれぞれ固有の物理的特性に従います。透明な媒体を光が通るときには屈折し、鏡は周囲の環境を捉えて歪ませます。布は適切な重みをもって垂れ下がり、シワが寄ります。このレベルの質感が、Sora 2の出力に見られるリアルさを支えています。

ネイティブ音声生成

Sora 2は動画とともに音声を生成可能です。歩く音には歩調に合わせたリズムがあり、衝突音には適切な響きがあり、背景ノイズもシーンに合致しています。プロダクション品質には及びませんが、多くのパイプラインで工程を削減できる実用的なベースラインを提供します。

時間的一貫性

最大12秒間の動画において、Sora 2は照明、キャラクターの表現、背景のディテールにおいて高い一貫性を維持します。フレーム間で物が色を変えたり形を変えたりすることはありません。影はクリップ全体を通して光源に適切に追従します。このレベルの連続性は、不自然な飛びが生じやすい、ゆっくりとした動きのショットで特に重要です。

Sora 2の料金

OpenAI Sora 2の公式アクセス

OpenAI Sora 2へのアクセスは、ChatGPT Plusサブスクリプション(月額20ドル)またはProサブスクリプション(月額200ドル)の一部として提供されますが、厳しい制限があります。Plusユーザーは月間の生成回数に上限があり、ピーク時には待ち時間が長くなる可能性があります。OpenAIの直接API経由でのアクセスも可能ですが、OpenAIの承認を受けた開発者アカウントのみに限定されており、より高額な料金が設定されています。

Atlas Cloud API料金(推奨)

開発者がSora 2 APIにアクセスする最も簡単な方法はAtlas Cloudを利用することです。

- モデル: text

1openai/sora-2/text-to-video-pro-developer - 料金: 0.15ドル/秒

- 10秒クリップ: 1.50ドル

- 12秒クリップ(最大): 1.80ドル

- 無料サインアップクレジット: 1.00ドル

- 待ち時間: なし

登録時の1ドルの無料クレジットで約6秒の動画が生成でき、料金を支払う前に品質や物理精度のサンプルを確認できます。Sora 2の料金体系は、大量生産を行うチームにとっても予測が立てやすいリニアな価格設定です。

Sora 2 APIへのアクセス方法

オプション1:OpenAI直接利用

Sora 2はChatGPTサブスクリプションや開発者APIを通じて利用可能です。開発者APIへのアクセスにはアカウントの承認が必要で、生成ごとのコストも割高になります。ドキュメントはplatform.openai.comで提供されており、オンボーディングプロセスには動画生成エンドポイントの承認待ちリストが含まれます。

オプション2:Atlas Cloud(推奨)

多くの開発者にとって、製品化への最短ルートはSora 2 Atlas Cloud統合の利用です。OpenAI Sora 2だけでなく、Seedance 2.0、Kling 3.0、Veo 3.1を含む300以上のモデルのパワーを1つのAPIキーで利用できます。待ちリストなし。別々のアカウント契約も不要。請求も一本化されます。

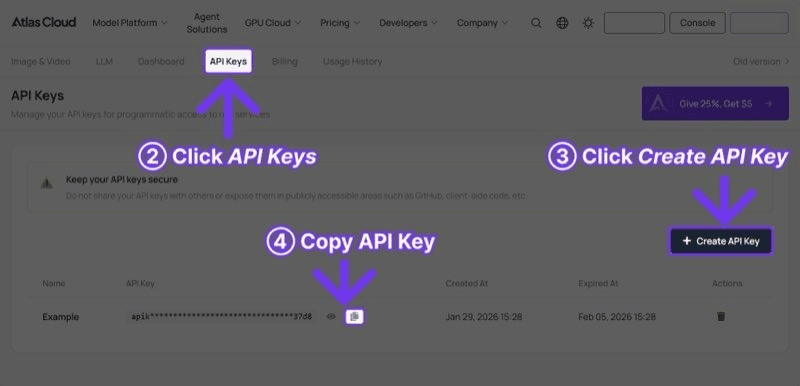

ステップ1:atlascloud.ai (https://www.atlascloud.ai?utm_medium=article&utm_source=blog&utm_campaign=sora-2-guide) にサインアップし、ダッシュボードからAPIキーを取得します。1ドルの無料クレジットが自動的にアカウントに追加されます。

ステップ2:PythonでSora 2を使って動画を生成します:

python1import requests 2import time 3 4API_KEY = "your-atlas-cloud-api-key" 5BASE_URL = "https://api.atlascloud.ai/api/v1" 6 7# Sora 2で動画を生成 8response = requests.post( 9 f"{BASE_URL}/model/generateVideo", 10 headers={ 11 "Authorization": f"Bearer {API_KEY}", 12 "Content-Type": "application/json" 13 }, 14 json={ 15 "model": "openai/sora-2/text-to-video-pro-developer", 16 "prompt": "A glass sphere rolling down a wooden staircase, each bounce creating ripples of light, realistic physics and reflections, cinematic slow motion", 17 "duration": 10, 18 "resolution": "1080p" 19 } 20) 21 22result = response.json() 23 24# 結果を取得するためにポーリング 25while True: 26 status = requests.get( 27 f"{BASE_URL}/model/prediction/{result['request_id']}/get", 28 headers={"Authorization": f"Bearer {API_KEY}"} 29 ).json() 30 if status["status"] == "completed": 31 print(f"Video: {status['output']['video_url']}") 32 break 33 time.sleep(5)

ステップ3: APIは即座に

1request_id1completedSora 2のプロンプトのコツ

Sora 2 APIでの多くのテストを経て、高品質な結果が得られるプロンプト手法を紹介します。Sora 2は物理的な相互作用や素材の挙動に焦点を当てたプロンプトに対して特に優れた性能を発揮します。

- 物理法則を具体的に指定する。Sora 2の強力なエンジンは物理シミュレーションですので、これを活用しましょう。単に「ボールが跳ねる」とするのではなく、「肩の高さから堅木(ハードウッド)の床に落とされたゴムボールが、3回バウンドして徐々に高さを失い、リアルな弾性と影の動きを見せる」のように記述します。物理特有の詳細を指定することでモデルはより正確に応答します。

- 素材や表面を描写する。Sora 2は異なる特性を持つ素材をシミュレートします。「すりガラス」、「ブラシ仕上げのアルミニウム」、「濡れた石畳」、「シルクのカーテン」といった具体的な素材名を使用してください。モデルはこれらのテクスチャを認識し、それぞれの素材に光の物理法則を正しく適用します。

- カメラワークには映画的な専門用語を使う。Sora 2は基本的な撮影用語をカメラコマンドとしてうまく解釈します。「スロードリーイン(ゆっくり前進)」、「前景から背景へのラックフォーカス」、「ローアングル追跡ショット」といった用語は、意図した通りのカメラ操作を実現します。「かっこいいカメラの動き」のような曖昧な指示は避けましょう。

- プロンプトは10〜12秒で設計する。最大12秒という制限を考慮し、一連の流れとして機能するアクションやシーンを描写しましょう。被写体は1つ、主要な動きを1つ、最後においしいカットを用意します。複数のシーンやカットを1つの生成に詰め込もうとしないでください。

- 因果関係の連鎖を活用する。Sora 2は現実世界で何かが次々と起こる状況の処理に強いようです。「デスクの上でドミノが倒れ、鉛筆立てを押し倒す」や「マッチに火をつけ、その火がキャンドルの芯に移る」といった、物理的なイベントが複数ステップ続くフレーズは、モデルの強みを引き出します。

テストで良好な結果が出たプロンプト例:

物理シミュレーションのショーケース:

plaintext1A ceramic mug tipping off the edge of a kitchen counter in slow motion, 2shattering on impact with a tile floor, fragments and liquid scattering 3realistically, soft morning light from a nearby window, cinematic depth of field

製品デモ:

plaintext1A smartphone placed on a reflective dark surface, water droplets falling 2onto the screen and beading naturally, demonstrating water resistance, 3studio lighting with subtle blue accent lights, 4K commercial style

自然シミュレーション:

plaintext1A single drop of water falling into a still pond, creating concentric 2ripples that expand outward, a fallen autumn leaf floating on the surface 3gently disturbed by the waves, golden hour lighting, macro lens perspective

Sora 2 vs 競合モデル

- Sora 2: 最大解像度: 高精細, 最大時間: 12秒, 参照入力: 画像1枚, 音声: 対応, APIコスト (Atlas Cloud): 0.15ドル/秒, 強み: 物理的リアリズム, コンテンツフィルタ: 厳格

- Seedance 2.0: 最大解像度: 高精細, 最大時間: 15秒, 参照入力: 12ファイル, 音声: 対応, APIコスト (Atlas Cloud): 0.022ドル/秒, 強み: マルチモーダル制御, コンテンツフィルタ: 厳格

- Kling 3.0: 最大解像度: Ultra HD, 最大時間: 10秒, 参照入力: 画像1-2枚, 音声: 対応 (5言語), APIコスト (Atlas Cloud): 0.126ドル/秒, 強み: 解像度+コスパ, コンテンツフィルタ: 非常に厳格

- Veo 3.1: 最大解像度: HDシネマティック, 最大時間: 8秒, 参照入力: 画像1-2枚, 音声: 対応, APIコスト (Atlas Cloud): 0.03ドル/秒, 強み: 映画的な仕上がり, コンテンツフィルタ: 中程度

Sora 2の強み

OpenAI Sora 2は、物理シミュレーションの精度と物体の挙動の納得感において最先端です。物理ベースの因果関係を含む動画コンテンツ(製品デモ、解説動画、物理ベースのアートなど)において、その出力品質に匹敵するモデルはありません。また、最大12秒という長さはKling 3.0(10秒)やVeo 3.1(8秒)よりも改善されており、1つのクリップ内でより多くの物語を描けます。

Sora 2の短所

Sora 2の料金は0.15ドル/秒で、本記事で紹介した中で最も高額です。Seedance 2.0は0.022ドル/秒で、約85%割安です。解像度は最大で高精細(HD)にとどまり、Kling 3.0のUltra HDより低いです。参照入力も画像1枚のみで、Seedance 2.0は最大12ファイルまで処理可能です。予算に制約があるチームや、詳細な参照ベースの制御が必要なプロジェクトでは、これらの違いが重要になります。

実践的なアプローチ

本Sora 2チュートリアルで紹介したように、ほとんどのチームは1つのモデルだけで完結させるのではなく、複数のモデルを使い分ける必要があります。Sora 2は物理演算が重要なシーンの制作に、Seedance 2.0は複雑で複数参照を必要とするプロジェクトに、Kling 3.0は最高解像度での最終レンダリングに、Veo 3.1は映画的な洗練に最適です。Atlas Cloudを利用すれば、1つのAPIキーと統合請求により、このマルチモデル戦略を実現可能です。

Sora 2は誰が使うべき?

次のような場合にSora 2を選択してください:

- 物理的な正確さが最優先事項である。重力、流体、衝突、素材の相互作用がSora 2の強みです。

- オブジェクトのリアルな挙動(落下、水しぶき、回転、機械的な動きなど)が求められる製品デモを作成する。

- 教育や科学的ビジュアライゼーションにおいて、詳細な検討に耐えうる物理現象の再現が必要である。

- 12秒の長さで十分なコンテンツを作成できる。Sora 2はKling 3.0やVeo 3.1よりもクリップあたりの時間が長いです。

- 予算よりも物理駆動コンテンツの品質を優先する。

次のような場合はSeedance 2.0を選択してください:

- 複数の画像、動画、音声ファイルなど、広範な参照素材が必要である。

- 予算効率が極めて重要である。Atlas Cloud上では0.022ドル/秒で、Sora 2より約7倍安価です。

- より長いクリップ(最大15秒)が必要である。

- 物理精度よりもマルチモーダルな入力制御を重視する。

次のような場合はKling 3.0を選択してください:

- Ultra HDでの出力が必要である(Sora 2はHDまで)。

- 無料枠の利用が重要である。Kling 3.0は毎日66クレジットを提供しています(Sora 2は有料のみ)。

- ECサイト向けコンテンツなどで、映像内の文字を鮮明にレンダリングする必要がある。

次のような場合はVeo 3.1を選択してください:

- 映画的な画質やカラーグレーディングが最優先である。

- 費用対効果の高いスケーリングが必要である(0.03ドル/秒でSora 2の5倍安価)。

- 短いクリップ(8秒以内)で十分である。

よくある質問

Sora 2 APIへのアクセス方法は?

Atlas Cloud経由が最も簡単です。サインアップしてAPIキーを取得し、リクエスト内にモデルID

1openai/sora-2/text-to-video-pro-developerSora 2の動画1本あたりのコストは?

Sora 2はAtlas Cloudで生成動画1秒あたり0.15ドルです。10秒のクリップで1.50ドル、最大12秒のクリップで1.80ドルとなります。OpenAI直接契約の場合、サブスクリプション階層によって異なりますが、一般的に同等の出力に対しAtlas Cloudよりも高額になります。

Sora 2で生成できる最大動画長は?

Sora 2はHD解像度で最大12秒です。これはSeedance 2.0(最大15秒)とKling 3.0(最大10秒)の中間に位置します。長尺が必要な場合は、複数のクリップを作成して編集でつなぎ合わせるのが一般的です。

Sora 2で画像から動画を生成(Image-to-Video)できますか?

はい。Sora 2は1枚の参照画像を入力として受け入れ、それを生成動画の初期フレームやスタイルの参照として利用しますが、画像は1枚までです。Seedance 2.0は最大12個の参照ファイルを利用可能です。

Sora 2はSeedance 2.0やKling 3.0よりも優れていますか?

これらのモデルはそれぞれ異なる強みを持っています。Sora 2は物理シミュレーションと物体の相互作用で最高性能を発揮します。Seedance 2.0はマルチモーダルな入力制御と低価格(0.022ドル/秒)で勝っています。Kling 3.0は最高解像度と無料枠の寛大さで優れています。多くのチームにとって最適な戦略は、Atlas Cloudのような統合プラットフォーム経由ですべてのモデルを使い、各タスクに最適なモデルを割り当てることです。

Sora 2は動画と一緒に音声も生成しますか?

はい。Sora 2のネイティブ音声生成は映像とタイミングが合っています。この音声はドラフトやSNS投稿用のコンテンツとしては十分実用的ですが、プロフェッショナルな制作物ではポストプロダクションでの差し替えや強化が必要になる場合があります。

総評

Sora 2はAI動画生成エコシステムにおいて非常に特異な立ち位置にあります。最も費用対効果が高いわけではなく、最高解像度でもなく、最もオープンな入力システムでもありません。しかし、現在公開されているどのAPIよりも物理的に正確な動画生成が可能です。アプリケーションやコンテンツが現実世界の物理法則を重視している場合(製品デモ、教育、科学的ビジュアライゼーション、現実に基づいたアートなど)、Sora 2はあなたにとって最も強力な選択肢となるでしょう。

本Sora 2チュートリアルの結論:Atlas CloudでSora 2、Seedance 2.0、Kling 3.0、Veo 3.1、その他300以上のモデルにアクセスしましょう。1つのAPIキー、1つの請求。ジョブごとに最適なモデルを選択する自由を。1ドルの無料クレジットで、Sora 2の物理シミュレーションを今すぐ試してみましょう。

────────────────────────────────────────────────────────────