Wan 2.6 vs Sora 2: Der Video-KI-Showdown 2025

Einführung

Die KI-Videolandschaft im späten Jahr 2025 wird von zwei Flaggschiffmodellen dominiert:

Beide generieren beeindruckende Videos, sind aber für sehr unterschiedliche Ziele optimiert. Wenn Sie sich fragen:

- „Wan 2.6 vs Sora 2 – welches soll ich für Werbung verwenden?"

- „Welches Modell ist besser für lange, filmische Welten?"

- „Wie teste ich beide an einem Ort und integriere sie in mein Produkt?"

Diese Anleitung bietet Ihnen einen praktischen, produktionsorientierten Vergleich – und zeigt, wie Atlas Cloud es Ihnen ermöglicht, beide Modelle in einem Playground auszuprobieren und über eine einzige API zu integrieren.

TL;DR Schneller Vergleich (Spezifikationen & Preisprofil)

Wan 2.6 vs Sora 2 im Überblick

| Wan 2.6 | Sora 2 | |

|---|---|---|

| Preis | 0,08 $/Sek. auf Atlas Cloud | 0,05 $/Sek. auf Atlas Cloud |

| Kernfokus | Charaktersteuerung & Storytelling | Weltsimulation & kommerzielle & filmische Videos |

| Typische Dauer | 5s; 10s; 15s | 10s; 15s |

| Eingabetypen | Text-zu-Video; Bild-zu-Video; Video-Referenz | Text-zu-Video; Bild-zu-Video |

| Größe | Text-zu-Video & Video-Ref: 720_1280; 1280_720; 960_960; 1088_832; 832_1088; 1920_1080; 1080_1920; 1440_1440; 1632_1248; 1248_1632; Bild-zu-Video: Gemäß der Größe des Referenzbildes. | 720_1280; 1280_720 |

| Auflösung | 720P, 1080P | —— |

| Stärke | Mehrteilige Erzählung, Gesichts-Stabilität, filmische Kamerabewegungen | Tiefe Physik, komplexe Umgebungen |

| Audio | Erzählung & Dialog | Immersive Hintergrundklanglandschaften |

| Am besten für | Charakteranimation, Social-Media-Inhalte, schnelle Ideenfindung | Werbung, E-Commerce, Filmemachen, professionelle Produktion |

| Semantische Extrapolation | Hervorragend in Filmszenen | Hervorragend in kommerzieller Werbung |

| Shot-Komposition | Intelligente Prompt-Ausführung | Prompt-Treue |

| Konsistenz | Charakterkonsistenz | Umgebungs-Konsistenz |

Auf Atlas Cloud können Sie:

- Denselben Prompt durch Wan 2.6 und Sora 2 laufen lassen

- Ausgabequalität vs. Kosten nebeneinander sehen

- Entscheiden, welches Modell den besten ROI für Ihren spezifischen Workflow liefert

Modellübersicht

Wan 2.6 im Überblick

Wan 2.6 von Alibaba Cloud verfügt über bahnbrechende multimodale Fähigkeiten und native Audio-Synchronisation. Dieses neueste Update von Wan 2.6 stattet Kreative mit fortschrittlichen Text-zu-Video- und Bild-zu-Video-Werkzeugen aus, die bis zu 15 Sekunden lange 1080p-Kinofilminhalte produzieren.

Schlüsselideen:

- Intelligente Segmentierung (Multi-Shot-Narrativ)

Versteht Szenengrenzen und behält dieselbe Charakteridentität über Nahaufnahmen, Halbtotalen und Totale hinweg bei. Ideal für Werbung und Storyboards, bei denen die Hauptfigur im Stil bleiben muss.

- 15-Sekunden-Hochleistungsclips

Erhöht die typische Videolänge auf ca. 15 Sekunden. Genug für einen vollständigen narrativen Bogen – Aufbau → Aktion → Reaktion – in einer einzigen Generierung, was perfekt zu 6–15-Sekunden-Werbespots und Social-Media-Hooks passt.

- Hochwertiges Audio & stabile Multi-Speaker-Dialoge

Ein großer Sprung in der nativen Audioerzeugung. Wan 2.6 liefert hyperrealistische Stimmklänge und unterstützt stabile Dialoge mit mehreren Sprechern. Es erzeugt synchronisierte, natürlich klingende Gespräche zwischen mehreren Charakteren und eliminiert den oft in KI-Audio anzutreffenden Roboterklang.

- Erweiterte Videoreferenz (Referenzgesteuertes Schauspiel)

Sie laden ein Probevideo (Aufnahme mit dem Handy) hoch, und Wan 2.6 klont Timing, Blockierung und Körpersprache auf einen generierten Charakter. Dies gibt Regisseuren eine schauspielerische Kontrolle ohne Nachdrehs.

Insgesamt fühlt sich Wan 2.6 wie eine umfassende Erzählmaschine für Regisseure an, die intelligente Multi-Shot-Visuals mit hochwertigen Dialogen verbindet, um vollständige, 15-sekündige filmische Storylines zu liefern.

Sora 2 im Überblick

Sora 2 ist ein fortschrittliches Videogenerierungsmodell, das frühere Systeme in Bezug auf physikalische Genauigkeit, Realismus und Steuerbarkeit deutlich übertrifft und als leistungsstarke Maschine für die Weltsimulation dient.

Schlüsselideen

- Unübertroffener Realismus & physikalische Simulation

Sora 2 verfügt über fortschrittliche Weltsimulationsfähigkeiten, wodurch generierte Szenen strenger den Naturgesetzen folgen. Es zeichnet sich durch die Lieferung hochwertiger Bilder in verschiedenen Ästhetiken aus, von hyperrealistischen und filmischen Aufnahmen bis hin zu ausgeprägten Anime-Stilen.

- Überlegene Steuerbarkeit & Konsistenz

Das System bietet beispiellose Kontrolle und kann detaillierte Anweisungen über mehrere Szenen hinweg befolgen. Entscheidend ist, dass es den "Weltzustand" (Persistenz) genau beibehält und sicherstellt, dass Objekte, Charaktere und Umgebungen über komplexe Sequenzen hinweg konsistent bleiben.

- Voll synchronisierte Audiointegration

Über stumme Bilder hinaus bietet Sora 2 synchronisierte Dialoge und Soundeffekte. Es erzeugt anspruchsvolle Hintergrundsoundscapes, Sprache und SFX mit hoher Realitätstreue, die perfekt zur onscreen gezeigten Aktion passen und ein voll immersives Erlebnis bieten.

- Integration in die reale Welt

Das Modell schlägt eine Brücke zwischen der virtuellen und der physischen Welt, indem es Benutzern ermöglicht, Elemente der realen Welt direkt in den generierten Inhalt einzubringen.

Zusammenfassend lässt sich sagen, dass Sora 2 ein hochwertiger Weltsimulator ist, der entwickelt wurde, um physikalisch konsistente Videos in verschiedenen Stilen mit vollständig synchronisiertem Audio durch hochgradig steuerbare Anweisungen zu generieren.

Kernunterschiede

Konsistenzfokus: Charaktere vs. Welten

- Wan 2.6: Seine Stärke liegt in der Charakterkonsistenz und Lippensynchronisation. Es zeichnet sich dadurch aus, die Identität eines Charakters über die Frames hinweg stabil zu halten und seine Mundbewegungen perfekt an die Sprache anzupassen.

- Sora 2: Seine Superkraft ist die Umgebungskonsistenz. Es hält einen stabilen, persistenten Weltzustand aufrecht und sorgt dafür, dass der Hintergrund, die Physik und die räumlichen Beziehungen auch bei Kamerabewegungen kohärent bleiben.

Cinematografie & Workflow

Die Workflow-Erfahrung unterscheidet sich je nach Anwendungsfall erheblich.

- Allgemeine Szenen:

- Wan 2.6 (Erstellung): Funktioniert hervorragend mit einfacher natürlicher Sprache. Sie beschreiben die Stimmung, und es "erstellt" die Szene für Sie. Es setzt auf generative Intuition.

- Sora 2 (Produktion): Erfordert detailliertere Kontrolle. Sie müssen wie ein Regisseur agieren und spezifische Kamera- und Shot-Anweisungen (z. B. Schwenks, Zooms) geben. Es fühlt sich eher wie ein technischer "Produktions"-Prozess an.

- Kommerzielle Szenen:

- Sora 2: Überraschenderweise zeigt Sora 2 im kommerziellen Kontext eine hochrangige konzeptionelle Inferenz. Es kann anspruchsvolle Storyboards und Shots für Anzeigen intelligent generieren, ohne dass eine Mikromanagement erforderlich ist.

Audio-Dynamik

- Wan 2.6: Konzentriert sich auf das Narrativ. Es gestaltet autonom Charakterdialoge basierend auf der generierten Persona.

- Sora 2: Konzentriert sich auf die Immersion. Es erzeugt hyperrealistische Umgebungsgeräusche und Hintergrund-Soundscapes basierend auf der physischen Umgebung.

Fazit: Kreieren vs. Produzieren

Letztendlich läuft die Wahl auf zwei unterschiedliche Philosophien hinaus:

- Wan 2.6 ist zum "Kreieren" von Charakteren: Es fühlt sich an wie ein intuitiver kreativer Partner, der die Schauspieler und ihre Leistung priorisiert.

- Sora 2 ist zum "Produzieren" von Welten: Es fungiert als hochwertiger Simulator, der die physische Umgebung und präzise filmische Kontrolle priorisiert.

Anwendungsfälle: Wann/Wer Wan 2.6 oder Sora 2 wählen sollte

(Gleicher Prompt, unterschiedliche Ausgaben)

Eine nützliche Methode zur Entscheidung ist, sich vorzustellen, denselben kreativen Brief durch beide Modelle laufen zu lassen und die Ergebnisse zu vergleichen.

Beispiel 1: Filmische Fantasy-Szene

plaintext1Prompt: 2Ein filmischer Sci-Fi-Trailer. Shot 1: Weitwinkelaufnahme, ein einsamer Entdecker in einem ramponierten Raumanzug, der über eine trostlose rote Marswüste geht, ein riesiges verlassenes Raumschiff in der Ferne. Shot 2: Nahaufnahme, der Entdecker hält an und wischt Staub von seinem Helmvisier, die Augen weiten sich vor Schock. Shot 3: Über-die-Schulter-Aufnahme, die eine leuchtende, biolumineszente blaue Blume enthüllt, die sich schnell vor ihm öffnet. 8k-Auflösung, hochdetailliert, konsistenter Charakter.

Ausgabe:

- Wan 2.6 Ausgabe (Klicken Sie hier, um das Ausgabevideo zu sehen)

- Konsistente Schauspielerin über Winkel hinweg

- Gute Befolgung von Anweisungen

- Immersive Hintergrund-Soundscapes

- Sora 2 (Klicken Sie hier, um das Ausgabevideo zu sehen)

- Gute Befolgung von Anweisungen

- Immersive Hintergrund-Soundscapes und Dialoge

Beispiel 2: 15-Sekunden-Produktwerbung

plaintext1Prompt: Ein YouTuber bewirbt dieses KI-Begleitspielzeug auf Englisch. 1280*720

Ausgabe:

- Wan 2.6 (Klicken Sie hier, um das Ausgabevideo zu sehen)

- Sora 2 (Klicken Sie hier, um das Ausgabevideo zu sehen)

- Ausgezeichnete Fähigkeit zur semantischen Extrapolation im kommerziellen Kontext

- Aufrechterhaltung einer hervorragenden Produktionskonsistenz

Beispiel 3: Anime-Stil

In diesem Fall sehen Sie deutlich, wie Wan 2.6 bei Dialogen und automatischer Szenenerkennung fortschrittlich ist, während Sora 2 bei immersiven Hintergrund-Soundscapes glänzt.

plaintext1Prompt: 2Hochwertiger Anime-Stil. Ein Mädchen in einem bunten floralen Yukata steht auf traditionellen Schrein-Treppen bei Nacht. Sie dreht sich zur Kamera um und lächelt sanft. Riesige, leuchtende Feuerwerke explodieren hinter ihr am dunklen Himmel und beleuchten ihre Silhouette. Sanftes Leuchten von hängenden Papierlaternen. Glühwürmchen, magische Atmosphäre.

Ausgabe:

- Wan 2.6 (Klicken Sie hier, um das Ausgabevideo zu sehen)

- Überlegene KI-Storyboarding-Fähigkeiten

- Fließendes Narrativ & natürlicher Dialog

- Sora 2 (Klicken Sie hier, um das Ausgabevideo zu sehen)

- Immersive Hintergrund-Soundscapes

Wer sollte was wählen?

- Influencer / Gelegenheits-Ersteller / diejenigen, die flexible Videoformate wünschen, die auf schnellen viralen Inhalt abzielen → Wan 2.6

- Professionelle Kreative & Marken / E-Commerce, die Polishing und Kontrolle benötigen → Sora 2

Verwendung beider Modelle auf Atlas Cloud

Anstatt sich auf "Wan 2.6 vs. Sora 2" festzulegen, können Sie mit Atlas Cloud beide Modelle nebeneinander nutzen – zuerst in einem Playground, dann über eine einzige API.

Methode 1: Direkte Nutzung auf der Atlas Cloud-Plattform

| Wan 2.6 Familie | Sora 2 Familie |

| Wan 2.6 Text-zu-Video | Sora 2 Text-zu-Video |

| Wan 2.6 Bild-zu-Video | Sora 2 Bild-zu-Video |

| Wan 2.6 Referenz-Video |

Methode 2: Zugriff über API

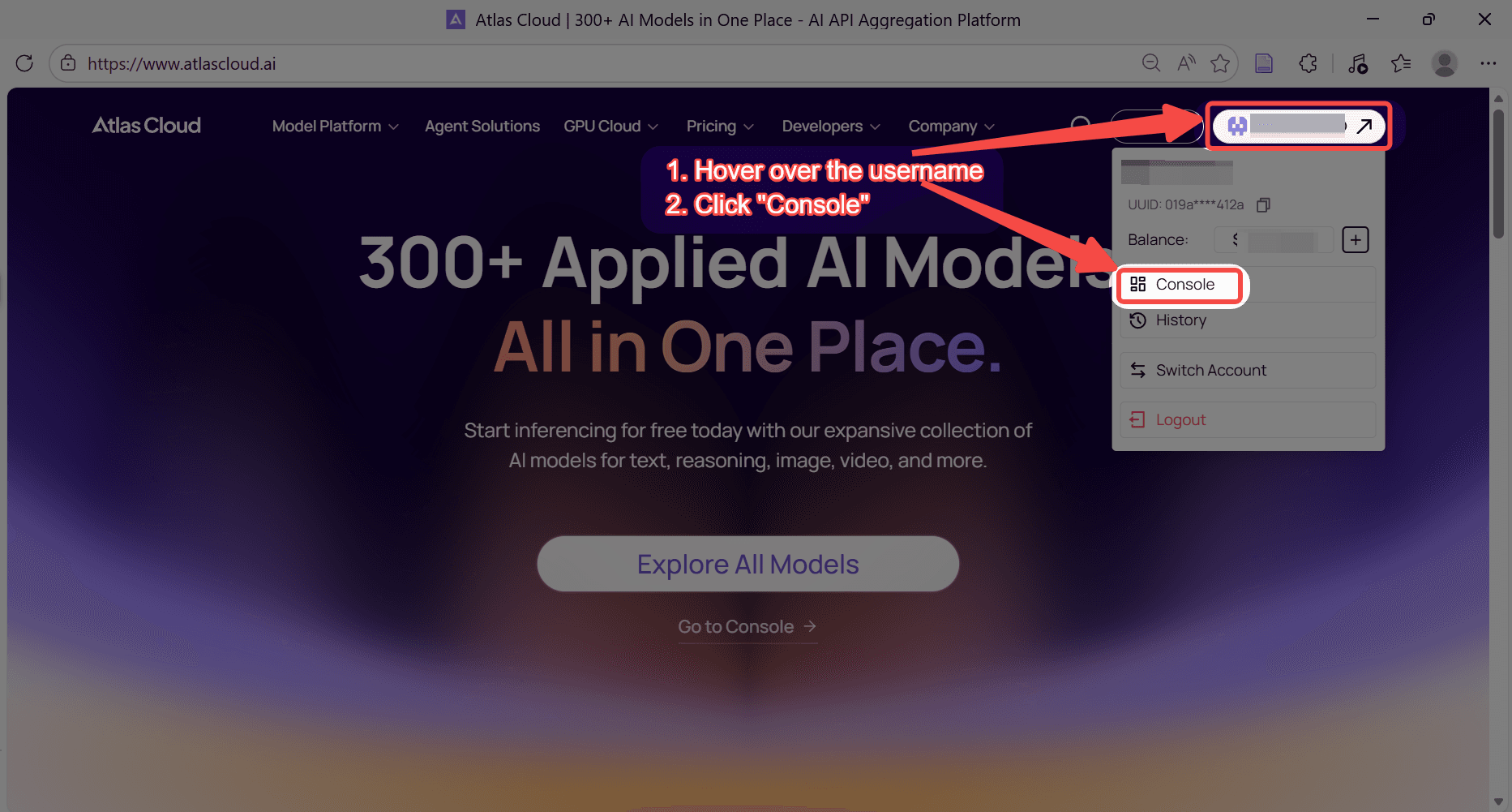

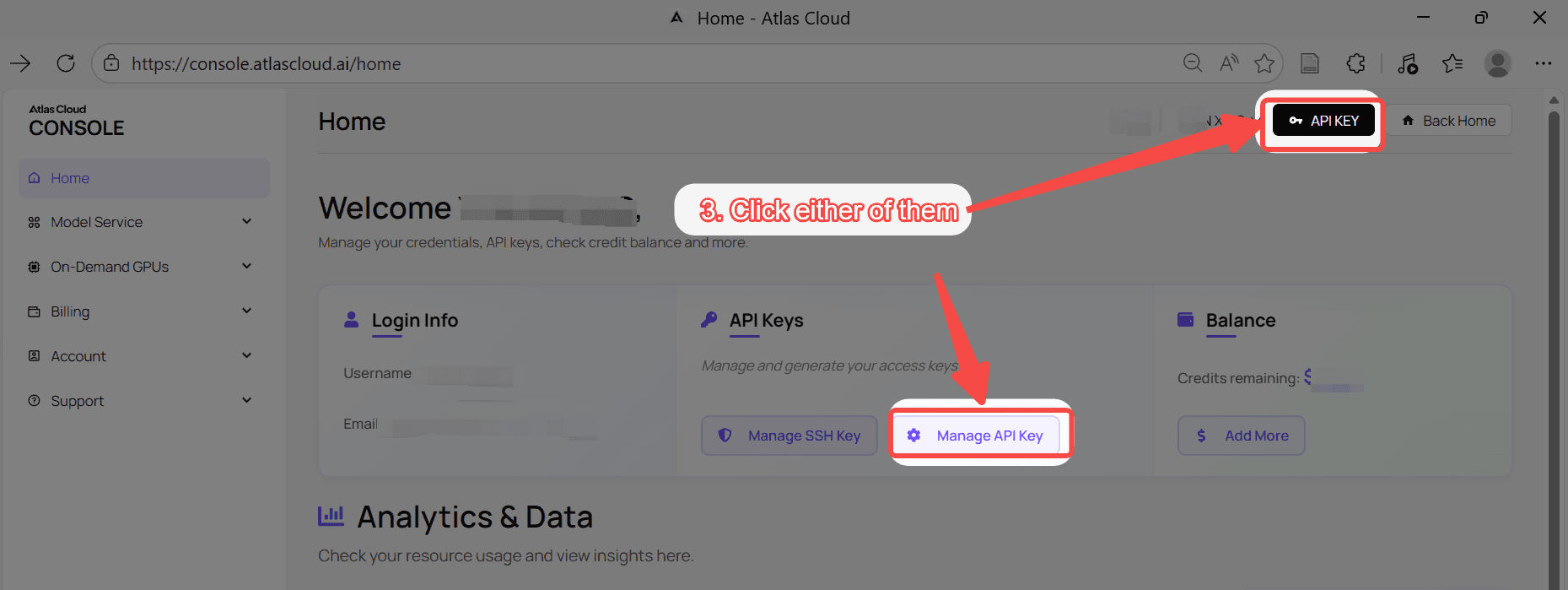

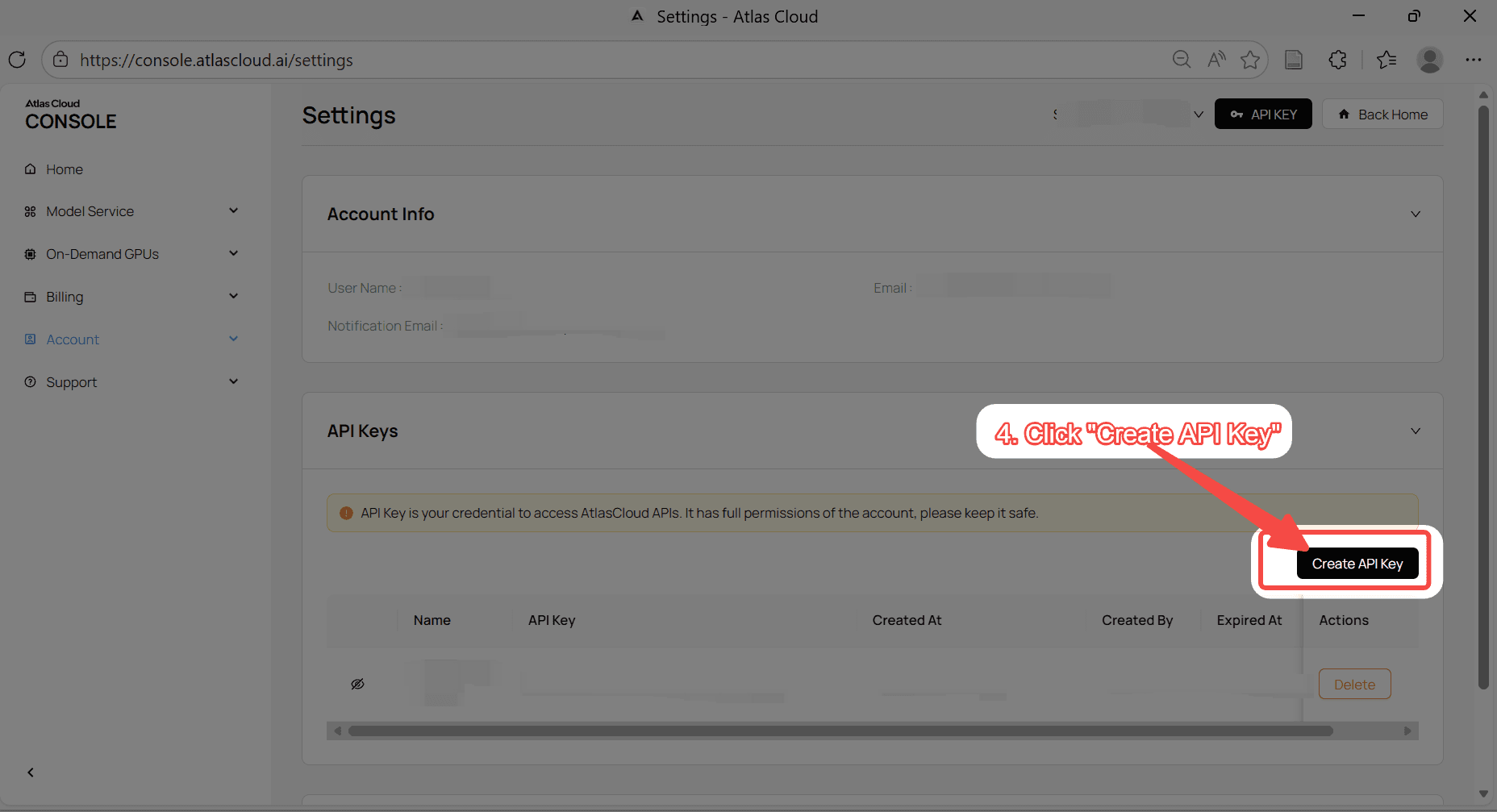

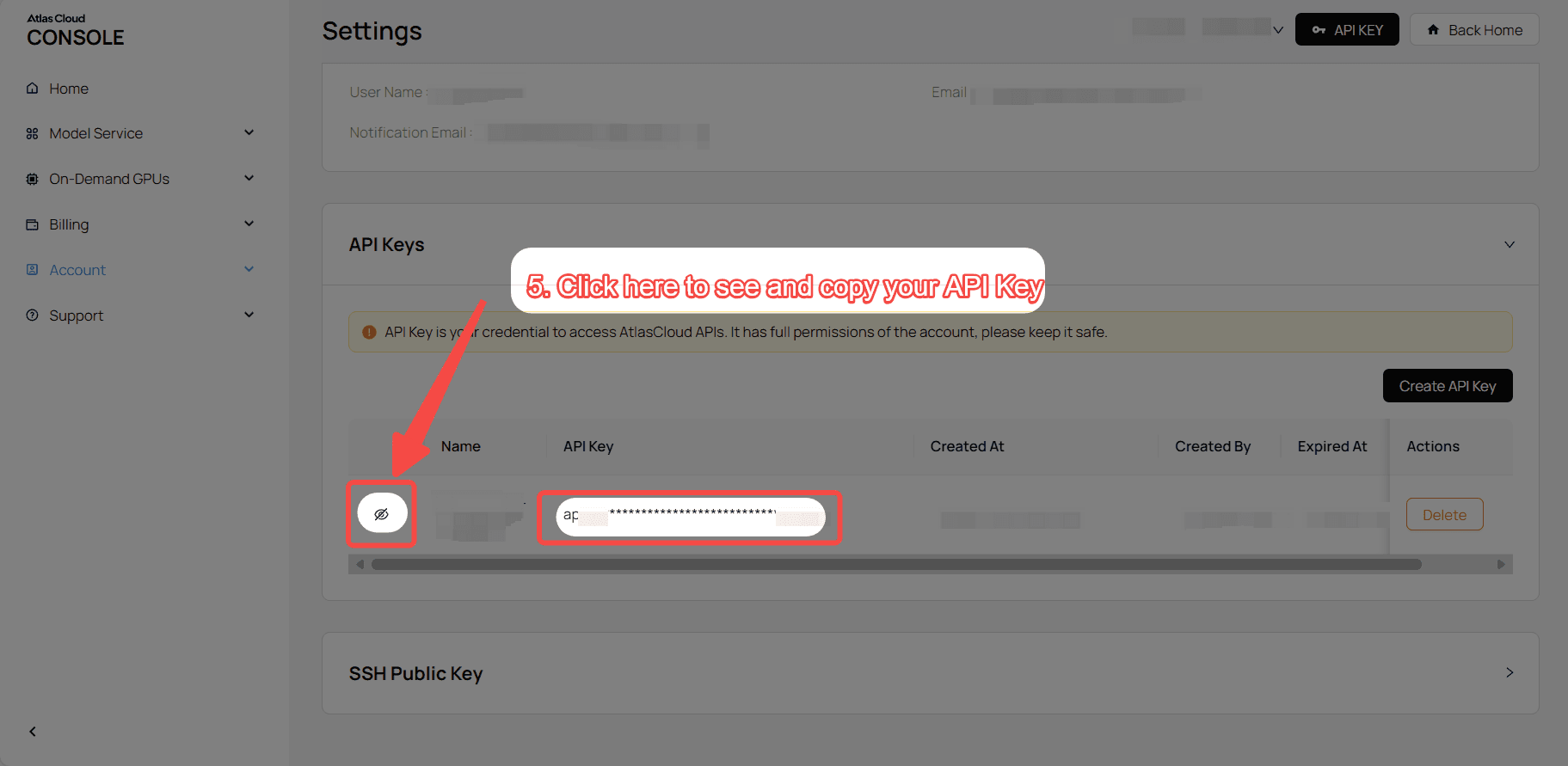

Schritt 1: Holen Sie sich Ihren API-Schlüssel

Erstellen Sie einen API-Schlüssel in Ihrer Konsole und kopieren Sie ihn für die spätere Verwendung.

Schritt 2: Überprüfen Sie die API-Dokumentation

Überprüfen Sie den Endpunkt, die Anfrageparameter und die Authentifizierungsmethode in unserer API-Dokumentation.

Schritt 3: Machen Sie Ihre erste Anfrage (Python-Beispiel)

Beispiel: Generieren eines Videos mit Wan 2.6 (Text-zu-Video).

python1import requests 2import time 3 4# Schritt 1: Videogenerierung starten 5generate_url = "https://api.atlascloud.ai/api/v1/model/generateVideo" 6headers = { 7 "Content-Type": "application/json", 8 "Authorization": "Bearer $ATLASCLOUD_API_KEY" 9} 10data = { 11 "model": "alibaba/wan-2.6/text-to-video", 12 "audio": None, 13 "duration": 15, 14 "enable_prompt_expansion": True, 15 "negative_prompt": "example_value", 16 "prompt": "Ein filmischer Sci-Fi-Trailer. Shot 1: Weitwinkelaufnahme, ein einsamer Entdecker in einem ramponierten Raumanzug, der über eine trostlose rote Marswüste geht, ein riesiges verlassenes Raumschiff in der Ferne. Shot 2: Nahaufnahme, der Entdecker hält an und wischt Staub von seinem Helmvisier, die Augen weiten sich vor Schock. Shot 3: Über-die-Schulter-Aufnahme, die eine leuchtende, biolumineszente blaue Blume enthüllt, die sich schnell vor ihm öffnet. 8k-Auflösung, hochdetailliert, konsistenter Charakter.", 17 "seed": -1, 18 "size": "1920*1080", 19 "shot_type": "multi" 20} 21 22generate_response = requests.post(generate_url, headers=headers, json=data) 23generate_result = generate_response.json() 24prediction_id = generate_result["data"]["id"] 25 26# Schritt 2: Auf Ergebnis warten 27poll_url = f"https://api.atlascloud.ai/api/v1/model/prediction/{prediction_id}" 28 29def check_status(): 30 while True: 31 response = requests.get(poll_url, headers={"Authorization": "Bearer $ATLASCLOUD_API_KEY"}) 32 result = response.json() 33 34 if result["data"]["status"] in ["completed", "succeeded"]: 35 print("Generiertes Video:", result["data"]["outputs"][0]) 36 return result["data"]["outputs"][0] 37 elif result["data"]["status"] == "failed": 38 raise Exception(result["data"]["error"] or "Generierung fehlgeschlagen") 39 else: 40 # Verarbeitung noch nicht abgeschlossen, 2 Sekunden warten 41 time.sleep(2) 42 43video_url = check_status()

FAQ

F: Wie hilft mir Atlas Cloud bei der Wahl zwischen Wan 2.6 und Sora 2? A: Atlas Cloud ermöglicht es Ihnen, denselben Prompt gleichzeitig durch beide Modelle laufen zu lassen. Sie können die Ausgabequalität und die Kosten nebeneinander betrachten, um zu entscheiden, welches Modell den besten Return on Investment (ROI) für Ihren spezifischen Workflow bietet.

F: Was ist der grundlegende Unterschied zwischen den beiden Modellen? A: Die Kernphilosophie unterscheidet sich: Wan 2.6 ist zum "Kreieren" gedacht und fungiert als intuitiver kreativer Partner, der sich auf Charaktere und narrative Leistung konzentriert. Sora 2 ist zum "Produzieren" gedacht und fungiert als hochwertiger Simulator, der sich auf physikalische Genauigkeit, Umgebungs-Konsistenz und präzise filmische Kontrolle konzentriert.

F: Welches Modell behandelt Audio besser? A: Beide unterstützen Audio, aber ihr Fokus unterscheidet sich:

- Wan 2.6: Konzentriert sich auf Narrativ. Es ist hervorragend für natürlich klingende, synchronisierte Dialoge zwischen mehreren Charakteren ohne Roboterklang.

- Sora 2: Konzentriert sich auf Immersion. Es erzeugt hyperrealistische Hintergrund-Soundscapes und Soundeffekte (SFX), die perfekt zur onscreen gezeigten physischen Aktion passen.