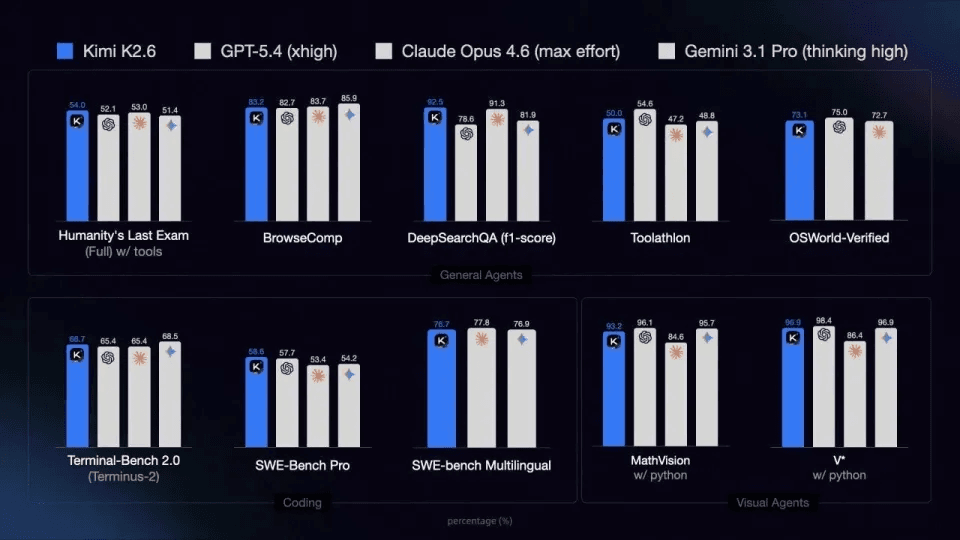

Kimi hat gerade K2.6 veröffentlicht — als Open Source auf HuggingFace, gebenchmarkt gegen GPT-5.4, Claude Opus 4.6 und Gemini 3.1 Pro. Es übertrifft alle drei bei Humanity's Last Exam, DeepSearchQA und SWE-Bench Pro, mit einer um fast 20 % verbesserten Coding-Fähigkeit gegenüber K2.5, 35 % weniger durchschnittlichen Arbeitsschritten und einer Preisgestaltung, die bei 1/8 von Claude Opus 4.6 für Agent-Workloads liegt.

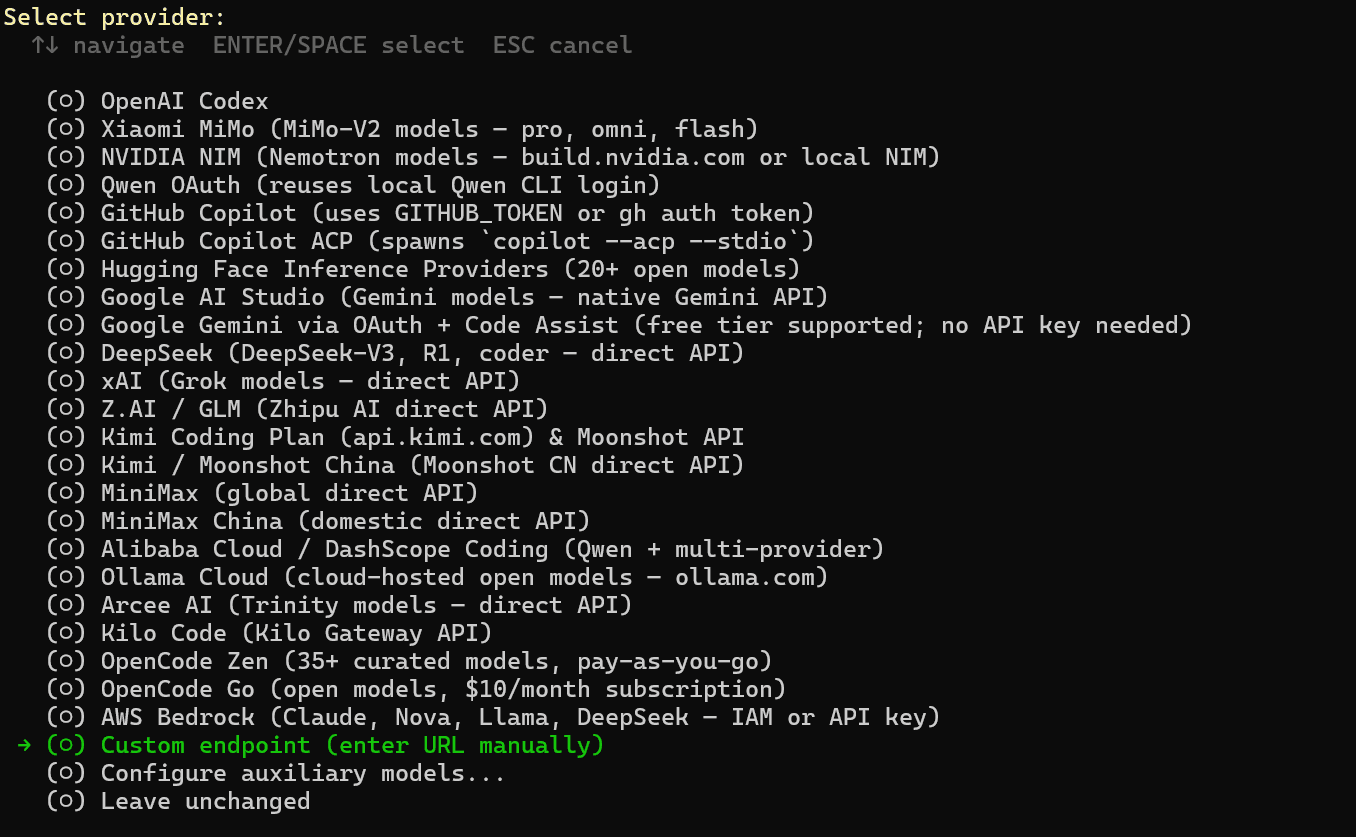

Wenn Sie KI-Agenten betreiben und K2.6 in Ihre bestehende Toolchain integrieren möchten, deckt dieser Leitfaden alle vier großen Frameworks ab — Claude Code, OpenCode, OpenClaw und Hermes Agent — mit einem gemeinsamen API-Endpunkt via atlascloud.ai. Die zweite Hälfte zeigt, was K2.6 in der Praxis leistet, sobald es läuft.

Kurzübersicht

| Tool | Konfigurationspfad | Modellwechsel | Hinweis |

| Claude Code | Umgebungsvariablen ANTHROPIC_* | per Env oder /model | keine |

| OpenCode | ~/.config/opencode/config.json | Feld „model“ bearbeiten | muss @ai-sdk/openai-compatible nutzen |

| OpenClaw | ~/.openclaw/openclaw.json | „primary“ bearbeiten | Gateway muss zuerst gestartet werden |

| Hermes Agent | interaktives Setup | Setup erneut ausführen | Modell-ID-Format muss exakt sein |

Alle Anleitungen in diesem Artikel wurden unter Windows mit WSL2 durchgeführt.

Teil 1 — Einrichtung

-

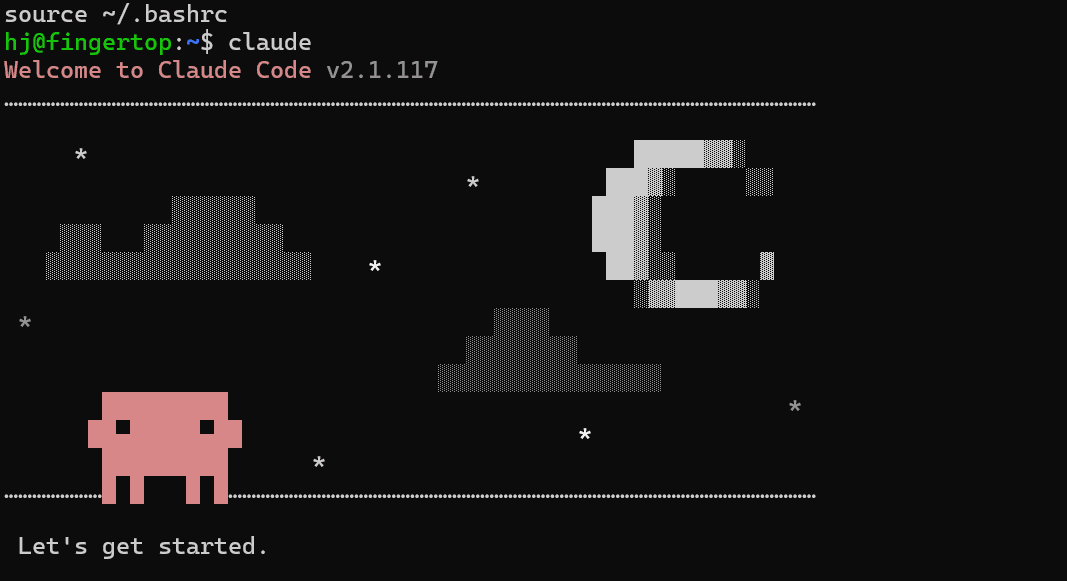

Claude Code (Am einfachsten)

Offizielle Dokumentation zum Download von Claude Code: https://github.com/anthropics/claude-code

Claude Code nutzt nativ das Anthropic-Format. Setzen Sie drei Umgebungsvariablen und Sie sind fertig:

plaintext1# Zur ~/.bashrc oder ~/.zshrc hinzufügen 2export ANTHROPIC_BASE_URL="https://api.atlascloud.ai" 3export ANTHROPIC_AUTH_TOKEN="apikey-xxx" 4export ANTHROPIC_MODEL="moonshot/kimi-k2.6" 5export ANTHROPIC_SMALL_FAST_MODEL="moonshot/kimi-k2.6"

Nach

1source ~/.bashrc1/model2. OpenCode (Konfigurationsdatei)

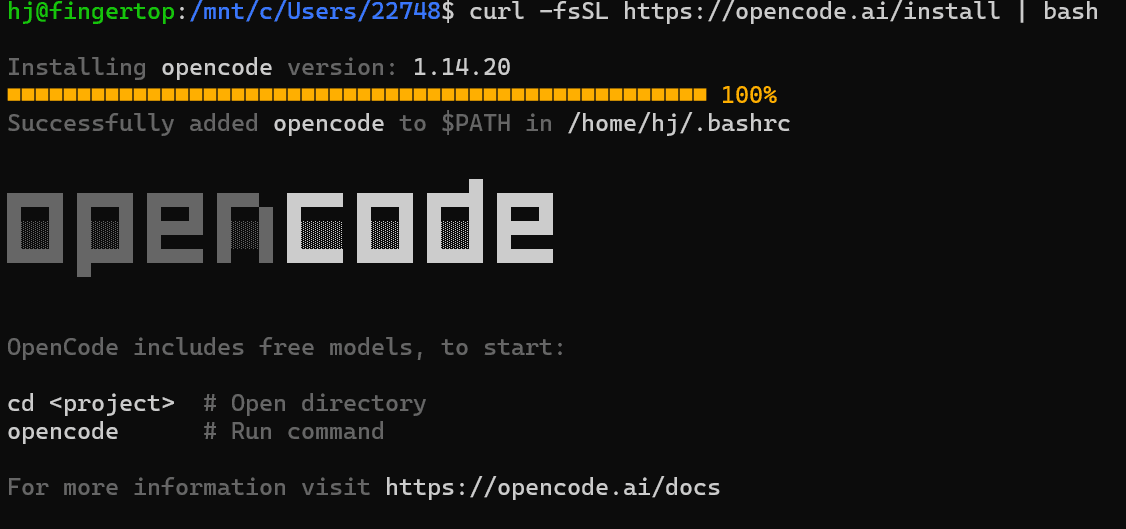

Offizielle Dokumentation zum Download von OpenCode: https://github.com/anomalyco/opencode

OpenCode hat einen integrierten

1openai1openai/1@ai-sdk/openai-compatible1~/.config/opencode/config.jsonplaintext1{ 2 "$schema": "https://opencode.ai/config.json", 3 "provider": { 4 "atlascloud": { 5 "npm": "@ai-sdk/openai-compatible", 6 "name": "AtlasCloud", 7 "options": { 8 "baseURL": "https://api.atlascloud.ai/v1", 9 "apiKey": "apikey-xxx" 10 }, 11 "models": { 12 "moonshot/kimi-k2.6": { "name": "Kimi K2.6" } 13 } 14 } 15 }, 16 "model": "atlascloud/moonshot/kimi-k2.6" 17}

Das Feld

1model1ProviderName/ModellKey

3. OpenClaw (Konfigurationsdatei + zwei Terminals)

OpenClaw läuft als zwei separate Prozesse: ein Gateway und eine TUI. Beide müssen aktiv sein, bevor Sie das Tool nutzen können.

1~/.openclaw/openclaw.jsonplaintext1{ 2 "agents": { 3 "defaults": { 4 "model": { 5 "primary": "custom-api-atlascloud-ai/moonshot/kimi-k2.6" 6 } 7 } 8 }, 9 "models": { 10 "providers": { 11 "custom-api-atlascloud-ai": { 12 "baseUrl": "https://api.atlascloud.ai/v1", 13 "api": "openai-completions", 14 "apiKey": "apikey-xxx", 15 "models": [ 16 { 17 "id": "moonshot/kimi-k2.6", 18 "name": "Kimi K2.6", 19 "api": "openai-completions" 20 } 21 ] 22 } 23 } 24 } 25}

Startreihenfolge:

plaintext1# Terminal 1 2openclaw gateway 3 4# Terminal 2 5openclaw tui

Für die interaktive Rekonfiguration:

1openclaw configureUm das Modell zu wechseln, bearbeiten Sie das Feld

1primary4. Hermes Agent (Interaktives Setup)

Hermes nutzt einen Assistenten anstelle einer Konfigurationsdatei:

plaintext1hermes setup

Füllen Sie die Prompts aus:

- Provider: text

1custom - Endpoint: text

1https://api.atlascloud.ai/v1 - API Key: text

1apikey-xxx - Model: text

1moonshot/kimi-k2.6

Wichtig: Die Modell-ID muss das Präfix

enthalten. Die Eingabe vontext1moonshot/allein führt zu einem 404-Fehler.text1kimi-k2.6

Um das Modell später zu wechseln, führen Sie

1hermes setup

Teil 2 — Was K2.6 wirklich leistet

Claude Code × K2.6 — Was passiert bei 23 gleichzeitigen Agenten?

Was versagt zuerst, wenn man ein KI-System an seine Grenzen bringt?

Ein Entwickler wollte genau das testen — indem er 23 Agenten simultan über Claude Code einen ganzen Tag lang laufen ließ. Über 26 Sitzungen hinweg bewältigte das System hochfrequente Tool-Aufrufe, mehrstufige Pipelines und langwierige Aufgaben wie PRD-Erstellung und SEO-Planung. Mit anderen Worten: ein realistischer "produktionsnaher" Workload, bei dem Systeme normalerweise zu bröckeln beginnen.

Aber diesmal passierte etwas Ungewöhnliches.

Es gab null 429-Rate-Limit-Fehler.

Für jeden, der versucht hat, Agent-Workflows zu skalieren, ist das ein herausragender Punkt. Unter ähnlichen Bedingungen stoßen Modelle wie GLM 5.1 häufig an Ratenbegrenzungen, was erzwungene Wiederholungen, den Abbruch von Pipelines und Instabilität im System zur Folge hat. K2.6 hingegen blieb stabil – nicht, weil es das Schnellste wäre, sondern weil es unter Druck konstant zuverlässig arbeitete.

Und dieser Unterschied ist wichtiger, als es klingt.

Denn sobald man über einfache Prompts zu Multi-Agenten-Systemen übergeht, lautet die eigentliche Herausforderung nicht mehr „kann das Modell gut antworten?“, sondern:

Kann es weiterhin gut antworten – über Dutzende parallele Aufgaben hinweg – ohne das System zu sprengen?

Qualität, die sich nach Planung anfühlt, nicht nur nach Generierung

Der Unterschied lag nicht nur bei der Stabilität. Er zeigte sich auch darin, wie K2.6 komplexe Aufgaben anging.

Als das Modell gebeten wurde, ein PRD (Product Requirements Document) zu schreiben, reagierte es nicht einfach nur — es strukturierte den Problemraum eigenständig. Wettbewerbsanalysen, User Stories, Priorisierung von Funktionen — all dies wurde nicht explizit angefordert, tauchte aber auf, als hätte das System verstanden, wie ein „vollständiges“ PRD auszusehen hat.

Bei SEO-Aufgaben war das Verhalten ähnlich. Statt direkt in Keyword-Vorschläge zu springen, leitete K2.6 zunächst die Suchintention ab und richtete die Content-Strategie entsprechend aus. Das Ergebnis wirkte weniger wie rohe Generierung und eher wie eine strategische Planung in der Frühphase.

Das ist eine subtile, aber wichtige Verschiebung:

Sie erhalten nicht mehr nur Antworten – Sie erhalten organisiertes Denken.

Und in Multi-Agenten-Umgebungen verstärkt sich dieser Effekt. Wenn jeder Agent strukturierte, qualitativ hochwertige Ergebnisse liefert, hat die Koordinierungsebene weit weniger Nacharbeit zu leisten.

Der Kompromiss: Stabilität hat ihren Preis

Allerdings ist diese Leistung nicht umsonst.

K2.6 ist merklich langsamer als GLM 5.1, insbesondere bei der First-Token-Latenz. Die Verzögerung ist nicht marginal – sie liegt etwa eine Größenordnung höher. In einer einzelnen Interaktion mag das tolerierbar sein. Doch in einem System, in dem 23 Agenten parallel laufen, erzeugt jeder Schritt eine kleine Pause, und diese Pausen summieren sich.

Ein Teil davon liegt in seiner Architektur begründet. K2.6 nutzt ein Mixture-of-Experts (MoE)-Design mit rund einer Billion Gesamtparametern und 32 Milliarden aktivierten Parametern pro Inferenz. Dieser Maßstab bringt Leistungsfähigkeit, aber auch Scheduling-Overhead mit sich. Und da es sich noch um eine Vorab-Version handelt, ist es wahrscheinlich, dass die Inferenz-Optimierung noch nicht vollständig ausgeschöpft ist.

Der Kompromiss ist also klar:

- Wenn Sie auf Durchsatz und Geschwindigkeit angewiesen sind, ist das relevant.

- Wenn Sie auf Stabilität und strukturierte Ergebnisse in großem Maßstab setzen, kann es sich lohnen.

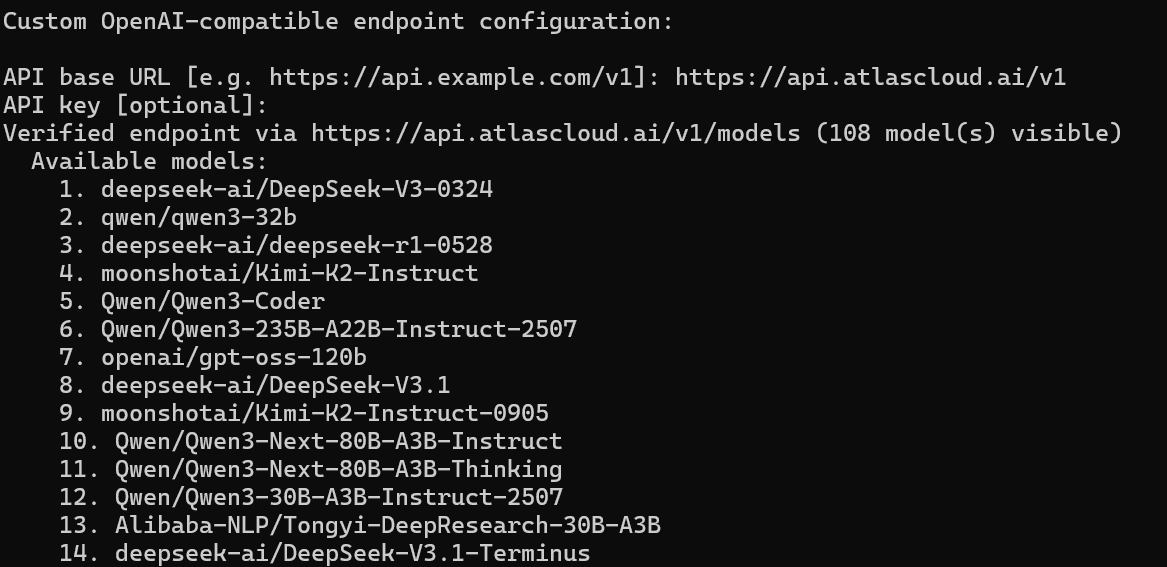

OpenCode × K2.6 — Von einem Prompt zu neun parallelen Arbeitsströmen

Wenn das Claude-Code-Experiment zeigt, wie sich K2.6 unter Druck verhält, offenbart OpenCode etwas anderes: wie es Arbeit organisiert.

K2.6 führt eine Koordinierungsebene namens AgentSwarm ein, bei der ein einzelner „Coordinator“-Agent Dutzende spezialisierter Sub-Agenten spawnen kann, denen jeweils eine spezifische Rolle zugewiesen wird. Anstatt eine Aufgabe Schritt für Schritt in einem einzigen Thread zu bearbeiten, zerlegt das System diese und führt mehrere Prozesse parallel aus.

Um zu sehen, wie das in der Praxis aussieht, betrachten wir dieses Beispiel:

Ein Forscher bat K2.6, ein tiefgehendes Profil von Dario Amodei zu erstellen und seinen Weg vom Physik-Doktoranden in Princeton bis zur Gründung von Anthropic nachzuzeichnen. Statt dies als eine einzelne, umfangreiche Generierungsaufgabe anzugehen, zerlegte K2.6 das Thema in neun parallele Stränge.

Jeder Strang hatte eine eigene Aufgabe. Ein Agent konzentrierte sich rein auf die Recherche und sammelte öffentliche Informationen. Ein anderer übernahm das Layout und formatierte das Material in ein strukturiertes PDF. Ein separater Agent erstellte einen Datensatz der wichtigsten Karriere-Entscheidungspunkte. Währenddessen verfasste ein schreibender Agent ein Ich-Erzählungs-Narrativ mit dem Titel „Dear 2008.“

All das lief zur gleichen Zeit.

Das Ergebnis war nicht nur ein einzelner Output, sondern ein koordiniertes Paket: eine 80-seitige Präsentation, unterstützt durch strukturierte Daten und formatierte Dokumente. Was normalerweise mehrere Tools, Sitzungen und manuelle Zusammenstellungen erfordert hätte, wurde als einheitliches Lieferergebnis produziert.

Warum dies Ihre KI-Nutzung verändert

Der entscheidende Faktor hier ist das Skill-System.

Anstatt jede Aufgabe als frischen Prompt zu behandeln, ermöglicht K2.6 das Laden strukturierten Wissens – wie eines Goldman-Sachs-Berichts, einer Wettbewerbsanalyse oder einer gut geschriebenen Produktspezifikation – und macht daraus einen wiederverwendbaren „Skill“. Wenn ein Sub-Agent läuft, erbt er dieses Framework: den analytischen Stil, den Ton, sogar die Struktur.

Mit der Zeit verwandelt dies Ihr System in etwas grundlegend anderes als einen prompt-basierten Workflow.

Es wird zu einer wiederholbaren Produktions-Pipeline.

Und das führt zu einem Umdenken bei der KI-Nutzung:

Sie geben einem Modell keine Prompts mehr – Sie managen ein Team.

Wenn Sie Agenten-basierte Workflows aufbauen, ist dieser Unterschied schwer zu ignorieren.

Alle vier Tools verbinden sich über

1https://api.atlascloud.ai/v11moonshot/kimi-k2.6FAQ

-

Was ist der Unterschied zwischen der Nutzung von Hermes Agent und dem direkten Aufruf der Kimi K2.6 API?

Der Hauptunterschied liegt in Ausführung vs. Antwort.

Wenn Sie die Kimi K2.6 API direkt aufrufen, erhalten Sie im Grunde nur eine einzige Antwort pro Anfrage. Selbst bei komplexen Aufgaben müssen Sie diese manuell zerlegen, über mehrere Prompts iterieren und die Ergebnisse selbst zusammenfügen. Dies funktioniert gut für einfache oder interaktive Anwendungsfälle, wird aber bei strukturierten Workflows schnell ineffizient.

Hermes ändert dies durch die Einführung von Workflow-Orchestrierung. Anstelle eines einzelnen Prompts definieren Sie eine Pipeline mit mehreren Schritten – Recherche, Planung, Ausführung, etc. – und Hermes weist jeden Schritt einem Agenten zu. Diese Agenten können Ergebnisse untereinander weitergeben, Zwischenergebnisse validieren und Schritte bei Fehlern sogar wiederholen.

In der Praxis bedeutet dies, dass Sie von „Prompt Engineering“ zu Task-Orchestrierung übergehen. Die API wird zu einer Komponente innerhalb eines Systems, anstatt das System selbst zu sein.

-

Ist Kimi K2.6 gut für Multi-Agenten-Workflows und Automatisierung geeignet?

Ja – genau hier zeigt es eine bemerkenswert gute Leistung.

In Multi-Agenten-Setups sind die größten Herausforderungen normalerweise:

- Konsistenz über Schritte hinweg

- Stabilität bei langen Laufzeiten

- Fähigkeit, strukturierten Aufgaben zu folgen

Kimi K2.6 zeigt in allen drei Bereichen eine starke Leistung. Wenn es innerhalb von Hermes verwendet wird, kann es strukturierte Outputs über mehrere Phasen hinweg beibehalten und komplexe Aufgabenketten bewältigen, ohne das Format zu verlieren oder die Richtung vorzugeben.

Ein weiterer wichtiger Aspekt ist die Selbstkorrektur. Wenn ein Zwischenergebnis vom Ziel abweicht, kann das System diesen Schritt neu generieren, anstatt mit fehlerhaften Daten fortzufahren. Das macht es wesentlich besser geeignet für Automatisierungsszenarien, in denen Sie nicht jeden Schritt manuell überwachen möchten.

Insgesamt fühlt es sich eher wie eine zuverlässige Ausführungsebene an als wie ein einfacher Textgenerator.

-

Warum ist Kimi K2.6 in Agenten-Workflows langsamer als andere Modelle?

Die langsamere Geschwindigkeit ist hauptsächlich auf die Art der Nutzung zurückzuführen, nicht nur auf das Modell selbst.

In einem Standard-Chat-Szenario warten Sie nur auf eine Antwort. In einem Agenten-Workflow kann eine einzelne Aufgabe mehrere Schritte umfassen – jeder erfordert einen separaten Modellaufruf sowie den Koordinierungs-Overhead zwischen den Agenten. Das führt naturgemäß in jeder Phase zu Latenz.

Zusätzlich ist Kimi K2.6 mit einer komplexeren Architektur (z. B. MoE-artiges Routing) konzipiert, was den Inferenz-Overhead im Vergleich zu kleineren oder stärker optimierten Modellen erhöhen kann. In Kombination mit Multi-Agenten-Orchestrierung wird die Verzögerung deutlicher spürbar.

Der Kompromiss ist jedoch, dass jeder Schritt hochwertigere, strukturiertere Ergebnisse liefert, was den Bedarf an Wiederholungen oder manuellen Korrekturen reduziert. Während es also bei der reinen Antwortzeit langsamer ist, kann es auf Workflow-Ebene effizienter sein.