La consistencia de personajes en las API de video por IA es la capacidad de mantener la identidad visual de un personaje —rasgos, vestimenta y proporciones— a lo largo de diferentes tomas. Al ir más allá de la "ruleta de prompts" hacia restricciones de API estructuradas como Reference Anchors (Anclajes de Referencia) y Fine-tuned LoRAs (LoRAs ajustados), los creadores ahora pueden producir contenido episódico con un 95% de continuidad visual, reduciendo los costos de producción hasta en un 80%.

Durante años, el fenómeno del "Character Drift" (deriva del personaje) —donde los rasgos faciales o la vestimenta del protagonista cambian de forma inconsistente entre fotogramas— relegó al video por IA al terreno de los memes inquietantes. Esta falta de estabilidad visual fue la barrera principal que impidió que la IA superara los clips cortos para llegar a la narración profesional.

Ahora se define por la persistencia. La industria ha pasado de "probar y rezar" a una producción estructurada. Plataformas centralizadas como Atlas Cloud finalmente han resuelto la "crisis de identidad" al proporcionar una puerta de enlace unificada a API de video por IA de alta consistencia.

| Métrica | Rendimiento 2024 | Rendimiento 2026 |

| Deriva del personaje | Alta (50% de cambio facial) | Mínima (<5% de varianza visual) |

| Configuración de identidad | Prompts manuales | Anclaje de referencia automatizado |

| Modo de renderizado | Fotograma a fotograma | Coherencia temporal con estado |

Al dominar estas API de video por IA, los creadores ya no solo están "escribiendo prompts", sino dirigiendo una nueva era del cine digital. Las siguientes tecnologías han convertido a la IA de un juguete experimental en un motor cinematográfico profesional:

- Atlas Cloud: Una plataforma de API unificada que orquesta modelos de vanguardia (SOTA) como Seedance 2.0 y Kling 3.0, permitiendo a los desarrolladores bloquear identidades de personajes en series completas mediante un único endpoint.

- LTX Studio: Una plataforma integral diseñada específicamente para la consistencia entre tomas y el control narrativo.

- Endpoints personalizados de ComfyUI: Flujos de trabajo modulares que permiten a los creadores integrar identidades de personajes específicas (LoRAs) en el espacio latente.

Cómo las API de 2026 resuelven la coherencia temporal

La transición de clips parpadeantes y "oníricos" a contenido episódico estable es impulsada por un cambio fundamental en cómo las API de video por IA manejan los datos. En 2026, la industria ha superado los simples prompts de texto hacia una arquitectura con "estado" (Stateful) que trata la identidad del personaje como una variable persistente en lugar de una generación aleatoria.

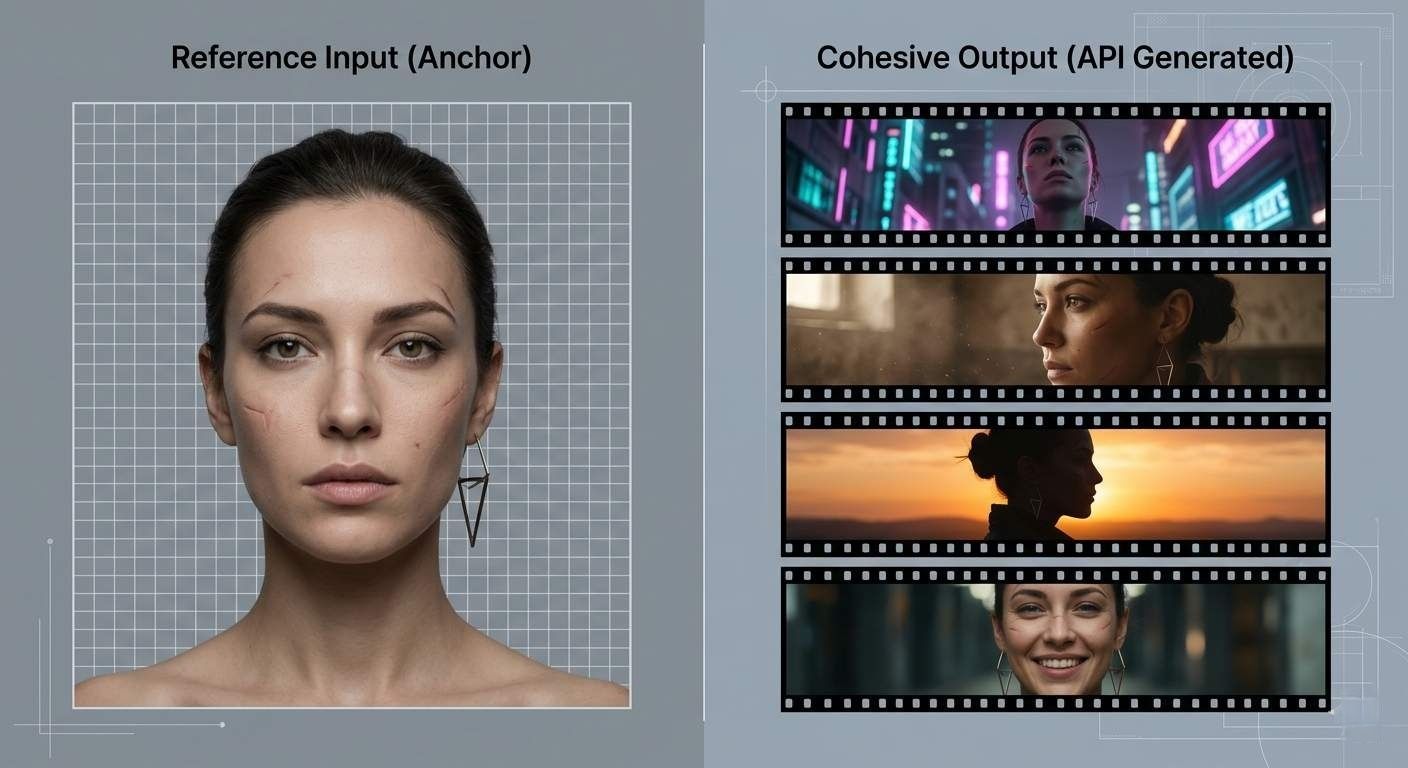

Más allá del prompt: Anclaje de identidad

Las API modernas ahora utilizan el anclaje de identidad para eliminar la deriva del personaje. En lugar de utilizar solo un prompt básico como "hombre barbudo", los desarrolladores ahora emplean una "Identidad Base". Esta es usualmente una foto nítida o un modelo de cabeza en 3D que actúa como una regla estricta. Funciona como un ancla estable. De esta manera, cada fotograma se ve exactamente como el personaje original, manteniendo el rostro y la estructura ósea iguales sin importar la luz o el ángulo de cámara.

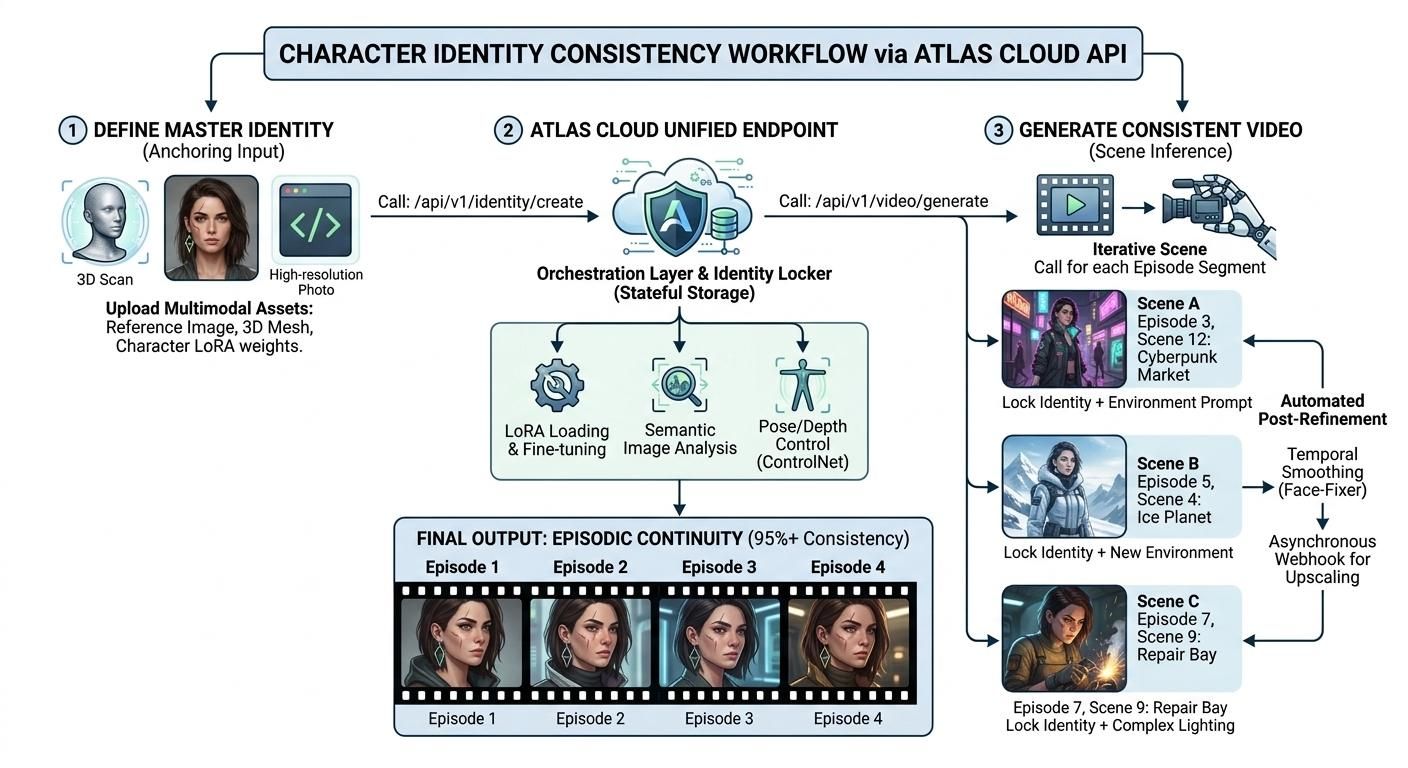

Figura: Image_0.png demuestra cómo un único retrato de referencia neutral (el 'Ancla') fuerza a la API de IA a mantener la misma identidad (nótese la cicatriz y el pendiente únicos) a través de diversas escenas dinámicas, incluyendo cambios de perspectiva, iluminación y entorno.

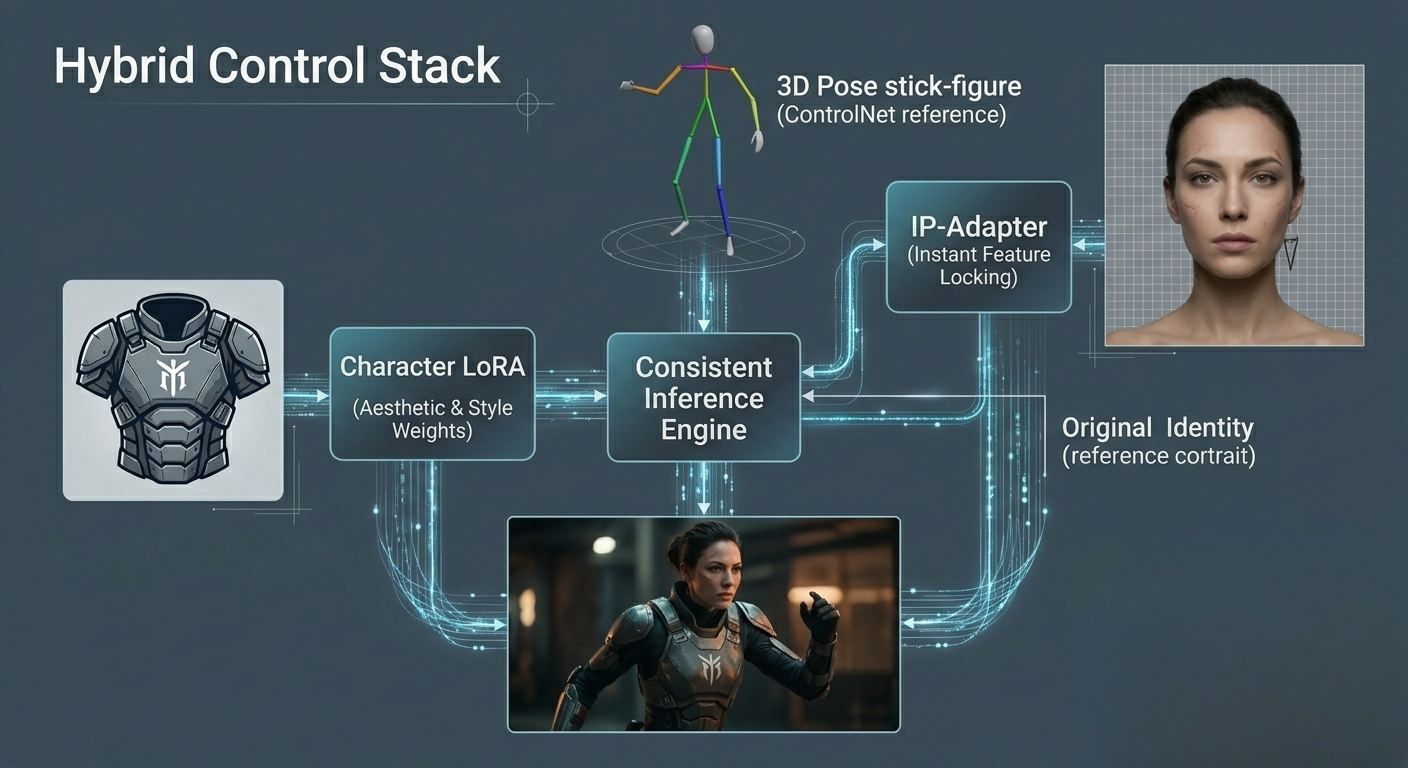

El papel de los LoRA y los IP-Adapters

Para lograr una consistencia de vanguardia, los pipelines técnicos aprovechan dos componentes clave:

- LoRAs (Low-Rank Adaptation): Son capas de peso pequeñas y ajustadas que "bloquean" la estética específica de un personaje, como texturas de piel únicas o patrones de ropa.

- IP-Adapters: A diferencia de los LoRA, que requieren entrenamiento, los IP-Adapters permiten la inyección instantánea de identidad "zero-shot".

Los flujos de trabajo profesionales más estables utilizan ahora una "pila híbrida":

| Componente | Función técnica | Consistencia objetivo |

| LoRA de identidad | Forma corporal general y vibra | 70% |

| PuLID / IP-Adapter | Bloqueo preciso de rasgos faciales | 90% |

| ControlNet | Regulación espacial y de pose | 95%+ |

image_1.png ilustra visualmente cómo se aplican múltiples restricciones. Vemos el control espacial (ControlNet/Pose), los rasgos específicos del personaje (IP-Adapter referenciando la imagen) y los pesos estéticos especializados (LoRA para la armadura) combinándose para generar un personaje consistente en un nuevo contexto.

Trayectorias de semilla y bloqueo del espacio latente

Un avance técnico de alto valor es el uso del bloqueo del espacio latente. Toda generación de IA comienza con una "semilla" (ruido aleatorio). Al mantener el patrón de ruido o "trayectoria de semilla" consistente entre fotogramas, las API evitan transiciones donde el rostro se "derrite". Este método asegura que la matemática detrás de los píxeles evolucione suavemente, permitiendo que los personajes se muevan a través de entornos complejos sin perder su integridad visual.

Al combinar estos tres elementos, los creadores finalmente pueden hacer programas donde el protagonista se ve igual en cada episodio. El rostro permanece perfectamente consistente desde la primera escena hasta el final de la temporada.

Image_2.png ofrece una comparación lado a lado. La línea de tiempo superior (ruido estándar) muestra cómo el rostro del personaje de image_0.png se "derrite": rasgos, expresiones e incluso la identidad cambian. La línea de tiempo inferior (ruido bloqueado) muestra el rostro permaneciendo casi 95% idéntico, mostrando solo una evolución natural (como un giro de cabeza) gracias a las restricciones matemáticas aplicadas por la API.

Revolucionando el pipeline de producción episódica

La integración de API de video por IA con consistencia de personajes ha cambiado fundamentalmente el panorama económico de los medios episódicos. La gran ventaja aquí ya no es solo la "velocidad". Se trata de permitir que cualquier persona cree historias de alta calidad. Estas herramientas se encargan del trabajo difícil de mantener los visuales uniformes. Esto permite a creadores pequeños y estudios diminutos producir trabajos que lucen tan bien como las grandes producciones de Hollywood.

El nuevo paradigma de producción

Históricamente, crear un personaje consistente para una serie animada requería una inversión inicial masiva en modelado 3D, rigging y mapeo de texturas. Si el diseño de un personaje cambiaba a mitad de temporada, la "deuda técnica" podía descarrilar toda la producción.

Los flujos de trabajo de IA modernos reemplazan estos activos rígidos con pesos dinámicos y ajustados. Los equipos de producción que utilizan pipelines nativos de IA han reportado una reducción del 70-90% en los costos generales.

Benchmark de eficiencia: Tradicional vs. Nativo de IA

La siguiente tabla ilustra la disrupción en los indicadores clave de rendimiento para un episodio estándar de 22 minutos:

| Característica | Animación/CGI tradicional | Workflow de API de video por IA |

| Configuración de personaje | Meses de modelado/rigging | 2–4 horas de entrenamiento de LoRA |

| Costo por episodio | $100,000 – $1M+ | $500 – $5,000 |

| Velocidad de iteración | Semanas (tiempo de renderizado) | Minutos (tiempo de inferencia) |

| Consistencia | Perfecta (codificada a mano) | Alta (limitada por API al 95%+) |

Aunque los métodos tradicionales aún mantienen la ventaja para la precisión perfecta a nivel de píxel, el modelo de Inferencia sobre Renderizado permite a los creadores generar borradores en minutos. Esta "compresión temporal" permite a los estudios publicar un 42% más de contenido mensualmente, transformando el contenido episódico de un lujo de movimiento lento a un medio ágil y receptivo.

Caso de estudio: El auge de las "Micro-Series" y los influencers virtuales

Estamos pasando de clips aleatorios a historias reales, y esto ha creado una nueva tendencia: la "Micro-Serie" de IA. Mediante el uso de herramientas de video inteligentes que mantienen a los personajes iguales, las personas están creando programas que lucen tan bien como las caricaturas regulares. La mejor parte es que requiere mucho menos tiempo y cuesta mucho menos dinero.

La revolución indie: 20 episodios en 20 días

Los creadores independientes en plataformas como TikTok y YouTube Shorts ya no están limitados por la "deriva de identidad" que antes plagaba el metraje generado por IA. Al usar plataformas unificadas como Atlas Cloud para orquestar modelos como Seedance 2.0 o Kling 3.0, un solo creador puede definir una "ID de personaje" una vez y reutilizarla en toda una temporada.

Este salto técnico ha permitido el auge de la narración serializada donde:

- Velocidad de producción: Los creadores lanzan micro-series de 20 episodios en semanas, en lugar de los 12-18 meses requeridos para el CGI tradicional.

- Engagement: Los influencers virtuales ahora capturan una cuota de mercado del 4.2% con tasas de interacción que promedian el 5.67%, casi el triple que sus contrapartes humanas.

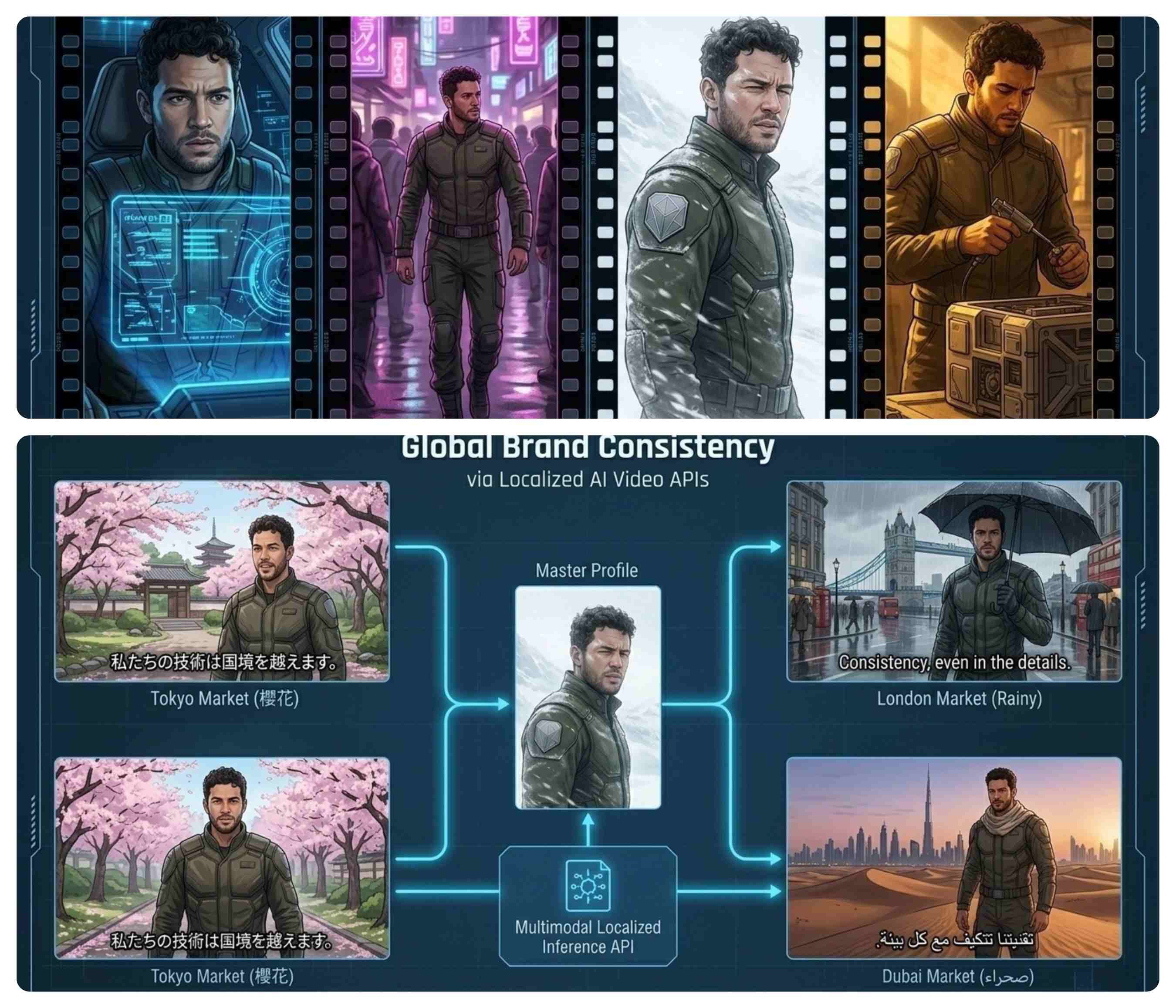

Consistencia de marca global y portavoces de IA

Para las empresas globales, la "crisis de identidad" fue alguna vez un riesgo para la seguridad de la marca. Hoy, las compañías utilizan API de video por IA para mantener un "Portavoz Virtual" consistente en diversos mercados. Al invocar un embedding de personaje centralizado a través de una API, una marca puede generar contenido localizado donde el portavoz permanece visualmente idéntico mientras habla diferentes idiomas o aparece en entornos culturalmente específicos.

| Beneficio | Impacto en marcas globales |

| Fidelidad visual | La identidad permanece 95%+ idéntica en todas las regiones. |

| Localización | Lip-sync y traducción de idiomas en tiempo real mediante llamadas a API localizadas. |

| Gestión de riesgos | 0% riesgo de controversia en comparación con embajadores celebridades humanos. |

Tendencias de crecimiento del mercado

El impacto económico de esta consistencia es asombroso. Los datos de la industria destacan un cambio fundamental en el gasto de las marcas hacia estos activos digitales persistentes:

- Tamaño del mercado: El mercado de influencers virtuales alcanzó los $4.6 mil millones a principios de 2026.

- Eficiencia: Los costos de producción por publicación para personajes consistentes mediante IA son 38% menores que aquellos que involucran influencers humanos.

- Adopción: El 92% de las marcas están ahora utilizando o probando activamente flujos de trabajo de IA para marketing episódico.

Al tratar la identidad del personaje como un activo digital escalable, las API de video por IA han ido más allá de la fase de "juguete", convirtiéndose en la columna vertebral de una nueva y altamente eficiente economía episódica.

Cómo hacer que su flujo de trabajo sea consistente

Pasar de jugar con clips de IA a hacer programas reales requiere un nuevo plan. Necesita un flujo de trabajo organizado y fácil de escalar. El estándar de la industria se ha movido hacia arquitecturas de "Acceso de una sola llave" que utilizan entradas multimodales para anclar la identidad visual. Al aprovechar las API de video por IA unificadas, los creadores pueden mantener la continuidad del personaje en diversas escenas sin necesidad de edición manual fotograma a fotograma.

Paso 1: Definir la Identidad Maestra

La base de cualquier serie consistente es la Identidad Maestra. En lugar de solo escribir descripciones de texto, los creadores ahora usan una combinación de archivos. Por lo general, toman una foto de referencia nítida y la combinan con un mapa 3D o un LoRA de personaje. Este "Ancla de Identidad" mantiene las cosas estables. Asegura que el rostro, pequeñas cicatrices o incluso los patrones de la camisa permanezcan exactamente iguales en cada toma.

Paso 2: Orquestar mediante Atlas Cloud

En lugar de hacer malabares con claves de API separadas y formatos de datos incompatibles para diferentes modelos, los pipelines profesionales ahora utilizan la API unificada de Atlas Cloud. Esta capa de orquestación permite el intercambio fluido de modelos mientras se mantiene el mismo código base principal.

Por ejemplo, un creador puede invocar el sistema de "Referencia Universal" de Seedance 2.0 a través de Atlas Cloud para bloquear los rasgos del personaje para una secuencia de acción compleja de 15 segundos. Si una toma específica requiere el movimiento fluido superior de Kling 3.0 o la iluminación cinematográfica fotorrealista de Veo 3.1, el desarrollador puede simplemente alternar el parámetro del modelo dentro del entorno de Atlas Cloud.

| Etapa del workflow | Herramienta | Ventaja clave |

| Intercambio de modelos | Kling 3.0 ↔ Veo 3.1 | Rendimiento optimizado por tipo de toma |

| Bloqueo de identidad | Seedance 2.0 Ref | Persistencia facial y de vestimenta |

| Integración | SDK de Atlas Cloud | Endpoint unificado; sin claves fragmentadas |

Ejemplo de código seedance-2.0 image-to-video:

python1import requests 2import time 3 4# Paso 1: Iniciar la generación de video 5generate_url = "https://api.atlascloud.ai/api/v1/model/generateVideo" 6headers = { 7 "Content-Type": "application/json", 8 "Authorization": "Bearer $ATLASCLOUD_API_KEY" 9} 10data = { 11 "model": "bytedance/seedance-2.0/image-to-video", 12 "prompt": "Una nave futurista suave flota lentamente alrededor de un planeta masivo. Se pueden ver las nubes brillantes y el aire resplandeciente del planeta desde el espacio. El fondo está lleno de estrellas y nubes de gas coloridas. La nave se mueve constantemente a lo largo de su camino, pareciendo una gran escena de película de ciencia ficción. La iluminación se siente profunda y real mientras la cámara sigue a la nave.", 13 "image": "https://static.atlascloud.ai/media/images/454eee7f1a05a0bf276afe2e056200ba.png", 14 "duration": 5, 15 "resolution": "720p", 16 "ratio": "adaptive", 17 "generate_audio": True, 18 "watermark": False, 19} 20 21generate_response = requests.post(generate_url, headers=headers, json=data) 22generate_result = generate_response.json() 23prediction_id = generate_result["data"]["id"] 24 25# Paso 2: Consultar resultado 26poll_url = f"https://api.atlascloud.ai/api/v1/model/prediction/{prediction_id}" 27 28def check_status(): 29 while True: 30 response = requests.get(poll_url, headers={"Authorization": "Bearer $ATLASCLOUD_API_KEY"}) 31 result = response.json() 32 33 if result["data"]["status"] in ["completed", "succeeded"]: 34 print("Video generado:", result["data"]["outputs"][0]) 35 return result["data"]["outputs"][0] 36 elif result["data"]["status"] == "failed": 37 raise Exception(result["data"]["error"] or "La generación falló") 38 else: 39 time.sleep(2) 40 41video_url = check_status()

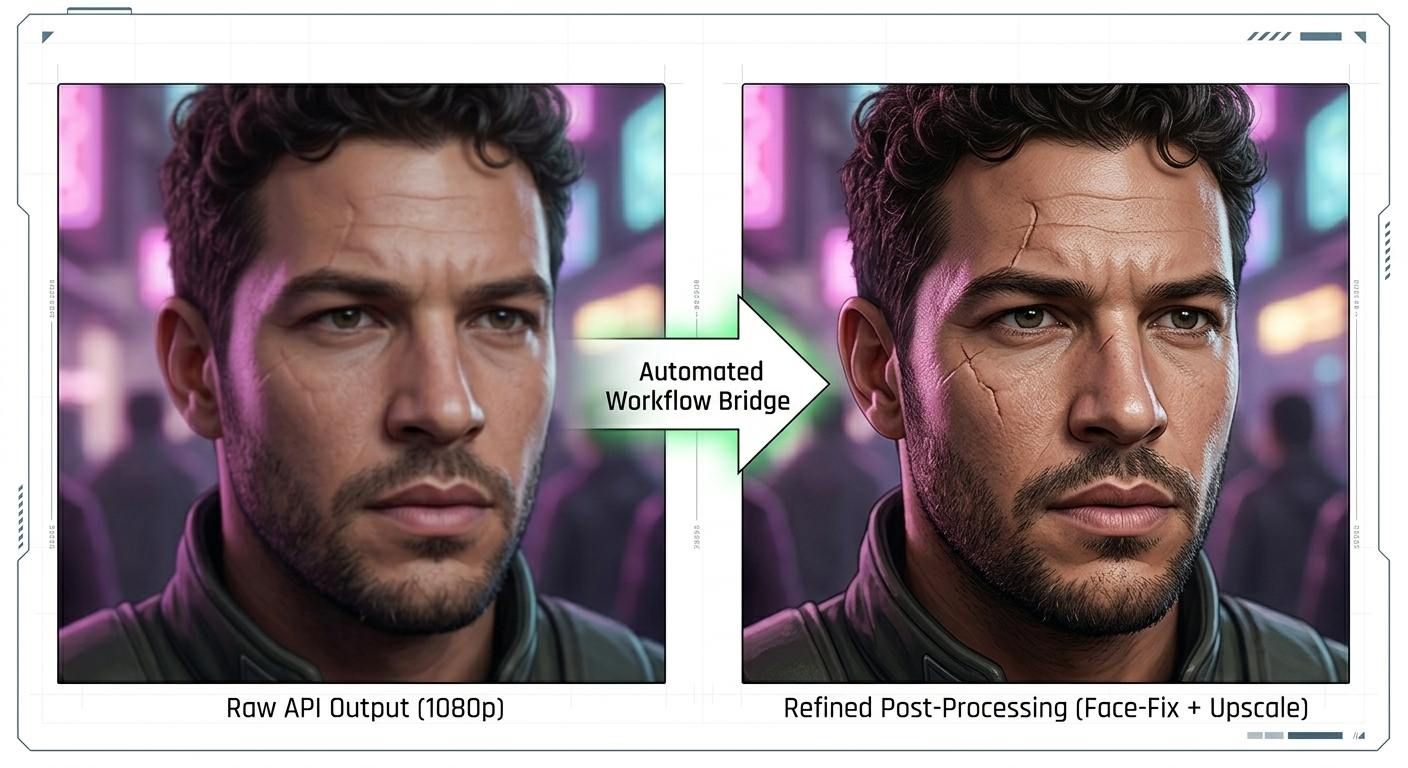

Paso 3: Refinamiento posterior a la generación

Para lograr una calidad "4K lista para emisión", la etapa final implica un puente de posprocesamiento automatizado. Usando la arquitectura de webhooks asíncronos de Atlas Cloud, el sistema puede activar automáticamente tareas de mejora externas en el momento en que un renderizado a 1080p esté completo.

Las tareas de posprocesamiento automatizadas comunes incluyen:

- Suavizado temporal: Eliminar micro-fluctuaciones en los rasgos del personaje.

- Upscaling 4K externo: Pasar la salida de la API de 1080p a través de un modelo de superresolución especializado.

- Sincronización audiovisual: Usar la integración Vidu Q3 para temporizar automáticamente los efectos de sonido con las acciones del personaje.

Al utilizar este proceso de tres pasos con las API, los equipos pueden manejar automáticamente el 85% del trabajo visual. Esto permite crear programas de alta calidad en pocos minutos mientras todo mantiene una apariencia consistente.

Perspectivas a futuro: ¿El fin del "Valle Inquietante"?

Hacia finales de 2026, la evolución de las API de video por IA se está moviendo más allá del contenido episódico pre-renderizado hacia un paradigma de "Identidad en Vivo". Las barreras técnicas que alguna vez crearon el "valle inquietante" —micro-tartamudeos e inconsistencias en la iluminación— están siendo erosionadas por el renderizado neuronal en tiempo real.

El cambio hacia video consistente en tiempo real

La próxima frontera es la transición de la generación estática a los Avatares de IA en Vivo. Es probable que las versiones futuras de estas herramientas funcionen en menos de 100ms. Esto significa que los personajes pueden verse iguales mientras chatean contigo en tiempo real. Cambiará la forma en que contamos historias. Las personas podrán hablar con los personajes durante transmisiones en vivo o elegir sus propios caminos en un programa. Incluso cuando la historia cambie según lo que hagas, el personaje seguirá luciendo perfecto.

La capa ética: Protegiendo los derechos de identidad

Con la capacidad de replicar perfectamente a un personaje —o a una persona— surge un desafío legal significativo. La industria está desarrollando marcos de "Derechos de Identidad" para prevenir la clonación digital no autorizada. En 2026, estamos viendo el surgimiento de:

- Verificación de identidad en cadena (On-Chain): Uso de blockchain para "firmar" el perfil de peso único de un personaje.

- Estándares de marca de agua: Marca de agua obligatoria al estilo SynthID para todas las identidades generadas por API para distinguir entre actores humanos y sintéticos.

Preguntas frecuentes

¿Qué es la consistencia de personaje en el video por IA?

La consistencia de personaje significa que un modelo de IA puede mantener a un sujeto con el mismo aspecto. Asegura que el rostro, el cabello y la ropa se mantengan iguales a través de diferentes ángulos y configuraciones. En la producción real de un programa, esto es lo que convierte a un montón de clips aleatorios en una historia sólida y conectada.

¿Qué API de video por IA soportan la consistencia de personajes?

Aunque muchos modelos están entrando al mercado, los líderes actuales que proporcionan controles de consistencia robustos vía API incluyen:

- LTX-Studio: Enfocado en el bloqueo de personajes cinematográfico de "escena a escena".

- Magic Hour: Una opción popular para creadores enfocados en la animación consistente de personajes y el intercambio de rostros (face-swapping).

- Atlas Cloud: Una plataforma unificada que orquesta múltiples modelos a través de un único endpoint centrado en la consistencia.

¿Puedo usar mi propio rostro para la consistencia de personajes?

Sí. A través de funciones de "Character Cameo" e IP-Adapters, puedes subir un retrato de referencia tuyo. La API extrae tus "pesos latentes faciales" y los aplica al protagonista digital, asegurando que sigas siendo el protagonista consistente durante todo el episodio.