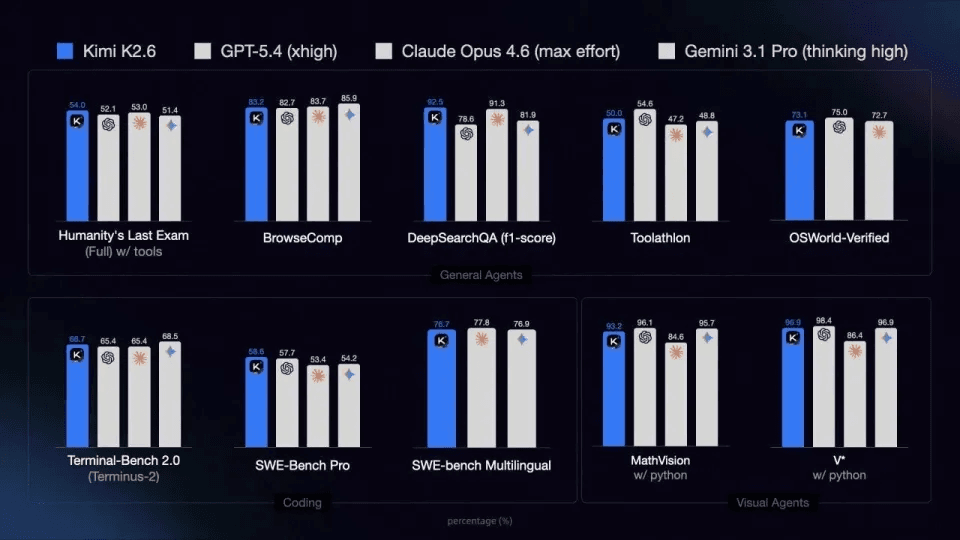

Kimi acaba de lanzar K2.6, con código abierto en HuggingFace y comparado frente a GPT-5.4, Claude Opus 4.6 y Gemini 3.1 Pro. Supera a los tres en Humanity's Last Exam, DeepSearchQA y SWE-Bench Pro, con una capacidad de codificación casi un 20% superior a K2.5, una reducción del 35% en el promedio de pasos por tarea y un precio de 1/8 del de Claude Opus 4.6 para cargas de trabajo de Agentes.

Si estás ejecutando Agentes de IA y quieres integrar K2.6 en tu cadena de herramientas actual, esta guía cubre los cuatro marcos principales —Claude Code, OpenCode, OpenClaw y Hermes Agent— utilizando un único punto de acceso API compartido a través de atlascloud.ai. La segunda mitad muestra lo que K2.6 hace realmente una vez que está en funcionamiento.

Referencia Rápida

| Herramienta | Ubicación de Configuración | Cambiar Modelo | Observación |

| Claude Code | variables de entorno ANTHROPIC_* | cambiar env o /model | ninguna |

| OpenCode | ~/.config/opencode/config.json | editar campo model | requiere @ai-sdk/openai-compatible |

| OpenClaw | ~/.openclaw/openclaw.json | editar primary | requiere iniciar gateway primero |

| Hermes Agent | configuración interactiva hermes | reejecutar setup | formato de ID de modelo debe ser exacto |

Todos los tutoriales de este artículo se completaron en Windows usando WSL2.

Parte 1 — Configuración

-

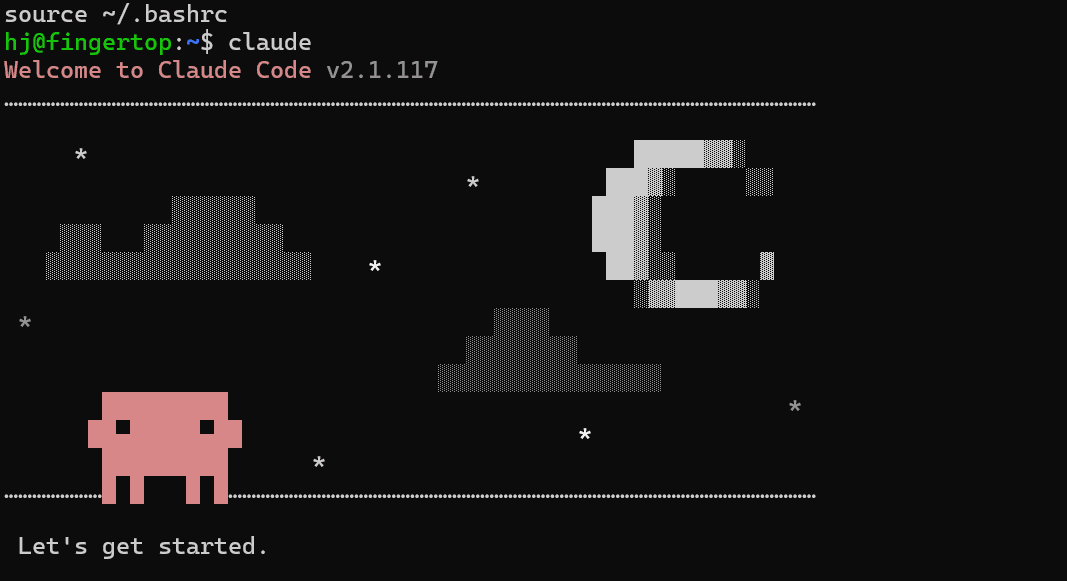

Claude Code (La más sencilla)

Documentación oficial de descarga de Claude Code: https://github.com/anthropics/claude-code

Claude Code utiliza de forma nativa el formato de Anthropic. Define tres variables de entorno y listo:

plaintext1# Añadir a ~/.bashrc o ~/.zshrc 2export ANTHROPIC_BASE_URL="https://api.atlascloud.ai" 3export ANTHROPIC_AUTH_TOKEN="apikey-xxx" 4export ANTHROPIC_MODEL="moonshot/kimi-k2.6" 5export ANTHROPIC_SMALL_FAST_MODEL="moonshot/kimi-k2.6"

Después de

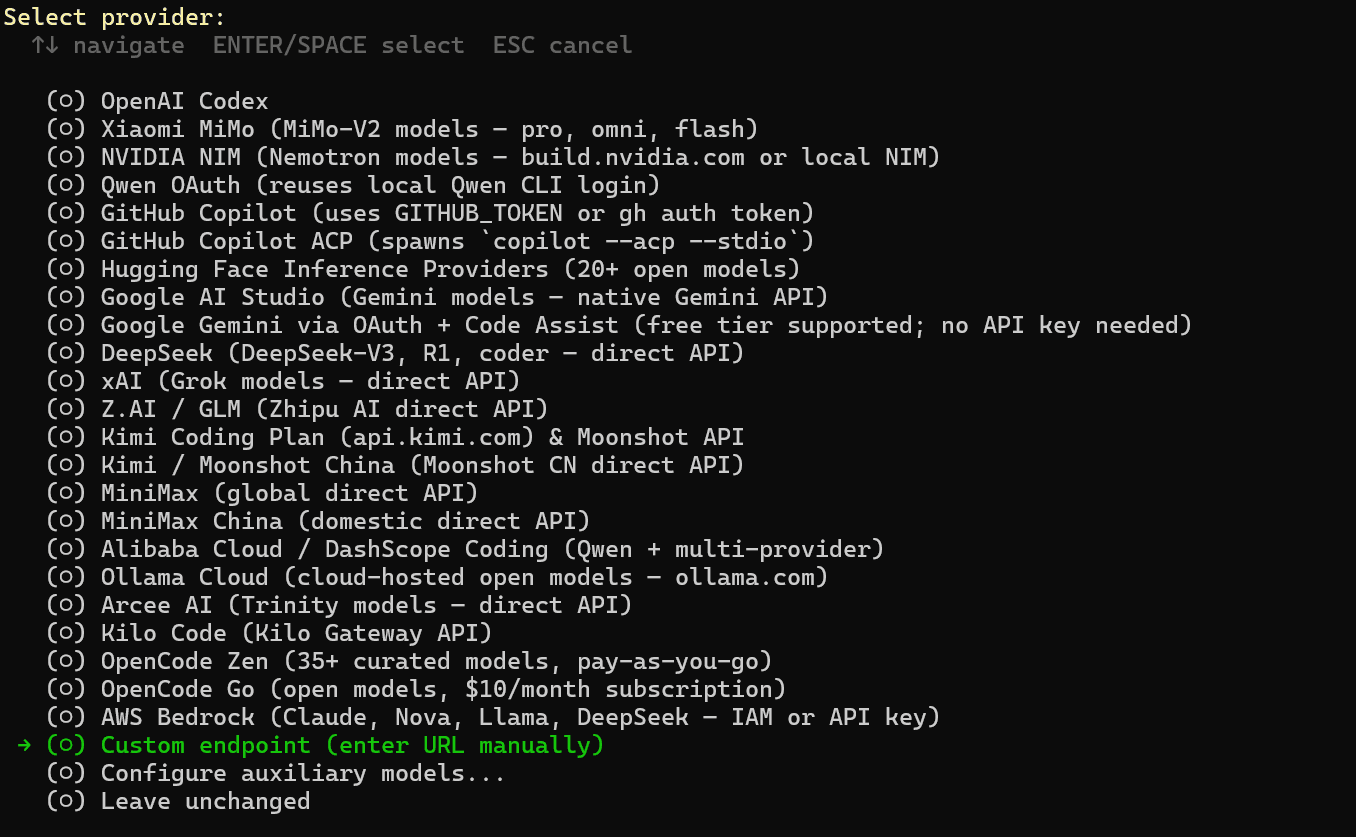

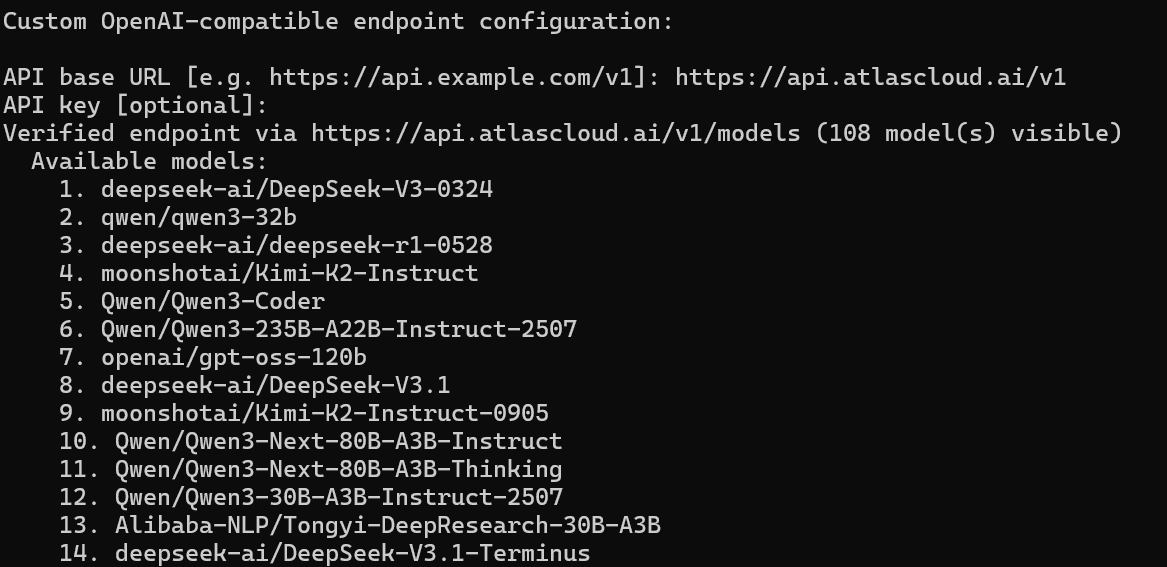

1source ~/.bashrc1/model2. OpenCode (Archivo de configuración)

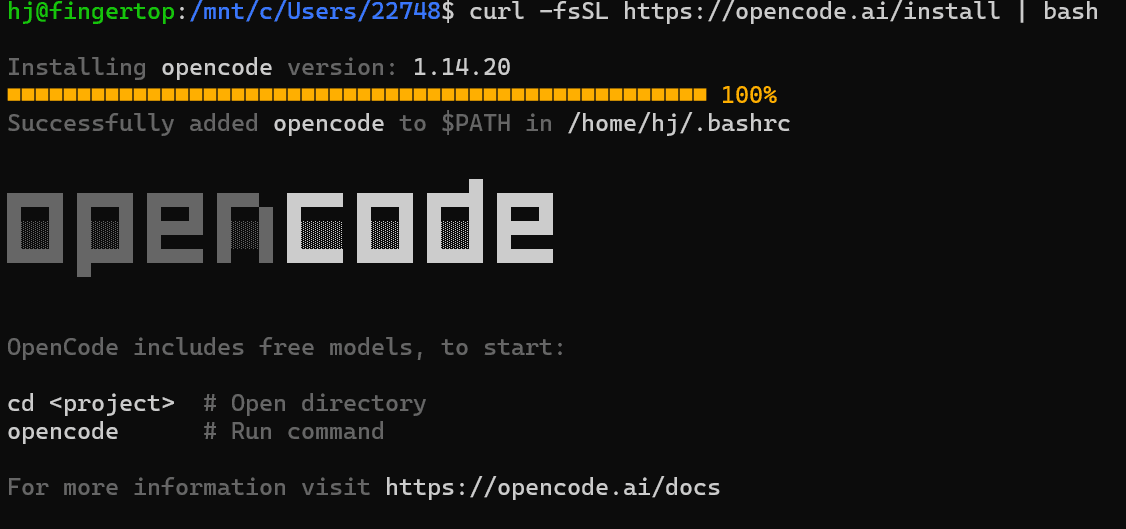

Documentación oficial de descarga de OpenCode: https://github.com/anomalyco/opencode

OpenCode tiene un proveedor

1openai1openai/1@ai-sdk/openai-compatible1~/.config/opencode/config.jsonjson

plaintext1{ 2 "$schema": "https://opencode.ai/config.json", 3 "provider": { 4 "atlascloud": { 5 "npm": "@ai-sdk/openai-compatible", 6 "name": "AtlasCloud", 7 "options": { 8 "baseURL": "https://api.atlascloud.ai/v1", 9 "apiKey": "apikey-xxx" 10 }, 11 "models": { 12 "moonshot/kimi-k2.6": { "name": "Kimi K2.6" } 13 } 14 } 15 }, 16 "model": "atlascloud/moonshot/kimi-k2.6" 17}

El campo

1model1providerName/modelKey

3. OpenClaw (Archivo de configuración + Dos Terminales)

OpenClaw se ejecuta como dos procesos separados: una puerta de enlace (gateway) y una TUI. Ambos deben estar activos antes de poder usarlo.

1~/.openclaw/openclaw.jsonjson

plaintext1{ 2 "agents": { 3 "defaults": { 4 "model": { 5 "primary": "custom-api-atlascloud-ai/moonshot/kimi-k2.6" 6 } 7 } 8 }, 9 "models": { 10 "providers": { 11 "custom-api-atlascloud-ai": { 12 "baseUrl": "https://api.atlascloud.ai/v1", 13 "api": "openai-completions", 14 "apiKey": "apikey-xxx", 15 "models": [ 16 { 17 "id": "moonshot/kimi-k2.6", 18 "name": "Kimi K2.6", 19 "api": "openai-completions" 20 } 21 ] 22 } 23 } 24 } 25}

Orden de inicio:

bash

plaintext1# Terminal 1 2openclaw gateway 3 4# Terminal 2 5openclaw tui

Para una reconfiguración interactiva:

1openclaw configurePara cambiar de modelo, edita el campo

1primary4. Hermes Agent (Configuración interactiva)

Hermes utiliza un asistente en lugar de un archivo de configuración:

bash

plaintext1hermes setup

Completa las indicaciones:

- Provider: text

1custom - Endpoint: text

1https://api.atlascloud.ai/v1 - API Key: text

1apikey-xxx - Model: text

1moonshot/kimi-k2.6

Importante: El ID del modelo debe incluir el prefijo

. Ingresartext1moonshot/por sí solo devolverá un 404.text1kimi-k2.6

Para cambiar de modelo más tarde, vuelve a ejecutar

1hermes setup

Parte 2 — ¿Qué hace K2.6 realmente?

Claude Code × K2.6 — ¿Qué sucede cuando se ejecutan 23 agentes a la vez?

¿Qué es lo que realmente falla primero cuando llevas un sistema de IA al límite?

Un desarrollador decidió ponerlo a prueba exactamente así: ejecutando 23 agentes simultáneamente a través de Claude Code durante todo un día. A través de 26 sesiones, el sistema manejó llamadas a herramientas de alta frecuencia, tuberías de pasos múltiples y tareas de cadena larga como la escritura de PRD y la planificación SEO. En otras palabras, una carga de trabajo realista "tipo producción" donde las cosas suelen empezar a fallar.

Pero esta vez, ocurrió algo inusual.

Hubo cero errores 429 de límite de tasa.

Para cualquiera que haya intentado escalar flujos de trabajo de agentes, esta es la parte que destaca. En condiciones similares, modelos como GLM 5.1 tienden a alcanzar límites de tasa con frecuencia, forzando reintentos, rompiendo tuberías e introduciendo inestabilidad en el sistema. K2.6, por el contrario, se mantuvo estable; no por ser el más rápido, sino por ser consistentemente fiable bajo presión.

Y esa distinción importa más de lo que parece.

Porque una vez que vas más allá de las instrucciones únicas hacia sistemas multi-agente, el verdadero desafío ya no es "¿puede el modelo responder bien?", sino:

¿Puede seguir respondiendo bien —a través de docenas de tareas paralelas— sin romper el sistema?

Una calidad que se siente como planificación, no solo generación

La diferencia no solo radicaba en la estabilidad. También se reflejó en cómo K2.6 manejó tareas complejas.

Cuando se le pidió que redactara un PRD, el modelo no solo respondió; estructuró el espacio del problema por sí mismo. Análisis competitivo, historias de usuario, priorización de características; nada de esto se solicitó explícitamente, pero aparecieron como si el sistema entendiera cómo debería verse un PRD "completo".

En las tareas de SEO, el comportamiento fue similar. En lugar de pasar directamente a sugerencias de palabras clave, K2.6 primero infirió la intención de búsqueda y luego alineó la dirección del contenido en consecuencia. La salida se sintió menos como una generación cruda y más como una planificación estratégica inicial.

Este es un cambio sutil, pero importante:

Ya no solo recibes respuestas, recibes pensamiento organizado.

Y en entornos multi-agente, eso se multiplica. Cuando cada agente produce resultados estructurados y de alta calidad, la capa de coordinación tiene mucho menos trabajo de limpieza que hacer.

La compensación: la estabilidad tiene un costo

Dicho esto, este rendimiento no es gratuito.

K2.6 es notablemente más lento que GLM 5.1, especialmente en términos de latencia del primer token. El retraso no es marginal; es aproximadamente un orden de magnitud mayor. En una sola interacción, esto podría ser tolerable. Pero en un sistema donde hay 23 agentes ejecutándose en paralelo, cada paso introduce una pequeña pausa, y esas pausas se acumulan.

Parte de esto proviene de su arquitectura. K2.6 utiliza un diseño de Mezcla de Expertos (MoE), con cerca de 1 billón de parámetros totales y 32 mil millones activados por inferencia. Esa escala aporta capacidad, pero también sobrecarga de programación. Y dado que esta sigue siendo una versión preliminar, es probable que la optimización de la inferencia aún no se haya llevado al máximo.

Por lo tanto, la compensación queda clara:

- Si te importa el rendimiento y la velocidad, esto importa.

- Si te importa la estabilidad y las salidas estructuradas a escala, puede valer la pena.

OpenCode × K2.6 — De una instrucción a nueve flujos de trabajo paralelos

Si el experimento de Claude Code muestra cómo se comporta K2.6 bajo presión, OpenCode revela algo más: cómo organiza el trabajo.

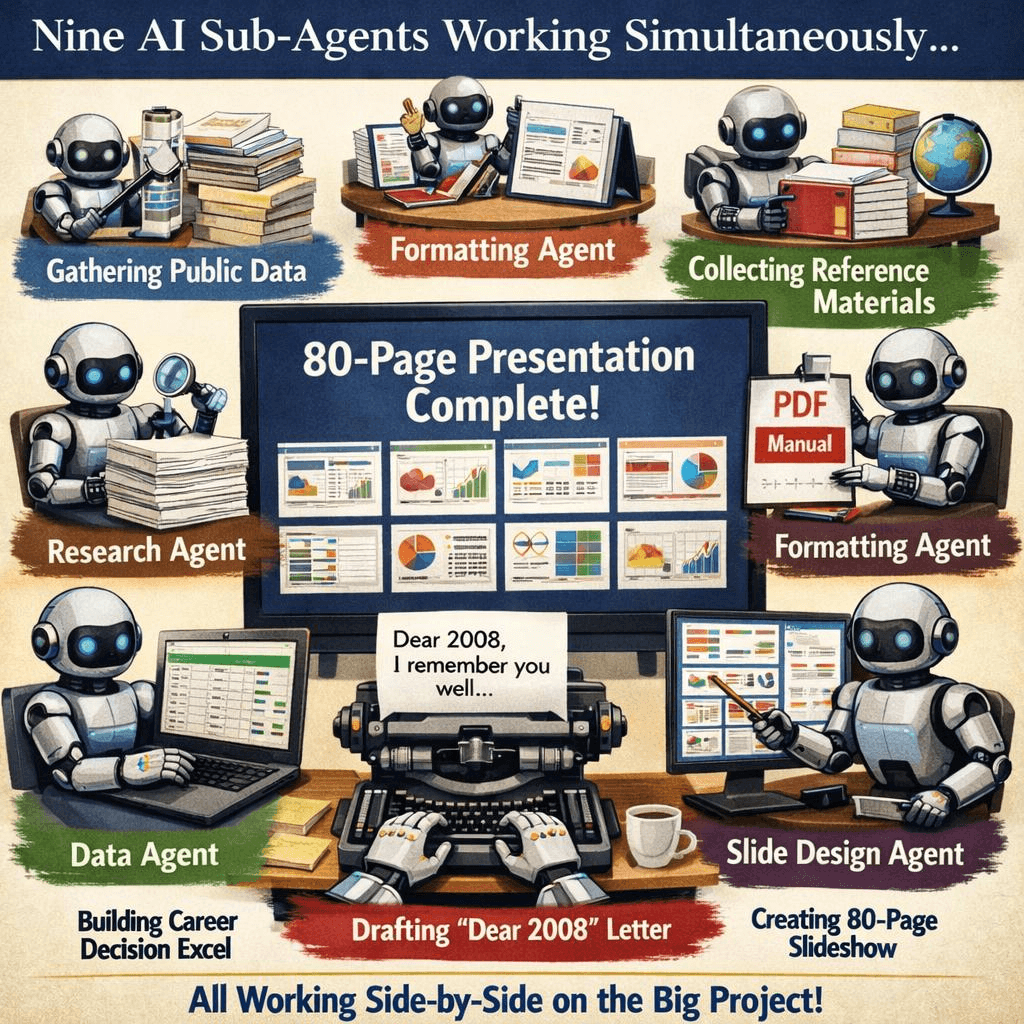

K2.6 introduce una capa de coordinación llamada AgentSwarm, donde un único agente "Coordinador" puede generar docenas de subagentes especializados, cada uno asignado a un rol específico. En lugar de manejar una tarea paso a paso en un solo hilo, el sistema la descompone y ejecuta múltiples procesos en paralelo.

Para ver cómo se ve esto en la práctica, considera este ejemplo.

Un investigador le pidió a K2.6 que produjera un perfil profundo de Dario Amodei, rastreando su trayectoria desde un doctorado en física en Princeton hasta la fundación de Anthropic. En lugar de abordar esto como una tarea de generación única y extensa, K2.6 la descompuso en nueve pistas paralelas.

Cada pista tenía una responsabilidad distinta. Un agente se centró puramente en la investigación, recopilando información pública. Otro manejó el diseño, formateando el material en un PDF estructurado. Un agente separado construyó un conjunto de datos de puntos clave de decisión profesional. Mientras tanto, un agente de escritura produjo una narrativa en primera persona titulada "Querido 2008".

Todo esto se ejecutó al mismo tiempo.

El resultado no fue solo una salida única, sino un paquete coordinado: una presentación de diapositivas de 80 páginas, respaldada por datos estructurados y documentos formateados. Lo que normalmente requeriría múltiples herramientas, sesiones y ensamblaje manual se produjo como un entregable unificado.

Por qué esto cambia la forma en que usas la IA

El facilitador clave aquí es el sistema de Habilidades (Skills).

En lugar de tratar cada tarea como una instrucción nueva, K2.6 te permite cargar conocimiento estructurado —como un informe de Goldman Sachs, un análisis de la competencia o una especificación de producto bien redactada— y convertirlo en una "Habilidad" reutilizable. Cuando se ejecuta un subagente, este hereda ese marco: el estilo analítico, el tono, incluso la estructura.

Con el tiempo, esto convierte tu sistema en algo muy diferente a un flujo de trabajo basado en instrucciones.

Se convierte en una tubería de producción repetible.

Y eso conduce a un cambio en cómo piensas sobre el uso de la IA:

Ya no estás dando instrucciones a un modelo, estás gestionando un equipo.

Si estás construyendo flujos de trabajo basados en agentes, esa diferencia es difícil de ignorar.

Las cuatro herramientas se conectan a través de

1https://api.atlascloud.ai/v11moonshot/kimi-k2.6Preguntas Frecuentes

-

¿Cuál es la diferencia entre usar Hermes Agent y llamar a la API de Kimi K2.6 directamente?

La diferencia fundamental reside en la ejecución frente a la respuesta.

Cuando llamas a la API de Kimi K2.6 directamente, esencialmente obtienes una única respuesta por solicitud. Incluso para tareas complejas, todavía necesitas desglosarlas manualmente, iterar a través de múltiples instrucciones y combinar las salidas tú mismo. Esto funciona bien para casos de uso simples o interactivos, pero rápidamente se vuelve ineficiente para flujos de trabajo estructurados.

Hermes cambia esto al introducir la orquestación de flujos de trabajo. En lugar de una sola instrucción, defines una tubería con múltiples pasos —investigación, planificación, ejecución, etc.— y Hermes asigna cada paso a un agente. Estos agentes pueden pasarse resultados entre sí, validar salidas intermedias e incluso reintentar pasos cuando algo sale mal.

En la práctica, esto significa que pasas de la "ingeniería de instrucciones" (prompt engineering) a la orquestación de tareas. La API se convierte en un componente dentro de un sistema, en lugar de ser el sistema en sí mismo.

-

¿Es Kimi K2.6 bueno para flujos de trabajo multi-agente y automatización?

Sí, aquí es donde funciona notablemente bien.

En configuraciones multi-agente, los mayores desafíos suelen ser:

- coherencia entre pasos

- estabilidad durante ejecuciones largas

- capacidad de seguir tareas estructuradas

Kimi K2.6 muestra un rendimiento sólido en las tres áreas. Cuando se usa dentro de Hermes, puede mantener salidas estructuradas a través de múltiples etapas y manejar cadenas de tareas complejas sin romper el formato ni perder la dirección.

Otro aspecto importante es la autocorrección. Si un resultado intermedio se desvía del objetivo, el sistema puede regenerar ese paso en lugar de continuar con datos erróneos. Esto lo hace mucho más adecuado para escenarios de automatización donde no deseas supervisar manualmente cada paso.

En general, se siente más cerca de una capa de ejecución fiable que de un simple generador de texto.

-

¿Por qué Kimi K2.6 es más lento en flujos de trabajo de agentes en comparación con otros modelos?

La velocidad más lenta se debe principalmente a cómo se está utilizando, no solo al modelo en sí.

En un escenario de chat estándar, solo esperas una respuesta. En un flujo de trabajo de agentes, una sola tarea puede involucrar múltiples pasos, cada uno de los cuales requiere una llamada de modelo por separado, además de la sobrecarga de coordinación entre agentes. Esto introduce latencia de forma natural en cada etapa.

Además, Kimi K2.6 está diseñado con una arquitectura más compleja (por ejemplo, enrutamiento tipo MoE), lo que puede aumentar la sobrecarga de inferencia en comparación con modelos más pequeños o más optimizados. Cuando se combina con la orquestación multi-agente, el retraso se vuelve más notable.

Sin embargo, la compensación es que cada paso produce salidas de mayor calidad y más estructuradas, lo que reduce la necesidad de reintentos o correcciones manuales. Por lo tanto, aunque es más lento en tiempo de respuesta bruto, puede ser más eficiente a nivel de flujo de trabajo.